Andersons vinkel

Bruk av AI til å simulere filmkorn

Make America Grainy Again: et nytt AI-verktøy kan fjerne filmkorn fra gamle opptak, komprimere videoen til en brøkdel av størrelsen, og så legge kornet tilbake så seerne ikke merker noe. Det fungerer med eksisterende video-standarder og reduserer båndbredde med opptil 90 prosent, samtidig som det beholder den vintage-looken.

For mange av oss som ser på filmer eller gamle TV-serier, er ‘suset’ av filmkorn en trøst; selv når vi ikke bevisst registrerer det, forteller kornet oss at det vi ser på ble laget med kjemikalier, ikke kode, og binder opplevelsen til den fysiske verden: til valg av film, eksponering, laboratorieprosesser og gamle epoker:

Hollywoods tilnærming til korn har skiftet sammen med endringer i kultur og produksjonsmetoder. På 1960-tallet bidro utviklingen av kamerafilm og fotografiske praksiser til åretets distinkte visuelle identitet. Senere begynte regissører som arbeidet i digitalt å gjeninnføre korn med vilje. I midten av 1980-årene valgte regissør James Cameron en spesielt grov Kodak-film for Aliens (1986, nederst til høyre i bildet over), sannsynligvis for å forbedre atmosfæren og også hjelpe til å skjule ledninger fra praktisk VFX-miniatyrarbeid. Kilde: https://archive.is/3ZSjN (min eget siste artikkel om dette emnet)

Analog tekstur kommer fra en tid da produksjon av media kostet ekte penger, tilgang var begrenset, og det var minst en løs forestilling om at bare de mest kapable eller bestemte kunne komme gjennom, fungerer som en forkortelse for realisme og troverdighet – og, når høyoppløselig innspillings-teknologi eliminerte det, nostalgi.

Christopher Nolan byttet aldri. Mens mesteparten av industrien tok i bruk digitalt for sin hastighet og fleksibilitet, insisterte den anerkjente regissøren på celluloid som både en disiplin og en estetikk.

Denis Villeneuve, som arbeidet rett innenfor digitale rørledninger, parser fortsatt sine opptak gjennom foto-kjemiske prosesser. For Dune-filmene, som ble spilt inn digitalt, ble opptakene trykt på film og deretter scannet tilbake til digitalt, utelukkende for atmosfære og effekt.

Falskt korn

Aficionadoer av film- og TV-kvalitet assosierer synlig korn med høyoppløselig, der bitraten (mengden data som presses inn i hver ramme) er så høy at selv de minste detaljene, som halidkorn, blir bevart.

Men hvis strømmingtjenester virkelig gjorde denne type bitrate tilgjengelig, ville det føre til alvorlige belastninger på nettverkskapasiteten, og sannsynligvis forårsake buffring og stuttering. Derfor lager plattformer som Netflix optimerte AV1-versjoner av innholdet og bruker AV1-kodekens muligheter til å legge til korn til filmen eller episoden på en intelligent og passende måte, sparing 30% av båndbredde i prosessen.

AV1 er designet for å inkorporere kunstig filmkorn, som i disse eksemplene. Kilde: https://waveletbeam.com/index.php/av1-film-grain-synthesis

‘Korn-fetisjen’ er en relativt sjelden digital ekvivalent til ataviske trender som vinyl-gjenoppblomstringen, og det er vanskelig å si om det brukes av strømmingtjenester for å gjøre høyt optimert video å se ut som virkelig dyrt ‘råvideo’ (for seere som har underbevisst assosiert disse karakteristikkene), eller for å avlede den percipielle kvalitetsnedgangen som gamle 4:3-serier ellers ville ta når strømmingtjenester beskjærer dem til widescreen-aspektforhold; eller bare for å tilpasse seg den retro ‘Nolan-estetikk’ generelt.

Korn-silo

Problemet er at korn også er støy. Digitale systemer hater støy, og strømmingkodeker som AV1 fjerner støy for å spare båndbredde, med mindre korninnstillinger er eksplisitt konfigurert. Liksom AI-oppgraderinger som Topaz Gigapixel-serien behandler korn som en feil som skal korrigeres.

I feltet diffusjonsbasert bilde-syntese er korn ekstremt utfordrende å generere, siden det representerer ekstrem detalj, og derfor ville vanligvis bare dukke opp i massivt overfittede modeller, fordi hele den latente diffusjonsmodell (LDM)-arkitekturen er designet for å dekonstruere støy (som korn) til klart bilde, snarere enn å behandle kornflekker som implisitte egenskaper i media.

Derfor kan det være utfordrende å skape overbevisende korn med maskinlæring. Og selv om en kunne gjøre det, ville å rendre det rett tilbake til en optimert video bare å øke videoens filstørrelse tilbake opp.

På grunn av denne logistiske overvegelsen, tilbyr state-of-the-art video-kodeker som Versatile Video Coding (VVC) korn som en slags ‘sidecar’-tjeneste.

VVC komprimerer den rene, avstøyde videoen og kasserer kornet. I stedet for å sløse bort data på å prøve å bevare tilfeldige høyfrekvente kornmønster, analyserer det kornet separat og koder en liten mengde parametre (f.eks. amplitude, frekvens og blandingmodus) som beskriver hvordan å regenerere lignende korn under avspilling.

Disse parameterne lagres i en FGC-SEI (Film Grain Characteristics Supplemental Enhancement Information) strøm, som følger med hovedbit-strømmen. Etter avkoding, bruker en syntese-modul disse instruksjonene til å gjenapplikere syntetisk korn som etterligner det originale.

Dette bevarer ‘utseendet’ til høy-bitrate, korn-rikt emulsjon, samtidig som det faktiske bitrate holdes lavt, siden koderen ikke er tvunget til å bruke ressurser på å bevare uforutsigbare støy.

I tillegg, som med diskrete undertekstfiler, er dette falske ‘korn’-innholdet spesifikt for videoen i question; å tilfeldig aplikere generiske kornfilter i plattformer som Photoshop eller After Effects, eller i automatiserte prosesseringsrørledninger, ville ikke resultere i ’tilpasset’ korn, men i stedet en uavhengig overlagring av støy:

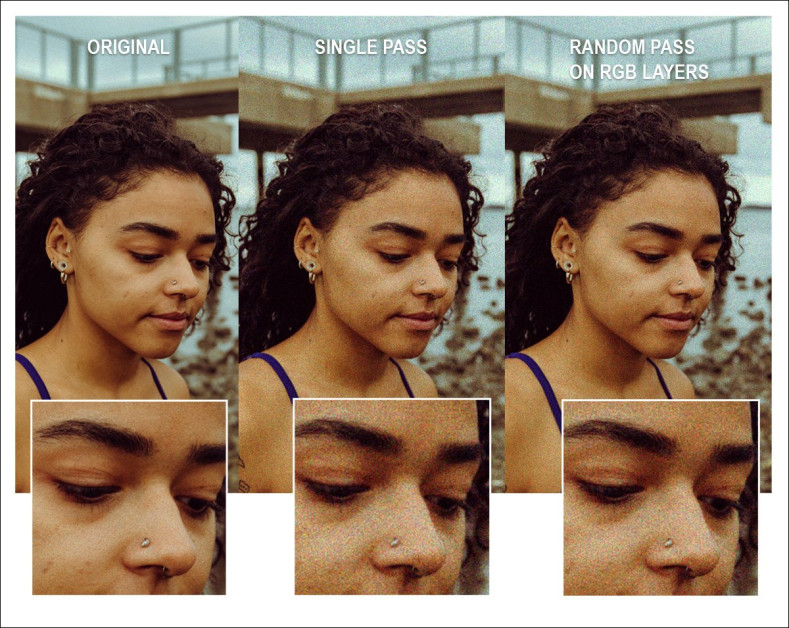

Venstre: originalbilde. Midten: Photoshop Camera Raw Grain aplikert jevnt over alle kanaler. Høyre: samme Grain-filter aplikert individuelt til hver kanal i sekvens. Kildebilde (CC0): https://stocksnap.io/photo/woman-beach-FJCOO6JWDP (via min eget tidligere artikkel)

Photoshops ‘Grain’-filter legger til uniformt tilfeldig støy; men ekte filmkorn kommer fra halidkristaller av varierende størrelser. Å aplikere filteret til hver kanal separat (se bildet over) skaper bare mer kaos, ikke realisme. Ekte filmkorn reflekterer hvordan lys treffer lagdelte emulsjoner ved eksponeringsøyeblikket. Å simulere det ville kreve å estimere hvordan forskjellige områder av et bilde ville ha aktivert hver halidlag, ikke bare å dele effekten over RGB-kanaler.

FGA-NN

Inn i denne tvilsomme forfølgelse kommer en ny forskningsartikkel fra Frankrike – en kort, men interessant utflukt som tilbyr en kvantitativt og kvalitativt overlegen metode for å analysere og gjenskape korn:

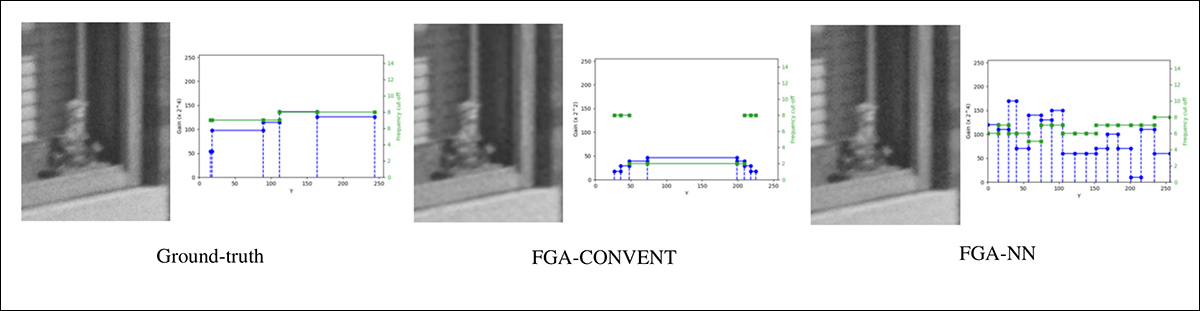

Sammenligning mellom grunn-sannhet-korn og resultater fra ulike analyse- og syntese-metoder. Kilde: https://arxiv.org/pdf/2506.14350

Det nye systemet, tittelen FGA-NN, avviker ikke fra den konvensjonelle bruken av konvensjonell Gaussian-basert korn-syntese gjennom den standard VVC-kompatible metoden, Versatile Film Grain Synthesis (VFGS). Hva systemet endrer er analysen, ved å bruke en neural nettverk til å estimere syntese-parameterne mer nøyaktig

Derfor er det endelige kornet fortsatt syntetisert ved hjelp av samme konvensjonelle Gaussian-modell – men nettverket matet bedre metadata inn i en standard, regel-basert generator, og oppnår en state-of-the-art-modell.

Den nye artikkelen er tittelen FGA-NN: Film Grain Analysis Neural Network, og kommer fra tre forskere ved InterDigital R&D, Cesson-Sévigné. Selv om artikkelen ikke er lang, la oss se på noen av de viktigste aspektene ved de fremstegene den nye metoden tilbyr.

Metode

For å gjenta: FGA-NN-systemet tar et kornete video som inndata og trekker ut en kompakt beskrivelse av kornet, og utgangsparametre i den standardiserte FGC-SEI-formatet som brukes av diverse moderne kodeker. Disse parameterne overføres sammen med videoen, og tillater avkoderen å gjenopprette kornet ved hjelp av VFGS, i stedet for å kode kornet direkte.

Skjema for å analysere og gjenapplikere filmkorn i video-distribusjon, ved å bruke FGA-NN for parameter-ekstraksjon og VFGS for syntese.

For å trene nettverket, trengte forfatterne par av kornete videoer og tilhørende FGC-SEI-metadata. Ettersom de fleste kornete opptak mangler denne type metadata, skapte forskerne sin egen datasett ved å generere FGC-SEI-parametre, aplikere syntetisk korn til rene videoer, og bruke disse som treningseksempler.

Treningdata for FGA-NN ble skapt ved å aplikere syntetisk korn til rene opptak fra BVI-DVC– og DIV2K-datasettene. Tilfeldige FGC-SEI-parametre ble generert og brukt med VFGS-syntese-verktøyet, og hver kornete video kunne parets med kjent metadata.

Den frekvensbaserte modellen som støttes av gjeldende video-standarder, ble brukt, med parameter-områder begrenset for å opprettholde visuell plausibilitet over luma- og chroma-kanaler.

Treningdata for den nye samlingen ble skapt ved å aplikere syntetisk korn til rene opptak fra BVI-DVC– og DIV2K-datasettene. Tilfeldige FGC-SEI-parametre ble generert og brukt med Versatile Film Grain Synthesis (VFGS)-verktøyet, og hver kornete video kunne parets med kjent metadata.

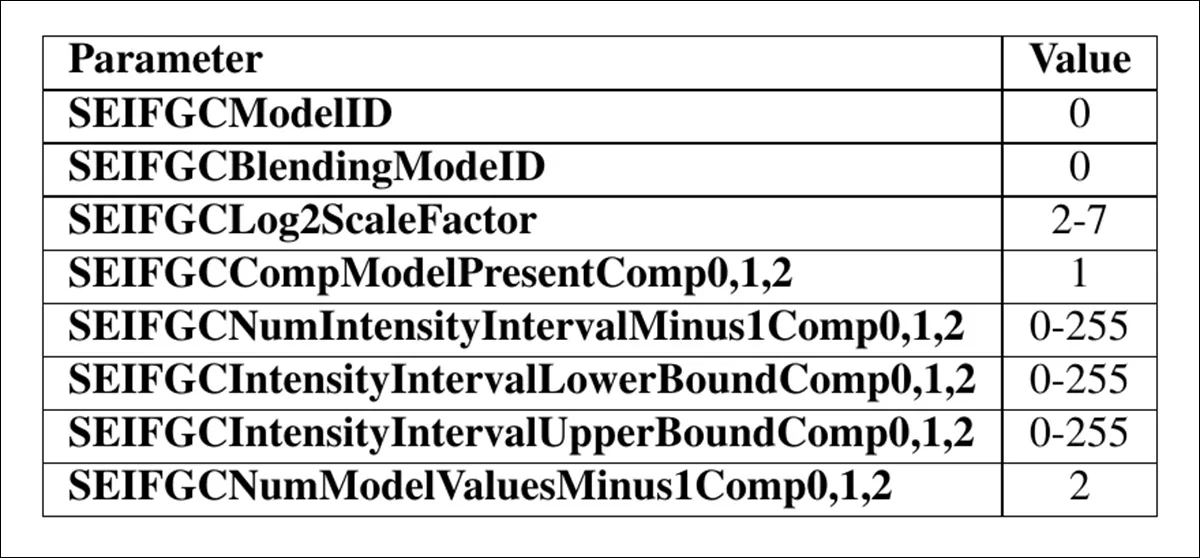

Oversikt over tilfeldige FGC-SEI-parameter-områder brukt for å generere syntetisk korn for trening, aplikert til rene opptak fra BVI-DVC- og DIV2K-datasettene. Parametre ble begrenset for å sikre visuelt plausibelt resultat over både luma- og chroma-kanaler.

Frekvensfiltreringsmodellen, den eneste syntese-metoden som for tiden støttes i kodek- implementasjoner som VVC Test Model (VTM), ble brukt gjennom hele prosessen. Parameter-områder ble begrenset for å opprettholde visuell plausibilitet over både luma- og chroma-kanaler.

Nettverkseffekt

FGA-NN har to koordinerte modeller, for luma og chroma, hver designet for å forutsi de spesifikke parameterne som trengs for å gjenskape realistisk filmkorn.

For hver inndata-bilde, estimerer systemet en mengde intensitets-intervaller, skaleringsfaktorene koblet til hvert intervall, de horisontale og vertikale cut-off-frekvensene, og en generell skaleringsjustering kjent som Log2Scale-faktoren. For å håndtere dette, bruker modellen en felles funksjons-ekstraktor som prosesserer det kornete inndata og matet inn i fire separate utgangs-grener, hver ansvarlig for en annen forutsigelse-oppgave:

Arkitektur for luma-versjonen av FGA-NN. En felles ryggsekk trekker ut funksjoner fra kornete inndata-rammer, etterfulgt av fire utgangs-grener tilpasset spesifikke parameter-forutsigelse-oppgaver: intervall-grenser, skaleringsfaktorer, cut-off-frekvenser og global Log2Scale. Chroma-nettverket bruker samme struktur med justerte inndata- og utgangs-dimensjoner.

Intervall-grensene forutsies ved hjelp av regresjon, mens skaleringsfaktorer, cut-off-frekvenser og den globale skaleringsjusteringen behandles som klassifiserings-problemer.

Arkitekturen er justert for å reflektere kompleksiteten til hver oppgave, med større interne lag brukt for mer fin-grådige forutsigelser; spesifikt, chroma-modellen speiler luma-strukturen, men tilpasser seg de forskjellige egenskapene til farge-data.

Trening og tester

FGA-NN ble trent ved hjelp av fire objektive funksjoner, hver av dem tilpasset en av dens forutsigelse-oppgaver. For klassifiserings-utgangene ble en kategorisk cross-entropy-tap brukt for å redusere gapet mellom forutsagte etiketter og grunn-sannhet.

Intervall-grensene ble normalisert til et 0-til-1-område og optimert ved hjelp av en kombinerings-tap: en eksponentielt skalert L1 tap (expL1) som straffet større feil mer kraftig, og en monotonicity-straff som avskrekket nedadgående trender. Alle fire tapene ble kombinert, med høye vekter tildelt cut-off og skaleringsfaktorer, mens intervall-grensene og Log2Scale ble vektert på 1 og 0,1.

Trening ble utført under Adam-optimatoren, med en læringshastighet på 5e-4, over 10 000 iterasjoner, med en batch-størrelse på 64.

Den eneste sammenlignbare verktøyet som var egnet for sammenlignende tester, var FGA-CONVENT, som også produserer verdier i FGC-SEI-formatet, og som brukes til korn-behandling. Begge systemene ble testet på UHD-sekvenser fra JVET-subjektive evalueringsettet, ved å bruke opptak som inneholdt ekte filmkorn.

Lodrette stiplete linjer indikerer intensitets-intervall-grensene, mens Log2Scale-forsterkningen er notert i akse-etiketten.

I bildet over ser vi identiske beskjæret rammer generert av VFGS ved hjelp av parametre fra hver metode, sammenlignet med originalen. Deres respektive luma-estimater er også plottet mot grunn-sannhet-verdier satt manuelt ved hjelp av VFGS, som her diagrammerer piksel-intensitet på X-aksen (0–255), skaleringsfaktorer på blå Y-akse (0–255), og cut-off-frekvenser på grønn Y-akse (2–14).

Forfatterne uttaler:

‘En kan observere at FGA-NN nøyaktig fanger den generelle trenden til grunn-sannhet filmkorn-mønster og amplitude, og resulterer i syntetiserte bilder med perseptuelt like filmkorn som de til grunn-sannheten.

‘På den andre siden, forutsier FGA-CONVENT en lavere skaleringsfaktor, kompensert av en tilsvarende lavere Log2Scale-faktor som et resultat av dens design, og har en tendens til å generere et grovere filmkorn-mønster enn referansen, og resulterer i et distinkt, men visuelt konsistent utseende.’

De noterer at direkte sammenligning med grunn-sannhet korn-parametre er uansvarlig, siden skalerings- og Log2Scale-faktorer kan kompensere for hverandre, og mindre feil ofte har liten visuell innvirkning.

Test av tro

Filmkorn troskap ble benchmarket over fire arbeidsflyter: FGA-NN med VFGS; FGA-CONVENT pluss VFGS; Style-FG; og 3R-INN. Tester brukte både FGC-SEI- og FilmGrainStyle740k-datasettene, sammenlignet utgang med grunn-sannhet ved hjelp av Lærte Perseptuelle Likhet-mål (LPIPS); JSD-NSS; og Kullback–Leibler (KL)-divergens.

Benchmark-resultater på FilmGrainStyle740k-datasettet. Style-FG og 3R-INN overgår andre på grunn av at de er trent på denne mengden, med FGA-NN som følger tett etter. FGA-CONVENT underpresterer, og reflekterer sin avhengighet av fler-ramme-analyse og homogene regioner – betingelser som ikke er møtt av de små, tekstur-rike inndataene som brukes i dette tilfelle.

Av disse resultater, uttaler forfatterne:

‘På FilmGrainStyle740k-testsettet, oppnår Style-FG og 3R-INN de beste resultater, ettersom disse metodene ble spesifikt trent på denne mengden, med FGA-NN som følger tett etter. FGA-CONVENTs ytelse kombinerer med VFGS er underoptimal på begge testsettene.

‘Dette skyldes bare det faktum at analysen avhenger av homogene regioner og utnytter informasjon fra flere rammer i en virkelig filmkorn-analyse-bruksfall, mens i denne evalueringen analysen får en enkelt lav-oppløselig bilde (256×256 til en maksimum på 768×512), som ofte inneholder betydelig tekstur.

‘Dette vanskeliggjør utfordringen for konvensjonell analyse-metode, og gjør det umulig å bruke FGA-CONVENT på slike små bilder.’

Til slutt noterer forfatterne at selv om læring-baserte metoder som 3R-INN og Style-FG produserer sterke visuelle resultater på kurerte datasett, gjør deres høye beregningskostnad dem upassende for distribusjon på sluttbruker-enheter.

Sammenligning av lav-bitrate-rammer forbedret med ulike analyse- og syntese-arbeidsflyter (tredje til siste kolonner).

I motsetning til dette, parer den nye artikkelen den lettvinte FGA-NN-analyse-modulen med den håndteringseffektive VFGS-syntese-metoden, som forfatterne beskriver som en mer levedyktig og distribuerbar løsning for å gjeninnføre filmkorn i komprimert video.

De uttaler videre at fordelen med FGA-NN er potensielt betydelig, i skala:

‘[Koding] UHD-videoer med filmkorn ved medium til lav bitrate ved hjelp av vår filmkorn-analyse- og syntese-arbeidsflyt, muliggjør bitrate-besparelser på opptil 90% sammenlignet med høy-bitrate-koding.’

Konklusjon

Obsesjonen med filmkorn er en av de merkelige og mest kuriose konseptene i den post-analoge alderen, og det er interessant å notere at det som en gang ble betraktet som en begrensning av mediumet, nå har blitt et symbol på autentisitet og realisme i seg selv, selv (kanskje underbevisst) for en ny generasjon av seere født etter den effektive nedgangen til emulsjon.

Det bør noteres at ingen av state-of-the-art korn-gjenskapings-metodene, inkludert denne nye innovasjonen, kan nøyaktig fange den sanne effekten av måten lys påvirker lagdelte halider i en ekte foto-kjemisk prosess, over en rekke betingelser.

Først publisert onsdag, 18. juni 2025