Andersons vinkel

Bruk av AI for å forbedre ekte fotos før de tas

I stedet for å bruke GenAI til å fikse fotos etter du har tatt dem, har forskere trent et system som forteller deg hvordan du skal bevege deg, posere og ramme inn bildet på forhånd, ved hjelp av studert kunnskap om hva som gjør bilder minneverdige.

Å fikse fotos etterpå har blitt enklere i lang tid, ettersom produsenter og teknologiplattformer stadig oftere tilbyr redigering i kameraet som lar brukerne endre bildene så snart de har tatt dem. Populære systemer av denne typen inkluderer Google’s konversasjonsredigering, og Samsung’s generative redigering, blant andre.

Men en ny trend som favoriserer ‘autentisitet’ over AI-forbedrede resultater, kan bety at mange av forbrukerne som slike systemer er rettet mot, begynner å regarde ‘endrede’ fotos som AI-slop.

Kanskje dette er hva som inspirerte Google til å lage en AI-trening ‘kamera-trener’ informert av Gemini, som er i stand til å gi direkte instruksjoner for å forbedre et bilde under prosessen med å ta det:

Google’s Camera Coach forteller brukeren hvordan de skal ramme inn et bilde, samt andre grundleggende råd. Kilde

Som et proprietært system, og med praktisk talt ingen informasjon tilgjengelig på nett i forhold til det, ser Camera Coach ut til å utnytte Gemini for å hjelpe brukerne med å forbedre rammingen (se bildet ovenfor) eller å gjøre mindre endringer i holdning (slik som å bevege seg nærmere hverandre, eller å se direkte på kameraet).

Så langt som noen kan si, skyver produktet komposisjonen mot medianen, antageligvis basert på millioner av lastede innholdspunkter som sannsynligvis har bidratt til Gemini’s treningsdata. På denne måten har de lastede brukerne skapt AI’s kalibrering ved å avvise utilfredsstillende skudd og laste opp de de liker – en effektiv (og gratis) form for dataset-kurering!

Det er sagt, bilder som er utjevnede i termer av komposisjon, besitter ikke nødvendigvis de samme estetiske verdiene eller seer-impakten som bilder som er minneverdige.

Bortenfor ‘Ost!’ og tredjedelsregelen

Til dette formålet, og mot et system som er mer tilgjengelig på tvers av plattformer, tilbyr ny forskning fra Italia et Coach-liknende system som er basert på forhåndskunnskap om hva som gjør bilder minneverdige:

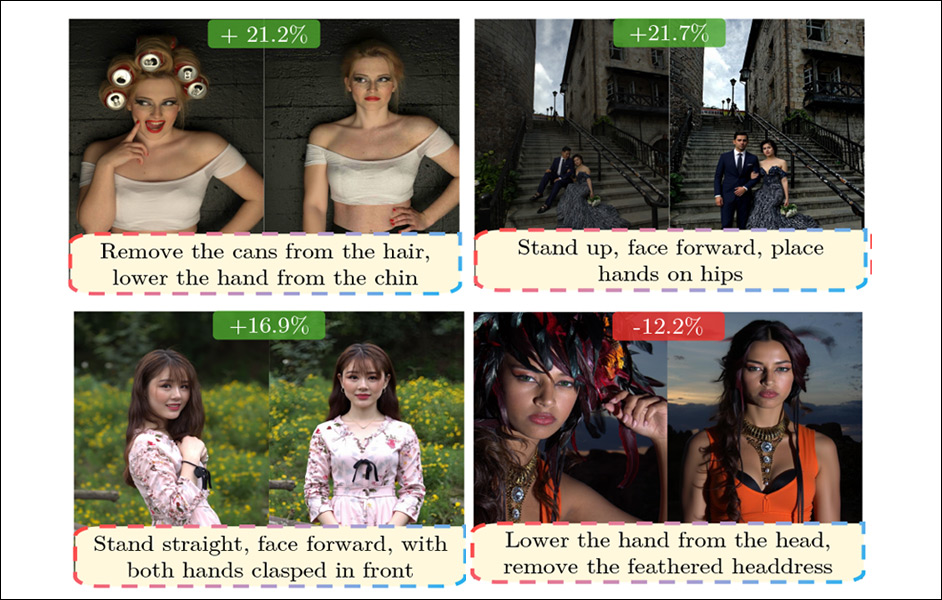

Langtrekkende eksempler på råd fra forfatternes nye system. Kilde

I eksemplene ovenfor, ser vi råd gitt av forfatternes nye system – kalt MemCoach – som det er vanskelig å forestille seg en komposisjons-sentrert AI som Camera Coach kunne gi. I det første (venstre) tilfelle, er rådet om å fjerne hodeplagget spesielt tvilsomt; i det andre bildet, er det vanskelig å forestille seg hva konvensjonell kontekst en komposisjons-basert AI kunne trekke fra den generelle scenariot (dvs. et ‘kunstnerisk’ bilde av en ung kvinne som ligger på gulvet med øynene lukket).

Kjerneforståelsen om minneverdighet i fotografi, brukt til å utvikle det tre-delte italienske systemet, er hentet fra ulike tidligere arbeider, inkludert 2015 outing Hva gjør et objekt minneverdig?, og 2013 paper Hva gjør et fotografi minneverdig?.

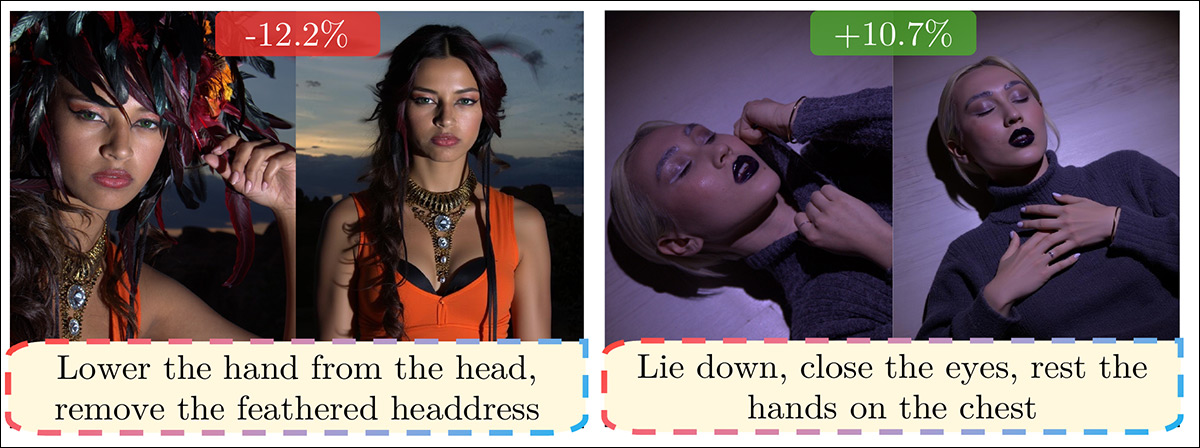

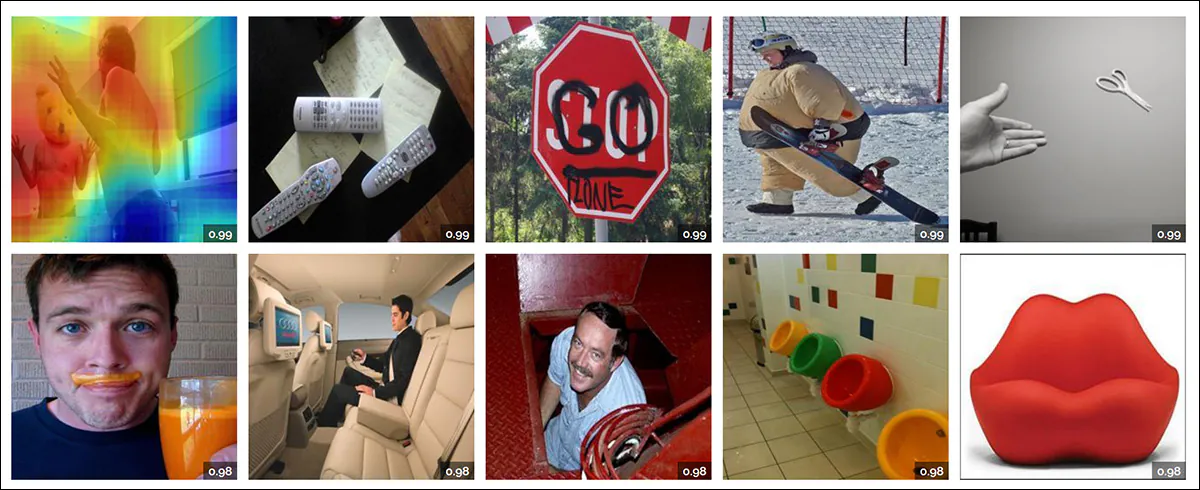

Fra 2013-papiret What makes a photograph memorable?, representative eksempler på gode, medium og dårlige fotos, i termer av minneverdighet. Kilde

Hvem som helst, som meg, med en negativ Unix-fødselsdato, vil sannsynligvis gjenkjenne malen for ‘minst minneverdige bilder’ (øverst til høyre i bildet ovenfor), fra de endeløse slide-nøttene som forheklet vår barndom. Som forfatterne sier*:

‘Disse arbeidene identifiserte nøkkelintrinsic faktorer som tilstedeværelse av mennesker, indoor-scener, eller emosjonelle uttrykk, snarere enn objekter og panoramautsikt, samt ekstrinsiske faktorer, inkludert kontekst og observatøren. ‘

Prosjektet sentrerer seg rundt ‘minneverdighets-tilbakemelding’ (MemFeed), som uttrykkes i MemCoach-tutor-applikasjonen, og en benchmark (tittel MemBench) basert på PPR10K-datasettet.

Fra papiret PPR10K: A Large-Scale Portrait Photo Retouching Dataset with Human-Region Mask and Group-Level Consistency, diverse eksempler fra datasettet. Øverste rad viser originale bilder, nederste rad viser ekspert-retusjerte versjoner sammen med tilhørende menneske-region masker. De originale bildene varierer mye i synsvinkel, bakgrunn, lys og kamera-innstillinger, mens de retusjerte resultater viser forbedret visuell kvalitet og sterkere konsistens innen hver gruppe. Kilde

Papiret observerer at minneverdighet er kvantifiserbar i bilder, snarere enn en registrering av subjektive vurderinger, og forfatterne merker videre at egenskapen har blitt identifisert både for bilder (i forskjellige arbeider) og videoer (i forskjellige andre).

Det nye papiret er tittel Hvordan ta et minneverdig bilde? Empowering brukere med handlebare tilbakemeldinger, og kommer fra fire forskere på Universitetet i Trento, Universitetet i Pisa og Fondazione Bruno Kessler. Den tilhørende prosjektsiden antyder at GitHub-kode og Hugging Face-vert data vil være tilgjengelig neste måned (mars 2026).

Metode

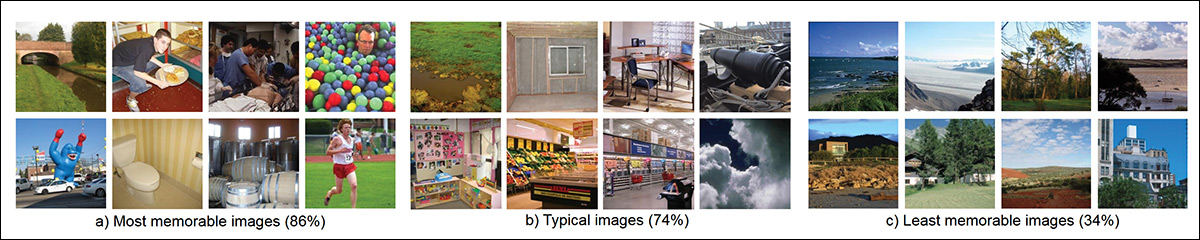

For å kurere MemBench-datasettet fra kilde-PPR10K-portrett-datasettet, grupperte forskerne bilder fra samme scene og scoret hver bilde for minneverdighet ved hjelp av en trent prediktor basert på CLIP funksjoner. De rangerte så bildene innen hver scene fra minst til mest minneverdig og parret dem deretter:

Oversikt over MemBench-konstruksjon og evaluering. Øverste rad viser data-pipeline, fra gruppering av bilder etter scene og prediksjon av minneverdighet, til rangering av bilder og generering av minneverdighets-tilbakemelding. Nederste rad viser evaluering, måling av tilbakemeldingskvalitet gjennom redigering-basert minneverdighets-gevinst og perplexitet-scoring.

For hver par, ble naturlige språk-beskrivelser generert med InternVL3.5-modellen for å forklare de synlige forskjellene mellom mindre minneverdig versjon og mer minneverdig versjon; og disse beskrivelsene ville utgjøre trenings-signalet for minneverdighets-tilbakemeldingssystemet.

I motsetning til den type logikk som ligger til grunn for Google’s Camera Coach, søkte forskerne en mer subtil mengde tolkninger†:

‘I motsetning til komputasjonsfotografiske justeringer som fokuserer på post-hoc-korreksjoner (f.eks. “gjør bildet lysere”), fokuserer vi på semantiske handlinger som en bruker kan utføre på fly for et bedre skudd, f.eks. “Vend dere mot hverandre”.’

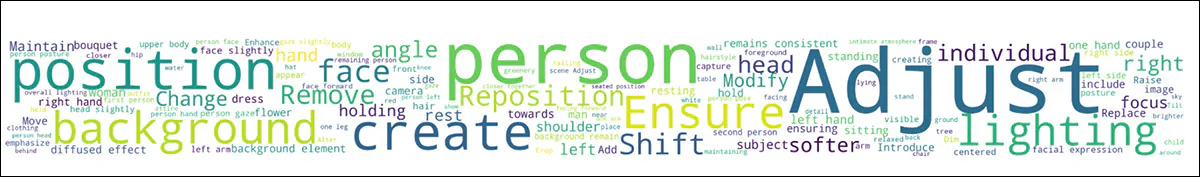

Den endelige MemBench-samlingen består av rundt 10 000 bilder gruppert i 1 570 scener, i gjennomsnitt 6,5 bilder per scene. Ord-skya forfatterne genererte (se bildet under), antyder en bred mengde semantiske kategorier i datasettet:

En ord-sky av de mest hyppige termene i MemBench.

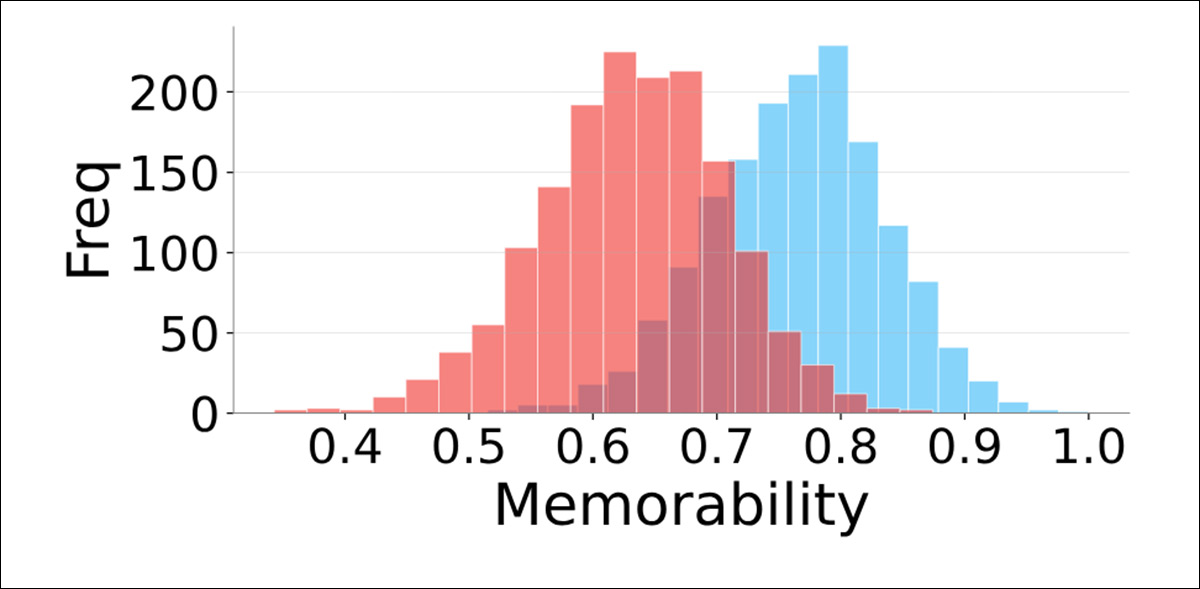

Kilde-bilder hadde en minneverdighets-score på 0,63, mens de mest minneverdige skuddene fra samme scene strakk seg fra 0,51 opp til 1,0, med merkbar overlapping mellom de to gruppene:

Minneverdighets-score-distribusjoner som sammenligner de minst og mest minneverdige bildene innen hver scene.

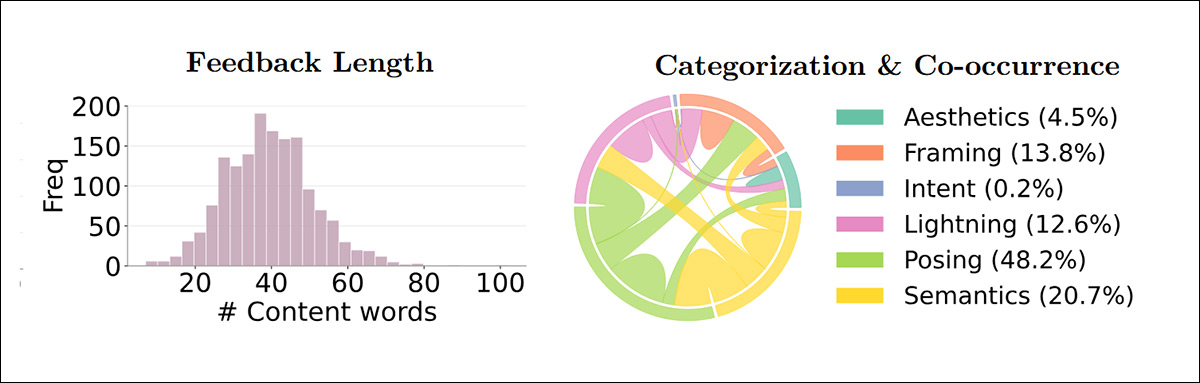

Tilbakemeldingen varierte fra korte 7-ords-notater til merket lengre instruksjoner (venstre, i bildet under). Hver del av råd ble deretter brutt ned i små handlingstyper ved hjelp av GPT-5 Mini (høyre, i bildet under):

Tilbakemeldingslengde-distribusjon målt i innhold-ord, og kategorisering av atomiske under-handlinger med akkord-bredden som indikerer sam-forekomst-hyppighet over kategorier.

Forfatterne merker at de fleste forslagene fokuserte på hvordan subjektet var posisjonert, fulgt av endringer i mening eller scene-innhold, med ramming ofte koblet til posisjonering, og lys-justeringer ofte knyttet til semantiske endringer.

Flux-kapasitoren

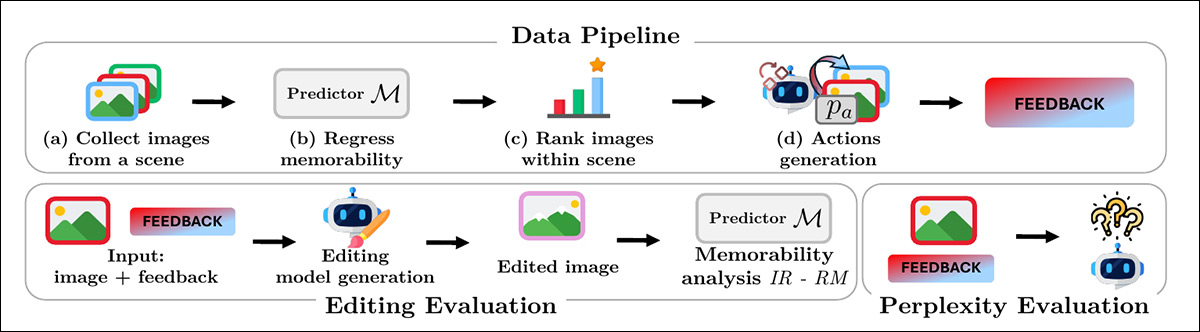

For å evaluere om minneverdighet økte ved tilbakemeldingen, ble bruker-etterlevelse simulert ved hjelp av FLUX.1 Kontext-generativ modell, som en proxy for fotografen. Gitt en kilde-bilde og en tekst-tilbakemelding, ble en redigert versjon generert av Flux som simulerte de foreslåtte endringene:

Bildene til venstre er ekte, fra datasettet, og bildene til høyre (i hver enkelt tilfelle) er skapt av Flux, basert på prompten (i gul, under). På denne måten kunne effektiviteten av promptene evaluere uten omfattende menneskelig involvering. Denne kunnskapen ville til slutt føre tilbake til MemCoach-rammeverket, og faktisk representere en arbeidsflyt som kunne iterativt forbedre et system av denne typen (dvs. til slutt med ekte verden-eksempler snarere enn Flux-eksempler).

Både det originale og det redigerte bildet ble deretter sendt gjennom en minneverdighets-prediktor, som muliggjorde måling av hvor ofte den redigerte versjonen oppnådde en høyere score – betegnet som Forbedrings-forhold – og hvor stor gevinsten var i forhold til start-bildet, betegnet som Relativ minneverdighet.

Lignende til minneverdighets-fokusert referanse-tilbakemelding ble også målt ved å beregne perplexitet mot bakgrunns-beskrivelsene, og en 80–20 split ble brukt på scenenivå så at testing kun ble utført på scener som ikke hadde blitt brukt under trening.

Tilstand av kunnskap

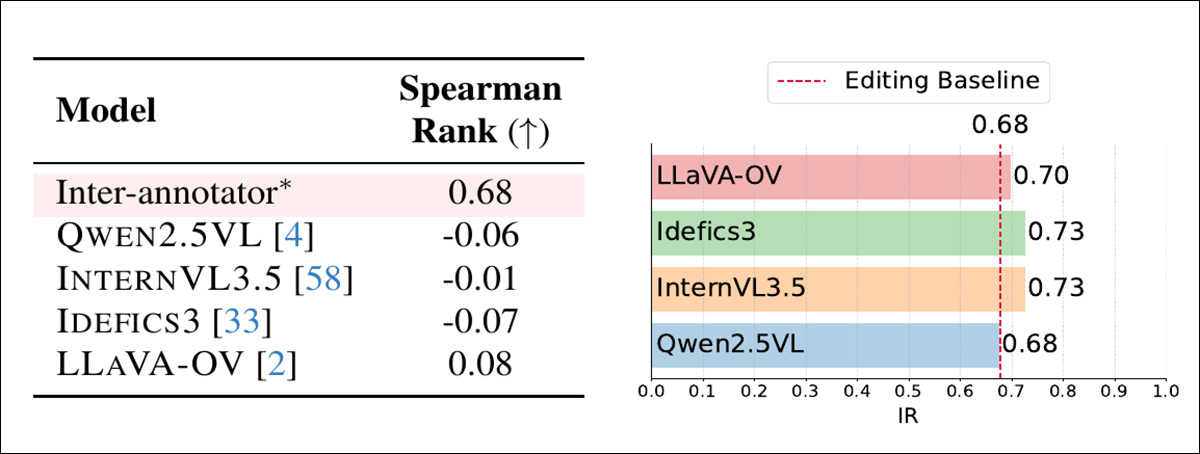

Minneverdighets-bevisstheten til nåværende multimodale store språk-modeller ble testet. Bilder fra LaMem-datasettet ble vist til flere ledende modeller, som ble bedt om å si om bildet var minneverdig. Modellens konfidens-estimat ble deretter sammenlignet med poengene tildelt av menneskelige seere i den opprinnelige studien:

Tester som indikerer at baseline multimodale modeller ikke fanger minneverdighet. Venstre, Spearman-rang-korrelasjon mellom modell-prediksjoner og LaMem-bakgrunns-poeng, med inter-annotator-enighet fra LaMem vist som referanse. Høyre, forbedrings-forhold oppnådd av null-skudd-tilbakemelding i forhold til redigering-basert baseline, viser bare marginale gevinst.

Nesten ingen meningsfull korrelasjon med menneskelige vurderinger ble funnet, og, til tross for stor-skala-pre-trening, hevder forfatterne at modellene ikke sporet hva mennesker konsekvent husker.

Eksempler fra LaMem-datasettet. Øverst til venstre, ser vi også en varme-kart avbildet for dette bildet. Kilde

MemCoach

MemCoach fokuserer på semantiske, på-fly-instruksjoner som kan utføres før skuddet tas – for eksempel, justering av posisjon, endring av interaksjoner mellom subjekter, eller modifisering av scene-elementer. Tilbakemeldingen gitt av MemCoach varierer fra 7 til 102 innhold-ord. Minneverdighet, papiret hevder, synes å være drevet mer av subjekt-konfigurasjon og narrative-koder enn av enkle komposisjonelle justeringer:

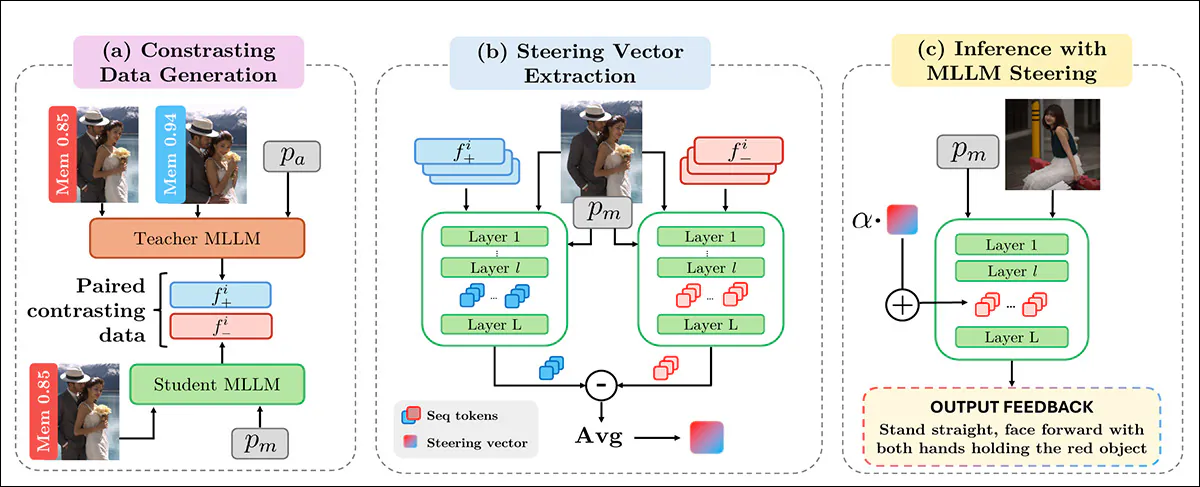

Oversikt over MemCoach-pipeline, hvor minneverdighets-tilbakemelding fra en lærer-MLLM er parret med nøytrale elev-respons for å danne kontrast-data; aktiverings-forskjeller over lag er gjennomsnittlig for å avlede en minneverdighets-styrings-vektor; og den vektoren injiseres under slutning for å skyve elev-aktiveringer mot å produsere forbedrede, minneverdighets-orienterte tilbakemeldinger, uten ekstra trening.

Tester

Syv multimodale store språk-modeller (MLLMs) ble brukt i testfasen for det nye systemet: Qwen2.5V.L; InternVL3_5-8B; Idefics3-8B; og LLaVA-OneVision-1.5. I tillegg ble GPT-5 Mini inkludert som en representant for proprietære, lukkede modeller, sammen med estetikk-spesialiserte Q-Instruct og AesExpert-modellene. MLLM-ene opererte ulikt som null-skudd-orakler og lærer-orakler.

InternVL3.5 ble brukt både for lærer- og elev-modellene, med MemBench-trening-delen brukt til å lage kontrast-eksempler:

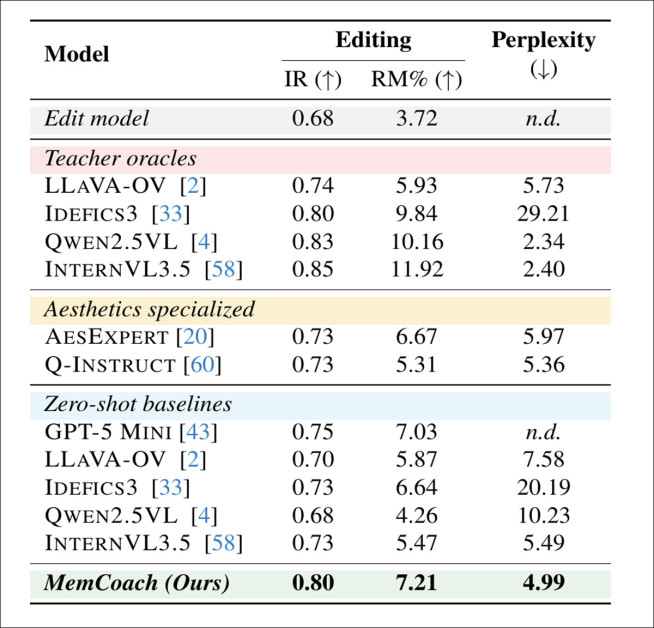

MemCoach-ytelse sammenlignet med state-of-the-art MLLMs over lærer-orakler, estetikk-spesialiserte modeller og null-skudd-baselinjer, viser høyere forbedrings-forhold og konkurrerende relativ minneverdighet sammen med den laveste perplexitet, indikerer mer konsistent og minneverdighets-orientert tilbakemelding.

I tabellen for den første testen (vist ovenfor), ser vi at MemCoach synes å levere mer effektive minneverdighets-råd enn noen av sammenlignings-modellene – og den styrte InternVL3.5-modellen øker minneverdighet oftere, og med en større gevinst, med en 5% forbedrings-forhold-gevinst over GPT-5 Mini, og en 31,81% hopp i relativ minneverdighet over sin ustyrte versjon.

Det overgår også estetikk-fokuserte systemer, til tross for å ikke kreve ekstra trening. Lavere perplexitet, papiret hevder, antyder videre at dens tilbakemelding følger de samme lingvistiske mønster som menneskelige minneverdighets-vurderinger tenderer å belønne:

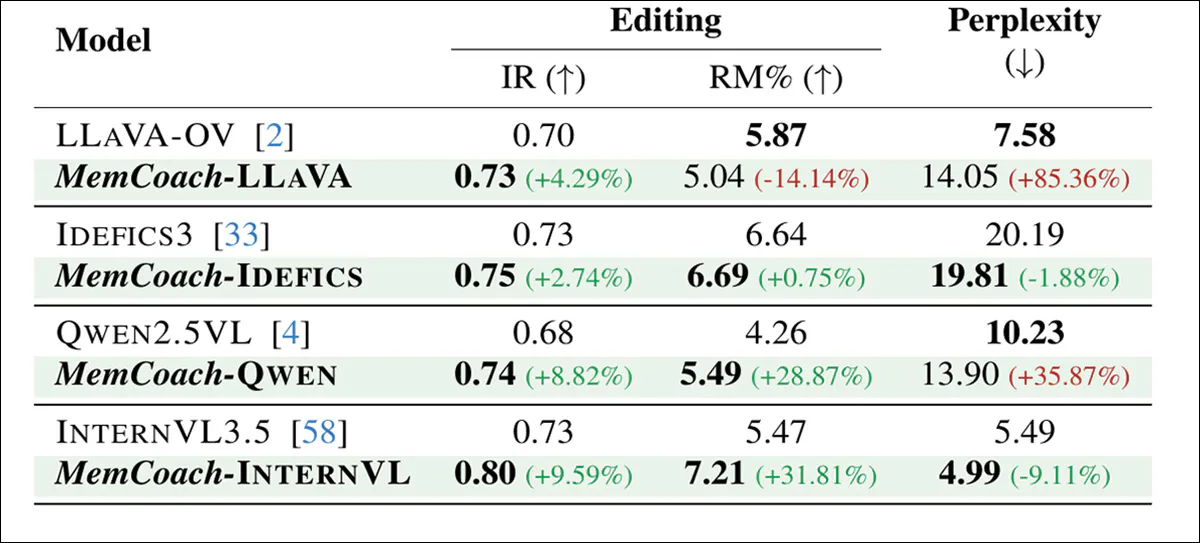

Generalisering-resultater som viser at MemCoach forbedrer minneverdighets-tilbakemelding over flere multimodale rygger, konsistent øker forbedrings-forhold og relativ minneverdighet, samt reduserer perplexitet for de fleste modellene.

En ytterligere test (se tabell ovenfor) indikerer at tilføyelse av MemCoach økte minneverdighets-tilbakemelding over hver enkelt testet multimodal rygg, med konsistente gevinst i forbedrings-forhold og den største hopp i relativ minneverdighet for Qwen2.5VL og LLaVA-OV.

En kvalitativ evaluering ble deretter utført, med analyse av eksempler på MemCoach-tilbakemelding hvor kilde-bildet, den naturlige språk-tilbakemeldingen og den imaginerte forbedrede resultatet ble undersøkt side-om-side:

Kvalitative eksempler på minneverdighets-tilbakemelding generert av MemCoach. Hver triplet viser kilde-bildet, den naturlige språk-instruksjonen og det resulterende redigerte bildet, med relativ minneverdighet (RM) som indikerer den målte endringen. Veiledningen varierer fra posisjons- og blikk-justeringer til semantiske inngrep som objektfjerning, illustrerende både vellykkede gevinst og tilfeller hvor fjerning av uvanlige elementer reduserer minneverdighet.

Av disse resultater, sier forfatterne:

‘Eksemplene fremhever variasjonen av forslag modellen foreslår, fra fine-grå komposisjonelle justeringer, som å endre blikk-retning, posisjon eller hånd-posisjon, til semantiske inngrep som objektfjerning eller ansikts-uttrykks-endring.

‘Tilbakemeldingen er naturlig tolkbar og handlebar, uttrykt i konsise tekst-instruksjoner (hovedsakelig inneholdende verb “Bring”, “Stå”, “Fjern”) som kan direkte implementeres, effektivt verbalisere hvordan man tar et minneverdig bilde.’

Konklusjon

Det ville være svært interessant å sammenligne metodologien til Google’s lukkede-boks-tilnærming med MemBench-prosjektet – ikke minst for å vite hva sentrale standarder, referanser og databaser Google brukte til å definere systemets estetiske standarder.

Den negative aspekten ved systemer av denne typen, åpne eller lukkede kilde, er at de på skala risikerer å tvinge frem uniforme standarder som er bestemt til å ende som memes og klisjeer – en slags visuell ekvivalent til AI-streken-debatter, hvor den ‘korrekte’ prosedyren har blitt noe forheklet i uformell bruk.

* Min konvertering av forfatternes inline-citater til hyperlenker, hvis lenken ikke er presentert andre steder i artikkelen.

† Papiret henviser her, som i flere andre steder, til ‘supplementær materiale’ som jeg ikke kan finne, hverken fra papiret, den grunnleggende Arxiv-listingen eller prosjektsiden.

Først publisert torsdag, 26. februar 2026