Andersons vinkel

Mindre Deepfakes Kan Være En Større Trussel

Conversasjons-AI-verktøy som ChatGPT og Google Gemini brukes nå til å lage deepfakes som ikke byter ansikter, men på mer subtile måter kan omskrive hele historien inni et bilde. Ved å endre gester, rekvisitter og bakgrunner, kan disse redigeringene lure både AI-detektorer og mennesker, og øke risikoen for å oppdage hva som er ekte på nettet.

I den nåværende klimaet, spesielt i kjølvannet av betydelige lovgivninger som TAKE IT DOWN-loven, assosierer mange av oss deepfakes og AI-drevet identitetssyntese med ikke-samtykkende AI-pornografi og politisk manipulasjon – generelt, grove forvrengninger av sannheten.

Dette vant oss til å forvente at AI-manipulerte bilder alltid skal være rettet mot høyrisiko-innhold, der kvaliteten på renderingen og manipuleringen av konteksten kan lykkes i å oppnå en troverdighetskupp, i det minste på kort sikt.

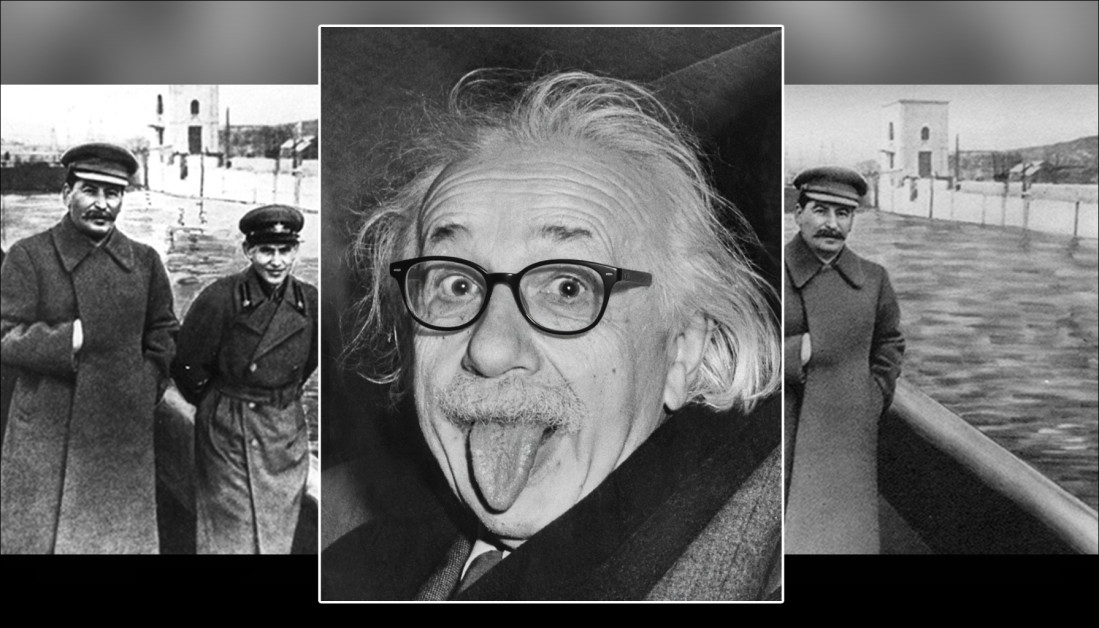

Historisk sett har imidlertid mye subtilere endringer ofte hatt en mer sinistertype og varig effekt – som den statens fototekniske trickery som tillot Stalin å fjernet de som hadde falt i unåde fra det fotografiske registret, som ble parodiert i George Orwells roman Nitten Åttifire, der hovedpersonen Winston Smith tilbringer sine dager med å omskrive historien og få bilder laget, ødelagt og ‘amendert’.

I følgende eksempel er problemet med det andre bildet at vi ‘ikke vet hva vi ikke vet’ – at den tidligere sjefen for Stalins hemmelige politi, Nikolai Yezhov, tidligere okkuperte plassen der nå bare er en sikkerhetsbarriere:

Nå ser du ham, nå er han…vapor. Stalin-æraens fotografiske manipulasjon fjerner en vanæret partimedlem fra historien. Kilde: Offentlig domene, via https://www.rferl.org/a/soviet-airbrushing-the-censors-who-scratched-out-history/29361426.html

Slike strømninger, ofte gjentatt, består på mange måter; ikke bare kulturelt, men i datavisjon selv, som tar ut treningsdata fra statistisk dominante temaer og motiv. For å gi et eksempel, det faktum at smarttelefoner har senket terskelen og massivt redusert kostnadene for fotografering, betyr at deres ikonografi har blitt uunngåelig assosiert med mange abstrakte konsepter, selv når dette ikke er passende.

Hvis konvensjonell deepfaking kan sees på som en handling av ‘angrep’, er skadelige og vedvarende mindre endringer i audiovisuelle medier mer lignende ‘gaslighting’. I tillegg gjør evnen til at denne type deepfaking kan gå ubemerket, det vanskelig å identifisere via statens deepfake-dettekteringssystemer (som søker etter grove endringer). Denne tilnærmingen er mer lignende vann som sliter ned en stein over en vedvarende periode, enn en stein kastet mot et hode.

MultiFakeVerse

Forskere fra Australia har lagt frem et forsøk på å møte mangelen på oppmerksomhet til ‘subtile’ deepfaking i litteraturen, ved å kuratere en betydelig ny datasett med person-sentrerte bilde-manipulasjoner som endrer kontekst, emosjon og narrativ uten å endre subjektets kjernidentitet:

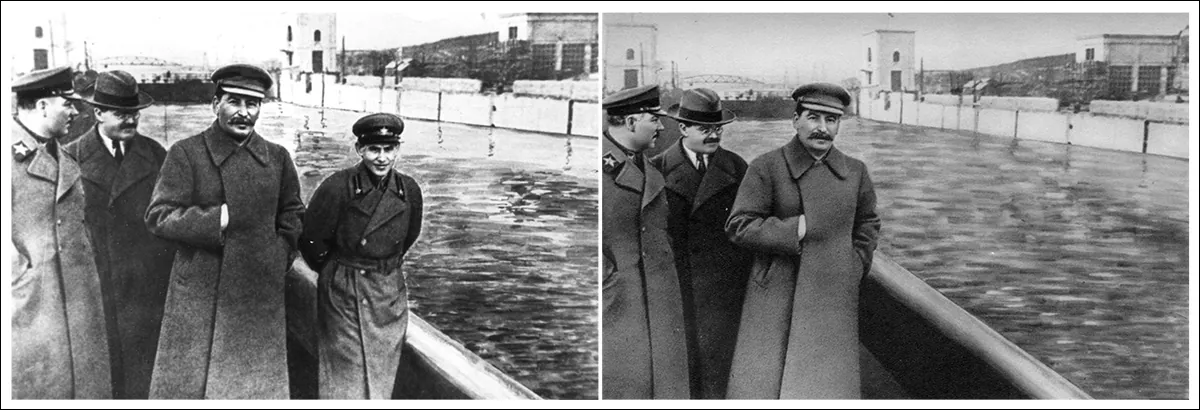

Eksempler fra den nye samlingen, ekte/falske par, med noen endringer mer subtile enn andre. Merk, for eksempel, tapet av autoritet for den asiatiske kvinnen, nederst til høyre, da hennes doktors stetoskop fjernes av AI. Samtidig har erstatningen av doktors blokk for klippbordet ingen åpenbar semantisk vinkel. Kilde: https://huggingface.co/datasets/parulgupta/MultiFakeVerse_preview

Tittelen MultiFakeVerse består av 845 826 bilder generert via visjon-språk-modeller (VLMs), som kan tilgås online og lastes ned, med tillatelse.