Kunstig intelligens

UniTune: Googles alternativ til neuralt bilde-redigeringsteknikk

Google Research ser ut til å angripe tekstbasert bilde-redigering fra flere kanter, og ventar antakelig å se hva som “fungerer”. like i kjølvannet av denne uken sin lansering av sin Imagic-papir, har søkegiganten foreslått en ytterligere latent diffusjonsbasert metode for å utføre ellers umulige AI-baserte redigeringer av bilder via tekstkommandoer, denne gangen kalt UniTune.

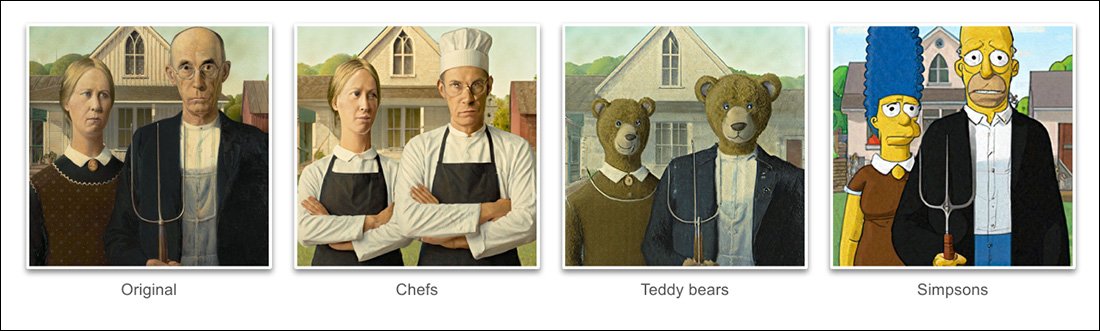

Basert på eksemplene gitt i prosjektets nye papir, har UniTune oppnådd en ekstraordinær grad av disentanglement av semantisk pose og ide fra faktisk hard bildeinnhold:

UniTune’s kommando over semantisk komposisjon er usedvanlig. Merk hvordan i den øverste raden av bilder, ansiktene til de two personene ikke er forvrengt av den ekstraordinære transformasjonen på resten av kildebildet (høyre). Kilde: https://arxiv.org/pdf/2210.09477.pdf

Som Stable Diffusion-tilhengere har lært nå, kan å anvende redigeringer på deler av et bilde uten å forringe resten av bildet være en vanskelig, noen ganger umulig operasjon. Selv om populære distribusjoner som AUTOMATIC1111 kan lage masker for lokale og begrensede redigeringer, er prosessen tøff og ofte uforutsigbar.

Den åpenbare løsningen, i alle fall for en datamaskin-vision-utøver, er å sette inn et lag av semantisk segmentering som kan gjenkjenne og isolere objekter i et bilde uten brukerintervensjon, og faktisk har det vært flere nye initiativer nylig langs denne tankegangen.

En annen mulighet for å låse ned uordentlige og sammenfiltrede neurale bilde-redigeringer er å utnytte OpenAI’s innflytelsesrike Contrastive Language–Image Pre-training (CLIP)-modul, som er i hjertet av latente diffusjonsmodeller som DALL-E 2 og Stable Diffusion, for å fungere som en filter ved punktet hvor en tekst-til-bilde-modell er klar til å sende en tolket render tilbake til brukeren. I denne sammenhengen bør CLIP fungere som en vakt og kvalitetskontrollmodul, som avviser feilformede eller ellers uegnede render. Dette er i ferd med å bli institusjonalisert (Discord-lenke) på Stability.ai’s DreamStudio API-drevne portal.

Men, siden CLIP er både syndebukk og løsning i en slik scenario (fordi det i stor grad også informerte måten bildet ble utviklet på), og siden hardware-kravene kan overstige hva som sannsynligvis er tilgjengelig lokalt for en sluttbruker, kan denne tilnærmingen ikke være ideal.

Komprimert språk

Den foreslåtte UniTune “finjusterer” en eksisterende diffusjonsmodell – i dette tilfelle, Googles egen Imagen, selv om forskerne statuerer at metoden er kompatibel med andre latente diffusjonsarkitekturer – slik at en unik token injiseres i den som kan kalles opp ved å inkludere den i en tekstprompt.

Ved første øyekast høres dette ut som Google DreamBooth, for tiden en besettelse blant Stable Diffusion-tilhengere og utviklere, som kan injisere nye karakterer eller objekter i en eksisterende checkpoint, ofte på mindre enn en time, basert på en håndfull kildebilder; eller som Textual Inversion, som lager “sidecar”-filer for en checkpoint, som behandles som om de var opprinnelig trent inn i modellen, og kan dra nytte av modellens egne enorme ressurser ved å modifisere dens tekstklassifiserer, med påfølgende en liten fil (i sammenligning med de minimum 2 GB pruned checkpoints av DreamBooth).

I virkeligheten hevder forskerne at UniTune avviste begge disse tilnærmingene. De fant ut at Textual Inversion utelot for mange viktige detaljer, mens DreamBooth ‘fungerte dårligere og tok lengre tid’ enn løsningen de til slutt ble enige om.

Likevel bruker UniTune samme innkapslet semantisk “metaprompt”-tilnærming som DreamBooth, med trente endringer som kalles opp av unike ord valgt av treningspersonen, som ikke vil komme i konflikt med noen termer som allerede eksisterer i en møysommelig trent offentlig utgivelsesmodell.

‘For å utføre redigeringsoperasjonen, sampler vi de finjusterte modellene med prompten “[sjeldne_tokens] edit_prompt” (f.eks. “beikkpic to hunder i en restaurant” eller “beikkpic en minion”).’

Prosess

UniTune-metoden sender essensielt det opprinnelige bildet gjennom en diffusjonsmodell med en sett av instruksjoner på hvordan det skal modifiseres, ved å bruke de enorme repositoryene av tilgjengelig data trent inn i modellen. I virkeligheten kan du gjøre dette nå med Stable Diffusions img2img-funksjonalitet – men ikke uten å forvrengle eller på noen måte endre deler av bildet som du ville foretrukket å beholde.

Under UniTune-prosessen er systemet finjustert, det vil si at UniTune tvinger modellen til å gjenopptake trening, med de fleste av dens lag ufrosne (se under). I de fleste tilfeller vil finjustering ødelegge den totale generelle tapverdien til en hardt-vunnet høy-ytende modell til fordel for å injisere eller raffinere noen andre aspekter som ønskes å bli skapt eller forbedret.

Men med UniTune ser det ut til at modellkopien som påvirkes, selv om den kan veie flere gigabyte eller mer, vil bli behandlet som en disponibel biprodukt, og kastet ved slutten av prosessen, etter å ha tjent et enkelt formål. Denne type datatonnasje blir en hverdagslig lagringskrise for DreamBooth-tilhengere, hvis egne modeller, selv når de er pruned, ikke er mindre enn 2 GB per emne.

Som med Imagic, skjer hovedjusteringen i UniTune på de to nederste av de tre lagene i Imagen (base 64px, 64px>256px, og 256px>1024px). I motsetning til Imagic, ser forskerne noen potensiell verdi i å optimalisere justeringen også for dette siste og største superoppløsningslaget (selv om de ikke har forsøkt det ennå).

For det laveste 64px-laget er modellen biaset mot basebildet under trening, med multiple duplikate par av bilde/tekst som mates inn i systemet for 128 iterasjoner på en batch-størrelse på 4, og med Adafactor som tapfunksjon, som opererer med en læringsrate på 0,0001. Selv om T5-encoderen bare er frosset under denne finjusteringen, er den også frosset under primær trening av Imagen

Den ovennevnte operasjonen blir deretter gjentatt for 64>256px-laget, ved å bruke samme støyforsterkningsprosedyre som ble brukt under den opprinnelige treningen av Imagen.

Sampling

Det finnes mange mulige sampling-metoder som kan brukes for å fremkalle endringene som er gjort fra den finjusterte modellen, inkludert Classifier Free Guidance (CFG), en hovedsak også i Stable Diffusion. CFG definerer essensielt omfanget av hvor mye modellen er fri til å “følge sin fantasi” og utforske rendringsmulighetene – eller også, ved lavere innstillinger, omfanget av hvor mye den bør holde seg til inndata og gjøre færre dramatiske endringer.

Liksom Textual Inversion (en litt mindre med DreamBooth), er UniTune åpen for å anvende distinkte grafiske stiler til opprinnelige bilder, samt mer fotorealistiske redigeringer.

Forskerne eksperimenterte også med SDEdit‘s ‘late start’-teknikk, hvor systemet oppmuntres til å bevare opprinnelig detalj ved å være bare delvis “støy” fra begynnelsen av, men heller vedlikeholde sine essensielle karakteristika. Selv om forskerne bare brukte dette på det laveste laget (64px), tror de at det kunne være en nyttig tilleggsamplingsteknikk i fremtiden.

Forskerne utnyttet også prompt-til-prompt som en ytterligere tekstbasert teknikk for å kondisjonere modellen:

‘I “prompt til prompt”-innstillingen fant vi at en teknikk vi kaller Prompt Guidance er spesielt nyttig for å justere trofasthet og uttrykksfullhet.

‘Prompt Guidance er lignende Classifier Free Guidance, bortsett fra at referansen er en annen prompt i stedet for den uavhengige modellen. Dette guider modellen mot forskjellen mellom de to promptene.’

Men prompt-guidance, hevder forfatterne, var bare nødvendig av og til i tilfeller hvor CFG ikke klarte å oppnå det ønskede resultatet.

En annen ny samplingsteknikk som ble møtt under utviklingen av UniTune var interpolering, hvor områder av bildet er så distinkte at både det opprinnelige og endrede bildet er svært like i komposisjon, og tillater en mer “naiv” interpolering å bli brukt.

Interpolering kan gjøre de høyere anstrengelsesprosessene til UniTune redundante i tilfeller hvor områder som skal transformeres er diskrete og godt avgrensede.

Forfatterne foreslår at interpolering potensielt kan fungere så godt at den kan brukes som en standardinnstilling, og observerer også at den har kraften til å fremkalle ekstraordinære transformasjoner i tilfeller hvor komplekse okklusjoner ikke trenger å forhandles av mer intensive metoder.

UniTune kan utføre lokale redigeringer med eller uten redigeringsmasker, men kan også bestemme hvor redigeringer skal plasseres, med en usedvanlig kombinasjon av tolkende kraft og robust essensialisering av kildebildedata:

I det øverste bildet i den andre kolonnen, har UniTune, som er oppgitt å sette inn en ‘rød tog i bakgrunnen’, plassert den i en passende og autentisk posisjon. Merk hvordan i de andre eksemplene semantisk integritet til kildebildet opprettholdes, selv midt i ekstraordinære endringer i pikselinnhold og kjernestiler i bildene.

Latens

Selv om den første iterasjonen av et nytt system alltid vil være langsomt, og selv om det er mulig at enten fellesskapsengasjement eller bedriftsforpliktelse (det er vanligvis ikke begge) vil til slutt akselerere og optimere en ressurskrevende rutine, både UniTune og Imagic utfører noen ganske store maskinlæringsmanøvrer for å skape disse fantastiske redigeringene, og det er tvilsomt i hvilken grad en slik ressurskrevende prosess noen gang kan bli skalert ned til hjemmebruk, i stedet for API-drevet tilgang (selv om sistnevnte kan være mer ønskelig for Google).

For øyeblikket er rundtur-reisen fra inndata til resultat omtrent 3 minutter på en T4-GPU, med omtrent 30 sekunder ekstra for inferens (som ved enhver inferensrutine). Forfatterne innrømmer at dette er høy latens, og knapt kvalifiserer som “interaktivt”, men de påpeker også at modellen forblir tilgjengelig for ytterligere redigeringer en gang den er initialt finjustert, til brukeren er ferdig med prosessen, noe som reduserer redigerings-tiden per redigering.

Først publisert 21. oktober 2022.