Kunstig intelligens

Den flyktige definisjonen av ‘Deepfake’

En overbevisende ny studie fra Tyskland kritiserte EU AI-akten definisjon av begrepet ‘deepfake’ som for vag, særlig i sammenheng med digital bilde-manipulering. Forfatterne argumenterer for at akten betoning av innhold som ligner virkelige personer eller hendelser – men potensielt kan se falske ut – mangler klarhet.

De påpeker også at akten unntak for ‘standard redigering’ (dvs. angivelig mindre AI-basert modifikasjon av bilder) ikke tar hensyn til både den omfattende innflytelsen av AI i forbrukerapplikasjoner og den subjektive naturen av kunstneriske konvensjoner som forutgår AI.

Upresis lovgivning på disse områdene gir opphav til to nøkkelrisikoer: en ‘kjøleffekt’, der lovens brede tolkningsområde hemmer innovasjon og innføring av nye systemer; og en ‘scofflaw-effekt’, der loven blir ignorert som overrekkende eller irrelevant.

I begge tilfeller, vag lovgivning overfører effektivt ansvaret for å etablere praktiske juridiske definisjoner til fremtidige domstolsavgjørelser – en forsiktig og risikofylt tilnærming til lovgivning.

AI-basert bilde-manipuleringsteknologi er fortsatt betydelig foran lovgivningens evne til å håndtere dem, synes det. For eksempel er et bemerkelsesverdig eksempel på den økende elastisiteten av begrepet AI-drevet ‘automatisk’ post-prosessering, ifølge artikkelen, funksjonen ‘Scene Optimizer’ i nyere Samsung-kameraer, som kan erstatte bruker-tatt bilder av månen (et vanskelig motiv) med et AI-drevet, ‘forbedret’ bilde:

Top left, an example from the new paper of a real user-taken image of the moon, to the left of a Samsung-enhanced version automatically created with Scene Optimizer; Right, Samsung’s official illustration of the process behind this; lower left, examples from the Reddit user u/ibreakphotos, showing (left) a deliberately blurred image of the moon and (right), Samsung’s re-imagining of this image – even though the source photo was a picture of a monitor, and not the real moon. Sources (clockwise from top-left): https://arxiv.org/pdf/2412.09961; https://www.samsung.com/uk/support/mobile-devices/how-galaxy-cameras-combine-super-resolution-technologies-with-ai-to-produce-high-quality-images-of-the-moon/; https:/reddit.com/r/Android/comments/11nzrb0/samsung_space_zoom_moon_shots_are_fake_and_here/

I nedre venstre del av bildet ovenfor, ser vi to bilder av månen. Det til venstre er et foto tatt av en Reddit-bruker. Her er bildet blitt bevisst uskarpt og nedskalert av brukeren.

Til høyre ser vi et foto av samme degraderte bilde tatt med en Samsung-kamera med AI-drevet post-prosessering aktivert. Kameraet har automatisk ‘forbedret’ det gjenkjente ‘måne’-objektet, selv om det ikke var den virkelige månen.

Artikkelen retter dyper kritikk mot Best Take-funksjonen i Google’s nyeste smarttelefoner – en omstridt AI-funksjon som redigerer sammen ‘beste’ deler av en gruppefoto, scannende flere sekunder av en fotosekvens så at smil flyttes frem eller tilbake i tid som nødvendig – og ingen blir vist i midten av å blunke.

Artikkelen hevder at denne type sammensatt prosess har potensialet til å misrepresentere hendelser:

‘[I] en typisk gruppefoto-innstillinger, ville en gjennomsnittlig tilskuer sannsynligvis fortsatt betrakte det resulterende fotot som ekte. Smilet som er innført eksisterte innen noen sekunder fra det gjenværende fotot ble tatt.

‘På den andre siden, er ti sekunders tidsramme for best take-funksjonen tilstrekkelig for en humørforandring. En person kan ha stoppet å smile mens resten av gruppen ler om en vits på deres bekostning.

‘Som en konsekvens, antar vi at slik et gruppefoto kan meget vel utgjøre en deep fake.’

Den nye artikkelen har tittelen Hva utgjør en Deep Fake? Den uklare linjen mellom legitim prosessering og manipulering under EU AI-akten, og kommer fra to forskere ved Computational Law Lab ved Universitetet i Tübingen, og Saarland Universitet.

Gamle triks

Manipulering av tid i fotografering er langt eldre enn forbruker-nivå AI. Artikkelen påpeker eksistensen av mye eldre teknikker som kan argumenteres som ‘uautentiske’, som sammenføyning av flere sekvensielle bilder til et High Dynamic Range (HDR)-foto, eller et ‘sydd’ panoramabilde.

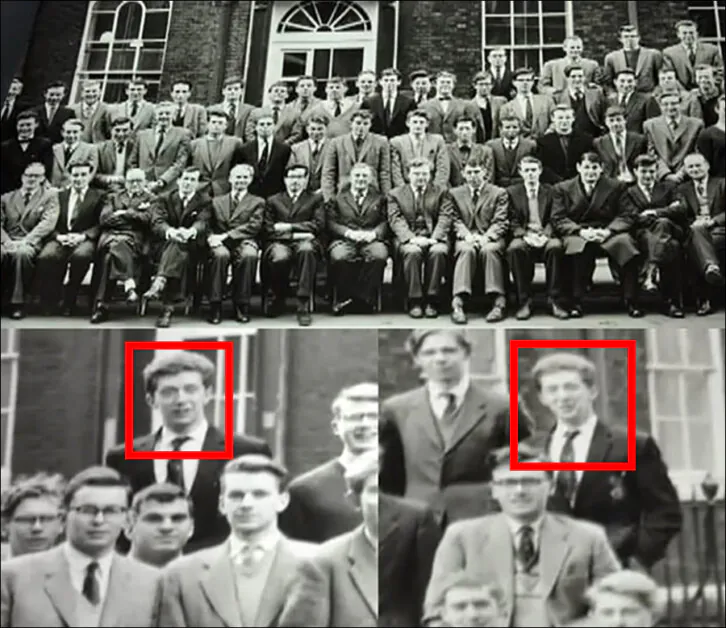

I virkeligheten var noen av de eldste og mest morsomme fotografiske falskner tradisjonelt skapt av skolebarn som løp fra den ene enden av en skolegruppe til den andre, foran banen av de spesielle panoramakameraene som en gang ble brukt til sports- og skolegruppefotografering – noe som enablet eleven å dukke opp to ganger i samme bilde:

Frisken til å lure panoramakameraer under gruppefotografering var for stor for mange elever, som var villige til å risikere en dårlig sesjon i rektors kontor for å ‘klore’ seg selv i skolefotografi. Source: https://petapixel.com/2012/12/13/double-exposure-a-clever-photo-prank-from-half-a-century-ago/

Medmindre du tar et foto i RAW-modus, som grunnleggende dumpes kamera-linsens sensor til en svært stor fil uten noen form for tolkning, er det sannsynlig at dine digitale foto ikke er fullstendig autentiske. Kamera-systemer anvender rutinemessig ‘forbedrings’-algoritmer som bilde-skjerping og hvit-balans, som standard – og har gjort det siden opprinnelsen av forbruker-nivå digital fotografering.

Artikkelen argumenterer for at selv disse eldre typene digitalt bilde-forbedring ikke representerer ‘realitet’, siden slike metoder er designet for å gjøre foto mer tiltalende, ikke mer ‘ekte’.

Studien foreslår at EU AI-akten, selv med senere endringer som recitals 123–27, plasserer all fotografisk utgang innenfor en bevis-ramme som ikke er egnet til konteksten hvor foto blir produsert disse dager, i motsetning til (nominelt objektive) natur av sikkerhetskamera-film eller rettsmedisinsk fotografering. De fleste bildene som blir behandlet av AI-akten, er mer sannsynlig å opphav fra kontekster hvor produsenter og nettverksplattformer aktivt fremmer kreativ foto-tolkning, inkludert bruk av AI.

Forskerne foreslår at foto ‘har aldri vært en objektiv fremstilling av realitet’. Overveielser som kameraets plassering, valg av dybdeskala og lysvalg, bidrar alle til å gjøre et fotografi dyp subjektivt.

Artikkelen observerer at rutinemessige ‘rydd-oppgaver’ – som fjerning av sensor-støv eller uønskede kraftledninger fra et ellers velkomponert bilde – bare var semi-automatisert før AI-oppgangen: brukere måtte manuelt velge en region eller initiere en prosess for å oppnå deres ønskede resultat.

I dag er disse operasjonene ofte utløst av en brukers tekst-prompt, mest merkbart i verktøy som Photoshop. På forbruker-nivå er slike funksjoner stadig mer automatisert uten bruker-inngang – et resultat som åpenbart blir betraktet av produsenter og plattformer som ‘åpenbart ønskelig’.

Den utvannede betydningen av ‘Deepfake’

En sentral utfordring for lovgivning rundt AI-endret og AI-generert bilde er tvetydigheten av begrepet ‘deepfake’, som har hatt sin betydning betydelig utvidet over de siste to årene.

Opprinnelig ble begrepene bare brukt på video-utgang fra autoencoder-baserte systemer som DeepFaceLab og FaceSwap, begge avledet fra anonym kode postet på Reddit i slutten av 2017.

Fra 2022, kom Latent Diffusion Models (LDMs) som Stable Diffusion og Flux, samt tekst-til-video-systemer som Sora, som også tillot identitet-utveksling og tilpasning, med forbedret oppløsning, fleksibilitet og trofasthet. Nå var det mulig å skape diffusjons-baserte modeller som kunne avbilde kjendiser og politikere. Siden begrepet ‘deepfake’ allerede var en overskrift-genererende skatt for medieprodusenter, ble det utvidet til å dekke disse systemene.

Senere, både i media og i forskningslitteraturen, ble begrepet også inkludert tekst-basert personliggjøring. På dette tidspunktet var den opprinnelige betydningen av ‘deepfake’ nesten tapt, mens dens utvidede betydning var stadig i utvikling, og økende utvannet.

Men siden ordet var så brennende og galvaniserende, og var nå et kraftig politisk og medie-merke, viste det seg umulig å gi opp. Det tiltalte lesere til nettsider, midler til forskere, og oppmerksomhet til politikere. Denne leksikale tvetydigheten er hovedfokus for den nye forskningen.

Som forfatterne observerer, omfatter artikkel 3(60) i EU AI-akten fire betingelser som definerer en ‘deepfake’.

1: Sant Måne

Først og fremst, må innholdet være generert eller manipulert, dvs. enten skapt fra scratch ved hjelp av AI (generering) eller endret fra eksisterende data (manipulering). Artikkelen fremhever vanskeligheten i å skille mellom ‘akseptable’ bilde-redigering-resultater og manipulative deepfakes, gitt at digitale foto aldri er sanne representasjoner av realitet.

Artikkelen hevder at en Samsung-generert måne er argumenterbart ekte, siden månen er usannsynlig å endre utseende, og siden AI-generert innhold, trent på virkelige måne-bilder, sannsynligvis er nøyaktig.

Men forfatterne påpeker også at siden Samsung-systemet har vist seg å generere et ‘forbedret’ bilde av månen i et tilfelle hvor kilde-bildet ikke var månen selv, ville dette bli betraktet som en ‘deepfake’.

Det ville være upraktisk å utarbeide en omfattende liste over forskjellige bruksområder rundt denne type ad hoc-funksjonalitet. Derfor synes byrden av definisjon å gå over til domstolene.

2: TekstFakes

Andre, må innholdet være i form av bilde, lyd eller video. Tekst-innhold, selv om det er underlagt andre transparens-krav, blir ikke betraktet som en deepfake under AI-akten. Dette blir ikke dekket i detalj i den nye studien, selv om det kan ha en merkbar innvirkning på effektiviteten av visuelle deepfakes (se under).

3: Virkelige Verdensproblemer

Tredje, må innholdet ligne eksisterende personer, objekter, steder, enheter eller hendelser. Denne betingelsen etablerer en kobling til den virkelige verden, noe som betyr at ren fabrikkert bilde, selv om det er fotorealistisk, ikke vil kvalifisere som en deepfake. Recital 134 av EU AI-akten understreker ‘lignende’-aspektet ved å legge til ordet ‘appreciably’ (en åpenbar henvisning til senere rettslige avgjørelser).

Forfatterne, som sitater tidligere arbeid, overveier om et AI-generert ansikt må tilhøre en virkelig person, eller om det bare må være tilstrekkelig liknende en virkelig person, for å tilfredsstille denne definisjonen.

For eksempel, hvordan kan en bestemme om en sekvens av fotorealistiske bilder som avbilder politikeren Donald Trump har intensjonen av personliggjøring, hvis bildene (eller vedlagte tekster) ikke spesifikt nevner ham? Ansiktsgjenkjenning? Bruker-undersøkelser? En dommers definisjon av ‘sunn fornuft’?

Ved å returnere til ‘TekstFakes’-problemet (se over), utgjør ord ofte en betydelig del av visuelle deepfakes. For eksempel, er det mulig å ta et (uendret) bilde eller video av ‘person a’, og si, i en overskrift eller en sosial medie-post, at bildet er av ‘person b’ (antagelig at de to personene ligner hverandre).

I et slikt tilfelle, trengs ingen AI, og resultatet kan være slående effektivt – men utgjør slike lavteknologiske tilnærminger også en ‘deepfake’?

4: Retusj, Ombygging

Til slutt, må innholdet se autentisk eller sannferdig ut for en person. Denne betingelsen understreker persepsjonen av menneskelige tilskuere. Innhold som bare blir gjenkjent som representasjon av en virkelig person eller objekt av en algoritme, vil ikke bli betraktet som en deepfake.

Av alle betingelsene i 3(60), er dette den som mest åpenbart henviser til senere domstolsavgjørelser, siden det ikke tillater noen tolkning via tekniske eller mekaniserte midler.

Det er noen åpenbare vanskeligheter i å nå enighet om en så subjektiv bestemmelse. Forfatterne påpeker, for eksempel, at forskjellige mennesker, og forskjellige typer mennesker (slik som barn og voksne), kan være forskjellige disposisjon til å tro på en bestemt deepfake.

Forfatterne påpeker videre at de avanserte AI-egenskapene til verktøy som Photoshop utfordrer tradisjonelle definisjoner av ‘deepfake.’ Mens disse systemene kan inkludere grunnleggende sikkerhetstiltak mot kontroversielt eller forbudt innhold, utvider de dramatisk konseptet av ‘retusj.’ Brukere kan nå legge til eller fjerne objekter på en overbevisende, fotorealistisk måte, og oppnå en profesjonell nivå av autentisitet som omdefinerer grensene for bilde-manipulering.

Forfatterne uttaler:

‘Vi argumenterer for at den nåværende definisjonen av deep fakes i AI-akten og de tilhørende forpliktelsene ikke er tilstrekkelig spesifisert for å håndtere utfordringene som deep fakes stiller. Ved å analysere livssyklusen til et digitalt foto fra kamera-sensoren til digitale redigeringsfunksjoner, finner vi at:

‘(1.) Deep fakes er dårlig definert i EU AI-akten. Definisjonen lar for mye rom for hva en deep fake er.

‘(2.) Det er uklart hvordan redigeringsfunksjoner som Google’s “best take”-funksjon kan betraktes som unntak fra transparens-forpliktelsene.

‘(3.) Unntaket for vesentlig redigert innhold reiser spørsmål om hva som utgjør vesentlig redigering av innhold og om denne redigeringen må være merkbart for en naturlig person.’

Tar Unntak

EU AI-akten inneholder unntak som, ifølge forfatterne, kan være svært tillatende. Artikkel 50(2), hevder de, tilbyr et unntak i tilfeller hvor majoriteten av et originalt kilde-bilde ikke er endret. Forfatterne påpeker:

‘Hva kan betraktes som innhold i betydningen av artikkel 50(2) i tilfeller av digital lyd, bilder og video? For eksempel, i tilfeller av bilder, må vi overveie piksel-rom eller det synlige rom som er merkbart for mennesker? Substantielle manipulasjoner i piksel-rom kan ikke endre menneskelig persepsjon, og på den andre siden, kan små forstyrrelser i piksel-rom endre persepsjonen dramatisk.’

Forskerne gir eksempelet på å legge til en håndvåpen til fotot av en person som peker på noen. Ved å legge til våpenet, endrer en så lite som 5% av bildet; likevel er den semantiske betydningen av den endrede delen merkbar. Derfor synes dette unntaket ikke å ta hensyn til noen ‘sunn fornuft’-forståelse av hvordan en liten detalj kan påvirke den totale betydningen av et bilde.

Artikkel 50(2) tillater også unntak for en ‘assist-funksjon for standard redigering’. Siden akten ikke definerer hva ‘standard redigering’ betyr, synes selv post-prosessering-funksjoner som Google’s Best Take å være beskyttet av dette unntaket, ifølge forfatterne.

Konklusjon

Den uttalte intensjonen bak det nye arbeidet er å oppmuntre til tverrfaglig studie rundt regulering av deepfakes, og å fungere som en startpunkt for nye dialoger mellom datavitenskapsmenn og juridiske eksperter.

Men artikkelen selv underkaster seg tautologi på flere punkter: den bruker ofte begrepet ‘deepfake’ som om dens betydning var selvforklarende, mens den samtidig kritiserte EU AI-akten for å ikke definere hva som faktisk utgjør en deepfake.

Først publisert mandag, 16. desember 2024