Kunstig intelligens

Det svarte boks-problemet i LLMs: Utfordringer og fremvoksende løsninger

Maskinlæring, en undergruppe av AI, omfatter tre komponenter: algoritmer, treningdata og den resulterende modellen. En algoritme, i essensen en samling av prosedyrer, lærer å identifisere mønster fra et stort sett med eksempler (treningdata). Kulminasjonen av denne treningen er en maskinlæringsmodell. For eksempel ville en algoritme trent med bilder av hunder resultere i en modell i stand til å identifisere hunder på bilder.

Svart boks i maskinlæring

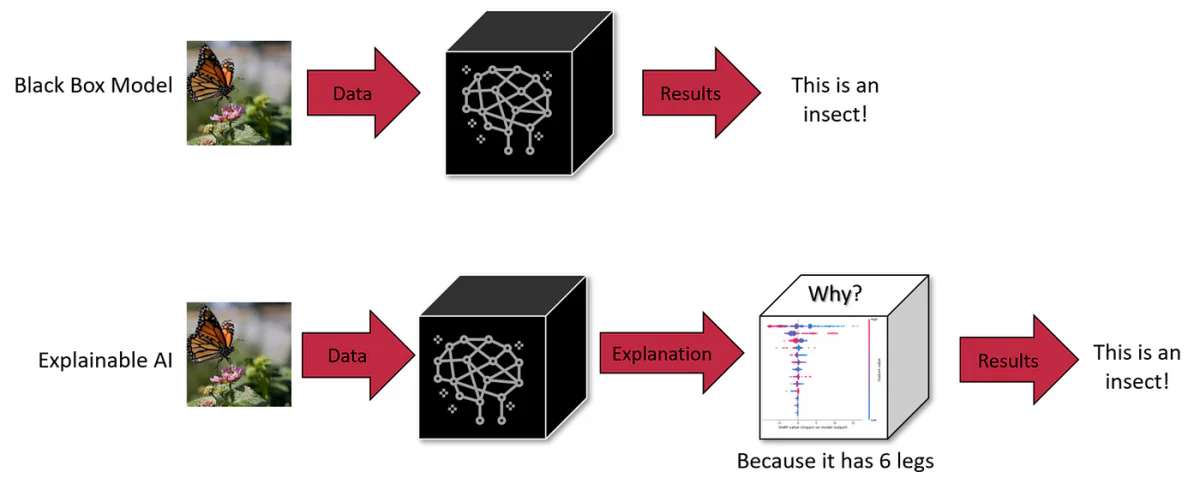

I maskinlæring kan noen av de tre komponentene — algoritme, treningdata eller modell — være en svart boks. Mens algoritmer ofte er offentlig kjent, kan utviklere velge å holde modellen eller treningdata hemmelig for å beskytte immaterielle rettigheter. Denne uklarheten gjør det vanskelig å forstå AIens beslutningsprosess.

AI-svart bokser er systemer hvis interne virkemåter forblir uklare eller usynlige for brukerne. Brukere kan sette inn data og motta utdata, men logikken eller koden som produserer utdataet forblir skjult. Dette er en vanlig karakteristikk i mange AI-systemer, inkludert avanserte generative modeller som ChatGPT og DALL-E 3.

LLMs som GPT-4 presenterer en betydelig utfordring: deres interne virkemåter er i stor grad uklare, noe som gjør dem til “svarte bokser”. Slike uklarheter er ikke bare et teknisk puslespill; de stiller reelle sikkerhets- og etiske bekymringer. For eksempel, hvis vi ikke kan skjønne hvordan disse systemene når frem til konklusjoner, kan vi stole på dem i kritiske områder som medisinske diagnoser eller finansielle vurderinger?

Utforskning av LIME- og SHAP-teknikkene

Tolkningsbarhet i maskinlæring (ML) og dyp læring (DL) modeller hjelper oss å se inn i de uklare indre virkemåtene til disse avanserte modellene. Local Interpretable Model-agnostic Explanations (LIME) og SHapley Additive exPlanations (SHAP) er to slike mainstream tolkningsbarhets-teknikker.

LIME, for eksempel, bryter ned kompleksiteten ved å lage enklere, lokale surrogate-modeller som approksimerer oppførselen til den opprinnelige modellen rundt et bestemt innputt. Ved å gjøre dette, hjelper LIME med å forstå hvordan enkelte egenskaper påvirker forutsagnene til komplekse modeller, i praksis gir det en ‘lokal’ forklaring på hvorfor en modell tok en bestemt beslutning. Det er spesielt nyttig for ikke-tekniske brukere, da det oversetter den intrikate beslutningsprosessen til modellene til mer forståelige termer.

SHAP, på den andre siden, tar inspirasjon fra spillteori, spesielt konseptet Shapley-verdier. Det tildeeler en ‘viktighet’-verdi til hver egenskap, som indikerer hvor mye hver egenskap bidrar til forskjellen mellom den faktiske forutsagnet og basisforutsagnet (gjennomsnittsforutsagnet over alle innputt). SHAPs styrke ligger i dens konsistens og evne til å gi en global perspektiv – det forklarer ikke bare enkeltforutsagn, men gir også innsikt i modellen som helhet. Dette er spesielt verdifullt i dyp læringsmodeller, hvor de sammenkoblede lagene og tallrike parametre ofte gjør forutsagnsprosessen til å se ut som en reise gjennom en labyrint. SHAP avmystifiserer dette ved å kvantifisere bidraget fra hver egenskap, og tilbyr en klarere kart over modellens beslutningsveier.

SHAP (Source)

Både LIME og SHAP har oppstått som essensielle verktøy i området AI og ML, og de adresserer det kritiske behovet for transparens og troverdighet. Mens vi fortsetter å integrere AI dyptere i ulike sektorer, blir evnen til å tolke og forstå disse modellene ikke bare et teknisk nødvendighet, men en grunnleggende krav for etisk og ansvarlig AI-utvikling. Disse teknikkene representerer betydelige skritt i å avdekke kompleksiteten i ML- og DL-modeller, og omgjør dem fra uforståelige ‘svarte bokser’ til forståelige systemer hvis beslutninger og atferd kan forstås, stoles på og effektivt utnyttes.

Skalene og kompleksiteten til LLMs

Skalene til disse modellene bidrar til deres kompleksitet. Ta GPT-3, for eksempel, med sine 175 milliarder parametre, og nyere modeller med billioner. Hver parameter samvirker på intrikate måter innenfor neuralt nettverk, og bidrar til emergente evner som ikke kan forutsies ved å undersøke enkeltkomponenter alene. Denne skalaen og kompleksiteten gjør det nesten umulig å fullstendig forstå deres interne logikk, og stiller en hindring i å diagnostisere fordommer eller uønskede atferd i disse modellene.

Avveien: Skala mot tolkningsbarhet

Å redusere skalaen til LLMs kunne forbedre tolkningsbarheten, men til en kostnad av deres avanserte evner. Skalaen er det som muliggjør atferd som mindre modeller ikke kan oppnå. Dette presenterer en innebygd avveining mellom skala, evne og tolkningsbarhet.

Impakt av LLM-svart boks-problemet

1. Feilaktig beslutning

Uklarheten i beslutningsprosessen til LLMs som GPT-3 eller BERT kan føre til uoppdagede fordommer og feil. I felt som helsevesen eller strafferett, hvor beslutninger har langtrekkende konsekvenser, er evnen til å auditere LLMs for etisk og logisk sunnhet en stor bekymring. For eksempel kan en medisinsk diagnose LLM som baserer seg på foreldede eller fordomsfulle data gi skadelige anbefalinger. Liksom LLMs i rekrutteringsprosesser kan uforvarende videreføre kjønnsforbias. Den svarte boks-naturen skjuler ikke bare feil, men kan potensielt forsterke dem, og krever en proaktiv tilnærming for å forbedre transparensen.

2. Begrenset tilpasning i ulike sammenhenger

Mangelen på innsikt i de interne virkemåtene til LLMs begrenser deres tilpasning. For eksempel kan en rekrutterings LLM være ineffektiv i å vurdere kandidater for en rolle som verdsetter praktiske ferdigheter over akademiske kvalifikasjoner, på grunn av dens evne til å tilpasse sine vurderingskriterier. Liksom en medisinsk LLM kan stride med sjeldne sykdomsdiagnoser på grunn av. Denne infleksibiliteten understreker behovet for transparens for å omkalibrere LLMs for bestemte oppgaver og sammenhenger.

3. Fordommer og kunnskapsluker

LLMs’ prosessering av store treningdata er underlagt begrensningene pålagt av deres algoritmer og modellarkitekturer. For eksempel kan en medisinsk LLM vise demografiske fordommer hvis den er trent på ubalanserte datasamlinger. Liksom en LLMs kompetanse i nisjetema kan være misvisende, og føre til overmodige, feilaktige utdata. Å håndtere disse fordommene og kunnskapslukene krever mer enn bare tilleggsdata; det krever en undersøkelse av modellens prosesseringsmekanismer.

4. Juridisk og etisk ansvar

Den uklare naturen til LLMs skaper en juridisk gråsone når det gjelder ansvar for skader forårsaket av deres beslutninger. Hvis en LLM i et medisinsk miljø gir feilaktig råd som fører til skade på pasienter, blir det vanskelig å bestemme ansvar på grunn av modellens uklarhet. Denne juridiske usikkerheten stiller risiko for enheter som setter i verk LLMs i sensitive områder, og understreker behovet for klart styre og transparens.

5. Tillitsproblemer i sensitive anvendelser

For LLMs brukt i kritiske områder som helsevesen og finansielle vurderinger, undergraver mangelen på transparens deres tillit. Brukere og regulatorene må sikre at disse modellene ikke har fordommer eller tar beslutninger basert på urimelige kriterier. Å verifisere fraværet av fordommer i LLMs krever en forståelse av deres beslutningsprosesser, og understreker viktigheten av forklarbarhet for etisk utvikling.

6. Risiko med personlige data

LLMs krever omfattende treningdata, som kan inkludere sensitive personlige informasjoner. Den svarte boks-naturen til disse modellene stiller spørsmål om hvordan denne dataen prosesseres og brukes. For eksempel kan en medisinsk LLM trent på pasientjournaler reise spørsmål om datavern og bruk. Å sikre at personlige data ikke misbrukes eller utnyttes, krever transparente datahåndteringprosesser innenfor disse modellene.

Fremvoksende løsninger for tolkningsbarhet

For å håndtere disse utfordringene, utvikles det nye teknikkene. Disse inkluderer kontrafaktiske (CF) approksimasjonsmetoder. Den første metoden involverer å fremme en LLM til å endre et bestemt tekstkonsept mens andre konsepter holdes konstant. Denne tilnærmingen er effektiv, men ressurskrevende på inferenstid.

Den andre tilnærmingen involverer å lage et dedikert innlejringrom styrt av en LLM under trening. Dette rommet sammenfaller med en kausal graf og hjelper med å identifisere sammenfall som approksimerer CF-er. Denne metoden krever færre ressurser på testtid og har vist seg å kunne forklare modellforutsagn effektivt, selv i LLMs med billioner av parametre.

Disse tilnærmingene understreker viktigheten av kausale forklaringer i NLP-systemer for å sikre sikkerhet og etablere tillit. Kontrafaktiske approksimasjoner gir en måte å forestille seg hvordan en gitt tekst ville endre seg hvis et bestemt konsept i dens generative prosess var annerledes, og hjelper med å estimere kausale effekter av høynivå-konsepter på NLP-modeller.

Dykk ned: Forklaringsmetoder og kausalitet i LLMs

Prøving og egenskapsviktighetsverktøy

Prøving er en teknikk brukt til å tyde hva interne representasjoner i modeller koderer. Den kan være enten overvåket eller uovervåket, og er rettet mot å bestemme om bestemte konsepter er kodet på bestemte steder i nettverket. Mens effektiv til en viss grad, mangler prøvingene i å gi kausale forklaringer, som Geiger et al. (2021) har vist.

Egenskapsviktighetsverktøy, en annen form for forklaringsmetode, fokuserer ofte på innputtegenskaper, selv om noen gradient-baserte metoder utvider dette til skjulte tilstander. Et eksempel er Integrated Gradients-metoden, som tilbyr en kausal tolkning ved å utforske baseline (kontrafaktiske, CF) innputt. Til tross for deres nytte, sliter disse metodene med å knytte sine analyser til virkelige konsepter utenfor enkle innputtegenskaper.

Intervensjonsbaserte metoder

Intervensjonsbaserte metoder involverer å modifisere innputt eller interne representasjoner for å studere effekter på modellatferd. Disse metodene kan lage kontrafaktiske tilstander for å estimere kausale effekter, men de kan ofte generere uvirkelige innputt eller nettverkstilstander hvis de ikke kontrolleres nøye. Den kausale proxy-modellen (CPM), inspirert av S-learner-konseptet, er en ny tilnærming i dette området, som etterligner atferden til den forklarte modellen under kontrafaktiske innputt. Imidlertid er behovet for en distinkt forklarer for hver modell en betydelig begrensning.

Approksimasjon av kontrafaktiske

Kontrafaktiske er vidt brukt i maskinlæring for dataforbedring, og involverer perturbasjoner av ulike faktorer eller etiketter. Disse kan genereres gjennom manuell redigering, heuristisk nøkkelord-erstatning eller automatisert tekst-omskriving. Mens manuell redigering er nøyaktig, er det også ressurskrevende. Nøkkel-baserte metoder har begrensninger, og generative tilnærminger tilbyr en balanse mellom flyt og dekning.

Troverdige forklaringer

Troverdighet i forklaringer refererer til å avbilde den underliggende begrunnelsen til modellen nøyaktig. Det finnes ingen universelt akseptert definisjon av troverdighet, noe som fører til at den karakteriseres gjennom ulike metrikker som Sensitivitet, Konsistens, Egenskapsviktighetsavtale, Robusthet og Simulering. De fleste av disse metodene fokuserer på egenskapsnivå-forklaringer og ofte forveksler korrelasjon med kausalitet. Vår arbeid har som mål å gi høynivå-konsept-forklaringer, og å utnytte kausalitetslitteraturen for å foreslå et intuitivt kriterium: Orden-Troverdighet.

Vi har dykket ned i de innebygde kompleksitetene til LLMs, og forstått deres ‘svarte boks’-natur og de betydelige utfordringene det stiller. Fra risikoen for feilaktig beslutning i sensitive områder som helsevesen og finansielle vurderinger, til de etiske dilemmaer omkring fordommer og rettferdighet, behovet for transparens i LLMs har aldri vært mer tydelig.

Fremtiden for LLMs og deres integrering i våre daglige liv og kritiske beslutningsprosesser henger av vår evne til å gjøre disse modellene ikke bare mer avanserte, men også mer forståelige og ansvarlige. Jakten på forklarbarhet og tolkningsbarhet er ikke bare et teknisk foretak, men en grunnleggende del av å bygge tillit til AI-systemer. Mens LLMs blir mer integrert i samfunnet, vil kravet om transparens vokse, ikke bare fra AI-utøvere, men fra hver enkelt bruker som interagerer med disse systemene.