Andersons vinkel

Streaming av AI-avatarer som om det var 1999

NY forskning presenterer en måte å strømme livlige 3D-avatarer som dukker opp nesten umiddelbart og skjerper i sanntid, i stedet for å tvinge brukerne til å vente på at massive nedlastinger skal fullføres.

På mange måter har de enorme ressurskravene til generativ AI og AI-assisterte rendringssystemer ført forbrukerklarheten tilbake tjue eller flere år. Bare i 2023 syntes en 64 GB RAM-allokering i en bærbar eller stasjonær PC som overkill; nå, med den økende populariteten av RAM og/eller CPU-offloading, er 64 GB ganske beskjedent for lokale AI-behov; og disse en gang så vanlige og rimelige komponentene i PC-er fortsetter å øke i pris mens bedrifter sliter med å møte etterspørselen etter AI-tjenester.

Størrelsen og grådigheten til AI og dens prosesser og miljøer overstiger vanligvis forbruker-nivå-hardware, og selv å kjøre “slanke” lokale modeller som GGUF-versjoner vil vanligvis belaste det gjennomsnittlige systemet.

Selv tekstbaserte AI-tjenester som ChatGPT er utsatt for betydelig belastning både på klient- og servernivå. Derfor, når AI blir bedt om å levere online multimediainnhold i sanntid, kan vi forvente noen meget alvorlige kompromisser i latens og/eller kvalitet – lignende internettets tidlige kamp med strømming av media, og de meget hatede animerte “buffering”-ikonene til RealPlayer og QuickTime.

Sist gang at multimediainnhold og nettverksproblemer skapte friksjon i brukeropplevelsen, var forbruker-nivå-hardware fortsatt under utvikling gjennom Moores lov, og ble nesten eksponentielt bedre hvert år, selv om operativsystemer, nettverk og andre støttesystemer utviklet seg for å møte etterspørselen; og i løpet av de siste ti årene har kapasiteten til forbrukerteknologi overskredet multimediainnholdets krav (kanskje sogar til det punktet hvor omlasting trengte å bli kick-startet for å vedlikeholde salg).

Men denne overfloden av lokale evner kan være på vei til å ta slutt snart, ettersom lokal hardware blir lavere-spekket og mer dyrt, og som AI-baserte tjenester krever høyere server-side og lokale ressurser.

Å Få En Førstegangsgodtgjørelse

Tilbake i pre-bredbånd-tiden, før den tidligste brukbare strømming av video, var web-brukerne vant til at bilder langsomt kom i fokus, da progressive JPEG-er tillot den båndbreddshungrende brukeren å se på bildet som lastes ned, noen ganger smertefullt langsomt, ettersom mer bilde-data ble lastet ned lokalt.

Nå synes det som om vi kan være på vei til en lignende opplevelse med AI-basert Gaussian Splat-avatarer:

Klikk for å spille. Fra det nye ProgressiveAvatars-prosjektet, en sammenligning av strømming av Gaussian-avatarer. På venstre side, det eldre GaussianAvatars-prosjektet laster langsomt ned nye data, men ser dårlig ut mens data bygges opp; på høyre side, Progressive Avatars-versjonen bygger også detalj langsomt, men gjør det på en intelligent måte som gir en grunnleggende menneskelig likhet fra starten. Kilde

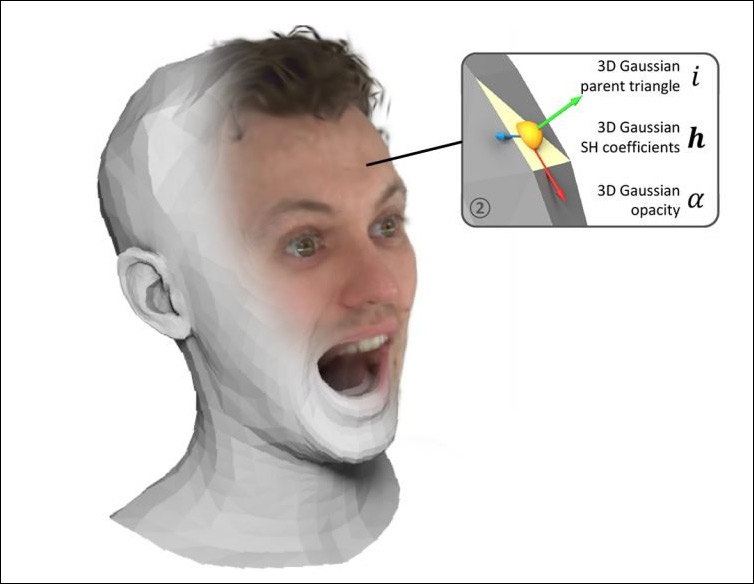

Ovenfor ser vi to versjoner av en Gaussian Splat-basert (GSplat) Avatar – en menneskelig representasjon som er delvis aktivert av en ikke-AI-rendringsteknikk som stammer fra tidlig på 1990-tallet, og også av mer moderne metoder, som FLAME-parametriske menneskelige modeller, og AI-baserte treningstilnærminger:

Gaussian Splatting bruker en Gaussian-representasjon av farge og 3D-informasjon i stedet for en piksel eller voxel, og kartlegger denne ultra-realistiske teksturen over en mer tradisjonell type CGI-mesh, som selv er fasilitert av en ‘parametrisk menneske’, et CGI-ansikt og/eller kropp, i systemer som FLAME og STAR. Kilde

På venstre side i videoen ovenfor kan vi se at en tradisjonell implementering av en Gaussian splat-avatær ser ganske forferdelig ut mens vi venter på at dataene skal lastes ned. På høyre side, en ny implementering fra Kina, kalt ProgressiveAvatars, kan løse opp på en mye mer elegant måte mens dataene lastes ned, og presenterer et ikke-alarmende menneskebilde fra starten.

Forfatterne hevder at deres metode er den første som virkelig “strømmer” en Gaussian-avatær, og sannsynligvis den første som gjør det på en progressiv måte, hvor bildet bygges opp elegant, og de viktigste områdene – som øyne og lepper – kan prioriteres, så avatæren kan bli samtalevennlig selv når den bare er delvis lastet ned:

Click to play. Fra ProgressiveAvatars-prosjektets nettsted, en illustrasjon av oppmerksomhetsbevisst lasting.

Før dette har en “nivå av detalj” (LOD)-tilnærming blitt brukt i tidligere forsøk på å slimme ned ‘GSplat’-avatærer, lignende video-spill-optimaliseringer, hvor suksessivt mer detaljerte versjoner av en person lastes ned avhengig av om de okkuperer nok av visningsområdet eller brukerens oppmerksomhet til å være verdt anstrengelsen.

Selvfølgelig medfører dette en betydelig mengde redundante “reserve”-avatærer, og forfatterne rammer sin tilnærming som et mer rasjonelt system. Ved implikasjon tillater en metode av denne typen også endringer å bli gjort i en GSplat-figur (dvs. tilpassing) uten å måtte propagere slike endringer gjennom en rekke av forskjellige LOD-“tvillinger”.

En Fremvoksende Domene

Hvis dette ser ut som et nisje-problem, så var strømming av video også et nisje-problem tilbake i dagene når å få de tidligste pluginene til å fungere ble overført til den nærmeste tilgjengelige nerd. Videre har potensialet for AI-baserte strømmingsrepresentasjoner gått ut over menneskelige avatærer, og utvider seg til by-generering, spill, og 3D-baserte* versjoner av praktisk talt alle online-domener – som Virtual Try-On, for kleshandel:

Klikk for å spille. Fra et prosjekt i 2024, en grov titt på fremtiden til online ‘prøv-på’. Andre prosjekter søker å legge til bevegelse og interaktivitet – krevende aspekter å strømme og håndtere. Kilde

Nett som LOD-baserte tilnærminger har vært hovedsakelig brukt av video-spill, er mange andre overveielser som en gang var eksklusive for spillutvikling sannsynligvis kommer til å gå over i splat-baserte representasjoner. For eksempel avbilder de fleste av disse tidlige GSplat-utgangspunktene en enkel menneske som gøringer og mugger, eller kanskje snakker; men mange situasjoner vil være nødvendige som inneholder flere mennesker, samt miljømessige egenskaper og atmosfære – en scenario hvor høyt performant ‘triage’-systemer vil bestemme hvor strømmingsdataene må prioriteres, for å holde brukeren i øyeblikket.

Den nye artikkelen heter ProgressiveAvatars: Progressive Animatable 3D Gaussian Avatars, og kommer fra tre forskere ved University of Science and Technology of China i Hefei.

Metode

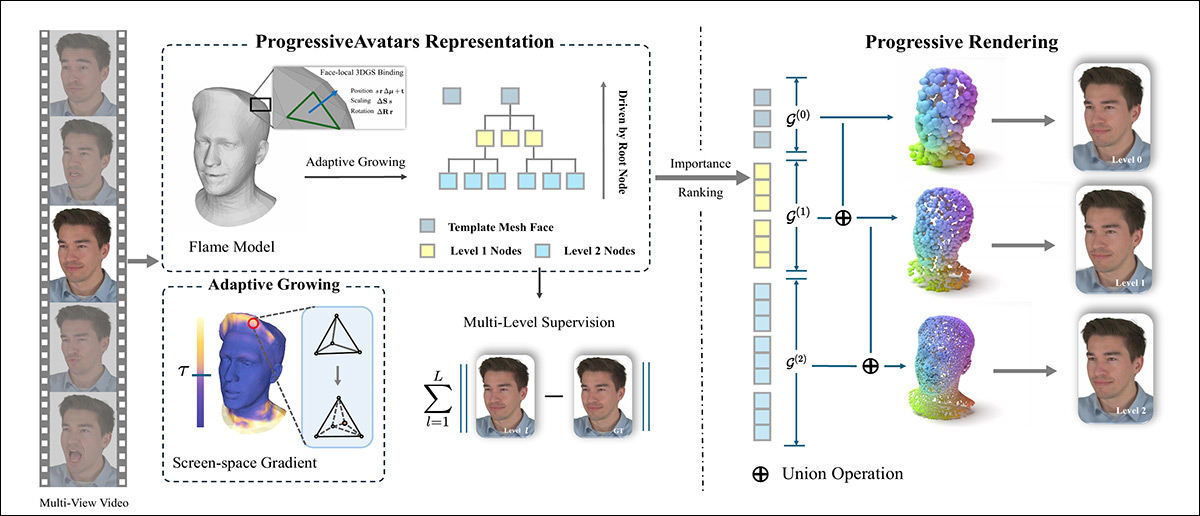

Tilnærmingen utnytter initialt video av en persons hode. For hver ramme, blir en standard FLAME-parametrisk ansiktsmodell tilpasset, så at formen og uttrykket endrer seg over tid, mens den underliggende mesh-strukturen forblir uendret. Fordi den grunnleggende topologien ikke endrer seg, kan en stabil FLAME-mal bli gjenbrukt og forbedret i stedet for å bli bygget opp fra scratch hver gang, som skjer i lignende tidligere arbeid:

Hodevideo blir først tilpasset med en sporet FLAME-mesh, etterfulgt av at 3D-Gaussianer blir festet til hver ansiktsdel og vokser hierarkisk der skjerm-rom-gradier indikerer manglende detalj. Under trening, bygger denne adaptive underinndelingen en multi-nivå-representasjon under multi-viewport-oversikt, og ved inferens, bestemmer per-ansikts viktighetsskår hvilke Gaussianer som strømmes først, og lar avatæren dukke opp raskt og forbedre seg progressivt mens høyere detaljnivåer blir lagt til.

Over denne grunnstrukturen blir detaljer lagt til i lag; overflaten blir implisitt inndelt i en hierarki, og små tre-dimensjonale Gaussianer blir festet til ansiktsdelene på hver detaljnivå.

Selv om de initielle grovere lagene fanger den generelle hodeformen og bevegelsen, gir de påfølgende finere lagene rynker, subtile deformasjoner og høyfrekvent tekstur. Bilder blir deretter rendret fra disse Gaussianerne ved hjelp av en differensierbar Gaussian-rasterisator og trent mot multi-viewport-grunnssannhetsbilder, så avatæren lærer å gjenskape den virkelige personens utseende.

Under trening vokser denne hierarkien automatisk: områder som trenger mer detalj blir inndelt videre, guidet av skjerm-rom-signal, så computational anstrengelse konsentrerer seg der brukerens øye er mest sannsynlig å merke feil.

Under inferens, lar denne samme hierarki progressiv strømming til, hvor en grov versjon av en avatær kan vises først, og, mens ekstra lag blir lastet ned, kan nye Gaussianer bli lagt til uten å endre det som allerede vises, og lar en animert hode-avatær dukke opp raskt, og blir skarpere og mer detaljert mens mer data ankommer.

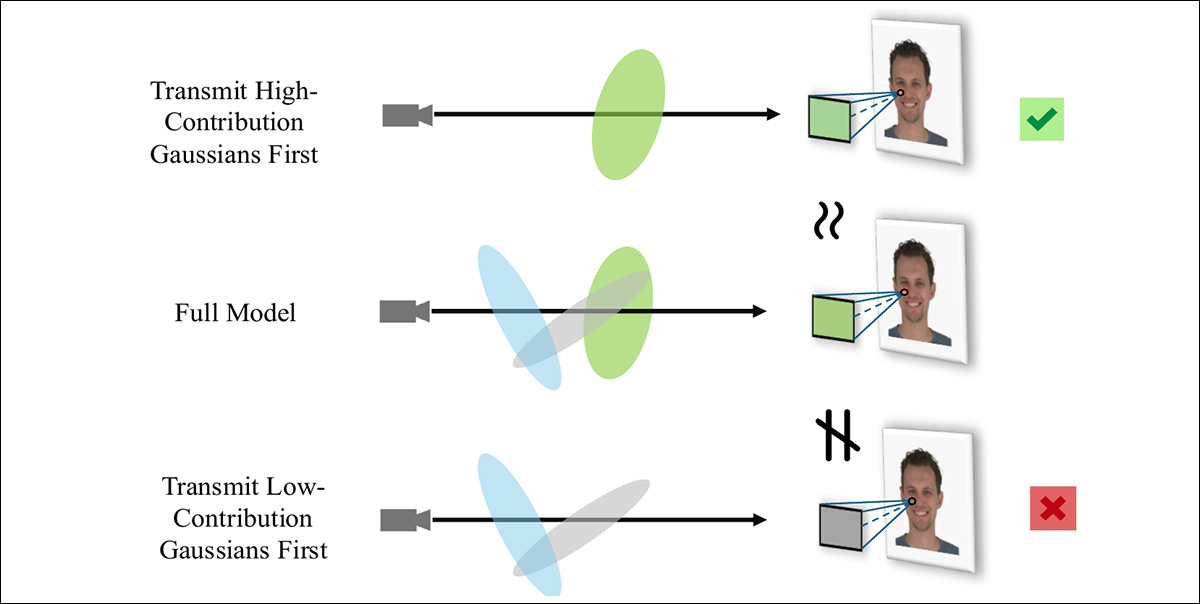

Forfatterne observerer at hele systemet henger sammen av prioriteringen av innkommende data:

Når alle Gaussianer på et gitt nivå er tilgjengelige, blir fullmodellen rendret med maksimal trofasthet; men under strømming, sender de høyeste bidrags-Gaussianerne først lar tidlige delresultater nærme seg sluttbildet, hvorvidt overføring av lav-bidrags-Gaussianer først forvrenger fargebalanse og betoner mindre komponenter.

Data og Tester

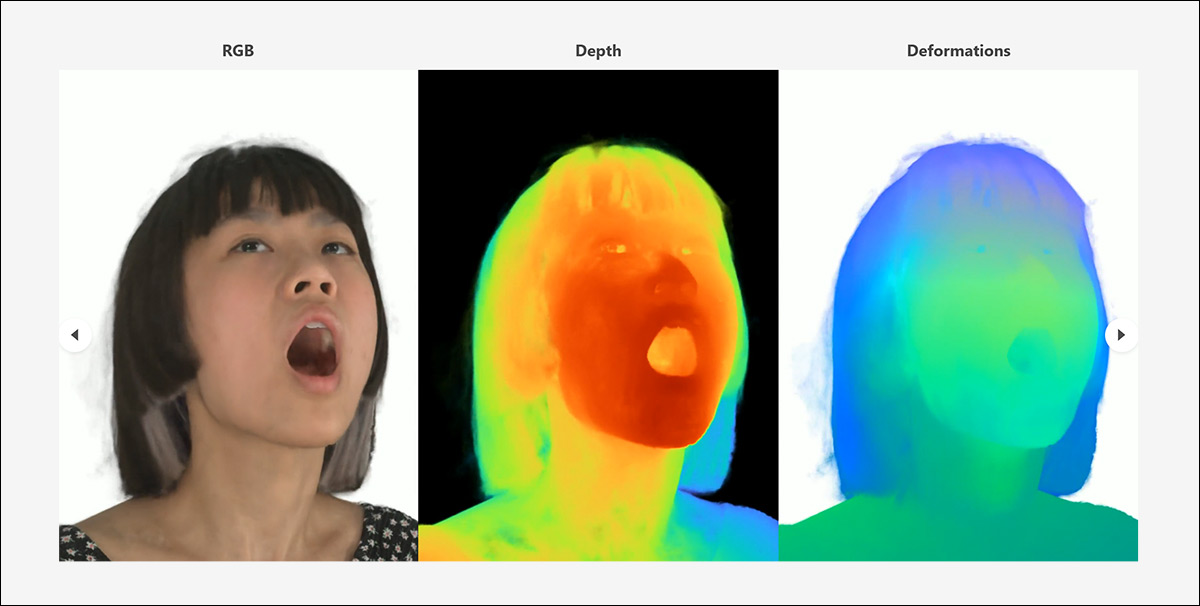

For tester, ble den nye metoden evaluert på NeRSemble-datasetten, som består av multi-viewport-videoer for hver enkelt subjekt dekket, med kalibrerte parametre over alle visninger:

Eksempler på diverse tolkninger av subjekter inkludert i NeRSemble-datasett brukt i tester for ProgressiveAvatars. Kilde

I linje med den opprinnelige GaussianAvatars-metodikken, ble bildene nedskalert til 802x550px, og en forgrunnsmask generert, og det opprinnelige prosjektets trening/test split ble adoptert.

Adam-optimisereren ble brukt for parameteroppdateringer, med en læringshastighet på 1×10-2 på alle barysentriske koordinater. Trening kjørte for 60 000 iterasjoner, med hierarkiet automatisk utvidet hver 2 000. iterasjon.

Først testet forfatterne for rekonstruksjon og animasjon – oppgaven med å konvertere flatt video til et 3D-bevisst (x/y/x)-system, ved hjelp av FLAMEs kanoniske CGI-representasjon som ankermesh. For dette ble alle baseline-modellene trent fra scratch, og rivaliserende rammeverk testet var den ovennevnte GaussianAvatars, og PointAvatar.

For disse testene ble metrikker brukt Peak Signal-to-Noise Ratio (PSNR), Structural Similarity Index (SSIM), og Lærte Perceptual Image Patch Similarity (LPIPS):

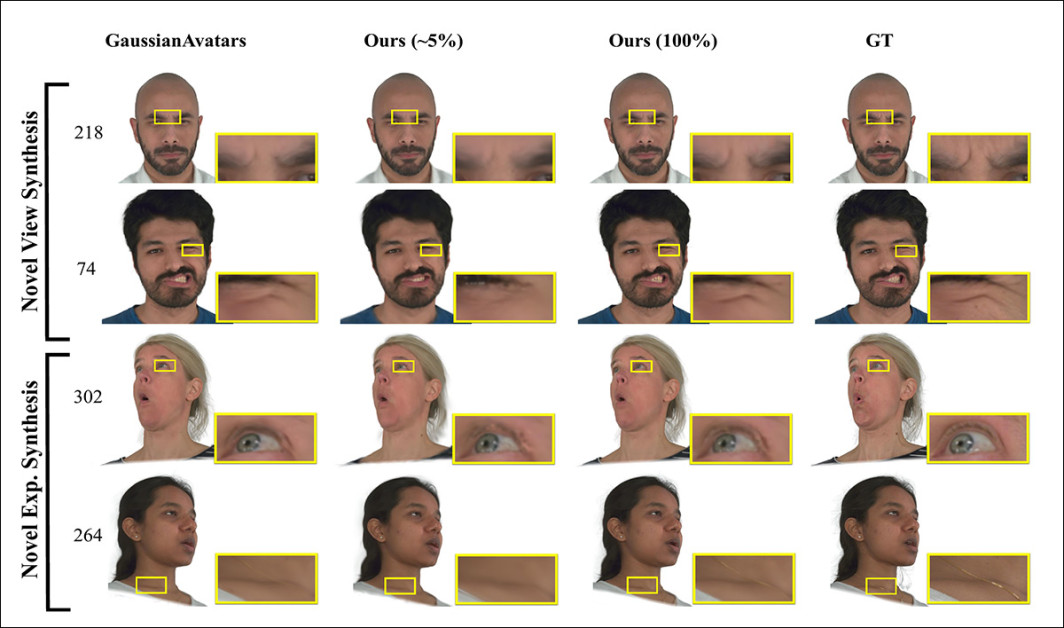

Kvalitativ sammenligning på ny-viewport- og ny-uttrykkssyntese. Baseline GaussianAvatars sliter med fin detalj rundt øyne, rynker og hudtekstur, mens den foreslåtte metoden allerede bevarer nøkkelansiktsstruktur ved omtrent fem prosent av overført data og konvergerer mot grunnssannhet mens mer Gaussianer strømmes, og nærmer seg fullmodellen og referansebilder (grunnssannhet).

Med hensyn til disse resultater, hevder forfatterne:

‘[Vår] metode rekonstruerer skarpe detaljer i flere regioner, særlig rundt halsen, skuldrene og klærne. Disse områdene er relativt grovt tessellert i FLAME-maljen sammenlignet med høy-saliens ansiktsområder (for eksempel periokulært område).

‘Derfor allokerer tidligere metoder ofte for få 3D-Gaussianer til disse områdene for å trofast fange deres fin-skala detalj. I motsetning øker vår adaptive vekststrategi antallet Gaussianer og forbedrer hierarkiet bare der det er nødvendig, og gjør allokering uavhengig av FLAMEs ikke-uniforme tessellering.’

Forfatterne merker også at deres tilnærming er på linje med state-of-the-art-metoder, og gir en fungerende avatær med en trivial 5% båndbredde-tiltak:

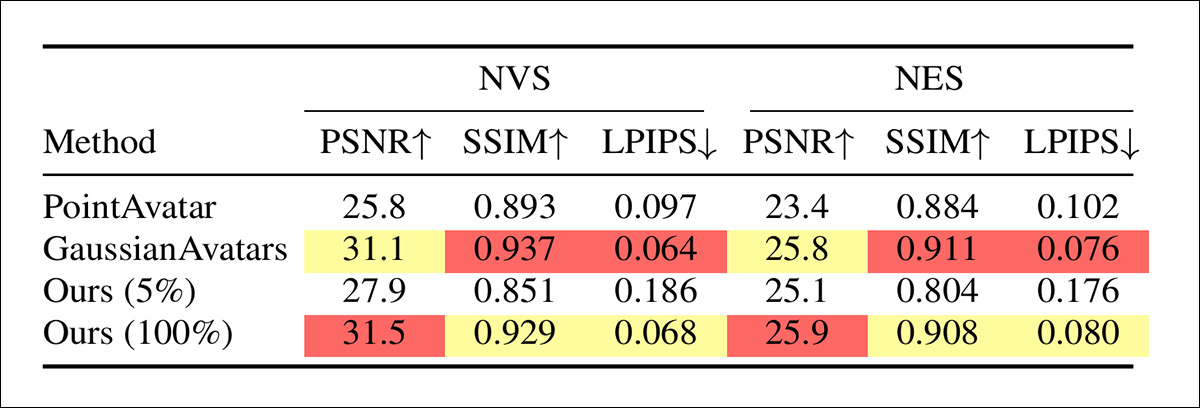

Kvantitativ sammenligning på ny-viewport-syntese og ny-uttrykkssyntese ved hjelp av PSNR, SSIM og LPIPS. Ved full overføring oppnår den foreslåtte metoden den høyeste PSNR på begge oppgaver og forblir konkurransedyktig med GaussianAvatars på perceptuelle metrikker, mens 5%-innstillingen illustrerer kvalitets-avtalen under ekstreme båndbredde-begrensninger.

Neste, testet forskerne den progressive renderingen selv. Dette ble gjort på en NVIDIA RTX 4090, med 24Gb VRAM, ved 550x802px-oppløsning. I dette scenarioet merker forfatterne at en 25%-budsjett ville bruke opp alle ‘nivå 1’-Gaussianer, samt en undergruppe av nivå 2-Gaussianer, som gir en omtrentlig oversikt over hvordan Gaussian-grupperingene samler detalj i de høyere nummergruppene, og at de lavere nummergruppene i hovedsak bygger den grunnleggende canvasen:

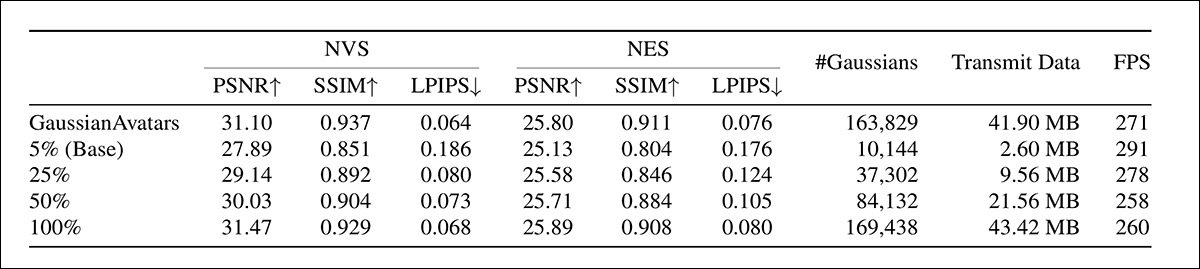

Ytelse under forskjellige overføringsbudsjett for ny-viewport- og ny-uttrykkssyntese, som viser at kvalitet stadig nærmer seg eller overgår GaussianAvatars mens mer Gaussianer og data strømmes, mens sanntids-hastigheter opprettholdes, på en RTX 4090.

Forfatterne kommenterer:

‘Med bare 2,60 MB overført (5% budsjett), har avatæren allerede oppnådd rimelig kvalitet. Mens høyere-nivå-Gaussianer strømmes, skjerper fine strukturer som skjorteknapper, tenner og hår gradvis, mens tidsmessig stabilitet opprettholdes.

‘Ved 100% overføring, oppnår vår tilnærming en rendringskvalitet som er sammenlignbar med SOTA-metoder. Merkelig nok, faller rammeraten ikke betydelig, sannsynligvis fordi 3DGS-arbeidsbelastningen ennå ikke har mettet GPUen.’

Men forfatterne merker også at i multi-bruker VR-scenarier, ville antallet 3D-Gaussianer raskt vokse til et punkt hvor GPU-rasterisering blir en flaskehals. I disse tyngre scenariene, tilbyr den foreslåtte tilnærmingen en fordel ved å tillate systemet å avveie antallet primitiver mot visuell kvalitet, og lettet belastningen uten å kollapse rendringen.

Selv om artikkelen ikke detaljerer det, har prosjektets nettsted flere sammenligninger, også med MeGA-hybrid mesh-Gaussian-avatær-prosjektet:

Klikk for å spille. En av en serie suppleringer fra artikkelen, denne sammenligner den nye tilnærmingen i forhold til ny-viewport-syntese.

Konklusjon

Gaussian Splatting kan eller kan ikke vare, eller bli husket mye mer enn RealPlayer nå er, i forhold til gryningen av interaktiv strømming: AI-drevne eller AI-assisterte 3D-bevisste representasjonsopplevelser, inkludert video-samtale, virtuell handle, rute-navigasjon og diverse underholdningsapplikasjoner. Det kan være at alternative teknologier eller tilnærminger seirer, eller at GSplat-proven er den mest pålitelige AI-video-representasjonen.

Hvis ikke annet, høres denne interessante nye artikkelen ut som en del av omfanget av denne nye domenen, og minner oss, kanskje nostalgisk, om båndbredde-sviktende internett i gamle dager.

* Ved ‘3D’ mener jeg ikke den type opplevelse som krever spesielle briller, men snarere opplevelser hvor multimediainnholdet har en form for forståelse av X/Y/Z-koordinater.

Først publisert onsdag, 18. mars 2026