Kunstig intelligens

Synthese av menneskebilder fra reflekterte radiobølger

Forskere fra Kina har utviklet en metode for å syntetisere nære fotorealistiske bilder av mennesker uten kameraer, ved å bruke radiobølger og Generative Adversarial Networks (GANs). Systemet de har utviklet er trenet på virkelige bilder tatt i god lys, men er i stand til å fange relativt autentiske ‘snapshots’ av mennesker selv når forholdene er mørke – og selv gjennom større hindringer som ville skjule menneskene for konvensjonelle kameraer.

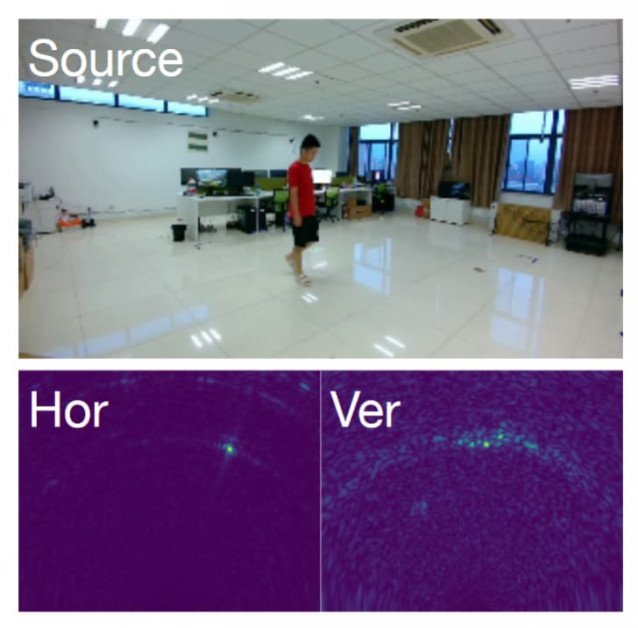

Bildene avhenger av ‘varme-kart’ fra to radiantenner, en som fanger data fra taket ned, og en annen som registrerer radiobølge-forstyrrelser fra en ‘stående’ posisjon.

De resulterende fotoene fra forskernes proof-of-concept-eksperimenter har et ansiktsløst, ‘J-Horror’-aspekt:

RFGAN er trenet på bilder av virkelige mennesker i kontrollerte miljøer og på radiobølge-varme-kart som registrerer menneskelig aktivitet. Etter å ha lært trekk fra dataene, kan RFGAN så generere snapshots basert på nye RF-data. Det resulterende bildet er en approksimering, basert på den begrensede oppløsningen av de lave frekvens RF-signalene som er tilgjengelig. Denne prosessen fungerer selv i mørke miljøer, og gjennom en rekke potensielle hindringer. Kilde: https://arxiv.org/pdf/2112.03727.pdf

For å trene GAN, kalt RFGAN, brukte forskerne sammenføyde data fra et standard RGB-kamera, og fra de tilhørende radiobølge-varme-kartene som ble produsert på det eksakte øyeblikket for opptak. Bilder av syntetiske mennesker i det nye prosjektet tenderer til å være uskarpe på en måte som ligner tidlig Daguerreotype-fotografering, fordi oppløsningen av radiobølgene som brukes er svært lav, med en dybdeoppløsning på 7,5 cm, og en vinkeloppløsning på omtrent 1,3 grader.

Ovenfor, bildet som matet GAN-nettverket – nedenfor, de to varme-kartene, horisontal og vertikal, som karakteriserer personen i rommet, og som syntetiseres selv innenfor arkitekturen til en 3D-representasjon av de forstyrrede dataene.

Den nye artikkelen, tittelen RFGAN: RF-Basert Menneskesynthese, kommer fra seks forskere fra University of Electronic Science and Technology of China.

Data og Arkitektur

På grunn av mangelen på noen tidligere datasett eller prosjekter som delte dette omfanget, og det faktum at RF-signaler ikke har blitt brukt tidligere i et GAN-bilde-syntese-rammeverk, måtte forskerne utvikle nye metoder.

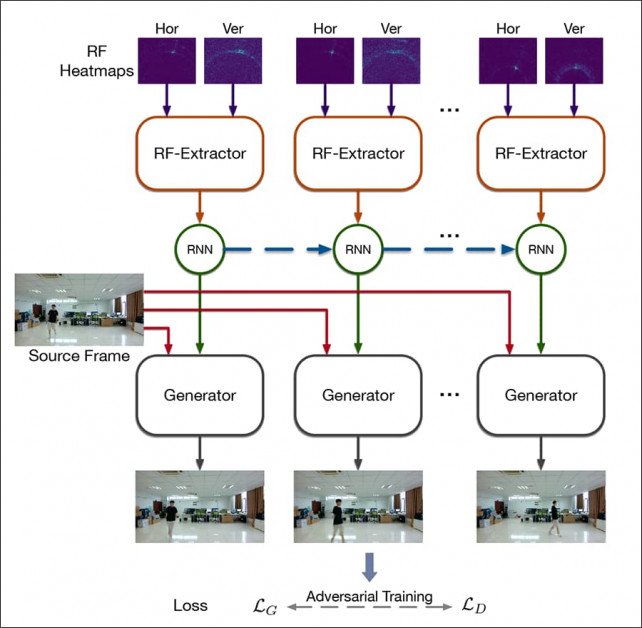

Kjerne-arkitekturen til RFGAN.

Adaptiv normalisering ble brukt til å tolke de doble varme-kart-bildene under trening, så de korresponderer romlig med de fanget bildedataene.

RF-fangst-enhetene var millimeter-bølge (mmWave) radarer konfigurert som to antennearrayer, horisontal og vertikal. Frekvens-Modulert Kontinuerlig Bølge (FMCW) og lineære antenner ble brukt for transceiving.

Generatoren mottar en kilde-ramme som en inndata-lag, med RF-fusjon (varme-kart)-representasjonen som orkestrerer nettverket gjennom normalisering på nivået av konvolusjons-lagene.

Data

Dataene ble samlet inn fra RF-signal-refleksjoner fra mmWave-antennen med en frekvens på bare 20 Hz, med samtidig menneske-video fanget i en svært lav hastighet på 10 fps. Ni innendørs-scener ble fanget, med seks frivillige, hver av dem iført forskjellige klær for ulike sesjoner av data-innsamlingen.

Resultatet var to distinkte datasett, RF-Activity og RF-Walk, den første inneholdt 68 860 bilder av mennesker i ulike posisjoner (slik som squat og walk), sammen med 137 760 tilhørende varme-kart-rammer; og den andre inneholdt 67 860 menneske-tilfeldige-gå-rammer, sammen med 135 720 par av tilhørende varme-kart.

Dataene, ifølge konvensjon, ble delt ujevnt mellom trening og testing, med 55 225 bilde-rammer og 110 450 varme-kart-par brukt til trening, og resten holdt tilbake for testing. RGB-fangst-rammer ble større til 320×180, og varme-kartene større til 201×160.

Modellen ble deretter trenet med Adam med en konstant læringshastighet på 0,0002 for både generatoren og diskriminatoren, på en epoke på 80 og en (svært sparsom) batch-størrelse på 2. Treningen skjedde via PyTorch på en forbruker-nivå enkelt GTX-1080 GPU, hvis 8 GB VRAM ville vanligvis bli betraktet som ganske beskjedent for en slik oppgave (forklaringen for den lave batch-størrelsen).

Selv om forskerne tilpasset noen konvensjonelle mål for å teste realisme av utgangen (detaljert i artikkelen), og utførte de vanlige ablasjonstestene, var det ingen tilsvarende tidligere arbeid mot å måle RFGANs ytelse.

Åpen Interesse i Hemmelige Signaler

RFGAN er ikke det første prosjektet som forsøker å bruke radiofrekvenser til å bygge en volumetrisk bilde av hva som skjer i et rom. I 2019 utviklet forskere fra MIT CSAIL en arkitektur kalt RF-Avatar, i stand til å rekonstruere 3D-mennesker basert på radiofrekvens-signaler i Wi-Fi-området, under alvorlige forhold av okklusjon.

I MIT CSAIL-prosjektet fra 2019, ble radiobølger brukt til å fjerne okklusjoner, selv inkludert vegger og klær, for å rekonstruere fangete subjekter i en mer tradisjonell CGI-basert arbeidsflyt. Kilde: https://people.csail.mit.edu/mingmin/papers/rf-avatar.pdf

Forskerne i den nye artikkelen anerkjenner også løst-relatert tidligere arbeid rundt miljø-kartlegging med radiobølger (ingen av dem forsøker å rekonstruere fotorealistiske mennesker), som søkte å estimere menneske-hastighet; se gjennom vegger med Wi-Fi; evaluere menneske-poser; og sogar gjenkjenne menneske-gest, blant andre mål.

Overførbarhet og Videre Anvendelse

Forskerne satte deretter ut til å se om deres oppdagelse var over-tilpasset det innledende fangst-miljøet og trening-omstendighetene, selv om artikkelen tilbyr få detaljer om denne fasen av eksperimentet. De hevder:

‘For å distribuere vår modell i et nytt scenario, trenger vi ikke å trene hele modellen fra starten. Vi kan finjustere den forhånds-trente RFGAN med svært lite data (omtrent 40 sekunders data) for å få lignende resultater.’