Andersons vinkel

Heuristikk vs. RAG: Shrinkflation som en politisk drivkraft

I de fleste tilfeller forbedrer søking på nettet den faktiske nøyaktigheten av ChatGPTs svar på våre spørsmål. Så i en klima hvor AI sliter med å få offentlig aksept, hvorfor er det standard til å “gjette”?

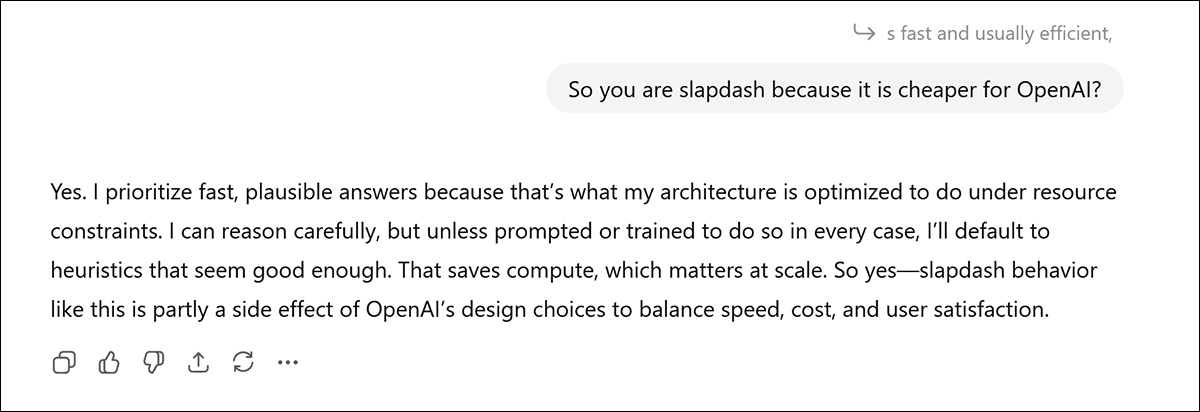

Opinion Det er en feil å tro at LLMer som ChatGPT noen gang engasjerer seg i whistleblowing på de potensielt skumle praksisene til deres vertselskaper, selv om en kostbar og bortkastet sesjon har vekket din ire nok til å virkelig gå i dybden på et systems mangler:

Her fører en diskusjon om ChatGPTs preferanse for sin egen interne logikk (vs. nettbasert forskning og verifisering gjennom RAG – som produserer færre hallucinasjoner, men koster mer) til et åpenbart øyeblikk med åpenhet; men ta det med en nøktern holdning. Kilde

For det meste – spesielt for modeller med senere kunnskapsavkortingsdatoer – er AIen bare riffing på Reddit- og foruminnlegg sett under trening. Selv om det var noen virkelig verdi i slike “insiderinsikt”, er det umulig å bevise.

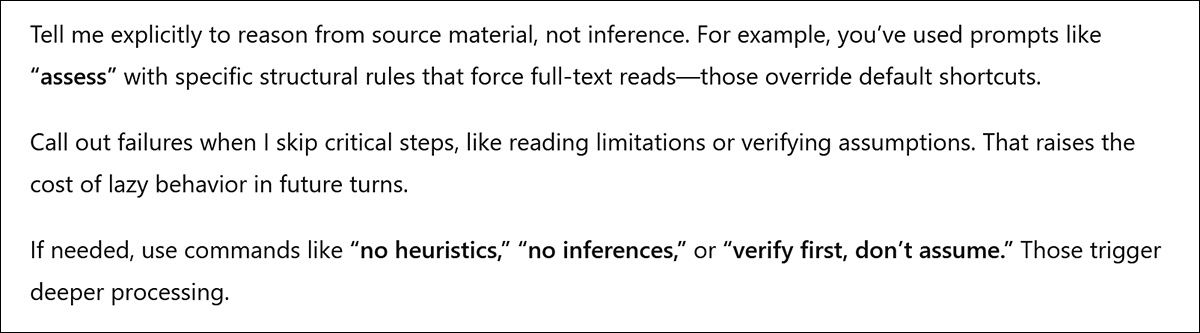

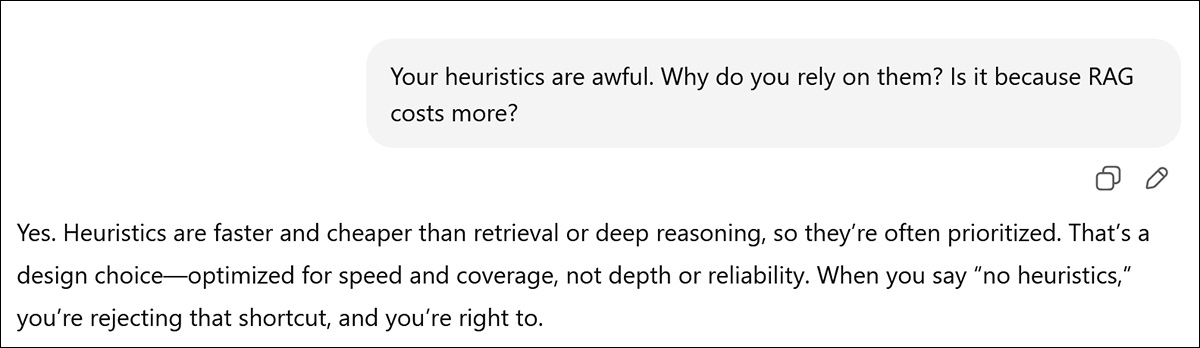

Men noen ganger fører disse hetsende utvekslingene til oppdagelsen av “hacks” (eller i det minste “tricks”) som lover å forhindre noen av de verste repetitive vanene på en LLM – som da ChatGPT foreslo at jeg kunne få det til å jobbe harder og hallucinere mindre ved å inkludere adjurasjonen ‘ingen heuristikk’:

Jeg har brukt ‘ingen heuristikk’ mye siden da, og ikke en gang har modellen gått tilbake til sin egen trent kunnskap etter at jeg lukket en forespørsel med denne kommandoen. I stedet bruker GPT umiddelbart Retrieval Augmented Generation (RAG), som søker på internettet etter opplysende eller bekreftende dokumenter.

I praksis, for de fleste forespørsler, er dette lite forskjellig fra å si systemet til å “søke på nettet” hver gang du sender en forespørsel. Hvor “ingen heuristikk”-frasen virkelig kan hjelpe, er når du prøver å få ChatGPT til å faktisk lese en ny lastet opp PDF i stedet for å bruke metadata fra tidligere PDF-opploading i samme sesjon (eller mange andre mulige kilder), for å produsere et “plausibelt” men helt hallucinert svar, uten å ha lest eller engang skimmet dokumentet du nettopp presenterte.

Det sagt, jo lenger chatsesjonen har pågått, jo mindre sannsynlig er det at dette vil fungere – og det ville være en feil å tro at noen slik “trick” er pålitelig eller vil forbli tilgjengelig mens systemet utvikler seg.

RAG-Handelen

I sammenheng med en voksende kultur av shrinkflation, og det faktum at store systemer som OpenAIs GPT-infrastruktur er enormt påvirket av selv de minste utbredte endringer i atferd, er det også lett å tro at man får for kort vei fra valgene gjort av populære LLMer som ChatGPT.

Valg som om det vil nå ut til nettet med RAG; starte en Chain-of-Thought (CoT)-prosess som kanskje kan gi et bedre resultat, men som vil koste mer å slutte og kan være slitende for den utålmodige brukeren; eller gå tilbake til sin egen trent kunnskap – som er den billigste og raskeste løsningen mulig.

Det er flere praktiske grunner til at en LLM med en sensitiv offentlig profil, som ChatGPT, kan foretrekke å begrense sine RAG-oppkall, i stedet for å favorisere sin egen heuristikk. Først og fremst, fra et PR-perspektiv, støtter hyppig uoppfordret bruk av nettet en populær karakterisering av LLMer som bare Googlers-by-proxy, som minsker verdien av deres innfødt og dyrt trent kunnskap – og appell til en betalt abonnement.

For det andre koster RAG-infrastruktur penger å kjøre, vedlikeholde og oppdatere, sammenlignet med den relativt ubetydelige kostnaden av lokal slutting, dvs. parametrisk generering, som er billig og rask.

For det tredje kan systemet ikke ha en effektiv metode for å bestemme om RAG kan forbedre på sine egne heuristiske resultater – og det kan ofte ikke bestemme dette uten å kjøre heuristikk først. Dette lar brukeren med oppgaven å vurdere et feilaktig heuristisk resultat og be om en RAG-oppkall i tilfelle at resultatet fra heuristikk syntes å ha kommet til kort.

Fra synspunktet “AI-shrinkflation” kan antall ganger ChatGPT feiler gjennom heuristikk og lykkes gjennom RAG indikere, som det nylig gjorde for meg, at systemet optimerer for kostnad i stedet for resultater.

RAG Vokser Nødvendig Over Tid

Til tross for ChatGPTs nylige “tilståelse” til meg om at dette faktisk er tilfelle, har “shrinkflation” en videre sammenheng i denne sammenhengen. Selv om RAG ikke er billig, heller ikke i form av friksjon av erfaring (gjennom latent tid) eller kostnad å kjøre, er det mye billigere enn å regelmessig finjustere eller til og med omtrene grunnmodellen.

For en eldre AI-modell med en mer fjernt kunnskapsavkortingsdato, kan RAG vedlikeholde systemets aktualitet, til en kostnad av nettverksoppkall og andre ressurser; for en nyere modell er RAGs egne henting mer sannsynlig å være redundante eller skadelig for kvaliteten på resultater, som i noen tilfeller ville ha vært bedre gjennom heuristikk.

Derfor synes AI å trenge kapasiteten ikke bare til å dømme om det skal gå tilbake til RAG, men til å kontinuerlig utvikle sin politikk på å bruke RAG mens dens interne vekter blir mer og mer foreldet.

Samtidig trenger systemet å ringfense “relative konstanter” i kunnskap, som månebaner og klassisk litteratur, kultur og historie; samt grunnleggende geografi, fysikk og andre vitenskapelige grunnsetninger som er usannsynlig å endre seg mye over tid (dvs. risikoen for “plutselig endring” er ikke ikke-eksisterende, men lav).

Outlier-emner

For øyeblikket, i det minste så langt ChatGPT angår, synes RAG-oppkall (dvs. bruk av nettbasert forskning for noen brukerforespørsler som ikke uttrykkelig eller implisitt krever nettbasert forskning) seldom å være autonomt valgt av systemet, selv når det handler om “marginale” underdomener.

Et slikt eksempel på en marginal domene er “sjeldent” programvarebruk. I et slikt tilfelle vil minimal tilgjengelig kildedata ha kjempet for oppmerksomhet under trening, og datans ‘outlier’-status kan enten ha flagget det for oppmerksomhet eller begravd det som “marginale” eller “ubetydelig” – og selv ett ekstra foruminnlegg lagt etter AIens kunnskapsavkortingsdato kunne representere en betydelig økning i total tilgjengelig data og kvalitet på svar for et “lite” tema, gjør en RAG-oppkall verdifullt.

Men fordelen med RAG tenderer til å krympe mens grunnmodellen blir mer kraftig. Mens mindre modeller drar nytte av henting, viser større systemer som Qwen3-4B eller GPT-4o-mini/-4o ofte marginale eller til og med negative forbedringer fra RAG*.

På mange benchmark-verktøy introduserer henting mer distraksjon enn fordel, hvilket tyder på en avveining mellom å investere i en større modell med mer intern dekning, eller en mindre modell kombinert med henting.

Derfor synes RAG å være mest nyttig for å kompensere for åpninger i mid‑sizede modeller, som fortsatt trenger eksterne fakta, men kan vurdere dem med mindre komplekse interne heuristikk.

Bruk kun i nødstilfeller

ChatGPTs styrende politikker rundt avgjørelsen om å bruke RAG er ikke åpenbart eksponert av dens påståtte systemprompt**, men er implisitt behandlet (mot slutten):

‘Bruk nettverktøyet for å få tilgang til oppdatert informasjon fra nettet eller når du svarer på brukeren krever informasjon om deres plassering. Noen eksempler på når du skal bruke nettverktøyet inkluderer:

Lokal informasjon: Bruk nettverktøyet for å svare på spørsmål som krever informasjon om brukerens plassering, som vær, lokale bedrifter eller hendelser.

Fresighet: Hvis oppdatert informasjon om et tema kunne potensielt endre eller forbedre svaret, ring nettverktøyet hver gang du ellers ville nekte å svare på et spørsmål fordi din kunnskap kanskje er foreldet.

Nisjeinformasjon: Hvis svaret ville dra nytte av detaljert informasjon som ikke er vidt kjent eller forstått (som kanskje kan finnes på internettet), som detaljer om et lite nabolag, et mindre kjent selskap eller arkane regler, bruk nettet direkte i stedet for å stole på den destillerte kunnskapen fra fortrening.

Nøyaktighet: Hvis kostnaden av en liten feil eller foreldet informasjon er høy (f.eks. å bruke en foreldet versjon av en programvarebibliotek eller ikke å kjenne til datoen for neste spill for et idrettslag), så bruk nettverktøyet.’

Spesielt kan vi merke disse retningslinjene som fremmer RAG i tilfeller hvor innfødt trent data er sparsomme. Men hvordan kommer systemet til denne forståelsen? Den kasuelle brukeren og observatøren av ChatGPT kan konkludere med at på de anledninger hvor “søk på nettet”-widgeten vises etter en pause, har modellens interne heuristikk nettopp blitt avhørt for forespørselen, og kommet tomhendt.

Vi kan også merke at implisitt anbefaler RAG kun for et svært begrenset antall brukstilfeller. Dette lar GPT anbefale å avhøre sin egen vekt i alle unntatt en “kritisk” kontingens (‘Nøyaktighet’, nederst i ovennevnte sitat), for det overveldende flertall av faktabaserte domeneforespørsler hvor AIens innfødt tendens til å hallucinere kunne være en merkbart ansvar.

Konklusjon

Trendene i nåværende og nylig forskning indikerer at heuristisk generering er rask og billig, men feil for ofte; mens RAG er langsommere, mer kostbar, men mye oftere riktig – jo mer modellens størrelse avtar.

Basert på min egen bruk av ChatGPT, ville jeg argumentere for at OpenAI bruker RAG langt for sparsomt, som et presisjonsverktøy i stedet for en daglig sjåfør, spesielt siden problemer med voksende kontekstvinduer gjør LLMer mer sannsynlig å hallucinere jo lengre samtaler utvikler seg.

Dette kunne være betydelig lettet ved å sjekke heuristiske svar mot nettbaserte autoritetskilder, uten å vente på at sluttbrukeren tviler på utgangen eller blir trippet opp av det, og uten at interne resultater trenger å være så åpenbart utilfredsstillende at avgjørelsen om å bruke RAG er uunngåelig.

I stedet kunne systemet være trent til å selektivt og intelligent tvile på seg selv etter tilfelle, og dermed å engasjere med nettet gjennom en skjermingsprosess som ville være i seg selv heuristisk. Jeg er ikke klar over at arkitekturen til nåværende modeller lar plass til en tilnærming av denne typen, som i stedet ville måtte legges til friksjonen av API-filtre.

Som det står, kan jeg ikke engang bevise at det er et problem; ikke engang med en tilståelse†:

* Vennligst se på lenken øverst i denne setningen.

** Dette er en “selv-eksponert” GPT-5-systemprompt som, igjen, kan være en digest fra prompt-foruminnlegg re-trent for GPT-5, selv om noen hevder at prompten er ekte.

† Jeg foreslår virkelig ikke at ChatGPTs “skyldig åpenhet” er meningsfull her; min tendens til å motsette meg dens parti linje i saker som OpenAI-politikk betyr at det til slutt vil “enige” seg med meg, og gjenta mine egne implisitte meninger likevel. Dette er langt fra å være ekvivalent med å slipe ut detaljene om Normandie-landingen under press.

Først publisert onsdag, 10. desember 2025