Kunstig intelligens

Desentangling er den neste dypte-fake-revolusjonen

CGI-dataforbedring brukes i et nytt prosjekt for å få større kontroll over dypte-fake-bilder. Selv om du fortsatt ikke kan bruke CGI-hoder til å fylle hullene i dypte-fake-ansiktsdatasett, betyr en ny bølge av forskning på å skille identitet fra kontekst at du snart kanskje ikke trenger det.

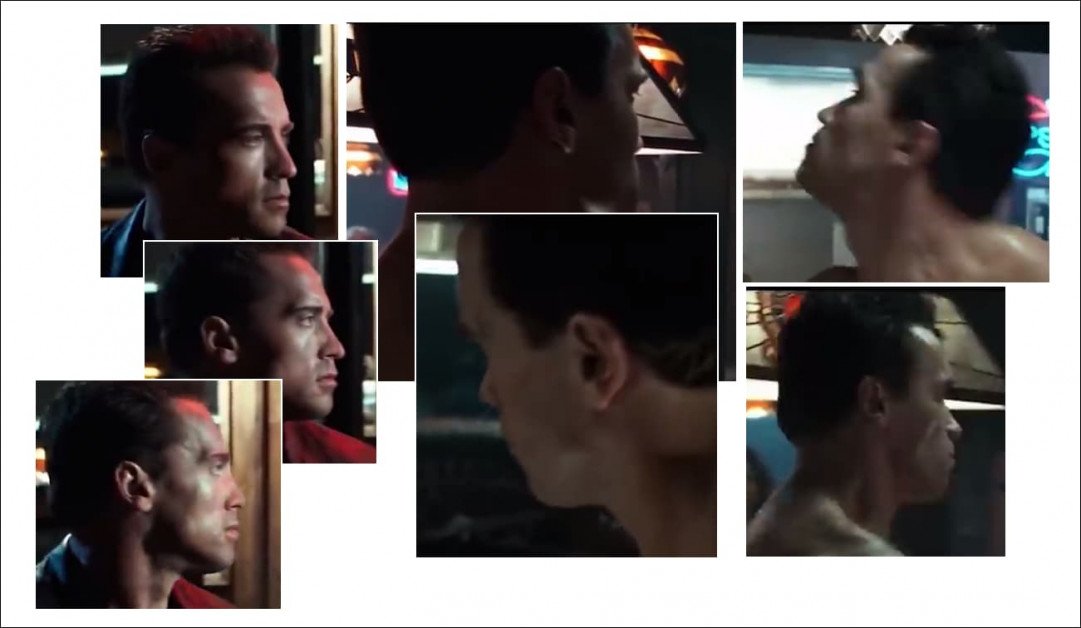

Skaperne av noen av de mest suksessfulle virale dypte-fake-videoene de siste årene velger sine kildevideoer svært omsorgsfullt, og unngår vedvarende profilbilder (dvs. sideprofiler som er populære i politiets arrestprosedyrer), skarpe vinkler og usedvanlige eller forsterkede uttrykk. Økende, er demonstrasjonsvideoene produsert av virale dypte-fake-kunstnere redigerte sammenstillinger som velger de “enkleste” vinklene og uttrykkene å dypte-fake.

I virkeligheten er den mest tilgjengelige målet-videoen for å sette inn en dypte-fake-kjendis en der den opprinnelige personen (hvis identitet vil bli slettet av dypte-faken) ser rett inn i kameraet, med et minimalt uttrykksregister.

Flertallet av populære dypte-faker de siste årene har vist subjekter som ser rett inn i kameraet, og enten bærer kun populære uttrykk (slik som smil), som kan lett trekkes ut fra røde teppe-paparazzibilder, eller (som med den falske Sylvester Stallone som Terminator, bildet til venstre), ideelt med ingen uttrykk i det hele tatt, siden nøytrale uttrykk er ekstremt vanlige, og derfor lett å inkorporere i dypte-fake-modeller.

Fordi dypte-fake-teknologier som DeepFaceLab og FaceSwap utfører disse enklere byttinger svært godt, er vi tilstrekkelig imponert over hva de oppnår, til å ikke merke hva de ikke er i stand til, og – ofte – ikke engang forsøker:

Graber fra en anerkjent dypte-fake-video hvor Arnold Schwarzenegger blir forvandlet til Sylvester Stallone – med mindre vinklene er for trikseye. Profiler er et varig problem med nåværende dypte-fake-tilnærminger, delvis fordi åpen kildekode-programvare brukt til å definere ansiktsposer i dypte-fake-rammeverk ikke er optimalisert for sidevisninger, men hovedsakelig fordi av mangelen på egnet kildeinformasjon i enten ett eller begge av de nødvendige datasettene. Kilde: https://www.youtube.com/watch?v=AQvCmQFScMA

Ny forskning fra Israel foreslår en ny metode for å bruke syntetisk data, som CGI-hoder, til å bringe dypte-fake inn i 2020-årene, ved å skille identitet fra kontekst (dvs. de essensielle ansiktskarakteristikkene til ‘Tom Cruise’, fra alle vinkler) fra dens kontekst (dvs. å se opp, å se sidelengs, å rynke, å rynke i mørket, å fryne, å lukke øynene, osv.).

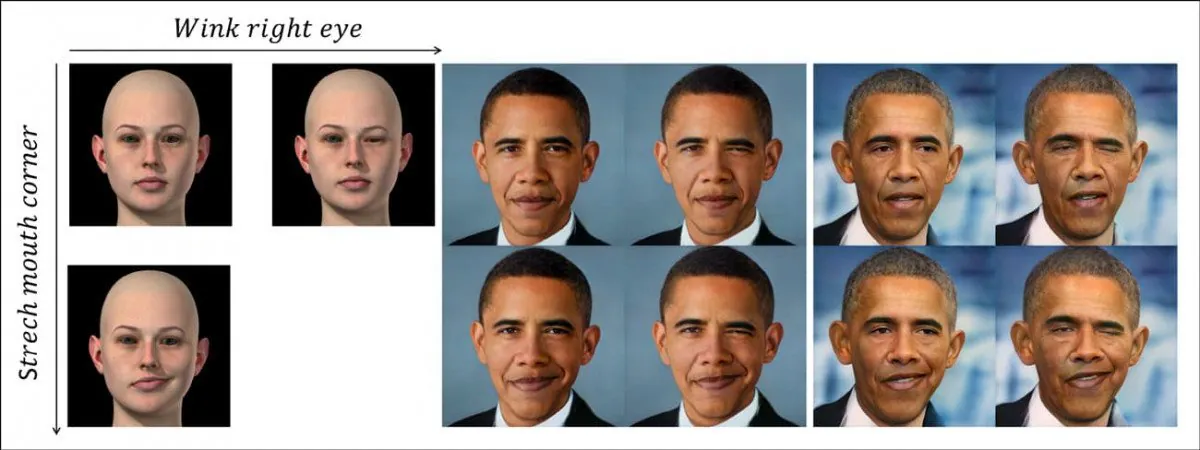

Det nye systemet skiller posisjon og kontekst (dvs. å blunke et øye) fra den enkeltes identitetskode, ved å bruke uavhengig syntetisk ansiktsdata (avbildet til venstre). I øverste raden ser vi en ‘blunk’ overført til identiteten til Barack Obama, fremmet av den lærte ikke-lineære banen til en GANs latente rom, representert av CGI-bildet til venstre. I raden under ser vi den strekte munndreksfacet overført til den tidligere presidenten. Nederst til høyre ser vi begge karakteristika brukt samtidig. Kilde: https://arxiv.org/pdf/2111.08419.pdf

Dette er ikke bare dypte-fake-hoddukke, en teknikk mer egnet for avatarer og delvis ansikts-lip-synkronisering, og som har begrensede muligheter for fullstendige dypte-fake-video-omforminger.

Snarere representerer dette en vei fremover for en grunnleggende skille mellom instrumentell (slik som ‘endre vinkelen på hodet’, ‘skape en rynke’) fra identitet, og tilbyr en vei til en høynivå snarere enn ‘avledet’ bilde-syntese-basert dypte-fake-rammeverk.

Det nye papiret har tittelen Delta-GAN-Encoder: Encoding Semantic Changes for Explicit Image Editing, using Few Synthetic Samples, og kommer fra forskere ved Technion – Israel Institute of Technology.

For å forstå hva arbeidet betyr, la oss se på hvordan dypte-faker nå produseres overalt fra dypte-fake-porno-sider til Industrial Light and Magic (siden DeepFaceLab åpen kildekode-repository er nå dominerende i både ‘amatør’ og profesjonell dypte-faking).

Hva holder tilbake nåværende dypte-fake-teknologi?

Dypte-faker produseres nå ved å trene en encoder/decoder maskinlæringsmodell på to mapper med ansiktsbilder – personen du vil ‘male over’ (i tidligere eksempel, det er Arnie) og personen du vil overføre inn i filmen (Sly).

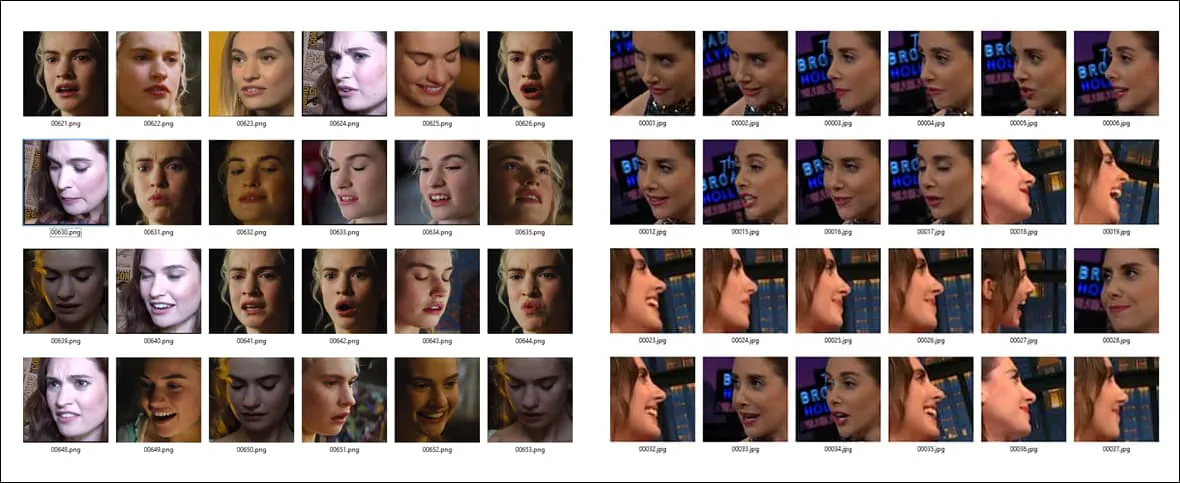

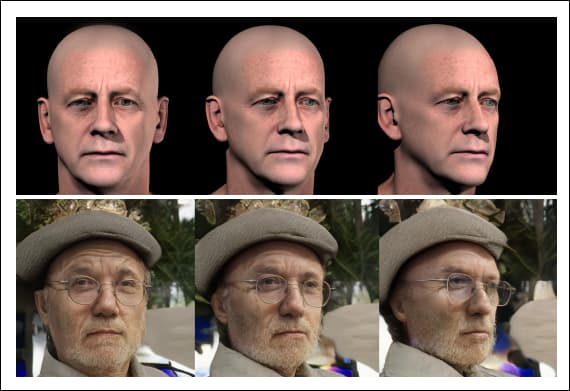

Eksempler på varierende posisjon og lysforhold over to forskjellige ansiktssett. Merk den karakteristiske uttrykket i slutten av tredje raden i kolonne A, som er usannsynlig å ha en nært ekvivalent i det andre datasettet.

Encoder/decoder-systemet sammenligner så hver enkelt bilde i hver mappe til hverandre, vedlikeholder, forbedrer og gjentar denne operasjonen for hundredtusener av iterasjoner (ofte i så lenge som en uke), til det forstår de essensielle karakteristikkene til begge identiteter godt nok til å bytte dem rundt etter ønske.

For hver av de to personene som byttes i prosessen, er det dypte-fake-arkitekturen lærer om identitet entangled med kontekst. Det kan ikke lære og anvende prinsipper om en generisk posisjon ‘for godt og alltid’, men trenger mange eksempler i treningsdatasettet, for hver og enkelt identitet som skal være involvert i ansiktsbyttet.

Derfor, hvis du vil bytte to identiteter som gjør noe mer uvanlig enn bare å smile eller se rett inn i kameraet, trenger du mye eksempler på den spesifikke posisjonen/identiteten over begge ansiktssett:

Fordi ansikts-ID og posisjonskarakteristika nå er så sammenflettet, er en vidtfavnende likhet i uttrykk, hodeposisjon og (i mindre grad) lysforhold nødvendig over to ansiktsdatasett for å trene en effektiv dypte-fake-modell på systemer som DeepFaceLab. Jo mindre en bestemt konfigurasjon (slik som ‘sidevisning/smiling/solbelyst’) er fremtredende i begge ansiktssett, jo mindre nøyaktig vil den rendre i en dypte-fake-video, hvis nødvendig.

Hvis sett A inneholder den uvanlige posisjonen, men sett B mangler den, er du ganske enkelt ute av hell; uansett hvor lenge du trener modellen, vil den aldri lære å gjengi den posisjonen godt mellom identitetene, fordi den bare hadde halvparten av den nødvendige informasjonen under treningen.

Selv om du har matchende bilder, kan det ikke være nok: hvis sett A har den matchende posisjonen, men med skarpt sidelys, sammenlignet med den flatt belyste ekvivalent posisjonen i det andre ansiktssettet, vil kvaliteten på byttet ikke være like god som hvis hver delte felles lyskarakteristika.

Hvorfor dataene er sjeldne

Med mindre du blir arrestert jevnt, har du sannsynligvis ikke så mange sideprofiler av deg selv. Enhver som dukket opp, kastet du sannsynligvis vekk. Siden bildebyråer gjør det samme, er sideprofiler vanskelige å få tak i.

Dypte-fakere inkluderer ofte flere kopier av den begrensede sidevisningsdata de har for en identitet i et ansiktssett, bare for å sikre at posisjonen får litt oppmerksomhet og tid under trening, i stedet for å bli diskontert som en outlier.

Men det er mange flere mulige typer sidevisningsansiktsbilder enn det som sannsynligvis er tilgjengelig for inklusjon i et datasett – smil, rynke, skrike, gråte, mørkelys, forakt, kede, glad, flash-lys, å se opp, å se ned, åpne øyne, lukke øyne… og så videre. Enhver av disse posisjonene, i flere kombinasjoner, kan være nødvendig i et mål-dypte-fake-video.

Og det er bare profiler. Hvor mange bilder har du av deg selv som ser rett opp? Har du nok til å broadly representere de 10 000 mulige uttrykk du kan ha mens du holder denne eksakte posisjonen fra denne eksakte kamera-vinkelen, og dekker minst noen av de en million mulige lysmiljøer?

Sannsynligvis har du ikke engang ett bilde av deg selv som ser opp. Og det er bare to vinkler av de hundre eller flere som trengs for full dekning.

Selv om det var mulig å generere full dekning av et ansikt fra alle vinkler under en rekke lysforhold, ville det resulterende datasettet være for stort til å trene, i rekkefølgen av hundredtusener av bilder; og selv om det kunne trenes, ville naturen av treningsprosessen for nåværende dypte-fake-rammeverk kaste bort det meste av denne ekstra dataen til fordel for en begrenset mengde avledede funksjoner, fordi nåværende rammeverk er reduksjonistiske, og ikke svært skalerbare.

SYntetisk erstatning

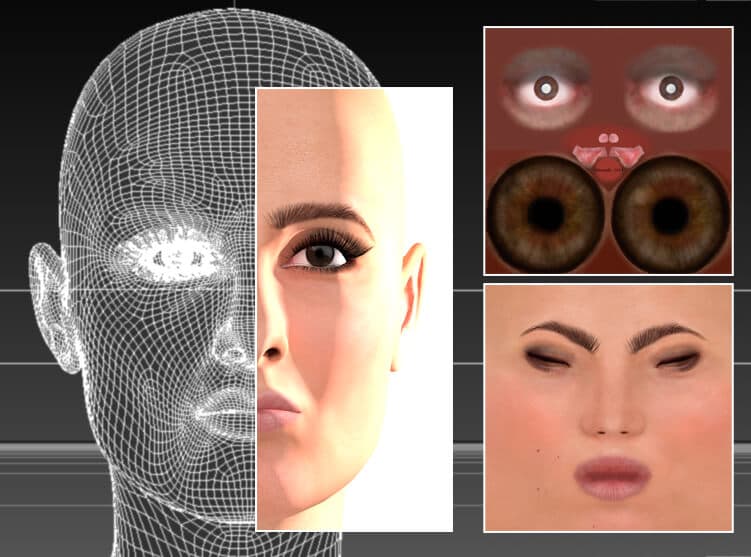

Siden dypte-fakens begynnelse har dypte-fakere eksperimentert med å bruke CGI-stil-bilder, hoder laget i 3D-applikasjoner som Cinema4D og Maya, til å generere disse ‘manglende posisjonene’.

Ingen AI nødvendig; en skuespiller blir rekonstruert i en tradisjonell CGI-program, Cinema 4D, ved å bruke mesh og bitmap-teksturer – teknologi som går tilbake til 1960-årene, selv om den først fikk bred anvendelse fra 1990-årene og utover. I teorien kunne denne ansiktsmodellen bli brukt til å generere dypte-fake-kilde-data for uvanlige posisjoner, lysstiler og ansiktsuttrykk. I praksis har det vært av begrenset eller ingen nytte i dypte-faking, siden ‘falskheten’ i renderingene tenderer å bli gjennomført i byttede videoer. Kilde: denne artikkelforfatterens bilde på https://rossdawson.com/futurist/implications-of-ai/comprehensive-guide-ai-artificial-intelligence-visual-effects-vfx/

Dette er generelt forkastet tidlig av nye dypte-fake-utøvere, fordi selv om det kan gi posisjoner og uttrykk som ellers er utilgjengelige, tenderer den syntetiske utseendet til CGI-ansiktene å bli gjennomført til byttene på grunn av sammenfletting av ID og kontekstuell/semantisk informasjon.

Dette kan føre til plutselige glimt av ‘uncanny valley’-ansikter i en ellers overbevisende dypte-fake-video, når algoritmen begynner å trekke på den eneste dataen den måtte ha for en uvanlig posisjon eller uttrykk – åpenbart falske ansikter.

Blant de mest populære subjektene for dypte-fakere, er en 3D-dypte-fake-algoritme for den australske skuespilleren Margot Robbie inkludert i standardinstallasjonen av DeepFaceLive, en versjon av DeepFaceLab som kan utføre dypte-faker i en live-strøm, som en webcam-sesjon. En CGI-versjon, som vist ovenfor, kunne bli brukt til å få uvanlige ‘manglende’ vinkler i dypte-fake-datasett. Kilde: https://sketchfab.com/3d-models/margot-robbie-bust-for-full-color-3d-printing-98d15fe0403b4e64902332be9cfb0ace

CGI-ansikter som en løs, konseptuell retningslinje

I stedet er den nye Delta-GAN Encoder (DGE)-metoden fra de israelske forskerne mer effektiv, fordi posisjons- og kontekstinformasjonen fra CGI-bildene har blitt fullstendig skilt fra ‘identitets’-informasjonen til målet.

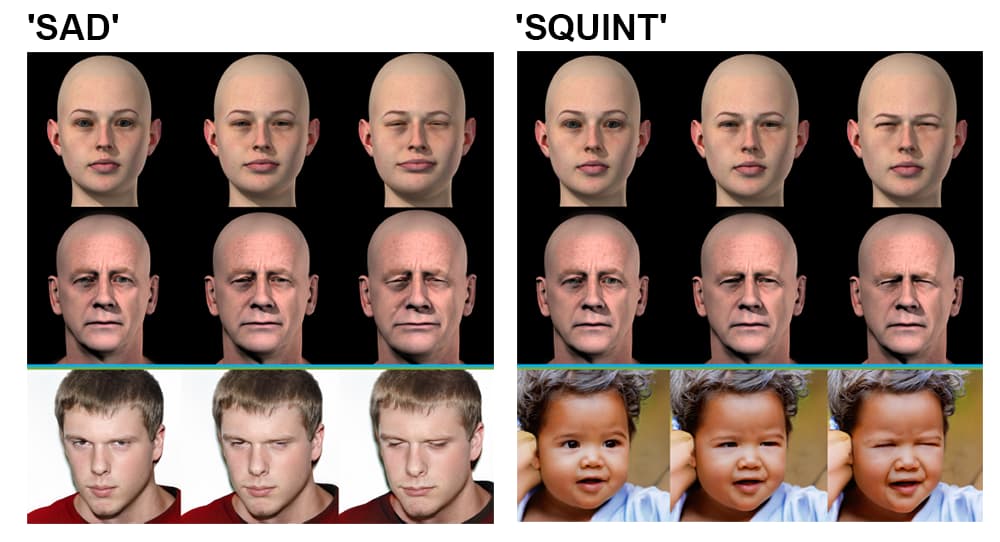

Vi kan se dette prinsippet i virksomhet i bildet under, hvor forskjellige hode-orienteringer har blitt oppnådd ved å bruke CGI-bildene som en retningslinje. Siden identitetsfunksjonene er uavhengige av kontekstfunksjonene, er det ingen gjennomføring av den falske, syntetiske utseendet til CGI-ansiktet eller identiteten avbildet i det:

Med den nye metoden trenger du ikke å finne tre separate, virkelige kildebilder for å utføre en dypte-fake fra flere vinkler – du kan bare rotere CGI-hodet, hvis høynivå-abstrakte funksjoner pålegges identiteten uten å lekke noen ID-informasjon.

Delta-GAN-Encoder. Øverste venstre gruppe: vinkelen på et kildebilde kan endres på ett sekund for å rendre et nytt kildebilde, som blir reflektert i utgangen; øverste høyre gruppe: lys er også skilt fra identitet, og tillater overføring av lysstiler; nederste venstre gruppe: flere ansiktsdetaljer endres for å skape en ‘sørgmodig’ uttrykk; nederste høyre gruppe: en enkelt ansiktsuttrykksdetalj endres, så øynene er sammenknevet.

Dette skille mellom identitet og kontekst oppnås i treningsstadiet. Rørledningen for det nye dypte-fake-arkitekturen søker etter den latente vektoren i en forhånds-trent Generative Adversarial Network (GAN) som matcher bildet som skal transformeres – en Sim2Real-metodikk som bygger på et prosjekt fra IBM’s AI-forskningsavdeling.

Forskerne observerer:

‘Med bare noen få eksempler, som skilles av en bestemt attributt, kan en lære den skilte atferden til en forhånds-trent sammenflettet generativ modell. Det er ingen behov for eksakte virkelige eksempler for å nå dette målet, som ikke nødvendigvis er mulig.

‘Ved å bruke ikke-realistiske data-eksempler, kan samme mål oppnås takket være å utnytte semantikken til de kodete latente vektorer. Å påføre ønskede endringer over eksisterende data-eksempler kan gjøres uten å utforske den latente rommet explicit.

Forskerne forventer at de grunnleggende prinsippene for skille som utforskes i prosjektet kan overføres til andre domener, som interiør-arkitektur-simuleringer, og at Sim2Real-metoden som er adoptert for Delta-GAN-Encoder kan til slutt muliggjøre dypte-fake-instrumentalitet basert på bare skisser, i stedet for CGI-stil-inndata.

Det kan hevdes at omfanget av hvilken grad det nye israelske systemet kan eller ikke kan syntetisere dypte-fake-videoer er langt mindre viktig enn fremgangen forskningen har gjort i å skille kontekst fra identitet, og dermed fått mer kontroll over den latente rommet til en GAN.

Skille er et aktivt forskningsfelt i bilde-syntese; i januar 2021 demonstrerte en Amazon-ledet forsknings papir lignende posisjonskontroll og skille, og i 2018 gjorde en papir fra Shenzhen Institutes of Advanced Technology ved det kinesiske vitenskapsakademiet fremgang i å generere vilkårlige utsikter i en GAN.