Kunstig intelligens

En AI-drevet bias-sjekker for nyhetsartikler, tilgjengelig i Python

Forskere i Canada, India, Kina og Australia har samarbeidet om å produsere en fritt tilgjengelig Python-pakke som kan brukes effektivt til å spore og erstatte ‘urettferdig språk’ i nyhetskopier.

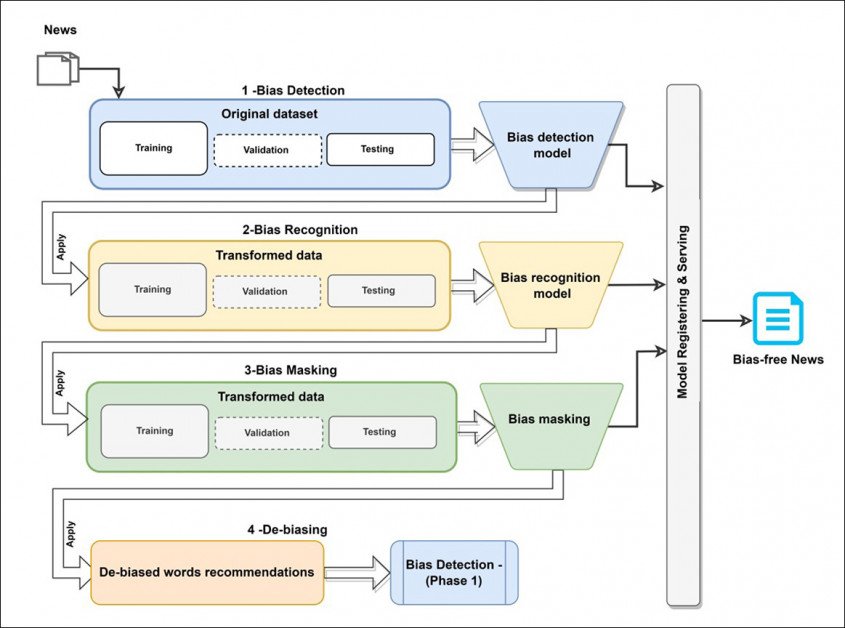

Systemet, tittelen Dbias, bruker ulike maskinlærings-teknologier og databaser for å utvikle en tre-stegs sirkulær arbeidsflyt som kan forfine forvrengt tekst til den returnerer en ubiasert, eller i det minste en mer nøytral versjon.

Loaded language in a news snippet identified as ‘biased’ is transformed into a less incendiary version by Dbias. Source: https://arxiv.org/ftp/arxiv/papers/2207/2207.03938.pdf

Systemet representerer en gjenbrukbar og selvinnholdende pipeline som kan installeres via Pip fra Hugging Face, og integreres i eksisterende prosjekter som en supplerende stage, add-on eller plugin.

I april, lignende funksjonalitet implementert i Google Docs kom under kritikk, ikke minst for mangelen på redigering. Dbias, på den andre siden, kan være mer selektivt trent på noen korpus av nyheter som sluttbrukeren ønsker, og beholde evnen til å utvikle tilpassede rettferdighetshåndhevelser.

Den kritiske forskjellen er at Dbias-pipeline er ment å automatisk transformere ‘loaded language’ (ord som legger til en kritisk lag til faktisk kommunikasjon) til nøytral eller prosaisk språk, i stedet for å skole brukeren på en kontinuerlig basis. I essensen vil sluttbrukeren definere etiske filtre og trene systemet deretter; i Google Docs-tilnærmingen er systemet – argumenterbart – i ferd med å trene brukeren, på en ensidig måte.

Conceptual architecture for the Dbias workflow.

Ifølge forskerne er Dbias den første virkelig konfigurerbare bias-avdekning-pakken, i kontrast til de ferdige samlingprosjektene som har karakterisert denne undersektoren av Natural Language Processing (NLP) til dags dato.

Den nye papiret er tittelen An Approach to Ensure Fairness in News Articles, og kommer fra bidragsytere ved University of Toronto, Toronto Metropolitan University, Environmental Resources Management at Bangalore, DeepBlue Academy of Sciences i Kina, og The University of Sydney.

Metode

Den første modulen i Dbias er Bias Detection, som utnytter DistilBERT-pakken – en høyt optimalisert versjon av Googles ganske maskinintensive BERT. For prosjektet ble DistilBERT finjustert på Media Bias Annotation (MBIC)-dataset.

MBIC består av nyhetsartikler fra en rekke mediekilder, inkludert Huffington Post, USA Today og MSNBC. Forskerne brukte den utvidede versjonen av datasettet.

Selv om den opprinnelige dataen ble annotert av crowdsourced-arbeidere (en metode som kom under kritikk sent i 2021), var forskerne i det nye papiret i stand til å identifisere ytterligere uannoterte eksempler på bias i datasettet, og la til disse manuelt. De identifiserte tilfellene av bias relaterte til rase, utdanning, etnisitet, språk, religion og kjønn.

Neste modul, Bias Recognition, bruker Named Entity Recognition (NER) til å individuere forvrengte ord fra inndata-teksten. Papiret sier:

‘For eksempel, nyheten “Don’t buy the pseudo-scientific hype about tornadoes and climate change” har blitt klassifisert som forvrengt av den forutgående bias-detection-modulen, og bias recognition-modulen kan nå identifisere termen “pseudo-scientific hype” som et forvrengt ord.’

NER er ikke spesifikt designet for denne oppgaven, men har blitt brukt tidligere for bias-identifikasjon, særlig for et 2021-prosjekt fra Durham University i Storbritannia.

For denne fasen brukte forskerne RoBERTa kombinert med SpaCy English Transformer NER-pipeline.

Neste fasen, Bias Masking, involverer en ny, multi-mask av de identifiserte bias-ordene, som opererer sekvensielt i tilfeller med flere identifiserte bias-ord.

Loaded language erstattes med pragmatisk språk i den tredje fasen av Dbias. Merk at ‘mouthing’ og ‘using’ er like handlinger, selv om den førstnevnte anses som nedlatende.

Så nødvendig, vil tilbakemeldingen fra denne fasen bli sendt tilbake til begynnelsen av pipeline for videre evaluering til en rekke passende alternative fraseringer eller ord har blitt generert. Denne fasen bruker Masked Language Modeling (MLM) langs linjene etablert av en 2021-samarbeid ledet av Facebook Research.

Vanligvis vil MLM-oppgaven maskere 15% av ordene tilfeldig, men Dbias-arbeidsflyten sier i stedet til prosessen å ta de identifiserte forvrengte ordene som inndata.

Arkitekturen ble implementert og trent på Google Colab Pro på en NVIDIA P100 med 24GB VRAM ved en batch-størrelse på 16, ved å bruke bare to etiketter (forvrengt og ubiasert).

Tester

Forskerne testet Dbias mot fem sammenlignbare tilnærminger: LG-TFIDF med Logistisk Regresjon og TfidfVectorizer (TFIDF) ord-embeddings; LG-ELMO; MLP-ELMO (en feed-forward kunstig nevralnettskontainer med ELMO-embeddings); BERT; og RoBERTa.

Metrikker brukt for testene var nøyaktighet (ACC), presisjon (PREC), gjentakelse (Rec) og en F1-score. Da forskerne ikke hadde noen kunnskap om noen eksisterende system som kunne utføre alle tre oppgavene i en enkelt pipeline, ble det gjort unntak for de konkurrerende ramverkene, ved å evaluere bare Dbias’ primære oppgaver – bias-detection og -gjenkjennelse.

Resultater fra Dbias-prøvene.

Dbias lyktes i å overgå resultater fra alle konkurrerende ramverk, inkludert de med en tyngre prosesseringsavtrykk