Kunstig intelligens

Modellroutere og tilbakekoblingsfellen: Hvordan AI lærer av seg selv

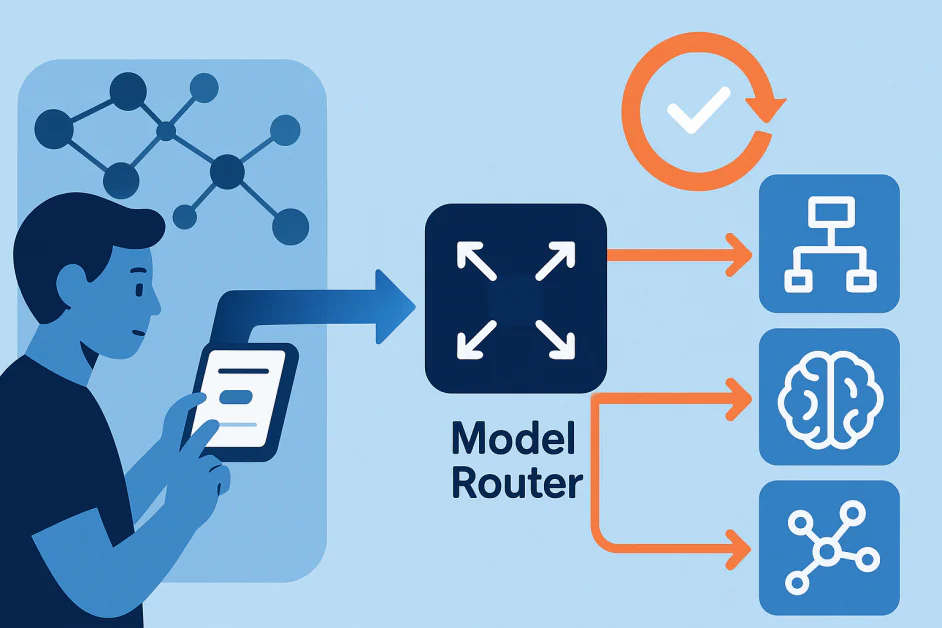

Moderne AI-systemer er ikke lenger bygget rundt en enkelt modell som håndterer alle oppgaver. I stedet er de avhengige av samlinger av modeller, hver designet for spesifikke formål. I sentrum av denne oppsettet er modellrouteren, en komponent som tolker en brukers forespørsel og bestemmer hvilken modell som skal håndtere den. For eksempel, i systemer som OpenAI’s GPT-5, kan en router sende en enkel forespørsel til en lettvektmodell for hastighet, mens den routerer komplekse resoneringoppgaver til en mer avansert modell.

Routere er ikke bare trafikkmestre. De lærer av brukeratferd, som når mennesker bytter modeller eller foretrekker bestemte svar. Dette skaper en syklus: routeren tildeler forespørselen, modellen produserer et svar, brukerreaksjoner gir tilbakekobling, og routeren oppdaterer sine beslutninger. Når disse syklusene opererer stille i bakgrunnen, kan de danne skjulte tilbakekoblingsløkker. Slike løkker kan forsterke bias, forsterke feilaktige mønster eller gradvis redusere ytelse på måter som er vanskelige å oppdage.

Denne artikkelen ser på hvordan modellroutere fungerer, hvordan tilbakekoblingsløkker oppstår, og hva risikoene de utgjør når AI-systemer fortsetter å utvikle seg.

Forståelse av modellroutere i AI

En modellrouter er beslutningssjiktet i et multi-modell AI-system. Dens rolle er å bestemme hvilken modell som best passer til en oppgave. Valget avhenger av faktorer som forespørselskompleksitet, brukerens intensjon, kontekst og avveininger mellom kostnad, nøyaktighet og hastighet.

I motsetning til systemer som følger faste regler, er de fleste modellroutere maskinlæringsystemer selv. De er trent på virkelige verdenssignaler og tilpasser seg over tid. De kan lære av brukeratferd som å bytte mellom modeller, vurdere svar eller omskrive forespørsler, samt fra automatiserte evalueringer som måler utgangskvalitet.

Denne tilpasningen gjør routere kraftfulle, men også risikable. De forbedrer effektivitet og gir en bedre brukeropplevelse, men de samme tilbakekoblingsprosessene som finjusterer deres beslutninger, kan også skape forsterkende løkker. Over tid kan disse løkkene påvirke ikke bare ruterstrategier, men også hvordan det større AI-systemet oppfører seg.

Hvordan tilbakekoblingsløkker dannes

En tilbakekoblingsløkke oppstår når et systems utgang påvirker dataene det senere lærer fra. Et enkelt eksempel er et anbefalingssystem: hvis du klikker på en idrettsvideo, viser systemet deg mer idrettsinnhold, som former hva du ser neste. Over tid forsterker systemet sine egne mønster. Et annet eksempel for å forstå tilbakekoblingsløkken er prediktiv politi. En algoritme kan forutsi høyere kriminalitet i visse nabolag, som kan føre til flere patruljer. Økte patruljer avdekker flere hendelser, som så bekrefter algoritmens forutsagn. Systemet ser nøyaktig ut, men dataene er skjeve på grunn av sin egen innflytelse. Tilbakekoblingsløkker kan være direkte eller skjulte. Direkte løkker er lett å gjenkjenne, som et anbefalingssystem som trener på sine egne forslag. Skjulte løkker er mer subtile fordi de oppstår når forskjellige deler av et system indirekte påvirker hverandre.

Modellroutere kan danne lignende løkker. En routers beslutning former hvilken modell som produserer svaret. Det svaret former brukeratferd, som blir tilbakekobling for routeren. Over tid kan routeren begynne å forsterke mønster som fungerte i fortiden, i stedet for å velge den beste modellen hver gang. Disse løkkene er vanskelige å oppdage og kan stille og rolig skyve AI-systemer i uventede retninger.

Hvorfor tilbakekoblingsløkker i routere er risikable

Mens tilbakekoblingsløkker hjelper routere å forbedre oppgave-matching, bærer de også risikoer som kan forvrengle systematferd. En risiko er å forsterke innledende bias. Hvis en router gjentakende sender en bestemt type forespørsel til Modell A, kommer mesteparten av tilbakekoblingen fra Modell A sine utganger. Routeren kan da anta at Modell A alltid er best, og sette Modell B til side, selv om den kunne fungere bedre noen ganger. Dette ulike bruken kan bli selvforsterkende. Modeller som fungerer bra på routed oppgaver tiltrekker seg flere forespørsler, som forsterker deres styrker. Underbrukte modeller får færre sjanser til å forbedre seg, og skaper ubalanse og reduserer mangfold.

Bias kan også komme fra evalueringmodellene som brukes til å dømme riktighet. Hvis “dommer”-modellen har blinde flekker, blir dens bias overført direkte til routeren, som så optimaliserer for dommerens verdier i stedet for virkelige brukerbehov. Brukeratferd legger til en annen kompleksitet. Hvis en router tenderer til å returnere bestemte svarstiler, kan brukerne tilpasse sine forespørsler for å matche disse mønsterene, og forsterke dem enda mer. Over tid kan dette snevre både brukeratferd og systemresponser. Routere kan også lære å assosiere bestemte forespørselsmønster eller demografi med spesifikke modeller. Dette kan føre til systematisk forskjellige erfaringer over grupper, potensielt forsterke og amplifisere eksisterende samfunnsbias.

En annen nøkkelbekymring er langtidsdrift. Beslutningene en router tar i dag, påvirker treningdataene som brukes i morgen. Hvis modeller blir trent på utganger som er påvirket av routing, kan de lære routens preferanser i stedet for uavhengige tilnærminger. Dette kan gjøre responsene over modeller mer ensartede og innbygge bias som varer over tid.

Strategier for å bryte syklusen

Redusere risikoen for skjulte løkker krever aktiv design og tilsyn. Trening bør bruke mangfoldige datakilder, ikke bare brukerklikk eller -bytting. Tilfeldig routing kan også forhindre at en modell monopoliserer en oppgavetype. Overvåking er essensielt. Regelmessige auditor kan avsløre om en router drifter mot bestemte mønster eller overtrer på en enkelt modell. Gjennomsiktighet i routerbeslutninger hjelper forskere å oppdage bias tidlig.

Routere bør også bli trent om igjen med ferske, balanserte data, så gamle bias ikke blir låst inn. Inkorporering av menneskelig tilsyn, spesielt i sensitive domener, legger til en annen lag av ansvar. Mennesker kan identifisere når en router systematisk favoriserer en modell eller mis klassifiserer bestemte forespørsler.

Nøkkelen er å behandle routeren som en modell som er underlagt tilbakekobling, ikke som en fast eller nøytral komponent. Ved å erkjenne hvordan routere selv er formet av dataene de skaper, kan forskere og utviklere designe systemer som forblir rettferdige, tilpasningsdyktige og pålitelige over tid.

Bunnpunktet

Modellroutere tilbyr klare fordeler i effektivitet og tilpasning, men de bærer også skjulte risikoer. Tilbakekoblingsløkker innen disse systemene kan stille og rolig forsterke bias, begrense mangfold av responser og låse modeller inn i smale mønster av atferd. Ettersom disse arkitekturer blir mer vanlige, vil det å gjenkjenne og håndtere disse risikoene tidlig være nøkkel til å bygge AI-systemer som forblir rettferdige, pålitelige og virkelig tilpasningsdyktige.