Tankeledere

Fra kode til kur: Den neste AI-revolusjonen trenger en hånd (og øyne)

Hvordan agensystemer, XR-smartglass og robotikk vil gi mennesker mer makt – ikke erstatte dem

Vi lever i en paradoks innen kunstig intelligens.

På skjermene er AI overmenneskelig. Store språkmodeller skriver fungerende Python-kode på sekunder. Generative systemer produserer fotorealistiske bilder og videoer på minutter. Nobel-vinnende systemer som AlphaFold har forutsagt strukturen til nesten alle kjente proteiner. De digitale seirene stapler seg opp.

Men i den fysiske verden av biomedisinsk forskning, er oppdagelsesprosessen fortsatt smertefullt manuell. Vi føler ikke at AI akselerer vitenskap eller medisin, i hvert fall ikke ennå. Tallene avslører dybden av problemet. En banebrytende Nature-undersøkelse av over 1 500 forskere fant ut at over 70 % har prøvd og feilet å gjenta en annen forskers eksperimenter. Enda mer foruroligende: over halvparten kunne ikke gjenta sitt eget arbeid. I kreftbiologi spesifikt, fant en åtteårig reproduksjonsprosjekt ut at bare 40 % av høy-impakt funn kunne replikeres og 68 % av eksperimentene manglet tilstrekkelig dokumentasjon for å kunne forsøke å replikere.

Dette er den skitne hemmeligheten i moderne vitenskap: vi har et kunnskapskapningsproblem, ikke bare et oppdagelsesproblem. Kritiske eksperimentelle detaljer bor i forskernes hoder, ikke i papirer. Protokoller glir. Tacit kunnskap går ut døren når trainere avgår. AI-systemer trent på publisert litteratur arver alle disse gapene.

Det grunnleggende problemet er at mens en AI kan designe et nytt protein for kreftbehandling i en digital simulering, kan den ikke plukke opp en pipette for å teste det. Den kan ikke navigere i den uforutsigbare virkeligheten i et våt laboratorium for å validere sin egen hypotese. Den kan ikke se en erfaren forskers hender og lære de subtile teknikker som gjør eksperimentene til å fungere.

Denne “utføringsgapen” er den eneste største flaskehalsen som forhindrer AI-revolusjonen fra å bli en medisinsk revolusjon. Mens de fleste robotikk-selskaper fortsatt er opptatt av å lære maskiner å foldere vaskeklær eller laste oppvaskmaskiner, er de blant de som ligger etter på de virkelig transformative evnene i disse fremgangene i felt som medisin.

For å løse dette, må vi gå utenfor chatbots og mot AI Co-Scientists, agenssystemer som broer den digitale og den fysiske verden, og driver utenfor planlegging og kode og inn i virkelige utføringer. Ved Stanford utvikler vi LabOS, et digital-fysisk AI-rammeverk som demonstrerer hvordan AI-agenter, XR-smartglass og samarbeidsrobotikk kan forenes for å lukke denne løkken, og omforme vitenskapelige eksperimenter til en samarbeidende samtale mellom menneske og maskin, samtidig som den automatisk fanger kunnskapen som for tiden går tapt.

Den store skille: Hvorfor AI trenger “øyne” og “hender”

Mange av de mest synlige AI-seirene har skjedd der miljøet er fullstendig digitalt: kodearkiv, kurerte datasett eller simuleringsbenchmark (der AI konkurranse om å kjøre et virtuelt firma eller digitalt investere i aksjer).

Våtlaboratorier er forskjellige. Biologi, og generelt vitenskapelig oppdagelse, er en veldig støyende prosess. Instrumenter glir, operatører improviserer, og “protokollen” lever ofte delvis i menneskers hoder. Forskjellen mellom et rent resultat og et mislykket løp kan være en pipetteringsvinkel, en vortexmønster, en reagenssubstitusjon eller en inkubasjon som varte 10 minutter for lenge. Disse kontekstuelle detaljene kommer sjelden inn i en papir og de er akkurat det som en AI-modell trenger hvis den skal generalisere utenfor et datasett.

Det er derfor lab-grad AI trenger øyne (for å fatte hva som skjer i kontekst), hender (for å standardisere og sikkerhetsautomatisere høy-variansetrinn) og minne (for å registrere hva som faktisk skjedde). Uten disse evnene kan modeller anbefale hva som skal gjøres, men de kan ikke pålitelig oversette anbefalinger til validert fysisk utføring eller forklare feil når virkeligheten avviker fra planen.

Forbi chatbots: Fra copiloter til co-vitenskapsmenn

Begrepet “agens AI” brukes noen ganger løst. I biomedisinske miljøer bør det bety noe presist: et system som kan ta et mål (for eksempel “optimer CRISPR-geneediting effektivitet samtidig som minimere utenfor mål”), bryte det ned i en rekke oppgaver, utføre disse oppgavene over verktøy, evaluere resultater og tilpasse planen under begrensninger og med auditable beslutningsprosesser.

Dette er viktig fordi forskningsarbeidsflyter ikke er ett enkelt modellkall. De er end-to-end-pipelines som omfatter hypotesedannelse, eksperimentell design, dataforedling, statistisk testing og tolkning. Nytenkning i legemiddelforskning har startet å betone agenssystemer som kan skalerer disse pipelineene i stedet for bare å akselerere enkelttrinn (for eksempel Unite.AI sin diskusjon om agenter i small-molecule discovery).

I programvareutvikling har vi allerede sett tidlige empiriske bevis for at AI-copiloter kan øke utviklerens gjennomstrømming. I biomedisin er den analoge muligheten ikke bare å skrive kode, men å skrive og validere protokoller, strukturere data, overvåke utføring og lukke løkken mellom prediksjon og måling, og koble AI til menneskelige forskere i laboratorier.

LabOS: Når AI kjører på et operativsystem for laboratoriene i morgen

I vårt arbeid ved Stanford på AI4Science, som omfatter genredigering copiloter som CRISPR-GPT og AI-XR co-execution systemer som LabOS som hjelper forskere i biomedisinske og materialvitenskapelige laboratorier, har vi vært opptatt av en arkitektonisk skift:

1. Designe et end-to-end “laboratorium-operativsystem” som kobler en digital (tørr) laboratorium til et fysisk (våt) laboratorium.

Premissen er enkel: hvis en lab-notebok er minnet til vitenskapen, så bør et lab-OS være utføringslaget, fange intensjon, oversette det til handlinger, observere resultater og gjøre hver løp til strukturert kunnskap.

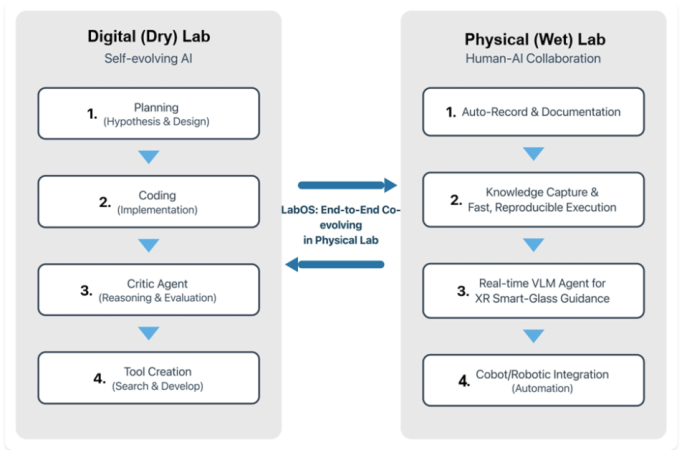

Figur. En konseptuell visning av LabOS som kobler en selv-utviklende digital laboratorieløkke (planlegging, kode, kritikk, verktøybygging) med en menneske-AI våtlaboratorieløkke (auto-dokumentasjon, kunnskapsfang, XR-veiledning og robot-integrasjon).

2. AI i det digitale laboratoriet – Selv-utviklende planlegging og verktøybygging

I det digitale (tørre) laboratoriet kan vi la AI gjøre hva den allerede gjør bra: søke, syntetisere og foreslå. Men vi ønsker også at den skal være selv-forbedrende. Ikke ved å “hallusinere ny vitenskap”, men ved å lære bedre verktøy og arbeidsflyter fra tilbakemeldinger.

En praktisk digital-laboratorieløkke kan rammes inn som fire gjentakende faser:

- Planlegging (hypotese + design): foreslå hypoteser, velge eksperimentelle variabler, forutse confoundere og spesifisere målbare sluttpunkter.

- Koding (implementering): generere eller tilpasse analyse-skript, simulerings-pipelines og instrumentkontroll-maler der det er aktuelt.

- Kritik agent (resonnement + evaluering): stress-teste antagelser, sjekke statistisk kraft, foreslå kontroller, og flagge sannsynlige feilmodi.

- Verktøybygging (søke + utvikle): når arbeidsflyten mangler en komponent (en parser, en QC-rutine, en dashboard), bygge den og legge den tilbake til verktøykassen.

3. AI i det fysiske laboratoriet – AI med “øyne” (XR-glass) og “hender” (robotikk)

Det fysiske laboratoriet er der systemet enten tjener tillit – eller mister den. Målet er ikke å erstatte forskeren, men å redusere friksjon og feil samtidig som det øker observabiliteten.

Vi ser på det fysiske laboratorieløkken som fire komplementære evner:

- Auto-registrer og dokumentasjon: fange handlinger, tidsstempel, instrumentinnstillinger og avvik automatisk, så dokumentasjon ikke er en ettertanke.

- Kunnskapsfang for rask, reproduksibel utføring: konvertere løp til strukturerte, spørbare artefakter (protokollversjoner, parametersett, QC-utfall) i tråd med dataforvaltningsprinsipper som FAIR.

- Sanntids visuell-språklig veiledning via XR-smartglass: bruke multimodale modeller til å tolke scenen (hva operatøren gjør, hvilken reagens som er i hånden) og gi steg-for-steg veiledning og sikkerhetskontroller. AR/XR har allerede demonstrert verdi i høyrisikofysiske arbeidsflyter som eksperimentveiledning (LabOS, Stanford, Princeton, i samarbeid med NVIDIA).

- Cobot/robot-integrasjon for automatisering: standardisere repetitive trinn, muliggjøre trygge overleveringer, og redusere variasjon. Plattformer for simulering-til-reell arbeidsflyt (for eksempel NVIDIA Isaac) og sanntids AI-prosessering på kanten som smartglass direktesending og menneske-AI-interaksjon i LabOS er viktige aktiveringslag.

Denne arkitekturen stemmer overens med en bredere retning i feltet: “selv-kjørende” eller autonome laboratorier som kombinerer automatisering med maskinlæring til å planlegge neste eksperiment. Hva LabOS legger til er et tettere menneskegrensesnitt, så autonomi ikke kommer på bekostning av gjennomsiktighet.

Hvorfor Lab-grad AI ikke bare er “AI på et datasett”

AI-systemer for biomedisinsk/vitenskapelig superintelligens ser ofte imponerende ut i retrospektiv evaluering eller når de tar eksamener, og så underpresterer i det fysiske laboratoriet. Årsaken er sjelden en enkelt feil. Det er vanligvis en mismatch mellom modellens antagelser og laboratoriets realitet.

Tre gap viser seg gjentakende:

- Kontekstgap: datasett omfatter vanligvis ikke kontekstvariable som operatører vet er viktige (temperatur-utflukter, reagenspartinummer, subtile protokollavvik).

- Handlingsgap: mange AI-systemer kan anbefale hva som skal gjøres, men kan ikke pålitelig oversette denne anbefalingen til validert fysisk handling eller forklare feil når virkeligheten avviker fra planen.

- Tilbakemeldingsgap: uten strukturert, høykvalitets tilbakemelding fra utføring, kan modeller ikke lære hvor de feiler – og forskere kan ikke granske hvorfor.

Å lukke disse gapene er mindre om å oppfinne en ny neural nettverksarkitektur, men mer om å bygge instrumentering, grensesnitt og datakontrakter som gjør laboratoriet leselig for maskiner, og lar AI se og arbeide med mennesker.

Tillit ved design: Sikkerhet og styring for AI som kan handle

Agens AI i oppdagelsesforskning raiser ikke bare bekymringer om nøyaktighet. Det introduserer nye feilmodi fordi det kan handle. I et laboratorium betyr handling potensialet for avfall, skade eller misvisende konklusjoner, spesielt når eksperimenter mater inn i kliniske hypoteser.

En nyttig holdning er å behandle et AI-aktiveringslaboratorium som et sosio-teknisk system som trenger forsikring. Flere eksisterende rammer hjelper, men de må oversettes til laboratoriets realitet:

- Risikostyring som en kontinuerlig praksis: NISTs AI-risikostyringsrammeverk (AI RMF 1.0) gir en praktisk vokabular for å kartlegge, måle og håndtere AI-risiko over hele livssyklusen.

- Reguleringsmessig tilpasning for medisinsk-tilstøtende AI: FDAs AI/ML-programvare som medisinsk enhet (SaMD)-arbeid, inkludert handlingsplan og relaterte retningslinjer, tilbyr en konkrete visning av hva “god praksis” ser ut som når AI påvirker pasientbehandling.

For genredigering og andre høy-konsekvensdomener er styring allerede en global samtale. Anbefalinger diskuteres på menneskelig genredigering, for å betone behovet for passende tilsynsmekanismer og ansvarlig styring, som de som er fremmet av American Society for Gene and Cell Therapy, eller ASGCT. Systemer som LabOS bør være designet for å gjøre overholdelse enklere, ikke vanskeligere.

Sjekkliste: Kontroller for trygg AI Co-vitenskapsmenn for vitenskapelig oppdagelse

I vårt syn bør et sikkerhetsbevisst lab-OS implementere minst følgende design:

- Proveniens som standard: hver datasett, protokollversjon og modellutgang bør være sporbar til inndata og tidsstempel.

- Begrenset autonomi: systemet bør ha eksplisitte tillatelser (hva det kan gjøre uten bekreftelse) og eskaleringregler (når det må spørre).

- Menneskelig overtakelse og elegant degradering: når sensorer eller datastrømmer feiler, eller usikkerhet er høy, bør systemet falle tilbake til en tryggere, enklere modus.

- Kontinuerlig validering: in-silico-prediksjoner bør kombineres med fysisk laboratorie-validering; fysisk laboratorie-løp bør inkludere QC-porter før konklusjoner sprer seg nedstrøms tilbake til AI-modellene/agentene i den digitale verden.

- Sikkerhet og dual-bruk bevissthet: beskytte laboratorie-infrastruktur mot manipulering.

Gi mennesker makt overalt: Kan AI Co-vitenskapsmenn utjevne spillere?

En av de mest overbevisende løftene om en AI-XR “co-vitenskapsmann” er ikke bare hastighet for eliteinstitusjoner, men tilgjengelighet for alle. Tenk på hva som for tiden begrenser mindre laboratorier, startup-selskaper og fjern/landlige/kliniske klinikker:

- Begrenset tilgang til spesialisert ekspertise for gull-standarden protokoller og instrumenter.

- Høyere relativ kostnad for opplæring, feil og omgjøring.

- Fragmentert verktøy: notatbøker, regneark, instrumentlogger og analyse-skript sjelden kobler sammen renket.

Et system som kan veilede utføring i kontekst (via XR-glass), fange hva som skjedde automatisk, og foreslå neste beste trinn basert på tidligere løp, kunne gjøre avanserte assayer mer gjentakbare over steder. I prinsippet kunne det også støtte distribuert klinisk forskning hvor protokoller må utføres konsekvent, selv når ressurser varierer.

Tidsplan: Når får hver forsker og kliniker en Co-vitenskapsmann?

Kort sagt er vi nærmere enn mange tror for noen høyverdi, høyfrekvens oppgaver (som å produsere et legemiddel pålitelig i laboratoriet) og lenger enn de fleste demoer antyder for andre (som AI fullstendig løser store problemer som kreft eller Alzheimers). En realistisk veikart ser ut som følger:

- Nær fremtid (innen 1 år): Arbeidsflyt-copiloter som reduserer administrativt arbeid: protokollutkast, litteratursyntese, analyse-maler og automatiserte QC-rapporter. Begrensningen er integrering, ikke modellkapasitet.

- Midtfremtid (1-2 år): Co-utførings-systemer i laboratoriet: XR-glass-veiledning, automatisert dokumentasjon og selektiv robotikk for høy-variansetrinn. Tillit vil avhenge av audit-spor og tett menneske-i-løkken design.

- Lengre fremtid (3+ år): Tverrfaglige co-forskere som kobler oppdagelse til oversettelse: kobler laboratorie-data til kliniske endepunkter, overvåker sikkerhetssignaler og hjelper med å designe prøver – samtidig som det overholder reguleringsmessige og etiske forventninger.

Fra kode til kur: Veien fremover til 1000x vitenskapelig oppdagelse

LabOS er ett forsøk på å svare på et enkelt spørsmål: hva hvis et eksperiment kunne kjøres som en samtale, hvor intensjon, utføring og bevis er koblet sammen fra ende til ende? Hvis vi bygger disse systemene godt, kan de hjelpe med å løse gapet som bremser biomedisin og mange fysiske vitenskapsdisipliner (for eksempel materialvitenskap). Hvis vi bygger dem dårlig, vil de forsterke ugyldighet og skape nye sikkerhetsrisiko.

Det viktigste arbeidet de neste årene vil være grunnleggende: standardiserte data- og enhetsgrensesnitt via bygging av operativsystemet (mye som iOS kjører alle typer apper), bygging av AI-benchmark som inkluderer utføring og usikkerhet (som LabSuperVision-benchmark i LabOS), og start på distribusjon i den virkelige verden som oppmuntrer til innovasjon samtidig som det beskytter pasienter og forskningsintegritet.

For forskere og klinikere er spørsmålet ikke om AI vil komme inn i laboratoriet. Det har allerede gjort det. Spørsmålet er om vi vil integrere det som en samling løsrevne verktøy eller som et pålitelig, auditable system designet for realitetene i biomedisinsk vitenskap.

Forslag til lesing og kilder

- Reproduksjonsundersøkelse (Nature, 2016): https://www.nature.com/articles/533452a

- CRISPR-GPT fagfellevurdert artikkel (Nature Biomedical Engineering): https://www.nature.com/articles/s41551-025-01463-z

- Stanford Medicine nyheter om CRISPR-GPT (2025): https://med.stanford.edu/news/all-news/2025/09/ai-crispr-gene-therapy.html

- LabOS preprint (arXiv): https://arxiv.org/abs/2510.14861

- LabOS og LabSuperVision-benchmark-nettsted: https://ai4lab.stanford.edu

- NIST AI-risikostyringsrammeverk (AI RMF 1.0): https://nvlpubs.nist.gov/nistpubs/ai/NIST.AI.100-1.pdf

- FDA-oversikt over AI/ML-programvare som medisinsk enhet: https://www.fda.gov/medical-devices/software-medical-device-samd/artificial-intelligence-software-medical-device

- FAIR-data-prinsipper (Scientific Data, 2016): https://doi.org/10.1038/sdata.2016.18

- Unite.AI om flasker i småmolekyl-legemiddelforskning: https://www.unite.ai/how-ai-is-breaking-down-the-bottlenecks-in-small-molecule-drug-discovery/

- Unite.AI om AI og robotisk kirurgi: https://www.unite.ai/how-ai-is-ushering-in-a-new-era-of-robotic-surgery/