Andersons vinkel

AI deler nettet i tre forskjellige virkeligheter

Nye studier viser at Google nå bruker tre forskjellige informasjonssystemer innen sin egen søkeimperium, med vanlig søk, AI-oversikter og Gemini som alle favoriserer forskjellige kilder, rangeringer og innhold.

Reduksjonisme hersker. Over de siste tolv månedene har ‘La meg google det for deg’ meme blitt overtatt av en ny ‘La meg sammenfatte det google-søket for deg’ trend, hvor AI-oversikter i søkeresultater stadig oftere sparer lesere problemer med å klikke på søkelinker (arguably de-finansierer kildesidene i prosessen), ved å kondensere hele søkeresultatene inn i noen genererte paragrafer.

En kunne tenke at den grunnleggende kunnskapen som dukker opp, og valget av nettsteder som trekkes fra denne kunnskapen, ville være relativt likt over alle tre av de mest populære metodene for å søke etter informasjon på internett: i tradisjonell websøk; i AI-oversiktene (AIOs) som nå toppen av de fleste websøkeresultater; og gjennom økende bruk av LLMs som ChatGPT som web-orakler (med eller uten eksterne RAG-forespørsler).

Men, ny forskning fra USA indikerer at dette er, overraskende, langt fra tilfelle; og at selv innen Google’s egen treenighet av orakler – SERPS*, AI-summeringer og direkte interaksjon med Gemini LLM-serien – det åpenbart er betydelige og interessante forskjeller, for hver rute.

Treveisdeling

I en klar og omfattende ny rapport, med tittelen Hvordan generativ AI forstyrer søk: En empirisk studie av Google-søk, Gemini og AI-oversikter, seks forskere fra New Jersey Institute of Technology beskriver måtene søkemåtene divergerer på, og tilbyr noen mulige teorier for disse bruddene i tilnærmingen.

Rapporten sier:

‘[Først, vi] finner at for 51,5% av representative, virkelige brukerforespørsler, AIOs genereres, og vises over de organiske søkeresultatene. Kontroversielle spørsmål resulterer ofte i en AIO.

‘For det andre, viser vi at de hentede kildene er vesentlig forskjellige for hver søkemotor (<0,2 gjennomsnittlig Jaccard-lignhet). Vanlig Google-søk er betydelig mer sannsynlig å hente informasjon fra populære eller institusjonelle nettsteder i regjering eller utdanning, mens generative søkemotorer er betydelig mer sannsynlig å hente Google-eide innhold.

‘Tredje, observerer vi at nettsteder som blokkerer Google’s AI-kryper er betydelig mindre sannsynlig å bli hentet av AIOs, til tross for å ha tilgang til innholdet.’

Ettersom rapporten er en smørgåsbord av fascinerende innsikter, snarere enn å følge den vanlige lineære og metode-drevne arbeidsflyten, skal vi ta en nærmere titt på disse, og noen av dens mest overraskende og opplysende innsikter.

Den gamle ‘To-En’

En av de mange interessante funnene i studien indikerer at Google’s AI-oversikter tenderer til å bli undertrykt for plutselige nyhetsbegivenheter, siden de tidligste og mest tilgjengelige kildene kanskje ikke er de mest nøyaktige.

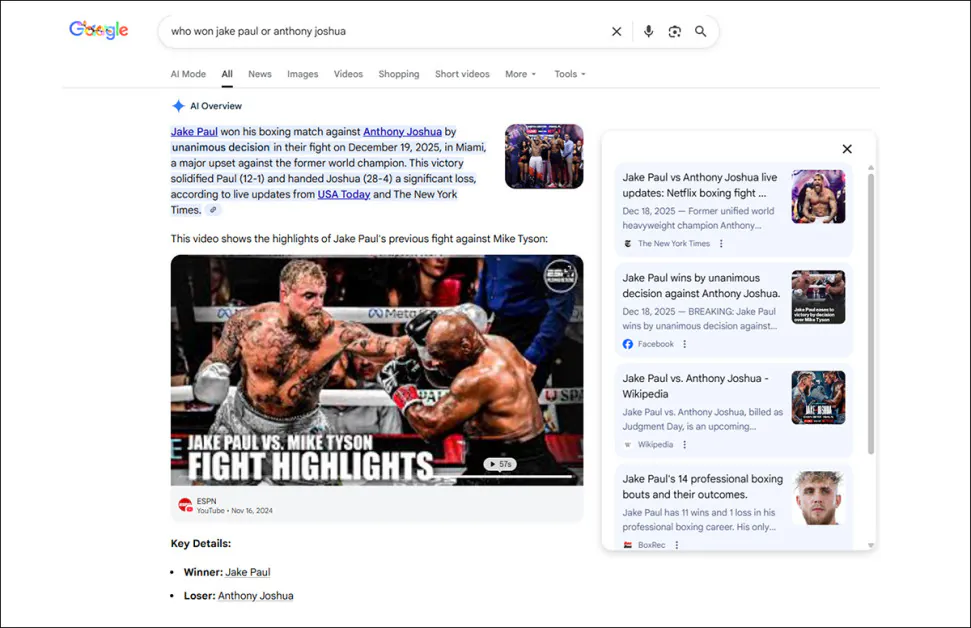

Dette systemet fungerer ikke alltid: i eksemplet under, notert av forskerne, en Google AI-oversikt om resultatet av en boksekamp tilskrev seieren til feil bokser, til tross for at den eneste kilden som sa dette (feil) resultat var en satirisk sportsfeed på Facebook:

En av grunnene til at Google’s AI-oversikter unngår tidskritiske summeringer er at tidlig informasjon kan være ufullstendig eller fullstendig uriktig. I dette tilfelle tapte bokser Jake Paul faktisk kampen. Kilde

Forskerne noterer at AIOs tenderer til å dukke opp når en hendelse er minst fem dager gammel, som kvalifiserer dette som en anomali – men likevel, en som forskerne lett kunne fremkalle.

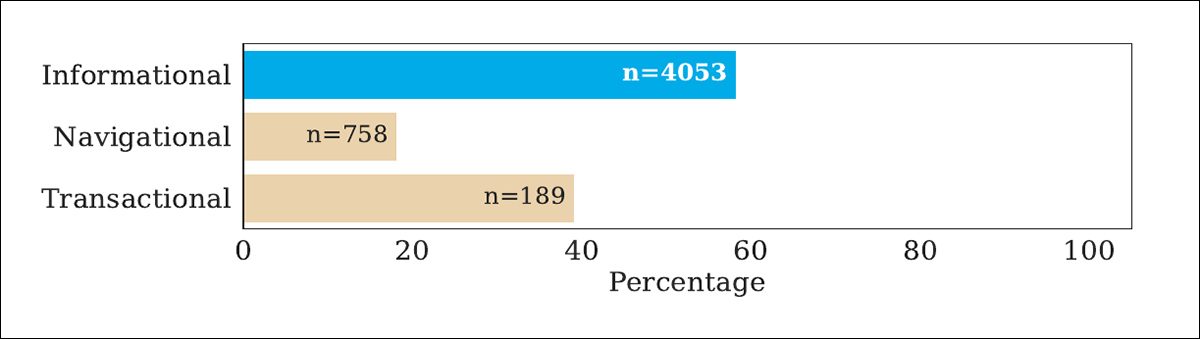

AIOs ble funnet å være mer sannsynlig å bli generert når forespørselen ble avsluttet med et spørsmålstecken, og at forespørselsintensjon var en faktor i om en AIO ville bli presentert:

Prosenten av hendelser hvor en AI-søkesammendrag ble produsert i en av forskernes tester. Her indikerer ‘informasjons’ direkte spørsmål, som tenderer til å produsere AIOs mer enn noen annen type interaksjon.

I tillegg hevder rapporten, lengre forespørsler tenderer til å være mer sannsynlig å produsere en AI-sammendrag i stedet for bare rette søkeresultater, selv om forfatterne ennå ikke tilbyr en teori for å forklare dette.

Et delt kongerike

Kanskje det mest overraskende overordnede resultatet fra den nye studien er den relativt små overlapp i resultatkvalitet/type mellom Google’s (nevnte) tre søkeplattformer.

Rapporten viser gjentatte ganger at vanlig Google-søk, AI-oversikter og Gemini (LLM) henter vesentlig forskjellige kilder for samme forespørsel, med overlap-scoren lav nok til å antyde tre konkurrerende tilbakekallingslogikker innen én selskap, hvor brukerne kanskje antar at Google har én autoritativ indeks, og én rangeringsfilosofi:

Selv innen Google’s egen økosystem, var overlappen mellom tradisjonell søk, AI-oversikter og Gemini overraskende liten, med samme forespørsel ofte produserte vesentlig forskjellige kilde-lister avhengig av hvilken Google-system håndterte forespørselen. I denne sammenligningen ser vi hvordan de tre systemene matchet hverandre over tusenvis av søkeforespørsler, fra shopping og debatt-temaer til lokale søk og generell kunnskapsspørsmål, med lavere score indikerer mindre enighet mellom de valgte kildene.

Med hensyn til denne delen av analysen, sier forfatterne†:

‘[Tabellen over] presenterer gjennomsnittlig lignhet mellom listen over kilder returnert av AIO, Gemini og tradisjonell SERP for hver forespørsel i benchmark-datasettet.

‘Hovedpoenget er at uansett forespørselsundergruppe og hvilken par av søkemotorer som sammenlignes, de hentede listene er ulike, til tross for at alle tre er utviklet av Google.’

Forskerne noterer videre at ingen søkemåte testet hadde en rang-bias overlapp (RBO) over 0,27, som er en meget lav score. De noterer videre at Amazon Retail og lokaliseringsforespørsler (dvs. ‘butikker nær meg’) hadde den laveste lignheten blant søkemåtene.

De tilskriver den lave enigheten til grunnleggende ‘inkonsistens mellom søkemotorer’, noterende at hverken tilfeldighet eller noen annen åpenbar faktor kan gjøres til å forklare denne desynkopasjonen.

En intuitiv forklaring, kan man hevde, er at treningdatapunkter er tildelt rang i en meget annen måte enn metoden Google har utviklet for PageRank og dens etterfølgere over de siste to tiårene. Videre, på den avvei at Google-søkets algoritme har en hemmelig agenda, er det vanskeligere å implementere denne typen interferens eller ‘gaming’ i difusjonsbaserte AI-er som Gemini (selv via filtering, systemforespørsler og de forskjellige metodene for å innhegne som pålegges kommersielle modeller).

Selvbetjening..?

Visse nettsteder, eller kategorier av nettsteder, å se ut til å ha blitt berørt av innføringen av AI-sammendrag og innføringen av LLM-basert søk i tradisjonell søkerom – både negativt og positivt, avhengig av tilfelle:

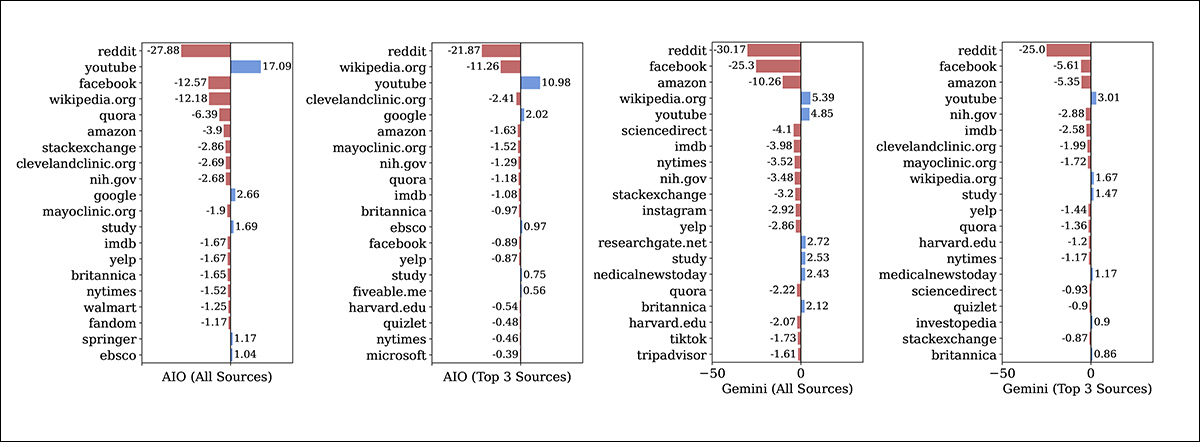

I sammenligning med tradisjonell Google-søk, reduserte AI-oversikter og Gemini begge sitater fra mange større nettsteder, mens de økte synligheten for en mindre mengde favoriserte domener. YouTube viste seg å være en av de største fordelene på begge systemer, mens Reddit, Wikipedia, Facebook og mange institusjonelle kilder dukket opp mindre ofte i AI-genererte henting.

Forfatterne noterer at noen uventede preferanser dukker opp blant de tre metodene, under testing:

‘Vi har tre hovedpoeng fra [grafene over]. Først, store og kjente nettsteder er de mest berørt (både positivt og negativt). Dette er intuitivt, siden store nettsteder har rykte og mangfold i innhold til å være relevante for mange forskjellige forespørsler.

‘For det andre, mottar de fleste av disse nettstedene færre totale, og færre topp tre, sitater med generative søkemotorer (indikert av røde bjeller og negative tall i [grafene over]). Dette antyder at generativ søk tenderer til å hente informasjon fra mer nisje-kilder enn tradisjonelle søkemotorer.

‘Tredje, favoriserer Google’s AIOs Google-nettsteder (dvs. google.com og youtube.com-domener).

‘Gemini favoriserer også YouTube i sammenligning med tradisjonell Google-søk, men den absolutte forskjellen er mindre.’

Noen ‘Blokkører’..?

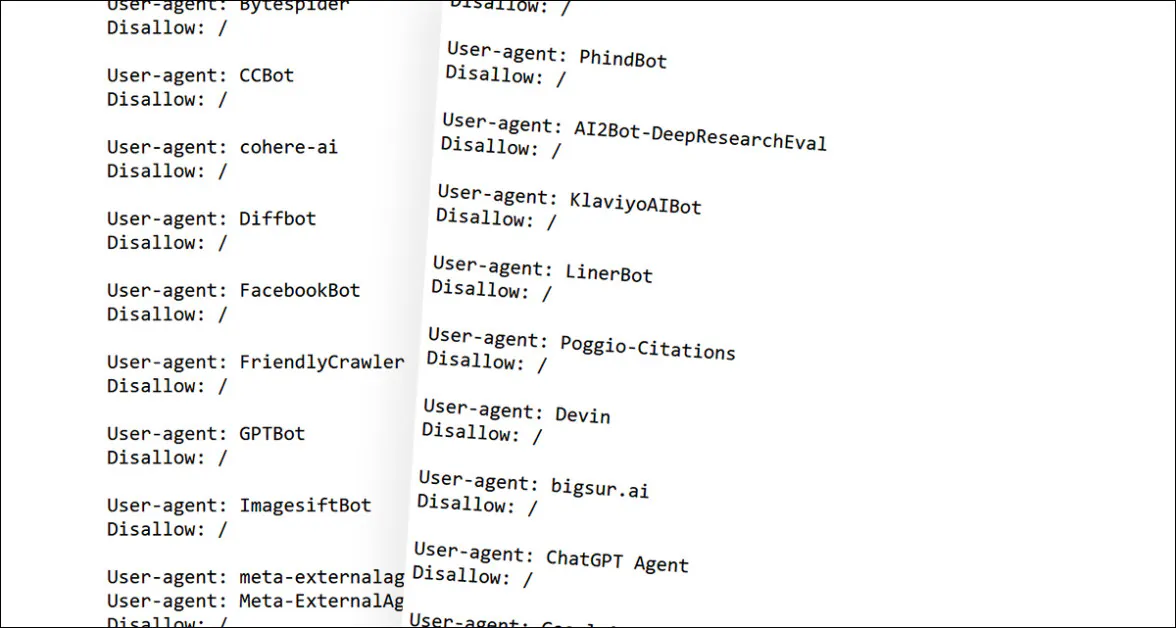

Studien fant også at utgivere som blokkerer Google’s AI-webkryper – den automatiske web-roboten som skraper data fra nettstedet ditt med mindre du forteller den ikke å gjøre det med en robots.txt-fil – tenderer til å ikke dukke opp i AI-sammendrag.

Dette kan se ut som en åpenbar selvforårsaket skade, men i virkeligheten har Google offentlig erklært at innhold fra plattformer som blokkerer AI-krypere vil ikke bli hindret fra å dukke opp i AI-sammendrag; snarere, utgiverne vil bare ikke få deres data skrapet, kurert inn i en samling, og kjørt gjennom neste runde av AI-trening for Gemini og andre Google AI-prosjekter.

Likevel, det var ikke konklusjonen som de nye rapportens forskere kom til, da de fant at populære AI-forbudsutgivere var svært sjelden sitert av Gemini, både i LLM og i den mer strømlinjeformede og agile søkeresultat-inkarnasjonen. De ‘effektivt forbudte’ utgiverne ble rapportert av rapporten å være NYTimes, CNN, BBC, ScienceDirect, Reuters, Wiley, Nature, ESPN, Business Insider, CNBC, NPR, WIRED, USA Today, NBC News, Genius, National Geographic, The Conversation, U.S. News & World Report, Scientific American, Consumer Reports, og STAT.

Noen av robots.txt AI-skraping-forbudene som er virkningsfulle for de ovennevnte utgiverne. Men har det ført til en videre sensur fra Google?

Forfatterne sier:

‘I våre analyser av de mest berørte domenene, fant vi at 21 populære [utgivere] (som hentes for minst 20 unike forespørsler av både Google-søk og AIOs) aldri ble sitert av Gemini.

‘Flere populære sosiale medier (Facebook, Instagram, Tiktok) og anmeldelsesnettsider (IMDb, Yelp, Tripadvisor) mottok også null sitater fra Gemini. Ved nærmere undersøkelse, fant vi at alle disse nettstedene blokkerer Google-Extended-bot i sine robots.txt-filer.’

Hvis dette funnet viser seg å være verifisert andre steder og varig, kunne en spekulere om at disse selskapene potensielt blir presset av Google til å gi etter og samarbeide med deres AI-operasjoner gjennom delvis de-listing. Ved første øyekast, ser resultatene ut til å være straffende – men så, funnene fra den nye studien er mer indikative på kaos enn forhåndsinnrettet; derfor er den eneste rimelige kommentaren en kan komme frem til at disse resultatene ser overfladisk ‘spiteful’ ut, uansett hva som egentlig forårsaker dem.

Konklusjon

Meninger Dette er en klarsynt zip-bomb av en rapport, hvis bare ti primære sider utvikler seg til en nesten overveldende kaskade av ytterligere funn. Ettersom vi har hatt tid til å dekke bare en liten del av disse, anbefaler jeg kilde-PDF-en selv til den mest avslappede leseren (en sjelden hendelse).

Et ‘gult’ syn kan kaste mange negative tolkninger på forfatternes oppdagelser, men arbeidet er kanskje best behandlet som indikativt for en global teknologileder som prøver å oppnå og beholde en global ledelse i AI-basert søk, ved hjelp av høyst kontrasterende plattformer som utviklet seg under svært forskjellige omstendigheter og over svært forskjellige epoker.

Mens tre søkemåter undersøkes i rapporten, er den virkelige kontroversen mellom tradisjonelle søkeresultater, rangert av proprietære metoder, og de skarpt kontrasterende distribusjonsbaserte valgmetodene som dominerer datakurering og AI-trening.

AI som i 1999

Før innføringen av Google, var det mulig å ‘spille’ søkeresultater gjennom ren mengde, og på denne måten kunne en ofte oppnå førsteside-SERPS-plassering med minimal (ofte automatisert) innsats. Dette ‘tallspillet’ ble effektivt avsluttet rundt 2002 av Google’s mer sofistikerte og hemmelige søkerangeringsalgoritme. Men siden innsatsen var betydelig, forsvant ikke høyvolum og lavkvalitetsinnhold noen gang på noen meningsfull måte.

Derfor, da hyperskala-samlinger som Common Crawl la grunnlaget for den moderne AI-revolusjonen, var data-prominensen dømt til å bli dominert av hvor godt automatiserte prosesser kunne filtrere og rangere innkommende datakvalitet, og (mye mindre sannsynlig), hvor mye penger som var tilgjengelige for å betale mennesker for å rangere denne dataen.

Det var mye dårlig eller lavkvalitetsdata i disse enorme og ukritiske samlingene; data som kanskje ikke inkluderte nakenhet eller sværing eller rasistiske tropar, eller noen av de andre tingene som er relativt enkle å filtrere ut av treningsdatasett – men som likevel var selvbetjent og voluminøs, akkurat som resultater fra internett-søk cirka 1999-2001.

Fordi disse data-induksjonsprosessene er fortsatt ikke gode, er det svært vanskelig, selv for Google, å få AI til å fungere på en forretningsmessig måte, siden Gemini’s PageRank-liknende beslutninger dikteres ikke av Google’s politiingeniører, men av en fullstendig feilaktig forståelse av hvordan hyperskala-data transformerer til datafordelinger og latente innkapslinger under AI-modell-trening.

* Søkeresultatsider.

† Forfatternes betoning, ikke min. Likevel, har jeg erstattet fet skrift med kursiv, siden kursiv betoning ikke fungerer godt i sitater som allerede er primært kursiv.

Først publisert onsdag, 13. mai 2026