Kunstig intelligens

En kartell av innflytelsesrike datasett dominerer maskinlæringsforskning, foreslår en ny studie

En ny rapport fra University of California og Google Research har funnet ut at et lite antall ‘benchmark’ maskinlæringsdatasett, hovedsakelig fra innflytelsesrike vestlige institusjoner, og ofte fra regjeringens organisasjoner, dominerer stadig mer AI-forskningssektoren.

Forskerne konkluderer med at denne tendensen til å ‘defaulte’ til høyt populære åpne kildekodedatasett, som ImageNet, fører til en rekke praktiske, etiske og sogar politiske bekymringer.

Blant deres funn – basert på kjerne data fra Facebook-leden community-prosjektet Papers With Code (PWC) – hevder forfatterne at ‘vidt brukte datasett introduseres av bare en håndfull elite-institusjoner’, og at denne ‘konsolideringen’ har økt til 80% i de senere år.

‘[Vi] finner at det er økende ulikhet i datasett-bruk globalt, og at mer enn 50% av alle datasett-bruk i vårt utvalg av 43 140 korresponderer til datasett introdusert av tolv elite, primært vestlige, institusjoner.’

En kart over ikke-oppgave-spesifikke datasett-bruk over de siste ti årene. Kriteriet for inklusjon er hvor institusjonen eller selskapet står for mer enn 50% av kjente bruk. Vises til høyre er Gini-koeffisienten for konsentrasjon av datasett over tid for både institusjoner og datasett. Kilde: https://arxiv.org/pdf/2112.01716.pdf

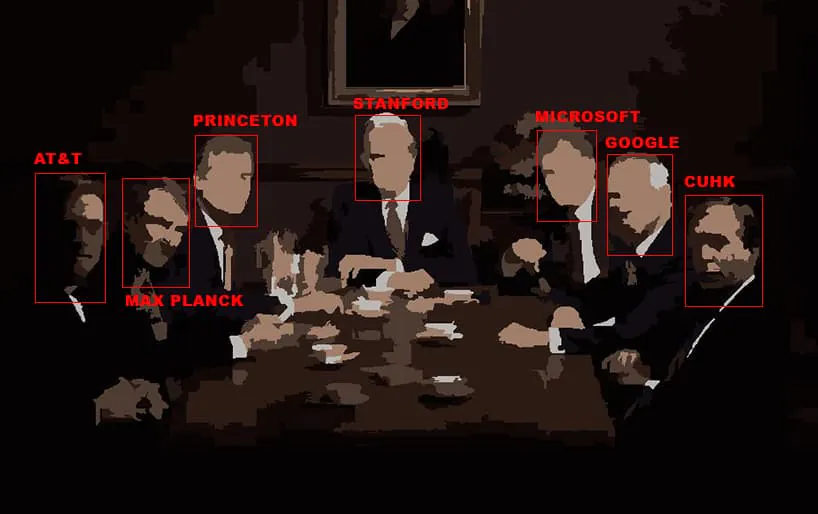

De dominante institusjonene inkluderer Stanford University, Microsoft, Princeton, Facebook, Google, Max Planck-instituttet og AT&T. Fire av de topp ti datasett-kildene er corporate-institusjoner.

Rapporten karakteriserer også den økende bruken av disse elite-datasettene som ‘et kjøretøy for ulikhet i vitenskapen’. Dette er fordi forskningsteam som søker community-godkjenning er mer motivert til å oppnå state-of-the-art (SOTA) resultater mot en konsistent datasett enn de er til å generere originale datasett som ikke har noen slik status, og som ville kreve at peer-grupper tilpasser seg nye metrikker i stedet for standard-indeksene.

I alle fall, som rapporten erkjenner, å lage sin egen datasett er en prohibitivt dyrt foretak for mindre ressurssterke institusjoner og team.

‘Den prima facie vitenskapelige gyldigheten som tildeles av SOTA-benchmarking er generisk forvirret med den sosiale troverdigheten forskerne oppnår ved å vise at de kan konkurrere på en vidt anerkjent datasett, selv om en mer kontekst-spesifik benchmark kunne være mer teknisk passende.

‘Vi hevder at disse dynamikkene skaper en “Matthew-effekt” (dvs. “de rike blir rikere og de fattige blir fattigere”) hvor suksessfulle benchmark, og de elite-institusjonene som introduserer dem, får en ubalansert størrelse innen feltet.

Rapporten paper er tittelen Reduced, Reused and Recycled: The Life of a Dataset in Machine Learning Research, og kommer fra Bernard Koch og Jacob G. Foster ved UCLA, og Emily Denton og Alex Hanna ved Google Research.

Arbeidet reiser en rekke spørsmål om den økende trenden mot konsolidering som den dokumenterer, og har blitt møtt med generell godkjenning på Open Review. En anmelder fra NeurIPS 2021 kommenterte at arbeidet er ‘ekstremt relevant for alle som er involvert i maskinlæringsforskning.’ og forutså dens inklusjon som obligatorisk lesning på universitetskurser.

Fra nødvendighet til korrupte

Forfatterne noterer at den nåværende kulturen av ‘beat-the-benchmark’ oppstod som en kur for mangelen på objektive evaluering-verktøy som førte til at interessen og investeringen i AI kollapset for en andre gang for over tretti år siden, etter nedgangen i forretningsentusiasmen mot ny forskning i ‘Expert Systems’:

‘Benchmark typisk formaliserer en bestemt oppgave gjennom et datasett og en tilhørende kvantitativ målestokk for evaluering. Praksisen ble opprinnelig introdusert til [maskinlæringsforskning] etter “AI-vinteren” på 1980-tallet av regjeringsfinansierere, som søkte å bedre vurdere verdien mottatt på bevilgninger.’

Rapporten argumenterer for at de innledende fordelene med denne uformelle kulturen av standardisering (reduserer barrierer for deltakelse, konsistente metrikker og mer agile utviklingsmuligheter) begynner å bli overveiet av ulemper som naturlig oppstår når en samling av data blir mektig nok til å effektivt definere sine ‘bruksvilkår’ og omfang av innflytelse.

Forfatterne foreslår, i linje med mye nylig industri- og akademisk tankegang om saken, at forskningssamfunnet lenger ikke stiller nye problemer hvis disse ikke kan håndteres gjennom eksisterende benchmark-datasett.

De noterer også at blind tilknytning til dette lille antall ‘gull’-datasett oppmuntrer forskere til å oppnå resultater som er overfitted (dvs. at de er datasett-spesifikke og ikke sannsynligvis vil fungere like godt på virkelige data, på nye akademiske eller originale datasett, eller sogar nødvendigvis på forskjellige datasett i ‘gull-standarden’).

‘Gitt den observerte høye konsentrasjonen av forskning på et lite antall benchmark-datasett, tror vi at det er spesielt viktig å diversifisere former for evaluering for å unngå overfitting til eksisterende datasett og misrepresentere fremgangen i feltet.’

Regjeringspåvirkning i datavisjonsforskning

Ifølge rapporten er datavisjonsforskning mer berørt av syndromet den beskriver enn andre sektorer, med forfatterne som noterer at Natural Language Processing (NLP) forskning er langt mindre berørt. Forfatterne foreslår at dette kan være fordi NLP-samfunn er ‘mer samholdne’ og større i størrelse, og fordi NLP-datasett er mer tilgjengelige og enklere å kuratere, samt at de er mindre og mindre ressurskrevende når det gjelder datainnsamling.

I datavisjon, og spesielt med hensyn til ansiktsgjenkjenning (FR) datasett, hevder forfatterne at corporate-, statlige og private interesser ofte kolliderer:

‘Corporate og regjeringsinstitusjoner har mål som kan komme i konflikt med personvern (f.eks. overvåking), og deres vektlegging av disse prioritetene er sannsynligvis forskjellig fra de som holdes av akademikere eller AI’s bredere samfunnsinteressenter.’

For ansiktsgjenkjenning, fant forskerne at forekomsten av rent akademiske datasett faller dramatisk mot gjennomsnittet:

‘[Fire] av de åtte datasettene (33,69% av totalt bruk) var eksklusivt finansiert av corporate, det amerikanske militæret eller den kinesiske regjeringen (MS-Celeb-1M, CASIA-Webface, IJB-A, VggFace2). MS-Celeb-1M ble til slutt trukket tilbake på grunn av kontrovers omkring verdien av personvern for forskjellige interessenter.’

I ovenstående graf, som forfatterne noterer, ser vi også at det relativt nye feltet Image Generation (eller Image Synthesis) er tungt avhengig av eksisterende, langt eldre datasett som ikke var ment for denne bruken.

Rapporten observerer en økende trend for ‘migrasjon’ av datasett bort fra deres opprinnelige formål, og stiller spørsmål om deres egnethet for behovene til nye eller utenforliggende forskningssektorer, og omfanget av hvilken grad budsjettbegrensninger kan ‘generisere’ omfanget av forskernes ambisjoner inn i den smalere rammen som både materialet og en kultur så obseddert med år-for-år-benchmark-rangeringer at nye datasett har vanskelig for å få fotfeste.

‘Våre funn indikerer også at datasett regelmessig overføres mellom forskjellige oppgave-samfunn. På den mest ekstreme siden, ble majoriteten av benchmark-datasettene i omløp for noen oppgave-samfunn skapt for andre oppgaver.’

Med hensyn til maskinlæringsluminariene (inkludert Andrew Ng) som har stadig kalt for mer diversitet og kuratering av datasett i de senere årene, støtter forfatterne holdningen, men tror at denne type innsats, selv om den er vellykket, potensielt kan bli underminert av den nåværende kulturens avhengighet av SOTA-resultater og etablerte datasett:

‘Vår forskning foreslår at å bare kalle for ML-forskere til å utvikle flere datasett, og å endre incitamentsstrukturer så at datasett-utvikling er verdsatt og belønnet, kan ikke være nok til å diversifisere datasett-bruk og perspektivene som ultimate formasjoner og setter MLR-forskningsagendaer.

‘I tillegg til å incitamentere datasett-utvikling, forespråker vi likeverdige politiske inngrep som prioriterer betydelig finansiering for personer i mindre ressurssterke institusjoner til å skape høykvalitetsdatasett. Dette ville diversifisere — fra et sosialt og kulturelt perspektiv — de benchmark-datasettene som brukes til å evaluere moderne ML-metoder.’

6. desember 2021, 16:49 – Rettet possessiv i overskrift. – MA