Andersons hoek

AI-gegenereerde afbeeldingen in het licht brengen met HDR

AI-afbeeldingen en -video’s kunnen indrukwekkend zijn, maar ze zijn niet van ‘professionele’ kwaliteit – een probleem dat een nieuw onderzoeksproject probeert aan te pakken.

In de professionele audiovisuele gemeenschap is een van de meest voorkomende bezwaren tegen de opkomst van AI het huidige gebrek aan professionele standaarden voor beeld- en videoreproductie. Niet in de laatste plaats is dit het vermogen om te werken met High Dynamic Range (HDR)-afbeeldingen en -video’s.

HDR-afbeeldingen zijn het moderne equivalent van een in de 19e en 20e eeuw gebruikte fotografische praktijk genaamd bracketing, waarbij dezelfde foto meerdere keren wordt genomen met een toenemende hoeveelheid licht dat op de filmemulsie wordt toegelaten:

Boven, een korte bracketed sequentie. Ingevoegd hieronder, de hoge dynamische bereik dat kan worden afgeleid van deze foto’s in één afbeelding. Bron

In traditionele fotografie resulteerde dit in meerdere foto’s die, met enige expertise en inspanning, konden worden samengesteld tot één afdruk die profiteerde van alle verschillende niveaus van detail die beschikbaar waren over het bereik van de belichtingen. Maar het was geen triviaal of eenvoudig proces.

Deze dagen kan een ‘auto-bracketed’ beeldsequentie ofwel meerdere beelden produceren of worden samengevoegd tot één HDR-afbeelding – effectief een veelvoud van belichtingen in één beeld, die HDR-capabele beeldbewerkingsprogramma’s zoals Photoshop kunnen doorlopen en de fotograaf toelaten om te orkestreren in één ideale uitvoerbeeld.

Als je je afvraagt waarom je je hier druk over zou moeten maken, of hoe dit soort dingen je eigen fotografie beïnvloedt, is de illustratie voor dit artikel bedoeld om dit op een vertrouwde manier te demonstreren:

Boven, links zien we een typisch voorbeeld van een sRGB (d.w.z. niet-HDR) beeld. Alleen het verhelderen (getoond rechts) toont niet de monster in de kast, omdat die details zijn weggegooid toen de fotograaf en de geautomatiseerde processen van de camera besloten wat te prioriteren in de foto:

Onder is een indicatie (links) van hoe ‘uitgebleekt’ de voorgrond zou moeten zijn op het moment van belichting om de kast-monster te registreren in een niet-HDR-foto, en (rechts) hoe het monster in duisternis wordt ondergedompeld wanneer de belichting wordt gemaakt voor de goed verlichte voorgrondonderwerpen:

Onder zien we het soort detail dat kan worden ‘gered’ uit een HDR-afbeelding of -beeldsequentie. In dit geval was de monster ‘verborgen’ in de laagste visuele registers van de HDR-sequentie, op een niveau waar de rest van de inhoud ‘uitgebleekt’ zou zijn in bijna-wit (boven, links). Door te specificeren dat een breed bereik van helderheidsniveaus selectief in hetzelfde beeld moet worden uitgedrukt, kunnen deze dissonante elementen worden samengesteld tot één rationeel beeld:

Een niet-HDR-afbeelding wordt een display-referred image genoemd, en een hoog-gamut HDR-afbeelding wordt een scene-referred image genoemd.

HDR-video is ook een ding, en deze soort tonale veelzijdigheid en ductiliteit geeft filmmakers enige vrijheid om beelden te redden, te graderen en te interpreteren op een aantal creatieve en consistente manieren; niet verwonderlijk, dan, dat creatieven aarzelen om te werken met de ‘platte’ sRGB-uitvoer die typisch is voor de meeste generatieve AI-kaders.

HDR in AI

Natuurlijk is de onderzoekssector geïnteresseerd in het brengen van AI-gegenereerde kaders in de HDR-tijdperk. Echter, het is geen triviaal taak, zowel vanwege de fundamentele architectuur van diffusie-gebaseerde generatieve systemen, als vanwege het feit dat goede HDR-gegevens een grote hoeveelheid schijfruimte in beslag nemen, waardoor onhandige verzamelingen ontstaan; gevolglijk zijn datasets die geschikt zijn voor de taak schaars.

Niettemin biedt een samenwerking tussen een universiteit in Singapore en Adobe Research een methode om HDR-beeldsequentieën te produceren, in een methodologie die theoretisch kan worden toegepast op zowel video als stilbeelden:

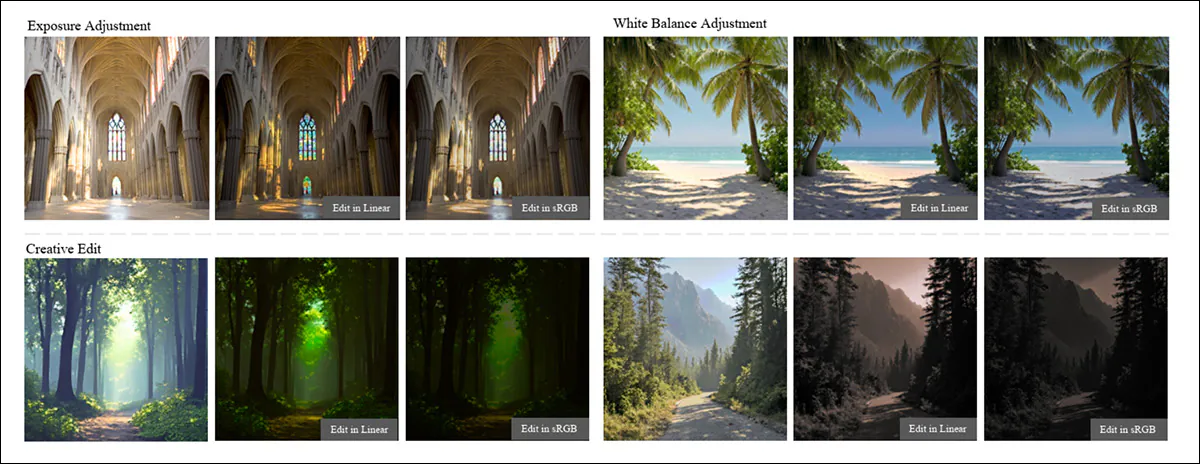

Van de projectsite voor het nieuwe werk, voorbeelden van ‘gebrackette’ tekst-naar-afbeelding-uitvoer. Bron

Het nieuwe systeem genereert meerdere gealigneerde versies van hetzelfde beeld bij verschillende helderheidsniveaus en leert hoe helder de scène werkelijk was, en combineert deze vervolgens tot één resultaat dat detail behoudt in zowel schaduwen als highlights, waardoor latere bewerkingen van belichting of kleur zich kunnen gedragen als aanpassingen aan een echte camera-opname, in plaats van kwetsbare aanpassingen aan een volledig verwerkt beeld.

Het systeem maakt gebruik van een diversiteit van verschillende modellen voor de taak, waaronder varianten van Qwen en Flux:

Voorbeelden uit het nieuwe artikel, waarin wordt getoond hoe het systeem meerdere exposure-versies van dezelfde scène kan genereren terwijl de onderliggende structuur vast blijft. Vanaf een eenvoudige randkaart produceert het model consistente beelden over zeer donkere tot zeer heldere instellingen, of de prompt beschrijft maanlicht, zonlicht, zonsondergang of zelfs een klein voorwerp zoals een ballon, met het onderwerp en de compositie die stabiel blijven terwijl alleen de verlichting verandert. De methode kan helderheid op een gecontroleerde, camera-achtige manier variëren, in plaats van te zweven of nieuwe inhoud te verzinnen bij blootstellingsschommelingen. Bron

De auteurs verklaren:

‘Het genereren van lineaire beelden is moeilijk, omdat vooraf getrainde VAE’s in latent diffusiemodellen moeite hebben om extreme highlights en schaduwen tegelijk te behouden vanwege de hogere dynamische bereik en bitdiepte.

‘Daartoe vertegenwoordigen we een lineair beeld als een reeks van exposure-brackets, elk een specifiek deel van het dynamische bereik vastleggend, en stellen we een DiT-gebaseerde flow-matching-architectuur voor voor tekst-geconditioneerde exposure-bracket-generatie.

‘We demonstreren verder downstream-toepassingen, waaronder tekst-geleide lineaire beeldbewerking en structuur-geconditioneerde generatie via ControlNet.’

Het nieuwe werk heeft de titel Lineaire beeldgeneratie door synthese van exposure-brackets en komt van vier auteurs uit S-Lab aan de Nanyang Technological University, Adobe NextCam en Adobe Research. Naast de eerdergenoemde projectpagina en de YouTube-video die bij de release hoort, is er ook een (momenteel schaarse) GitHub-repo en de belofte van een dataset-release.

Hoewel de auteurs veel voorbeelden van output van het systeem op de bijbehorende projectpagina leveren, zullen kijkers een HDR-capabele monitor nodig hebben om de kenmerken van de HDR-uitvoer echt te onderscheiden. Niettemin vindt u de onderzoekersthe YouTube-overzicht ingesloten aan het einde van dit artikel – maar wees zich ervan bewust dat de verschillen tussen de getoonde voorbeelden mogelijk niet duidelijk zijn op een niet-HDR-monitor.

Methode en gegevens

De auteurs benadrukken de mate waarin gegevensverzameling een uitdaging is in deze specifieke onderneming:

‘Het verkrijgen van een groot aantal lineaire beelden is uiterst moeilijk in de praktijk. Bovendien zijn de meeste openbare HDR-datasets ofwel panorama (en richten zich dus bijna uitsluitend op grote-schaal-scène-inhoud) of leveren ze geen echte lineaire beelden, waardoor ze ongeschikt zijn voor onze doeleinden.

‘Daarom gebruiken we voornamelijk RAW-beeld-datasets als basis voor training.’

De onderzoekers maakten creatief gebruik van de weinige opties die ze hadden, door de RAISE-dataset te gebruiken als echte trainingsgegevens en de MIT-Adobe FiveK-dataset als evaluatiegegevens*.

Om bruikbare HDR-trainingsgegevens te bouwen, verwerkten de onderzoekers de RAW-camera-bestanden via een gestandaardiseerde pijplijn om camera-specifieke eigenaardigheden weg te halen, en zetten ze de beelden om in een consistente, scène-referente lineaire formaat:

Schema voor de workflow van de auteurs: het systeem start vanaf ruis die vier exposure-niveaus van dezelfde scène vertegenwoordigt, samen met een tekstprompt en een helderheidstoken. Dit wordt vervolgens verwerkt via gestapelde transformatie-blokken die de verschillende exposure-niveaus uitlijnen terwijl ze de verlichting aanpassen. Het systeem voorspelt vervolgens zowel de set van exposure-afbeeldingen als een algemene helderheidsschaal, en decodeert en combineert ze vervolgens tot één scène-referente afbeelding, waarbij detail in zowel schaduwen als highlights wordt behouden.

Dit omvatte het reconstrueren van volledig RGB vanuit sensordata, het toepassen van kleurcorrectie, het normaliseren van witbalans en het kortstondig verplaatsen naar een perceptueel kleurruimte voor ruisreductie voordat terug te keren naar een schoon lineair signaal. De werkelijke licht in de scène werd vervolgens hersteld met behulp van de belichtingsinstellingen van de camera, zodat elk pixel de werkelijke helderheid weerspiegelde in plaats van een display-klaar benadering.

Omdat dergelijke waarden sterk kunnen variëren, werd de data vervolgens gestabiliseerd door elke afbeelding te schalen op basis van de eigen helderheidsverdeling, met behulp van mid-range- en highlight-statistieken om zowel uitgebleekte afbeeldingen als overbelichte highlights te vermijden, en uiteindelijk een genormaliseerde lineaire afbeelding te verkrijgen die het werkelijke bereik van licht in de scène behield, terwijl deze stabiel genoeg bleef voor training.

Tekstlabels voor de afbeeldingen werden vervolgens gemaakt met het Qwen2.5-VL 7B-model, met prompts die waren ontworpen om de kenmerken van het Flux-model te matchen dat zou worden gebruikt bij generatie-tijd.

Elke afbeelding werd gesplitst in exposure-‘slices’ en doorgegeven aan een gedeelde VAE-encoder, die alle exposure-niveaus omzette in een gemeenschappelijke latent-ruimte die was ontworpen om het volledige helderheidsbereik te vangen. De latenten werden vervolgens verfijnd vanuit ruis en gedecodeerd terug naar afbeeldingen, waardoor consistente reconstructie mogelijk was over donkere en heldere gebieden, zonder dat deze werden samengevoegd tot één ‘geplatte’ exposure.

LoRA-finetuning werd gebruikt om het vooraf getrainde Flux-backbone aan te passen aan lineaire beeldgegevens met minimale extra parameters, waardoor het Single-Diffusion Transformers (single-DiT)-model stabiel bleef, zelfs wanneer de helderheid varieerde over exposure-brackets.

Exposure Modulation Self-Attention (centrale kolom in schema-illustratie hierboven) werd geïntroduceerd om alle brackets gezamenlijk te verwerken, waardoor luminantie per exposure kon worden aangepast terwijl structuur en fijne details werden uitgelijnd.

3D Rotary Positional Embedding (3D-R[o]PE) werd gebruikt om zowel spatiale positie als exposure-identiteit te coderen, zodat het model kon onderscheiden tot welk bracket elk token behoorde, terwijl spatiale consistentie werd behouden, waardoor een schone scheiding van helderheidsvariatie van scène-inhoud mogelijk was.

Overzicht van de dataset die in de studie wordt gebruikt, waarin wordt getoond hoe afbeeldingen zijn verdeeld over inhoudstypen en binnen- en buitenscènes, naast de spreiding van helderheidswaarden in de verwerkte gegevens. De histogrammen plotten luminantie en de stralingschaal in log-ruimte, waaruit blijkt hoe breed de helderheid in de werkelijke wereld kan variëren, met hogere stralingswaarden die fysiek helderder scènes aangeven en de sterke dynamische bereik van het model aantonen.

3D-RoPE split waar een kenmerk was en ‘welk exposure het afkomstig is’ in afzonderlijke signalen, zodat helderheidsvariatie onafhankelijk kon worden aangepast, zonder de spatiale details te corrumperen.

Tests

De onderzoekers gebruikten Flux-dev als generatief kader, met training die plaatsvond op vier NVIDIA A100-GPU’s, elk met 80GB VRAM. De batchgrootte werd ingesteld op 4 (per GPU), over 10.000 iteraties.

LoRA-finetuning gebruikte een rank van 64. De AdamW-optimizer werd gebruikt bij een leer tempo van 2×102 (voor het exposure-modulatie-aspect).

De auteurs merken op dat er twee eerdere werken zijn die vergelijkbaar zijn in omvang, maar dat geen van beiden een voor de hand liggende kandidaat was voor een testfase. Het door Max Planck geleide uitstapje van 2022 GlowGAN is beperkt tot het genereren van specifieke beeldcategorieën, terwijl Bracket Diffusion (opnieuw geleid door het Max Planck Institute) uit 2025 alleen een HDR-afbeelding kan genereren op 256x256px, en enkele minuten nodig heeft om dit te doen.

Uit het originele GlowGAN-artikel, typische laag-dynamische bereik (LDR) beelden verliezen detail in schaduwen en highlights, terwijl het model leert om hoog-dynamische bereik (HDR) versies te produceren die detail behouden over helderheidsniveaus en herstel van verzadigde gebieden mogelijk maken via inverse toonkaart-mapping. Bron

Daarom werden de onderzoekers in de afwezigheid van directe baselines voor lineaire beeldgeneratie hun methode vergeleken met aangepaste versies van bestaande modellen, in plaats van speciaal ontworpen alternatieven.

Een reeks experimenten (‘T2I Fine-Tuning’) fine-tune de tekst-naar-afbeelding-diffusie-model Flux met LoRA, trainend om lineaire beelden direct te genereren, en evaluerend hoe een state-of-the-art T2I-model zich aanpaste aan dit domein.

Een tweede vergelijking (‘T2V fine-tuning’) gebruikte het tekst-naar-video-model Wan 2.1, waarvan de VAE meerdere frames comprimeert in een gedeelde latent; in deze setup werden vier exposure-brackets in één latent-representatie geëncodeerd en vervolgens gedecodeerd, testend of een video-achtig pijplijn exposure-variatie kon modelleren.

De derde reeks experimenten (‘T2I Model Inflation’) vergeleek tegen CameraCtrl en Generative Photography, die beide beeld-diffusie-modellen uitbreiden via temporele modules, om meerdere kaders te produceren.

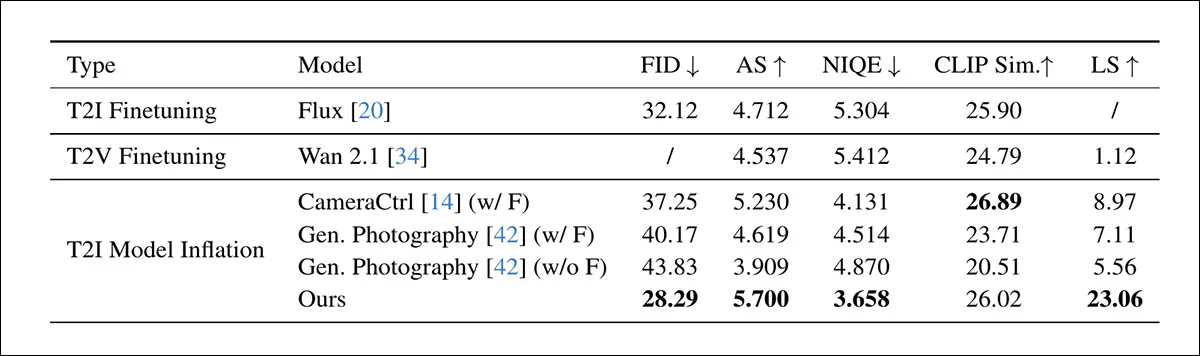

De gebruikte metrics waren Fréchet Inception Distance (FID); Aesthetic Score (AS); Naturalness Image Quality Evaluator (NIQUE); CLIP Sim score; en Luminantie Overeenkomst (LS):

Een vergelijking van de methode van de auteurs met enkele aangepaste baselines voor het genereren van lineaire, scène-referente beelden. Tekst-naar-afbeelding (Flux) en tekst-naar-video (Wan 2.1) modellen worden fine-getuned met LoRA om te testen hoe goed bestaande generatieve systemen deze instelling behandelen, terwijl CameraCtrl en Generative Photography beeld-diffusie-modellen uitbreiden met temporele componenten. Sommige scores ontbreken, omdat bepaalde modellen geen consistente exposure-brackets kunnen produceren, die nodig zijn om het volledige dynamische bereik te herstellen. Over de gerapporteerde metrics heen bereikt de nieuwe methode de sterkste overall resultaten, met name op maatregelen die verband houden met beeldkwaliteit en nauwkeurige helderheidsreconstructie.

Met betrekking tot deze resultaten verklaren de auteurs:

‘Vanwege de brede verdeling van lineaire beelden, maakt direct fine-tunen van T2I Model op lineaire gegevens het moeilijk om schaduw- en highlight-details in evenwicht te brengen. T2I Model Inflation-methoden lijden aan zowel een beperkt dynamisch bereik als een aanzienlijke beeldkwaliteitsdegradatie, zelfs na fine-tuning.

‘Voor T2V Fine-tuning entangle Wan 2.1’s 4× temporele downsampling de 4 exposure-brackets in één latent-representatie, waardoor een ernstige distributie-mismatch ontstaat die niet kan worden opgelost door fine-tuning alleen.

‘Door scène-referente eigenschappen rechtstreeks te modelleren met behulp van exposure-brackets, bereikt onze methode een superieure visuele kwaliteit en dynamisch bereik over alle baselines.’

Een vergelijking met LoRA-gefine-tune Flux en Wan 2.1, waarin wordt getoond hoe elke methode exposure-wijzigingen over dezelfde scènes behandelt. Concurrerende benaderingen hebben de neiging om detail te verliezen in zeer donkere of zeer heldere gebieden, terwijl de voorgestelde methode consistentie behoudt en bruikbaar detail herstelt over het volledige bereik van exposure-niveaus. Verwijs naar de bronartikel en appellant-projectsite voor betere kwaliteit voorbeelden.

Verwijs naar de uitgebreide experimenten en aanvullende materialen sectie van het bronartikel voor verdere tests.

Conclusie

Voor mediaprofessionals, zoals die in film- en tv-productie werken, heeft dezelfde uitvoer die de wereld heeft geïntrigeerd (en, steeds vaker, de irritatie van) de wereld verlaten, omdat bijna al hun pijplijnen op de een of andere manier afhankelijk zijn van HDR-opnames.

Daarom is dit een tijdig project, dat een faciliteit vertegenwoordigt die men zou hopen dat het een optionele standaard zou worden over nieuwe kaders – hoewel het zeker zal verdubbelen rendering tijden; duidelijk, ook, zal latentie serieus moeten worden aangepakt als HDR AI-inhoud niet wordt toegewezen aan de ‘in post’ in plaats van in-camera categorie.

* Normaal gesproken zouden we voorbeelden laten zien, maar aangezien de lezer mogelijk geen HDR-capabele monitor heeft, laten we deze in dit geval weg.

Eerst gepubliceerd op zondag, 26 april 2026