Andersons hoek

Het gebruik van AI om echte foto’s te verbeteren voordat ze zijn genomen

In plaats van GenAI te gebruiken om foto’s te corrigeren na u ze hebt gemaakt, hebben onderzoekers een systeem getraind dat u vertelt hoe u moet bewegen, poseren en de shot kaderen voordat u deze maakt, met behulp van gekende kennis over wat foto’s onthoudbaar maakt.

Het corrigeren van foto’s achteraf is al een tijdje gemakkelijker geworden, omdat fabrikanten en technologieplatforms steeds vaker in-camera bewerking aanbieden waarmee gebruikers afbeeldingen kunnen wijzigen zodra ze zijn gemaakt. Populaire systemen van dit type zijn onder andere Google’s conversational editing, en Samsung’s generative edit, onder andere.

Echter, een nieuwe trend die de voorkeur geeft aan ‘authenticiteit’ boven AI-verbeterde resultaten, kan ertoe leiden dat veel consumenten waarop deze systemen zijn gericht, ‘bewerkte’ foto’s als AI-slop gaan beschouwen.

Misschien is dit wat Google ertoe heeft gebracht om een AI-getrainde ‘camera-coach’ te creëren die is geïnformeerd door Gemini, die in staat is om directe instructies te geven om een foto tijdens het maken ervan te verbeteren:

Google’s Camera Coach vertelt de gebruiker hoe hij een foto moet herschikken, evenals andere basisinstructies. Bron

Als een propriëtair systeem, en met praktisch geen informatie beschikbaar online met betrekking tot het, lijkt Camera Coach Gemini te gebruiken om gebruikers te helpen bij het verbeteren van de framing (zie bovenstaande afbeelding) of om kleine veranderingen aan te brengen in de houding (zoals dichter bij elkaar komen of rechtstreeks naar de camera kijken).

Dus, voor zover iemand kan zien, duwt het product de compositie naar het gemiddelde, vermoedelijk op basis van miljoenen geüploade datapunten die waarschijnlijk hebben bijgedragen aan de trainingsdata van Gemini. Op deze manier hebben de uploadende gebruikers de kalibratie van de AI gemaakt door onbevredigende shots te weigeren en de shots die ze leuk vinden te uploaden – een effectieve (en gratis) vorm van dataset-curatie!

Dat gezegd hebbende, foto’s die gemiddeld zijn in termen van compositie, bezitten niet noodzakelijkerwijs dezelfde esthetische waarden of kijker-impact als foto’s die onthoudbaar zijn.

Verder dan ‘Cheese!’ en de Regel van de Drieën

Daartoe, en naar een systeem dat meer toegankelijk is over platforms, biedt nieuw onderzoek uit Italië een Coach-achtig systeem dat is gebaseerd op voorafgaande kennis van wat foto’s onthoudbaar maakt:

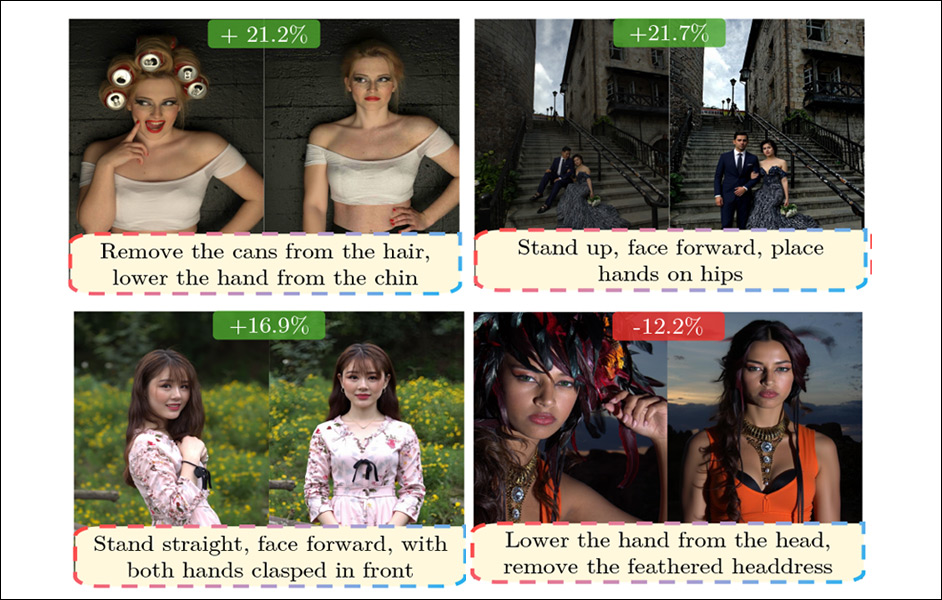

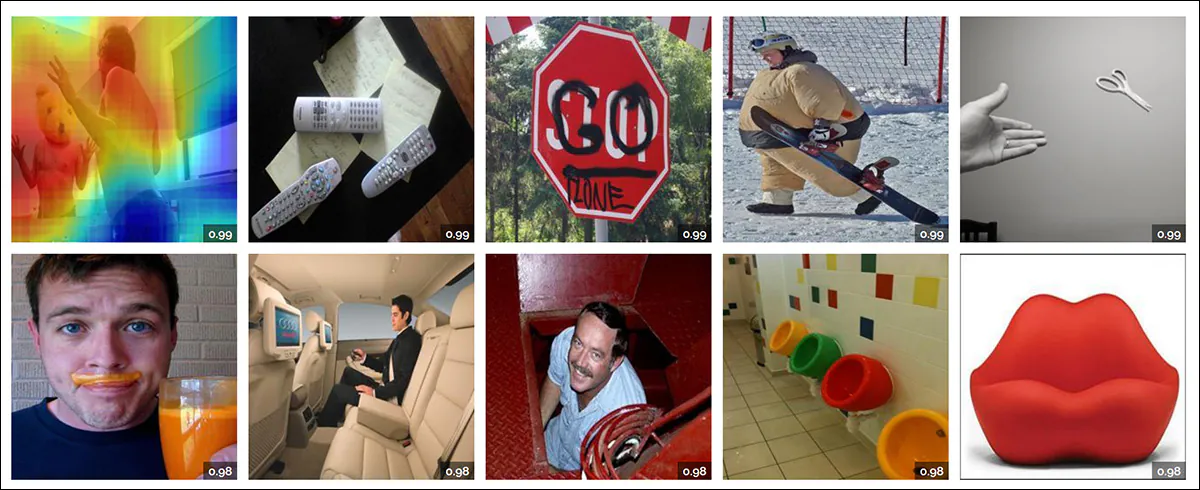

Uiteenlopende voorbeelden van instructies van het nieuwe systeem van de auteurs. Bron

In de bovenstaande voorbeelden zien we instructies gegeven door het nieuwe systeem van de auteurs – gedoopt MemCoach – die het moeilijk is om je voor te stellen dat een compositie-georiënteerde AI zoals Camera Coach zou kunnen geven. In het eerste (meest linkse) geval is de instructie om de hoofdbedekking te verwijderen bijzonder verdacht; in de tweede afbeelding is het moeilijk om te begrijpen wat een conventionele context een compositie-georiënteerde AI zou kunnen trekken uit het algemene scenario (d.w.z. een ‘artistieke’ afbeelding van een jonge vrouw die op de grond ligt met haar ogen dicht).

De kernbegrip over onthoudbaarheid in fotografie, gebruikt om het drieledige Italiaanse systeem te ontwikkelen, is afgeleid van verschillende eerdere werken, waaronder de uit 2015 uitgave Wat maakt een object onthoudbaar?, en de paper Wat maakt een foto onthoudbaar? uit 2013.

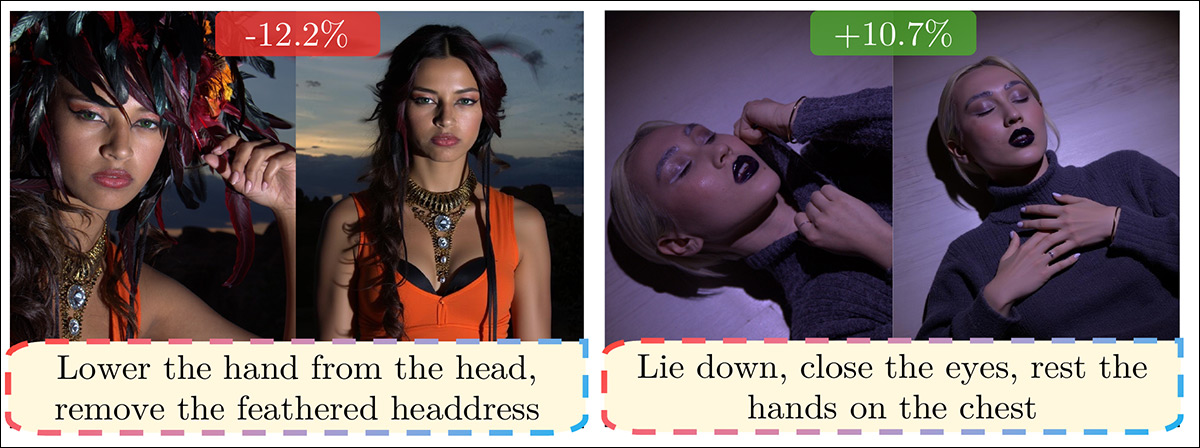

Uit de paper What makes a photograph memorable?, representatieve voorbeelden van goede, middelmatige en slechte foto’s, in termen van onthoudbaarheid. Bron

Iedereen, zoals ik, met een negatieve Unix-geboortedatum, zal waarschijnlijk het sjabloon voor ‘minst onthoudbare afbeeldingen’ (bovenste rechts in de afbeelding hierboven) herkennen, van de eindeloze slide-avonden die onze kindertijd hebben vervloekt. Zoals de auteurs verklaren*:

‘Deze werken identificeerden sleutelintrinsieke factoren zoals de aanwezigheid van mensen, binnenhuisscènes, of emotionele expressies, in plaats van objecten en panoramische weergaven, evenals extrinsieke factoren, waaronder context en de waarnemer. ‘

Het project draait om ‘onthoudbaarheidsfeedback’ (MemFeed), die wordt uitgedrukt in de MemCoach-tutor-toepassing, en een benchmark (getiteld MemBench) op basis van de PPR10K-dataset.

Uit de paper PPR10K: A Large-Scale Portrait Photo Retouching Dataset with Human-Region Mask and Group-Level Consistency, diverse voorbeelden uit de dataset. Boveste rij toont de oorspronkelijke afbeeldingen, onderste rij toont expert-geretoucheerde versies samen met overeenkomstige human-regiomaskeer. De oorspronkelijke foto’s variëren sterk in gezichtspunt, achtergrond, belichting en camera-instellingen, terwijl de geretoucheerde resultaten een verbeterde visuele kwaliteit en een sterkere consistentie binnen elke groep vertonen. Bron

De auteurs merken op dat onthoudbaarheid kwantificeerbaar is in foto’s, in plaats van een register van subjectieve oordelen, en de auteurs noteren verder dat de eigenschap zowel voor foto’s (in verschillende werken) als voor video’s (in verschillende andere) is geïdentificeerd.

Het nieuwe paper is getiteld Hoe neem je een onthoudbare foto? Gebruikers empoweren met actiegerichte feedback, en komt van vier onderzoekers uit de Universiteit van Trento, de Universiteit van Pisa en Fondazione Bruno Kessler. De bijbehorende projectpagina suggereert dat GitHub-code en Hugging Face-gehoste gegevens volgende maand (maart 2026) beschikbaar zullen zijn.

Methode

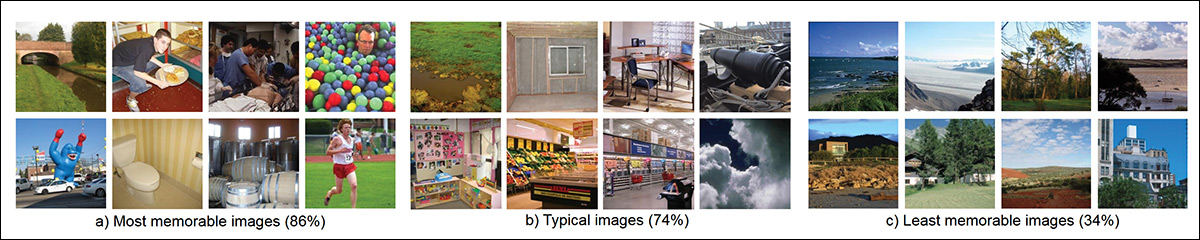

Om de MemBench-dataset te cureren uit de bron-PPR10K-portretdataset, groepeerden de onderzoekers foto’s uit hetzelfde scène en scoorden elke afbeelding voor onthoudbaarheid met een getrainde predictor op basis van CLIP functies. Ze rangschikten de foto’s vervolgens binnen elke scène van minder naar meer onthoudbaar en paarden ze dienovereenkomstig:

Overzicht van MemBench-constructie en evaluatie. Boveste rij toont de datapipeline, van het groeperen van afbeeldingen per scène en het voorspellen van onthoudbaarheid, tot het rangschikken van foto’s en het genereren van onthoudbaarheidsbewuste actiefeedback. Onderste rij illustreert evaluatie, met het meten van de kwaliteit van feedback via bewerkingsgebaseerde onthoudbaarheidswinst en perplexiteitsscore.

Voor elk paar werden natuurlijke taalbeschrijvingen gegenereerd met het InternVL3.5-model om de zichtbare verschillen tussen de minder onthoudbare versie en de meer onthoudbare versie te verklaren; en deze beschrijvingen zouden het trainings-signaal vormen voor het onthoudbaarheidsfeedbacksysteem.

In tegenstelling tot de logica die ten grondslag ligt aan Google’s Camera Coach, zochten de onderzoekers een subtieler set van interpretaties†:

‘In tegenstelling tot computergestuurde fotografische aanpassingen die zijn gericht op post-hoc correcties (bijv. “maak de afbeelding helderder”), richten wij ons op semantische acties die een gebruiker live kan uitvoeren voor een betere opname, bijv. “Kijk elkaar aan”.’

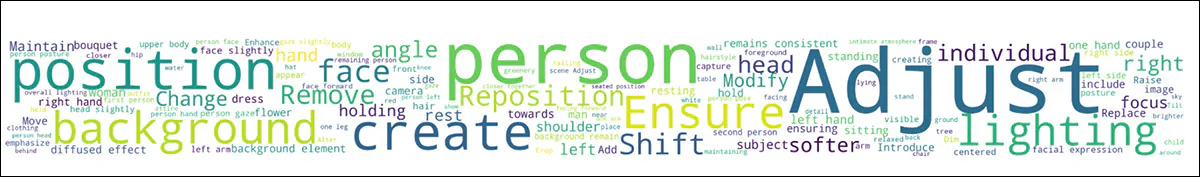

De definitieve MemBench-verzameling bestaat uit ongeveer 10.000 afbeeldingen, gegroepeerd in 1.570 scènes, met gemiddeld 6,5 afbeeldingen per scène. De woordenwolk die de auteurs hebben gegenereerd (zie afbeelding hieronder), suggereert een breed scala aan semantische categorieën in de dataset:

Een woordenwolk van de meest voorkomende termen in MemBench.

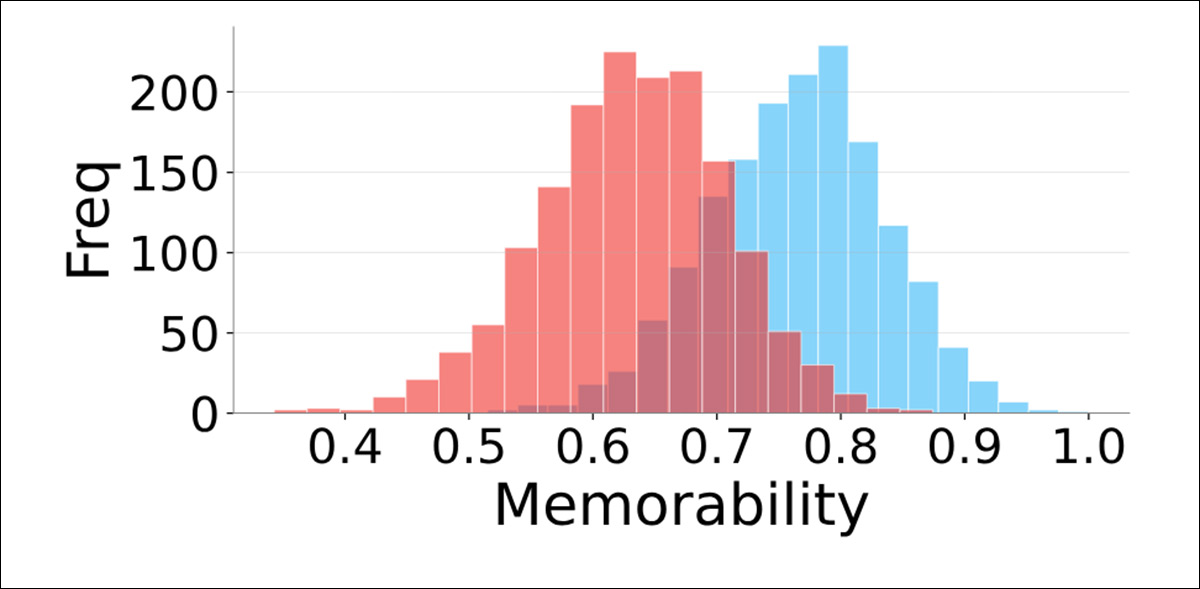

Bronafbeeldingen hadden gemiddeld een onthoudbaarheidsscore van 0,63, terwijl de meest onthoudbare opnames uit dezelfde scène varieerden van 0,51 tot 1,0, met een opvallende overlap tussen de twee groepen:

Verdeling van onthoudbaarheidsscores bij de vergelijking van de minst en meest onthoudbare afbeeldingen binnen elke scène.

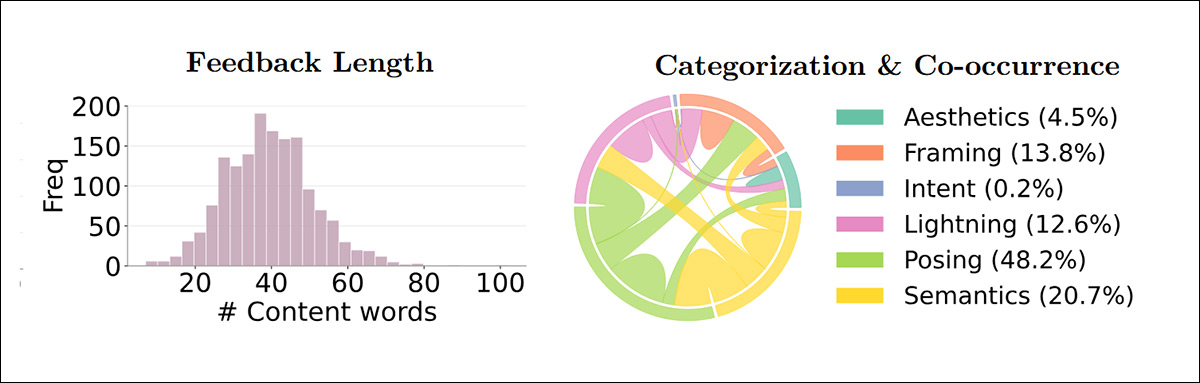

De feedback varieerde van korte notities van zeven woorden tot opvallend langere instructies (links in de afbeelding hieronder). Elke stukje advies werd vervolgens onderverdeeld in kleine actietypen met behulp van GPT-5 Mini (rechts in de afbeelding hieronder):

Verdeling van de lengte van feedback in inhoudswoorden, en categorisatie van atomaire sub-acties met akkoordbreedtes die de frequentie van co-occurrentie aangeven tussen categorieën.

De auteurs merken op dat de meeste suggesties zich richtten op hoe het onderwerp werd geposeerd, gevolgd door veranderingen in betekenis of scène-inhoud, waarbij framing vaak werd gekoppeld aan poseren, en verlichtingsaanpassingen vaak werden gekoppeld aan semantische veranderingen.

Flux Capacitor

Om te beoordelen of de onthoudbaarheid werd verhoogd door de feedback, werd de naleving van de gebruiker gesimuleerd door het gebruik van het FLUX.1 Kontext-generatieve model als een proxy voor de fotograaf. Gegeven een bronafbeelding en een stuk tekstuele feedback, werd een bewerkte versie gegenereerd door Flux die de voorgestelde veranderingen simuleerde:

De afbeeldingen links zijn echt, uit de dataset, en de afbeeldingen rechts (in elk geval) zijn gegenereerd door Flux op basis van de prompt (in geel, hieronder). Op deze manier kon de effectiviteit van prompts worden beoordeeld zonder uitgebreide menselijke betrokkenheid. Deze kennis zou uiteindelijk terugkeren naar het MemCoach-kader, en vertegenwoordigt in feite een werkstroom die een systeem van dit type (d.w.z. uiteindelijk met echte voorbeelden in plaats van Flux-voorbeelden) iteratief kan verbeteren.

Zowel de oorspronkelijke als de bewerkte afbeeldingen werden vervolgens door een onthoudbaarheidspredictor geleid, waardoor het meten van hoe vaak de bewerkte versie een hogere score behaalde – genaamd de Verbeteringsratio – en hoe groot de winst was ten opzichte van de startafbeelding, genaamd Relatieve onthoudbaarheid.

Overeenkomst met onthoudbaarheidsgerichte referentie-instructies werd ook gemeten door de perplexiteit te berekenen tegen de grondwaarheidsbeschrijvingen, en een 80–20 split werd toegepast op scèneniveau, zodat alleen op scènes werd getest die niet waren gebruikt tijdens de training.

State of the Art

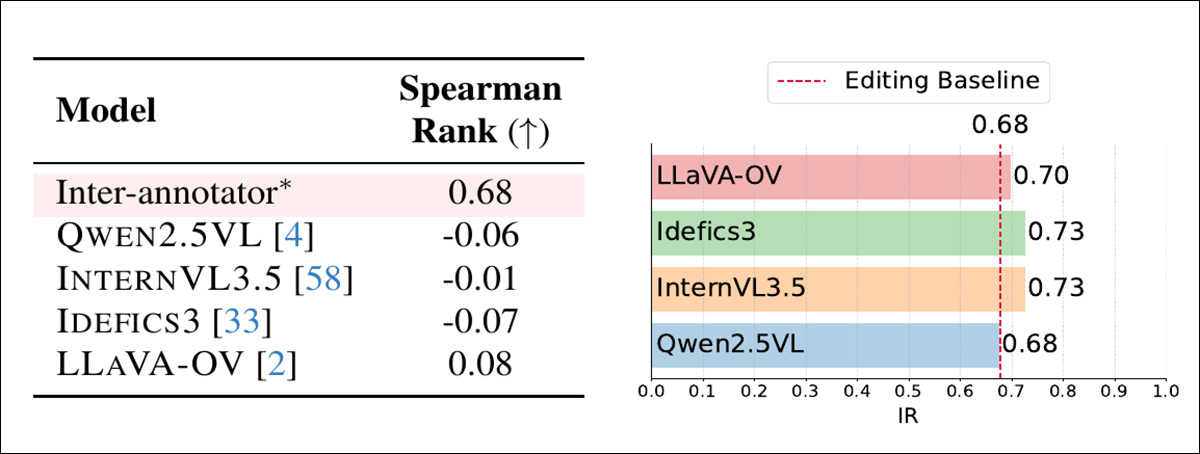

De onthoudbaarheidsbewustzijn van huidige multimodale grote taalmodellen werd getest. Afbeeldingen uit de LaMem-dataset werden getoond aan verschillende toonaangevende modellen, die werden gevraagd of de afbeelding onthoudbaar was. De schatting van het model werd vervolgens vergeleken met de scores die waren toegewezen door menselijke kijkers in de oorspronkelijke studie:

Tests die aantonen dat basismultimodale modellen de onthoudbaarheid niet vastleggen. Links, Spearman-rangcorrelatie tussen modelvoorspellingen en LaMem-grondwaarheidscores, met inter-annotatorovereenstemming van LaMem weergegeven voor referentie. Rechts, verbeteringsratio behaald door zero-shot-feedback ten opzichte van de bewerkingsbaseline, met slechts marginale winst.

Bijna geen enkele betekenisvolle correlatie met menselijke oordelen werd gevonden, en ondanks grote voorafgaande training, beweren de auteurs dat de modellen niet wat mensen consequent onthouden.

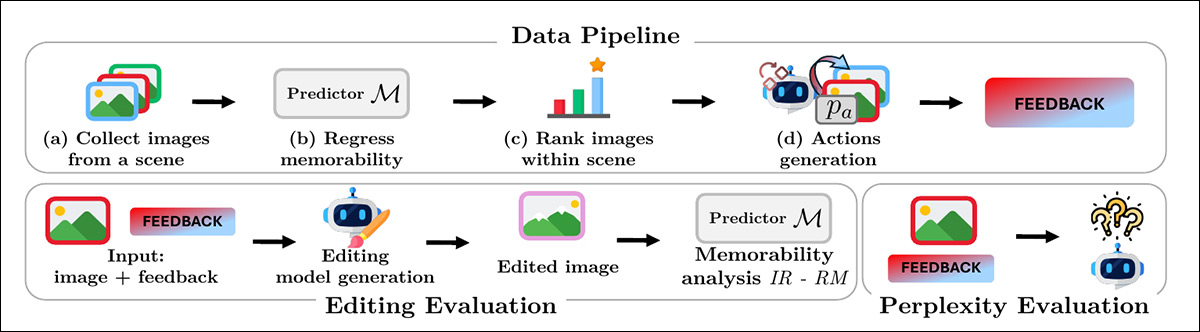

MemCoach

MemCoach richt zich op semantische, live-instructies die kunnen worden uitgevoerd voordat de sluiter wordt ingedrukt – bijvoorbeeld door de pose aan te passen, interacties tussen onderwerpen te wijzigen of scène-elementen te modificeren. De feedback die door MemCoach wordt gegeven, varieert van 7 tot 102 inhoudswoorden. Onthoudbaarheid, zo stelt het paper, lijkt meer te worden aangedreven door onderwerpconfiguratie en narratieve signalen dan door eenvoudige compositie-aanpassingen:

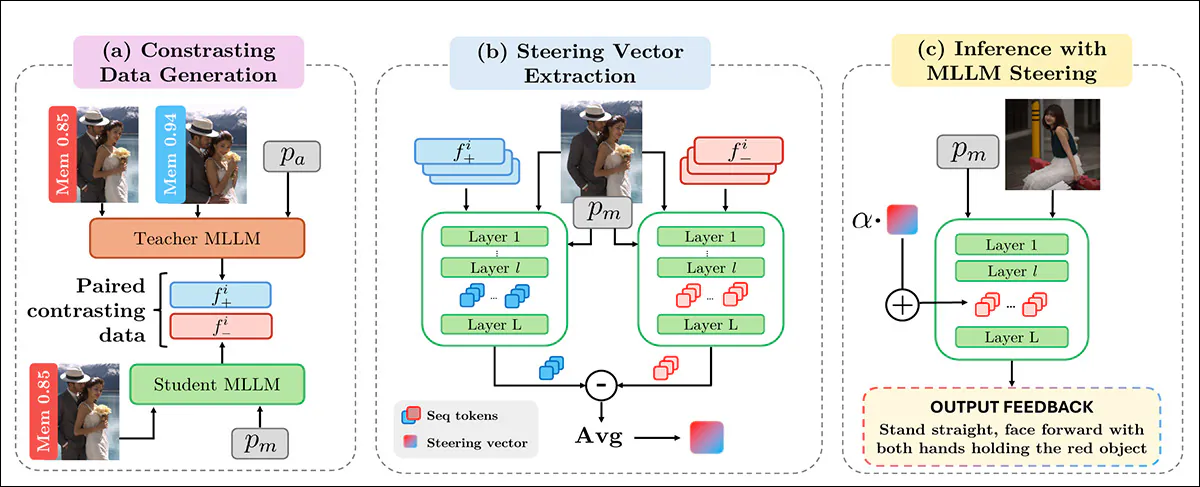

Overzicht van de MemCoach-pijplijn, waarin onthoudbaarheidsbewuste instructies van een leermeester-MLLM worden gepaard met neutrale studentenreacties om contrastieve gegevens te vormen; activiteitsverschillen over lagen worden gemiddeld om een onthoudbaarheidsstuurvector te verkrijgen; en die vector wordt ingevoerd bij inferentie om studentenactiviteiten te verschuiven naar het produceren van verbeterde, onthoudbaarheidsgerichte feedback, zonder aanvullende training.

Tests

Zeven Multimodale Grote Taalmodellen (MLLM’s) werden gebruikt in de testfase voor het nieuwe systeem: Qwen2.5V.L; InternVL3_5-8B; Idefics3-8B; en LLaVA-OneVision-1.5. Daarnaast werd GPT-5 Mini opgenomen als een vertegenwoordiger van propriëtaire, gesloten modellen, evenals de esthetiek-georiënteerde Q-Instruct en AesExpert-modellen. De MLLM’s werkten op verschillende manieren als zero-shot en leermeester-orakels.

InternVL3.5 werd gebruikt voor zowel de leermeester- als de studentenmodellen, met de MemBench-trainingsplitsing gebruikt om contrastieve voorbeelden te creëren:

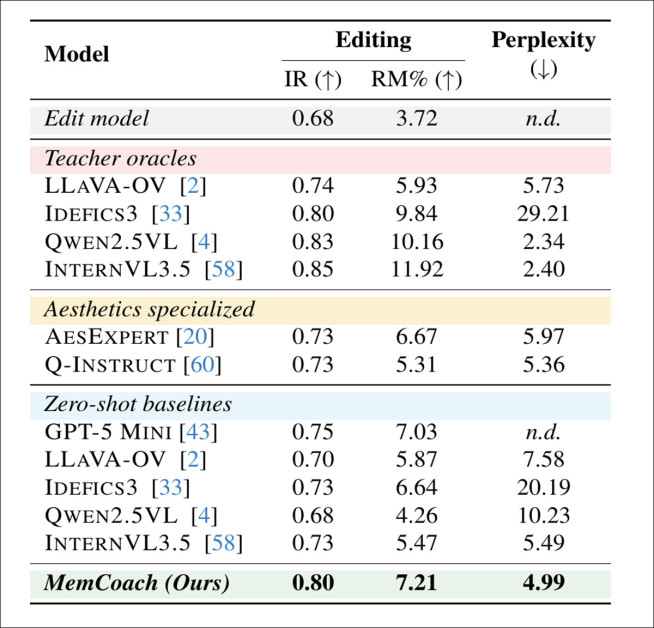

MemCoach-prestaties in vergelijking met state-of-the-art MLLM’s over leermeester-orakels, esthetiek-georiënteerde modellen en zero-shot-baselines, met een hogere verbeteringsratio en concurrerende relatieve onthoudbaarheid, evenals de laagste perplexiteit, wat aangeeft dat de feedback consistenter en meer onthoudbaarheidsgericht is.

In de tabel voor de eerste test (hierboven weergegeven) zien we dat MemCoach meer effectieve onthoudbaarheidsadvies lijkt te geven dan enig van de vergelijkingsmodellen – en het gestuurde InternVL3.5-model verhoogt de onthoudbaarheid vaker en met een grotere hoeveelheid, met een 5% verbeteringsratio-winst ten opzichte van GPT-5 Mini, en een 31,81% sprong in relatieve onthoudbaarheid ten opzichte van zijn ongestuurde versie.

Het presteert ook beter dan esthetiek-georiënteerde systemen, ondanks dat het geen extra training vereist. Lagere perplexiteit, zo beweert het paper, suggereert verder dat de feedback van MemCoach dezelfde linguïstische patronen volgt die menselijke onthoudbaarheidsoordelen tendens hebben om te belonen:

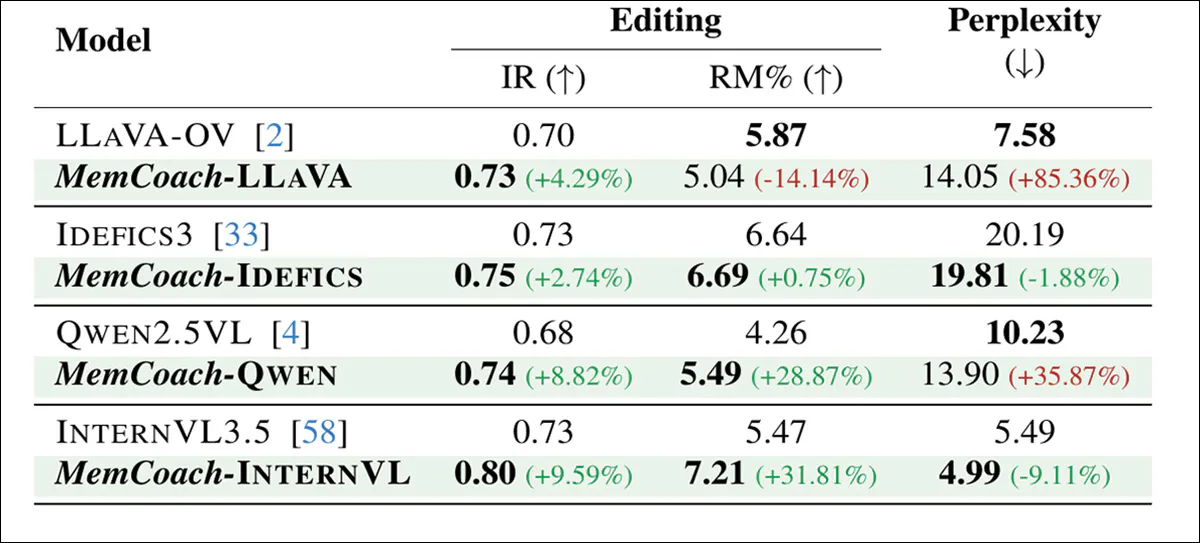

Generalisatieresultaten die aantonen dat MemCoach de onthoudbaarheidsgerichte feedback over meerdere multimodale backbones verbetert, door consequent de verbeteringsratio en relatieve onthoudbaarheid te verhogen, evenals het reduceren van perplexiteit voor de meeste modellen.

Een kwalitatieve evaluatie werd vervolgens uitgevoerd, waarbij voorbeelden van MemCoach-feedback werden geanalyseerd waarin de bronafbeelding, de natuurlijke taal-suggestie en het veronderstelde verbeterde resultaat zij aan zij werden bekeken:

Kwalitatieve voorbeelden van onthoudbaarheidsgerichte feedback gegenereerd door MemCoach. Elke triplet toont de bronafbeelding, de natuurlijke taal-instructie en de resulterende bewerkte afbeelding, met relatieve onthoudbaarheid (RM) die de gemeten verandering aangeeft. De instructies variëren van pose- en blikaanpassingen tot semantische interventies zoals het verwijderen van objecten, waarbij zowel succesvolle winst als gevallen waarin het verwijderen van ongebruikelijke elementen de onthoudbaarheid vermindert, worden geïllustreerd.

Van deze resultaten zeggen de auteurs:

‘De voorbeelden benadrukken de variëteit aan suggesties die het model doet, variërend van fijne compositieaanpassingen, zoals het veranderen van de blikrichting, pose of handpositie, tot semantische interventies die het verwijderen van objecten of het veranderen van gezichtsuitdrukkingen betreffen.

‘Feedback is natuurlijk interpreteerbaar en uitvoerbaar, uitgedrukt in bondige tekstuele instructies (meestal met werkwoorden “Breng”, “Sta”, “Verwijder”) die direct kunnen worden geïmplementeerd, effectief verwoorden hoe je een onthoudbare foto neemt.’

Conclusie

Het zou het meest interessant zijn om de methodologie van Google’s gesloten benadering te vergelijken met het MemBench-project – niet in de laatste plaats om te weten wat de centrale standaarden, referenties en databases zijn die Google heeft gebruikt om de esthetische standaarden van het systeem te definiëren.

Het negatieve aspect van systemen van dit type, open of gesloten bron, is dat ze op grote schaal het risico lopen om uniforme standaarden af te dwingen die zijn voorbestemd om te eindigen als memes en clichés – een soort visueel equivalent van de AI-streepje-debatten, waarin de ‘juiste’ procedure enigszins vervloekt is in informeel gebruik.

* Mijn conversie van de inline-citaten van de auteurs naar hyperlinks, als de link niet elders in het artikel wordt weergegeven.

† Het paper verwijst hier, evenals op verschillende andere plaatsen, naar ‘aanvullend materiaal’ dat ik niet kan vinden, noch vanuit het paper, noch vanuit de kern-Arxiv-lijst, noch vanuit de projectsite.

Eerst gepubliceerd op donderdag 26 februari 2026