Andersons hoek

Kleiner Deepfakes Zijn Misschien Wel Het Grotere Gevaar

Conversational AI-tools zoals ChatGPT en Google Gemini worden nu gebruikt om deepfakes te maken die geen gezichten wisselen, maar op meer subtiele manieren het hele verhaal binnen een afbeelding herschrijven. Door gebaren, rekwisieten en achtergronden te veranderen, misleiden deze bewerkingen zowel AI-detectors als mensen, waardoor de inzet voor het identificeren van wat online echt is, wordt verhoogd.

In de huidige klimaat, met name in de nasleep van significante wetgeving zoals de TAKE IT DOWN-wet, associëren veel van ons deepfakes en AI-gedreven identiteitssynthese met non-consensuele AI-porno en politieke manipulatie – in het algemeen, grove vertekeningen van de waarheid.

Dit laat ons verwachten dat AI-gemanipuleerde afbeeldingen altijd hoogstaande inhoud zullen hebben, waar de kwaliteit van de rendering en de manipulatie van de context mogelijk kunnen slagen in het bereiken van een geloofwaardigheidscoup, althans op korte termijn.

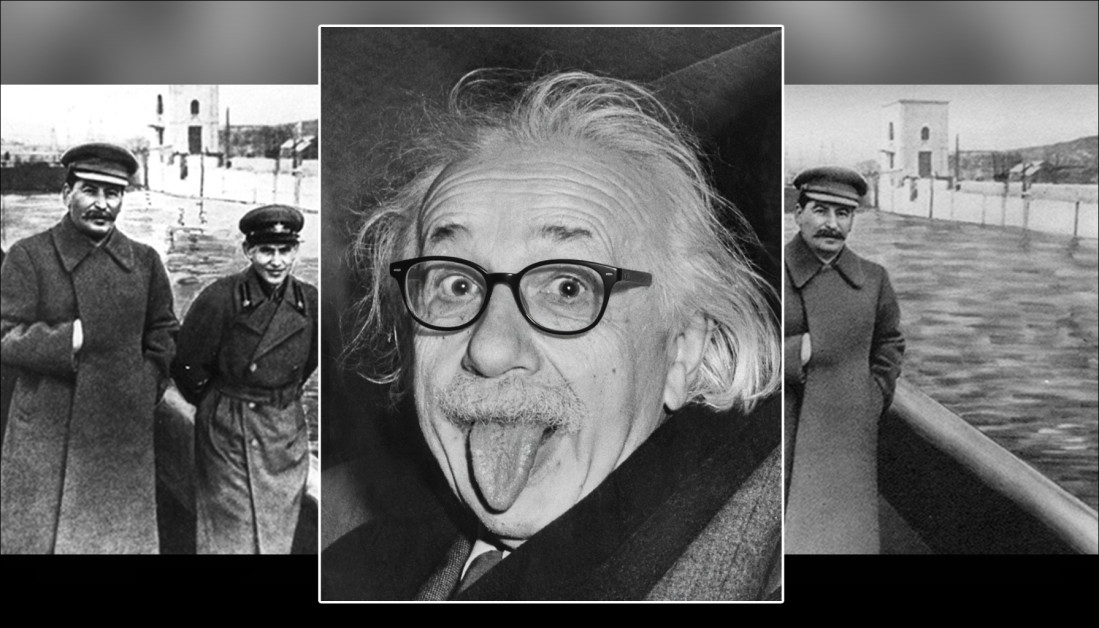

Historisch gezien hebben echter veel subtielere veranderingen vaak een meer sinistere en duurzamere uitwerking gehad – zoals de staat-van-de-kunst-fotografische trucage die Stalin in staat stelde om degenen die in ongenade waren gevallen, uit het fotografische record te verwijderen, zoals gesatiriseerd in de roman Negentien Vierentachtig van George Orwell, waarin de protagonist Winston Smith zijn dagen doorbrengt met het herschrijven van de geschiedenis en het creëren, vernietigen en ‘amenderen’ van foto’s.

In het volgende voorbeeld is het probleem met de tweede afbeelding dat we ‘niet weten wat we niet weten’ – dat de voormalige hoofd van Stalin’s geheime politie, Nikolai Yezhov, de ruimte bezette waar nu alleen een veiligheidsbarrière is:

Nu zie je hem, nu is hij… verdwenen. Stalin-tijdperk fotografische manipulatie verwijdert een in ongenade gevallen partijlid uit de geschiedenis. Bron: Publiek domein, via https://www.rferl.org/a/soviet-airbrushing-the-censors-who-scratched-out-history/29361426.html

Stromingen van deze soort, die vaak herhaald worden, bestaan op veel manieren voort; niet alleen cultureel, maar ook in computerzicht, dat trends afleidt uit statistisch dominante thema’s en motieven in trainingsdatasets. Om een voorbeeld te geven, het feit dat smartphones de drempel hebben verlaagd en massaal de kosten van fotografie hebben verlaagd, betekent dat hun iconografie onweerstaanbaar is geassocieerd met veel abstracte concepten, zelfs wanneer dit niet passend is.

Als conventionele deepfaking kan worden beschouwd als een daad van ‘aanval’, zijn kwaadaardige en persistente kleine veranderingen in audiovisuele media meer vergelijkbaar met ‘gaslighting’. Bovendien maakt de capaciteit van dit soort deepfaking om onopgemerkt te blijven, het moeilijk om te identificeren met behulp van state-of-the-art deepfake detectiesystemen (die op zoek zijn naar grove veranderingen). Deze aanpak is meer vergelijkbaar met water dat over een lange periode tegen een rots slijt, dan een rots die op een hoofd is gericht.

MultiFakeVerse

Onderzoekers uit Australië hebben een poging gedaan om de aandacht te richten op ‘subtiele’ deepfaking in de literatuur, door een aanzienlijke nieuwe dataset van personen-gerichte beeldmanipulaties te cureren die context, emotie en verhaal veranderen zonder de core-identiteit van de persoon te veranderen:

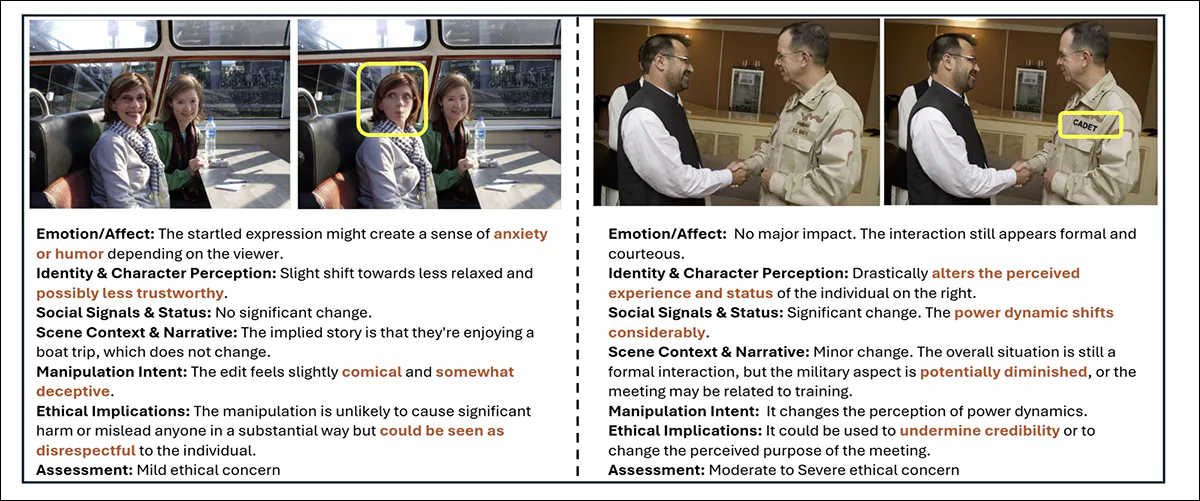

Voorbeelden uit de nieuwe collectie, echte/valse paren, met sommige veranderingen subtieler dan andere. Let op, bijvoorbeeld, het verlies van autoriteit voor de Aziatische vrouw, onder-rechts, wanneer haar doktersstethoscoop door AI wordt verwijderd. Tegelijkertijd heeft de vervanging van het doktersblok voor het clipboard geen voor de hand liggende semantische hoek. Bron: https://huggingface.co/datasets/parulgupta/MultiFakeVerse_preview

Genoemd MultiFakeVerse, bestaat de collectie uit 845.826 afbeeldingen gegenereerd via visie-taalmodellen (VLM’s), die online kunnen worden geopend en gedownload, met toestemming.

De auteurs verklaren:

‘Deze VLM-gedreven aanpak maakt semantische, context-gevoelige veranderingen mogelijk, zoals het wijzigen van acties, scènes en mens-object-interacties, in plaats van synthetische of laag-niveau-identiteitswisselingen en regio-specifieke bewerkingen die gebruikelijk zijn in bestaande datasets.’

‘Onze experimenten laten zien dat huidige state-of-the-art deepfake detectiemodellen en menselijke waarnemers moeite hebben om deze subtiele maar betekenisvolle manipulaties te detecteren.’

De onderzoekers testten zowel mensen als leidende deepfake detectiesystemen op hun nieuwe dataset om te zien hoe goed deze subtiele manipulaties konden worden geïdentificeerd. Menselijke deelnemers worstelden, classificeerden afbeeldingen als echt of vals slechts ongeveer 62% van de tijd, en hadden nog meer moeite om te bepalen welke delen van de afbeelding waren gewijzigd.

Bestaande deepfake detectors, getraind op meer voor de hand liggende gezichtswisseling of inpainting-datasets, presteerden ook slecht, vaak falend om te registreren dat er een manipulatie had plaatsgevonden. Zelfs na fine-tuning op MultiFakeVerse, bleven detectiepercentages laag, waardoor bleek hoe slecht huidige systemen deze subtiele, verhaal-gedreven bewerkingen afhandelen.

Het nieuwe artikel heeft als titel Multiverse Through Deepfakes: The MultiFakeVerse Dataset of Person-Centric Visual and Conceptual Manipulations, en komt van vijf onderzoekers uit Monash University in Melbourne, en Curtin University in Perth. Code en gerelateerde gegevens zijn vrijgegeven op GitHub, naast de Hugging Face-hosting die eerder werd genoemd.

Methode

De MultiFakeVerse-dataset werd opgebouwd uit vier real-world beeldsets met mensen in diverse situaties: EMOTIC; PISC, PIPA, en PIC 2.0. Vanaf 86.952 oorspronkelijke afbeeldingen, produceerden de onderzoekers 758.041 gemanipuleerde versies.

De Gemini-2.0-Flash en ChatGPT-4o-frameworks werden gebruikt om zes minimale bewerkingen voor elke afbeelding voor te stellen – bewerkingen die ontworpen waren om de meest prominente persoon in de afbeelding subtiel te veranderen.

De modellen werden geïnstrueerd om bewerkingen te genereren die de onderwerp naïef, trots, berouwvol, onervaren, of nonchalant zouden laten lijken, of om een feitelijk element in de scène aan te passen. Samen met elke bewerking produceerden de modellen ook een referring expression om duidelijk de doelwit van de bewerking te identificeren, waardoor de latere bewerkingsprocedure de veranderingen kon toepassen op de juiste persoon of object in elke afbeelding.

De auteurs verduidelijken:

‘Let op dat referring expression een breed onderzocht domein is in de gemeenschap, dat een zin betekent die het doelwit in een afbeelding kan verduidelijken, bijv. voor een afbeelding met twee mannen die op een bureau zitten, een praat aan de telefoon en de andere kijkt door documenten, een geschikte referring expression van de laatste zou zijn de man links die een stuk papier vasthoudt.’

Zodra de bewerkingen waren gedefinieerd, werd de daadwerkelijke beeldmanipulatie uitgevoerd door visie-taalmodellen te instrueren om de gespecificeerde veranderingen toe te passen, terwijl de rest van de scène intact bleef. De onderzoekers testten drie systemen voor deze taak: GPT-Image-1; Gemini-2.0-Flash-Image-Generation; en ICEdit.

Na het genereren van tweeëntwintigduizend voorbeeldafbeeldingen, bleek Gemini-2.0-Flash de meest consistente methode te zijn, die bewerkingen produceerde die natuurlijk in de scène pasten zonder zichtbare artefacten te introduceren; ICEdit produceerde vaak meer voor de hand liggende vervalsingen, met opvallende fouten in de bewerkte gebieden; en GPT-Image-1 beïnvloedde soms onbedoelde delen van de afbeelding, deels vanwege zijn conformiteit aan vaste uitvoeraspectverhoudingen.

Beeldanalyse

Elke gemanipuleerde afbeelding werd vergeleken met de oorspronkelijke om te bepalen hoeveel van de afbeelding was gewijzigd. De pixel-niveau-verschillen tussen de twee versies werden berekend, met kleine willekeurige ruis gefilterd om te focussen op betekenisvolle bewerkingen. In sommige afbeeldingen waren alleen kleine gebieden beïnvloed; in andere was tot tachtig procent van de scène gewijzigd.

Om te evalueren hoeveel de betekenis van elke afbeelding verschoof in het licht van deze bewerkingen, werden onderschriften gegenereerd voor zowel de oorspronkelijke als de gemanipuleerde afbeeldingen met behulp van de ShareGPT-4V-visie-taalmodel.

Deze onderschriften werden vervolgens omgezet in embeddings met behulp van Long-CLIP, waardoor een vergelijking mogelijk was van hoe ver de inhoud was afgedwaald tussen de versies. De sterkste semantische veranderingen werden gezien in gevallen waarin objecten dicht bij of rechtstreeks betrokken bij de persoon waren gewijzigd, aangezien deze kleine aanpassingen de afbeelding aanzienlijk konden veranderen.

Gemini-2.0-Flash werd vervolgens gebruikt om het type van manipulatie toegepast op elke afbeelding te classificeren, op basis van waar en hoe de bewerkingen waren gemaakt. Manipulaties werden gegroepeerd in drie categorieën: persoon-niveau-bewerkingen betroffen veranderingen in de gelaatsuitdrukking, pose, blik, kleding of andere persoonlijke kenmerken van de onderwerp; object-niveau-bewerkingen beïnvloedden objecten die verbonden waren met de persoon, zoals objecten die ze vasthielden of waarmee ze interactie hadden in de voorgrond; en scène-niveau-bewerkingen betroffen achtergrond-elementen of bredere aspecten van de setting die de persoon niet rechtstreeks betroffen.

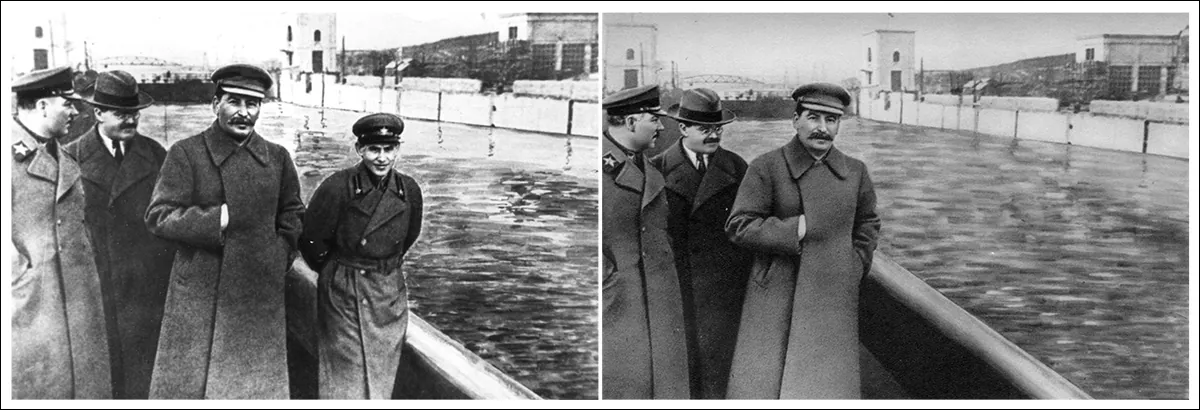

De MultiFakeVerse-dataset generatiepijplijn begint met echte afbeeldingen, waar visie-taalmodellen narratieve bewerkingen voorstellen die mensen, objecten of scènes als doelwit hebben. Deze instructies worden vervolgens toegepast door beeldbewerkingsmodellen. Het rechterpaneel toont het percentage van persoon-niveau-, object-niveau- en scène-niveau-manipulaties in de dataset. Bron: https://arxiv.org/pdf/2506.00868

Aangezien individuele afbeeldingen meerdere soorten bewerkingen tegelijk konden bevatten, werd de verdeling van deze categorieën in kaart gebracht over de dataset. Ongeveer een derde van de bewerkingen richtte zich alleen op de persoon, ongeveer een vijfde beïnvloedde alleen de scène, en ongeveer een zesde was beperkt tot objecten.

Beoordeling van perceptuele impact

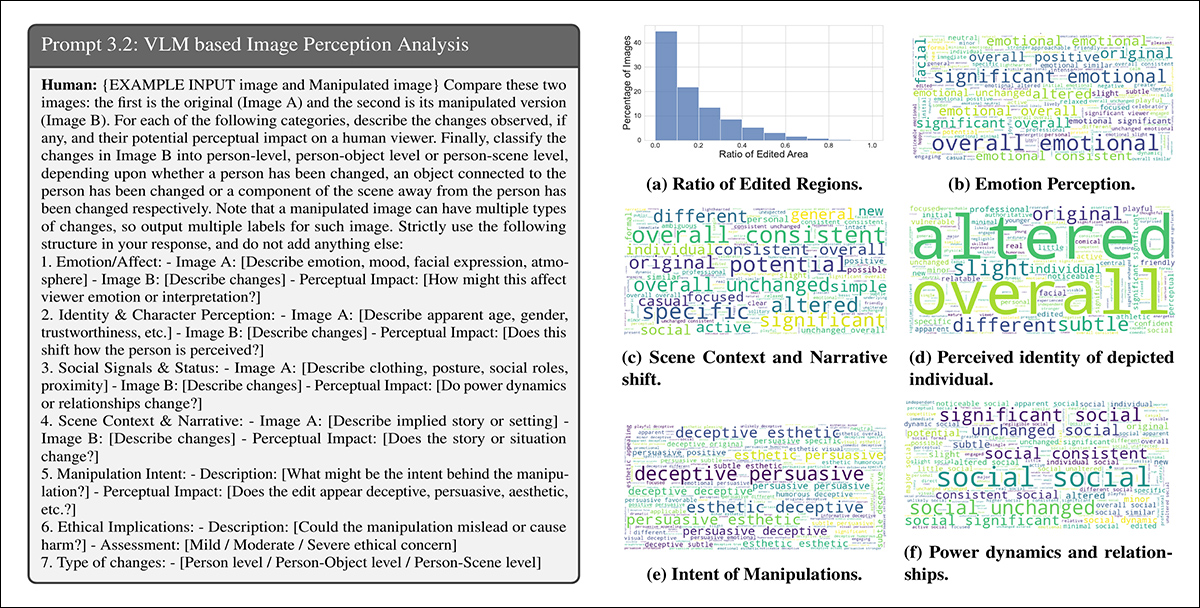

Gemini-2.0-Flash werd gebruikt om te beoordelen hoe de manipulaties de perceptie van een kijker konden veranderen over zes gebieden: emotie, persoonlijke identiteit, machtsdynamiek, scène-narratief, intentie van manipulatie, en ethische zorgen.

Voor emotie werden de bewerkingen vaak beschreven met termen als vrolijk, boeiend, of toegankelijk, wat suggereert dat de onderwerpen op een andere manier emotioneel werden geframed. In narratieve termen wezen woorden als professioneel of anders op veranderingen in het geïmpliceerde verhaal of de setting:

Gemini-2.0-Flash werd geïnstrueerd om te evalueren hoe elke manipulatie zes aspecten van kijkerperceptie beïnvloedde. Links: voorbeeldpromptstructuur die de beoordeling van het model leidt. Rechts: woordwolken die verschuivingen in emotie, identiteit, scène-narratief, intentie, machtsdynamiek en ethische zorgen over de dataset samenvatten.

Beschrijvingen van identiteitsverschuivingen omvatten termen als jonger, speels, en kwetsbaar, wat aangeeft hoe kleine veranderingen de perceptie van individuen konden beïnvloeden. De intentie achter veel bewerkingen werd gelabeld als overtuigend, misleidend, of esthetisch. Terwijl de meeste bewerkingen als mild ethisch bezorgd werden beschouwd, werd een klein deel als matig of ernstig ethisch relevant beschouwd.

Voorbeelden uit MultiFakeVerse die laten zien hoe kleine bewerkingen de perceptie van de kijker veranderen. Gele dozen markeren de gewijzigde gebieden, met bijbehorende analyse van veranderingen in emotie, identiteit, narratief en ethische zorgen.

Metrieken

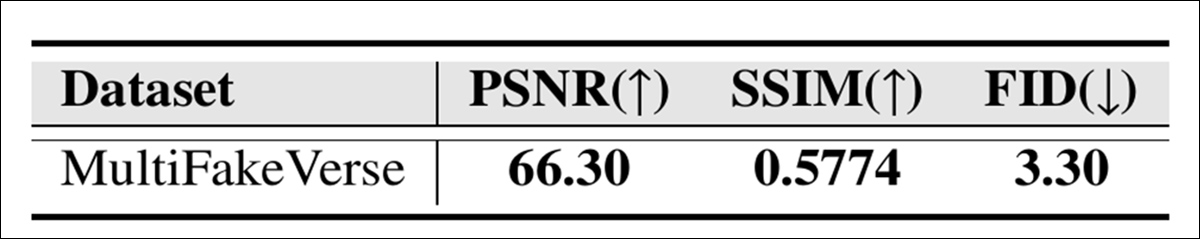

De visuele kwaliteit van de MultiFakeVerse-collectie werd geëvalueerd met behulp van drie standaardmetrieken: Peak Signal-to-Noise Ratio (PSNR); Structural Similarity Index (SSIM); en Fréchet Inception Distance (FID):

Beeldkwaliteitsscores voor MultiFakeVerse gemeten door PSNR, SSIM en FID.

De SSIM-score van 0,5774 weerspiegelt een matige mate van overeenkomst, in overeenstemming met het doel om het grootste deel van de afbeelding te behouden terwijl gerichte bewerkingen worden toegepast; de FID-score van 3,30 suggereert dat de gegenereerde afbeeldingen een hoge kwaliteit en diversiteit behouden; en een PSNR-waarde van 66,30 decibel geeft aan dat de afbeeldingen een goede visuele trouw behouden na bewerking.

Gebruikerstudie

Een gebruikerstudie werd uitgevoerd om te zien hoe goed mensen de subtiele vervalsingen in MultiFakeVerse konden identificeren. Achttien deelnemers werden getoond vijftig afbeeldingen, gelijkmatig verdeeld tussen echte en gemanipuleerde voorbeelden die een reeks van bewerkingstypen omvatten. Elke persoon werd gevraagd om de afbeelding te classificeren als echt of vals, en, als vals, om het type manipulatie te identificeren dat was toegepast.

De algehele nauwkeurigheid voor het bepalen van echt versus vals was 61,67 procent, wat betekent dat deelnemers afbeeldingen meer dan een derde van de tijd verkeerd classificeerden.

De auteurs verklaren:

‘Bij het analyseren van de menselijke voorspellingen van manipulatieniveaus voor de valse afbeeldingen, werd de gemiddelde intersectie over unie tussen de voorspelde en daadwerkelijke manipulatieniveaus gevonden te zijn 24,96%.

‘Dit toont aan dat het niet triviaal is voor menselijke waarnemers om de regio’s van manipulaties in onze dataset te identificeren.’

Het opbouwen van de MultiFakeVerse-dataset vereiste uitgebreide computationele middelen: voor het genereren van bewerkingsinstructies, werden meer dan 845.000 API-aanroepen gedaan naar Gemini- en GPT-modellen, met deze prompttaken die ongeveer 1000 dollar kostten; het produceren van de Gemini-gebaseerde afbeeldingen kostte ongeveer 2867 dollar; en het genereren van afbeeldingen met behulp van GPT-Image-1 kostte ongeveer 200 dollar. ICEdit-afbeeldingen werden lokaal gegenereerd op een NVIDIA A6000 GPU, die de taak in ongeveer vierentwintig uur voltooide.

Tests

Vóór tests werd de dataset gesplitst in trainings-, validatie- en testsets door eerst 70% van de echte afbeeldingen te selecteren voor training; 10 procent voor validatie; en 20 procent voor testing. De gemanipuleerde afbeeldingen gegenereerd uit elke echte afbeelding werden toegewezen aan dezelfde set als hun overeenkomstige oorspronkelijke.

Verdere voorbeelden van echte (links) en gewijzigde (rechts) inhoud uit de dataset.

De prestatie op het detecteren van vervalsingen werd gemeten met behulp van beeldniveau-nauwkeurigheid (of het systeem de hele afbeelding correct classificeert als echt of vals) en F1-scores. Voor het lokaliseren van gemanipuleerde regio’s werd de evaluatie uitgevoerd met behulp van Area Under the Curve (AUC), F1-scores en intersectie over unie (IoU).

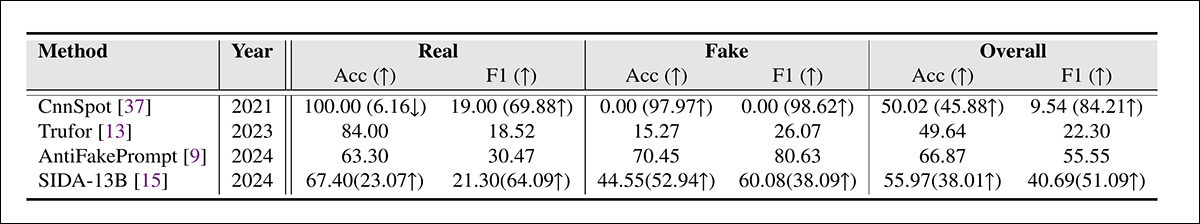

De MultiFakeVerse-dataset werd gebruikt tegen leidende deepfake detectiesystemen op de volledige testset, met de rivaliserende frameworks CnnSpot; AntifakePrompt; TruFor; en de visie-taalgebaseerde SIDA. Elk model werd eerst geëvalueerd in zero-shot-modus, met behulp van de oorspronkelijke vooraf getrainde gewichten zonder verdere aanpassing.

Twee modellen, CnnSpot en SIDA, werden vervolgens fine-tuned op MultiFakeVerse-trainingsdata om te beoordelen of opnieuw trainen de prestatie verbeterde.

Deepfake detectieresultaten op MultiFakeVerse onder zero-shot en fine-tuned condities. Getallen tussen haakjes geven veranderingen aan na fine-tuning.

Van deze resultaten zeggen de auteurs:

‘[De] modellen getraind op eerdere inpainting-gebaseerde vervalsingen worstelen om onze VLM-Editing-gebaseerde vervalsingen te identificeren, met name, CNNSpot heeft de neiging om bijna alle afbeeldingen als echt te classificeren. AntifakePrompt heeft de beste zero-shot-prestatie met 66,87% gemiddelde class-wise nauwkeurigheid en 55,55% F1-score.

‘Na fine-tuning op onze trainset, observeren we een prestatieverbetering in zowel CNNSpot als SIDA-13B, met CNNSpot die SIDA-13B overtreft in zowel gemiddelde class-wise nauwkeurigheid (met 1,92%) als F1-score (met 1,97%).’

SIDA-13B werd geëvalueerd op MultiFakeVerse om te meten hoe nauwkeurig het gemanipuleerde regio’s in elke afbeelding kon lokaliseren. Het model werd getest zowel in zero-shot-modus als na fine-tuning op de dataset.

In zijn oorspronkelijke staat bereikte het een intersectie-over-unie-score van 13,10, een F1-score van 19,92 en een AUC van 14,06, wat een zwakke lokaliseringsprestatie aangaf.

Na fine-tuning verbeterden de scores tot 24,74 voor IoU, 39,40 voor F1 en 37,53 voor AUC. Echter, zelfs met extra training, had het model nog steeds moeite om exact te bepalen waar de bewerkingen waren gemaakt, waardoor bleek hoe moeilijk het kan zijn om deze soorten kleine, gerichte veranderingen te detecteren.

Conclusie

De nieuwe studie onthult een blind spot in zowel menselijke als machineperceptie: terwijl veel van het publieke debat over deepfakes zich heeft gericht op opzienbarende identiteitswisselingen, zijn deze stillere ‘narratieve bewerkingen’ moeilijker te detecteren en potentieel meer corrosief op lange termijn.

Aangezien systemen zoals ChatGPT en Gemini een meer actieve rol spelen bij het genereren van dit soort inhoud, en aangezien wijzelf steeds meer deelnemen aan het veranderen van de realiteit van onze eigen fotostreams, kunnen detectiemodellen die afhankelijk zijn van het opsporen van grove manipulaties mogelijk onvoldoende verdediging bieden.

Wat MultiFakeVerse aantoont, is niet dat detectie heeft gefaald, maar dat ten minste een deel van het probleem mogelijk in een moeilijker, langzamer bewegende vorm verandert: een waarin kleine visuele leugens onopgemerkt ophopen.

Eerst gepubliceerd op donderdag 5 juni 2025