Kunstmatige intelligentie

Betere Machine Learning-prestaties door middel van CNN-gebaseerde afbeeldingsverkleining

Google Research heeft een nieuwe methode voorgesteld om de efficiëntie en nauwkeurigheid van beeldgebaseerde computer vision-trainingsworkflows te verbeteren door de manier te verbeteren waarop de afbeeldingen in een dataset worden verkleind in het voorverwerkingsstadium.

In de paper Learning to Resize Images for Computer Vision Tasks, gebruiken onderzoekers Hossein Talebi en Peyman Milanfar een CNN om een nieuwe hybride beeldverkleiningsarchitectuur te creëren die een opvallende verbetering oplevert in herkenningresultaten die zijn behaald op vier populaire computer vision-datasets.

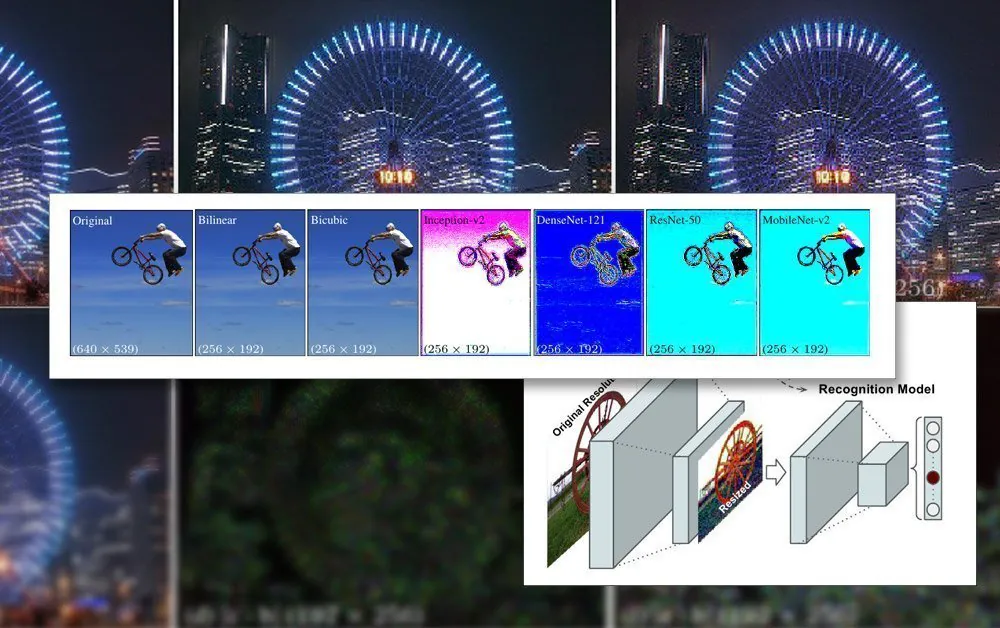

Het voorgestelde gezamenlijke kader voor herkenning en verkleining. Bron: https://arxiv.org/pdf/2103.09950.pdf

Het paper stelt vast dat de huidige rescaling/verkleiningsmethoden die in geautomatiseerde machine learning-pijplijnen worden gebruikt, decennialang verouderd zijn en vaak alleen maar basisbilineaire, bicubische en nearest neighbor verkleining – methoden die alle pixels ondiscrimineerd behandelen.

In tegenstelling tot de voorgestelde methode, verrijkt de beeldgegevens via een CNN en voegt die invoer toe aan de verkleinde afbeeldingen die uiteindelijk door de architectuur van het model zullen gaan.

Afbeeldingsbeperkingen in AI-training

Om een model te trainen dat met afbeeldingen werkt, omvat een machine learning-kader een voorverwerkingsstadium, waarin een uiteenlopende variëteit aan afbeeldingen van verschillende groottes, kleurruimtes en resoluties (die bijdragen aan de trainingsdataset) systematisch worden bijgesneden en verkleind tot consistente dimensies en een stabiele, enkele indeling.

In het algemeen zal dit enige compromis inhouden op basis van het PNG-formaat, waarbij een afweging wordt gemaakt tussen verwerkingstijd/middelen, bestandsgrootte en beeldkwaliteit.

In de meeste gevallen zijn de definitieve dimensies van de verwerkte afbeelding zeer klein. Hieronder zien we een voorbeeld van de 80×80-resolutie-afbeelding waarop sommige van de vroegste deepfakes-datasets werden gegenereerd:

Aangezien gezichten (en andere mogelijke onderwerpen) zelden in het vereiste vierkante verhouding passen, moeten zwarte balken worden toegevoegd (of verspilde ruimte toegestaan) om de afbeeldingen te homogeniseren, waardoor de daadwerkelijk bruikbare beeldgegevens verder worden verkleind:

Hier is het gezicht uit een grotere afbeeldingsgebied gehaald totdat het zo economisch mogelijk is bijgesneden om het hele gezichtsgebied te omvatten. Echter, zoals te zien is aan de rechterkant, zal een groot deel van de resterende gebied niet worden gebruikt tijdens de training, waardoor de belangrijkheid van de beeldkwaliteit van de verkleinde gegevens toeneemt.

Aangezien de GPU-mogelijkheden in recente jaren zijn verbeterd, met de nieuwe generatie NVIDIA-kaarten die zijn uitgerust met toenemende hoeveelheden video-RAM (VRAM), beginnen de gemiddelde bijdragende afbeeldingsgroottes toe te nemen, hoewel 224×224 pixels nog steeds vrij standaard is (bijvoorbeeld, het is de grootte van de ResNet-50-dataset).

Een niet-verkleinde 224×244 pixels afbeelding.

Batchen in VRAM

De reden waarom de afbeeldingen allemaal dezelfde grootte moeten hebben, is dat gradient descent, de methode waarmee het model zich in de loop van de tijd verbetert, uniforme trainingsgegevens vereist.

De reden waarom de afbeeldingen zo klein moeten zijn, is dat ze moeten worden geladen (volledig gedecomprimeerd) in VRAM tijdens de training in kleine batchen, meestal tussen 6-24 afbeeldingen per batch. Te weinig afbeeldingen per batch, en er is niet genoeg groepsmateriaal om goed te generaliseren, evenals het verlengen van de trainingsduur; te veel, en het model kan falen om de noodzakelijke kenmerken en details te verkrijgen (zie hieronder).

Deze ‘live loading’-sectie van de trainingsarchitectuur wordt de latent space genoemd. Dit is waar kenmerken herhaaldelijk uit dezelfde gegevens (d.w.z. dezelfde afbeeldingen) worden geëxtraheerd totdat het model is geconvergeerd naar een toestand waarin het alle algemene kennis heeft die nodig is om transformaties uit te voeren op later, ongezien gegevens van een soortgelijk type.

Dit proces duurt meestal dagen, maar kan zelfs een maand of langer duren van constante en onvermoeibare hoge volume 24/7 cogitatie om bruikbare generalisatie te bereiken. Toenames in VRAM-grootte zijn alleen nuttig tot op zekere hoogte, aangezien zelfs kleine toenames in beeldresolutie een effect van orde van grootte kunnen hebben op de verwerkingssnelheid, en gerelateerde effecten op de nauwkeurigheid die niet altijd gunstig zijn.

Het gebruik van grotere VRAM-capaciteit om hogere batchgroottes te accommoderen, is ook een gemengde zegen, aangezien de grotere trainingsnelheden die hierdoor worden behaald, waarschijnlijk worden gecompenseerd door minder precieze resultaten.

Daarom, aangezien de trainingsarchitectuur zo beperkt is, is alles wat een verbetering kan bewerkstelligen binnen de bestaande beperkingen van de pijplijn een opvallende prestatie.

Hoe superieure verkleining helpt

De uiteindelijke kwaliteit van een afbeelding die zal worden opgenomen in een trainingsdataset is bewezen te hebben een verbeterend effect op het resultaat van de training, met name in objectherkenningstaken. In 2018 stelden onderzoekers van het Max Planck Institute for Intelligent Systems dat de keuze van resamplingmethode een opvallend effect heeft op de trainingsprestaties en resultaten.

Bovendien heeft eerder onderzoek van Google (mede geschreven door de auteurs van het nieuwe paper) aangetoond dat de classificatie nauwkeurigheid kan worden verbeterd door controle te houden over compressie-artefacten in dataset-afbeeldingen.

Het CNN-model dat is ingebouwd in de nieuwe resampler combineert bilineaire verkleining met een ‘skip connection’-functie die output van het getrainde netwerk kan incorporeren in de verkleinde afbeelding.

In tegenstelling tot een typische encoder/decoder-architectuur, kan de nieuwe voorstel niet alleen als een feed-forward-bottleneck fungeren, maar ook als een inverse-bottleneck voor opschaling naar elke doelgrootte en/of aspectverhouding. Bovendien kan de ‘standaard’ resamplingmethode worden vervangen door elke andere geschikte traditionele methode, zoals Lanczos.

Hoogfrequente details

De nieuwe methode produceert afbeeldingen die in feite lijken te ‘bakken’ sleutelfuncties (die uiteindelijk door het trainingsproces zullen worden herkend) rechtstreeks in de bronafbeelding. In esthetische termen zijn de resultaten onconventioneel:

De nieuwe methode toegepast op vier netwerken – Inception V2; DenseNet-121; ResNet-50; en MobileNet-V2. De resultaten van de door Google Research voorgestelde beeldverkleiningsmethode produceren afbeeldingen met duidelijke pixelaggregatie, waarbij de sleutelfuncties worden voorzien die tijdens het trainingsproces zullen worden onderkend.

De onderzoekers merken op dat deze initiële experimenten uitsluitend zijn geoptimaliseerd voor beeldherkenningstaken, en dat in tests hun CNN-gebaseerde ‘leren verkleiner’ in staat was om verbeterde foutpercentages te behalen in dergelijke taken. De onderzoekers zijn van plan om in de toekomst de methode toe te passen op andere soorten beeldgebaseerde computer vision-toepassingen.