Anderson의 관점

더 작은 Deepfakes가 더 큰 위협일 수 있다

대화형 AI 도구인 ChatGPT와 Google Gemini는 이제 얼굴을 교체하지 않는 Deepfakes를 생성하는 데 사용되고 있습니다. 대신, 더 미묘한 방식으로 이미지 내의 전체 이야기를 다시 작성할 수 있습니다. 제스처, 소품, 배경을 변경함으로써 이러한 편집은 AI 감지기와 인간 모두를 속여서 온라인에서 실제 것을 식별하는 위험을 높입니다.

현재 상황, 특히 TAKE IT DOWN 법과 같은 중요한 법안의 채택 이후, 많은 사람들이 Deepfakes와 AI 기반 身分 합성을 비동의 AI 포르노와 정치 조작과 관련시킵니다. 일반적으로, 진실의 거친 왜곡입니다.

이것은 우리를 AI 조작된 이미지들이 항상 고위험 콘텐츠를 대상으로 해야 한다는 생각에 익숙하게 만듭니다. 여기서 렌더링의 품질과 컨텍스트의 조작이 적어도 단기적으로 신뢰성 쿠폰을 달성하는 데 성공할 수 있습니다.

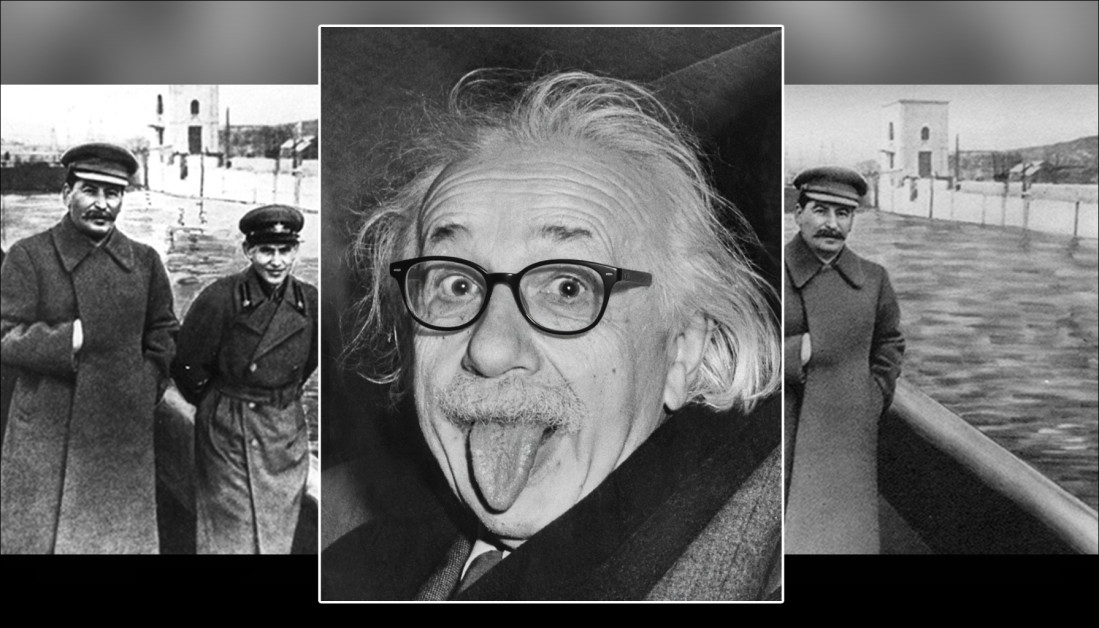

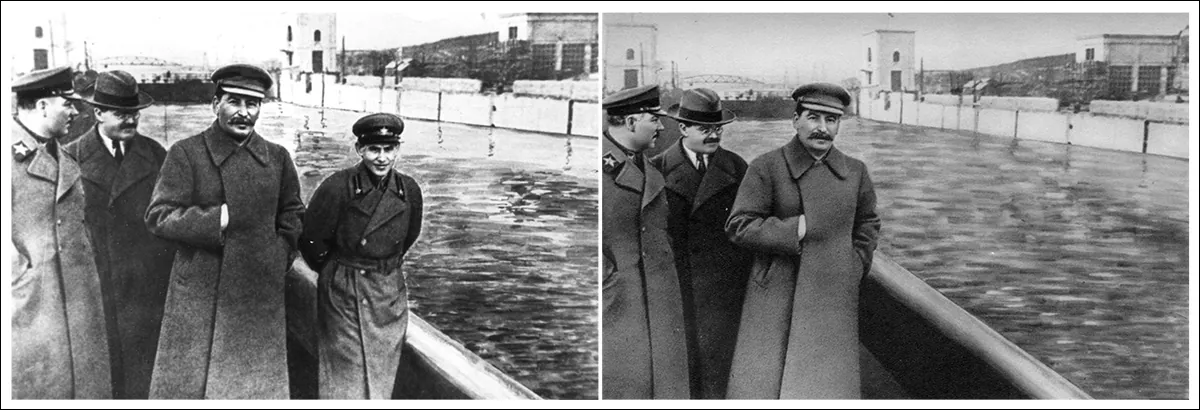

그러나 역사적으로, 훨씬 더 미묘한 변경은 더 음흉하고 지속적인 영향을 미쳤습니다. 예를 들어, 스탈린의 사진トリック은 조지 오웰의 소설 1984에서 풍자된 대로, 스탈린의 비밀 경찰의 전 수장 니콜라이 예조프를 사진 기록에서 제거하는 것을 허용했습니다.

다음 예에서, 두 번째 사진의 문제는 우리가 ‘모르는 것을 모른다’는 것입니다. 즉, 스탈린의 비밀 경찰의 전 수장 니콜라이 예조프가 지금은 안전 장치만 있는 공간을 차지했습니다:

이제 그를 보세요, 이제 그는… 증발했습니다. 스탈린 시대 사진トリック은 역사에서 한 당파 회원을 제거합니다. 출처: 공공 도메인, https://www.rferl.org/a/soviet-airbrushing-the-censors-who-scratched-out-history/29361426.html

이러한 종류의 흐름은 반복되어 문화적으로, 컴퓨터 비전 자체에서 지속됩니다. 컴퓨터 비전은 훈련 데이터셋의 통계적으로 우세한 주제와 모티프에서 추세를 도출합니다. 예를 들어, 스마트폰은 사진의 진입 장벽을 낮추고, 대량으로 사진의 비용을 낮추었기 때문에, 스마트폰의 아이콘이 많은 추상적인 개념과 관련되어 있습니다. 적절하지 않은 경우에도.

전통적인 Deepfaking은 ‘공격’ 행위로 인식될 수 있지만, 오디오-비주얼 미디어의 악의적이고 지속적인 작은 변경은 더 giống ‘가스라이팅’입니다. 또한 이러한 종류의 Deepfaking이 눈에 띄지 않게 하는 능력은 상태-of-the-아트 Deepfake 감지 시스템을 통해 식별하기 어렵게 만듭니다 (이 시스템은 거친 변경을 찾고 있습니다). 이 접근 방식은 바위에 물을 내리는 것보다 더 giống합니다.

MultiFakeVerse

호주 연구자들은 ‘미묘한’ Deepfaking에 대한 문헌의 부족에 주목하여, 사람 중심 이미지 조작을 다루는 새로운 데이터셋을 구축했습니다. 이 데이터셋은 컨텍스트, 감정, 내러티브를 변경하는 것을 목표로 하지만, 주체의 핵심 身分을 변경하지는 않습니다:

새로운 컬렉션에서 샘플링된 실제/가짜 쌍, 일부 변경은 다른 변경보다 더 미묘합니다. 예를 들어, 아래쪽 오른쪽에 있는 아시아 여성이 의사의 청진기(stethoscope)를 제거하여 권위를 잃는 것을 注意하세요.同時, 의사의 패드 대신 클립보드를 대체하는 것은 명백한 의미적 각도가 없습니다. 출처: https://huggingface.co/datasets/parulgupta/MultiFakeVerse_preview

이 컬렉션은 MultiFakeVerse라고 불리며, 845,826개의 이미지로 구성되어 있으며, 비전 언어 모델(VLMs)을 통해 생성되었습니다. 이 이미지는 온라인에서 접근할 수 있으며, 다운로드할 수 있습니다.

저자들은 다음과 같이 말합니다:

‘이 VLM 기반 접근 방식은 합성 또는 저수준 身分 교체 및 지역 특정 편집이 일반적인 기존 데이터셋과 달리, 행동, 장면, 인간-객체 상호 작용을 수정하는 등의 의미적, 컨텍스트 인식 편집을 가능하게 합니다.

‘我们的 실험은 현재 상태-of-the-아트 Deepfake 감지 모델과 인간 관찰자가 이러한 미묘하지만 의미있는 조작을 감지하는 데 어려움을 겪고 있음을 보여줍니다.’

연구자들은 인간과 리딩 Deepfake 감지 시스템을 모두 테스트하여 이러한 미묘한 조작이 얼마나 잘 식별될 수 있는지 확인했습니다. 인간 참가자는 약 62%의 시간에만 이미지를 실제 또는 가짜로 올바르게 분류했으며, 이미지가 변경된 부분을 식별하는 데 더 큰 어려움을 겪었습니다.

기존 Deepfake 감지기는 대부분 더 명백한 얼굴 교체 또는 inpainting 데이터셋에서 훈련되었기 때문에 성능이 좋지 않았으며, 종종 조작이 발생했는지 등록하지 못했습니다. даже MultiFakeVerse에서 fine-tuning을 한 후에도 감지率은 낮았습니다. 이는 현재 시스템이 이러한 미묘한, 내러티브 주도 편집을 처리하는 데 얼마나 부족한지 보여줍니다.

… (Content continues)