인공지능

신경 렌더링: NeRF가 신선한 공기에서 산책하다

Google Research와 하버드 대학의 협력을 통해 Neural Radiance Fields(NeRF)를 사용하여 완전한 장면의 360도 신경 비디오를 생성하는 새로운 방법이 개발되었습니다. 이 새로운 접근법은 NeRF를 테이블탑 모델 또는 내부 시나리오에 국한되지 않고任何 환경에서 캐주얼한 추상적인 사용으로 한 단계 더 가까이 가져옵니다.

본 문서의 끝에서 전체 비디오를 참조하십시오. Source: https://www.youtube.com/watch?v=YStDS2-Ln1s

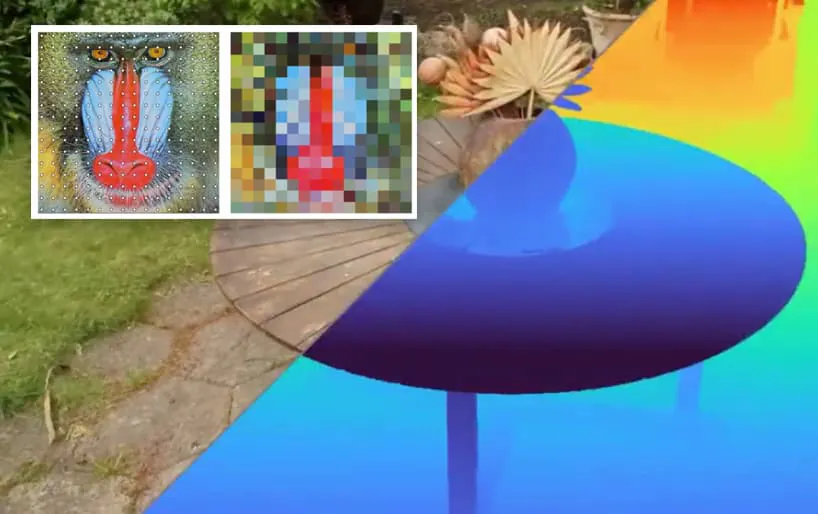

Mip-NeRF 360는 확장된 배경과 ‘무한’ 개체(예: 하늘)와 같은 개체를 처리할 수 있습니다. 이는 이전 버전과 달리 빛의 경로를 해석하는 방식에 제한을 두고 주의의 경계를 설정하여 길고 긴 훈련 시간을 합리화하기 때문입니다. 본 문서의 끝에 첨부된 새로운 비디오에서 더 많은 예시와 프로세스에 대한 자세한 내용을 참조하십시오.

새로운 논문은 Mip-NeRF 360: Unbounded Anti-Aliased Neural Radiance Fields로 제목이 붙여졌으며, Google Research의 Senior Staff Research Scientist인 Jon Barron이 주도했습니다.

이번 발전을 이해하기 위해서는 신경 복사 필드 기반 이미지 합성의 기본적인 작동 방식을 이해해야 합니다.

NeRF란 무엇인가?

NeRF 네트워크를 ‘비디오’로 설명하는 것은 어렵습니다. 이는 사실상 하나의 사진(또는 비디오 프레임)에서 여러 관점을 사용하여 장면을 조립하여 완전히 3D로 구현된 가상 환경입니다. 그러나 이는 기계 학습 알고리즘의 잠재 공간에서만 존재하며, 여기서 원하는 많은 관점과 비디오를 추출할 수 있습니다.

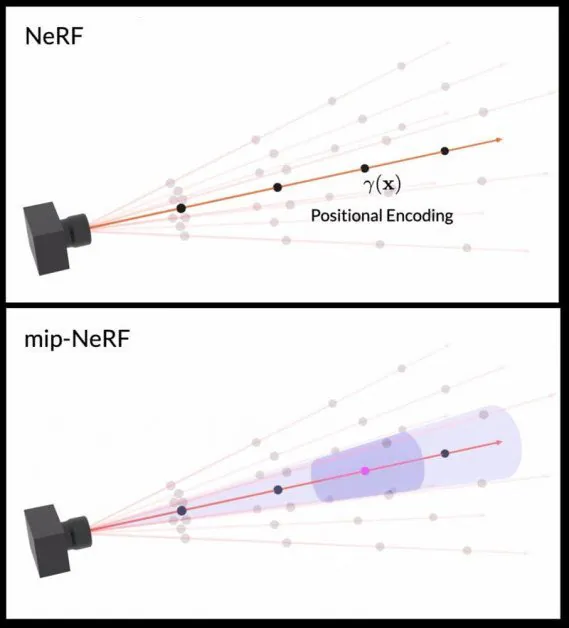

NeRF가 신경 장면을 조립하는 데 사용하는 데이터를 제공하는 여러 카메라 캡처 지점을 나타내는 그림(오른쪽).

기여한 사진에서 파생된 정보는 전통적인 voxel grid와 유사한 행렬로 훈련되며, 3D 공간의 모든 점은 값을 가지므로 장면을 탐색할 수 있습니다.

전통적인 voxel 행렬은 2D 컨텍스트(예: JPEG 파일의 픽셀 그리드)에서 픽셀 정보를 3차원 공간으로 배치합니다. Source: ResearchGate

사진 사이의 중간 공간을 계산한 후(必要에 따라), 각 기여한 사진의 모든 가능한 픽셀의 경로가 효과적으로 ‘레이 트레이싱’되어 색상 값이 할당되며, 투명도 값도 할당됩니다(이 값이 없으면 신경 행렬은 완전히 불투명하거나 완전히 비어있게 됩니다).

voxel grid와 달리, CGI 기반 3D 좌표 공간과 달리, ‘닫힌’ 개체의 ‘내부’는 NeRF 행렬에서 존재하지 않습니다. CGI 드럼 키트를 열고内部을 볼 수 있지만, NeRF의 관점에서 볼 때, 드럼 키트의 존재는 표면의 불투명도 값이 ‘1’이 될 때 끝납니다.

픽셀의 더 넓은 관점

Mip-NeRF 360은 2021년 3월에 발표된 연구의 확장입니다. 이는 NeRF에 효율적인 안티-앨리어싱을 도입했지만, 철저한 초과 샘플링은 필요하지 않습니다.

NeRF는 전통적으로 하나의 픽셀 경로만 계산하므로, 초기 인터넷 이미지 형식과 이전 게임 시스템에서 볼 수 있는 것과 같은 ‘jaggies’를 생성하는 경향이 있습니다. 이러한 계단 현상은 일반적으로 인접한 픽셀을 샘플링하고 평균적인 표현을 찾는 방식으로 해결되었습니다.

전통적인 NeRF는 하나의 픽셀 경로만 샘플링하므로, Mip-NeRF는 광범위한 픽셀에 대한 정보를 제공하여 경제적인 안티-앨리어싱과 더 나은 세부 사항을 생성할 수 있는 원뿔형 캐치먼트 영역을 도입했습니다.

Mip-NeRF에서 사용하는 원뿔형 캐치먼트 영역은 원뿔형 프러스텀으로 나누어지며, 이는 픽셀의 정확도와 앨리어싱을 계산하는 데 사용할 수 있는 불분명한 가우시안 공간을 생성하기 위해 추가로 ‘블러’ 처리됩니다. Source: https://www.youtube.com/watch?v=EpH175PY1A0

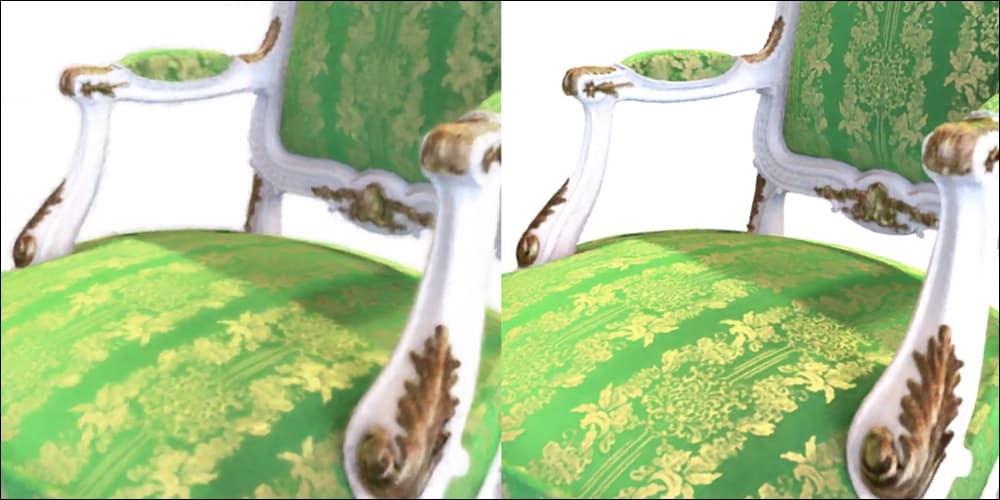

표준 NeRF 구현에 대한 개선은 주목할 만했습니다:

Mip-NeRF(오른쪽), 2021년 3월에 출시되어 더 경제적인 앨리어싱 파이프라인을 통해 더 나은 세부 사항을 제공합니다. Source: https://jonbarron.info/mipnerf/

NeRF 무제한

2021년 3월 논문은 Mip-NeRF를 무제한 환경에서 사용할 때 발생하는 세 가지 문제를 해결하지 못했습니다. 새로운 논문은 Mip-NeRF 가우시안에 칼만 스타일 워프를 적용하여 이를 해결합니다.

둘째, 더 큰 장면은 더 많은 처리 능력과 더 긴 훈련 시간을 필요로 하므로, Mip-NeRF 360은 장면 기하학을 작은 ‘제안’ 다층 퍼셉트론(MLP)로 증류하여 이를 해결합니다. 이는 큰 표준 NeRF MLP가 예측한 기하학을 예측하기 전에 경계를 설정합니다. 이를 통해 훈련 속도를 3배로 증가시킵니다.

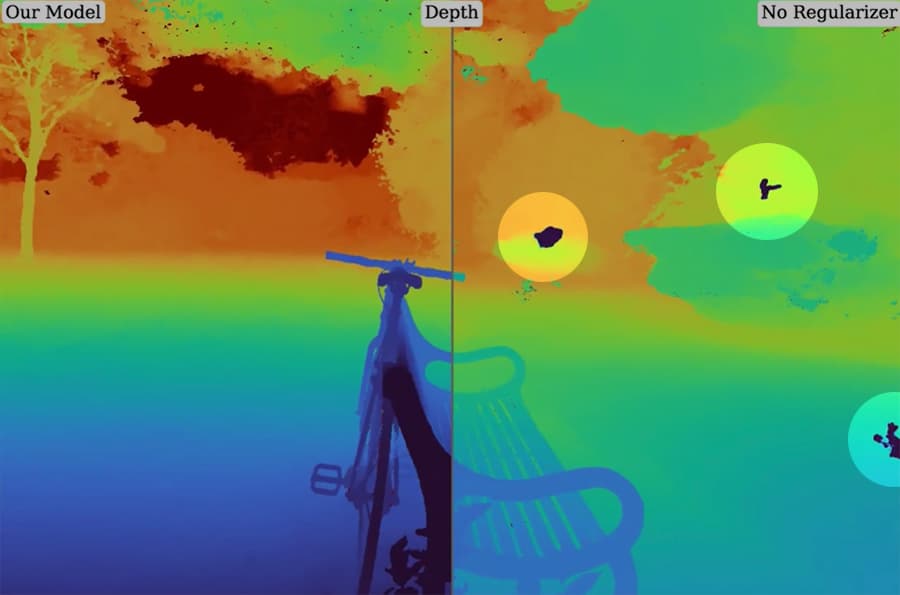

마지막으로, 더 큰 장면은 해석된 기하학의 이산화를 모호하게 만들 수 있으며, 이는 게임에서 볼 수 있는 출력 ‘티어링’과 같은 아티팩트를 생성할 수 있습니다. 새로운 논문은 Mip-NeRF 레이 간격에 대한 새로운 정규화를 생성하여 이를 해결합니다.

오른쪽에는 큰 장면을 경계하기 어려워서 발생하는 Mip-NeRF의 원치 않는 아티팩트가 표시됩니다. 왼쪽에는 새로운 정규화기가 장면을 충분히 최적화하여 이러한 방해를 제거했습니다.

새로운 논문에 대한 자세한 내용은 아래 비디오와 2021년 3월 Mip-NeRF 소개 비디오를 참조하십시오. 또한 NeRF 연구에 대한 자세한 내용은 지금까지의 내용을 확인할 수 있습니다.

원래 2021년 11월 25일에 게시됨

2021년 12월 21일, 12:25 – 죽은 비디오를 교체했습니다. – MA