인공지능

NeRF, CGI 대체에 한 걸음 더 다가서다

MIT와 Google의 연구진이 결국 CGI를 대체할 수 있는 신흥 AI 주도 기술의 가장 근본적인 장애물 중 하나를 해결하는 데 큰 진전을 이루었습니다. 바로 신경 방사장(NeRF) 이미지를 구성 시각 요소로 분리하여 이미지를 재질감 처리하고 재조명할 수 있게 하는 것입니다. NeRFactor라고 불리는 이 새로운 접근법은 캡처한 이미지를 객체별 노멀(여기에 텍스처를 할당할 수 있음), 광원 가시성, 알베도(표면에서 반사되는 입사광의 비율) 및 양방향 반사 분포 함수(BRDF)로 효과적으로 분리합니다. 이러한 요소들이 분리되면, 개별 객체나 객체 그룹의 텍스처를 전환할 수 있을 뿐만 아니라, NeRF 이미지에 대한 입력을 생성하는 다중 카메라 배열로 캡처된 어떤 조명도 배제한 채, 새롭고 독특한 광원과 그림자 구현을 추가할 수 있습니다.

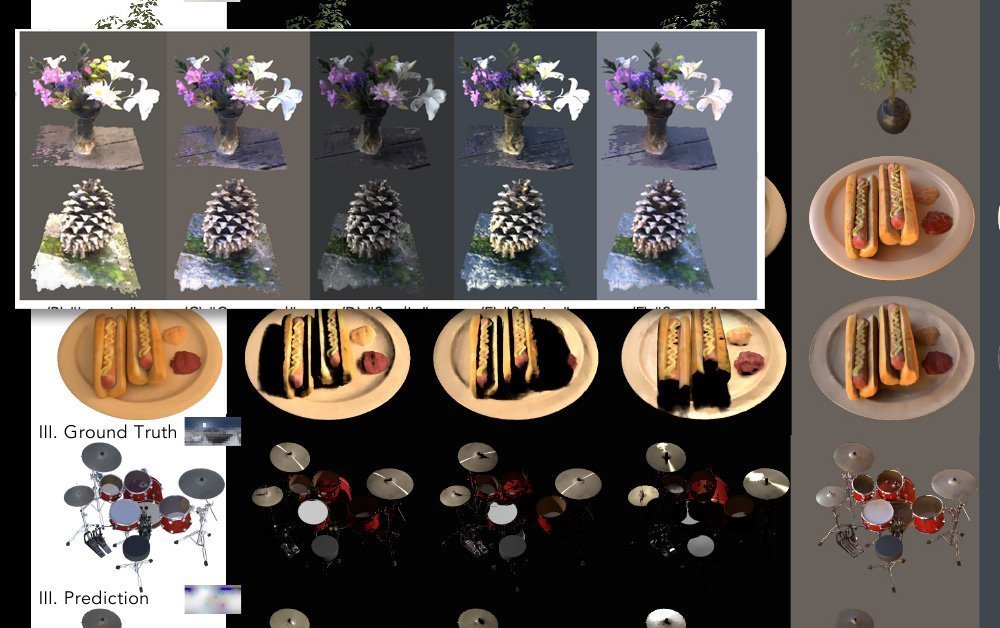

NeRFactor에서 분리된 노멀, 가시성, 알베도 및 BRDF. Source: 이 모델은 사용자 정의 임의 광원에서의 부드러운 또는 강한 그림자를 지원하며, 재구성 손실, 이전 BRDF 계산 데이터, 기본적인 단순 평활화 정규화를 사용하여 캡처된 비디오의 네 가지 측면을 프로그래밍 방식으로 분리합니다.

NeRFactor는 1998년 도입 이후 시각 산업 및 예술 분야에 널리 퍼진 확립된 접근법인 HDR 라이트 프로브를 사용하여 광선의 가능한 경로를 평가하며, 이를 통해 임의 조명이 가능해집니다. 이는 통제 불가능한 수의 매개변수를 생성하기 때문에, 라이트 프로브는 다층 퍼셉트론(MLP)을 통해 필터링되어, 모델 공간에 대한 완전한 조명 볼륨 맵을 계산하려고 시도하지 않고 인지된 기하학을 프로브에 매핑합니다.

반사에 대한 고찰

이 새로운 연구는 아마도 캡처된 이미지에서 반사를 제어하는 레이어를 분리한다는 점에서 가장 의미가 있을 것입니다. 이는 신경 방사장 이미지의 가장 큰 과제 중 하나로 남아 있습니다. 진정으로 새롭고 유연한 NeRF 시스템은 텍스처를 대체할 수 있어야 할 뿐만 아니라, 결정적으로 CGI 워크플로에서 일반적으로 고려되는 일반적인 고정 환경 외에도 움직이는 객체를 반사할 수 있는 방법이 필요하기 때문입니다.  이 문제는 최근 Intel의 컨볼루션 신경망을 통해 비디오 게임 영상을 사실적인 비디오로 변환하는 인상적인 새로운 연구와 관련하여 지적되었습니다. 이러한 워크플로에서는 소스 자료의 많은 ‘베이크드(baked)’ 측면이 개별적이고 교체 가능해야 하며, 이는 반사(모델 범위를 완전히 벗어나는 ‘화면 밖’ 기하학을 활용함)보다는 재조명(NeRF에서 렌더링되는 기하학의 함수임)을 해결하는 것이 논란의 여지가 있지만 더 쉽습니다. 따라서, NeRF 비디오에서 반사를 용이하게 하는 레이어를 분리하는 것은 NeRF가 ‘반사 문제’를 해결하는 데 한 걸음 더 가까워지게 합니다. HDR 환경의 사용은 이미 세계 환경 반사(즉, 하늘, 풍경 및 기타 ‘고정된’ 주변 요소) 생성 문제를 해결하지만, 움직이고 동적인 반사를 도입하려면 새로운 접근법이 필요할 것입니다.

이 문제는 최근 Intel의 컨볼루션 신경망을 통해 비디오 게임 영상을 사실적인 비디오로 변환하는 인상적인 새로운 연구와 관련하여 지적되었습니다. 이러한 워크플로에서는 소스 자료의 많은 ‘베이크드(baked)’ 측면이 개별적이고 교체 가능해야 하며, 이는 반사(모델 범위를 완전히 벗어나는 ‘화면 밖’ 기하학을 활용함)보다는 재조명(NeRF에서 렌더링되는 기하학의 함수임)을 해결하는 것이 논란의 여지가 있지만 더 쉽습니다. 따라서, NeRF 비디오에서 반사를 용이하게 하는 레이어를 분리하는 것은 NeRF가 ‘반사 문제’를 해결하는 데 한 걸음 더 가까워지게 합니다. HDR 환경의 사용은 이미 세계 환경 반사(즉, 하늘, 풍경 및 기타 ‘고정된’ 주변 요소) 생성 문제를 해결하지만, 움직이고 동적인 반사를 도입하려면 새로운 접근법이 필요할 것입니다.

NeRF를 이용한 사진 측량법

신경 방사장 이미지는 여러 각도에서 캡처된 장면이나 객체로부터 완전한 볼류메트릭 공간을 개발하기 위해 머신 러닝 분석을 사용합니다.

‘새로운 CGI’의 맥락에서 본 NeRF

신경 방사장 이미지는 사람, 객체, 장면의 움직이는 이미지를 포함한 현실 세계의 이미지에서 직접 도출됩니다. 대조적으로, CGI 방법론은 세계를 ‘연구’하고 해석하며, 숙련된 작업자가 현실 세계 이미지(즉, 얼굴 및 환경 캡처)를 활용하는 메시, 리그 및 텍스처를 구축해야 합니다. 이는 본질적으로 해석적이고 장인적인 접근 방식으로, 비용이 많이 들고 힘든 작업입니다. 또한, CGI는 인간 형상을 재현하려는 노력에서 ‘불쾌한 골짜기’ 효과와 지속적인 문제를 겪어 왔으며, 이는 단순히 실제 사람들의 비디오나 이미지를 캡처하고 조작하는 NeRF 주도 접근법에는 제약이 되지 않습니다. 더 나아가, NeRF는 필요에 따라 사진에서 직접 전통적인 CGI 스타일의 메시 기하학을 생성할 수 있으며, 사실상 컴퓨터 생성 이미지에서 항상 필요했던 많은 수동 절차를 대체할 수 있습니다.

NeRF의 과제

MIT와 Google의 이 최신 연구는 지난해 NeRF 논문의 엄청난 홍수 속에서 등장했으며, 그 중 많은 논문이 2020년 초기 논문에서 제기된 다양한 과제에 대한 해결책을 제시했습니다. 4월에는 중국 연구 컨소시엄의 혁신으로 NeRF 장면에서 사람을 포함한 측면의 개별 타임라인을 개별적으로 분리하는 방법을 제공했습니다.

이 중국 연구는 최종 사용자가 캡처된 요소를 복사, 붙여넣기 및 크기 조정하여 원본 소스 비디오의 선형 타임라인에서 분리할 수 있게 합니다. Source: 이 접근법은 카메라 배열로 캡처된 모든 각도에서 장면을 재구상할 수 있게 할 뿐만 아니라(일반적인 비디오 캡처에 나타나는 단일 뷰뿐만 아니라), 다용도 합성도 가능하게 합니다. 심지어 동일한 영상에서 각각의 개별 시간 프레임(또는 필요에 따라 거꾸로 실행)으로 실행되는 두 가지 측면을 표현할 수 있는 능력까지도 가능하게 합니다. [caption id="attachment_175426" align="alignnone" width="420"] 이 중국 연구는 최종 사용자가 캡처된 요소를 복사, 붙여넣기 및 크기 조정하여 원본 소스 비디오의 선형 타임라인에서 분리할 수 있게 합니다. Source: NeRF의 가장 큰 과제 중 하나는 장면을 훈련하는 데 필요한 상당한 자원을 줄이는 것이며, 이는 최근 여러 논문에서 다루어졌습니다. 예를 들어, 막스 플랑크 지능형 시스템 연구소는 최근 KiloNeRF를 소개했는데, 이는 렌더링 시간을 1000배까지 단축할 뿐만 아니라 NeRF가 대화형으로 작동할 수 있게 합니다. [caption id="attachment_175870" align="alignnone" width="398"]

이 중국 연구는 최종 사용자가 캡처된 요소를 복사, 붙여넣기 및 크기 조정하여 원본 소스 비디오의 선형 타임라인에서 분리할 수 있게 합니다. Source: NeRF의 가장 큰 과제 중 하나는 장면을 훈련하는 데 필요한 상당한 자원을 줄이는 것이며, 이는 최근 여러 논문에서 다루어졌습니다. 예를 들어, 막스 플랑크 지능형 시스템 연구소는 최근 KiloNeRF를 소개했는데, 이는 렌더링 시간을 1000배까지 단축할 뿐만 아니라 NeRF가 대화형으로 작동할 수 있게 합니다. [caption id="attachment_175870" align="alignnone" width="398"] GTX 1080ti에서 50fps로 대화형 환경을 실행하는 KiloNeRF. Source: https://github.com/creiser/kilonerf

GTX 1080ti에서 50fps로 대화형 환경을 실행하는 KiloNeRF. Source: https://github.com/creiser/kilonerf

그러나, 2021년 연구자와 대중의 상상력을 진정으로 사로잡은 NeRF 속도 혁신은 UC 버클리가 주도한 PlenOctrees 협업으로, 신경 방사장의 실시간 렌더링을 제공합니다: PlenOctrees의 대화형 기능 효과는 라이브 웹 기반 인터페이스에서 재현되었습니다.

Firefox에서 PlenOctrees 객체의 라이브 대화형 이동 (움직임은 이 GIF가 나타내는 것보다 더 부드럽고 역동적임). Source: http://alexyu.net/plenoctrees/demo/

또한, Recursive-NeRF (2021년 5월 칭화대학교 연구진의 논문)는 주문형 고품질 재귀 렌더링을 제공합니다. 사용자에게 보이지 않을 수 있는 부분을 포함한 전체 장면을 렌더링하도록 강제하는 대신, Recursive-NeRF는 JPEG의 손실 압축과 유사한 것을 제공하며, 주문형 추가 이미지를 처리하기 위해 개별 하위 NeRF를 생성할 수 있어 계산 자원을 엄청나게 절약합니다.

Recursive-NeRF로 불필요한 렌더 계산을 버리면서 디테일 유지. 고해상도를 보려면 이미지를 클릭하세요. Source: https://arxiv.org/pdf/2105.09103.pdf

다른 접근법으로는 200fps에서 고품질 신경 렌더링을 달성한다고 주장하는 FastNeRF가 있습니다. 많은 NeRF 최적화 기술이 탐색을 제한하지만 상호작용성을 크게 향상시키는, 렌더링하고자 하는 측면을 확정하고 다른 측면을 버리는 방식으로 장면을 ‘베이킹(baking)’하는 것을 포함한다는 점이 지적되었습니다. 이 방식의 단점은 GPU에서 저장 장치로 부담이 이동한다는 것입니다. 베이크된 장면은 지나치게 많은 디스크 공간을 차지하기 때문입니다. 이는 어느 정도 베이크된 데이터를 다운샘플링하여 완화할 수 있지만, 이 또한 탐색이나 상호작용의 길을 차단한다는 측면에서 일종의 확정을 수반합니다. 모션 캡처와 리깅에 관해서는, 5월에 공개된 저장대학교와 코넬대학교의 새로운 접근법이 입력 비디오에서 해석된 블렌드 가중치 필드와 골격 구조를 사용하여 애니메이션 가능한 인간을 재현하는 방법을 제공했습니다:  Animatable NeRF에서 파생된 골격 구조. Source:

Animatable NeRF에서 파생된 골격 구조. Source:

NeRF는 언제 ‘쥬라기 공원’ 순간을 맞이할까?

신경 방사장을 통한 이미지 합성의 빠른 발전 속도