인공지능

Mistral AI: Llama2를 넘어서 오픈소스 공간에서 새로운 벤치마크 설정

최근에 대형 언어 모델(LLM)이 주목을 받고 있습니다. ChatGPT와 같은 모델의 성과로 인해 Meta의 Llama 모델이 오픈소스 LLM에 대한 관심을 재점화했습니다. 목표는 GPT-4와 같은 상위 모델과 같은 성능을 가진 오픈소스 LLM을 만들면서도 비용과 복잡성을 줄이는 것입니다. 이러한 접근성과 효율성의 결합은 연구자와 개발자에게 새로운 기회를 열어주었으며 자연어 처리 기술의 발전에 새로운 시대를 열었습니다. 최근에 생성적 AI 스타트업은 자금을 모금하고 있습니다. Together는 2,000만 달러를 모금하여 오픈소스 생성적 AI 모델을 구축하고 있습니다. Anthropic도 4.5억 달러를 모금했으며, Cohere는 Google Cloud와 파트너십을 맺고 2.7억 달러를 모금했습니다.

Mistral 7B: 크기 및 가용성 소개

성능 벤치마크

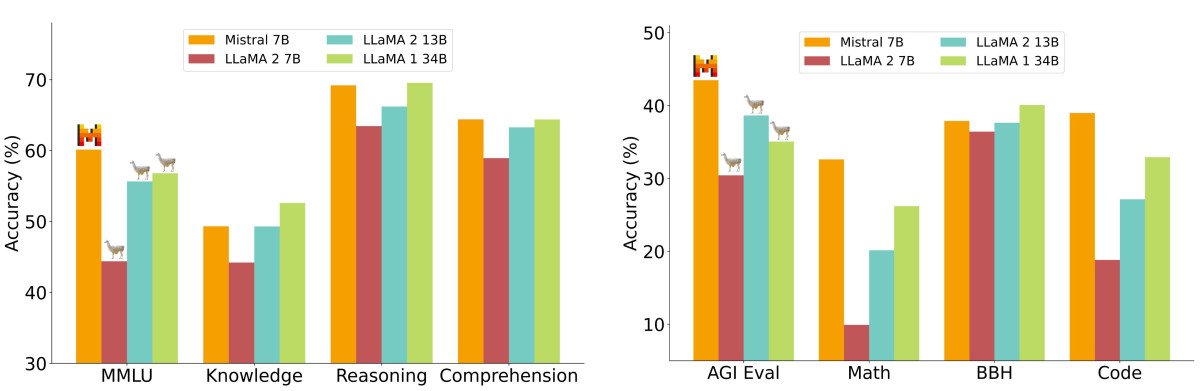

Mistral 7B의 성능 분석 결과, Llama 2 모델家族과 비교했을 때 모든 벤치마크에서 Mistral 7B가 훨씬 더 나은 성능을 보여주었습니다. 실제로, Mistral 7B는 Llama 34B의 성능과 일치하며 특히 코드와 推론 벤치마크에서 두드러졌습니다.

무엇이 Mistral 7B 모델을 다른 언어 모델보다 더 나은 것으로 만드는가?

주의 메커니즘의 단순화 주의 메커니즘의 세부 사항은 기술적이지만 기본적인 아이디어는 상대적으로 간단합니다. 책을 읽고 중요한 문장을 강조하는 것을 상상해 보세요. 이것은 주의 메커니즘이 “강조” 또는 입력 데이터의 특정 지점에 중요성을 부여하는 방식과 유사합니다. 언어 모델의 contexto에서 이러한 메커니즘은 모델이 가장 관련이 높은 입력 데이터의 부분에 집중할 수 있도록 하여 출력이 일관성 있고 contextoually 정확하도록 합니다. 표준 트랜스포머에서 주의 점수는 다음 공식으로 계산됩니다.

이 공식에는 Q와 K의 행렬 곱셈과 같은 중요한 단계가 포함됩니다. 이 단계는 시퀀스 길이가 증가함에 따라 계산 비용이 증가하는 주요 이유 중 하나입니다. 이는 표준 트랜스포머가 특히 긴 시퀀스를 처리할 때 느려지는 주요 이유 중 하나입니다.

그룹 쿼리 주의 (GQA)

GQA는 중간 지점의 해결책입니다. 하나 또는 여러 ‘키-값’ 헤드를 사용하는 대신, GQA는 헤드를 그룹화합니다. 이렇게 하면 GQA는 다중 헤드 주의와 유사한 성능을 제공하면서 MQA의 속도를 달성할 수 있습니다. Mistral과 같은 모델에서는 이는 품질을 너무 많이 희생하지 않으면서 효율적인 성능을 의미합니다.

슬라이딩 윈도우 주의 (SWA)

Mistral AI의 투명성 vs. 분산의 안전성 우려

Mistral AI는 또한 투명성에 대해 강조하며 “트릭이나 독점 데이터가 없습니다”라고 말했습니다. 그러나 현재 사용 가능한 모델인 ‘Mistral-7B-v0.1’은 사전 훈련된 기본 모델이므로 모더레이션이 없이 어떤 질의에도 응답할 수 있습니다. 이것은 잠재적인 안전성 우려를 야기합니다. GPT와 Llama와 같은 모델은 언제 응답해야 하는지 판단하는 메커니즘을 가지고 있지만, Mistral의 완전한 분산 특성은 악의적인 사용자에 의해 악용될 수 있습니다. 그러나 대형 언어 모델의 분산에는 장점도 있습니다. 일부 사람들은 이를 악용할 수 있지만, 사람들은 이를 사회적 благ을 위해 그리고 모든 사람에게 지능을 접근할 수 있도록 활용할 수 있습니다.

배포 유연성

주목할 점은 bahwa Mistral 7B는 Apache 2.0 라이선스하에 제공된다는 것입니다. 이는 이를 사용하는 데 실제 장벽이 없다는 것을 의미합니다. 개인적 용도, 큰 기업, 또는 정부 기관에서 사용하더라도, 시스템을 실행하거나 클라우드 리소스에 투자할 수 있습니다. MIT 라이선스나 CC BY-SA-4.0 라이선스와 같은 다른 라이선스가 있지만, Apache 2.0 라이선스는 대규모 프로젝트에 강력한基础을 제공합니다.

최종 생각

오픈소스 대형 언어 모델의 부상, 특히 Mistral 7B는 AI 산업에서 중요한 전환점을 나타냅니다. 이는 높은 품질의 언어 모델을 더广い 관객에게 접근할 수 있도록 합니다. Mistral AI의 혁신적인 접근 방식, 즉 그룹 쿼리 주의와 슬라이딩 윈도우 주의는 품질을 희생하지 않으면서 효율적인 성능을 약속합니다. Mistral의 분산 특성은 특정挑戰을 제기하지만, 유연성과 오픈소스 라이선스는 AI의 민주화를 위한 잠재력을 강조합니다. 미래에는 Mistral이 7B 모델을 시작으로 더 큰 모델을 출시할 계획입니다. 이러한 새로운 모델이 7B의 성능과 일치한다면, Mistral은 산업에서 빠르게 주요 플레이어로 부상할 수 있습니다.