Anderson의 관점

AI, 뉴스를 감지할 수 있는가?

AI는 뉴스 기사를 작성하는 데越来越 능숙해지고 있지만 뉴스를 식별하는 데는 아직 많이 부족하다.

의견 5년 전 AI가 뜨거운 뉴스 스토리를 찾는 능력에 대해 마지막으로 살펴본 이후, 풍경은 상당히 변경되어 AI 주도 자동화 수준이 증가하고, 필연적으로 성장하는 고통과 논쟁이 뒤따랐다.

최근에 WSJ 보고서는 다작인 AI 지원 Fortune 기고가에게 미래의 기자를 소개했는데, 그들은 프레스 릴리스의 번역과 같은 하찮은 작업에서 해방되어 대형 출판물만이 예산을 갖고 하는 기능과 특징을 작성하고 조사하는 데 여유를 갖게 된다.

하지만 우리가 훨씬 덜 자주 듣는 것은 AI가 뉴스 스토리를 식별하는 능력이다.

소음 감소

2021년의 기사에서 나는 연구 분야를 다루는 작가们에 초점을 맞췄는데, 그 이유는 내가 대부분의 시간을 그 분야에서 보내기 때문이다. 그리고 새로운 AI 혁명이 그 분야에 미친 가장 큰 영향은 AI 구동 연구 논문 제출의 제어할 수 없는 폭풍을 만들어 냈는데, 그 결과 신호 대 소음 비율이 매우 높아져서 단일 개인의 노력으로도 Arxiv AI 관련 도메인을 포괄적으로 다루는 것이 불가능해졌다.

확실히 이것은 AI가 탁월한 분야이다. 즉, 인간이 해결할 수 없는 방대한 양의 데이터를 반복적으로 처리하여 몇 초 안에 사람들에게는 몇 일, 아니면 몇 일이 걸릴 수 있는 ‘이상치’를 찾는 것이다.

그러면 왜 AI는 여전히 수천, 아니 수만 개의 일일 경쟁자 중에서 뜨거운 뉴스 스토리를 식별하는 데 इतन 나쁠까?

과거 지향적 AI

이러한 방대한 양의 AI 생성 콘텐츠는 학술 분야를 훨씬 넘어서서 발생하고 있다. 지난해 말에는 웹上的 모든 새로운 글 중 절반이 이미 AI에 의해 작성되고 있으며, 이 추세는 더욱 가속화될 것으로 추정된다. 따라서 소음은 어디서나 엄청난데, 학술 분야만이 아니라 모든 곳에서 그렇다.

과거 몇 년 동안 ‘뜨거운’ 스토리를 식별하는 AI/알고리즘 식별 시스템에 일부進步가 있었지만, 이러한 시스템은 계층화된 및 예측 가능한 데이터 피드를 집중적으로 처리하므로 다소 취약한 컨텍스트에서만 작동할 수 있다.

이 점에서 스탠퍼드 대학교의 박사 후 연구원이자 전 뉴욕 타임즈 기자 Alexander Spangher는 기계 학습 프로세스와 통계 분석에 적용할 수 있는 ‘뉴스 가치’를 정의하기 위해 여러 시도를 해왔으며, 법원 서류, 주 법안, 시의회 회의 등 공개 문서와 같은 корп에서 자동화된 리드 생성에 대한 증거를 생성했다. 이러한 스키마 주도 출력은 Fortune의 다작인 AI 구동 기자가 하루에 6~7개의 뉴스 기사를 작성할 수 있다:

공개 문서 корп에서 얻은 단어 분포의 ‘열기’. 이 경우 ‘권한 부여’가 높은 점수를 가지고 있음을 볼 수 있는데, 이는 결정, 변화, 그리고 새로운 것이 나타날 수 있기 때문이다. 출처

그러나 Spangher가 이끄는 2023년 제안과 같은 접근 방식의 문제는 bahwa 그것들이 전형적인 AI 방식으로 데이터의 관찰된 경향을 중심으로 한다. 즉, 이전에 좋은 뉴스가 된 것을 관찰하고, 더 많은 것을 찾는다.

실제 세계에서는 예상치 못한 출처가 거의 항상 ‘원 히트 원더’로 나타나고, 그들이 처음으로 유용한 것을 생산한 이후에, 일시적인 명성이나 악명을 얻은 후에도, 다시는 유용한 것을 생산하지 않는다.

시대 징조

따라서 이러한 종류의 ‘원 앤 던’ 뉴스 소스를 모니터링하는 것은 일반적으로 소음에 더 많은 것을 추가할 뿐이므로, AI는 대신 뉴스가 될 소스의 징조를 식별할 수 없을까? 만약 누군가 어떤 종류의 소스가 언젠가 유용한 것을 생산할 수 있는지 알 수 있다면, 그들은 그들의 특성에 초점을 맞추고, 컨텍스트나 방법에 대한 관심을 가지지 않을 수 있다.

이 논리에서, 에드워드 스노든의 2010년대 폭로에서 알 수 있듯이, 최근 CIA(또는 유사한 조직)를 떠난 사람은 미래의 소식의 잠재적 소스로 따라야 한다.

그러나 이러한 종류의 지속적인 모니터링을 자동화할 수 있는 RSS 피드나 API는 없을 것이다. 이유는 LinkedIn과 다른 많은 이전에 공개된 데이터 소스가 후퇴하고 있기 때문이다. 또한 빈번한 문제가 발생한다. 이유는 API나 사이트를 5초마다 폴링할 수 없기 때문이다. 자원 비용 외에도 플랫폼의 IP 차단 응답으로 인해 이러한 활동은 지속 불가능하다.

さらに, 이러한 공개에는 자동화하기 어려운 ‘인간적 차원’이 있다.

개인적인 터치로 뉴스 수집: 1976년 앨런 파쿨라 영화 ‘올 더 프레지던트 맨’의 디스크 릴리스에서 정보원이 그림자에서 나오는 장면. 출처

또한 실제 세계에서는 미래 뉴스 소스의 정의 특성을 식별하기가非常 어렵다. 그것은 ‘최근에 CIA를 떠난 사람’이 아니며, 그것은 프로토콜에 의해 정의되지 않는다. X 또는 GitHub와 같은 플랫폼은 스스로도 너무 많은 신호를 출력하며, 검색 용어 또는 게시물 범주를 좁히는 것은 거의 차이를 만들지 않는다. 실제로 문제에 관여하고, 커뮤니티(또는 저장소 등)에 참여하고 있는 경우에만 개발의 중요성을真正로 인식할 수 있다.

甚至 ‘보안 경보’와 같은 용어는 사건의真正한 심각성 또는 뉴스 가치를 상황화할 수 없다. 이유는 이러한 종류의 참조가 일일이 수천 번씩 이러한 커뮤니티에서 던져지기 때문이다. 그러나 그것은 광범위한 뉴스 가치를 갖지 않는다. 또한 이러한 종류의 모니터링을 영어로만 제한하더라도, 은유적 언어의 사용과 함께 관용구의 변형으로 인해 실제 ‘야생’ 게시물에서真正한 뉴스 경보를 구문 분석하기가 매우 어려울 것이다.

좁은 길

현재의 AI 구동 뉴스 가치 감지 시스템은 정식화된 데이터 구조(예: API에서 JSON 출력)에 의존하거나, AI 개발 알고리즘이 구조화된 스키마(예: 특정 조직의 프레스 릴리스)로 구문 분석할 수 있는 비정식 데이터 구조에 의존한다:

구문 분석된 RSS/XML 피드, 엄격한 데이터 컨테이너 계층 구조를 보여줌. 출처

이러한 접근 방식은 프로그램 출력(예: WSJ 기자에게서 언급한 바와 같이 날씨, 주식, 스포츠 점수 보고, 시정촌 및 정부 기관의 루틴 프레스 릴리스)에 적합하다.

그러나 통계 피드(예: 날씨, 주식, 스포츠)에서 ‘인간 경보’ 트리거를 첨부하는 것은 가능하지만, 인간의 주의가 여전히 필요하다. 이유는 정리된 정부 릴리스의 뉴스 가치를 평가하기 위해 인간의 주의가 필요하기 때문이다.

‘죽음’, ‘예상치 못한 질병’, ‘누출’, ‘사고’와 같은 용어는 모두 새로운 사건을 식별하는 데 도움이 될 수 있지만, 그것들은 오직 ‘루틴’ 사건만을 다룬다. 또한 대체 언어(또는 언어)를 설명할 수 없다.

엘리트 작가의 귀환?

최근 몇 년 동안 데이터 주도 저널리즘은 뉴스报道에서 승승장구하는 플랫폼이 되었다. 편집부는 더 이상 주요 출판사에서 특별 보고서 및 백서의 사전 공개를 허용하는 특혜 계약에 제한되지 않는다. 대신, 편집부는 직접 숫자를 분석할 수 있다.

그러나 이것은 무료 점심이 아니다. 이러한 공공 데이터를 이 방식으로 파싱하는 AI의 가치가 명백히 증가함에 따라, 수요에 대한 반응 또는 수요를 예측한 대응으로 대금 지불/AI 차단 반응이 뒤따랐다. 이는 주요 AI 플레이어를 잠재적인 전술로 몰고 간다.

신규 제한의 추가 마찰은 시민 기자로부터 전통 미디어 또는 적어도 데이터를 수집하고, 정제하고, 평가하는 데 필요한 추가 수동 작업을 흡수할 수 있는 자금이 있는 뉴스 기관으로 권력을 일부 회복시킨다. 따라서 AI의 실제 구현은 저널리즘에서 시장과 주요 플레이어가 AI 기반 혁신과 채택에 반응한 방식에 따라 실제로 시간을 되돌릴 수 있다. 즉, 뉴스 생산 수단을 비민주화하고, 의미 있는 데이터 주도 뉴스 가치 평가 시스템에 장애물을 더하는 것이다.

공통본능

이러한 제한은 우리를 ‘직감’으로 돌아가게 한다. 즉, 뉴스 가치 평가의 필수 구성 요소이다.

자연스럽게 이것은 이 분야에서 전문적으로 참여하는 사람들에게 안심할 수 있지만, 자만심은 실수이다. 이유는 이 직감이 어느 정도 일반화되어 특정 개인 또는 조직의 강박이나 취미에 의존하지 않고 운영될 수 있기 때문이다. 2022년 연구에서 노스웨스턴 대학교의 연구자들은 잠재적으로 뉴스 가치가 있는 이야기들의 크라우드소싱 평가를 사용하여 예측 모델을 훈련시켰다. 특히 새로 게시된 Arxiv 연구 논문의 뉴스 가치에 관한 것이다:

훈련 데이터를 얻기 위해 연구 참가자에게 제공된 설문 조사 질문. 출처

시스템은 후보자를相当히 잘 평가하며, 상위 10위 중 약 80%가 전문가에 의해 뉴스 가치가 있는 것으로 판단된다. 그러나 전문가와의 일치는 중간 정도였으며, 결과는 프레임워크 또는 청중 적합성과 같은 요인을 놓쳤다.

시스템은 2020년 논문에 제시된 원칙에 기반한다. 저널리즘의 편집적 지향 알고리즘을 위한 설계 고려 사항에 관한 계산 뉴스 발견. 대부분의 유사한 프로젝트와 마찬가지로 이 작업은 과학 저널리즘보다는 추상적인 뉴스 수집에 접근한다. 이유는 과학 문헌이 훈련 가능하고 해석 가능한 데이터 포인트로 파싱될 수 있는 템플릿화된 출력으로 향하는 경향이 있기 때문이다.

그러나, 내가 2021년에 관찰했듯이, 이것은 연구 과학자들이 연구 논문 제출의 규칙을 남용하여 인상적인 결과를 숨기거나 낮추거나, 아니면 완전히 실패했다는 사실로 인해 경우가 아니다.

さらに, AI 시스템이 과학 논문中的 그림과 표를 해석하는 데 매우 어려움을 겪는다는 점은 최근에 이 분야의 활발한 연구가 되었습니다:

과학적 그림 감지 벤치마크 ‘SciFigDetect’ 논문에서 실제 과학적 그림, 생성 프롬프트, Nano Banana와 GPT에 의해 생성된 합성 대응물. 출처

그것은 종종 그래프 또는 표에 결과가 포함되어 있지만, 본문의 주요 부분에서는 선택적 편향으로 보고하거나, 아니면 결과의 부정적인 결과를 완전히 무시한다는 것이다. 따라서 이 장애물은 AI 주도 과학 저널리즘에서 사소한 문제가 아니다.

さらに, 논문이 유도적이거나, 아니면 상태에 대한 미미한 발전(如果有的话)인 경우, 이것은 거의 불투명한 인용(즉, 용어를 검색하고, 읽을 수 있는 PDF 복사본을 찾고, 이전 예술의 범위를 이해하기 전에 새로운 작업의 원본성 또는 새로운 점을 이해하기 전에)으로 埋葬된다.

다시 혼자, 자연스럽게

위에서 설명한 크라우드소싱 방법은 잠재적인 뉴스 이야기와 전문가의 평가 사이에서 가능한 동의를 제안한다. 그러나 컨텍스트 없이, 뉴스 가치의 가장 широк은笔劃만 나타날 수 있다.

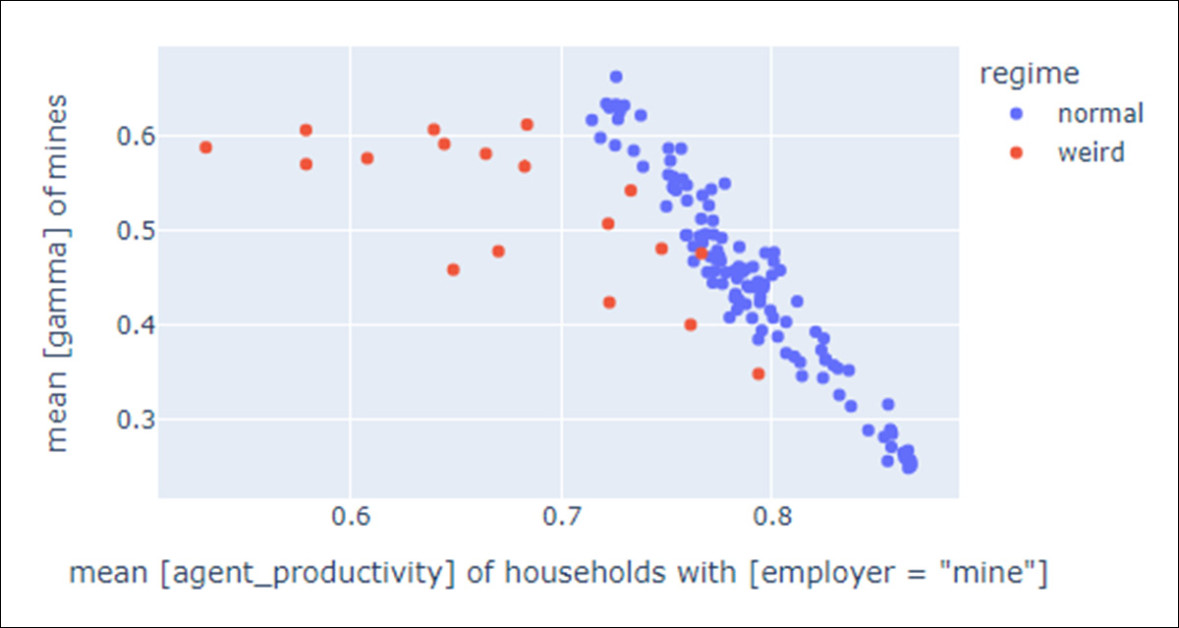

AI의 힘은 구성에 따라 데이터セット中的 ‘이상치’를 분리하는 능력에 있다. 즉, 데이터 트렌드의 예외적인 경우를 버리거나(의미 있는 예외가 아닌 경우), 또는 뉴스 수집을 위해 유용한 및 가치 있는 비공통적인 경우와 발생을 식별하는 데 사용된다:

산점도中的 이상치(빨간색). 출처

거의 모든 히트 뉴스 스토리는 이상치이다. 도메인이 활발하고 변동성이 높은 경우(예: 진행중인 전쟁), 그 도메인은 높은 확률로 뉴스 가치가 있는 스토리가 나타날 수 있지만, 공통의 관심이 해당 도메인에 집중될 가능성이 있으므로 대규모 경쟁이 발생한다.

许多 新闻 가치 있는 과학적 리드는 언어 분포의 중심이 아니다. 그것들은 방법의 희귀한 조합, 놀라운 부정적인 결과 또는 이상한 복제이다. 모델의 능력이 이러한 저빈도 그룹에서 불균형하게 저하되는 경우, 편집자의 ‘코’가 예민해야 하는 영역이 모델이 가장 신뢰할 수 없는 영역이 된다.

신뢰 문제

기자들은 여러 제약 조건(시간, 접근, 신뢰성, 청중, 조직 우선순위)을 균형있게 처리한다. 이는 명백하지 않은 선택을 이끌어낸다. 2022년 문헌 검토에서 덴마크의 연구자들은 기자들을 여러 가지 문제(예: 소스가 의제 또는 잘못된 정보를 가질 수 있음)를 균형있게 처리하는 것으로 특징지었다. 또한 압력하에서 간접적인 신뢰 신호를 사용하여 직접 확인을 건너뛸 수 있다.

이러한 ‘신뢰 문제’는 qualquer 명확한 AI 주도 뉴스 가치 식별 시스템 개발에서 발전 장애물이 될 것이다. 이유는 이러한 플랫폼과 상호 작용에는 사용자가 알고리즘적으로 삭제된 기사가真正로 작성자의 시간에値하지 않은 것을 신뢰해야 하기 때문이다.

광범위한 베타 테스트와 재훈련 또는 세부 튜닝은 인간의 감독이 남아 있는 경우에만 이러한 접근 방식의 신뢰성을 향상시킬 수 있다. 그러나 국가 또는 세계 문화의 변화(예: 정치 풍경의 놀라운 변화 또는 전쟁의 발발)는 이러한 妥協 시스템의 모든 기본 우선순위를必ず 뒤집을 것이며, AI에 의존하는 작가는 거의 처음부터 자신의 필요한 ‘내부 도메인 모델’을 재구성해야 할 것이다.

最初에 2026년 4월 20일 게시됨