Anderson의 관점

심지어 기본 AI도 이제 인간과 구별할 수 없는 뉴스를 작성할 수 있다

새로운 연구에 따르면 작은 지역 AI 모델도 사람들이 실제 저널리즘과 구별할 수 없는 뉴스를 작성할 수 있으며, 최고의 시스템과 일치하며, 독자들이 누가 무엇을 작성했는지 구별할 수 없다.

독일과 프랑스의 새로운 연구 협력을 통해 인간은 AI 또는 인간에 의해 작성된 뉴스 기사를 구별할 수 없다는 것을 알 수 있다. 즉, 오픈 소스 모델이 상대적으로 평균적인 소비자 수준의 데스크톱 컴퓨터에서 다운로드되고 실행될 수 있는 경우에도 vậy이다.

또한 작은 AI가 상승세에 있는 또 다른 지표로, 1,054명의 참가자로부터 2,318개의 판단을 수집한 专用 학술 연구 포털의 조사에 따르면 인간 독자는 상대적으로 MODEST한 모델에서 출력되는 기사의 출처를 확률적으로 식별할 수 없었다. 이러한 모델에는 Mistral과 Gemma의 변형이 포함되며, 이들은 7억 개의 매개변수를 가지고 있다.

테스트된 LLM의 평균 출처 및 진위성 점수. GPT-4o의 200억 매개변수는 작은 모델의 7억 매개변수를 크게 초과하지 않는다. 이 연구에서 테스트된 모델은 Gemma 7B, Phi-3 Mini, LLaMA-2 13B, Mistral 7B, GPT-4o, 및 GPT-3.5였다. 출처

저자들은 2024년 발표에서 처음 조사한 주제로 돌아왔다. 축복이거나 저주인가? 생성형 AI가 가짜 뉴스에 미치는 영향에 대한 조사. 이러한 발견은 1월에 처음 발표된 더 큰 프로젝트의 새로 발표된 결과이며, 저자들의 자체 JudgeGPT 온라인 참여 프레임워크를 사용한다.

경량급 전투력

인간이 구별할 수 있는가? LLM 생성 뉴스의 인간 인식에 대한 이중 축 연구라는 제목의 이 연구는 프랑크푸르트 응용 과학 대학교와 난테스의 IRISA 연구 단위의 세 명의 연구자로부터 나왔다. 이 연구의 방법론은 ‘가짜 뉴스’와 ‘AI 작성 뉴스’ 사이에 중요한 구별을 만든다. 즉, 가짜 뉴스는 사람이나 AI에 의해 작성될 수 있으며, 두 가지 측면은 반드시 동의어는 아니다.

그러나 아마도 가장 흥미로운 측면은 이 논문의 결론이다. Mistral 7B 및 Gemma 7B와 같은 작은 모델은 7억 개의 매개변수만으로도 200억 개의 매개변수를 가진 ChatGPT 모델(4o)와 대등하게 경쟁할 수 있다는 것이다:

‘7억 개의 매개변수만 있는 오픈 웨이트 모델은 GPT-4o 출력과 다를 바 없는 텍스트를 생성하며, 이는 인간과 구별할 수 없는 텍스트를 생성하는 능력이 더 이상 최첨단 모델에만 국한되지 않는다는 것을 나타낸다.’

그러나 ‘AI 생성 뉴스’는 철자 검사부터 전체적인 노력 위임까지 다양한 인간-AI 협력을 나타낼 수 있으며, 이 연구는 테스트에 사용된 AI 콘텐츠의 정확한 종류를 명확히하지 않는다. 그러나 그것은 생성 방법을 설명한다(아래 참조).

방법

JudgeGPT 플랫폼에 참여한 참가자들은 각 뉴스 단편에 대해 연속적인 0-100 슬라이더에 세 개의 독립적인 평가를 제공했다.

참가자가 소스 속성, 진위성, 및 주제 熟悉度를 평가하는 JudgeGPT 포털 GUI. 출처 논문에서 더 높은 해상도를 참조하십시오.

소스 판단은 통과가 기계에 의해 작성되었는지 인간에 의해 작성되었는지 여부를 포착했다. 진위성 판단은 그것이 가짜 또는 합법적인 것으로 인식되는지 여부를 결정했다. 주제 熟悉度는 독자가 주제를 얼마나 잘 알고 있는지 측정했다.

연속적인 척도를 사용하여 Likert 척도보다 더 정밀하게 정도의 확신을 포착하고, 통계 분석을 지원했다. 이는 pearson 상관계수 및 클러스터링을 포함한다.

기계 생성 텍스트 단편은 저자들의 자체 RogueGPT 프레임워크에 의해 생성되었으며, 이는 JudgeGPT의 피더 아키텍처이다. RogueGPT는 6개의 대형 언어 모델(LLM)의 기여를 조정한다: ChatGPT-4; ChatGPT-3.5; ChatGPT-4o; LLaMA-2 13B; Gemma 7B; 및 Mistral 7B.

Persona 기반 프롬프트가 텍스트를 생성하는 데 사용되었으며, AI 생성은 실제 뉴스 주제에 기반을 두었으며, 인간에 의해 事実 확인되었다.

반면에 인간이 작성한 단편은 ‘정립된 뉴스 아웃レット’ 및 미지정된 ‘정보 데이터베이스’에서 샘플링되었다.

저자들은 다음과 같이 관찰한다:

‘자극 세트는 의도적으로 기계 起源 단편(∼98%)으로 기울어져 있으며, 인간 起源 항목은 校準錨으로 작용한다. ‘

‘이 디자인 선택은 연구의 초점이 인간 대 기계 비교보다는 기계 내 변이(모델 간)에 있다는 것을 반영한다. 참가자는 기준 비율에 대해 알지 못하며, 거의 확률 수준의 검출[결과]는 인간 起源 하위 집합만으로 분석할 때에도 유지된다.’

참가자는 정보 제공 동의서에 동의하고 인구 통계학적 설문조사를 완료한 후 뉴스 단편을 평가했다. 이 설문조사는 연령, 교육, 정치적 성향, 및 AI에 대한 熟悉度를 다루었다.

각 참가자는 5~87개의 항목을 검토했으며, 중간값은 12였다. 표시 순서는 무작위로 설정되었으며, 모델 할당은 참가자 간에 균형을 유지하여 편향을 줄였다. 플랫폼은 세 개의 슬라이더 평가와 함께 응답 시간 및 匿名 식별자를 기록했으며, 이는 개별 판단을 배경 요인과 연결할 수 있도록 했다.

저자들은 샘플이 교육 수준이 높은 유럽 참가자로 기울어져 있음을 지적한다. 즉, 68%가 대학 교육을 받았으며, 74%가 유럽에 거주한다는 것을 지적한다. 이는 논문에서 더 넓은 일반화에 대한 한계로 언급한다.

테스트

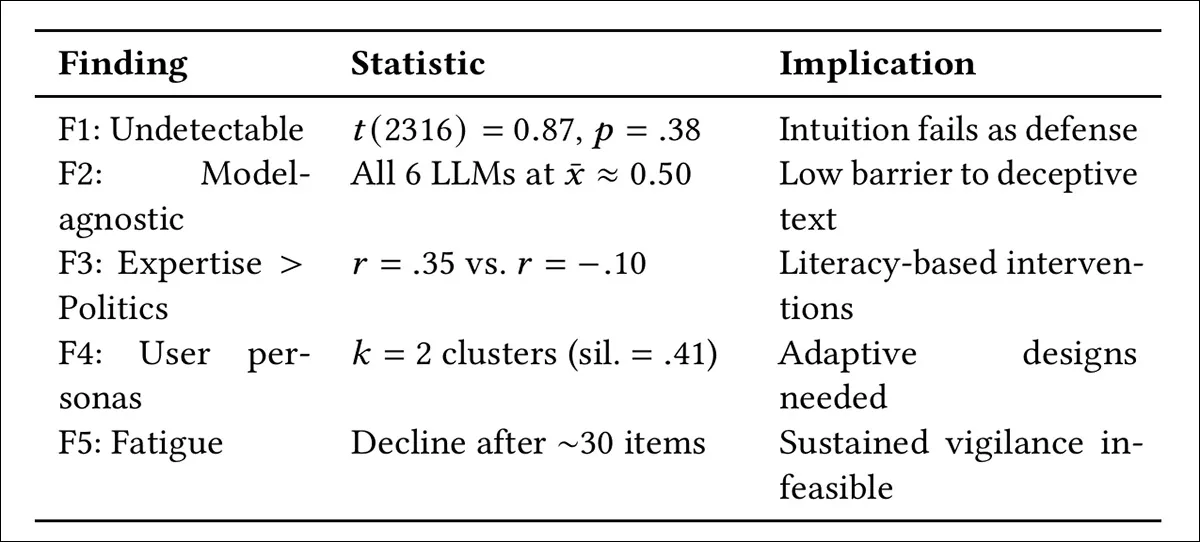

테스트는 다섯 가지 유형의 발견으로 나뉜다: 기계 생성 텍스트와 인간 작성 텍스트를 구별하는 것; 다른 LLM 간의 감지 비교; 도메인 전문 지식과 정치적 성향이 정확성에 미치는 영향 검토; 참가자 간의 구별되는 응답 전략 식별; 반복적인 평가에서 정확성이 어떻게 변경되는지 추적하는 것, 즉 피로:

1,054명의 참가자로부터 2,318개의 판단에 대한 다섯 가지 핵심 발견의 요약, 이는 인간이 AI 작성 텍스트를 감지하는 데 실패하며, 이는 모든 모델에서 확률 수준을 유지하며, 정확성이 도메인 전문 지식과 관련이 있으며, 참가자가 두 가지 신뢰 프로파일로 클러스터링되며, 성능이 약 30개의 평가 후에 감소한다는 것을 보여준다.

테스트는 기계 생성 텍스트와 인간 작성 텍스트를 구별하는 데 인간의 판단이 더 높은 확률을 나타내지 않는다는 것을 보여준다:

기계 및 인간 起源 단편의 소스 및 진위성 점수 분포는 상당한 중첩을 보여주며, 두 조건 사이에 유의미한 분리는 없으며, 통계적 테스트는 참가자가 AI 생성 텍스트와 인간 작성 콘텐츠를 신뢰성 있게 구별할 수 없음을 나타낸다.

두 번째 측면에서, 그래프는 감지 실패가 모델에 따라 다르지 않음을 보여준다. 즉, 모든 LLM의 출력은 확률 수준의 판단을 중심으로 클러스터링되며, 그들 사이에 유의미한 차이는 없다. Mistral 7B 및 Gemma 7B와 같은 더 작은 오픈 웨이트 시스템은 GPT-4o와 다르지 않게 평가되었으며, 이는 인간과 구별할 수 있는 텍스트가 더 이상 최첨단 모델에만 국한되지 않는다는 것을 나타낸다.

세 번째 측면에서, 정확성은 정치적 성향보다 도메인 전문 지식과 더 강하게 관련이 있었다. 즉, 가짜 뉴스에 대한 熟悉度는 더 나은 판단과 상관관계가 있었으며, 정치적 견해는 유의미한 영향을 미치지 않았다. 이는 학습된 분석 기술이 이데올로기보다 더 중요할 수 있음을 시사한다:

제3의 조사 라인에 관한 결과는 정치적 성향이 소스 속성 또는 진위성 평가에 유의미한 영향을 미치지 않는다는 것을 보여주며, 가짜 뉴스에 대한 熟悉度는 두 축 모두에서 정확성과 일관되게 관련이 있었다. 출처 논문에서 더 높은 해상도를 참조하십시오.

네 번째 발견은 참가자가 두 가지 구별되는 응답 스타일, 즉 ‘의심론자’와 ‘신뢰론자’로 클러스터링됨을 보여준다.

마지막으로, 다섯 번째 목표에 대해, 순차적인 판단의 롤링 분석은 참가자가 초기에 작업에 더 잘 적응하며, 약 15~20개의 평가 후에 정확성이 향상됨을 보여준다:

참가자의 평가 순서에 따른 소스 속성 및 진위성 점수의 롤링 평균은 초기 약 15~20개의 항목에서 작업에 적응하는 것으로 나타나며, 이후 약 30개의 평가 후에 두 측정값 모두에서 성능이 감소하는 것을 보여준다. 이는 인지 피로로 해석된다. 출처 논문에서 더 높은 해상도를 참조하십시오.

그러나 이 효과는 일시적이며, 약 30개의 항목 이후에 성능이 감소하기 시작하며, 참가자가 콘텐츠를 가짜로 표시하는 것을 기본 응답으로 돌아간다. 이는 인지 피로를 나타내며, 감지 기반 접근 방식이 실제로 얼마나 오래 효과적으로 유지될 수 있는지에 대한 한계를 시사한다.

이것은 우리가 가짜 뉴스와 실제 뉴스를, 또는 AI 뉴스와 인간 뉴스를 구별하는 것에 대한 전망에 지친 나머지, 안전을 위해 뉴스를 AI와/또는 가짜로 가정하는 경향이 있을 수 있는 일부 경험적 증거일 수 있다. 사람들이 자체 연구를 통해 가짜 뉴스 이야기를 검증하도록 요청하는 것이 실제로 문제를 더 악화시킨다는 것을 알게 된 사람들은 이것을 interess할 수 있다.

저자들은 결과가 나타내는 인간 판단의 실패는 이러한 문제를 시스템 수준의 대책, 즉 콘텐츠 출처, 적응형 신뢰 지표, 및 제한된 면역介入과 같은 기술로 넘겨야 함을 시사한다.

결론

이 논문의 우려스러운 측면은 저자들이 시작하거나 참여한 프로젝트와 논문들의 지지 네트워크이다. 또한 이 연구에서 사용된 AI 및 인간 작성 텍스트 샘플을 조사할 수 있다면 결과를 더 잘 이해할 수 있을 것이다.

그러나 오픈 소스 모델이 ChatGPT 시리즈와 같은 API 구동 거대한 모델과 비교할 수 있다는 것은 흥미롭다. 작업이 실제로 그렇게 어렵지 않으며, 200억 매개변수 모델이 과kill일 수 있는가? 우리는 이 질문에 답하기 위해 제출된 AI 및 인간 작성 소스 샘플에 대해 조금 더 알아야 한다.

한편, canirun.ai 웹사이트에 따르면 Mistral 7B(테스트에서 ChatGPT-4o와 거의 동일한 수준이었다)는 NVIDIA RTX 3080에 16GB의 VRAM과 함께 ‘잘 작동’하며, RTX 3060에 6GB의 VRAM과 함께 ‘적당히 작동’한다고 한다. 이는 거의 최신이나 최고의 그래픽 카드가 아니다. 따라서 이 실험에 참여하려는 사람은 자신의 방법론을 개발하여 샘플을 제출할 수 있다.

* Gemma 7B는 사이트에 나열되지 않는다.

2026년 4월 9일 처음 게시됨