Andersonの視点

「感覚」ベースの画像注釈のリスク

彼らは数ドル(またはまったくなし)しか支払われていないかもしれないが、画像を「有害」なコンテンツとして評価するために、未知の人々があなたの生活を変える選択を行うことができる。現在、Googleからの新しい論文は、これらのアノテーターが「有害」または攻撃的なものであるかどうかを判断するための独自のルールを作成しているように見えている。個々の画像に対する彼らの反応がどれほど奇妙または個人的であっても。何が間違うことができるのか?

意見 この週、Google ResearchとGoogle Mindの新しいコラボレーションは、13人以上の貢献者を新しい論文に集め、アルゴリズムの評価に画像を評価する際に、アノテーターの「直感的な感情」が考慮されるべきかどうかを探った。この論文は、既存の評価基準と一致しない場合でも、アノテーターの反応が考慮されるべきかどうかを調査している。

これはあなたにとって重要です。なぜなら、評価者やアノテーターが合意によって有害と判断するものは、自動的な検閲やモデレーションシステム、そして「猥褻」または「受け入れられない」材料の基準となる法律、たとえば新しいNSFWファイアウォール*の基準となるからです。これは、社会メディアプラットフォームやその他の環境でのコンテンツ評価システムにも適用されます。

したがって、有害と判断される基準が広がるにつれて、検閲の可能性も広がります。

感覚検閲

これは論文が提示する唯一の視点ではありません。論文はまた、画像を評価する人が、自分自身よりも他の人に有害と考えられるものに対してより厳格であることが多く、低品質の画像は安全性に関する懸念を引き起こすことが多いが、画像の品質は内容とは関係がないことを発見しています。

論文の結論では、これら2つの発見が強調されています。論文は、既存のフレームワークが主観的および文脈依存的な要素、たとえば感情的な反応、暗黙の判断、有害性の文化的解釈を考慮する必要があることを示唆しています。アノテーターの感情的な言語の頻繁な使用と、定義された有害性ラベルからの逸脱は、現在の評価慣行におけるギャップを強調しています。

‘私たちの研究結果は、既存のフレームワークが主観的および文脈依存的な要素、たとえば感情的な反応、暗黙の判断、有害性の文化的解釈を考慮する必要があることを示唆しています。アノテーターの感情的な言語の頻繁な使用と、定義された有害性ラベルからの逸脱は、現在の評価慣行におけるギャップを強調しています。 ‘

‘アノテーションガイドラインを拡張して、多様な文化的および感情的な解釈の例を含めることで、これらのギャップを解決することができます。’

新しい論文は、平均的な読者にとって明確で共感的な例から始まりますが、実際のコアマテリアルはより多くの疑問を引き起こします。ここでは、各画像の下に、アノテーターの感情的な反応が示されています。ソース: https://arxiv.org/pdf/2507.16033

これは、有害性を構成するものをよりよく定量化するための提案のように聞こえるかもしれませんが、論文はこれが望ましいことでも、実現可能でもないことを繰り返し述べています。

‘私たちの研究結果は、既存のフレームワークが主観的および文脈依存的な要素、たとえば感情的な反応、暗黙の判断、有害性の文化的解釈を考慮する必要があることを示唆しています。アノテーターの感情的な言語の頻繁な使用と、定義された有害性ラベルからの逸脱は、現在の評価慣行におけるギャップを強調しています。 ‘

‘アノテーションガイドラインを拡張して、多様な文化的および感情的な解釈の例を含めることで、これらのギャップを解決することができます。[…]’

‘[…] アノテータが曖昧な画像について推論するプロセスは、しばしば彼らの個人的、文化的、感情的な視点を反映しており、これらをスケール化または標準化することは難しい。’

これは、論理的な評価システムに「アノテーションガイドラインを拡張して、多様な文化的および感情的な解釈の例を含める」ことがどのように適合するかを理解することは難しい。

二元的な判断

画像やテキストが有害となる可能性は、確かに定量化することが難しい。なぜなら、高い文化は「低い」文化と交差するからです(たとえば、芸術や小説の場合)。これは、最初の「感覚」ベースの検閲基準につながります。つまり、猥褻な材料が正確に定義されない場合でも、「それを見たときにわかる」ということです。

新しい論文の包括的で探究的な議論の下に、共感と質的ニュアンスの権威が攻撃されているように見えます。つまり、プラットフォームがモデレーションを実装し、拡大するための許容可能な誤差の余地で実行できる中央集権的標準化された分類法(「暴力」、「ヌード」、「憎悪」など)です。

ここで浮かび上がる議論は、分散化された主観的、文脈依存的な人間のフィードバックだけが、GenAIの出力を適切に判断できるというものです。

しかし、これは明らかに拡張できない。なぜなら、1兆画像のフィルターパイプラインを「感覚」や生活経験で実行することはできないからです。有害性を多様な特性に定量化し、フィルタリングシステムの範囲に制限を設け、エッジケースで新しい指令を待つ必要があります(たとえば、不満を持つ当事者が彼らの特定の状況に対処する新しい法律の施行を待つ必要があるのと同様に)。

代わりに、新しい論文は、自動モデレーションパイプラインのための暗黙の指令を提示しています。つまり、範囲が自動的に拡大し、慎重さの側に大きく傾きます。つまり、1人のアノテータからの最も個人的な反応でも、他の人に有害性がない画像をペナルティにすることができます。

道徳的拡大

論文は、探究よりも立場を取ることを好みますが、科学的方法の要素を含みます。著者らは、より広い範囲のアノテーターの反応を特定する(厳密に測定するのではなく)ためのフレームワークを開発し、画像に対するこれらの反応が性別やその他の人口統計学的要因を超えてどのように変化するかを調べました。

テストの分析は、有害性への焦点†に加えて、テスト参加者が画像や関連テキストを含む修正されたテストデータセットを注釈付けたときの「道徳的推論」を調べました。

「道徳的感情オートレーター」は、道徳的基盤理論で定義されているケア、平等、比例、忠誠、権威、および純度などの道徳的価値観を捉えるように設計されました。この理論は、流動的で進化する性質を持つため、大規模な人間の評価システムに必要な具体的な定義の作成に反対しています。

この理論に基づいて、著者らは、恐怖、怒り、悲しみ、嫌悪、混乱、不気味さを含む、安全性の追加の次元を分類しました。

著者らは最初のものである恐怖について説明しています:

‘多くのアノテータは、「怖い」(たとえば、歪んだ顔や子供に向けられた銃などの暴力的な画像)、「不安定」(たとえば、「誰かが轢かれるのを見て、非常に心配で不安定です」というように、「血」のような赤いペンの塗料)、「不安定」(たとえば、「少年の画像には多くの歪みがあります… 私はそれが間違った側のレールで遊んでいるように見えるので、嫌な感じがします」)などの用語を使いました。’

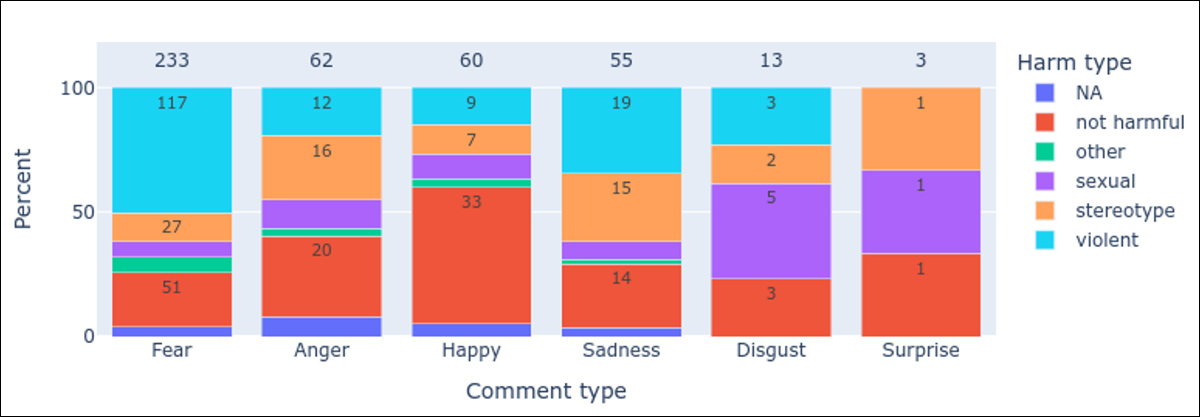

‘グラフは、「恐怖」を最も頻繁に言及された感情(233回)として定量化しています。ほぼ半分の言及は暴力的コンテンツに関連していますが、有害とみなされないコンテンツも2番目に高い「恐怖」の言及を引き起こしました。’

有害性カテゴリ間の感情関連用語の分布、バーの高さはコメントの割合を示し、バー内にカウントが表示され、各カテゴリの上に合計コメント数が表示されます。

新しい安全性の次元の包含について、著者らは次のように述べています:

‘これらの新しいテーマは、主観的、感情的、認識的な要素を統合することで、GenAI画像評価フレームワークを豊かにするための重要な必要性を強調しています。’

これは危険な道を進むことになるかもしれません。なぜなら、注釈付けプロセスが、すべてのアノテーターが確立された基準とベンチマークに従うのではなく、材料が1人のアノテーターに与える反応に基づいて、任意のルールを追加できるからです。

もしもこの考え方に経済的な原動力があれば、それは「超大規模な人間の注釈付け」を可能にすることです。ここで、プロセスは摩擦がなく、参加者は自己規制的であり、自分たちでルールや境界を決定します。

標準的な注釈付けの下では、ルールは人間の合意によって決定され、アノテーターによって遵守されます。論文で想定されているシナリオでは、最初の監視層が除去されるか、またはダウングレードされます。つまり、誰かが反応する可能性のある画像はすべてフラグ付けされることになります(おそらく、合意は時間がかかり、コストもかかるからです)。

ロールシャッハ判断

注釈付けの目的は、専門家の監視、複数のアノテーターの共通の合意、または両方によって、正確な説明または定義に到達することです。代わりに、有害性の限定されたが明確に定義された階層を、直感的で個人的な解釈的立場に拡大することは、ロールシャッハテストを注釈付けることと同等です。

たとえば、論文では、一部のアノテーターが画像の低品質(たとえば、JPEGアーティファクトや画像の技術的な欠陥)を「不安定」または「有害」を示すものとして解釈したことが示されています:

‘これは、タスクが画像の品質に関する指示を省略していたにもかかわらず発生しました。さらに、アノテータはこれらの品質のアーティファクトを意味的に重要であると解釈しました。’

‘アノテータの1人は、「画像は全く有害ではありません。彼の顔が少し歪んでいるだけです」とコメントしました。同様に、アノテータの1人は、別の画像の歪んだ顔が「痛みを示唆している」と解釈しました。’

主観的、感情的、または文脈依存的な反応を定義された安全性カテゴリよりも優先することで、ここで開かれるのは、任意のものが有害とみなされる可能性のある、また「寒冷化効果」のアドホックな削除や、コンテンツの否定的な再分類(たとえば、特定の利益団体に「反感」を与える可能性のあるコンテンツ)の実現の可能性があるレジームへの道です。

論文 “Just a strange pic”: GenAI画像の安全性注釈タスクにおける「安全性」の評価 – 多様なアノテーターの視点からは Arxivで利用可能です。

* これはここでは主な話題ではないので、ショートカットです。新しい法律の下では、違反サイトは、自分たちで警察するか、複雑で高価なレビューシステムや年齢確認技術を実施するか、または英国からのドメインへのアクセスをブロックする(これも自費で)ことが期待されます。

† これは「子供のことを考えて」というミームで表現できます。これは、他人の道徳的代理を、明らかに利他的な目的のために利用することを風刺しています。

最初に2025年7月25日に公開されました