ソートリーダー

実用的なプレイブック:防御可能なLLM出力のための

大企業のGenAI導入では、出力が見た目に正しければ、それは正しいという暗黙の前提が働いている。低リスク環境では、これは妥当なショートカットである。しかし、ヘルスケア、金融、製薬、品質保証などの規制業界では、これは潜在的なリスクである。

LLM出力が臨床上の決定、財務記録、またはコンプライアンス文書に影響を与える瞬間、流暢性は信頼性の代理として機能しなくなる。而且、監査員、規制機関、または法務チームが使用したデータ、適用したルール、誰が承認したかを問うとき、「モデルがそう言った」ことは誰も承認できない答えではない。

これは、ほとんどのGenAIチームが設計していない説明責任のギャップである。ここでは、そのギャップを埋める方法を示す。

「見た目が正しい」という基準が間違っている理由

伝統的なAI評価では、精度、待ち時間、コストが重要である。これらは重要である。しかし、規制環境では、他の要素を代替できない4番目の軸が導入される:監査可能性。

EU AI法は、現在有効であり、高リスクAIシステムには技術文書、トレース可能性ログ、ライフサイクル全体における人間の監視の証拠を保持することを要求している。FDAのAIを使用した医薬品および生物学的製剤の開発に関する最初のガイダンスは、ライフサイエンスでも同様の方向性を示唆している。これらのフレームワークでは、流暢性の評価は行われない。代わりに、再構築可能、検査可能、防御可能なシステムが必要である。

防御可能なLLM出力とは、検証可能な証拠の連なりを通じて追跡できるものである:どのデータから得たか、どのような制約が形作ったか、誰がレビューしたか、将来の検査のために何が保持されたか。そうでなければ、正しい出力でも防御できない。

これは、規制環境におけるAIの「本稼働可能」が実際に何を意味するかを再定義する。

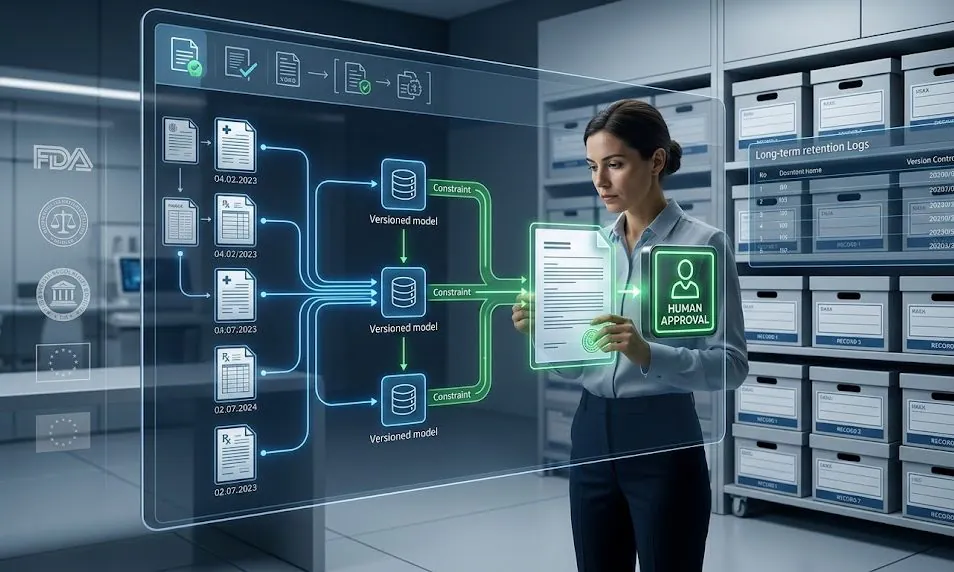

監査可能なGenAIの4つの柱

防御可能なLLMシステムを構築するには、4つのエンジニアリング要件が必要である。これらは抽象的な原則ではなく、システムが監査に耐えられるかどうかを決定するインフラストラクチャの決定である。

1. 起源:モデルが情報を取得する場所を制御する

企業AIで最も一般的な故障モードは、同時に最も目に見えないものである:モデルが一般的な知識や定義の不明確なデータソースから情報を取得すること。制御された知識の境界がない場合、出力は監査可能なソースに追跡できず、再構築は不可能になる。

実用的な解決策は、承認された知識の境界を確立することである:バージョン管理された、所有者のあるドキュメントおよびデータセットで、システムが明示的に使用を許可されているもの。各回答には、少なくとも最小限の証拠パックが必要である:ソース識別子(バージョンおよび有効日付を含む)、検索および選択された内容を示す取得ログ、およびインライン引用。有用な運用ルール:引用がない場合は主張しない。

これにより、システムは、メモリベースの生成から証拠ベースの推論に変換される。特定の出力を生成してから数週間または数か月後に誰かがそれを再構築する必要がある場合、区別は重要になる。

2. 制約:即興を制御された動作に置き換える

LLMは、説得力を持つように構築されている。制約がない場合、妥当性を最適化し、規制されたコンテキストでは、妥当性がリスクの源となる。

制約は、確率的テキスト生成器を境界付けられた実行コンポーネントに変換するメカニズムである。実践では、次のことを意味する:

- ソースバウンド生成:各主張には承認されたバージョンのソースが必要である。ソースがない場合は回答がない — ただ拒否またはエスカレーションのみである。

- 構造化された出力スキーマ:応答は、機械および監査員が検証できる形式(読み取り専用でなく)に従う。

- 信頼境界の適用:取得したコンテンツは入力として扱われ、セキュリティおよび監査可能性を損なう可能性のあるプロンプトインジェクションリスクに対処する。

- 最小特権アクセス:モデルは、実際に必要なデータおよびツールのみと対話し、監査トレイルをクリーンに保つ。

制約は、コンプライアンスのチェックボックスではありません。監査可能かどうかを決定するアーキテクチャの決定です。

3. レビュー:人間の監視を正式な制御レイヤーにする

規制されたAIでは、人間のレビューはアドホックではできない。リスク分類(高リスク出力は厳格な検証をトリガーする)およびイベント駆動型でなければならない。モデル信頼性が低い、ソースが欠如している、または異常が検出されたときにアクティブ化する。

EU AI法は、明示的に人間が、高リスク使用ケースにおけるAI駆動の決定を解釈、オーバーライド、および停止できるようにすることを要求している。要件を満たすには、レビューレコードが、誰が出力を承認したか、どのような条件下で、どのようなレベルの厳格さで承認したかを記録する必要がある。「誰かがチェックした」ことはコントロールではない。タイムスタンプ付きのレビューレコードは。

これにより、レビューは手動QAから正式なガバナンスレイヤーに昇格する。規制機関はこれをそう扱い始めている。

4. 保持:説明責任を永続させる

ログがない場合は監査トレイルがない。監査トレイルがない場合は説明責任は理論的である。

同時に、すべてを保持すると、特にGDPRまたはHIPAAなどのフレームワークの下で最小化要件の対象となる機密性の高いヘルスまたは財務データに関して、独自のリスクが生じる。

実用的なアプローチは、階層型モデルである。常にモデルおよびバージョンメタデータ、ソース識別子、ポリシーデシジョン、およびタイムスタンプを保存する。リスク分類に基づいて、プロンプト、出力、およびフルトレースのインタラクションコンテンツを選択的に保存し、適切なレダクションおよびアクセス制御を適用する。目標は、過剰なデータ収集によってダウンストリームのリスクを生じることなく、任意の出力を再構築できるようにすることである。

実際の例

これが、CFR 21 Part 11が、電子レコードを帰属可能、読み取り可能、同時的、元の、正確であることを要求するライフサイエンスでどのように適用されるかを考えてみましょう。規制ドキュメントを生成するLLMは、5つの基準すべてを満たさなければならない。ただ読み取り可能なテキストを生成するのではなく。

このコンテキストでは、4つの柱は任意の強化ではありません。コンプライアントシステムの最小限の基準です。起源は、出力が帰属可能で元のものであることを保証します。制約は、定義された境界内に留まることを保証します。レビューは、人間の監視が同時的であることを保証します。保持は、検査可能であることを保証します。

同様の論理は、MiFID IIが、決定とその根拠に関するレコードを要求する金融サービス、および、説明可能性と偏りの面で増加するスクラティニーの対象となっている臨床上の意思決定支援システムを持つヘルスケアにおいても適用されます。

より大きなシフト

GenAIは、実験から運用インフラストラクチャへの移行をしています。この移行は、受け入れられるシステムの基準を引き上げています。

有用な出力だけでは不十分です。組織は、説明可能、追跡可能、監査の下で防御可能な出力が必要です。AIは、現実的な結果をもたらすものに頼られているからです。

説明責任を最初から設計するチームは、AIを安全にスケールし、規制上の信頼を維持することができます。そうでないチームは、最終的に同じ瞬間を迎えることになります。監査、特定の出力に関する単純な質問、そして何も示すことができない。

監査可能なAIを構築することは、スピードを落とすことではなく、持続可能なものを構築することです。