人工知能

Vertex AIへの紹介

人工知能の急速に進化するランドスケープにおいて、テクノロジー領域のリーダーがしばしば直面する最大の課題の1つは、「実験的」から「エンタープライズ向け」への移行です。消費者向けチャットボットやインタラクティブなプラットフォームは、一般の想像力を助けるのに役立ちますが、企業はチャットインターフェイスだけでは成功することはできません。競争が以前よりも激化する時代に、企業は堅牢でスケーラブルでセキュアなエコシステムを必要とします。これは、GoogleがVertex AIで提供しようとしているものです。Google Cloudの統一された人工知能および機械学習プラットフォームです。

Vertex AIは、現代のクラウドインフラストラクチャーとのジェネレーティブAI統合のバックボーンとしての地位を固めようとしています。生のファウンデーションモデルとプロダクショングレードアプリケーションの間のギャップを埋める包括的な機能セットを提供しています。Vertex AIは、大規模言語モデル(LLM)のラッパーではなく、ジェネレーティブAIを現代のクラウドインフラストラクチャーの第一級市民として扱う統一された機械学習および人工知能(ML/AI)エコシステムです。

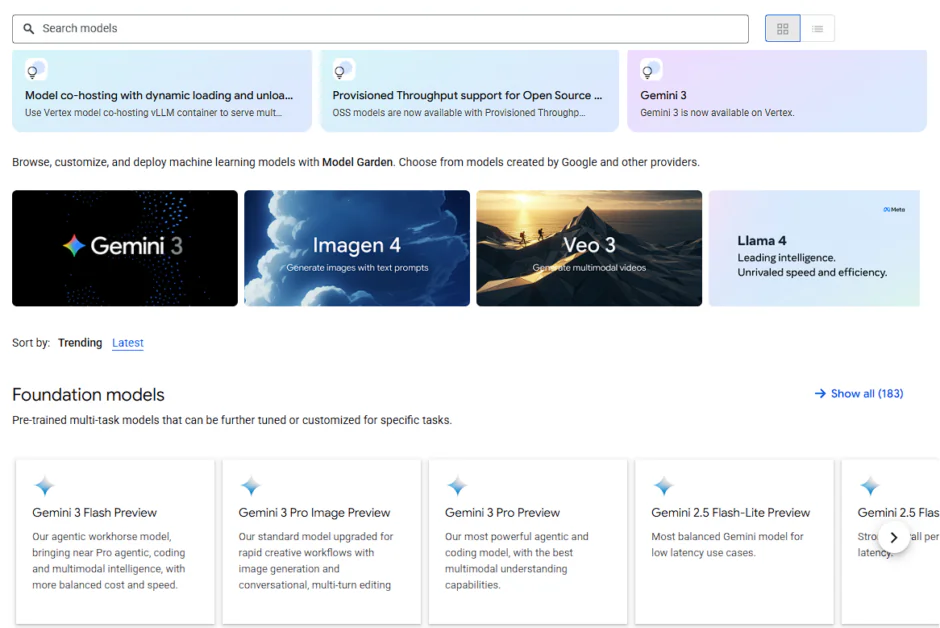

Vertex AIの中心には、モデルガーデンがあります。これは、モデルガーデンと呼ばれる、200以上のキュレーションされたファウンデーションモデルへのアクセスを提供する中央マーケットプレイスです。ここには、2百万トークンのコンテキストウィンドウを備えたマルチモーダルパワーハウスであるGemini 2.5 Proも含まれます。この記事では、Vertex AIのアーキテクチャを解析し、モデルガーデンがインテリジェンスの「アプリストア」としてどのように機能するか、そしてこのプラットフォームを次世代のエンタープライズソフトウェアのバックボーンにする技術的な柱を探ります。

コアアーキテクチャ:統一プラットフォーム

Vertex AIは、緩く結合されたツールのコレクションではなく、データとAIのエコシステムです。機械学習に今なお悩まされているデータ、ツール、チームの断片化を橋渡しするように設計されています。伝統的に、AIの開発は孤立した環境で行われ、時にはデータが複数のリポジトリに分散して保存されます。たとえば、組織は顧客データをSQLウェアハウスに保存し、構造化されていないドキュメントをData Lakeにダンプするかもしれません。データがシロ化されていると、AIは「部分的な真実」しか見えず、エンタープライズの完全なコンテキストがないため、偏った結果や高いハルシネーション率になる可能性があります。

Vertex AIは、BigQueryとCloud Storageでの生データの取り込みからプロダクション監視まで、ライフサイクル全体を統合しようとしています。基本的に、シロ間の「結合組織」として機能します。Vertex AIは、Cloud StorageとBigQueryとネイティブに統合されており、AIモデルは複雑な抽出、変換、読み込みパイプラインなしでデータを取得できます。

基盤:GoogleのAIハイパーコンピューター

Vertex AIのGenAIレイヤーは、Vertex AIと呼ばれる、統合されたスーパーコンピューティングシステムであるGoogleのAIハイパーコンピューター・アーキテクチャの上に構築されています。これは、以下で構成されています。

TPU v5p & v5e(Tensor Processing Units)

GoogleのTensor Processing Unitsは、ディープラーニングを定義する行列乗算用に特別に設計されたカスタムビルトのASIC(アプリケーション・スペシフィック・インテグレーテッド・サーキット)です。

- TPU v5p(パフォーマンス): これは、大規模なトレーニング用のフラグシップ・アクセラレーターです。各TPU v5pポッドは、4,800 Gbpsの最高帯域幅のInter-Chip Interconnect(ICI)で接続された8,960個のチップにスケールできます。テクニカルリーダーにとって、これは、前の世代と比較して、175億パラメーターのGPT-3サイズのモデルに対するトレーニングが2.8倍速くなり、市場投入までの時間が大幅に短縮されることを意味します。

- TPU v5e(効率): 中規模トレーニングと高スループットの推論用に設計されています。最大2.5倍の価格性能が向上しており、24時間365日推論を実行する必要があるが、巨額の予算がない企業にとって、理想的な選択です。

NVIDIA H100/A100 GPU for Flexibility

TPUは特化していますが、多くの開発チームはNVIDIA CUDAエコシステムに依存しています。Vertex AIは、NVIDIAの最新ハードウェアに対してファーストクラスのサポートを提供しています。

- NVIDIA H100(Hopper): 大規模なオープンソースモデル(Llama 3.1 405Bなど)を微調整するために大量のメモリ帯域幅が必要な場合に適しています。

- Jupiter Networking: 「ネットワークボトルネック」を防ぐために、GoogleはJupiterデータセンター・ネットワーク・ファブリックを使用しています。これにより、データはGPU間で電気の速さで移動し、RDMA(Remote Direct Memory Access)を使用してCPUオーバーヘッドをバイパスし、分散ノード全体でほぼローカルのパフォーマンスを提供します。

Dynamic Orchestration

Vertex AIで最も重要な技術的変化は、Dynamic Orchestrationです。レガシーエNVIRONMENTでは、GPUノードが3週間のトレーニング中に故障すると、ジョブ全体がクラッシュする可能性があります。

- Automated Resiliency: Vertex AIは、Google Kubernetes Engine(GKE)を使用して、ハードウェア障害が検出された場合にワークロードを自動的に健全なノードに移行する「セルフヒーリング」ノードを特徴としています。

- Dynamic Workload Scheduler: このツールにより、チームは優先順位に基づいて容量を要求できます。Flex Start(安価で、容量が利用可能になったときに開始)またはミッションクリティカルなリリースのための保証容量のいずれかを選択できます。

- Serverless Training: インフラストラクチャの管理が不要なチームの場合、Vertex AI Serverless Trainingにより、コードとデータを提出し、プラットフォームがクラスターを提供し、ジョブを実行し、クラスターを削除します。使用したコンピューティング秒だけに課金されます。

3つのエントリーポイント:発見、実験、自動化

さまざまな技術的役割を持つ人々(データサイエンティストからアプリケーション開発者まで)に対応するために、Vertex AIは3つの主要なエントリーポイントを提供します。

- モデルガーデン: 発見のマーケットプレイス。

- Vertex AI Studio: 実験のプレイグラウンド。

- Vertex AI Agent Builder: 自動化のファクトリー。

モデルガーデン:発見のマーケットプレイス

Google CloudのVertex AI Model Gardenは、Google Cloud内で幅広いファーストパーティ、オープンソース、サードパーティのAIモデル(多モーダルモデルを含む)を発見、テスト、カスタマイズ、デプロイするための集中プラットフォームです。ビジネスニーズのためのビジョン、テキスト、コードなどです。Vertex AIのツールとのシームレスな統合を提供し、MLOpsのストリームライン化を支援します。開発者と企業がタスク(テキスト生成、画像分析、コード補完など)に適したモデルを選択し、Google Cloud環境内で効率的にデプロイできるように、包括的なライブラリとして機能します。

モデルガーデンは、パフォーマンス、コスト、コントロールのバランスをとるために、モデルを3つの異なる層に分類します。

- ファーストパーティ(Google)モデル: これらは、Vertex AI内で利用可能なフラグシップのマルチモーダルモデルです。Googleは、Pro(複雑な推論)からFlash(低遅延、高ボリューム)まで、さまざまなサイズでこれらを提供し、開発者はモデルをユースケースに応じて最適化できるようにします。

- サードパーティ(プロプライエタリ)モデル: 構造化されたパートナーシップを通じて、Vertex AIは、Anthropic(Claude 3.5)やMistral AIなどの「モデルとしてのサービス」(MaaS)へのアクセスを提供します。5つの異なるAIプロバイダーの個別の請求およびセキュリティ資格情報を管理するのではなく、開発チームはすべてこれらに、既存のGoogle Cloudプロジェクトを使用して、統一されたAPI形式でアクセスできます。

- オープンソース&オープンウェイトモデル: この層には、MetaのLlama 3.2、Mistral、およびGoogleの独自のGemmaが含まれます。これらは、データの最大の分離を保証するために、独自のVPC(仮想プライベートクラウド)内でモデルを自己デプロイしたい組織に最適です。

統一されていない環境では、Llamaのようなオープンソースモデルをデプロイするには、PyTorch環境の設定、CUDAドライバーの構成、およびFlaskまたはFastAPIラッパーの管理が必要です。

モデルガーデンは、統一された管理エンドポイントを通じてこの「マングリング」段階を排除します。

- ワンクリックデプロイ: 多くのモデルでは、「デプロイ」をクリックすると、必要なTPU/GPUリソースが自動的にプロビジョニングされ、モデルがプロダクションレディなコンテナにラップされ、REST APIエンドポイントが提供されます。

- Hugging Face統合: Vertex AIは、Hugging Faceハブからモデルを直接Vertexエンドポイントにデプロイできるように開発者に許可し、利用可能なインテリジェンスの実質的に無限の拡張を提供します。

- プライベートサービス接続(PSC): 高度に規制された業界の場合、モデルはプライベートサービス接続を使用してデプロイできます。これにより、モデルエンドポイントはパブリックインターネットに公開されることはなく、データトラフィックは企業ネットワーク内にのみ保持されます。

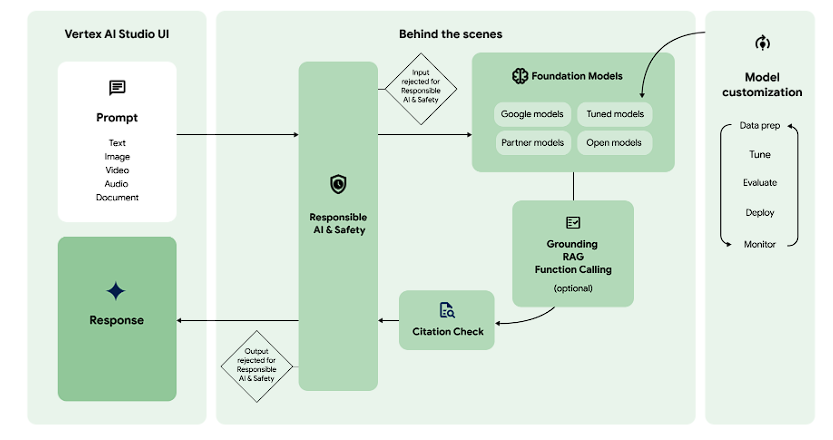

Vertex AI Studio: 実験のプレイグラウンド

モデルガーデンは選択についてですが、Vertex AI Studioは精度についてです。Vertex AI Studioは、伝統的なソフトウェアの世界で見られるコンパイラーやデバッガーに相当します。Vertex AI Studioは、生のモデルを特定のビジネスツールに塑成するためのワークスペースです。これは、プロンプトエンジニアリング、多モーダルテスト、ハイパーパラメーターの微調整の組み合わせを通じて実現されます。

多モーダルプロトタイピング: テキストを超えて

スタジオの特徴の1つは、多モーダル性をネイティブにサポートしていることです。テキスト以外のデータを扱うために複雑なコーディングが必要な他のプラットフォームとは異なり、Vertex AI Studioでは、モデルをテストするためにインターフェイスにファイルを直接ドロップできます。

- ビデオインテリジェンス: 45分間の技術的な基調講演をアップロードし、モデルに「特定のAPIが언급されるたびにそれを識別し、タイムスタンプ付きの要約を提供する」と指示できます。

- ドキュメント分析: モデルは単にテキストを読むのではなく、1,000ページのPDFの視覚的なレイアウトを分析し、グラフ、表、周囲の散文との関係を理解できます。

- コード実行: スタジオは、プレイグラウンドでのコード実行をサポートします。モデルに複雑な数学の問題を解いたり、CSVを分析したりするように求めた場合、モデルは、検証された答えを提供するために、セキュアなサンドボックス環境でPythonコードを書き、実行できます。

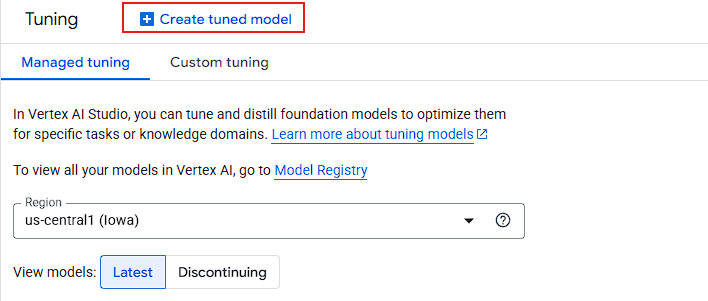

高度なカスタマイズ: チューニングパス

プロンプトエンジニアリング(ゼロショットまたはファインショット)が頭打ちになると、Vertex AI Studioは、モデルチューニングという重機械を提供します。

- 教師ありファインチューニング(SFT): 開発者は「プロンプト/レスポンス」ペア(理想的には100以上の例)のデータセットを提供します。これにより、モデルは特定のブランドの声、出力形式(特殊なJSONなど)、またはドメイン固有の用語を採用することを学習します。

- コンテキストキャッシング: 法律図書館やコードベースなどの巨大で静的なデータセットを扱う企業の場合、スタジオでは、コンテキストキャッシングを使用できます。これにより、モデルに100万トークンのデータを事前にロードしておくことができ、後のクエリでは待ち時間とコストが大幅に削減されます。

- 蒸留(教師-生徒): これは、高レベルのアーキテクチャの動きです。Gemini 2.5 Proのような巨大なモデルを使用して、Gemini 2.0 Flashのような小さくて速いモデルを「教える」ことができます。結果として、プロレベルのパフォーマンスを発揮するものの、フラッシュレベルの速度とコストで動作する軽量モデルが得られます。

Vertex AI Agent Builder: 自動化のファクトリー

Vertex AI Agent Builderは、高レベルのオーケストレーションフレームワークであり、開発者がファウンデーションモデル、エンタープライズデータ、および外部APIを組み合わせてエージェントを作成できるようにします。

「真実」のアーキテクチャ: グラウンドとRAG

エンタープライズAIの主な技術的障壁は、ハルシネーションです。エージェントビルダーは、洗練されたグラウンドエンジンを介してこれを解決します。

- Google検索によるグラウンド: 現実世界の知識(「ニューヨークの現在の金利は何ですか?」など)を必要とするクエリの場合、エージェントはGoogle検索を実行し、事実を抽出し、出典を示すことができます。

- Vertex AI Search(RAG-as-a-Service): 代わりに、開発者はVertex AI Searchを使用して独自のドキュメント(PDF、HTML、BigQueryなど)をインデックス化できます。これにより、「チャンキング」、「埋め込み」、「取得」ステップが自動化され、エージェントが内部の「真実の源」に基づいてのみ回答することが保証されます。

- Vertex AI RAGエンジン: 高度なカスタム実装の場合、このマネージドサービスにより、ベクトルベースとキーワードベースの結果を組み合わせたハイブリッド検索が可能になり、標準のLLM出力よりも最大30%の精度が向上します。

マルチエージェントオーケストレーション(A2Aプロトコル)

高度なエンタープライズワークフローでは、複数の専門エージェントが共同で作業することがよくあります。Vertex AIは、エージェント間のオープン標準であるエージェント間(A2A)プロトコルを導入します。

- 「旅行エージェント」が「財務エージェント」と通信して、フライトの予約が企業の予算内であることを確認できるようにします。

- 相互運用性: オープンプロトコルを使用しているため、Vertex AIで構築されたエージェントは、LangChainやCrewAIなどの他のフレームワークで構築されたエージェントと通信できます。

開発者スタック: ADKとエージェントエンジン

「テクノロジー・プラットフォーム」向けのオーディエンスの場合、エージェントビルダーは2つの異なるパスを提供します。

- ノーコードコンソール: ラピッドプロトタイピングとビジネスユーザーの構成のためのビジュアルドラッグアンドドロップインターフェイスです。

- エージェント開発キット(ADK): エンジニア向けのコードファーストPythonツールキットです。バージョン管理の統合、Vertex AIエージェントエンジンへのデプロイの可能性を提供します。セッションの永続性、スケーリング、ステート管理を自動的に処理するマネージドランタイムです。

結論: 「もしも」から「次に何」へ

AIデモからプロダクショングレードのエンタープライズアプリケーションへの移行は、デジタルトランスフォーメーションプロジェクトの「谷」で長年悩まされてきました。Vertex AIは、このギャップを埋めるように設計されています。データ、インフラストラクチャ、モデルオーケストレーションの断片化されたシロを統一することで、Google Cloudは、LLMの生の力からAIライフサイクルの運用的成熟度への会話を進めてきました。