人工知能

AI駆動の偏見チェッカー for ニュース記事、Pythonで利用可能

カナダ、インド、中国、オーストラリアの研究者が共同で、無料で利用できるPythonパッケージを開発しました。このパッケージは、ニュース記事の「不公平な言語」を効果的に検出して置き換えることができます。

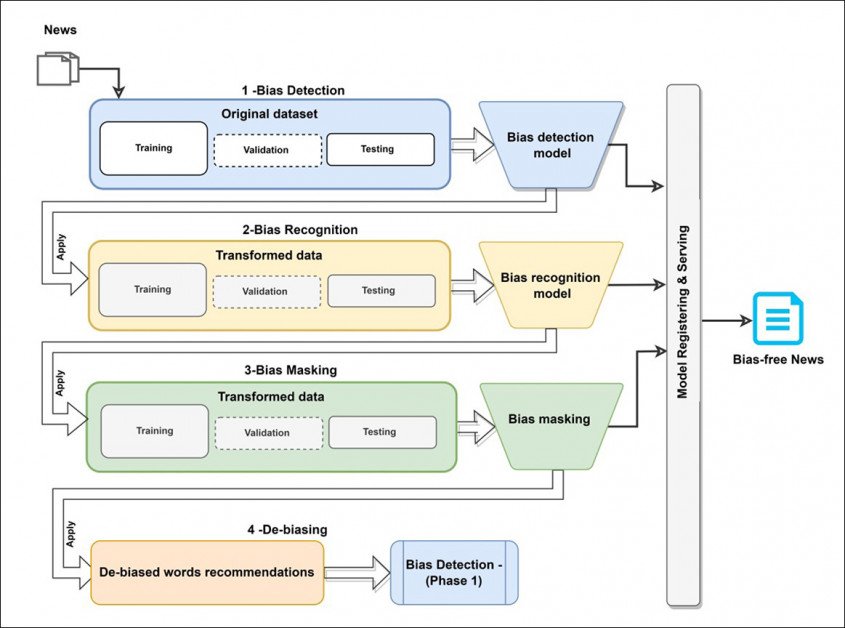

このシステムは、Dbiasと呼ばれ、さまざまな機械学習技術とデータベースを使用して、3段階の循環的なワークフローを開発し、偏ったテキストを非偏った、または少なくともより中立的なバージョンに戻すことができます。

ニュースのスニペットのロードされた言語が「偏った」と識別され、Dbiasによってより低炎症のバージョンに変換されます。 ソース: https://arxiv.org/ftp/arxiv/papers/2207/2207.03938.pdf

このシステムは、再利用可能で自己完結したパイプラインを表し、Pip経由でインストールでき、Hugging Faceからインストールでき、既存のプロジェクトに追加ステージ、追加モジュール、またはプラグインとして統合できます。

4月には、Google Docsに実装された同様の機能が、批判を受けました。特に、編集のできない点が批判されました。一方、Dbiasは、エンドユーザーが望む任意のニュースコーパスに選択的にトレーニングでき、カスタマイズされた公平性ガイドラインを開発する能力を維持しています。

重要な違いは、Dbiasパイプラインが「ロードされた言語」(事実の伝達に批判的な層を加える言葉)を中立的または平凡な言語に自動的に変換することを目的としていることです。ユーザーを継続的に教育するのではなく、エンドユーザーは倫理フィルターを定義し、システムをそれに応じてトレーニングします。Google Docsアプローチでは、システムがユーザーを一方的にトレーニングしているのです。

Dbiasワークフローの概念アーキテクチャ

研究者によると、Dbiasは、初めて真正に構成可能な偏見検出パッケージであり、現在までの自然言語処理(NLP)のこのサブセクターの特徴であるオフザシェルフのアセンブリプロジェクトとは対照的です。

新しい論文は、《ニュース記事の公平性を確保するためのアプローチ》と題され、トロント大学、トロント都市大学、バンガロールのEnvironmental Resources Management、中国のDeepBlue Academy of Sciences、シドニー大学の貢献者から来ています。

方法

Dbiasの最初のモジュールは、偏見検出です。これは、DistilBERTパッケージを利用しており、Googleの比較的機械的に集中的なBERTの高度に最適化されたバージョンです。このプロジェクトでは、DistilBERTはMedia Bias Annotation(MBIC)データセットでファインチューンされました。

MBICには、Huffington Post、USA Today、MSNBCなどのさまざまなメディアソースからのニュース記事が含まれています。研究者は、データセットの拡張バージョンを使用しました。

元のデータはクラウドソーシングされたワーカーによって注釈付けされました(この方法は2021年末に批判されましたが)、研究者は新しい論文で、データセット内の偏見の未注釈のインスタンスをさらに識別し、それらを手動で追加しました。識別された偏見の事例は、人種、教育、民族、言語、宗教、性別に関連していました。

次のモジュールは、偏見認識です。これは、固有表現認識(NER)を使用して、入力テキストから偏った言葉を個別化します。論文には以下のように記載されています:

「トーネードと気候変動についての疑似科学的なハイプを買わないでください」などのニュースは、前の偏見検出モジュールによって偏ったものとして分類され、偏見認識モジュールは「疑似科学的なハイプ」という言葉を偏った言葉として識別できます。」

NERは、このタスクに特に設計されていませんが、偏見識別のために以前に使用されており、特に2021年のDurham Universityのプロジェクトで注目されました。

この段階では、研究者はRoBERTaとSpaCy英語トランスフォーマーNERパイプラインを組み合わせて使用しました。

次のステージは、偏見マスキングです。これは、識別された偏見の言葉に対して新しいマルチマスクを実行し、複数の識別された偏見の言葉がある場合は順番に実行します。

Dbiasの3段階目で、ロードされた言語が実用的な言語に置き換えられます。注目してください。 ‘mouthing’と’using’は同じアクションを表しますが、前者は軽蔑的なものと見なされます。

必要に応じて、このステージからのフィードバックは、適切な代替フレーズまたは言葉が生成されるまで、パイプラインの開始に戻されます。このステージでは、マスク言語モデル(MLM)を使用します。これは、Facebook Researchが主導する2021年のコラボレーションに沿ったものです。

通常、MLMタスクは、15%の言葉をランダムにマスクしますが、Dbiasワークフローは、識別された偏った言葉を入力としてプロセスに指示します。

アーキテクチャは、Google Colab ProのNVIDIA P100で24GBのVRAMとバッチサイズ16を使用して実装およびトレーニングされ、2つのラベル(偏ったと非偏った)を使用しました。

テスト

研究者は、Dbiasを5つの比較可能なアプローチと比較しました。LG-TFIDFとロジスティック回帰およびTfidfVectorizer(TFIDF)ワードエンベッディング;LG-ELMO;MLP-ELMO(ELMOエンベッディングを含むフィードフォワード人工ニューラルネットワーク);BERT;およびRoBERTa。

テストに使用されたメトリックは、精度(ACC)、精度(PREC)、リコール(Rec)およびF1スコアでした。研究者は、すべての3つのタスクを単一のパイプラインで実行できる既存のシステムを知らなかったため、Dbiasの主なタスク(偏見検出と認識)のみを評価することで、競合フレームワークに配慮しました。

Dbiasの試験結果

Dbiasは、より重い処理フットプリントを持つものを含むすべての競合フレームワークを上回る結果を達成しました。

論文には以下のように記載されています:

「結果はまた、ディープニューラルエンベッディングが一般に、偏見分類タスクで従来のエンベッディング方法(たとえば、TFIDF)を上回ることができることを示しています。これは、ELMO(ディープニューラルエンベッディング)をLGと組み合わせた場合のTFIDFベクトル化よりも優れたパフォーマンスが見られるためです。」

「これはおそらく、ディープニューラルエンベッディングがさまざまなコンテキストでのテキスト内の言葉のコンテキストをよりよく捉えることができるためです。ディープニューラルエンベッディングとディープニューラル方法(MLP、BERT、RoBERTa)は、従来のML方法(LG)よりも優れています。」

研究者はまた、Transformerベースの方法が偏見検出で競合する方法を上回ることを指摘しています。

追加のテストでは、DbiasとさまざまなSpaCy Core Webバージョン(core-sm(小)、core-md(中)、core-lg(大))を比較しました。Dbiasはこれらの試験でもトップを走りました:

研究者は、偏見認識タスクは一般に、大きくて高価なモデルでは精度が高くなることを観察し、これはパラメータとデータポイントの数が増えたためであると推測しています。また、将来の研究の有効性は、高品質のデータセットを注釈付けるためのより大きな努力に依存することも指摘しています。

森と木

このような微妙な偏見認識プロジェクトが、最終的に、より広い視点をとり、特定のストーリーを選択することは、単に報告されたビューの統計だけでなく、他にも多くの要因によって偏ったものであることを考慮することができる、偏見を探すフレームワークに組み込まれることを願っています。

2022年7月14日に初めて公開されました。