L'angolo di Anderson

Perché l'intreccio concettuale significa che non puoi avere video generati dall'IA "a modo tuo"

Gli strumenti video basati sull'IA promettono il controllo totale, ma un "intreccio concettuale" nascosto lega insieme identità, espressioni e comportamenti, costringendo a ricorrere a espedienti e modelli predefiniti che infrangono il mito della magia infallibile dell'IA di generazione generale.

Opinione Da quando ho trattato a lungo l'argomento l'ultima volta cinque anni fa, il problema di intreccio concettuale L'utilizzo dell'IA nei sistemi addestrati si è esteso a una gamma di utenti molto più ampia, senza tuttavia essere realmente compreso meglio nei suoi termini.

Allora codificatore automatico sistemi deepfake (ovvero, i sistemi ormai defunti DeepFaceLab e quello meno incentrato sulla pornografia Cambia faccia, entrambi derivati dal disonorato e quasi immediatamente bannato Reddit del 2017 rilascio del codice) erano l'unica opzione disponibile per creare deepfake di persone relativamente fotorealistici.

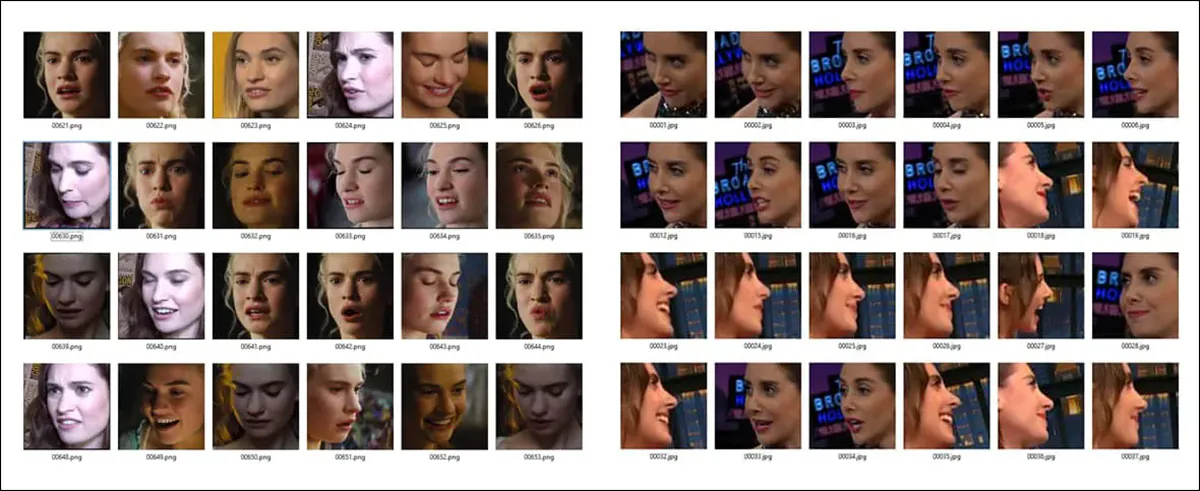

Questi sistemi si basavano su ampi set di dati di addestramento facciale che avevano lo scopo di fornire al modello di IA informazioni su A) l'aspetto della persona a riposo (un canonico riferimento incorporato) e B) come apparivano nelle diverse situazioni che un volto può riflettere, da sonno grazie a risata, orrore, la noia, cinismo, tristezza, ecc.

L'identità non si manifesta singolarmente, ma insieme alle espressioni facciali. Inoltre, per alcune emozioni possono essere disponibili dati facciali solo da angolazioni particolari ed estreme, il che tenderà ad associare l'angolazione all'emozione e viceversa.

Il problema era che l'identità canonica doveva solitamente essere dedotta da catture facciali che non erano di per sé 'neutre', cosicché la preponderanza di sorrisi e ghigni ottenuti durante lo scraping di set di dati stock avrebbe spostato il distribuzione verso un "predefinito sorridente". Ciò era dovuto all'elevato volume di foto di paparazzi sul tappeto rosso nei dati di addestramento estratti dal web che in genere alimentano questi modelli, così come a qualsiasi altra ragione altrettanto speciosa per cui un set di dati potrebbe essere distorto verso un tipo di immagine.

In altre parole, il sistema autoencoder dovrebbe tentare di estrarre un concetto di identità "neutra" da migliaia di immagini in cui i tratti del viso sono stati distorti da espressioni facciali normali.

Doveva inoltre cercare di districare i concetti semantici facciali delle diverse emozioni dagli angoli da cui sono stati presi i voltiCiò significava che, se le uniche espressioni facciali "terrorizzate" disponibili provenivano da una vista di profilo, il sistema addestrato sarebbe stato in grado di riprodurre quell'emozione in modo ottimale solo da quella prospettiva.

Rivolto in avanti

As basato sulla diffusione Dal 2022 in poi, gli approcci hanno dominato la scena dell'IA generativa per immagini (e successivamente per video), e i sistemi generativi sono diventati molto più abili nell'estrapolare espressioni facciali accurate anche con dati facciali limitati.

Anche le zone più spinose Challenge di creare viste del profilo convincenti è stato quasi superato, allo stato dell'arte attuale, mentre i dati di espressione sono stati efficacemente separati dall'identità, nella misura in cui il tipo di manipolazione di deepfake dal vivo, introdotta per la prima volta dagli autoencoder DeepFace dal vivo Il sistema di streaming ha numerose applicazioni di diffusione offline efficaci, e l'implementazione in tempo reale rappresenta un probabile sviluppo futuro:

Clicca per giocare. Dal progetto 'FlashPortrait', diversi esempi di avatar animati tramite video sorgente. In questo caso, non importa da che parte si collochi il dominio del "realismo", ammesso che ce ne sia uno. Fonte

Tuttavia, con l'ampliamento del campo di applicazione dell'IA di generazione e il progressivo aumento della sofisticazione dei risultati, il problema dell'entanglement si è semplicemente esteso a molte altre aree, e attualmente viene "risolto" con alcuni trucchi piuttosto banali e datati. Se non si conoscono questi trucchi, si potrebbe avere una visione più positiva della rapidità con cui l'IA applicata a video e immagini si sta evolvendo e superando i suoi vecchi problemi.

Gatti chiacchieroni

Spero sia chiaro perché, nei vecchi sistemi di autoencoder del 2017, fosse difficile separare identità ed emozione. I motivi erano i seguenti: a) la presenza di troppi dati di un solo tipo, oppure di una versione troppo specifica di un tipo di dati importanti, entrambe le situazioni causano una distorsione nella distribuzione; e/o b) l'architettura del modello non era in grado di separare queste qualità e tendeva a "incollarle" in fase di inferenza, a meno che l'utente non prestasse particolare attenzione a garantire l'equilibrio del proprio set di dati.

Esattamente per lo stesso motivo, problemi simili sono emersi in diversi modelli video open source e proprietari negli ultimi anni, sebbene siano stati oscurati da maggiori livelli di critica nei confronti allucinazione, mancanza di censurae diversi altri argomenti.

Ad esempio, nel Sistema Wan2.+, molti utenti hanno scoperto che è molto difficile per impedire che i loro personaggi generati parlare incessantementee spesso anche difficile fermarli guardando la telecamera.

Quest'ultimo problema (guardare in camera o rompere la quarta parete) precede l'avvento dei sistemi di sintesi video, poiché è emerso in vari sistemi di diffusione basati solo su immagini, a causa della prevalenza di foto "che guardano in camera" in dataset estratti dal web come LAION.

Il problema dei personaggi "loquaci" deriva dalla facile abbondanza di video "influencer" su YouTube, che naturalmente offrono migliaia di ore di discorso diretto alla telecamera, spesso organizzati in set di dati dove i ricercatori scientifici possono lavare e stirare il web scraping fornendo un contesto accademico.

Ma a meno che i curatori originali o successivi non si preoccupino di limitare il numero di video di questo tipo e di bilanciarli con filmati di diversa natura, si crea una grave distorsione nel modello video, che dovrà essere corretta attraverso soluzioni basate su suggerimenti e diversi sistemi di supporto di terze parti.

Di fronte al problema della "chiacchierone" di Wan, l'utente di Reddit u/Several-Estimate-681 ha proposto una soluzione che sfrutta un'impostazione nel Wan 2.1 Infinite Talk V2V sistema – un quadro progettato per incoraggiare loquacità in stile influencer – che consente all'utente di silenziare il personaggio visualizzato:

Clicca per giocare: Usa ascolta – una soluzione alternativa per ottenere l'attenzione sui personaggi in Wan2.+. Fonte

Chiaramente, scorciatoie di questo tipo non rappresentano soluzioni architettoniche di basso livello e, in assenza di vere soluzioni trovate e implementate dai creatori di modelli di base (perché gli hobbisti occasionali di solito non hanno milioni di dollari da ricreare o sintonizzare tale lavoro), questo significa che il gioco dell'intreccio 'colpisci la talpa' è probabile che sia azzeramento alla prossima versione.

Economico e fragile

Non c'è nulla nell'architettura di diffusione in sé che renda inevitabili questi problemi; anzi, se ci fosse un modo per applicare una curatela, un triage e una qualità davvero efficaci e di alta qualità didascalie e annotazioni Passando a set di dati su scala iperscalabile con milioni di punti dati, quasi tutti questi problemi probabilmente scomparirebbero.

Tuttavia, un tale livello di attenzione ai dettagli sarebbe paragonabile al Progetto Manhattan in termini di logistica, portata, risorse necessarie e puro sforzo a lungo termine. In un clima in cui una nuova architettura, o anche una nuova architettura versione Anche se ciò potesse vanificare l'enorme portata di un simile sforzo, al momento non c'è la volontà di assumersi un impegno di questo tipo.

Di conseguenza, nella misura in cui è compatibile con l'ottenimento di modelli utilizzabili, gli approcci più economici rimangono preferiti. Un esempio di tale "avarizia" è aumento dei dati, che, se applicato in modo illiberale e ai tipi sbagliati di videoclip del dataset, può avere risultati esilaranti:

Poiché l'aumento dei dati spesso inverte la direzione dei video sorgente nel dataset, il modello di intelligenza artificiale può occasionalmente apprendere alcune mosse "impossibili". - Fonte

Tuttavia, nel complesso, i sassi che rotolano in salita e le persone che escono dal personaggio attivando la "modalità influencer" tendono a essere considerati casi di danni collaterali in sistemi generativi che, nonostante tali persistenti errori e punti deboli, possono essere indotti a produrre risultati impressionanti e titoli di giornale sufficientemente sensazionali.

Soluzioni standard

Nel periodo attuale, centinaia di domini video generativi, quasi tutti i quali in qualche modo rompono il nuova serie di leggi e resistenza contro GenAI, si stanno godendo il momento di gloria prima che le forze dell'ordine, le liste nere o altri tipi di deplatforming rimuovano questi servizi commerciali.

I siti più grandi e conosciuti di questo genere, come Kling e Grok, tendono ad aderire a una qualche forma di autocensura (prima o poi) oppure a rispondere alle critiche modificando i tipi di contenuti che le loro piattaforme offrono agli utenti.

Ma dietro questi grandi nomi si celano centinaia di altre realtà improvvisate, che si adattano costantemente alla domanda di contenuti nuovi (e spesso più estremi).

Questo tipo di provisioning a basso costo evita gli elevatissimi costi e sforzi necessari per addestrare da zero i modelli di base. Molto spesso, viene esclusa anche la messa a punto, che costa considerevolmente meno.

Pertanto questi siti offrono "modelli" che si comportano in pratica in modo identico al 100% LoRA addestrati su misurache vengono utilizzati dagli appassionati di IA da oltre quattro anni per addestrare qualsiasi identità, stile, oggetto e (nel caso dei LoRA video) movimento o azione desiderati in un accessorio LoRA dedicato.

Con il LoRA interposto tra l'utente e il modello di base, i risultati ottenuti saranno molto specifici per ciò su cui il LoRA è stato addestrato e, di solito, le prestazioni più ampie del modello sono compromesse dall'influenza di flessione del peso del LoRA, che riprodurrà molto bene il proprio soggetto, ma interporrebbe anche quel materiale in qualsiasi richiesta (se i siti video GenAI improvvisati consentissero questo livello di controllo - non lo fanno; offrono solo un [AZIONE A VOSTRA SCELTA] modello e interpretare il testo/le immagini/i video inseriti nel modo che più probabilmente si tradurrà in un'applicazione corretta del modello).

Per ovvie ragioni, non posso inserire esempi di siti web in questo articolo; ma la letteratura di ricerca ha recentemente offerto alcuni esempi analoghi. Ecco, ad esempio, il Progetto EffectMaker Mostra il principio in azione, mediante il quale un'azione specifica viene applicata a un'immagine fornita dall'utente:

Clicca per giocare. In EffectMaker è possibile applicare effetti specifici e precisi a input personalizzati. Fonte

Anche in queste circostanze altamente selezionate e mirate, gli utenti spesso lamentano la necessità di molteplici tentativi, con conseguente spreco di token, per ottenere un buon risultato, e forse non dovremmo attribuire all'avidità del fornitore o a pratiche scorrette ciò che è più probabilmente colpa di un'innata tendenza a "provare e fallire". DiT Framework GenAI.

Si potrebbe sostenere che il grande pubblico si faccia un'idea delle capacità dell'IA generativa basandosi su esempi selezionati ad arte, che non sono rappresentativi di ciò che un utente occasionale e inesperto potrebbe realisticamente ottenere. Se un utente impiega sei tentativi con un modello (ad esempio, un LoRA fornito dal sito web dell'IA), tenderà a pubblicare e lodare il migliore, trasmettendo l'impressione che si possano ottenere risultati simili interrogando il modello di base, e dando l'impressione che i modelli generativi di base siano molto più semplici di quanto non siano in realtà.

Conclusione

La letteratura continua ad esaminare il problema dell'entanglement, che è emerso seriamente per la prima volta intorno al 2020, nel Max Planck/Google collaborazione Uno sguardo lucido all'apprendimento non supervisionato di rappresentazioni disaccoppiate e alla loro valutazione.

Inoltre, vari successori di Districamento tramite contrasto (Discoteca) emergono periodicamente, e la scena rimane vivace con una consapevolezza del problema che supera di gran lunga la consapevolezza pubblica di cosa sia l'IA non può farlo, a questo proposito.

Uno Studio cinese del 2024 Ciò suggerisce che una soluzione al problema dell'entanglement potrebbe non essere affatto necessaria per risolvere i problemi che esso comporta. Storicamente, questo trova conferma, poiché molti problemi irrisolvibili nella visione artificiale sono stati superati non risolvendoli, ma aggirandoli attraverso tecniche e approcci completamente nuovi.

Fino a quando non emergerà un concorrente così ben definito, sembra che continueremo a dover ricorrere a soluzioni tampone e palliativi per ovviare alle carenze e ai limiti di GenAI, e a sopportare la sovrastima da parte del pubblico della flessibilità e della duttilità dei modelli di base.

Prima pubblicazione lunedì 23 marzo 2026