Angolo di Anderson

Streaming di Avatar AI come se fosse il 1999

Nuova ricerca presenta un modo per trasmettere avatar 3D realistici che appaiono quasi istantaneamente e si affinano in tempo reale, invece di costringere gli utenti ad attendere che scaricamenti massicci si concludano.

In molti modi, le enormi richieste di risorse di sistemi di rendering generativi AI e assistiti da AI hanno riportato la prontezza per i consumatori indietro di vent’anni o più. Solo nel 2023, un’allocation di 64GB RAM in un laptop o un PC desktop sembrava eccessiva; ora, con la crescente popolarità di RAM e/o offloading CPU, 64GB è piuttosto modesto per le esigenze locali AI; e questi elementi un tempo banali e accessibili di PC continuano a aumentare di prezzo mentre le aziende lottano per soddisfare la domanda di servizi AI.

La scala e l’avidità di AI e dei suoi processi e ambienti di solito oscurano il hardware a livello di consumatore, e anche l’esecuzione di modelli ‘slim’ locali come versioni GGUF di solito mettono a dura prova il sistema medio.

Anche i servizi AI basati su testo come ChatGPT sono soggetti a notevoli sforzi sia a livello di client che di server. Pertanto, una volta che l’AI è incaricata di fornire esperienze multimediali online in tempo reale, possiamo ragionevolmente aspettarci alcuni compromessi molto gravi nella latenza e/o nella qualità – simili alle prime lotte di Internet con la trasmissione di media, e ai molto odiati icone di ‘buffering’ animati di RealPlayer e QuickTime.

L’ultima volta che problemi multimediali e di rete hanno creato attrito nell’esperienza dell’utente, il hardware a livello di consumatore stava ancora evolvendo attraverso la legge di Moore, migliorando quasi esponenzialmente ogni anno, anche mentre i sistemi operativi, le reti e altre infrastrutture di supporto evolvevano per soddisfare la domanda; e per gli ultimi dieci anni, più o meno, le capacità della tecnologia dei consumatori hanno superato le richieste multimediali (forse anche al punto in cui era necessario dare una spinta per mantenere le vendite).

Ma quel surplus di capacità locale potrebbe stare per finire presto, poiché il hardware locale diventa meno potente e più costoso, e poiché i servizi basati su AI richiedono risorse server-side e locali più elevate.

Ottenere un vantaggio

Tornando all’era pre-broadband, anche prima dei primi video di streaming utilizzabili, gli utenti web erano abituati a vedere immagini che si formavano lentamente, poiché i JPEG progressivi permettevano all’utente a corto di larghezza di banda di guardare l’immagine in fase di download, a volte in modo dolorosamente lento, poiché più dati dell’immagine venivano caricati localmente.

Ora, sembra, potremmo essere in forse di un’esperienza simile con gli avatar Gaussian Splat aiutati da AI:

Fare clic per riprodurre. Dal nuovo progetto ProgressiveAvatars, un confronto della trasmissione di avatar Gaussian. Fonte

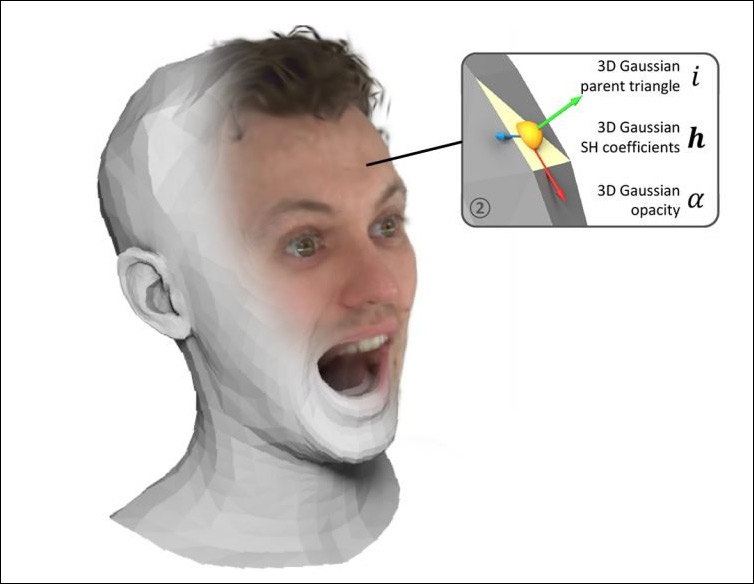

Sopra vediamo due versioni di un avatar Gaussian Splat (GSplat) – una rappresentazione umana abilitata parzialmente da una tecnica di rendering non-AI che risale ai primi anni ’90, e anche da metodi più moderni, come il modello parametrico umano FLAME, e approcci di formazione basati su AI:

Gaussian Splatting utilizza una rappresentazione gaussiana di colore e informazioni 3D al posto di un pixel o di un voxel, e mappa questa texture ultra-realistica su una mesh CGI tradizionale, che a sua volta è facilitata da un ‘umano parametrico’, un viso e/o corpo CGI, in sistemi come FLAME e STAR. Fonte

A sinistra nel video sopra possiamo vedere che un’implementazione tradizionale di un avatar Gaussian splat sembra piuttosto orribile mentre aspettiamo che i dati vengano caricati. A destra, una nuova implementazione dalla Cina, chiamata ProgressiveAvatars, è in grado di risolversi in modo molto più elegante mentre i dati vengono caricati, presentando un’immagine umana non allarmante fin dall’inizio.

Gli autori affermano che il loro metodo è il primo a trasmettere veramente un avatar Gaussian, e certamente il primo a farlo in modo progressivo, dove l’immagine si costruisce elegantemente, e le aree più importanti – come gli occhi e le labbra – possono essere priorizzate, in modo che l’avatar possa diventare conversazionale anche quando è solo parzialmente caricato:

Fare clic per riprodurre. Dal sito del progetto ProgressiveAvatars, un’illustrazione del caricamento consapevole dell’attenzione.

Prima di questo, un approccio ‘level of detail’ (LOD) è stato utilizzato in precedenti tentativi di ridurre ‘GSplat’ avatar, simili alle ottimizzazioni dei videogiochi, dove versioni sempre più dettagliate di una persona vengono caricate in base a quanto occupano il viewport o l’attenzione del viewer per valerne la pena.

Naturalmente, ciò comporta una quantità notevole di avatar ‘di riserva’ ridondanti, e gli autori presentano il loro approccio come un sistema più razionale. Per implicazione, un metodo di questo tipo consente anche di apportare modifiche a una figura GSplat (ad esempio, personalizzazioni) senza dover propagare tali modifiche attraverso una catena di ‘gemelli’ LOD diversi.

Un dominio emergente

Se questo sembra un problema di nicchia, beh, così sembrava anche la trasmissione video, ai tempi in cui ottenere i primi plugin funzionanti era affidato al nerd più vicino disponibile. Inoltre, il potenziale per rappresentazioni basate su AI e trasmissione va oltre gli avatar umani, estendendosi alla generazione di città, giochi, e versioni 3D di quasi ogni dominio online – come Virtual Try-On, per lo shopping di abbigliamento:

Fare clic per riprodurre. Dal progetto del 2024, uno sguardo approssimativo al futuro del ‘try-on’ online. Altri progetti cercano di aggiungere movimento e interattività – aspetti esigenti da trasmettere e gestire. Fonte

Proprio come gli approcci basati su LOD sono stati fino ad ora utilizzati principalmente dai videogiochi, molte altre considerazioni che erano un tempo appannaggio esclusivo dello sviluppo di giochi sono probabilmente destinate a trasferirsi nelle rappresentazioni basate su Splat. Ad esempio, la maggior parte di questi primi esordi GSplat raffigura un unico essere umano che fa smorfie e gesti, o forse parla; ma molte situazioni richiederanno più esseri umani, nonché caratteristiche ambientali e atmosfera – uno scenario in cui sistemi di ‘triage’ ad alte prestazioni determineranno dove i dati di trasmissione devono essere prioritizzati, al fine di mantenere lo spettatore nel momento.

Il nuovo articolo è intitolato ProgressiveAvatars: Progressive Animatable 3D Gaussian Avatars, e proviene da tre ricercatori dell’Università di Scienza e Tecnologia della Cina di Hefei.

Metodo

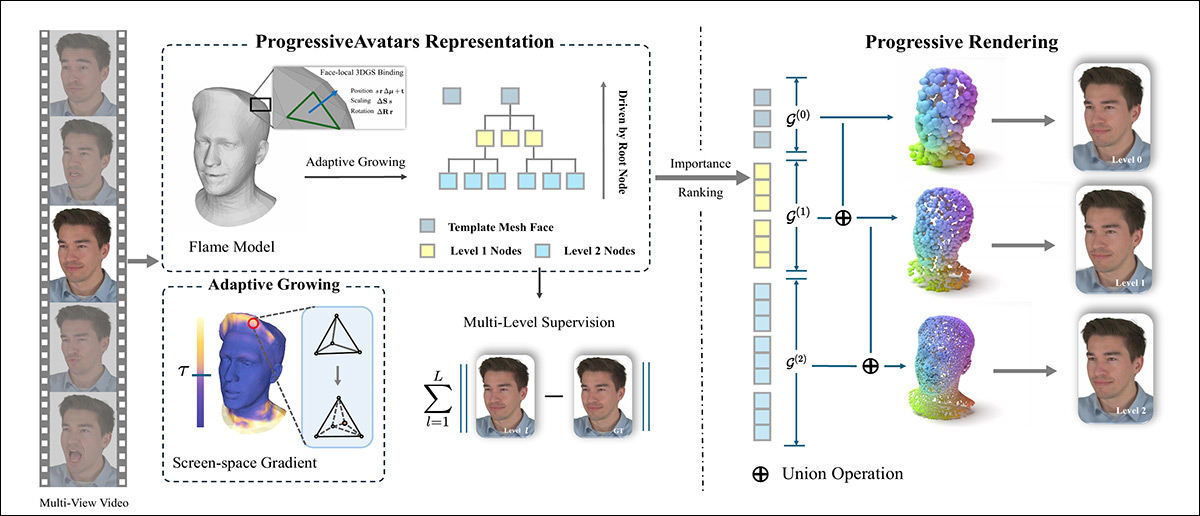

L’approccio inizialmente sfrutta un video della testa di una persona. Per ogni frame, un modello parametrico standard FLAME viene adattato, in modo che la forma e l’espressione cambino nel tempo, mentre la struttura della mesh di base rimane fissa. Poiché la topologia di base non cambia, un modello FLAME stabile può essere riutilizzato e raffinato invece di essere ricostruito da zero ogni momento, come avviene in lavori precedenti simili:

Il video della testa viene prima adattato con una mesh FLAME tracciata, dopo di che i Gaussiani 3D vengono attaccati a ogni faccia e crescono gerarchicamente dove i gradienti nello spazio schermo indicano dettagli mancanti. Durante l’addestramento, questa sottodivisione adattiva costruisce una rappresentazione a più livelli sotto la supervisione multi-vista, e al momento dell’inferenza, i punteggi di importanza per faccia determinano quali Gaussiani vengono trasmessi per primi, consentendo all’avatar di apparire rapidamente e di affinarsi progressivamente mentre vengono aggiunti livelli di dettaglio più elevati.

Sopra questa struttura di base, vengono aggiunti dettagli in strati; la superficie viene implicitamente suddivisa in una gerarchia, e piccoli Gaussiani tridimensionali vengono attaccati alle facce a ogni livello di dettaglio.

Sebbene i livelli iniziali più grossolani catturino la forma generale della testa e il movimento, i livelli successivi più fini forniscono rughe, deformazioni sottili e texture ad alta frequenza. Le immagini vengono quindi rese dai Gaussiani utilizzando un rasterizzatore gaussiano differenziabile e addestrato contro footage di verità fondamentale multi-vista, in modo che l’avatar impari a riprodurre l’aspetto della persona reale.

Durante l’addestramento, questa gerarchia cresce automaticamente: le aree che necessitano di più dettagli vengono suddivise ulteriormente, guidate da segnali nello spazio schermo, in modo che lo sforzo computazionale si concentri dove l’occhio dello spettatore è più probabile che noti errori.

Durante l’inferenza, questa stessa gerarchia consente la trasmissione progressiva, in cui una versione grezza di un avatar può essere visualizzata per prima, e, poiché vengono caricati ulteriori livelli, nuovi Gaussiani possono essere aggiunti senza alterare ciò che è già visualizzato, consentendo un avatar di testa animabile che appare rapidamente e diventa più nitido e dettagliato mentre arrivano più dati.

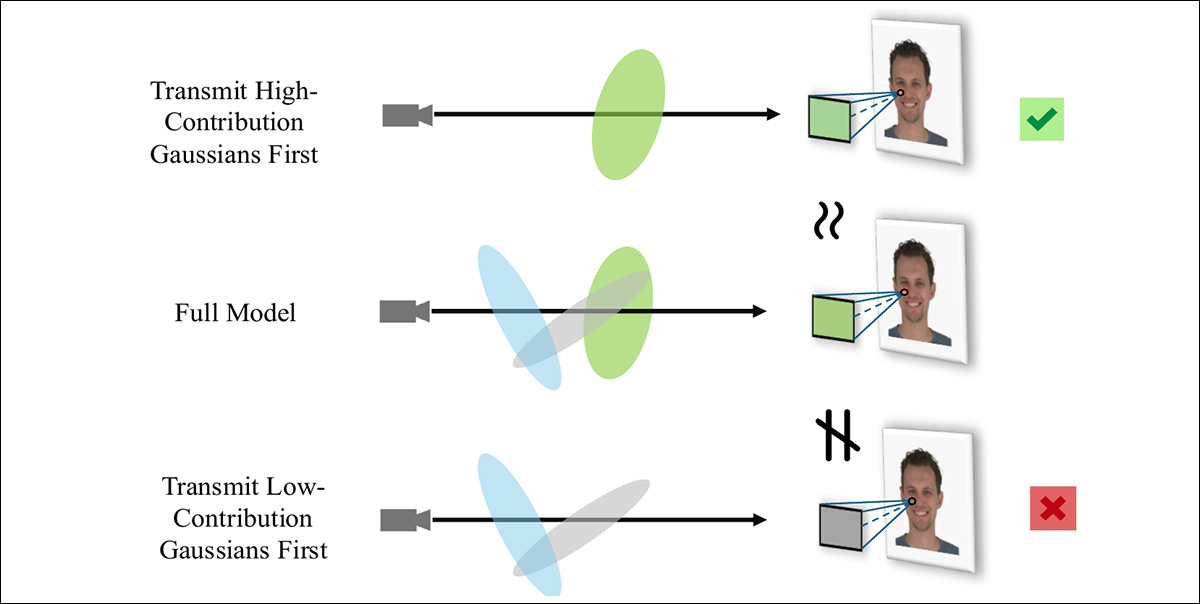

Gli autori osservano che l’intero sistema si basa sulla priorità dei dati in ingresso:

Quando tutti i Gaussiani a un determinato livello sono disponibili, il modello completo viene rendering con fedeltà massima; ma durante la trasmissione, l’invio dei Gaussiani con il contributo più elevato per primi consente ai risultati parziali precoci di corrispondere da vicino all’immagine finale, mentre la trasmissione dei Gaussiani a basso contributo per primi distorce l’equilibrio dei colori ed enfatizza componenti minori.

Dati e test

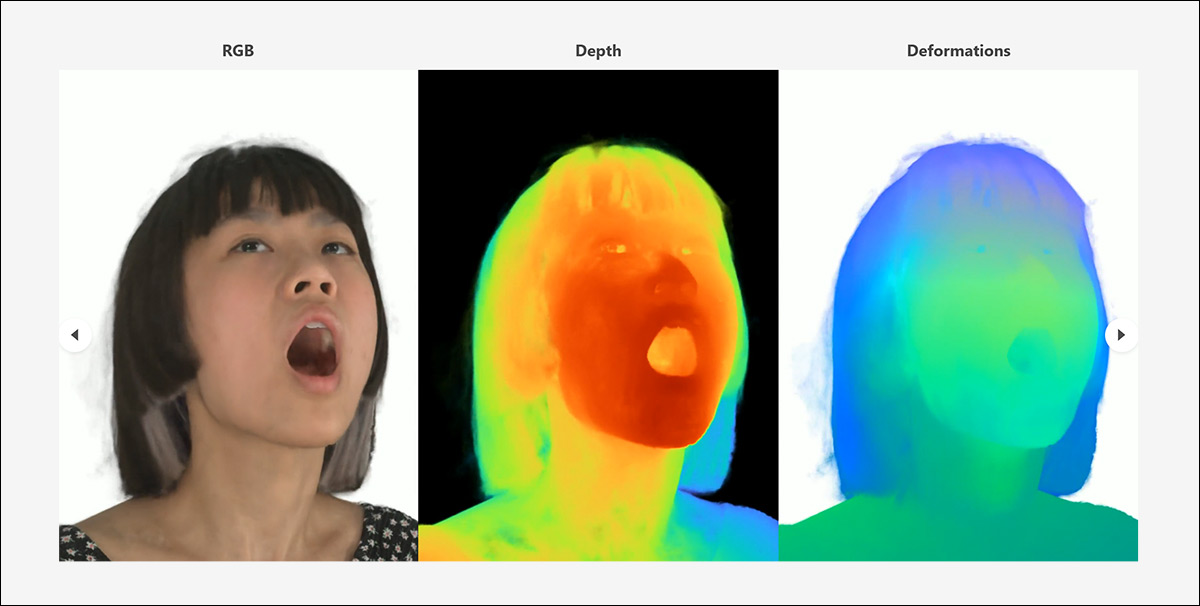

Per i test, il nuovo metodo è stato valutato sul set di dati NeRSemble, che consiste in video multi-vista per ogni soggetto coperto, con parametri calibrati in tutte le viste:

Esempi di interpretazioni diverse di soggetti inclusi nel set di dati NeRSemble utilizzato nei test per ProgressiveAvatars. Fonte

In linea con la metodologia originale GaussianAvatars, le immagini sono state ridimensionate a 802x550px e una maschera del primo piano è stata generata, e la divisione di addestramento/test originale del progetto è stata adottata.

L’ottimizzatore Adam è stato utilizzato per gli aggiornamenti dei parametri, con un tasso di apprendimento di 1×10-2 su tutte le coordinate baricentriche. L’addestramento è stato eseguito per 60.000 iterazioni, con la gerarchia automaticamente estesa ogni 2.000 iterazioni.

Inizialmente, gli autori hanno testato la ricostruzione e l’animazione – il compito di convertire un video piatto in un sistema 3D (x/y/x), utilizzando la rappresentazione CGI canonica di FLAME come mesh di ancoraggio. Per questo, tutte le linee di base sono state addestrate da zero, e i framework rivali testati sono stati il già menzionato GaussianAvatars, e PointAvatar.

Per questi test, le metriche utilizzate sono state Peak Signal-to-Noise Ratio (PSNR), Structural Similarity Index (SSIM), e Learned Perceptual Image Patch Similarity (LPIPS):

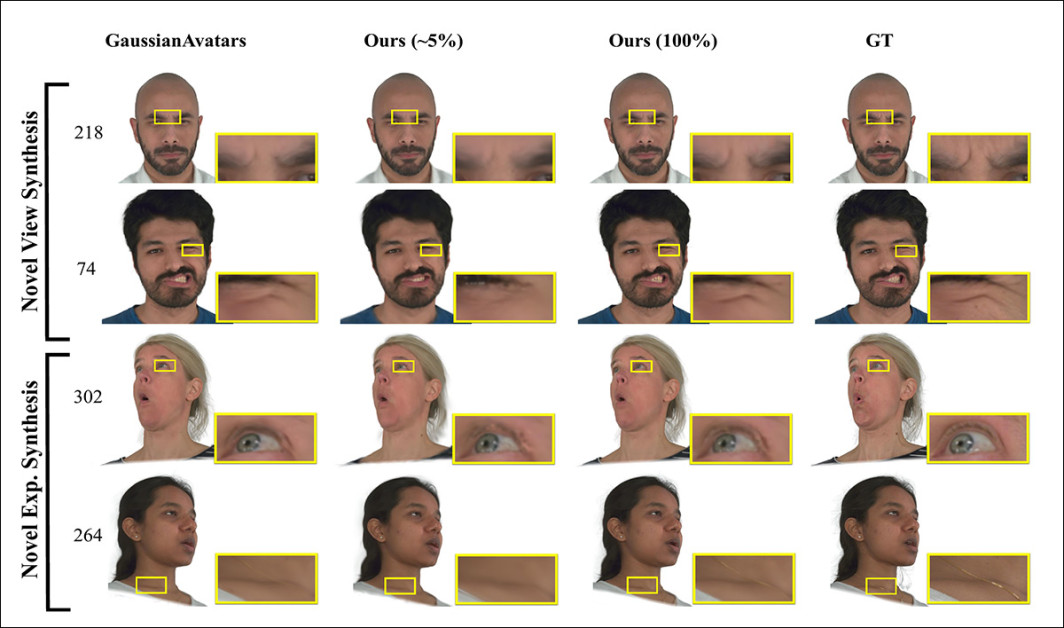

Confronto qualitativo sulla sintesi di vista e espressione nuove. La linea di base GaussianAvatars fatica con i dettagli fini intorno agli occhi, le rughe e la texture della pelle, mentre il metodo proposto conserva già la struttura facciale chiave a circa il 5% dei dati trasmessi e converge verso la verità di base mentre vengono trasmessi più Gaussiani, corrispondendo da vicino al modello completo e alle immagini di riferimento (verità di base).

Riguardo a questi risultati, gli autori affermano:

‘[Il nostro] metodo ricostruisce dettagli più nitidi in diverse aree, in particolare intorno al collo, alle spalle e ai vestiti. Queste aree sono relativamente tessellate in modo grossolano nel modello FLAME rispetto alle zone ad alta salienza facciale (ad esempio, la regione perioculare).

‘Di conseguenza, i metodi precedenti spesso assegnano troppi pochi Gaussiani 3D a queste aree per catturare fedelmente i loro dettagli a scala fine. Al contrario, la nostra strategia di crescita adattiva aumenta il numero di Gaussiani e raffina la gerarchia solo dove necessario, rendendo l’allocazione insensibile alla tessellazione non uniforme di FLAME.’

Gli autori notano inoltre che il loro approccio è pari ai metodi attuali, producendo un avatar funzionale con un modesto 5% di larghezza di banda:

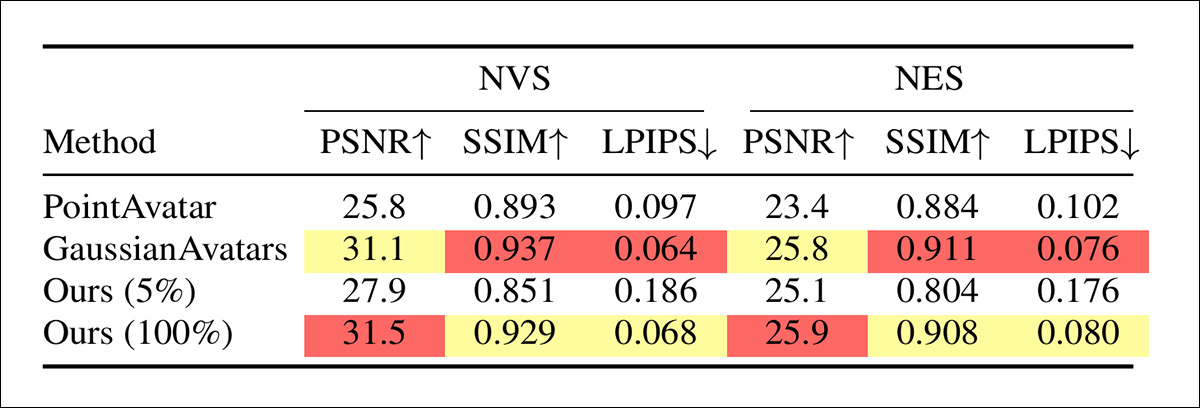

Confronto quantitativo sulla sintesi di vista e espressione nuove utilizzando PSNR, SSIM e LPIPS. Alla trasmissione completa, il metodo proposto raggiunge il PSNR più alto in entrambi i compiti e rimane competitivo con GaussianAvatars sulle metriche percettive, mentre l’impostazione del 5% illustra il compromesso di qualità sotto vincoli di larghezza di banda estremi.

Successivamente, i ricercatori hanno testato la rappresentazione progressiva stessa. Ciò è stato eseguito su un NVIDIA RTX 4090, con 24Gb di VRAM, a risoluzione 550x802px. In questo scenario, gli autori osservano che un budget del 25% utilizzerebbe tutti i Gaussiani di ‘livello 1’, nonché un subset di Gaussiani di livello 2, il che fornisce una visione d’insieme di come i gruppi di Gaussiani accumulino dettagli nei gruppi con numeri più alti, e di come i gruppi con numeri più bassi costruiscono essenzialmente la tela di base:

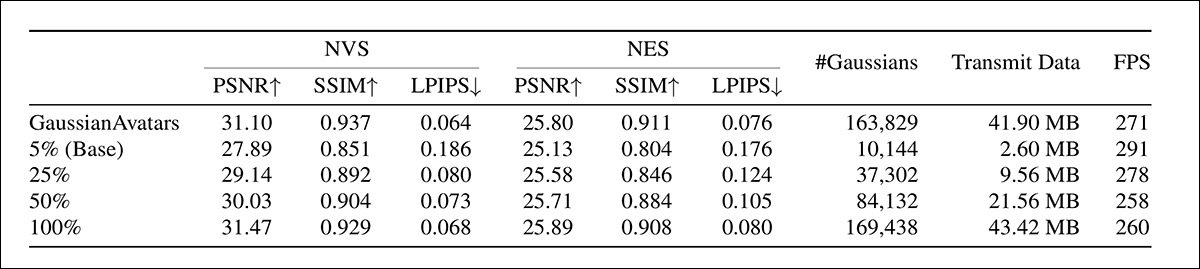

Prestazioni con diversi budget di trasmissione per la sintesi di vista e espressione nuove, mostrando che la qualità si avvicina costantemente o supera GaussianAvatars mentre vengono trasmessi più Gaussiani e dati, mantenendo velocità in tempo reale su un RTX 4090.

Gli autori commentano:

‘Con solo 2,60 MB trasmessi (5% di budget), l’avatar ha già raggiunto una qualità ragionevole. Mentre vengono trasmessi Gaussiani di livello più elevato, strutture fini come bottoni della camicia, denti e capelli si affinano gradualmente mentre si mantiene la stabilità temporale.

‘Alla trasmissione al 100%, il nostro approccio raggiunge una qualità di rendering paragonabile ai metodi attuali. Notiamo che le velocità dei frame non scendono significativamente, probabilmente perché il carico di lavoro 3DGS non ha ancora saturato la GPU.’

Tuttavia, gli autori osservano che in scenari di realtà virtuale multi-utente, il numero di Gaussiani 3D crescerebbe rapidamente al punto in cui la rasterizzazione della GPU diventerebbe un collo di bottiglia. In quei scenari più pesanti, l’approccio proposto offre un vantaggio consentendo al sistema di scambiare il numero di primitivi contro la qualità visiva, alleviando il carico senza far collassare il rendering.

Sebbene l’articolo non lo dettagli, il sito del progetto presenta ulteriori confronti di test, che includono anche il progetto MeGA ibrido mesh-Gaussian avatar:

Fare clic per riprodurre. Una delle serie di video supplementari dal sito del progetto dell’articolo, questo confronta il nuovo approccio in termini di sintesi di vista nuova.

Conclusione

Gaussian Splatting potrebbe o meno durare, o anche essere ricordato più di quanto RealPlayer non lo sia adesso, per quanto riguarda l’alba della trasmissione interattiva: esperienze rappresentative 3D guidate da AI, compresa la chat video, lo shopping virtuale, la navigazione di percorsi e diverse applicazioni di intrattenimento. Potrebbe essere che tecnologie o approcci alternativi vincono, o che GSplat si dimostri la rappresentazione video AI più affidabile.

Se non altro, questo interessante nuovo articolo annuncia un po’ dell’ambito di questo nuovo dominio, ricordandoci forse con nostalgia l’Internet a corto di larghezza di banda di un tempo.

* Con ‘3D’, non intendo l’esperienza che richiede occhiali speciali, ma piuttosto esperienze in cui il contenuto multimediale ha una certa comprensione delle coordinate X/Y/Z.

Pubblicato per la prima volta mercoledì 18 marzo 2026