Intelligenza artificiale

Diffusione Video Stabile: Modelli di Diffusione Video Latente per Grandi Set di Dati

Intelligenza Artificiale Generativa è stata una forza trainante nella comunità dell’IA da qualche tempo, e i progressi compiuti nel campo della modellazione di immagini generative, in particolare con l’uso di modelli di diffusione, hanno aiutato i modelli di video generativi a progredire significativamente non solo nella ricerca, ma anche in termini di applicazioni nel mondo reale. Convenzionalmente, i modelli di video generativi sono addestrati da zero o sono parzialmente o completamente adattati da modelli di immagini pre-addestrati con strati temporali aggiuntivi, su una miscela di set di dati di immagini e video.

Portando avanti i progressi nei modelli di video generativi, in questo articolo, parleremo del Modello di Diffusione Video Stabile, un modello di diffusione video latente in grado di generare contenuti di immagine a video e testo a video ad alta risoluzione e di stato dell’arte. Parleremo di come i modelli di diffusione latente addestrati per la sintesi di immagini 2D abbiano migliorato le capacità ed l’efficienza dei modelli di video generativi aggiungendo strati temporali e adattando i modelli su piccoli set di dati costituiti da video di alta qualità. Avremo un’analisi più approfondita dell’architettura e del funzionamento del Modello di Diffusione Video Stabile e valuteremo le sue prestazioni su vari metriche e le confronteremo con i framework attuali di stato dell’arte per la generazione di video. Quindi, iniziamo.

Modello di Diffusione Video Stabile e Modelli di Video Generativi: Un’introduzione

Grazie al suo potenziale quasi illimitato, l’Intelligenza Artificiale Generativa è stata l’oggetto principale di ricerca per i ricercatori di IA e ML da un po’ di tempo, e gli ultimi anni hanno visto rapidi progressi sia in termini di efficienza che di prestazioni dei modelli di immagini generative. Le conoscenze acquisite dai modelli di immagini generative hanno permesso ai ricercatori e agli sviluppatori di fare progressi sui modelli di video generativi, risultando in una maggiore praticità e applicazioni nel mondo reale. Tuttavia, la maggior parte della ricerca che tenta di migliorare le capacità dei modelli di video generativi si concentra principalmente sull’esatta disposizione degli strati temporali e spaziali, con poca attenzione dedicata a investigare l’influenza della selezione dei dati giusti sul risultato di questi modelli generativi.

Grazie ai progressi compiuti dai modelli di immagini generative, i ricercatori hanno osservato che l’impatto della distribuzione dei dati di addestramento sulle prestazioni dei modelli generativi è effettivamente significativo e indiscusso. Inoltre, i ricercatori hanno anche osservato che l’addestramento di un modello di immagine generativa su un set di dati grande e diversificato seguito da un adattamento su un set di dati più piccolo con una migliore qualità spesso risulta in un miglioramento significativo delle prestazioni. Tradizionalmente, i modelli di video generativi implementano le conoscenze acquisite dai modelli di immagini generative di successo, e i ricercatori non hanno ancora studiato l’effetto dei dati e le strategie di addestramento. Il Modello di Diffusione Video Stabile è un tentativo di migliorare le capacità dei modelli di video generativi esplorando territori inesplorati in precedenza, con un focus speciale sulla selezione dei dati.

I modelli di video generativi recenti si basano su modelli di diffusione e approcci di condizionamento testuale o di immagine per sintetizzare più frame di video o immagini coerenti. I modelli di diffusione sono noti per la loro capacità di apprendere come denoising gradualmente un campione da una distribuzione normale implementando un processo di raffinamento iterativo, e hanno fornito risultati desiderabili sulla sintesi di video ad alta risoluzione e testo-immagine. Utilizzando lo stesso principio alla sua base, il Modello di Diffusione Video Stabile addestra un modello di diffusione video latente sul suo set di dati video insieme all’uso di Reti Generative Avversarie (GAN) e anche modelli autoregressivi in una certa misura.

Il Modello di Diffusione Video Stabile segue una strategia unica mai implementata da nessun modello di video generativo, poiché si basa su baseline di diffusione video latente con un’architettura fissa e una strategia di addestramento fissa seguita dalla valutazione dell’effetto della cura dei dati. Il Modello di Diffusione Video Stabile mira a fare i seguenti contributi nel campo della modellazione di video generativi.

- Per presentare un flusso di lavoro di cura dei dati sistematico ed efficace nel tentativo di trasformare una grande raccolta di campioni di video non curati in un set di dati di alta qualità che viene poi utilizzato dai modelli di video generativi.

- Per addestrare modelli di immagine a video e testo a video di stato dell’arte che superano i framework esistenti.

- Per condurre esperimenti specifici del dominio per sondare la comprensione 3D e la forte priorità del moto del modello.

Ora, il Modello di Diffusione Video Stabile implementa le conoscenze acquisite dai Modelli di Diffusione Video Latente e dalle tecniche di cura dei dati al centro della sua fondazione.

Modelli di Diffusione Video Latente

I Modelli di Diffusione Video Latente o Video-LDM seguono l’approccio di addestrare il modello generativo principale in uno spazio latente con complessità computazionale ridotta, e la maggior parte dei Video-LDM implementa un modello di immagine-testo pre-addestrato accoppiato con l’aggiunta di strati di miscelazione temporale nell’architettura di pre-addestramento. Di conseguenza, la maggior parte dei Modelli di Diffusione Video Latente addestra solo gli strati temporali o salta il processo di addestramento, a differenza del Modello di Diffusione Video Stabile che adatta l’intero framework. Inoltre, per sintetizzare dati di testo a video, il Modello di Diffusione Video Stabile si condiziona direttamente su un prompt di testo, e i risultati indicano che il framework risultante può essere adattato in un modello di sintesi multi-vista o immagine-video facilmente.

Cura dei Dati

La cura dei dati è un componente essenziale non solo del Modello di Diffusione Video Stabile, ma anche per i modelli generativi nel loro complesso, poiché è essenziale pre-addestrare grandi modelli su grandi set di dati per aumentare le prestazioni in vari compiti, inclusa la modellazione del linguaggio, la generazione di testo-immagine discriminatoria e molto altro. La cura dei dati è stata implementata con successo sui modelli di immagini generative sfruttando le capacità di rappresentazioni di immagine-linguaggio efficienti, sebbene tali discussioni non si siano mai concentrate sullo sviluppo di modelli di video generativi. Ci sono diverse sfide che gli sviluppatori affrontano quando curano i dati per i modelli di video generativi, e per affrontare queste sfide, il Modello di Diffusione Video Stabile implementa una strategia di addestramento a tre fasi, risultando in risultati migliorati e un aumento significativo delle prestazioni.

Cura dei Dati per la Sintesi di Video di Alta Qualità

Come discusso nella sezione precedente, il Modello di Diffusione Video Stabile implementa una strategia di addestramento a tre fasi, risultando in risultati migliorati e un aumento significativo delle prestazioni. La Fase I è una fase di pre-addestramento di immagine che utilizza un modello di diffusione di immagine-testo 2D. La Fase II è per il pre-addestramento di video in cui il framework si addestra su una grande quantità di dati video. Infine, abbiamo la Fase III per il fine-tuning di video in cui il modello viene raffinato su un piccolo subset di video di alta qualità e alta risoluzione.

Tuttavia, prima che il Modello di Diffusione Video Stabile implementi queste tre fasi, è vitale elaborare e annotare i dati poiché serve come base per la Fase II o la fase di pre-addestramento di video, e gioca un ruolo critico nel garantire l’output ottimale. Per garantire la massima efficienza, il framework implementa inizialmente una pipeline di rilevamento di tagli concatenati a 3 livelli di FPS (Frame Per Second) variabili, e la necessità di questa pipeline è dimostrata nell’immagine seguente.

Successivamente, il Modello di Diffusione Video Stabile annota ogni clip di video utilizzando tre metodi di captioning sintetico variabili. La seguente tabella confronta i set di dati utilizzati nel Framework di Diffusione Stabile prima e dopo il processo di filtrazione.

Fase I: Pre-Addestramento di Immagine

La prima fase nella pipeline a tre fasi implementata nel Modello di Diffusione Video Stabile è il pre-addestramento di immagine, e per raggiungere ciò, il framework iniziale del Modello di Diffusione Video Stabile si basa su un modello di diffusione di immagine pre-addestrato, ovvero il modello Stable Diffusion 2.1, che lo equipaggia con rappresentazioni visive più forti.

Fase II: Pre-Addestramento di Video

La seconda fase è la Fase di Pre-Addestramento di Video, e si basa sui risultati che l’uso della cura dei dati nei modelli di immagine generativa multimodale spesso risulta in risultati migliori e in un’efficienza maggiore, insieme a una generazione di immagine discriminatoria potente. Tuttavia, a causa della mancanza di rappresentazioni potenti e pronte all’uso per filtrare campioni indesiderati per i modelli di video generativi, il Modello di Diffusione Video Stabile si basa sui segnali di input delle preferenze umane per la creazione di un set di dati appropriato utilizzato per il pre-addestramento del framework.

Per essere più specifici, il framework utilizza metodi diversi per curare subset di Diffusione Video Latente e considera il ranking dei modelli LVD addestrati su questi set di dati. Inoltre, il framework del Modello di Diffusione Video Stabile trova che l’uso di set di dati curati per l’addestramento dei framework aiuta a migliorare le prestazioni del framework e dei modelli di diffusione in generale. Inoltre, la strategia di cura dei dati funziona anche su set di dati più grandi, più rilevanti e più pratici.

Fase III: Fine-Tuning di Alta Qualità

Fino alla Fase II, il framework del Modello di Diffusione Video Stabile si concentra sul miglioramento delle prestazioni prima del pre-addestramento di video, e nella terza fase, il framework si concentra sull’ottimizzazione o sul miglioramento ulteriore delle prestazioni del framework dopo il fine-tuning di video di alta qualità, e su come il passaggio dalla Fase II alla Fase III viene raggiunto nel framework.

Risultati e Scoperte

È il momento di dare uno sguardo a come il framework del Modello di Diffusione Video Stabile si esegue su compiti del mondo reale e come si confronta con i framework attuali di stato dell’arte. Il framework del Modello di Diffusione Video Stabile utilizza l’approccio dei dati ottimali per addestrare un modello di base e poi esegue il fine-tuning per generare diversi modelli di stato dell’arte, ognuno dei quali esegue un compito specifico.

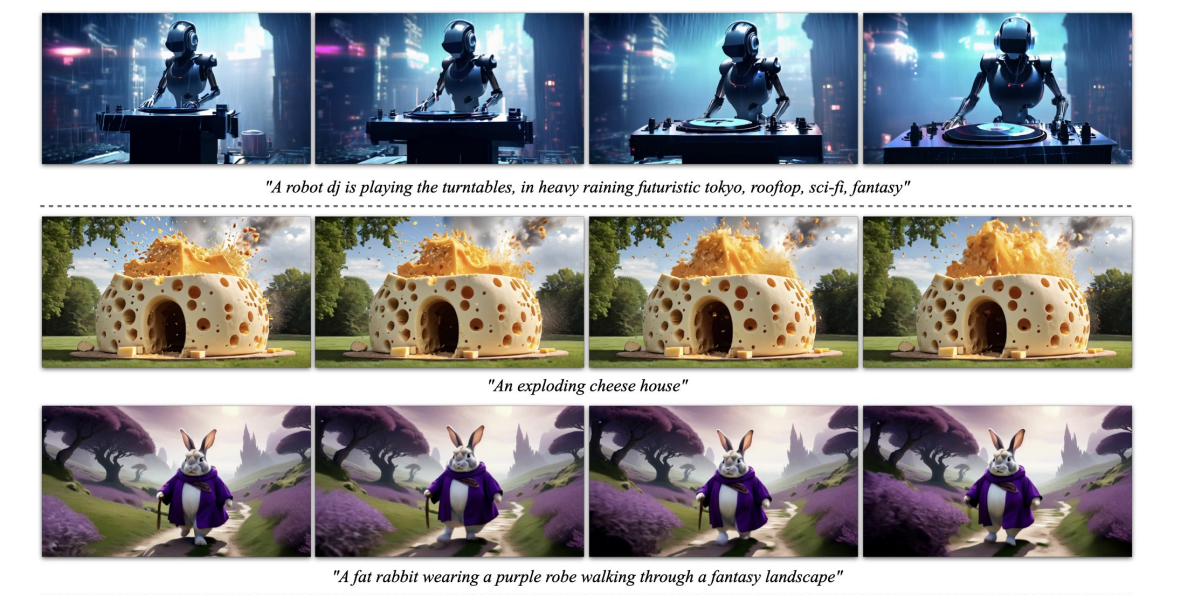

L’immagine sopra rappresenta i campioni di immagine a video ad alta risoluzione generati dal framework, mentre la figura seguente dimostra la capacità del framework di generare campioni di testo a video di alta qualità.

Modello di Base Pre-Addestrato

Come discusso in precedenza, il modello del Modello di Diffusione Video Stabile si basa sul framework di Stable Diffusion 2.1, e sulla base delle scoperte recenti, era cruciale per gli sviluppatori adottare la programmazione del rumore e aumentare il rumore per ottenere immagini con una migliore risoluzione durante l’addestramento dei modelli di diffusione di immagine. Grazie a questo approccio, il modello di base del Modello di Diffusione Video Stabile apprende rappresentazioni di moto potenti e, nel processo, supera i modelli di base per la generazione di video testo in un ambiente zero-shot, e i risultati sono visualizzati nella tabella seguente.

Interpolazione di Frame e Generazione Multi-Vista

Il framework del Modello di Diffusione Video Stabile adatta il modello di immagine a video su set di dati multi-vista per ottenere più viste nuove di un oggetto, e questo modello è noto come SVD-MV o Modello di Diffusione Video Stabile-Multi-Vista. Il modello SVD originale viene adattato con l’aiuto di due set di dati in un modo tale che il framework inserisca una singola immagine e restituisca una sequenza di immagini multi-vista come output.

Come si può vedere nelle immagini seguenti, il framework del Modello di Diffusione Video Stabile-Multi-Vista consegna prestazioni ad alta qualità paragonabili ai framework di stato dell’arte Scratch Multi-Vista, e i risultati sono una chiara dimostrazione della capacità di SVD-MV di sfruttare le conoscenze acquisite dal modello SVD originale per la generazione di immagini multi-vista. Inoltre, i risultati indicano anche che eseguire il modello per un numero relativamente piccolo di iterazioni aiuta a consegnare risultati ottimali, come nel caso della maggior parte dei modelli adattati dal framework SVD.

Nell’immagine sopra, le metriche sono indicate sul lato sinistro e, come si può vedere, il framework del Modello di Diffusione Video Stabile-Multi-Vista supera Scratch-MV e SD2.1 Multi-Vista framework di un margine decente. La seconda immagine dimostra l’effetto del numero di iterazioni di addestramento sulle prestazioni generali del framework in termini di punteggio Clip, e i framework SVD-MV consegnano risultati sostenibili.

Pensieri Finali

In questo articolo, abbiamo parlato del Modello di Diffusione Video Stabile, un modello di diffusione video latente in grado di generare contenuti di immagine a video e testo a video ad alta risoluzione e di stato dell’arte. Il Modello di Diffusione Video Stabile segue una strategia unica mai implementata da nessun modello di video generativo, poiché si basa su baseline di diffusione video latente con un’architettura fissa e una strategia di addestramento fissa seguita dalla valutazione dell’effetto della cura dei dati.

Abbiamo parlato di come i modelli di diffusione latente addestrati per la sintesi di immagini 2D abbiano migliorato le capacità e l’efficienza dei modelli di video generativi aggiungendo strati temporali e adattando i modelli su piccoli set di dati costituiti da video di alta qualità. Per raccogliere i dati di pre-addestramento, il framework esegue uno studio di scalabilità e segue pratiche di raccolta di dati sistematiche, e alla fine propone un metodo per curare una grande quantità di dati video e convertire video rumorosi in dati di input adatti per i modelli di video generativi.

Inoltre, il framework del Modello di Diffusione Video Stabile impiega tre fasi di addestramento di modelli di video distinti che vengono analizzati indipendentemente per valutare il loro impatto sulle prestazioni del framework. Il framework alla fine produce una rappresentazione di video abbastanza potente da adattare i modelli per la sintesi di video ottimale, e i risultati sono paragonabili ai modelli di generazione di video di stato dell’arte già in uso.