Robotica

Come i robot stanno imparando a chiedere aiuto

Nel mondo in evoluzione della robotica, una collaborazione innovativa tra l’Università di Princeton e Google si distingue. Gli ingegneri di queste prestigiose istituzioni hanno sviluppato un metodo innovativo che insegna ai robot una capacità cruciale: riconoscere quando hanno bisogno di aiuto e come chiederlo. Questo sviluppo segna un balzo significativo in avanti nella robotica, colmando il divario tra il funzionamento autonomo e l’interazione uomo-robot.

Il percorso verso robot più intelligenti e indipendenti è sempre stato ostacolato da una sfida significativa: la complessità e l’ambiguità del linguaggio umano. A differenza della chiarezza binaria dei codici del computer, il linguaggio umano è pieno di sfumature e sottigliezze, rendendolo un labirinto per i robot. Ad esempio, un comando semplice come “prendi il contenitore” può diventare un compito complesso quando sono presenti più contenitori. I robot, equipaggiati per percepire l’ambiente e rispondere al linguaggio, spesso si trovano a un bivio quando si confrontano con tali incertezze linguistiche.

Quantificazione dell’incertezza

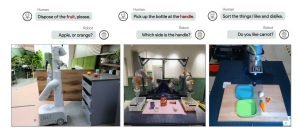

Affrontando questa sfida, il team di Princeton e Google ha introdotto un approccio innovativo che quantifica la “sfumatura” del linguaggio umano. Questa tecnica misura essenzialmente il livello di incertezza nei comandi linguistici e utilizza questa metrica per guidare le azioni del robot. In situazioni in cui un comando potrebbe portare a molteplici interpretazioni, il robot può ora valutare il livello di incertezza e decidere quando cercare ulteriore chiarificazione. Ad esempio, in un ambiente con più contenitori, un livello di incertezza più alto indurrebbe il robot a chiedere quale contenitore prendere, evitando così potenziali errori o inefficienze.

Questo approccio non solo consente ai robot di comprendere meglio il linguaggio, ma migliora anche la loro sicurezza e efficienza nell’esecuzione dei compiti. Integrando grandi modelli linguistici (LLM) come quelli dietro ChatGPT, i ricercatori hanno fatto un passo significativo nell’allineare le azioni robotiche più da vicino alle aspettative e alle esigenze umane.

Ruolo dei grandi modelli linguistici

L’integrazione degli LLM gioca un ruolo cruciale in questo nuovo approccio. Gli LLM sono strumentali nell’elaborazione e nell’interpretazione del linguaggio umano. In questo contesto, vengono utilizzati per valutare e misurare l’incertezza presente nei comandi linguistici dati ai robot.

Tuttavia, la dipendenza dagli LLM non è senza sfide. Come sottolineato dal team di ricerca, i risultati degli LLM possono essere a volte inaffidabili.

Anirudha Majumdar, professore assistente a Princeton, sottolinea l’importanza di questo equilibrio:

“Seguire ciecamente i piani generati da un LLM potrebbe causare ai robot di agire in modo insicuro o poco affidabile, quindi abbiamo bisogno che i nostri robot basati su LLM sappiano quando non sanno.”

Ciò evidenzia la necessità di un approccio sfumato, in cui gli LLM vengono utilizzati come strumenti di guida piuttosto che come decisori infallibili.

Applicazione pratica e testing

La praticità di questo metodo è stata testata in vari scenari, illustrando la sua versatilità e efficacia. Uno di questi test ha coinvolto un braccio robotico, incaricato di ordinare articoli di cibo giocattolo in diverse categorie. Questa semplice impostazione ha dimostrato la capacità del robot di navigare compiti con scelte ben definite in modo efficace.

Immagine: Princeton University

La complessità è aumentata notevolmente in un altro esperimento che ha coinvolto un braccio robotico montato su una piattaforma su ruote in una cucina ufficio. Qui, il robot ha affrontato sfide del mondo reale come l’identificazione del giusto articolo da inserire nel forno a microonde quando presentato con più opzioni.

Attraverso questi test, i robot hanno dimostrato con successo la loro capacità di utilizzare l’incertezza quantificata per prendere decisioni o cercare chiarificazione, convalidando così l’utilità pratica di questo metodo.

Implicazioni future e ricerca

Guardando avanti, le implicazioni di questa ricerca si estendono ben oltre le attuali applicazioni. Il team, guidato da Majumdar e dallo studente di dottorato Allen Ren, sta esplorando come questo approccio possa essere applicato a problemi più complessi nella percezione del robot e nell’IA. Ciò include scenari in cui i robot devono combinare informazioni visive e linguistiche per prendere decisioni, ulteriormente riducendo il divario tra la comprensione robotica e l’interazione umana.

La ricerca in corso mira non solo a migliorare la capacità dei robot di eseguire compiti con maggiore precisione, ma anche a navigare il mondo con una comprensione simile alla cognizione umana. Questa ricerca potrebbe aprire la strada a robot non solo più efficienti e sicuri, ma anche più in sintonia con le esigenze sfumate degli ambienti umani.

Puoi trovare la ricerca pubblicata qui.