L'angolo di Anderson

Correggere la limitata comprensione degli specchi e dei riflessi nei modelli di diffusione

Da quando l’intelligenza artificiale generativa ha iniziato a suscitare interesse pubblico, il campo di ricerca sulla visione artificiale ha approfondito il suo interesse nello sviluppo di modelli di intelligenza artificiale in grado di comprendere e replicare le leggi fisiche; tuttavia, la sfida di insegnare ai sistemi di apprendimento automatico a simulare fenomeni come la gravità e dinamica dei liquidi è stato un obiettivo significativo degli sforzi di ricerca per almeno il ultimi cinque anni.

Dal modelli di diffusione latente (LDM) hanno dominato la scena dell'intelligenza artificiale generativa nel 2022, secondo i ricercatori sempre più focalizzato sulla limitata capacità dell'architettura LDM di comprendere e riprodurre i fenomeni fisici. Ora, questo problema ha acquisito ulteriore importanza con lo sviluppo epocale del modello video generativo di OpenAI. sora, e la recente (probabilmente) più importante versione open source video modelli Video di Hunyuan e 2.1 anni.

Riflettendo male

La maggior parte della ricerca volta a migliorare la comprensione della fisica da parte dei LDM si è concentrata su aree come la simulazione dell'andatura, la fisica delle particelle e altri aspetti del moto newtoniano. Questi ambiti hanno attirato l'attenzione perché imprecisioni nei comportamenti fisici di base comprometterebbero immediatamente l'autenticità dei video generati dall'intelligenza artificiale.

Tuttavia, un piccolo ma crescente filone di ricerca si concentra su una delle più grandi debolezze dell'LDM: è relativa incapacità per produrre accurati riflessioni.

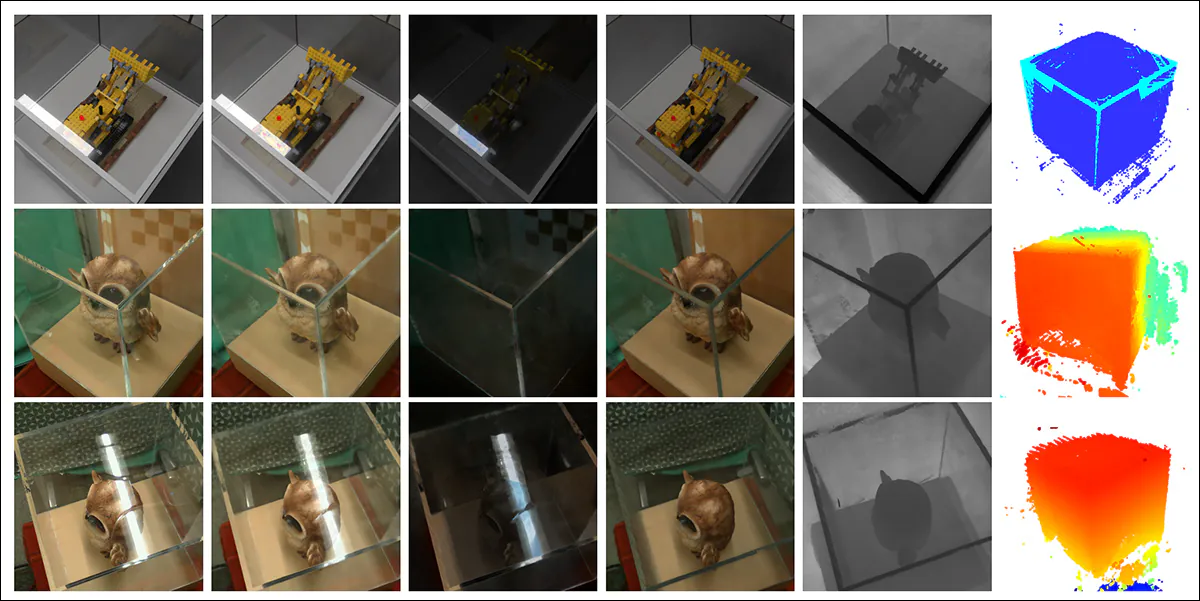

Dall'articolo di gennaio 2025 "Riflettere la realtà: abilitare i modelli di diffusione per produrre riflessi speculari fedeli", esempi di "fallimento della riflessione" a confronto con l'approccio dei ricercatori. Fonte: https://arxiv.org/pdf/2409.14677

Questo problema è stato una sfida anche durante l'era della CGI e rimane tale nel campo dei videogiochi, dove ray tracing Gli algoritmi simulano il percorso della luce mentre interagisce con le superfici. Il ray-tracing calcola come i raggi di luce virtuali rimbalzano sugli oggetti o li attraversano per creare riflessi, rifrazioni e ombre realistici.

Tuttavia, poiché ogni rimbalzo aggiuntivo aumenta notevolmente i costi di elaborazione, le applicazioni in tempo reale devono bilanciare la latenza con la precisione, limitando il numero di rimbalzi di raggi luminosi consentiti.

![Una rappresentazione di un fascio di luce calcolato virtualmente in uno scenario tradizionale basato su 3D (ad esempio, CGI), utilizzando tecnologie e principi sviluppati per la prima volta negli anni '1960 e che hanno raggiunto il fulmine tra il 1982 e il 93 (il periodo tra Tron [1982] e Jurassic Park [1993]. Fonte: https://www.unrealengine.com/en-US/explainers/ray-tracing/what-is-real-time-ray-tracing](https://www.unite.ai/wp-content/uploads/2025/04/ray-tracing.jpg)

Una rappresentazione di un fascio di luce calcolato virtualmente in uno scenario tradizionale basato su 3D (ad esempio, CGI), utilizzando tecnologie e principi sviluppati per la prima volta negli anni '1960 e che hanno raggiunto il loro fulmine tra il 1982 e il 93 (il periodo tra 'Tron' [1982] e 'Jurassic Park' [1993]. Fonte: https://www.unrealengine.com/en-US/explainers/ray-tracing/what-is-real-time-ray-tracing

Ad esempio, raffigurare una teiera cromata davanti a uno specchio potrebbe comportare un processo di ray tracing in cui i raggi luminosi rimbalzano ripetutamente tra superfici riflettenti, creando un ciclo pressoché infinito con scarsi benefici pratici per l'immagine finale. Nella maggior parte dei casi, una profondità di riflessione di due o tre rimbalzi supera già di per sé la percezione dell'osservatore. Un singolo rimbalzo darebbe origine a uno specchio nero, poiché la luce deve completare almeno due viaggi per formare un riflesso visibile.

Ogni rimbalzo aggiuntivo aumenta notevolmente i costi computazionali, spesso raddoppiando i tempi di rendering, rendendo più rapida la gestione dei riflessi una delle opportunità più significative per migliorare la qualità del rendering ray-tracing.

Naturalmente, i riflessi si verificano e sono essenziali per il fotorealismo anche in scenari molto meno ovvi, come la superficie riflettente di una strada cittadina o di un campo di battaglia dopo la pioggia; il riflesso della strada opposta in una vetrina o in una porta a vetri; o negli occhiali dei personaggi raffigurati, dove potrebbe essere necessario che appaiano oggetti e ambienti.

Una riflessione gemella simulata ottenuta tramite compositing tradizionale per una scena iconica di "Matrix" (1999).

Problemi di immagine

Per questo motivo, i framework che erano popolari prima dell'avvento dei modelli di diffusione, come Campi di radianza neurale (NeRF) e alcuni sfidanti più recenti come Splatting gaussiano hanno mantenuto le proprie lotte per realizzare i riflessi in modo naturale.

Migliori REF2-NeRF Il progetto (illustrato sotto) ha proposto un metodo di modellazione basato su NeRF per scene contenenti una teca di vetro. In questo metodo, la rifrazione e la riflessione sono state modellate utilizzando elementi dipendenti e indipendenti dalla prospettiva dell'osservatore. Questo approccio ha permesso ai ricercatori di stimare le superfici in cui si è verificata la rifrazione, in particolare le superfici di vetro, e ha permesso la separazione e la modellazione delle componenti luminose dirette e riflesse.

Esempi dal documento Ref2Nerf. Fonte: https://arxiv.org/pdf/2311.17116

Altre soluzioni di riflessione rivolte a NeRF degli ultimi 4-5 anni hanno incluso NeRFReN, Riflettere la realtàe Meta del 2024 Campi di radianza neurale consapevoli della riflessione planare progetto.

Per GSplat, documenti come Mirror-3DGS, Splatting gaussiano riflettentee RefGaussian hanno offerto soluzioni riguardo al problema della riflessione, mentre il 2023 Progetto Nero ha proposto un metodo su misura per incorporare qualità riflessive nelle rappresentazioni neurali.

MirrorVerse

Ottenere che un modello di diffusione rispetti la logica di riflessione è probabilmente più difficile rispetto ad approcci esplicitamente strutturali e non semantici come il Gaussian Splatting e NeRF. Nei modelli di diffusione, una regola di questo tipo ha probabilità di essere integrata in modo affidabile solo se i dati di training contengono molti esempi diversificati in un'ampia gamma di scenari, il che la rende fortemente dipendente dalla distribuzione e dalla qualità del dataset originale.

Tradizionalmente, l'aggiunta di comportamenti particolari di questo tipo è di competenza di un LORA oppure ritocchi del modello base; ma queste non sono soluzioni ideali, poiché un LoRA tende a distorcere l'output verso i propri dati di addestramento, anche senza richiesta, mentre le regolazioni fini, oltre ad essere costose, possono biforcare un modello principale in modo irrevocabile dal mainstream e generare una serie di strumenti personalizzati correlati che non funzioneranno mai con nessuno Altri ceppo del modello, compreso quello originale.

In generale, il miglioramento dei modelli di diffusione richiede che i dati di training prestino maggiore attenzione alla fisica della riflessione. Tuttavia, anche molti altri ambiti necessitano di un'analoga attenzione. Nel contesto dei dataset iperscalari, dove la cura personalizzata è costosa e difficile, affrontare ogni singola debolezza in questo modo è impraticabile.

Tuttavia, soluzioni al problema della riflessione LDM emergono di tanto in tanto. Un recente tentativo di questo tipo, proveniente dall'India, è l' MirrorVerse progetto che offre un set di dati migliorato e un metodo di formazione in grado di elevare lo stato dell'arte in questa particolare sfida nella ricerca sulla diffusione.

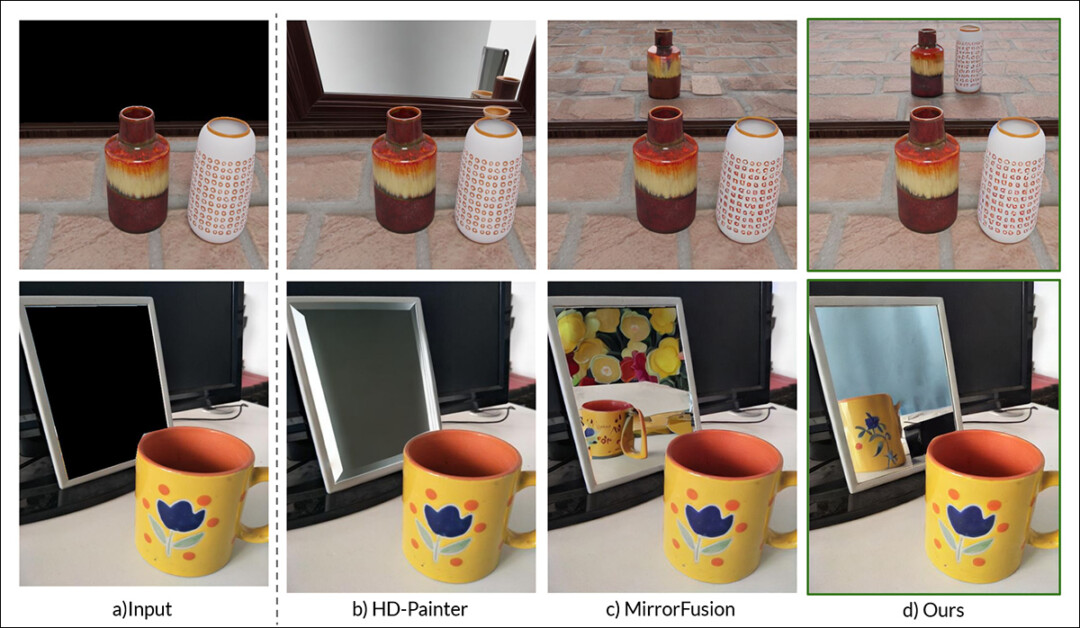

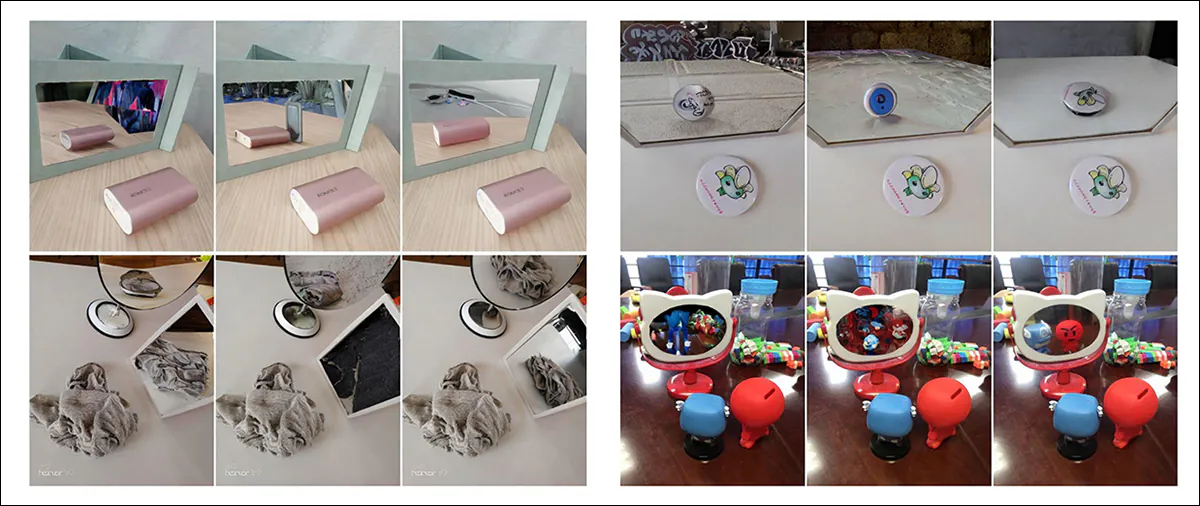

Più a destra, i risultati di MirrorVerse sono stati messi a confronto con due approcci precedenti (due colonne centrali). Fonte: https://arxiv.org/pdf/2504.15397

Come possiamo vedere nell'esempio sopra (l'immagine principale nel PDF del nuovo studio), MirrorVerse migliora le recenti proposte che affrontano lo stesso problema, ma è ben lungi dall'essere perfetto.

Nell'immagine in alto a destra, vediamo che i barattoli di ceramica sono leggermente a destra di dove dovrebbero essere e nell'immagine sottostante, che tecnicamente non dovrebbe mostrare alcun riflesso della tazza, un riflesso impreciso è stato inserito nell'area di destra, contro la logica degli angoli di riflessione naturali.

Pertanto daremo un'occhiata al nuovo metodo non tanto perché potrebbe rappresentare lo stato dell'arte attuale nella riflessione basata sulla diffusione, ma anche per illustrare la misura in cui questo potrebbe rivelarsi un problema irrisolvibile per i modelli di diffusione latente, statici e video, poiché è molto probabile che gli esempi di dati necessari di riflettività siano correlati ad azioni e scenari particolari.

Pertanto questa particolare funzione degli LDM potrebbe continuare a rivelarsi carente rispetto agli approcci specifici della struttura quali NeRF, GSplat e anche la CGI tradizionale.

Migliori nuovo documento è intitolato MirrorVerse: spingere i modelli di diffusione per riflettere realisticamente il mondoe proviene da tre ricercatori del Vision and AI Lab, dell'IISc di Bangalore e del Samsung R&D Institute di Bangalore. Il documento ha un pagina del progetto associata, così come a set di dati su Hugging Face, con codice sorgente rilasciato su GitHub.

Metodo

I ricercatori notano fin dall'inizio la difficoltà che modelli come Stable Diffusion e Flusso avere nel rispettare gli spunti basati sulla riflessione, illustrando abilmente la questione:

Dall'articolo: Gli attuali modelli di conversione testo-immagine all'avanguardia, SD3.5 e Flux, presentano notevoli difficoltà nel produrre riflessioni coerenti e geometricamente accurate quando si richiede di generarle in una scena.

I ricercatori hanno sviluppato MirrorFusion 2.0, un modello generativo basato sulla diffusione, volto a migliorare il fotorealismo e l'accuratezza geometrica dei riflessi speculari nelle immagini sintetiche. L'addestramento del modello si è basato sul nuovo set di dati curato dai ricercatori, intitolato MirrorGen2, progettato per affrontare il generalizzazione debolezze osservate negli approcci precedenti.

MirrorGen2 amplia le metodologie precedenti introducendo posizionamento casuale degli oggetti, rotazioni randomizzatee messa a terra esplicita dell'oggetto, con l'obiettivo di garantire che i riflessi rimangano plausibili su una gamma più ampia di pose e posizionamenti degli oggetti rispetto alla superficie dello specchio.

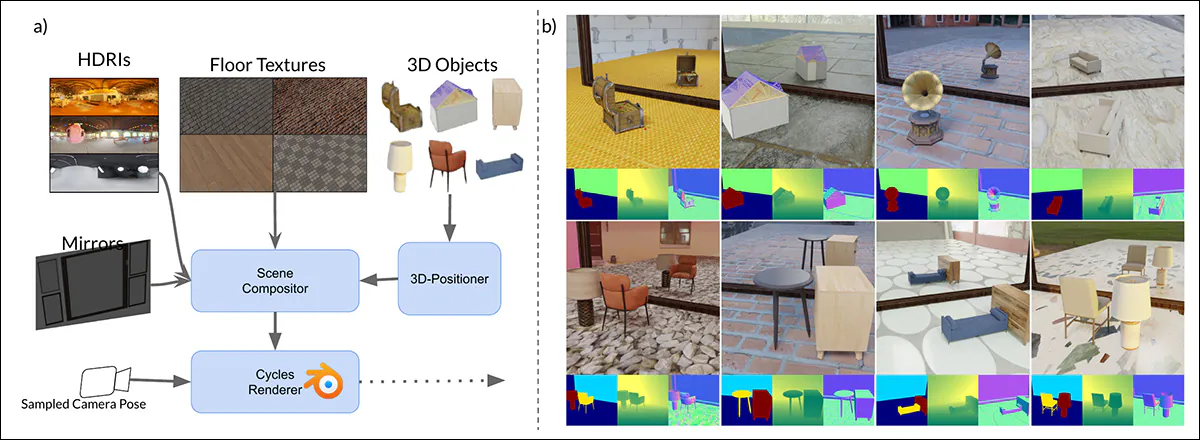

Schema per la generazione di dati sintetici in MirrorVerse: la pipeline di generazione del dataset ha applicato miglioramenti chiave posizionando, ruotando e ancorando casualmente gli oggetti all'interno della scena utilizzando il 3D-Positioner. Gli oggetti vengono inoltre abbinati in combinazioni semanticamente coerenti per simulare complesse relazioni spaziali e occlusioni, consentendo al dataset di catturare interazioni più realistiche in scene multi-oggetto.

Per rafforzare ulteriormente la capacità del modello di gestire complesse disposizioni spaziali, la pipeline MirrorGen2 incorpora accoppiato scene di oggetti, consentendo al sistema di rappresentare meglio le occlusioni e le interazioni tra più elementi in contesti riflettenti.

Il documento afferma:

"Le categorie vengono abbinate manualmente per garantire coerenza semantica, ad esempio abbinando una sedia a un tavolo. Durante il rendering, dopo aver posizionato e ruotato l'oggetto primario, un ulteriore oggetto della categoria abbinata viene campionato e disposto per evitare sovrapposizioni, garantendo regioni spaziali distinte all'interno della scena."

Per quanto riguarda il grounding esplicito degli oggetti, qui gli autori hanno fatto in modo che gli oggetti generati fossero "ancorati" al terreno nei dati sintetici di output, anziché "sospesi" in modo inappropriato, cosa che può accadere quando i dati sintetici vengono generati su larga scala o con metodi altamente automatizzati.

Poiché l'innovazione del set di dati è fondamentale per la novità del documento, procederemo prima del solito con questa sezione dell'articolo.

Dati e test

SynMirrorV2

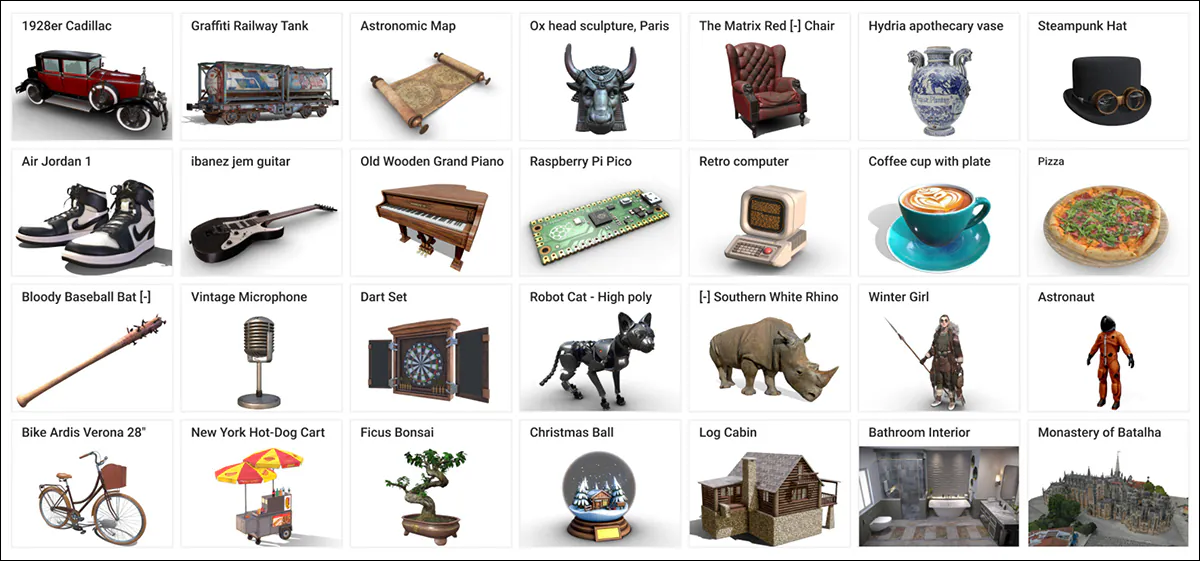

Il set di dati SynMirrorV2 dei ricercatori è stato concepito per migliorare la diversità e il realismo dei dati di addestramento alla riflessione speculare, con oggetti 3D provenienti da Obiettivo e Oggetti di Amazon Berkeley (ABO) set di dati, con queste selezioni successivamente perfezionate attraverso OGGETTO 3DIT, così come il processo di filtraggio dal V1 Progetto MirrorFusion, per eliminare gli asset di bassa qualità. Il risultato è stato un pool raffinato di 66,062 oggetti.

Esempi dal dataset Objaverse, utilizzati nella creazione del dataset curato per il nuovo sistema. Fonte: https://arxiv.org/pdf/2212.08051

La costruzione della scena ha comportato il posizionamento di questi oggetti su pavimenti strutturati da CC-Textures e sfondi HDRI dal PolyHaven Archivio CGI, utilizzando specchi a parete intera o rettangolari alti. L'illuminazione è stata standardizzata con una luce di area posizionata sopra e dietro gli oggetti, con un'angolazione di 45 gradi. Gli oggetti sono stati ridimensionati per adattarsi a un cubo unitario e posizionati utilizzando un'intersezione precalcolata tra lo specchio e la visuale della telecamera. tronchi, garantendo visibilità.

Sono state applicate rotazioni randomizzate attorno all'asse y ed è stata utilizzata una tecnica di messa a terra per evitare "artefatti fluttuanti".

Per simulare scene più complesse, il set di dati ha incorporato anche più oggetti disposti secondo coppie semanticamente coerenti basate sulle categorie ABO. Gli oggetti secondari sono stati posizionati per evitare sovrapposizioni, creando 3,140 scene multi-oggetto progettate per catturare diverse occlusioni e relazioni di profondità.

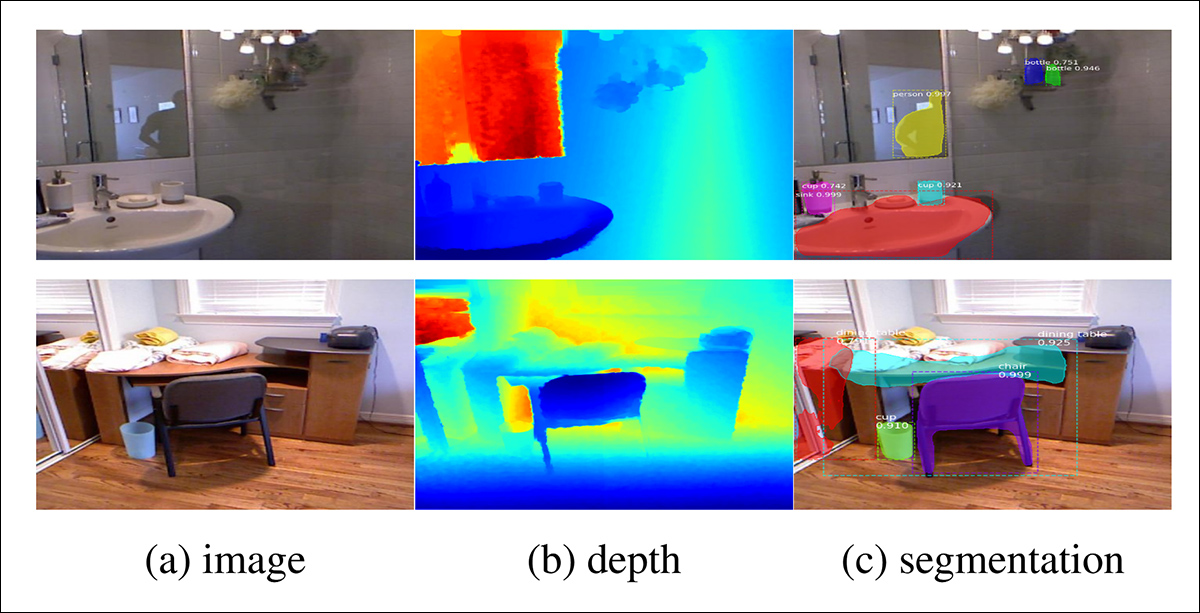

Di seguito sono riportati esempi di visualizzazioni renderizzate dal set di dati degli autori contenenti più oggetti (più di due), con illustrazioni della segmentazione degli oggetti e visualizzazioni della mappa di profondità.

Processo di formazione

Riconoscendo che il solo realismo sintetico non era sufficiente per una generalizzazione robusta ai dati del mondo reale, i ricercatori hanno sviluppato un processo di apprendimento curriculare in tre fasi per addestrare MirrorFusion 2.0.

Nella fase 1, gli autori hanno inizializzato il pesi sia del ramo di condizionamento che di quello di generazione con la Diffusione Stabile v1.5 checkpoint e perfezionato il modello sull'addestramento a singolo oggetto dividere del dataset SynMirrorV2. A differenza di quanto sopra menzionato Riflettere la realtà progetto, i ricercatori non hanno congelare il ramo di generazione. Hanno quindi addestrato il modello per 40,000 iterazioni.

Nella Fase 2, il modello è stato messo a punto per altre 10,000 iterazioni, sulla suddivisione dell'addestramento multi-oggetto di SynMirrorV2, per insegnare al sistema a gestire le occlusioni e le disposizioni spaziali più complesse presenti nelle scene realistiche.

Infine, nella fase 3, sono state condotte ulteriori 10,000 iterazioni di messa a punto utilizzando dati del mondo reale provenienti dal Set di dati MSD, utilizzando mappe di profondità generate dal Matterport3D stimatore di profondità monoculare.

Esempi tratti dal set di dati MSD, con scene del mondo reale analizzate in mappe di profondità e segmentazione. Fonte: https://arxiv.org/pdf/1908.09101

Durante l'addestramento, i prompt di testo sono stati omessi per il 20 percento del tempo di addestramento, per incoraggiare il modello a sfruttare al meglio le informazioni di profondità disponibili (ovvero, un approccio "mascherato").

L'allenamento si è svolto su quattro GPU NVIDIA A100 per tutte le fasi (le specifiche della VRAM non sono fornite, anche se sarebbero state 40 GB o 80 GB per scheda). Il tasso di apprendimento è stato di 1 e.-5 è stato utilizzato su un batch di 4 per GPU, sotto il Adam W ottimizzatore.

Questo schema di addestramento ha aumentato progressivamente la difficoltà dei compiti presentati al modello, iniziando con scene sintetiche più semplici e procedendo verso composizioni più impegnative, con l'intento di sviluppare una solida trasferibilità nel mondo reale.

Collaudo

Gli autori hanno valutato MirrorFusion 2.0 rispetto al precedente stato dell'arte, MirrorFusion, che fungeva da base di riferimento, e hanno condotto esperimenti sul set di dati MirrorBenchV2, coprendo sia scene con un solo oggetto che scene con più oggetti.

Sono stati condotti ulteriori test qualitativi su campioni del set di dati MSD e Oggetti scansionati da Google (GSO) set di dati.

La valutazione ha utilizzato 2,991 immagini di singoli oggetti provenienti da categorie visibili e non visibili e 300 scene di due oggetti provenienti da ABO. La performance è stata misurata utilizzando Rapporto segnale/rumore di picco (PSNR); Indice di similarità strutturale (SSIM); e Somiglianza della patch dell'immagine percettiva appresa (LPIPS) punteggi per valutare la qualità della riflessione sulla regione dello specchio mascherato. Somiglianza CLIP è stato utilizzato per valutare l'allineamento del testo con i prompt di input.

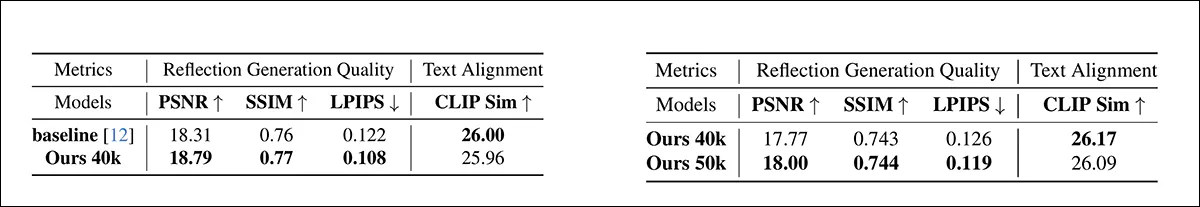

Nei test quantitativi, gli autori hanno generato immagini utilizzando quattro seed per un prompt specifico e selezionando l'immagine risultante con il punteggio SSIM migliore. Le due tabelle dei risultati per i test quantitativi sono riportate di seguito.

A sinistra, risultati quantitativi per la qualità della generazione di riflessioni di singoli oggetti sulla versione a oggetti singoli di MirrorBenchV2. MirrorFusion 2.0 ha superato la versione di riferimento, con i risultati migliori mostrati in grassetto. A destra, risultati quantitativi per la qualità della generazione di riflessioni di più oggetti sulla versione a oggetti multipli di MirrorBenchV2. MirrorFusion 2.0 addestrato con più oggetti ha superato la versione addestrata senza di essi, con i risultati migliori mostrati in grassetto.

Gli autori commentano:

"[I risultati] dimostrano che il nostro metodo supera il metodo di base e che la messa a punto su più oggetti migliora i risultati nelle scene complesse".

La maggior parte dei risultati, e quelli sottolineati dagli autori, riguardano test qualitativi. A causa delle dimensioni di queste illustrazioni, possiamo riprodurre solo parzialmente gli esempi dell'articolo.

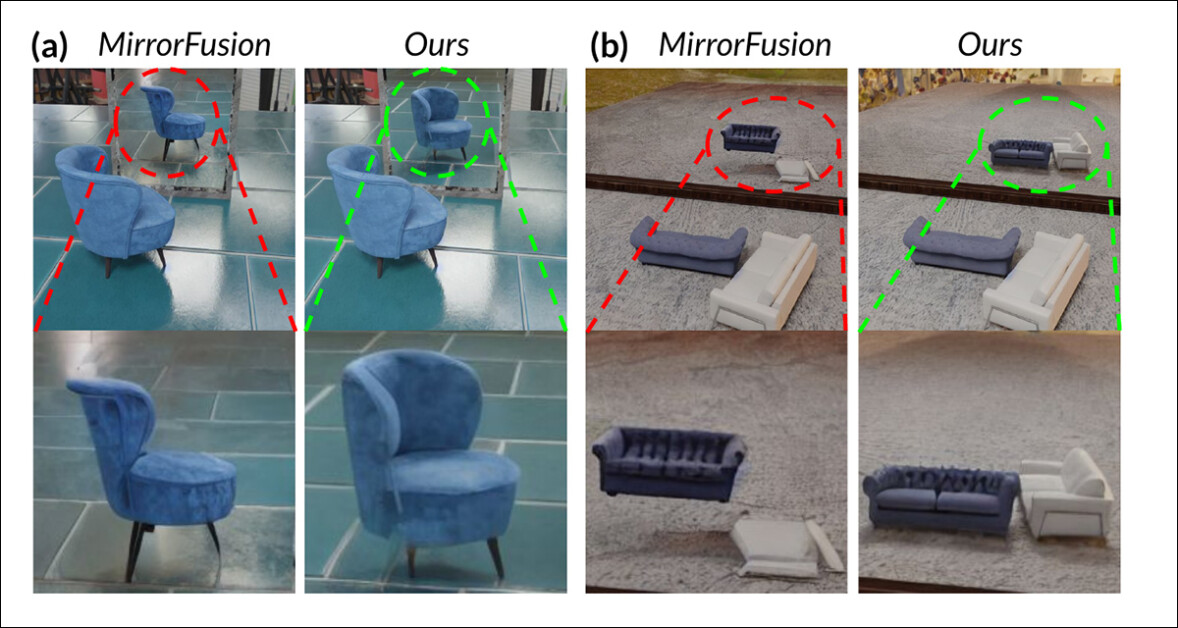

Confronto con MirrorBenchV2: la linea di base non è riuscita a mantenere riflessi accurati e coerenza spaziale, mostrando un orientamento errato della sedia e riflessi distorti di più oggetti, mentre (sostengono gli autori) MirrorFusion 2.0 riproduce correttamente la sedia e i divani, con posizione, orientamento e struttura accurati.

Tra questi risultati soggettivi, i ricercatori ritengono che il modello di base non sia riuscito a riprodurre accuratamente l'orientamento degli oggetti e le relazioni spaziali nelle riflessioni, producendo spesso artefatti come rotazione errata e oggetti fluttuanti. MirrorFusion 2.0, addestrato su SynMirrorV2, sostengono gli autori, mantiene l'orientamento e il posizionamento corretti degli oggetti sia in scene con un singolo oggetto che in scene con più oggetti, con conseguenti riflessioni più realistiche e coerenti.

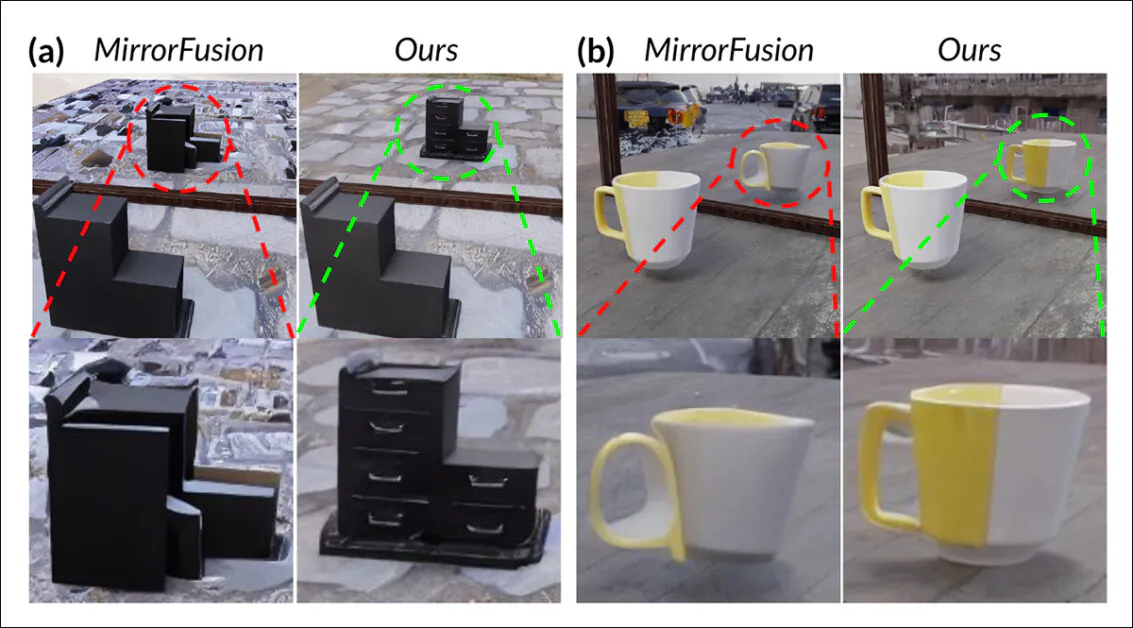

Di seguito vediamo i risultati qualitativi del set di dati GSO sopra menzionato:

Confronto con il dataset GSO. La baseline rappresenta in modo errato la struttura degli oggetti e produce riflessi incompleti e distorti, mentre MirrorFusion 2.0, sostengono gli autori, preserva l'integrità spaziale e genera geometria, colore e dettagli accurati, anche su oggetti fuori distribuzione.

Qui gli autori commentano:

MirrorFusion 2.0 genera riflessi significativamente più accurati e realistici. Ad esempio, nella Figura 5 (a – sopra), MirrorFusion 2.0 riflette correttamente le maniglie dei cassetti (evidenziate in verde), mentre il modello di base produce un riflesso non plausibile (evidenziato in rosso).

Allo stesso modo, per la "tazza bianco-gialla" nella Fig. 5 (b), MirrorFusion 2.0 fornisce una geometria convincente con artefatti minimi, a differenza della linea di base, che non riesce a catturare accuratamente la geometria e l'aspetto dell'oggetto.

Il test qualitativo finale è stato effettuato sul set di dati MSD reale sopra menzionato (risultati parziali mostrati di seguito):

Risultati di scene reali che mettono a confronto MirrorFusion, MirrorFusion 2.0 e MirrorFusion 2.0, ottimizzati sul dataset MSD. MirrorFusion 2.0, sostengono gli autori, cattura con maggiore precisione i dettagli complessi delle scene, inclusi oggetti disordinati su un tavolo e la presenza di più specchi in un ambiente tridimensionale. Vengono qui mostrati solo risultati parziali, a causa delle dimensioni dei risultati nell'articolo originale, a cui rimandiamo il lettore per i risultati completi e una migliore risoluzione.

In questo articolo, gli autori osservano che, sebbene MirrorFusion 2.0 abbia funzionato bene sui dati MirrorBenchV2 e GSO, inizialmente ha incontrato difficoltà con scene reali complesse nel dataset MSD. L'ottimizzazione del modello su un sottoinsieme di MSD ne ha migliorato la capacità di gestire ambienti congestionati e mirror multipli, ottenendo riflessioni più coerenti e dettagliate sulla porzione di test non elaborata.

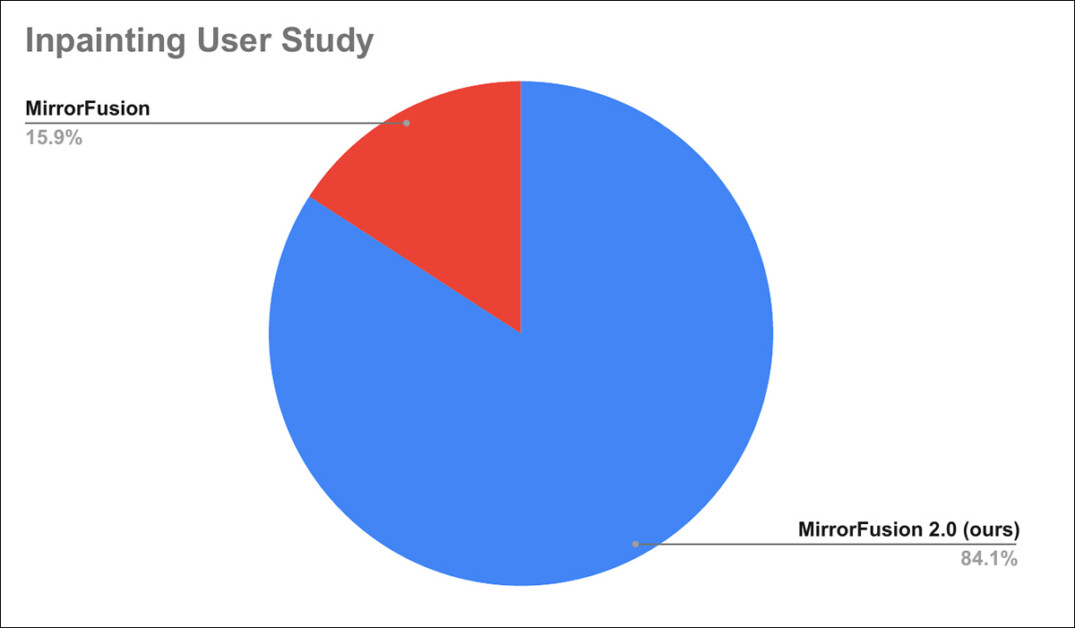

Inoltre, è stato condotto uno studio tra gli utenti, da cui emerge che l'84% di loro ha preferito le generazioni MirrorFusion 2.0 rispetto al metodo di base.

Risultati dello studio sugli utenti.

Poiché i dettagli dello studio condotto sugli utenti sono stati relegati all'appendice del documento, rimandiamo il lettore a tale testo per i dettagli specifici dello studio.

Conclusione

Sebbene molti dei risultati presentati nell'articolo rappresentino notevoli miglioramenti rispetto allo stato dell'arte, quest'ultimo per questo particolare obiettivo è così abissale che persino una soluzione aggregata poco convincente può prevalere con un minimo di sforzo. L'architettura fondamentale di un modello di diffusione è ostile all'apprendimento e alla dimostrazione affidabili di una fisica coerente, quindi il problema è mal posto e apparentemente non predisposto a una soluzione elegante.

Inoltre, l'aggiunta di dati ai modelli esistenti è già il metodo standard per porre rimedio alle carenze nelle prestazioni dei modelli LDM, con tutti gli svantaggi elencati in precedenza. È ragionevole supporre che se i futuri set di dati su larga scala prestassero maggiore attenzione alla distribuzione (e all'annotazione) dei punti dati relativi alla riflessione, potremmo aspettarci che i modelli risultanti gestiscano meglio questo scenario.

Ma lo stesso vale per molti altri problemi nell'output LDM: chi può dire quale di loro merita maggiormente lo sforzo e il denaro coinvolti nel tipo di soluzione che gli autori del nuovo articolo propongono qui?

Pubblicato per la prima volta lunedì 28 aprile 2025. Martedì 29 aprile: apportata correzione grammaticale nei paragrafi finali.