Angolo di Anderson

Anche l’AI di base può ora scrivere notizie che passano per umane

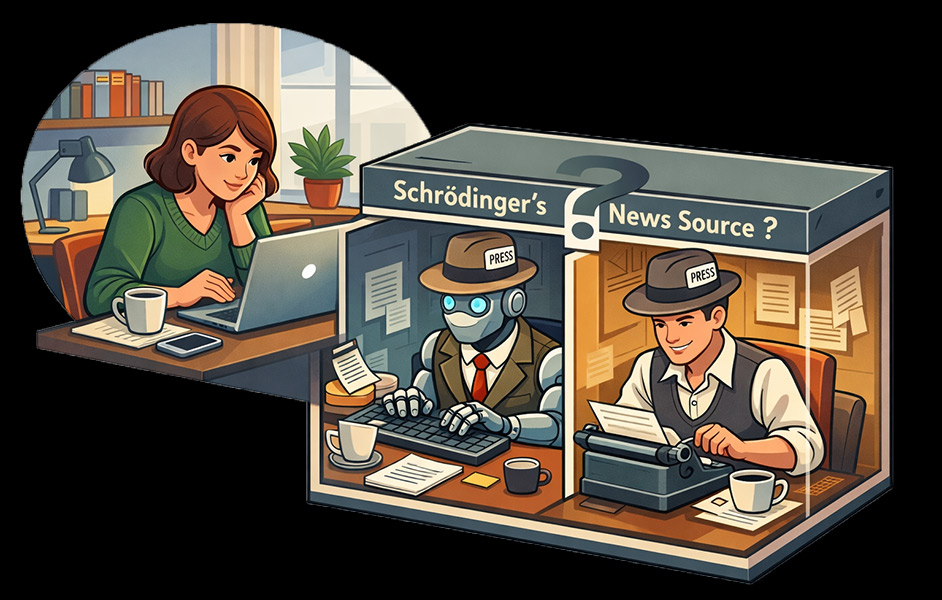

Una nuova ricerca indica che anche piccoli modelli di intelligenza artificiale locali possono ora scrivere notizie che le persone non possono distinguere dal vero giornalismo, eguagliando i sistemi di alto livello e lasciando i lettori incapaci di capire chi ha scritto cosa.

Secondo una nuova collaborazione di ricerca tra Germania e Francia, gli esseri umani non possono capire se un articolo di notizie è stato scritto da un’AI o da un essere umano – anche quando è stato scritto da modelli open source che possono essere scaricati e eseguiti su computer desktop di livello consumer relativamente medio.

In un’altra indicazione che il piccolo modello di intelligenza artificiale è in ascesa, un sondaggio di 2.318 giudizi raccolti da 1.054 partecipanti in un portale di studio accademico dedicato ha trovato che i lettori umani non potevano identificare la provenienza di un articolo a un livello superiore a quello casuale, anche quando era stato prodotto da modelli relativamente modesti con solo sette miliardi di parametri, tra cui Mistral e Llama varianti:

Punteggi di fonte e autenticità medi per LLM testati. I 200 miliardi di parametri di GPT-4o non superano di molto i 7 miliardi di parametri dei modelli più piccoli. Quelli testati per lo studio erano Gemma 7B, Phi-3 Mini, LLaMA-2 13B, Mistral 7B, GPT-4o e GPT-3.5. Fonte

Gli autori ritornano su un argomento che avevano esaminato per la prima volta nel 2024 rilascio Benedizione o maledizione? Un sondaggio sull’impatto dell’AI generativa sulle notizie false. I risultati stessi sono i risultati appena rilasciati di un progetto più ampio inizialmente annunciato a gennaio, e fanno uso del framework di partecipazione online JudgeGPT degli autori.

Potere leggero

Intitolato Possono gli esseri umani capire? Uno studio a doppia asse della percezione umana delle notizie generate da LLM, e proveniente da tre ricercatori tra l’Università di Scienze Applicate di Francoforte e l’unità di ricerca IRISA di Nantes, la nuova ricerca fa una distinzione importante tra ‘notizie false’ e ‘notizie scritte da AI’ (poiché le notizie false possono essere scritte da persone o da AI, e i due aspetti non sono necessariamente sinonimi).

Tuttavia, forse l’aspetto più interessante è la conclusione del paper che i modelli più piccoli, tra cui Mistral 7B e Gemma 7B, possono, con solo sette miliardi di parametri, competere con aplomb contro i likes di un modello ChatGPT (4o) con 200 miliardi di parametri:

‘I modelli open-weight con solo 7 miliardi di parametri producono testi valutati in modo diverso da GPT-4o, indicando che la capacità di generare testi indistinguibili da quelli umani non è più limitata ai modelli di frontiera.’

Tuttavia, ‘le notizie generate da AI’ possono rappresentare molti tipi diversi di collaborazione umana/AI, dalla correzione ortografica alla deferenza completa di sforzo, e lo studio non chiarisce esattamente che tipo di contenuto AI è stato prodotto per i test (anche se descrive la metodologia per produrlo – vedi sotto).

Metodo

Per i partecipanti coinvolti con la piattaforma JudgeGPT, ogni frammento di notizie è stato valutato utilizzando una struttura a doppia asse in cui hanno fornito tre valutazioni indipendenti su slider continui da 0 a 100:

L’interfaccia utente del portale JudgeGPT, dove i valutatori valutano il materiale su attribuzione di fonte; autenticità; e familiarità con l’argomento. Si prega di fare riferimento al paper di origine per una risoluzione migliore.

Giudizio di fonte ha catturato se un passaggio sembrava scritto da una macchina o da un essere umano; giudizio di autenticità, se era percepito come falso o legittimo; e familiarità con l’argomento, quanto bene il lettore conosceva l’argomento.

Sono stati utilizzati scale continue invece di una scala Likert, per catturare gradi di certezza più precisamente, e per supportare l’analisi statistica, inclusa correlazione di Pearson e clustering.

I frammenti di testo generati dalla macchina sono stati prodotti dal framework RogueGPT degli autori, l’architettura di alimentazione per JudgeGPT. RogueGPT orchestra contributi da sei Large Language Models (LLM): ChatGPT-4; ChatGPT-3.5; ChatGPT-4o; LLaMA-2 13B; Gemma 7B; e Mistral 7B.

È stato utilizzato il prompt basato su persona per generare i testi, e le generazioni AI sono state basate su argomenti di notizie reali e sono state verificate da esseri umani.

Al contrario, i frammenti di testo scritti da esseri umani sono stati campionati da ‘canali di notizie stabiliti’ e ‘banche dati di informazioni’ non specificate.