Intelligenza artificiale

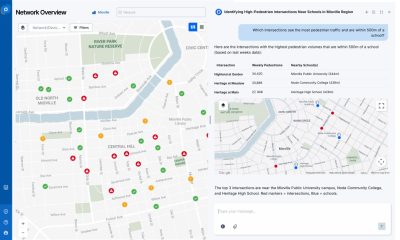

DeepSeek-V3 Svelato: Come La Progettazione AI Consapevole Dell’Hardware Riduce I Costi E Migora Le Prestazioni

DeepSeek-V3 rappresenta una svolta nello sviluppo di intelligenza artificiale a basso costo. Dimostra come una progettazione intelligente di hardware e software possa offrire prestazioni all’avanguardia senza costi eccessivi. Formando su soli 2.048 GPU NVIDIA H800, questo modello ottiene risultati notevoli attraverso approcci innovativi come l’Attenzione Latente Multi-Testa per l’efficienza della memoria, l’architettura Mixture of Experts per il calcolo ottimizzato e la formazione a precisione mista FP8 che sblocca il potenziale dell’hardware. Il modello mostra che team più piccoli possono competere con grandi aziende tecnologiche attraverso scelte di progettazione intelligenti piuttosto che attraverso la scalabilità brute.

La Sfida Della Scalabilità AI

L’industria dell’AI affronta un problema fondamentale. I grandi modelli linguistici stanno diventando più grandi e più potenti, ma richiedono anche enormi risorse computazionali che la maggior parte delle organizzazioni non può permettersi. Le grandi aziende tecnologiche come Google, Meta e OpenAI distribuiscono cluster di formazione con decine o centinaia di migliaia di GPU, rendendo difficile per i team di ricerca più piccoli e le startup competere.

Questo divario di risorse minaccia di concentrare lo sviluppo dell’AI nelle mani di poche grandi aziende tecnologiche. Le leggi di scalabilità che guidano i progressi dell’AI suggeriscono che modelli più grandi con più dati di formazione e potenza computazionale portano a migliori prestazioni. Tuttavia, la crescita esponenziale nelle esigenze di hardware ha reso sempre più difficile per i giocatori più piccoli competere nella corsa all’AI.

Le esigenze di memoria sono emerse come un’altra sfida significativa. I grandi modelli linguistici richiedono risorse di memoria significative, con una domanda che aumenta di più del 1000% all’anno. Nel frattempo, la capacità di memoria ad alta velocità cresce a un ritmo molto più lento, tipicamente inferiore al 50% all’anno. Questo mismatch crea ciò che i ricercatori chiamano il “muro della memoria AI“, dove la memoria diventa il fattore limitante piuttosto che la potenza computazionale.

La situazione diventa ancora più complessa durante l’inferenza, quando i modelli servono utenti reali. Le applicazioni AI moderne spesso coinvolgono conversazioni a più turni e contesti lunghi, richiedendo potenti meccanismi di caching che consumano sostanziali risorse di memoria. Gli approcci tradizionali possono rapidamente sopraffare le risorse disponibili e rendere l’inferenza efficiente una sfida tecnica ed economica significativa.

L’Approccio Hardware-Aware Di DeepSeek-V3

DeepSeek-V3 è progettato con l’ottimizzazione dell’hardware in mente. Invece di utilizzare più hardware per scalare modelli grandi, DeepSeek si è concentrato sulla creazione di progetti di modelli consapevoli dell’hardware che ottimizzano l’efficienza all’interno dei vincoli esistenti. Questo approccio consente a DeepSeek di raggiungere prestazioni all’avanguardia utilizzando solo 2.048 GPU NVIDIA H800, una frazione di ciò che i concorrenti richiedono normalmente.

L’intuizione chiave dietro DeepSeek-V3 è che i modelli AI dovrebbero considerare le capacità dell’hardware come un parametro chiave nel processo di ottimizzazione. Piuttosto che progettare modelli in isolamento e poi cercare di eseguirli in modo efficiente, DeepSeek si è concentrato sulla costruzione di un modello AI che incorpora una profonda comprensione dell’hardware su cui opera. Questa strategia di co-progettazione significa che il modello e l’hardware lavorano insieme in modo efficiente, piuttosto che trattare l’hardware come un vincolo fisso.

Il progetto si basa sui principali insight dei precedenti modelli DeepSeek, in particolare DeepSeek-V2, che ha introdotto innovazioni di successo come DeepSeek-MoE e Attenzione Latente Multi-Testa. Tuttavia, DeepSeek-V3 estende questi insight integrando la formazione a precisione mista FP8 e sviluppando nuove topologie di rete che riducono i costi dell’infrastruttura senza sacrificare le prestazioni.

Questo approccio hardware-aware si applica non solo al modello, ma anche all’intera infrastruttura di formazione. Il team ha sviluppato una rete a due livelli Fat-Tree Multi-Plane per sostituire le topologie tradizionali a tre livelli, riducendo significativamente i costi di networking del cluster. Queste innovazioni infrastrutturali dimostrano come una progettazione attenta possa ottenere risparmi di costo significativi in tutta la pipeline di sviluppo AI.

Le Principali Innovazioni Che Guidano L’Efficienza

DeepSeek-V3 introduce diverse migliorie che aumentano notevolmente l’efficienza. Una delle principali innovazioni è il meccanismo di Attenzione Latente Multi-Testa (MLA), che affronta l’alto utilizzo della memoria durante l’inferenza. I meccanismi di attenzione tradizionali richiedono la memorizzazione dei vettori Chiave e Valore per tutte le teste di attenzione. Ciò consuma enormi quantità di memoria man mano che le conversazioni diventano più lunghe.

MLA risolve questo problema comprimendo le rappresentazioni Chiave-Valore di tutte le teste di attenzione in un vettore latente più piccolo utilizzando una matrice di proiezione formata con il modello. Durante l’inferenza, solo questo vettore latente compresso deve essere memorizzato, riducendo notevolmente le esigenze di memoria. DeepSeek-V3 richiede solo 70 KB per token rispetto a 516 KB per LLaMA-3.1 405B e 327 KB per Qwen-2.5 72B1.

L’architettura Mixture of Experts fornisce un altro guadagno di efficienza cruciale. Invece di attivare l’intero modello per ogni calcolo, MoE attiva selettivamente solo le reti di esperti più rilevanti per ogni input. Questo approccio mantiene la capacità del modello mentre riduce notevolmente il calcolo effettivo richiesto per ogni passo in avanti.

La formazione a precisione mista FP8 migliora ulteriormente l’efficienza passando dalla precisione a 16 bit a quella a 8 bit. Ciò riduce il consumo di memoria della metà mentre mantiene la qualità della formazione. Questa innovazione affronta direttamente il muro della memoria AI rendendo un uso più efficiente delle risorse hardware disponibili.

Il Modulo di Predizione Multi-Token aggiunge un altro livello di efficienza durante l’inferenza. Invece di generare un token alla volta, questo sistema può prevedere più token futuri simultaneamente, aumentando notevolmente la velocità di generazione attraverso la decodifica speculativa. Questo approccio riduce il tempo complessivo necessario per generare risposte, migliorando l’esperienza utente mentre riduce i costi computazionali.

Le Principali Lezioni Per L’Industria

Il successo di DeepSeek-V3 fornisce diverse lezioni chiave per l’industria AI più ampia. Mostra che l’innovazione nell’efficienza è altrettanto importante quanto la scalabilità del modello. Il progetto evidenzia anche come una progettazione attenta di hardware e software possa superare i limiti delle risorse che altrimenti potrebbero limitare lo sviluppo dell’AI.

Questo approccio di progettazione hardware-aware potrebbe cambiare il modo in cui viene sviluppata l’AI. Invece di vedere l’hardware come un limite da lavorare intorno, le organizzazioni potrebbero trattarlo come un fattore di progettazione chiave che plasma l’architettura del modello fin dall’inizio. Questo cambiamento di mentalità può portare a sistemi AI più efficienti e a basso costo in tutta l’industria.

L’efficacia di tecniche come MLA e la formazione a precisione mista FP8 suggerisce che c’è ancora molto spazio per migliorare l’efficienza. Man mano che l’hardware continua ad avanzare, nuove opportunità di ottimizzazione emergeranno. Le organizzazioni che approfittano di queste innovazioni saranno meglio preparate a competere in un mondo con crescenti vincoli di risorse.

Le innovazioni di networking in DeepSeek-V3 enfatizzano anche l’importanza della progettazione dell’infrastruttura. Mentre molta attenzione è focalizzata sulle architetture dei modelli e sui metodi di formazione, l’infrastruttura gioca un ruolo critico nell’efficienza e nel costo complessivi. Le organizzazioni che costruiscono sistemi AI dovrebbero dare priorità all’ottimizzazione dell’infrastruttura insieme alle migliorie del modello.

Il progetto dimostra anche il valore della ricerca aperta e della collaborazione. Condividendo le loro intuizioni e tecniche, il team DeepSeek contribuisce all’avanzamento generale dell’AI mentre stabilisce la loro posizione come leader nello sviluppo di AI efficienti. Questo approccio beneficia l’intera industria accelerando i progressi e riducendo la duplicazione degli sforzi.

Il Punto Chiave

DeepSeek-V3 rappresenta un importante passo avanti nell’intelligenza artificiale. Mostra che una progettazione attenta può offrire prestazioni paragonabili, o migliori, di quelle ottenute semplicemente scalando i modelli. Utilizzando idee come l’Attenzione Latente Multi-Testa, i livelli Mixture-of-Experts e la formazione a precisione mista FP8, il modello raggiunge risultati di alto livello mentre riduce notevolmente le esigenze di hardware. Questa attenzione all’efficienza dell’hardware offre ai laboratori e alle aziende più piccole nuove possibilità di costruire sistemi avanzati senza enormi budget. Man mano che l’AI continua a svilupparsi, approcci come quelli in DeepSeek-V3 diventeranno sempre più importanti per garantire che i progressi siano sostenibili e accessibili. DeepSeek-3 insegna anche una lezione più ampia. Con scelte di architettura intelligenti e una stretta ottimizzazione, possiamo costruire AI potenti senza la necessità di risorse estese e costi. In questo modo, DeepSeek-V3 offre all’intera industria un percorso pratico verso un’AI accessibile e a basso costo che aiuta molte organizzazioni e utenti in tutto il mondo.