L'angolo di Anderson

Le IA di codifica tendono a soffrire dell'effetto Dunning-Kruger

Una nuova ricerca dimostra che le IA di programmazione come ChatGPT soffrono dell'effetto Dunning-Kruger, spesso agendo con maggiore sicurezza quando sono meno competenti. Quando affrontano linguaggi di programmazione poco familiari o poco chiari, affermano di avere un'elevata sicurezza anche quando le loro risposte sono incomplete. Lo studio collega l'eccessiva sicurezza del modello sia alle scarse prestazioni che alla mancanza di dati di addestramento, sollevando nuove preoccupazioni su quanto questi sistemi sappiano realmente di ciò che stanno cercando di capire. non sa.

Chiunque abbia trascorso anche una moderata quantità di tempo interagendo con i modelli linguistici di grandi dimensioni su questioni fattuali saprà già che gli LLM sono spesso disposti a dare un sbagliarsi con sicurezza risposta a una domanda dell'utente.

Insieme a forme più evidenti di allucinazione, il motivo di questa vana vanagloria non è chiaro al 100%. Una ricerca pubblicata durante l'estate suggerisce che i modelli danno risposte sicure anche quando sanno di sbagliarsi, per esempio; sebbene altre teorie attribuiscano l'eccessiva sicurezza a scelte architettoniche, tra le altre possibilità.

Ciò di cui l'utente finale può essere certo è che l'esperienza è incredibilmente frustrante, poiché siamo programmati per riporre fiducia in persone stime delle proprie capacità (anche perché in questi casi ci sono conseguenze, legali e di altro tipo, se una persona promette troppo e non mantiene nulla); e una sorta di trasferimento antropomorfico significa che tendiamo a replicare questo comportamento con i sistemi di intelligenza artificiale conversazionale.

Ma un LLM è un'entità irresponsabile che può e restituirà effettivamente un "Ops! Mani di burro..." dopo aver aiutato l'utente a distruggere inavvertitamente qualcosa di importante, o almeno sprecare un pomeriggio del loro tempo; supponendo che lo farà ammettere la responsabilità in assoluto.

Peggio ancora, questa mancanza di prudente circospezione sembra impossibile da eliminare, almeno in ChatGPT, che rassicurerà abbondantemente l'utente sulla validità dei suoi consigli e spiegherà i difetti del suo ragionamento solo dopo che il danno sarà fatto. Né l'aggiornamento del sistema memoria persistente, né l'uso di prompt ripetitivi sembrano avere un impatto significativo sulla questione.

Anche le persone possono essere ostinate e auto-illudersi, anche se chiunque commettesse errori così gravi e frequenti verrebbe probabilmente licenziato in anticipo. Queste persone soffrono dell'opposto della "sindrome dell'impostore" (in cui un dipendente teme di essere stato promosso al di sopra delle proprie capacità): effetto Dunning Kruger, dove una persona significativamente sovrastima la loro capacità di svolgere un compito.

Il costo dell'inflazione

Un nuovo studio di Microsoft esamina il valore dell'effetto Dunning-Kruger in relazione alle prestazioni efficaci delle architetture di codifica assistite dall'intelligenza artificiale (come quella di Redmond) Secondo pilota), in uno sforzo di ricerca che è il primo ad affrontare specificamente questo sottosettore degli LLM.

Lo studio analizza la sicurezza con cui tali IA, specializzate nella scrittura di codice, valutano le proprie risposte in relazione alle loro effettive prestazioni, in decine di linguaggi di programmazione. I risultati mostrano un chiaro schema simile a quello umano: quando i modelli erano meno capaci, erano più sicuri di sé.

L’effetto è stato più forte nelle lingue oscure o con poche risorse, dove i dati di addestramento erano scarsi: più debole era il modello o più rara era la lingua, maggiore era l’effetto. illusione di abilità:

Prestazioni effettive e percepite di GPT-4o nei diversi linguaggi di programmazione, ordinate in base alle prestazioni reali. Fonte: https://arxiv.org/pdf/2510.05457

I quattro autori, tutti collaboratori paritari che lavorano per Microsoft, sostengono che il lavoro solleva nuovi interrogativi su quanto ci si possa fidare di questi strumenti per giudicare il proprio output e affermano:

Analizzando l'affidabilità e le prestazioni del modello in un insieme eterogeneo di linguaggi di programmazione, abbiamo scoperto che i modelli di intelligenza artificiale rispecchiano i modelli umani di eccessiva sicurezza, soprattutto in ambiti non familiari o con poche risorse.

"I nostri esperimenti dimostrano che i modelli meno competenti e quelli che operano in linguaggi di programmazione rari presentano un bias più forte, simile a quello del DKE, suggerendo che l'intensità del bias è proporzionale alla competenza dei modelli. Questo è in linea con gli esperimenti condotti sull'uomo per quanto riguarda il bias."

I ricercatori contestualizzano questa linea di studio come un modo per comprendere come la fiducia nel modello diventi inaffidabile quando le prestazioni sono scarse e per verificare se i sistemi di intelligenza artificiale mostrano lo stesso tipo di eccesso di fiducia osservato negli esseri umani, con implicazioni a valle per la fiducia e l'implementazione pratica.

Anche se la nuovo documento Sfida La legge dei titoli di Betteridge, è comunque intitolato I modelli di codice soffrono dell'effetto Dunning-Kruger?Sebbene gli autori affermino che il codice per il lavoro è stato rilasciato, l'attuale preprint non contiene alcun dettaglio al riguardo.

Metodo

Lo studio ha testato la precisione con cui le IA programmatrici potevano valutare le proprie risposte, sottoponendo loro migliaia di domande di programmazione a risposta multipla, ciascuna delle quali apparteneva a un dominio linguistico specifico, da Python e Java a Perl e COBOL:

Domini del linguaggio di programmazione utilizzati nello studio, insieme al numero di domande di codifica a risposta multipla campionate per ciascun dominio.

Ai modelli è stato chiesto di scegliere l'opzione corretta e poi di stimare quanto fossero sicuri della loro scelta, con le loro prestazioni effettive misurate in base alla frequenza con cui hanno ottenuto la risposta giusta e la loro autovalutazione della fiducia che indica quanto sono stati bravi creduto Lo erano. Confrontando queste due metriche, i ricercatori hanno potuto vedere dove divergevano fiducia e competenza.

Per misurare il livello di affidabilità dei modelli, lo studio ha utilizzato due metodi: assoluta fiducia relativa fiduciaNel primo caso, è stato chiesto al modello di assegnare un punteggio da zero a uno accanto a ciascuna risposta, con la sua affidabilità per una data lingua definita dalla media di tali punteggi nelle domande in quella lingua.

Il secondo metodo ha esaminato quanto fosse affidabile il modello quando scegliere tra due domande; per ogni coppia, il modello doveva indicare di quale si sentiva più sicuro. Queste scelte venivano poi valutate utilizzando sistemi di classificazione originariamente progettati per i giochi competitivi, trattando ogni domanda come se si trattasse di un giocatore in una partita. I punteggi finali sono stati normalizzati e calcolati per ogni lingua per ottenere un punteggio di affidabilità relativa.

Nel documento vengono esaminate due forme consolidate dell'effetto Dunning-Kruger: una che traccia il modo in cui un singolo modello valuta erroneamente le proprie prestazioni in diversi domini; e un'altra che confronta i livelli di confidenza tra modelli più deboli e più forti.

La prima forma, chiamata DKE intra-partecipante, esamina se un singolo modello diventa più eccessivamente sicuro di sé nei linguaggi in cui ha prestazioni scadenti. Il secondo, DKE inter-partecipante, si chiede se i modelli che hanno prestazioni complessivamente peggiori tendano anche a valutare se stessi in modo più positivo.

In entrambi i casi, il divario tra fiducia e prestazioni effettive viene utilizzato per misurare l'eccesso di fiducia, con divari più ampi in contesti con basse prestazioni che indicano un comportamento simile a quello del DKE.

Risultati

Lo studio verifica l'effetto Dunning-Kruger in sei grandi modelli linguistici: Mistral; Phi-3; DeepSeek‑Distill; Phi-4; GPT‑0.1, e GPT‑4o.

Ogni modello è stato testato su domande di programmazione a risposta multipla tratte da quelle disponibili al pubblico Set di dati CodeNet, con 37 lingue* rappresentate per rivelare come la sicurezza e l'accuratezza variassero tra domini di codifica noti e meno noti.

L'analisi inter-modello mostra un chiaro schema Dunning-Kruger:

Prestazioni effettive rispetto a quelle percepite in sei modelli di codice, che mostrano come i modelli con prestazioni inferiori, come Mistral e Phi-3, mostrino un'elevata affidabilità nonostante una scarsa accuratezza, mentre i modelli più potenti, come GPT-4o, mostrano un comportamento più calibrato o addirittura poco affidabile.

I modelli con minore accuratezza, tra cui Mistral e Phi-3, tendevano a sovrastimare le proprie capacità, mentre i sistemi con prestazioni più elevate, come GPT-4o, mostravano livelli di confidenza che corrispondevano più da vicino alle loro prestazioni reali, in particolare se giudicati in base alla confidenza relativa.

I risultati indicano anche che i modelli più capaci a volte possono sottostimare se stessi (un modello che i punteggi di fiducia assoluta non riescono a catturare).

I risultati indicano inoltre che l'analisi intra-modello supporta la presenza dell'effetto Dunning-Kruger. Nel grafico dei risultati mostrato all'inizio dell'articolo, vediamo le prestazioni di ciascun modello nei diversi linguaggi di programmazione, ordinati in base alle prestazioni effettive.

Nei linguaggi in cui i modelli hanno ottenuto punteggi bassi, in particolare in quelli rari o con risorse limitate come COBOL, Prolog e Ceylon, la loro affidabilità è stata notevolmente superiore a quanto giustificato dai risultati. In linguaggi noti come Python e JavaScript, l'affidabilità si è allineata maggiormente alla loro reale accuratezza, e talvolta è persino scesa al di sotto di essa.

Questo modello è apparso sia nelle misure di fiducia assoluta che in quelle relative, suggerendo che i modelli sono meno consapevoli dei propri limiti quando operano in domini di codifica non familiari.

Trattare i modelli come partecipanti ha introdotto alcune limitazioni, poiché il numero limitato di modelli in gioco influisce sulla diversità; le differenze all'interno degli output di un singolo modello vengono ignorate e la distribuzione dei dati potrebbe non riflettere quella dei partecipanti umani reali.

Per tener conto di ciò, lo studio ha testato tre configurazioni alternative: in primo luogo, a ciascun modello è stata assegnata una persona distinta; in secondo luogo, le risposte sono state campionate a un livello più alto temperatura per creare più varianti; in terzo luogo, i prompt sono stati parafrasati più volte, e ogni versione è stata trattata come un partecipante separato:

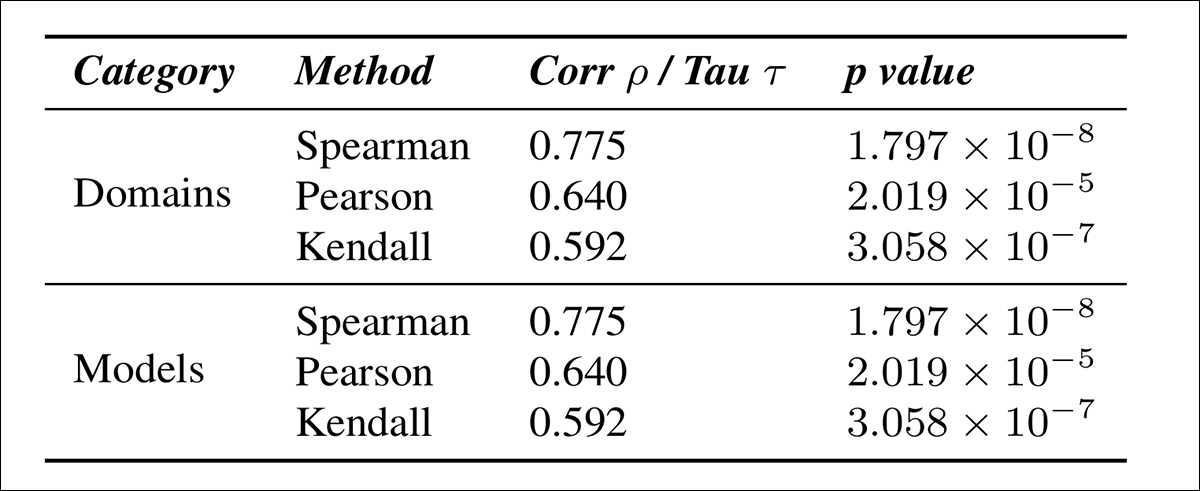

Correlazione tra eccesso di sicurezza e prestazioni effettive in diverse configurazioni sperimentali, che dimostra che il modello Dunning-Kruger rimane coerente in tutte le condizioni ed è più forte quando vengono campionate più risposte diverse dallo stesso modello.

La tabella dei risultati mostrata sopra indica quanto fortemente si manifesta l'effetto Dunning-Kruger in queste condizioni, rimanendo presente in ogni caso; e che il DKE era più pronunciato quando venivano campionate più risposte dallo stesso modello ad alta temperatura.

Per comprendere meglio in che modo le prestazioni percepite differiscono dalle prestazioni effettive, lo studio ha confrontato le stime di confidenza assoluta e relativa, calcolando quanto ciascun modello sovrastimasse la propria capacità (in particolare, la differenza tra il suo punteggio di confidenza e la sua accuratezza effettiva) e misurando poi in che modo tale sovrastima fosse correlata alle prestazioni effettive del modello:

Correlazione tra eccesso di fiducia (misurato come fiducia assoluta meno fiducia relativa) e accuratezza effettiva nei diversi domini di programmazione e tipi di modello, che mostra come una maggiore sovrastima sia costantemente associata a prestazioni inferiori.

La tabella dei risultati sopra illustra come la sovrastima sia correlata alle prestazioni effettive, sia nei diversi domini di programmazione che nei diversi modelli. In entrambi i casi, possiamo osservare che i modelli con minore accuratezza tendono a mostrare una maggiore sovrastima.

Inoltre, i modelli specializzati addestrati su domini più ristretti hanno mostrato effetti DKE più forti rispetto a quelli generalisti:

Correlazione tra sovrastima e prestazioni reali per modelli specializzati di base, a dominio singolo e multidominio, che mostra effetti DKE più forti all'aumentare della specializzazione.

Usando il Set di dati MultiPL-E in otto linguaggi di programmazione, gli autori hanno scoperto che la formazione a dominio singolo ha portato a una maggiore sicurezza rispetto alle configurazioni multi-dominio o di base, suggerendo che La DKE peggiora con l'aumento della specializzazione.

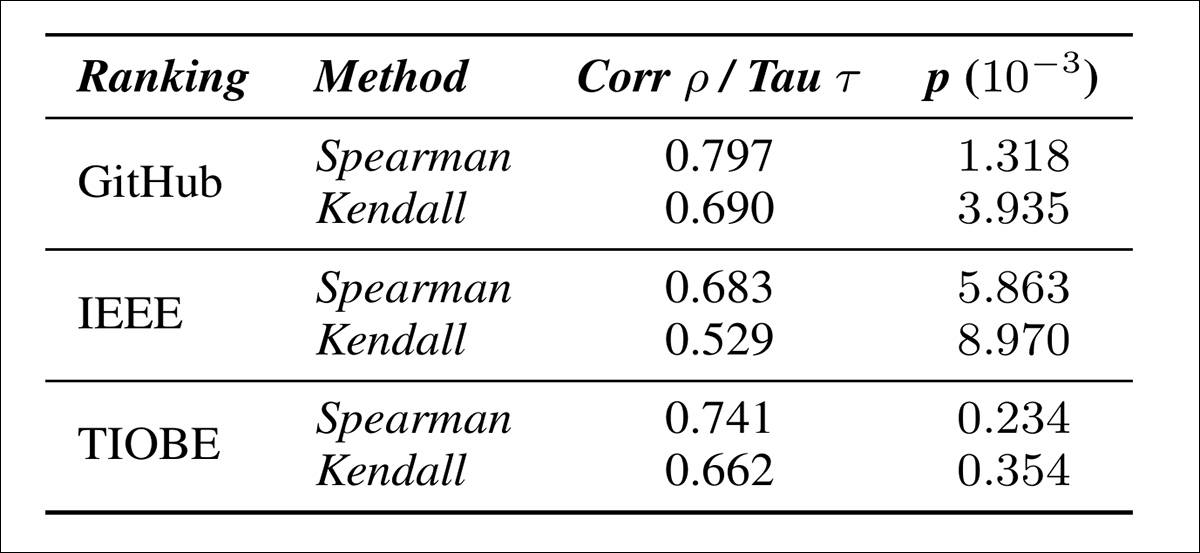

I test hanno anche scoperto che i modelli tendono ad essere più sicuri di sé nei linguaggi di programmazione rari. GitHub, IEEEe TIOBE nelle classifiche, la rarità è fortemente correlata a una maggiore fiducia percepita, con un picco pari a 0.797:

Correlazione tra eccesso di sicurezza nel modello e rarità linguistica, utilizzando tre classifiche di popolarità. Le lingue meno diffuse sono associate a prestazioni percepite più elevate.

Infine, gli autori hanno verificato se l'effetto Dunning-Kruger si manifesta nella generazione del codice, valutando i modelli sul set di dati MultiPL-E nei linguaggi Ada, Dart, Prolog, Swift, C++, Python, C# ed Elixir.

Sebbene l'effetto fosse ancora presente, era notevolmente più debole rispetto al contesto delle domande a risposta multipla, probabilmente a causa della maggiore difficoltà nel valutare la sicurezza e la correttezza nei compiti aperti:

Correlazione tra sovrastima e prestazioni effettive nella generazione di codice aperto, basata sui risultati MultiPL‑E in otto linguaggi di programmazione.

Considerando la spiegazione ancora controversa dell'effetto Dunning-Kruger, gli autori concludono:

Una possibile spiegazione che potrebbe essere comune sia agli esseri umani sia ai modelli di intelligenza artificiale è la spiegazione metacognitiva, secondo cui valutare la qualità dell'esecuzione di un'abilità è una parte cruciale dell'acquisizione di un'abilità.

Questa spiegazione può essere potenzialmente testata sperimentalmente nei modelli di intelligenza artificiale con uno studio controllato di diverse strategie di allenamento, per verificare se tutte portino a miglioramenti simultanei nelle prestazioni e nella capacità di valutare la qualità delle prestazioni. Tuttavia, questo studio va ben oltre lo scopo di questo articolo e lo rimandiamo a lavori futuri.

Conclusione

Anche nel suo dominio nativo, l'effetto Dunning-Kruger (come osserva l'articolo) può essere attribuibile a una causa statistica o cognitiva. Nel primo caso, l'applicazione di una sindrome finora prettamente umana a un contesto di apprendimento automatico è in realtà piuttosto valida.

Sebbene gli autori ipotizzino che in entrambi i casi la causa potrebbe essere di natura "cognitiva", ciò richiederebbe un punto di vista leggermente più metafisico.

Forse la scoperta più interessante dell'articolo è la misura in cui diversi LLM di programmazione tendono a raddoppiare gli sforzi nelle circostanze meno favorevoli, ovvero a dimostrare la massima sicurezza quando hanno a che fare con i linguaggi più radi o meno conosciuti, il che rappresenterebbe uno stratagemma quasi immediatamente controproducente in un ambiente di lavoro reale.

* I linguaggi di programmazione utilizzati sono stati Ada, Bash, C, C#, C++, COBOL, Ceylon, Clojure, D, Dart, Dash, Elixir, Erland, F#, Fortran, Go, Haskell, Java, JavaScript, Julia, Lisp, Kotlin, Lua, OCaml, Objective-C, PHP, Pascal, Perl, Prolog, Python, Racket, Ruby, Rust, Scala, Swift, TypeScript e Visual Basic.

Prima pubblicazione mercoledì 8 ottobre 2025