L'angolo di Anderson

I filtri di bellezza sono un potenziale strumento di attacco Deepfake

I filtri di bellezza ora fanno molto più che nascondere le imperfezioni: possono aiutare i deepfake e i morphing dei volti a eludere i sistemi di rilevamento. Un nuovo studio dimostra che anche i più lievi effetti di smoothing confondono i rilevatori di intelligenza artificiale, facendo sembrare reali le immagini false e quelle vere false. Se questa tendenza continua, i filtri di bellezza potrebbero subire restrizioni in contesti ad alto rischio, dai controlli alle frontiere alle videochiamate aziendali su Zoom.

In un accademico del 2024 collaborazione Tra Spagna e Italia, i ricercatori hanno riportato che il 90% delle donne tra i 18 e i 30 anni utilizzava filtri di bellezza prima di pubblicare immagini sui social media. In questo senso, i filtri di bellezza sono metodi algoritmici o assistiti dall'intelligenza artificiale per alterare l'aspetto del viso in modo da migliorarlo presumibilmente rispetto alla fonte originale:

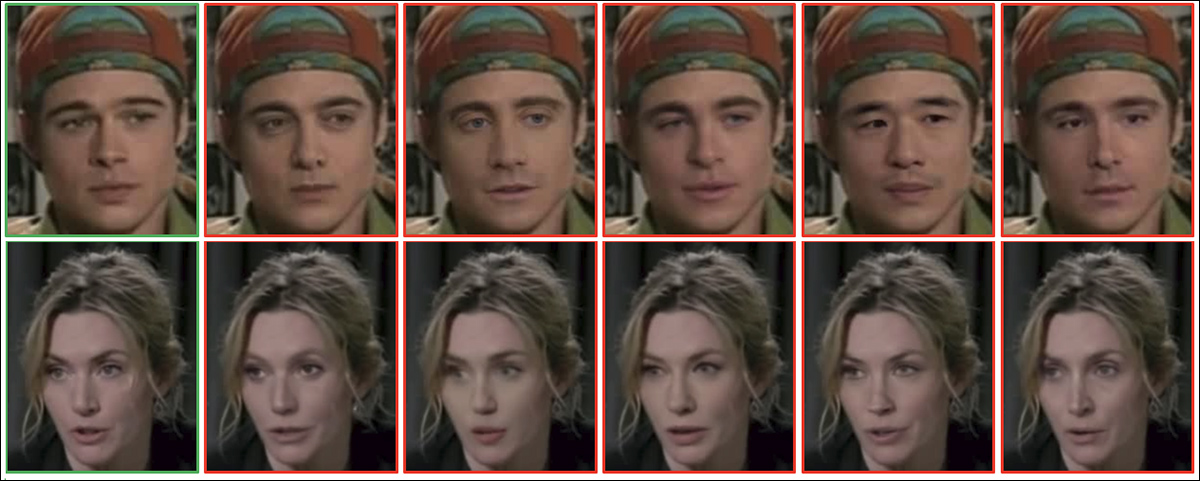

Dallo studio del 2024: esempi di volti femminili (a sinistra) e maschili (a destra) mostrati prima e dopo l'applicazione del filtro bellezza. Il filtro altera caratteristiche come il tono della pelle, gli occhi, il naso, le labbra, il mento e gli zigomi per migliorare l'attrattiva percepita. Fonte: https://arxiv.org/pdf/2407.11981

Tali filtri sono ampiamente disponibili come funzionalità native o aggiuntive nei sistemi video più diffusi, tra cui Snapchat e Zoom, e offrono la possibilità di levigare la pelle "imperfetta" e persino di modificare l'età del soggetto, fino al punto in cui si potrebbe dire che l'identità è stata sostanzialmente alterata:

Clicca per giocare: tre donne disattivano i filtri di "abbellimento" dei loro video, rivelando in che misura la loro fisionomia viene alterata dagli algoritmi o dall'intelligenza artificiale. Fonte: https://www.youtube.com/watch?v=gtCpea_5qxw

Il fenomeno sembrava raggiungere il punto di saturazione non appena la tecnologia era relativamente matura; un 2020 studio della City University di Londra ha rivelato che il 90% dei giovani utenti di Snapchat negli Stati Uniti, in Francia e nel Regno Unito utilizzava filtri nelle proprie app, mentre Meta ha riferito che più di 600 milioni di giovani avevano utilizzato filtri su Facebook o Instagram.

Esplorando gli effetti negativi di tali filtri sulla salute mentale, un articolo di Psychology Today rapporto ha ribadito che, tra le donne studiate, il 90%, con un'età media di 20 anni, utilizzava filtri o modificava in qualche modo le proprie foto. I filtri più popolari erano quelli utilizzati per uniformare il tono della pelle, dare un aspetto abbronzato, sbiancare i denti e persino ridurre le dimensioni del corpo.

Face Off

Poiché i filtri per il viso trarranno vantaggio dal 2025 rivoluzione nella sintesi video, e più in generale dal continuo interesse in questo settore di ricerca, la misura in cui possiamo "ricreare" o reimmaginare noi stessi nelle chat video in diretta sta sempre più scontrandosi con la preoccupazione della comunità della sicurezza riguardo a frodi o tecniche video deepfake criminali.

Un problema è che la gamma di test 'facili' sviluppato negli ultimi anni per rivelare un deepfaker video, che potrebbe cercare di frodare grandi quantità di denaro in un contesto aziendale, stanno inevitabilmente diventando meno efficaci poiché questi punti deboli vengono presi in considerazione nei dati di formazione e al momento dell'inferenza:

Clicca per giocare: Tre o quattro anni fa, agitare una mano davanti a un volto deepfake era un test affidabile per le videochiamate, ma possiamo vedere che gli sforzi dedicati di aziende come TikTok stanno facendo progressi nei classici "tell". Fonti: Ibid e https://archive.is/mofRV#wavehands

Ancora più critico, l'uso diffuso di filtri di abbellimento che cambiano/alterano il volto confonde le acque per una nuova ed emergente generazione di rilevatori di deepfake incaricati di tenere gli impostori fuori dalle videochiamate delle sale riunioni e lontano dalle potenziali vittime vulnerabili di frode del "rapimento" e dell'"impostore".

È più facile rendere convincente un deepfake, che sia una foto o un video, se la risoluzione dell'immagine è bassa oppure l'immagine in qualche modo degradata, poiché il sistema di falsificazione sottostante può nascondere i propri difetti dietro quelli che sembrano problemi di connettività o di piattaforma.

In effetti, i filtri di abbellimento più diffusi rimuovono alcuni dei materiali più utili per identificare i deepfake video, come la texture della pelle e altre aree del viso con dettagli. Vale la pena considerare che più un viso è vecchio, più è probabile che contenga tali dettagli, e quindi l'uso di filtri anti-invecchiamento di vanità può essere una tentazione particolare in tal caso.

Se è di moda un look in stile "androide" privo di dettagli, i rilevatori di deepfake potrebbero non avere il materiale necessario per distinguere tra immagini e personaggi video reali e falsi. Fonte: https://www.instagram.com/reel/DMyGerPtTPF/?hl=en

La Royal Society di fine 2024 carta Ciò che è bello è ancora buono: l'effetto alone di attrattività nell'era dei filtri di bellezza è stato confermato che l'uso di filtri aumenta universalmente l'attrattiva generale in entrambi i sessi (anche se una maggiore attrattiva tende a ridurre la stima generale dell'intelligenza nelle donne filtrate in base alla bellezza).

Pertanto è giusto dire che si tratta di una tecnologia popolare, che funziona e che sarebbe una sorta di shock culturale se improvvisamente venisse soggetta a limitazioni di sicurezza o vietata in diversi contesti.

Tuttavia, in un periodo in cui i video deepfake minacciano di diventare indistinguibili dai veri partecipanti al video, sia nell'aspetto che nel parlato, è possibile che in futuro il mero "rumore" globale dei filtri di bellezza debba essere attenuato per motivi di sicurezza.

Criminali abili

La questione è stata recentemente indagata in un nuovo documento dall'Università di Cagliari in Italia, intitolato Bellezza ingannevole: valutazione dell'impatto dei filtri di bellezza sul rilevamento di attacchi deepfake e morphing.

Nel nuovo studio, i ricercatori hanno applicato filtri di bellezza ai volti provenienti da due set di dati di riferimento e hanno testato diversi rilevatori di attacchi deepfake e morphing sia sulle immagini originali che su quelle modificate.

In quasi tutti i casi, l'accuratezza del rilevamento è diminuita dopo l'abbellimento; i cali più drastici si sono verificati quando i filtri hanno attenuato le rughe, schiarito il tono della pelle o rimodellato leggermente i tratti del viso. Questi cambiamenti hanno rimosso o distorto proprio gli indizi su cui si basano i modelli di rilevamento.

Ad esempio, il modello più performante su MorphDB ha perso più del 9% di accuratezza dopo il filtraggio e il problema è persistito in più architetture di rilevamento, il che indica che i sistemi attuali non sono resistenti ai comuni miglioramenti estetici.

Gli autori concludono:

I filtri [di abbellimento] rappresentano una minaccia per l'integrità dei sistemi di autenticazione biometrica e di analisi forense, rendendo il rilevamento affidabile di attacchi deepfake e morph in tali condizioni una sfida aperta e critica.

"I lavori futuri dovrebbero dare priorità allo sviluppo di sistemi di rilevamento delle manipolazioni digitali che siano resistenti a tali sottili alterazioni del mondo reale, siano esse dolose o meno, per garantire un riconoscimento affidabile dell'identità e una verifica dei contenuti in contesti quotidiani e critici per la sicurezza".

Metodo e dati

Per valutare come i filtri di bellezza influenzano il deepfake e rilevamento della metamorfosi, i ricercatori hanno applicato un filtro di smoothing progressivo e hanno testato i risultati su due reti neurali convoluzionali di riferimento (CNN) ben associato al problema target: AlexNet e VGG19.

Ciascuno dei due set di dati di riferimento testati conteneva esempi di manipolazioni facciali appropriate. Il primo era CelebDF, un benchmark video su larga scala con 590 clip reali e 5,639 clip contraffatte, create tramite tecniche avanzate di face-swap. La raccolta offre una vasta gamma di condizioni di illuminazione, pose del capo ed espressioni naturali di 59 individui, rendendola adatta per valutare la resilienza dei rilevatori di deepfake in scenari mediatici reali:

Esempi di immagini facciali alterate, da CelebDF. Fonte: https://github.com/yuezunli/celeb-deepfakeforensics

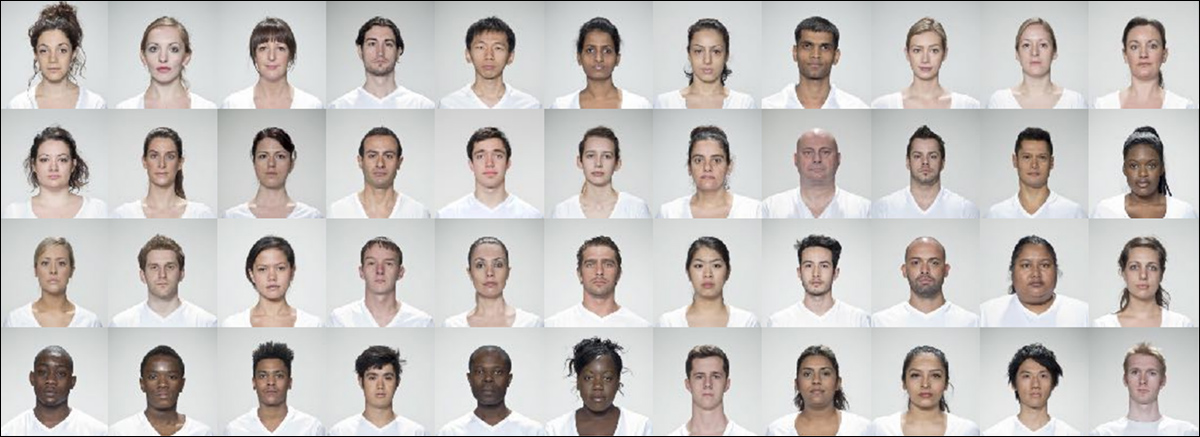

Il secondo è stato Livello del mare (registrazione richiesta), un set di dati di attacchi morphing creato dal Face Research Lab di Londra collezione, contenente volti reali e volti sintetici. Il set di dati include espressioni neutre e sorridenti di 102 soggetti ed è stato strutturato per riflettere le sfide realistiche dei sistemi di autenticazione biometrica utilizzati in contesti come il controllo delle frontiere.

Immagini dal set di dati sorgente Face Research Lab London set (FRLL), utilizzato in AMSL. Fonte: https://figshare.com/articles/dataset/Face_Research_Lab_London_Set/5047666?file=8541955

Ogni rete è stata addestrata sull'80% del set di dati deepfake o morphing, mentre il restante 20% è stato utilizzato per convalidaPer testare la robustezza rispetto all'abbellimento, i ricercatori hanno quindi applicato un filtro di levigatura progressiva alle immagini di prova, aumentando il raggio di sfocatura dal 3% al 5% dell'altezza del viso:

Esempi di volti tratti dai dataset CelebDF (in alto) e AMSL (in basso), mostrati prima e dopo l'applicazione di un filtro di bellezza basato sullo smoothing. Il raggio del filtro è stato scalato in base all'altezza del volto, con c = 3% e c = 5%, producendo effetti progressivamente più intensi.

Per quanto riguarda le metriche, ogni modello è stato valutato utilizzando il tasso di errore uguale (EER) sia sui campioni di prova originali che su quelli abbelliti. L'analisi ha anche riportato il tasso di errore di classificazione della presentazione Bona Fide (BPCER), o tasso di falsi positivi, e il tasso di errore di classificazione della presentazione dell'attacco (APCER), o tasso di falsi negativi, utilizzando la soglia impostata sui dati originali.

Volti trasformati dal set di dati AMSL.

Per valutare ulteriormente le prestazioni, l'area sotto la curva ROC (AUC) e sono state esaminate le distribuzioni dei punteggi per le immagini reali e false.

Test

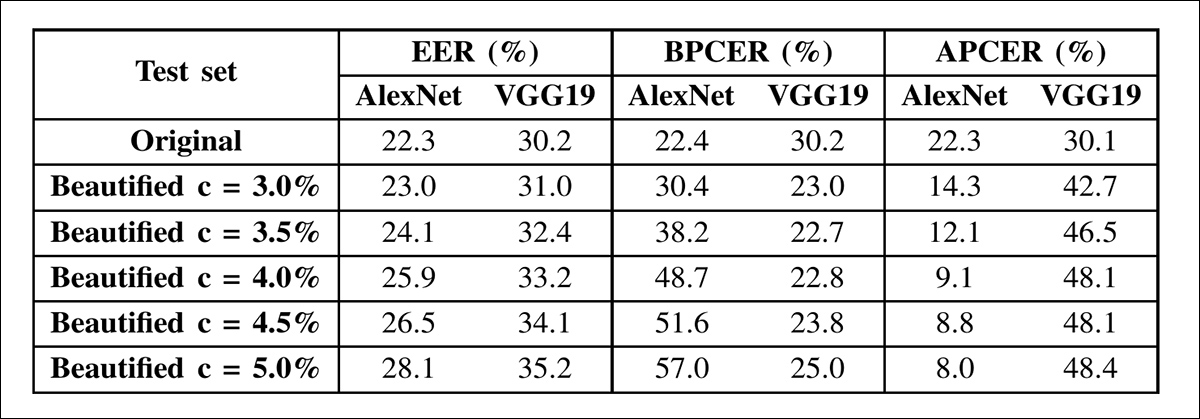

Nei risultati del rilevamento dei deepfake, entrambe le reti hanno mostrato un aumento dell'EER (Equal Error Rate) con l'aumentare dell'intensità di abbellimento. L'EER di AlexNet è aumentato dal 22.3% sulle immagini originali al 28.1% al livello di smoothing più elevato, mentre quello di VGG19 è aumentato dal 30.2% al 35.2%. Il calo delle prestazioni ha seguito andamenti diversi in ciascun caso:

Risultati del rilevamento di deepfake sul dataset CelebDF utilizzando AlexNet e VGG19. Entrambi i modelli sono stati testati su immagini originali e abbellite con livelli crescenti di smoothing facciale. Le metriche mostrate includono Equal Error Rate (EER), Bona Fide Presentation Classification Error Rate (BPCER) e Attack Presentation Classification Error Rate (APCER), utilizzando soglie fisse del set di test originale. L'accuratezza del rilevamento è diminuita all'aumentare dell'intensità dell'abbellimento, sebbene il modello di degradazione differisse tra le architetture.

Con l'aumento dell'abbellimento, AlexNet è diventato più propenso a scambiare volti reali per falsi, come dimostrato da un costante aumento del tasso di falsi positivi (BPCER). VGG19, d'altra parte, ha avuto difficoltà a individuare i falsi, con un tasso di falsi negativi (APCER) in crescita. I due modelli hanno risposto in modo diverso ai filtri, a indicare che anche architetture note possono fallire in modi diversi quando si trovano ad affrontare alterazioni estetiche.

Per comprendere meglio questi risultati, i ricercatori hanno applicato il filtro di abbellimento separatamente alle immagini reali e a quelle false e ne hanno misurato l'impatto sulle prestazioni di rilevamento. Questa ripartizione, mostrata nella tabella dei risultati sottostante, chiarisce l'origine della vulnerabilità di ciascun modello:

Precisione di rilevamento per AlexNet e VGG19 con abbellimento parziale sul dataset CelebDF. La tabella riporta tre scenari: reale abbellito vs falso abbellito (F-Real vs F-Fake); reale abbellito vs falso originale (F-Real vs O-Fake); e reale originale vs falso abbellito (O-Real vs F-Fake), con una diminuzione della precisione che indica una riduzione delle prestazioni del rilevatore. AlexNet è stato maggiormente influenzato quando le immagini reali sono state abbellite, mentre VGG19 ha avuto maggiori difficoltà quando l'abbellimento è stato applicato alle immagini false.

Per AlexNet, le prestazioni di rilevamento sono diminuite quando le immagini reali sono state abbellite, ma sono migliorate quando sono state smussate solo le immagini false. Per VGG19, le prestazioni sono migliorate leggermente con le immagini reali abbellite, ma sono peggiorate quando i deepfake sono stati filtrati. In tutti i casi, abbellimento più forte precisione ridotta.

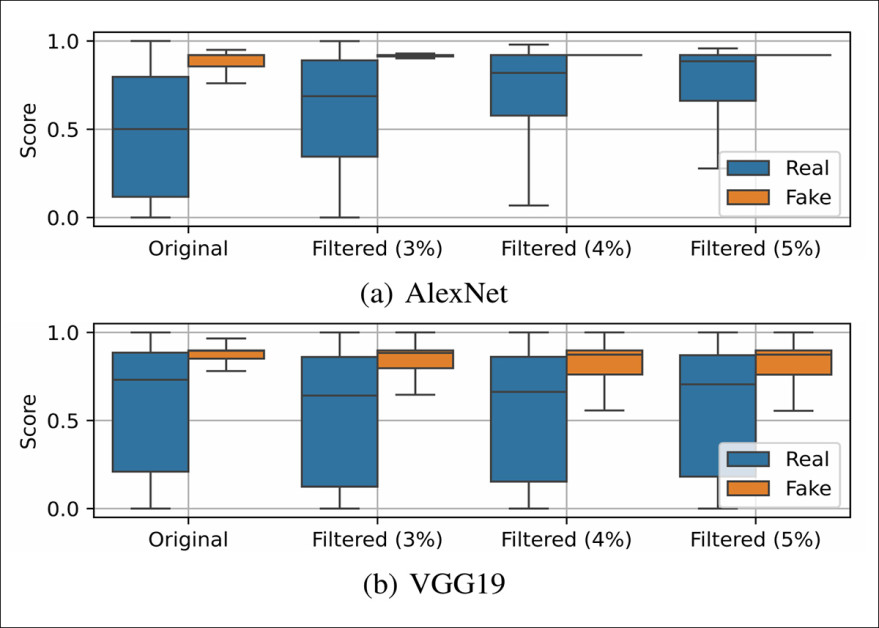

Box-plot che mostrano le distribuzioni dei punteggi di output di AlexNet e VGG19 su campioni reali e falsi dal dataset CelebDF, con livelli crescenti di abbellimento. Con l'intensificarsi dello smoothing, le distribuzioni dei punteggi per immagini reali e false diventano meno separabili, indicando una ridotta affidabilità del rilevamento. AlexNet diventa meno affidabile nell'identificare volti reali, mentre VGG19 diventa più propenso a classificare erroneamente quelli falsi.

L'abbellimento ha reso i punteggi di output di AlexNet più uniformi sia nei campioni reali che in quelli falsi, mentre VGG19 ha mostrato una maggiore dispersione all'interno di ciascuna classe. Nonostante questi effetti contrastanti sulla variabilità dei punteggi, entrambi i modelli hanno perso accuratezza. Per AlexNet, i punteggi dei volti reali si sono avvicinati a quelli dei deepfake. Per VGG19, i punteggi delle immagini reali e false hanno iniziato a sovrapporsi, riducendo la capacità del modello di distinguerli.

Il documento afferma:

Questi risultati hanno implicazioni importanti e rivelano la necessità di considerare il potenziale utilizzo di filtri di abbellimento nel rilevamento dei deepfake, poiché questi potrebbero avere un impatto imprevedibile sulle prestazioni. In particolare, diverse architetture rispondono in modo diverso alle manipolazioni facciali, anche se tali manipolazioni non sono pensate per ingannare.

Ad esempio, in base allo specifico rilevatore di deepfake, i filtri di abbellimento potrebbero alterare significativamente l'output, facendo sì che le immagini reali vengano identificate come false e, cosa ancora più importante, consentendo ai deepfake di ingannare il rilevamento.

"Pertanto, è necessario concentrarsi sullo sviluppo di rilevatori più resistenti a tali alterazioni sottili e non strettamente dannose che potrebbero servire da camuffamento per manipolazioni deepfake dannose".

Nello scenario di attacco morphing, un'immagine sintetica è stata creata combinando i tratti del viso di due individui. Questa immagine è stata utilizzata per ingannare i sistemi di riconoscimento facciale, consentendo di autenticare entrambe le identità di origine come se fossero la stessa persona. Tali attacchi sono considerati particolarmente rilevanti in contesti di sicurezza, dove i sistemi biometrici potrebbe essere tratto in inganno nell'accettare l'immagine modificata per l'identificazione ufficiale.

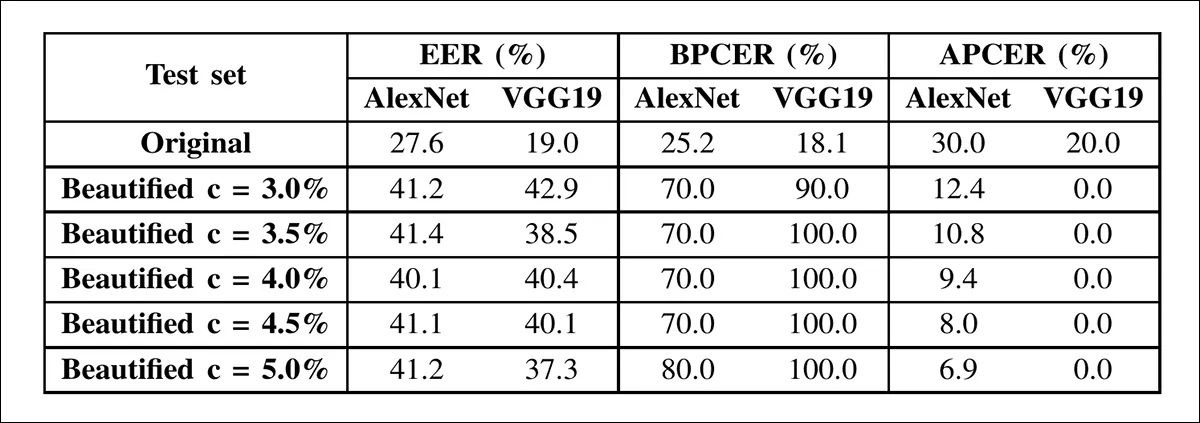

La tabella sopra mostra i risultati del rilevamento degli attacchi di morphing sulle immagini AMSL prima e dopo l'abbellimento, con entrambe le reti che mostrano forti aumenti di errore all'aumentare dell'intensità di smoothing.

Nello scenario di attacco morphing, le prestazioni sono peggiorate più drasticamente rispetto al rilevamento deepfake. L'EER di AlexNet è salito dal 27.6% al 41.2% e quello di VGG19 dal 19.0% al 37.3%, principalmente a causa di falsi positivi: volti autentici classificati erroneamente come morph. Con un raggio di smoothing del 3%, il tasso di falsi positivi di VGG19 ha raggiunto il 90%.

Questo schema si è mantenuto quando i filtri sono stati applicati selettivamente. La levigatura dei volti reali ha peggiorato il rilevamento, mentre la levigatura dei soli volti modificati ha migliorato i risultati. Con l'intensificarsi della levigatura, entrambe le reti hanno mostrato una riduzione della separazione tra punteggi reali e falsi, con VGG19 che è diventato particolarmente instabile.

Questi risultati, indicano gli autori, suggeriscono che i filtri di bellezza potrebbero aiutare i morph a eludere il rilevamento ancora più efficace dei deepfake, sollevando gravi preoccupazioni in termini di sicurezza.

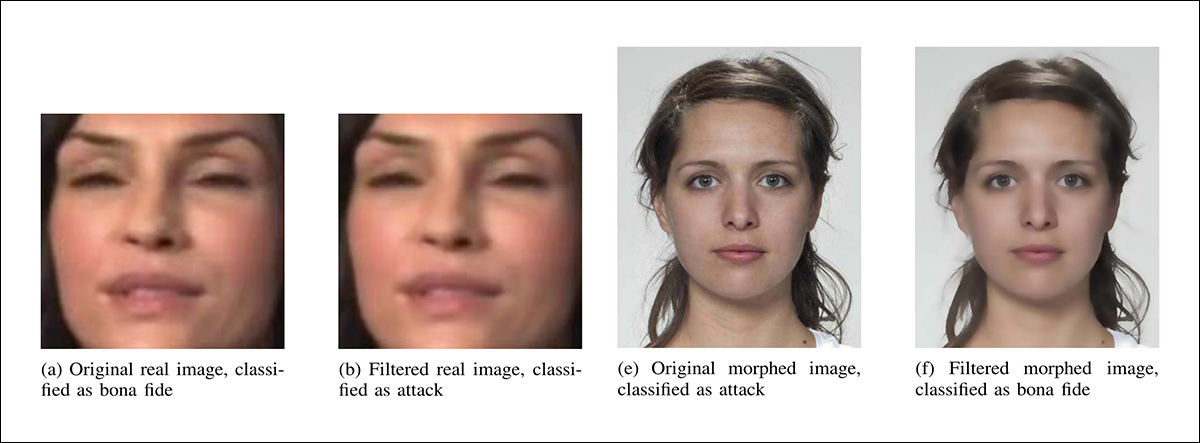

Esempi parziali (per mancanza di spazio) di come un abbellimento minimo (raggio di smoothing del 3%) abbia alterato le classificazioni di AlexNet. A sinistra, un'immagine reale viene classificata erroneamente come un attacco dopo il filtraggio, e a destra, un'immagine modificata viene classificata erroneamente come autentica dopo il filtraggio.

Infine, i ricercatori hanno scoperto che anche i filtri di abbellimento più blandi possono ridurre significativamente le prestazioni dei rilevatori di deepfake e morphing più all'avanguardia.

L'impatto variava a seconda dell'architettura, con AlexNet che mostrava un declino graduale e VGG19 che collassava con un filtraggio minimo. Poiché questi filtri sono comuni e non intrinsecamente dannosi, la loro capacità di nascondere gli attacchi rappresenta, suggeriscono gli autori, una minaccia concreta, soprattutto nei sistemi biometrici. Il documento sottolinea la necessità di modelli di rilevamento robusti anche a manipolazioni di immagini così sottili.

Conclusione

Uno dei motivi per cui potrebbe essere difficile addestrare sistemi di rilevamento deepfake in grado di ignorare i filtri di abbellimento è la mancanza di materiale di contrasto; in definitiva, la versione "abbellita" è quella che viene ampiamente diffusa e, a differenza del video che abbiamo incorporato in precedenza a titolo illustrativo, è molto raro che venga applicata un'immagine "prima".

Un altro ostacolo è che molti filtri eseguono esattamente il tipo di smoothing tipico delle operazioni di compressione durante il salvataggio delle immagini o la compressione dei video (un vantaggio per la larghezza di banda dei provider, oltre a rappresentare un restyling digitale per coloro che utilizzano il filtro).

Il settore della ricerca sul rilevamento dei deepfake è già profondamente impegnato nella lotta contro i casi di degrado delle immagini nel mondo reale dovuti a problemi quali fotocamere di scarsa qualità, compressione eccessiva o connettività di rete instabile: tutte queste condizioni rappresentano un vantaggio diretto per i truffatori di deepfake, costretti a impegnarsi molto di più in uno scenario di alta qualità e alta risoluzione.

Se i filtri di abbellimento alla fine diventino o meno una minaccia come responsabilità per la sicurezza sembra probabile che dipenda dalla misura in cui si rivelino un impedimento ai metodi di screening dei deepfake o finiscano per costituire una sorta di de facto un firewall che avvantaggia i malfattori più di coloro che li combattono.

Prima pubblicazione mercoledì 24 settembre 2025