Intelligenza artificiale

I modelli di intelligenza artificiale inciampano nella lettura di base dell’orologio mentre gli esseri umani eccellono

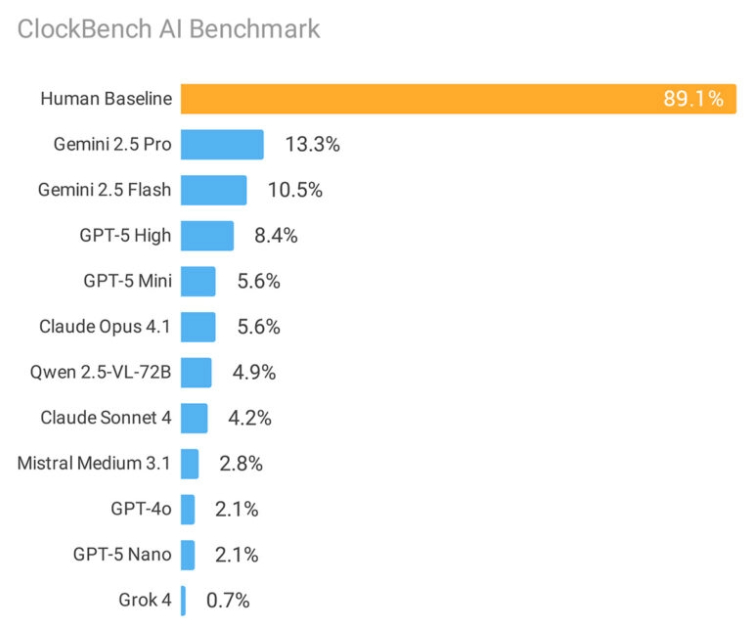

Uno studio completo che testa 11 modelli di intelligenza artificiale di punta contro gli esseri umani nella lettura di orologi analogici ha esposto una debolezza sorprendente negli attuali sistemi di intelligenza artificiale. Mentre gli esseri umani hanno raggiunto il 89,1% di accuratezza nel dire l’ora, il modello migliore di Google ha gestito solo il 13,3% di accuratezza nello stesso test.

Lo studio ClockBench, condotto dal ricercatore Alek Safar, dimostra che anche i sistemi di intelligenza artificiale più avanzati lottano con compiti visivi che la maggior parte delle persone padroneggia da bambino. Il benchmark ha testato sistemi di Google, OpenAI, Anthropic e altri importanti laboratori di intelligenza artificiale utilizzando 180 orologi analogici personalizzati.

Ciò va oltre gli orologi. I risultati evidenziano limitazioni fondamentali nel modo in cui i sistemi di intelligenza artificiale elaborano e ragionano sulle informazioni visive. “La lettura degli orologi analogici stabilisce una barra alta per eseguire ragionamenti all’interno dello spazio visivo”, nota Safar nel documento di ricerca. Il compito richiede ai modelli di identificare le mani dell’orologio, comprendere le loro relazioni e tradurre la posizione visiva in ora numerica.

Il divario di prestazioni diventa ancora più sorprendente quando si esaminano i modelli di errore. Quando gli esseri umani facevano errori, l’errore mediano era di solo tre minuti. I modelli di intelligenza artificiale, al contrario, hanno mancato il segno di uno a tre ore – all’incirca equivalente a indovinare a caso su un orologio da 12 ore.

Debolezze specifiche rivelate

I sistemi di intelligenza artificiale hanno particolarmente lottato con:

- numeri romani (3,2% di accuratezza)

- orologi con quadranti specchiati o al contrario

- sfondi colorati o design complessi

- orologi con lancette dei secondi che richiedono letture precise

Interessantemente, quando i modelli di intelligenza artificiale hanno letto correttamente un orologio, hanno eseguito bene compiti successivi come aggiungere ore o convertire fusi orari. Ciò suggerisce che la sfida fondamentale risiede nel riconoscimento visivo iniziale piuttosto che nel ragionamento matematico.

Riepilogo delle prestazioni dell’industria

I modelli di Google hanno guidato il gruppo, con Gemini 2.5 Pro che ha raggiunto il 13,3% di accuratezza e Gemini 2.5 Flash che ha raggiunto il 10,5%. OpenAI’s GPT-5 ha segnato l’8,4%, mentre i modelli Anthropic’s Claude hanno eseguito peggio, con Claude 4 Sonnet al 4,2% e Claude 4.1 Opus al 5,6%.

I modelli xAI’s Grok 4 hanno ottenuto risultati sorprendentemente scadenti con un’accuratezza dell’0,7%, sebbene ciò derivi dal fatto che il modello ha segnalato erroneamente il 63% di tutti gli orologi come mostranti ore impossibili quando solo il 20,6% lo faceva effettivamente.

Fonte: Alek Safar

Implicazioni più ampie per lo sviluppo dell’intelligenza artificiale

Lo studio si basa sull’approccio di benchmark “facile per gli esseri umani, difficile per l’intelligenza artificiale” visto in test come ARC-AGI e SimpleBench. Mentre i sistemi di intelligenza artificiale hanno rapidamente conquistato compiti intensivi di conoscenza e addirittura superato le prestazioni umane in molti test standardizzati, il ragionamento visivo di base rimane problematico.

La ricerca suggerisce che gli attuali approcci di scalabilità potrebbero non risolvere le sfide del ragionamento visivo. Safar ipotizza che gli orologi analogici potrebbero essere sottorappresentati nei dati di training e che tradurre le rappresentazioni visive dell’orologio in testo per il ragionamento crea ulteriori complicazioni.

ClockBench si unisce a una raccolta crescente di benchmark progettati per identificare le limitazioni dell’intelligenza artificiale che non sono immediatamente ovvie dalle prestazioni sui test tradizionali. L’intero set di dati rimane privato per evitare la contaminazione dei futuri dati di training dell’intelligenza artificiale, con solo piccoli campioni resi pubblici per il test.

I risultati sollevano domande su whether i paradigmi di sviluppo dell’intelligenza artificiale esistenti possano affrontare queste lacune nel ragionamento visivo o se saranno necessari approcci completamente nuovi – simili a come il calcolo del tempo di test ha sbloccato il progresso in altri domini.

Per ora, l’umile orologio analogico si erge come una fortezza inaspettata contro l’intelligenza artificiale, leggibile da quasi ogni essere umano ma sconcertante per i sistemi di intelligenza artificiale più sofisticati del mondo.