Intelligenza Artificiale

AI Image Matting che comprende le scene

Nel documentario extra che accompagna l'uscita in DVD del 2003 di Alien3 (1992), la leggenda degli effetti visivi Richard Edlund ha ricordato con orrore il "sumo wrestling" dell'estrazione di matte fotochimico che ha dominato il lavoro sugli effetti visivi tra 1930s fine e la fine degli anni '1980. Edlund ha descritto la natura imprevedibile del processo come "lotta sumo", in confronto alle tecniche digitali dello schermo blu/verde che hanno preso il sopravvento nei primi anni '1990 (e ha tornato alla metafora poiché).

L'estrazione di un elemento in primo piano (come una persona o un modello di astronave) da uno sfondo, in modo che l'immagine ritagliata possa essere composta in una lastra di sfondo, era originariamente ottenuta filmando l'oggetto in primo piano su uno sfondo blu o verde uniforme.

Processi laboriosi di estrazione fotochimica per un effetto visivo girato dalla ILM per "Il ritorno dello Jedi" (1983). Fonte: https://www.youtube.com/watch?v=qwMLOjqPmbQ

Nel metraggio risultante, il colore di sfondo sarebbe stato successivamente isolato chimicamente e utilizzato come modello per ristampare l'oggetto (o la persona) in primo piano in un stampante ottica come un oggetto "fluttuante" in una cella di pellicola altrimenti trasparente.

Il processo era noto come sovrapposizione di separazione dei colori (CSO), anche se questo termine alla fine sarebbe diventato più associato al grezzo 'Chromakey' effetti video nella produzione televisiva a basso budget degli anni '1970 e '1980, ottenuti con mezzi analogici piuttosto che chimici o digitali.

Una dimostrazione di Color Separation Overlay nel 1970 per lo spettacolo per bambini britannico 'Blue Peter'. Fonte: https://www.bbc.co.uk/archive/blue_peter_noakes_CSO/zwb9vwx

In ogni caso, sia per film che per elementi video, il metraggio estratto potrebbe essere successivamente inserito in qualsiasi altro metraggio.

Sebbene la Disney sia notevolmente più costosa e proprietaria processo a vapori di sodio (che puntava sul giallo, nello specifico, ed era anche utilizzato per l'horror del 1963 di Alfred Hitchcock Gli uccelli) ha dato una migliore definizione e mascherini più nitidi, l'estrazione fotochimica è rimasta scrupolosa e inaffidabile.

Il processo di estrazione a vapore di sodio brevettato dalla Disney richiedeva sfondi tendenti al giallo. Qui, Angela Lansbury è sospesa su fili durante la produzione di una sequenza ricca di effetti visivi per "Pomi d'ottone e manici di scopa" (1971). Fonte

Oltre il Digital Matting

Negli anni '1990, la rivoluzione digitale ha eliminato i prodotti chimici, ma non la necessità di schermi verdi. Ora era possibile rimuovere lo sfondo verde (o qualsiasi altro colore) semplicemente cercando i pixel all'interno di un intervallo di tolleranza di quel colore, in software di modifica dei pixel come Photoshop e una nuova generazione di suite di composizione video in grado di escludere automaticamente gli sfondi colorati. Quasi durante la notte, sessant'anni dell'industria della stampa ottica sono stati consegnati alla storia.

Gli ultimi dieci anni di ricerca sulla visione artificiale accelerata dalle GPU stanno introducendo l’estrazione matte in una terza era, incaricando i ricercatori di sviluppare sistemi in grado di estrarre mascherini di alta qualità senza la necessità di schermi verdi. Solo ad Arxiv, gli articoli relativi alle innovazioni nell’estrazione di primo piano basata sull’apprendimento automatico sono una caratteristica settimanale.

Mettendoci nella foto

Questo luogo di interesse accademico e industriale per l'estrazione dell'IA ha già avuto un impatto sullo spazio dei consumatori: implementazioni grezze ma realizzabili sono familiari a tutti noi sotto forma di Zoom Skype filtri che possono sostituire gli sfondi del nostro soggiorno con isole tropicali, ecc., nelle videoconferenze.

Tuttavia, i mascherini migliori richiedono ancora uno schermo verde, come Zoom notato mercoledì scorso.

A sinistra, un uomo davanti a uno schermo verde, con i capelli ben estratti tramite la funzione Sfondo Virtuale di Zoom. A destra, una donna davanti a una normale scena domestica, con i capelli estratti algoritmicamente, con minore accuratezza e con requisiti di elaborazione più elevati. Fonte: https://support.zoom.us/hc/en-us/articles/210707503-Changing-your-Virtual-Background-image

A ulteriore post dalla piattaforma Zoom Support avverte che l'estrazione senza schermo verde richiede anche una maggiore potenza di calcolo nel dispositivo di acquisizione.

La necessità di tagliarlo fuori

I miglioramenti in termini di qualità, portabilità e risparmio di risorse per i sistemi di estrazione opaca "in the wild" (ovvero l'isolamento delle persone senza la necessità di schermi verdi) sono rilevanti per molti altri settori e scopi oltre ai semplici filtri per videoconferenze.

Per lo sviluppo di set di dati, un riconoscimento facciale, completo della testa e del corpo intero migliorato offre la possibilità di garantire che elementi di sfondo estranei non vengano addestrati nei modelli di visione artificiale di soggetti umani; un isolamento più accurato migliorerebbe notevolmente segmentazione semantica tecniche progettate per distinguere e assimilare domini (es 'gatto', 'persona', 'barca'), e migliorare VAE trasformatoresistemi di sintesi di immagini basati su come il nuovo OpenAI DALL-MI2; e migliori algoritmi di estrazione ridurrebbero la necessità di costosi manuali rotoscoping in costose pipeline VFX.

In effetti, l'ascesa di multimodale (solitamente testo/immagine), in cui un dominio come "gatto" è codificato sia come immagine che con riferimenti testuali associati, sta già facendo breccia nell'elaborazione delle immagini. Un esempio recente è Testo2Live architettura, che utilizza la formazione multimodale (testo/immagine) per creare video di, tra una miriade di altre possibilità, cigni di cristallo e giraffe di vetro.

IA sensibile alla scena

Una buona parte della ricerca sulla stuoia automatica basata sull'intelligenza artificiale si è concentrata sul riconoscimento dei confini e sulla valutazione dei raggruppamenti basati sui pixel all'interno di un'immagine o di un fotogramma video. Tuttavia, una nuova ricerca dalla Cina offre una pipeline di estrazione che migliora la delineazione e la qualità opaca sfruttando descrizioni testuali di una scena (un approccio multimodale che ha preso piede nel settore della ricerca sulla visione artificiale negli ultimi 3-4 anni), affermando di aver migliorato i metodi precedenti in vari modi.

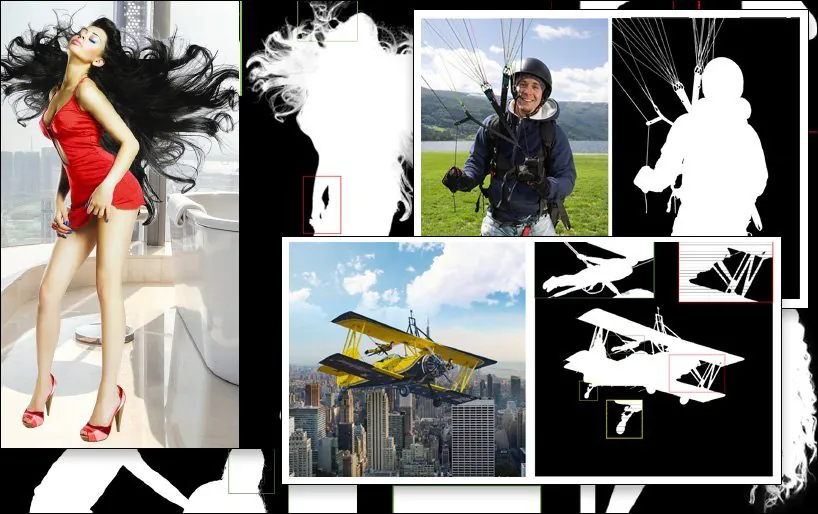

Un esempio di estrazione SPG-IM (ultima immagine, in basso a destra), rispetto ai metodi concorrenti precedenti. Fonte: https://arxiv.org/pdf/2204.09276.pdf

La sfida posta per il sottosettore della ricerca sull'estrazione è quella di produrre flussi di lavoro che richiedano un minimo indispensabile di annotazioni manuali e interventi umani, idealmente nessuno. Oltre alle implicazioni in termini di costi, i ricercatori del nuovo articolo osservano che le annotazioni e le segmentazioni manuali intraprese da crowdworker in outsourcing in varie culture possono far sì che le immagini vengano etichettate o addirittura segmentate in modi diversi, portando a algoritmi incoerenti e insoddisfacenti.

Un esempio di ciò è l'interpretazione soggettiva di ciò che definisce un "oggetto in primo piano":

Dal nuovo documento: metodi precedenti LFM MODNet ("GT" sta per Ground Truth, un risultato "ideale" spesso ottenuto manualmente o con metodi non algoritmici), hanno approcci diversi e variamente efficaci alla definizione del contenuto in primo piano, mentre il nuovo metodo SPG-IM delinea in modo più efficace il "contenuto vicino" attraverso il contesto della scena.

Per risolvere questo problema, i ricercatori hanno sviluppato una pipeline in due fasi intitolata Percezione situazionale Guidata Image Matting (SPG IM). L'architettura del codificatore/decodificatore a due stadi comprende Situational Perception Distillation (SPD) e Situational Perception Guided Matting (SPGM).

Innanzitutto, SPD preaddestra le trasformazioni delle caratteristiche visive in testuali, generando didascalie appropriate alle immagini associate. Successivamente, la previsione della maschera in primo piano viene abilitata collegando la pipeline a un romanzo previsione di salienza tecnica.

Quindi SPGM emette un mascherino alfa stimato in base all'input dell'immagine RGB non elaborata e alla maschera generata ottenuta nel primo modulo.

L'obiettivo è la guida alla percezione situazionale, in cui il sistema ha una comprensione contestuale di ciò in cui consiste l'immagine, consentendogli di inquadrare, ad esempio, la sfida di estrarre capelli complessi da uno sfondo rispetto a caratteristiche note di un compito così specifico.

Nell'esempio seguente, SPG-IM capisce che i cavi sono intrinseci a un "paracadute", mentre MODNet non riesce a mantenere e definire questi dettagli. Analogamente, la struttura completa dell'apparato del parco giochi viene arbitrariamente persa in MODNet.

La nuova carta è intitolato Percezione situazionale Guidata Image Matting, e proviene da ricercatori dell'OPPO Research Institute, PicUp.ai e Xmotors.

Matte automatizzati intelligenti

SPG-IM offre anche una rete di raffinamento AFT (Adaptive Focal Transformation) in grado di elaborare separatamente i dettagli locali e il contesto globale, facilitando i "matte intelligenti".

La comprensione del contesto della scena, in questo caso "ragazza con cavallo", può potenzialmente rendere l'estrazione del primo piano più semplice rispetto ai metodi precedenti.

Il documento afferma:

'Riteniamo che le rappresentazioni visive del compito visivo-testuale, ad es didascalia delle immagini, si concentra su segnali semanticamente più completi tra a) oggetto e oggetto e b) oggetto e ambiente circostante per generare descrizioni che possano coprire sia le informazioni globali che i dettagli locali. Inoltre, rispetto alla costosa annotazione pixel del matting delle immagini, le etichette testuali possono essere raccolte in massa a un costo molto basso.

Il ramo SPD dell'architettura è preaddestrato congiuntamente con l'Università del Michigan Virtex decodificatore testuale basato su trasformatore, che apprende rappresentazioni visive da didascalie semanticamente dense.

VirTex addestra congiuntamente una ConvNet e Transformers tramite distici di didascalie di immagini e trasferisce le informazioni ottenute alle attività di visione a valle come il rilevamento di oggetti. Fonte: https://arxiv.org/pdf/2006.06666.pdf

Tra gli altri test e gli studi sull'ablazione, i ricercatori hanno testato SPG-IM contro lo stato dell'arte trimapmetodi basati su Deep Image Matting (DIM), IndexNet, Image Matting sensibile al contesto (CAM), attenzione contestuale guidata (GCA), FBAe mappatura semantica delle immagini (SIM).

Altri framework precedenti testati includevano approcci senza trimap LFM, HAtMattinge MODNetPer un confronto equo, i metodi di prova sono stati adattati in base alle diverse metodologie; laddove il codice non era disponibile, le tecniche del documento sono state riprodotte dall'architettura descritta.

Il nuovo documento afferma:

"Il nostro SPG-IM supera di gran lunga tutti i metodi concorrenti senza trimap (LFM, HAttMatting e MODNet). Nel frattempo, il nostro modello mostra anche una notevole superiorità rispetto ai metodi all'avanguardia (SOTA) basati su trimap e guidati da maschera in termini di tutte e quattro le metriche nei dataset pubblici (ovvero Composition-1K, Distinction-646 e Human-2K) e nel nostro benchmark Multi-Object-1K."

E continua:

"Si può osservare chiaramente che il nostro metodo preserva i dettagli più fini (ad esempio, le punte dei capelli, le texture trasparenti e i bordi) senza la guida di trimap. Inoltre, rispetto ad altri modelli concorrenti privi di trimap, il nostro SPG-IM riesce a mantenere una migliore completezza semantica globale."

Pubblicato per la prima volta l'24 aprile 2022.