L'angolo di Anderson

La scrittura generata dall'intelligenza artificiale non si stanca mai e così si rivela

L'intelligenza artificiale in stile ChatGPT si rivela più coerente, mentre la scrittura umana rimane irregolare.

Il limitato finestra contestuale della maggior parte dei modelli linguistici di grandi dimensioni rivolti al consumatore (LLM) è uno dei fattori che possono fargli dimenticare o ricordare in modo errato parti precedenti delle conversazioni degli utenti: errori di richiamo che possono gradualmente trasformare il risultato in un totale nonsenso o, peggio, in un testo dall'aspetto ingannevolmente coerente che contiene errori sottili.

Poiché queste circostanze portano a allucinazioni, e poiché le allucinazioni sono ancora il più grande ostacolo Per far progredire l'IA nel mercato, sono stati spesi molti sforzi di ricerca nella creazione di sistemi di IA generativa in grado di creare porzioni di testo più lunghe ma molto più coerenti.

In effetti, si stanno facendo così tanti progressi che il riconoscimento di contenuti AI di lunga durata (vale a dire contenuti generati esclusivamente dall’IA, con – presumibilmente – un’assistenza umana minima o nulla) è considerato un problema crescente.

Smantellare un'IA ostruzionista

Tuttavia, recenti studi empirici contendere che più output producono i generatori di testo AI in un colpo solo, più è facile determinare se quel testo è stato scritto da un essere umano; ma la saggezza accettata riguardo a questo "ancoraggio" di rilevamento ha dato per scontato che l'IA possa essere individuata perché qualunque cosa stia facendo in modo diverso dagli umani, ha la possibilità di farlo più spesso in tratti più lunghi.

Non si fanno ipotesi circa distribuzione di questi "racconti" nel testo stesso.

Per contrastare questo fenomeno e ampliare il problema, un interessante studio di ricerca recente condotto in Cina offre un nuovo metodo per distinguere la nuova generazione di generatori di contenuti AI di lunga durata dagli autori umani. I ricercatori che hanno condotto lo studio sostengono che token-su-token la natura con cui viene generato il testo dell'IA significa che diventa più coerente con una lunghezza maggiore, mentre le eccentricità delle persone lo fanno non è un diminuire con la lunghezza.

In questo modo, gli autori suggeriscono che la loro intuizione offre una potenziale nuova metrica per i sistemi di rilevamento del testo basati sull'intelligenza artificiale*:

I token generati dall'intelligenza artificiale nell'ultima parte del testo mostrano fluttuazioni di probabilità più piccole e stabili, poiché le previsioni del modello diventano sempre più coerenti con l'accumularsi del contesto.

'Chiamiamo questo modello Decadimento della volatilità in fase avanzataQuesto fenomeno riflette il comportamento intrinseco della generazione autoregressiva: man mano che aumenta il contesto disponibile, la distribuzione delle previsioni del modello si affina, portando a una ridotta variabilità nelle statistiche a livello di token.

'La scrittura umana, al contrario, continua a introdurre scelte lessicali inaspettate e mantiene una maggiore volatilità nel corso del testo.'

Per catturare questa strana "fluidità" che si accumula nel testo dell'IA verso la fine, i ricercatori definiscono due semplici caratteristiche: la prima misura quanto il comportamento statistico della scrittura "salta" tra i token; la seconda controlla quanto stabili rimangono le cose su brevi tratti di testo.

Entrambi sono calcolati solo dal seconda metà dell'output, dove l'IA diventa notevolmente più regolare e la scrittura umana no. Gli autori notano che, sebbene questi segnali funzionino bene da soli, sono ancora più efficaci se combinati con metodi di rilevamento più vecchi che analizzano modelli più ampi. Notano anche che questo approccio funziona meglio su testi più lunghi, dove il contrasto può diventare più evidente.

Il nuovo documento propone una metodologia per testare l'"intelligenza artificiale" tramite l'analisi delle caratteristiche temporali della seconda metà, senza richiedere ulteriore formazione o messa a punto, né accesso privilegiato al modello.

. nuovo lavoro è intitolato Quando l'intelligenza artificiale si stabilizza: la stabilità in fase avanzata come caratteristica distintiva del rilevamento del testo generato dall'intelligenza artificialee proviene da quattro autori della Westlake University di Hangzhou.

Metodo

Per catturare la crescente fluidità del testo generato dall'intelligenza artificiale, i ricercatori hanno progettato due misurazioni che si concentrano solo sulla seconda metà di un passaggio. Queste si basano su punteggi di probabilità logaritmica da un modello linguistico standard e non richiedono alcuna messa a punto, riaddestramento o campioni aggiuntivi:

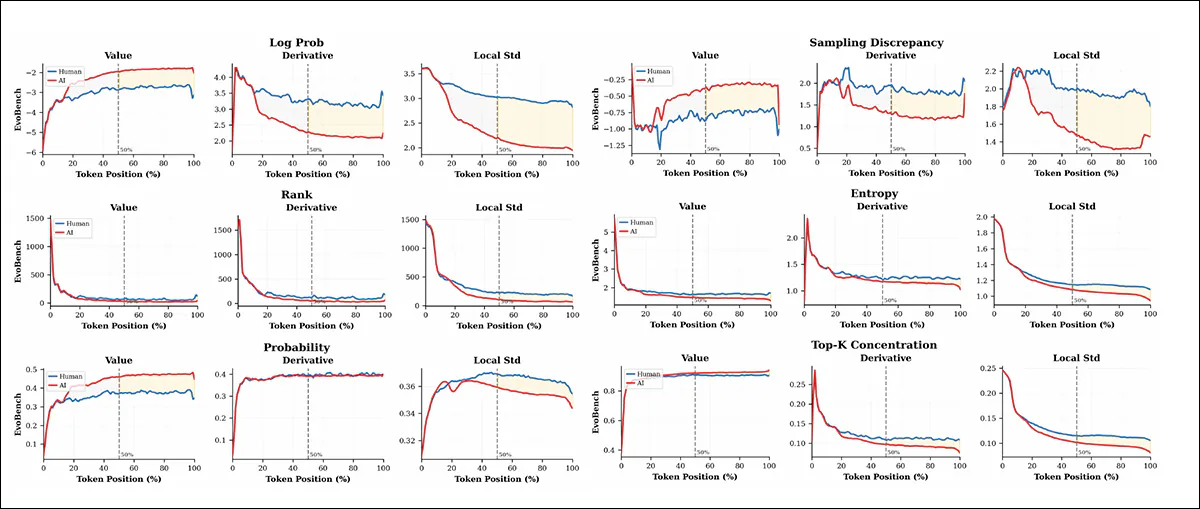

Dal nuovo articolo, ogni riga mostra il comportamento di una metrica di base di EvoBench lungo la sequenza di token: valore grezzo (a sinistra), derivata assoluta (al centro) e deviazione standard locale (a destra). Le linee umane e di intelligenza artificiale sono mostrate in blu e rosso. La maggior parte della divergenza appare nella seconda metà del testo, in particolare per la probabilità logaritmica e la discrepanza di campionamento, che mostrano una separazione crescente e un output di intelligenza artificiale più uniforme. Entropia e concentrazione Top-K mostrano poche variazioni nel tempo. Fonte

La prima misura, chiamata Dispersione derivata (DD) misura la rapidità con cui la sicurezza del modello cambia da una parola all'altra. Il testo scritto con l'intelligenza artificiale tende ad assestarsi su un ritmo, quindi questi cambiamenti diventano più piccoli e prevedibili nella seconda metà. Al contrario, la scrittura umana rimane "irregolare".

La seconda misura, Volatilità locale (LV), esamina quanto la fiducia del modello "oscilla" all'interno di una piccola finestra di testo. Ancora una volta, l'intelligenza artificiale tende a crescere in modo più costante nel tempo, mentre le scelte umane rimangono più sorprendenti e meno coerenti:

Il testo generato dall'intelligenza artificiale diventa più fluido man mano che procede, mentre la scrittura umana rimane irregolare. Questi grafici tracciano come l'affidabilità del modello cambia nel corso di un brano, riflettendo sia la nitidezza del cambiamento tra parole successive sia la quantità di variazione all'interno di porzioni locali di testo. In entrambi i casi, il calo è molto più ripido nell'output generato dalla macchina, con il contrasto che diventa particolarmente evidente dopo il punto centrale. I riquadri gialli evidenziano questo divario crescente nella seconda metà, dove la scrittura dell'intelligenza artificiale raggiunge una stabilità fino al 32% maggiore rispetto alla scrittura umana.

Ancora una volta, entrambe le metriche vengono calcolate solo a partire dal quest'ultimo metà del testo, dove la differenza tra la scrittura umana e quella automatica è più evidente. Questi vengono poi incorporati in un unico valore chiamato Rilevamento della stabilità temporale Punteggio (TSD) – che tende ad aumentare man mano che la scrittura diventa più "fluida" (e quindi più probabile che sia generata dall'intelligenza artificiale). Una semplice soglia viene quindi utilizzata per stabilire se un dato passaggio è probabilmente scritto da una macchina.

Poiché queste caratteristiche si concentrano su quando emerge uno schema, piuttosto che limitarsi a descrivere l'aspetto di tale schema, e vengono integrati da metodi più datati che ricercano anomalie statistiche nell'intero passaggio. Aggiungendo il punteggio TSD all'output dell'offerta di fine 2024 Fast-DetectGPT (sempre in collaborazione con Westlake) offre un ulteriore miglioramento nei risultati (soprattutto per i contenuti di lunga durata in cui l'effetto di smoothing nella fase finale è più forte).

Dati e test

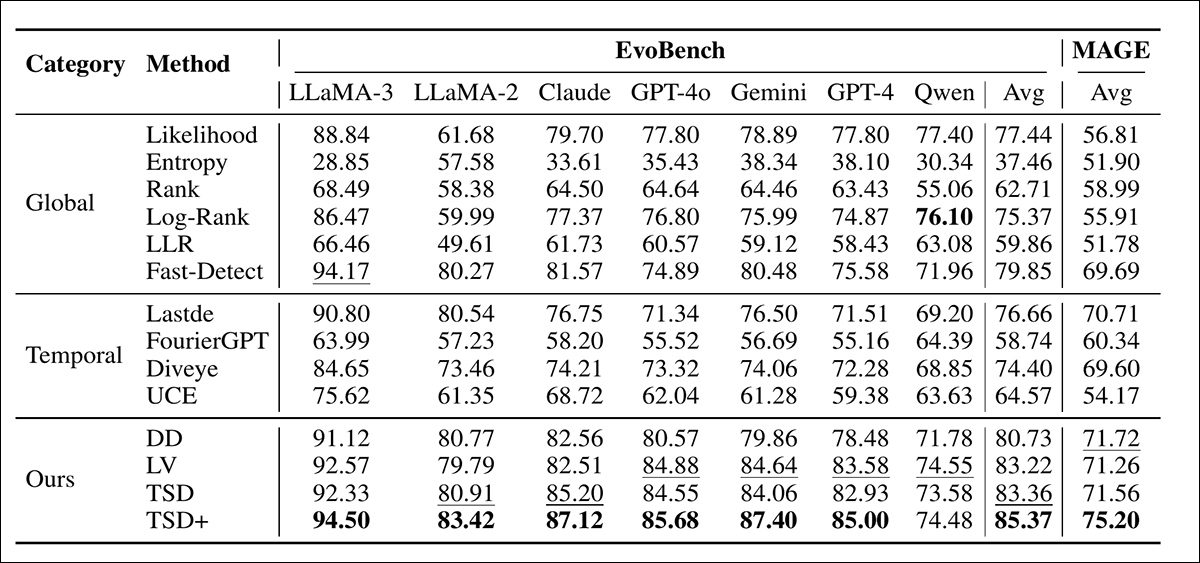

Gli autori hanno condotto test su due set di dati di riferimento correlati: EvoBench contiene 32,000 coppie di testo umano/IA generate su sette famiglie di modelli, tra cui GPT-4; GPT-4o; Claude; Google Gemelli; LLaMA-3, E Qwen, con un totale di 29 versioni di modello presentate.

L'altro quadro era Mago, che offre 30,000 coppie di test su otto famiglie di modelli, tra cui (ma non solo) la serie GPT di OpenAI e LLaMA, OPTe FLAN-T5 famiglie.

Contenders

Il nuovo metodo è stato testato su una serie di rilevatori zero-shot utilizzando lo stesso modello surrogato. Probabilità, entropia, Rangoe Log-Rank (Rileva GPT) statistiche misurate a livello di token durante l'intero passaggio; LLR (DetectLLM) ha applicato la normalizzazione per consentire il confronto diretto tra i modelli; e Rilevamento rapido curvatura locale stimata tramite perturbazioni basate sul campionamento.

Ultimo analizzate le sottosequenze discriminative nel segnale di probabilità, mentre FourierGPT operato nel dominio della frequenza. Diveye ha catturato i cambiamenti nella diversità "sorprendente" nella sequenza.

Infine, il ECU ha valutato il profilo di incertezza delle previsioni dei token, per identificare modelli di fiducia innaturali.

Attuazione e risultati

Tutti i metodi di rilevamento sono stati eseguiti utilizzando Llama-3-8B-Istruisci come modello surrogato condiviso, con sequenze di input limitate a 512 token. Le caratteristiche temporali sono state estratte solo dalla seconda metà di ogni passaggio, utilizzando un finestra scorrevole di 20 token per misurare la volatilità. Una versione fusa del metodo, chiamata TSD+, ha combinato il segnale proposto con Fast-DetectGPT.

Area sotto la curva caratteristica di funzionamento del ricevitore (AUROC) era la metrica di valutazione primaria†:

Prestazioni diverse tra i vari metodi testati su testo generato dall'intelligenza artificiale. L'accuratezza del rilevamento è dimostrata in due benchmark: EvoBench, che copre diversi LLM di alto profilo, e MAGE, un set di dati complementare. Le metriche sono raggruppate per tipo di metodo: statistiche globali, caratteristiche temporali e varianti proposte. I punteggi AUROC medi sono riportati nelle colonne finali. I risultati delle varianti del metodo degli autori superano costantemente le precedenti linee di base, con TSD+ che produce i punteggi più alti in quasi tutte le impostazioni del modello.

Di questi risultati iniziali, gli autori affermano:

Le nostre semplici caratteristiche temporali raggiungono prestazioni all'avanguardia tra i metodi autonomi, con TSD che raggiunge l'83.36% su EvoBench e il 71.56% su MAGE, superando tutte le linee di base, incluso Fast-DetectGPT.

"Ciò è notevole data la semplicità del nostro metodo: calcoliamo solo statistiche di secondo ordine dalla seconda metà delle sequenze, senza campionamento perturbativo o trasformazioni del dominio della frequenza."

Il nuovo metodo ha funzionato particolarmente bene sui modelli di intelligenza artificiale più recenti, come GPT-4 e GPT-4o, identificando il testo scritto dall'intelligenza artificiale con maggiore accuratezza rispetto al rilevatore più vicino, con un divario prestazionale fino al 9.66%. Sebbene i modelli più recenti e avanzati producano un testo meno "coerente", che nasconde alcuni segni di automazione, alcuni sottili schemi temporali sono ancora evidenti verso la fine.

Approcci concorrenti che si concentrano su ampie caratteristiche strutturali mancato per catturare questi modelli in fase avanzata. Integrando un rilevatore globale, il sistema ibrido apparentemente recupera questi segnali mancanti e migliora le prestazioni, in particolare nei benchmark in cui output di intelligenza artificiale più brevi possono indebolire gli indizi temporali.

Conclusione

Un aspetto non affrontato direttamente nel nuovo lavoro è la tendenza degli scrittori umani a ripetere il loro lavoro attraverso la stesura e vari livelli di controllo, a volte anche esterni, come il contributo di editor e correttori di bozze, nonché possibili modifiche suggerite dai dipartimenti legali, a seconda del contesto.

I molteplici soggetti interessati coinvolti in documenti semplici come un articolo di giornale ben nascosto possono praticamente cancellare le eccentricità su cui si concentra il nuovo sistema proposto, e di fatto equivalgono a una sorta di "versione analogica" di un processo di redazione assistito dall'intelligenza artificiale.

Inoltre, i sistemi in esame sono stati essi stessi addestrati per tali lavori e, poiché i dati di addestramento sono sempre più classificati in base all'autorità al momento dell'addestramento, le fonti più "ponderate" o considerate potrebbero essere le meno "naturali", almeno rispetto a qualcuno che scrive velocemente un'e-mail informale a un collega, invece di stilare un rapporto annuale per un'assemblea generale annuale.

Un'ulteriore e contrastante considerazione è che il contenuto del testo a cui hanno contribuito più persone può anche essere tra i pezzi di prosa più frammentati, imperfetti e ripetitivi da inserire in un set di dati, poiché spesso non è un hanno avuto il vantaggio di una voce unificante finale, lasciando evidente nella prosa la natura frammentaria del loro sviluppo.

* Lo stile del testo originale degli autori è stato riprodotto dall'articolo; le sottolineature non sono mie.

† Gli autori affermano "primario", senza elencare altri parametri di valutazione.

Prima pubblicazione lunedì 26 gennaio 2026