L'angolo di Anderson

Un'atmosfera anni '1970 per il monitoraggio dell'IA a risparmio energetico.

Una nuova ricerca dimostra che la maggior parte dell'intelligenza artificiale applicata ai video non necessita affatto del colore, attivandolo solo nei momenti chiave e riducendo il consumo di dati di oltre il 90% con una minima perdita di precisione.

Le telecamere di streaming remote e altri dispositivi video autonomi alimentati a batteria richiedono configurazioni di monitoraggio estremamente precise, poiché potrebbero dipendere da fonti di alimentazione instabili, come l'energia solare, o necessitare di ricariche periodiche o di altre forme di intervento umano, in situazioni in cui, idealmente, non dovrebbe essere necessaria la presenza di nessuno.

Parallelamente a questa linea di ricerca, cresce l'interesse per i dispositivi indossabili dotati di fotocamera. è cresciuto anche (anche se tali dispositivi erano già fortemente limitati da vincoli di potenza e di calcolo), perché bordo AI ora promette di renderli significativamente più utili.

Al di là di queste considerazioni, l'esigenza a lungo termine di ridurre i costi dell'IA edge e del monitoraggio (in particolare nei casi in cui tali risparmi non devono essere trasferiti al cliente) rende l'innovazione negli approcci al risparmio energetico per i casi d'uso "edge" particolarmente convincente.

Fai rumore

Nel campo della rilevamento video in streamingI dispositivi di monitoraggio edge con risorse limitate devono utilizzare la minor quantità di energia possibile, pur consumando energia sufficiente per monitorare gli eventi "interessanti", a quel punto varrà la pena impiegare più risorse.

In pratica, si tratta di un caso d'uso simile alle luci a rilevamento di movimento, che si illuminano solo quando sensori a basso consumo energetico rilevano la presenza di qualcuno.

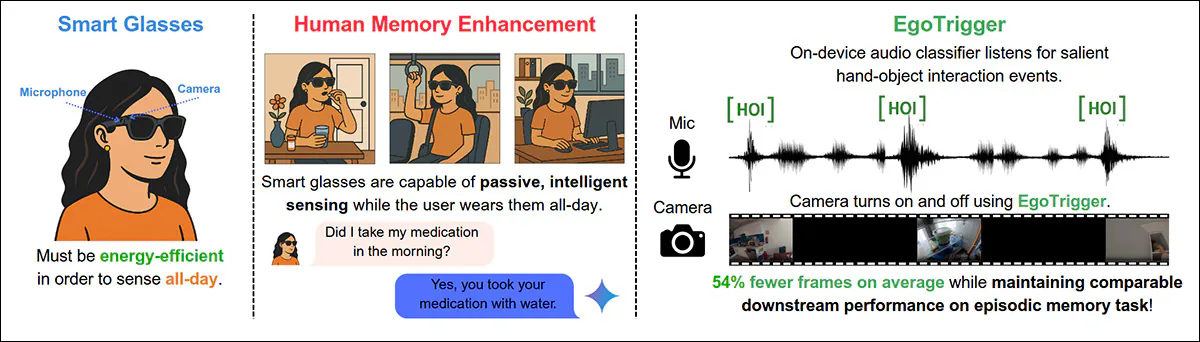

Poiché il monitoraggio e la compressione audio sono notevolmente meno dispendiosi in termini di risorse rispetto al video, negli ultimi anni diversi approcci hanno tentato di utilizzare segnali sonori per "attivare" l'attenzione in sistemi con risorse limitate; framework come Ascolta Guarda e Egotrigger:

Nel sistema Egotrigger, l'attivazione tramite segnali audio permette di acquisire immagini in modo selettivo a partire da segnali di interazione mano-oggetto, riducendo i fotogrammi ridondanti e preservando al contempo le prestazioni della memoria episodica nei sistemi di occhiali intelligenti con risorse limitate. Fonte

Chiaramente l'audio non è il mezzo ideale per individuare eventi visivi, poiché molti di questi eventi essenziali potrebbero non avere alcun segnale audio associato, oppure potrebbero verificarsi al di fuori della portata dei microfoni perimetrali.

Persona con un sonno leggero

Ciò che potrebbe essere meglio, suggerisce un nuovo documento, è un flusso video che può lavorare insieme all'IA per aumentare le risorse non appena si verifica un evento monitorato. La simulazione qui sotto* dà un'idea generale del concetto: il monitoraggio a bassa risoluzione viene mantenuto al livello minimo del segnale necessario per rilevamento di oggetti framework per operare e per indicare al sistema di aumentare la risoluzione a seguito del verificarsi di un evento:

Una simulazione del comportamento desiderato: lo streaming e l'analisi operano di default al minimo consumo di risorse, quel tanto che basta per attivare un maggiore consumo di risorse quando vengono rilevati eventi "interessanti" o ricercati nel flusso in scala di grigi. Lo stile di sorveglianza in bianco e nero può sembrare un po' "retrò", ma potrebbe essere un segnale di ciò che ci aspetta. Questo video è stato creato dall'autore esclusivamente a scopo illustrativo in relazione alle idee principali del nuovo articolo. Fonte:

Il nuovo lavoro, una collaborazione accademica tra varie istituzioni del Regno Unito e Huawei, propone un approccio senza addestramento, facilitato dall'IA, scala di grigi sempre, colore su richiesta schema per il monitoraggio dei bordi – progettato per funzionare a bassa frequenza token Utilizzo in assenza di "eventi chiave", con incremento del consumo solo per la durata dell'evento.

Nella comprensione dei benchmark di streaming video, il nuovo sistema, denominato ColorTrigger, è stato in grado di raggiungere il 91.6% delle prestazioni di base a colori utilizzando solo l'8.1% dei frame RGB in tali standard:

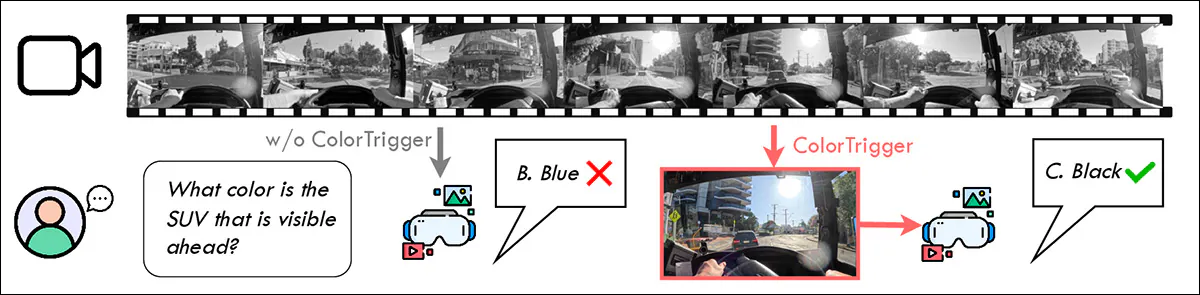

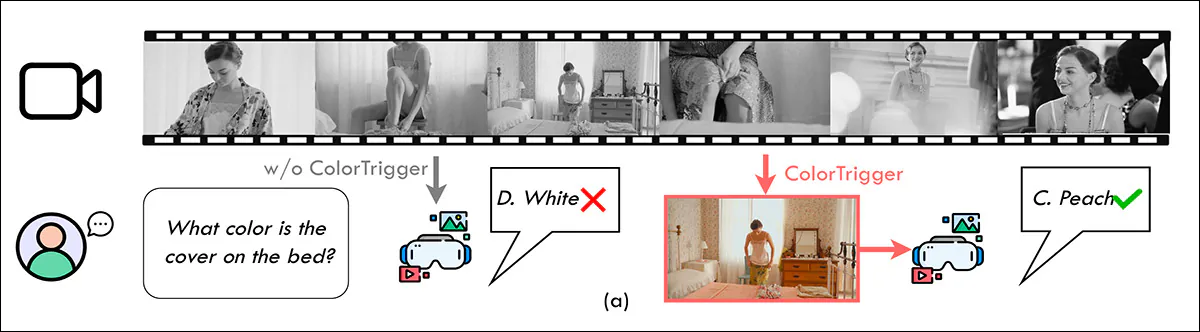

Quando il modello visualizza solo video in scala di grigi, confonde dettagli chiave e fornisce risposte errate; ma l'attivazione del colore al momento giusto disambigua l'immagine e corregge gli errori causati da compiti che dipendono dal colore. Fonte

Migliori nuovo documento è intitolato Il colore quando conta: attivazione online guidata dalla scala di grigi per il rilevamento di video in streaming sempre attivoe proviene da otto ricercatori della Queen Mary University di Londra, della Durham University, dell'Imperial College di Londra e dell'Huawei Noah's Ark Lab. L'articolo contiene anche un pagina del progetto di accompagnamento.

Metodo

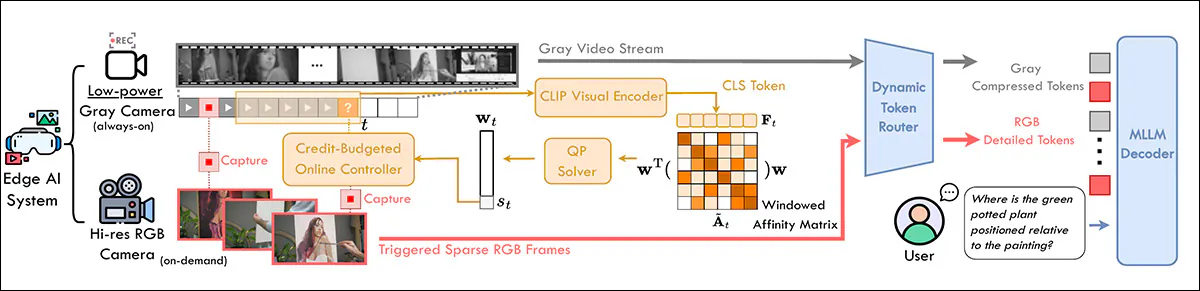

Per preservare la struttura temporale nel nuovo sistema, ColorTrigger mantiene una sorveglianza costante in scala di grigi a bassa larghezza di banda. Un trigger causale online analizza un finestra scorrevole (ovvero, un intervallo flessibile di fotogrammi con segno più o meno attorno a un determinato momento, come ad esempio il rilevamento di un evento scatenante) del flusso a bassa risoluzione:

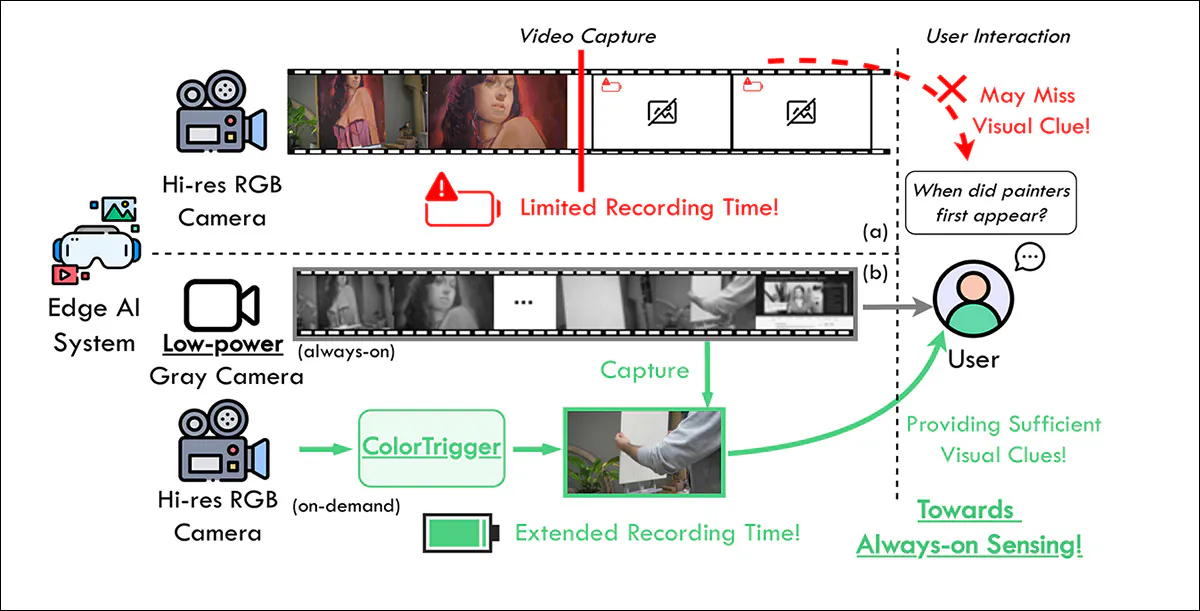

L'acquisizione continua di immagini RGB ad alta risoluzione consuma rapidamente energia, interrompendo la registrazione prematuramente e rischiando di far perdere momenti cruciali. Al contrario, ColorTrigger mantiene sempre attivo un flusso video in scala di grigi a basso consumo, attivando la telecamera RGB solo in momenti specifici, prolungando così la durata della registrazione e catturando i dettagli visivi necessari per rispondere a successive domande. Fonte

Mentre il sistema è in modalità "passiva" (ovvero, non ha ancora identificato un evento scatenante), il suo router di token dinamico alloca una capacità limitata a un decodificatore asimmetrico, cercando sempre ridondanza ed eventi che indichino novità, momento in cui il flusso di token riassegna la priorità alla capacità rispetto alla compressione:

Schema per ColorTrigger. Il sistema monitora un'analisi a finestra scorrevole dei fotogrammi recenti per rilevare ridondanze e cambiamenti, attivando l'acquisizione RGB ad alta risoluzione solo quando necessario, entro un budget basato su crediti. Un router di token dinamico assegna meno token agli input in scala di grigi e più ai fotogrammi RGB selezionati, preservando l'ordine temporale per l'elaborazione successiva del modello linguistico multimodale di grandi dimensioni (MLLM).

Fotogramma per fotogramma, il sistema deve decidere se il momento corrente contiene nuove informazioni che valgono il costo di catturare il colore. La breve cronologia recente dei fotogrammi in scala di grigi nella finestra scorrevole consente a ColorTrigger di confrontare il fotogramma corrente con il suo immediato passato. Ogni fotogramma viene convertito in un compatto rappresentazione delle caratteristichee queste caratteristiche vengono confrontate tra loro per misurare quanto siano simili o diverse le rispettive cornici di riferimento.

Questo processo di confronto è organizzato in una struttura che riassume quanto Ogni fotogramma si sovrappone agli altri, catturando efficacemente se la scena si ripete o cambia. Un semplice passaggio di ottimizzazione assegna un punteggio di importanza a ciascun fotogramma nella finestra, privilegiando la novità.

Bilanciamento del colore

Per evitare un uso eccessivo del colore, un semplice "sistema a crediti" limita la frequenza con cui il colore può essere attivato nel tempo. I crediti si accumulano gradualmente e vengono spesi quando si richiede il colore, garantendo che siano consentiti picchi di attività, ma che l'utilizzo complessivo rimanga controllato. Un'immagine viene "aggiornata" a colori solo se è informativa e se sono disponibili crediti a sufficienza.

Il Dynamic Token Router controlla la quantità di dettagli che ogni fotogramma riceve, anziché elaborare ogni fotogramma alla massima qualità. Quando non viene rilevato nulla di importante, il fotogramma in scala di grigi viene mantenuto a bassa risoluzione e trasformato in un piccolo set compresso di token. Quando viene rilevato un momento importante, il sistema passa al colore ed elabora il fotogramma a una risoluzione più elevata, offrendo una rappresentazione più ricca e dettagliata.

Entrambi i tipi di fotogrammi passano attraverso lo stesso modello, ma i fotogrammi in scala di grigi vengono elaborati in modo più leggero, mentre ai fotogrammi a colori selezionati viene dedicata maggiore attenzione. Gli output vengono quindi combinati nel loro ordine originale e inviati al modello come un flusso continuo.

Poiché la maggior parte dei frame rimane leggera e solo pochi vengono aggiornati, il sistema consente di risparmiare una grande quantità di risorse computazionali, pur acquisendo i dettagli chiave quando sono importanti:

Dal documento, un altro esempio in cui il sistema deve temporaneamente aumentare le risorse per distinguere un colore.

Dati e test

Per testare il sistema, i ricercatori hanno valutato rispetto a StreamingBench e OVO-Bench benchmark video, evitando l'elaborazione di futuro contenuto (che rappresenta un potenziale pericolo nei test offline).

Migliori congelati Il modello multimodale di linguaggio ampio (MLLM) utilizzato è stato InternVL3.5-8B-Istruttore, con l'innesco causale implementato tramite CLIP ViT-B/16.

Il flusso in scala di grigi è stato limitato al canale di luminanza nel CILAB spazio colore, in conformità con lavoro precedente, con i frame in scala di grigi risultanti ridimensionati a 224x224px prima di patchificazione (la suddivisione di un'immagine in piccoli blocchi di dimensioni fisse, in modo che ciascun blocco possa essere elaborato come un'unità separata dal modello).

I fotogrammi RGB, al contrario, presentavano un bitrate più elevato e venivano elaborati a 448x448 pixel, producendo 256 token, a differenza dei 64 token prodotti per i fotogrammi in scala di grigi.

Per prendere le decisioni del sistema sono stati utilizzati strumenti di ottimizzazione comuni: CVXPY (una libreria Python per impostare problemi di ottimizzazione) e Risolutore OSQP (un algoritmo veloce che calcola quando attivare il colore).

Il video è stato elaborato a 1 fps, con un limite di 128 fotogrammi per clip, per ridurre al minimo il carico computazionale.

I sistemi proprietari testati sono stati Gemelli 1.5 Pro; GPT-4o, E Claude 3.5 Sonetto. I modelli MLLM video open source testati sono stati LLaVA-OneVision-7B; Video-LLaMA2-7B, E Qwen2.5-VL-7B.

I modelli MLLM in streaming testati sono stati Flash-VStream-7B; VideoLLM-online-8B; Dispider-7B, E TimeChat-Online-7B.

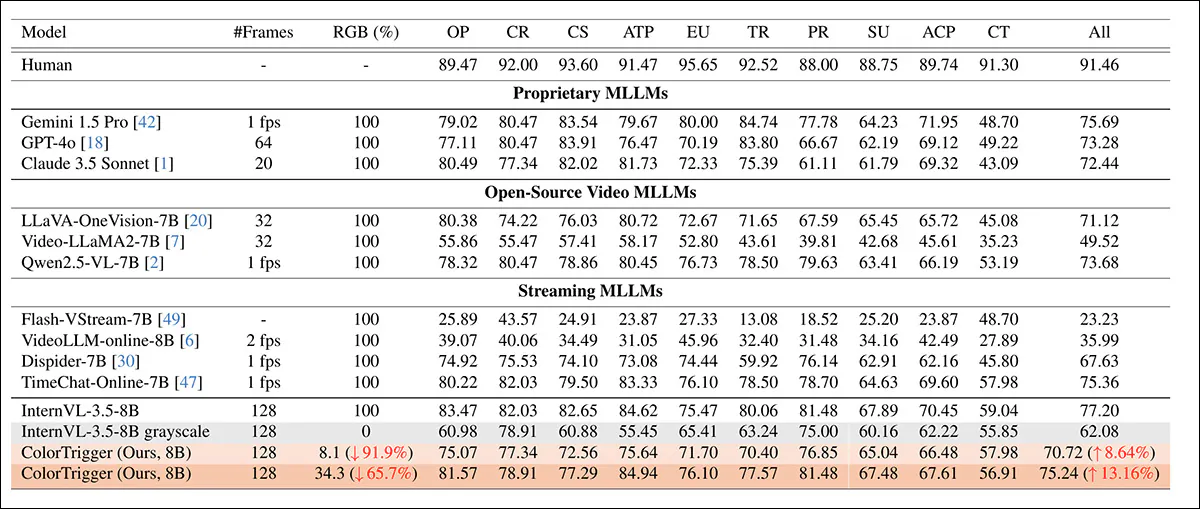

InternVL-3.5-8B e Qwen3-VL-8B sono stati effettuati test in varie configurazioni, dettagliate nella prima tabella dei risultati qui sotto, relative a StreamingBench:

Prestazioni su StreamingBench per attività di comprensione visiva in tempo reale, confrontando MLLM proprietari, open-source e in streaming con diversi budget di colore. RGB (%) indica la proporzione di frame mantenuti a colori dopo l'attivazione, dove 100 indica il colore completo e 0 indica l'input in scala di grigi. ColorTrigger viene valutato in due punti operativi, mantenendo l'8.1% e il 34.3% dei frame a colori, e dimostra una maggiore accuratezza complessiva rispetto al modello di riferimento in scala di grigi InternVL-3.5-8B, riducendo sostanzialmente l'utilizzo del colore rispetto all'impostazione a colori completi.

Qui gli autori commentano:

'ColorTrigger raggiunge prestazioni competitive nel sotto-compito di comprensione visiva in tempo reale di StreamingBench.'

'Il nostro modello con il 34.3% di frame RGB ottiene un punteggio di 75.24, superando il recente modello online Dispider-7B e avvicinandosi a TimeChat-Online-7B, risultando al contempo paragonabile a modelli proprietari come Gemini 1.5 Pro (75.69) e superando GPT-4o (73.28) e Claude 3.5 Sonnet (72.44).'

InternVL-3.5-8B ha ottenuto un punteggio di 77.20 utilizzando il colore pieno, mentre ColorTrigger ha raggiunto 75.24 utilizzando il 65.7% in meno di fotogrammi RGB – e persino con solo l'8.1% di fotogrammi a colori, ha ottenuto un punteggio di 70.72, superando il valore di riferimento in scala di grigi di 62.08 dell'8.64%, e rimanendo competitivo con altri modelli di streaming.

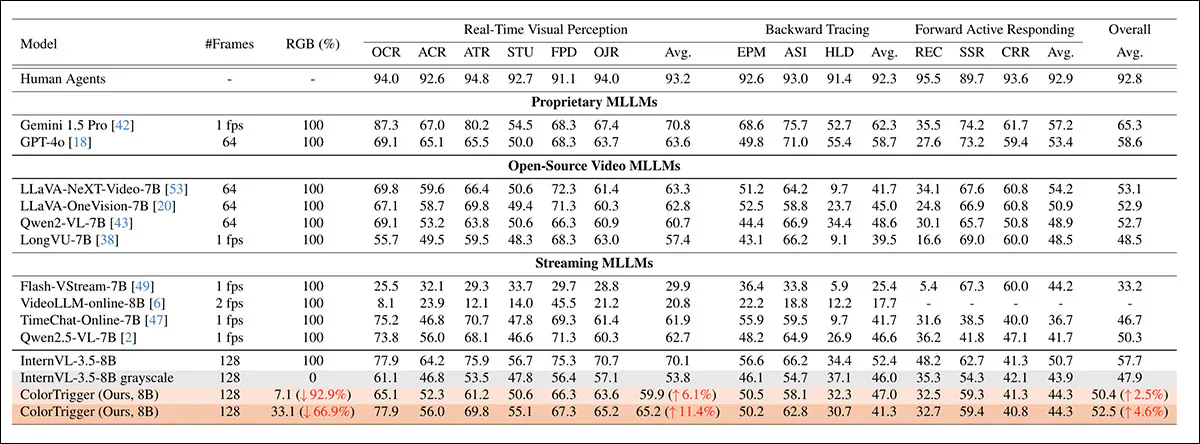

Successivamente, è stato testato OVO-Bench:

Prestazioni su OVO-Bench in tre categorie: Percezione visiva in tempo reale, Tracciamento all'indietro e Risposta attiva in avanti, confrontando MLLM proprietari, open-source e in streaming con diversi budget di colore. RGB (%) indica la proporzione di frame mantenuti a colori dopo l'attivazione, dove 100 indica il colore pieno e 0 indica l'input solo in scala di grigi. ColorTrigger è valutato in due punti operativi, mantenendo il 7.1% e il 33.1% di frame a colori, e mostra una maggiore accuratezza complessiva rispetto al riferimento in scala di grigi InternVL-3.5-8B, riducendo sostanzialmente l'utilizzo del colore rispetto all'impostazione a colori pieni.

Di questi risultati, gli autori affermano:

Il nostro modello con il 33.1% di frame RGB raggiunge un punteggio complessivo di 52.5, superando quasi tutti i modelli MLLM online open-source esistenti. Rispetto al modello base InternVL-3.5-8B con input RGB completo (57.7), ColorTrigger ottiene un punteggio di 52.5 riducendo l'utilizzo dei frame RGB del 66.9%, il che rappresenta un calo di soli 5.2 punti nelle prestazioni complessive.

'Questo modesto degrado è accompagnato da notevoli miglioramenti in termini di efficienza, a dimostrazione dell'efficacia della nostra strategia di instradamento adattivo.'

La percezione visiva in tempo reale ha raggiunto 65.2, con un incremento di 11.4 punti rispetto al valore di riferimento di 53.8 ottenuto con la sola scala di grigi. Anche limitandosi a soli 7.1% di frame RGB (una riduzione del 92.9%), ColorTrigger ha mantenuto un punteggio complessivo di 50.4, migliorando di 2.5 punti l'impostazione in scala di grigi.

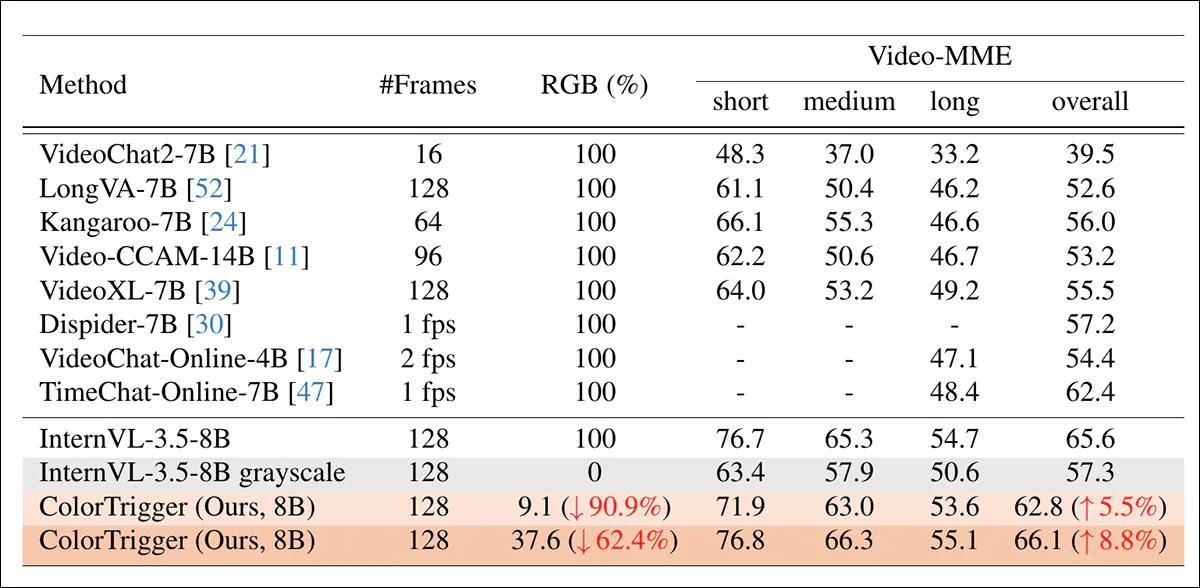

Infine i ricercatori hanno condotto un test contro un'attività video offline (un'attività analitica non progettata per testare la latenza o altre condizioni ambientali 'live', utilizzando il Video-MME Parametri di riferimento per la comprensione di video di lunga durata:

Confronto delle prestazioni dei sistemi testati sul benchmark Video-MME.

In questo test, il modello ha ottenuto un punteggio complessivo di 66.1, utilizzando il 37.6% di frame RGB, superando il punteggio di riferimento a colori InternVL-3.5-8B di 65.6, nonostante utilizzasse il 62.4% in meno di frame a colori.

Gli autori commentano:

Ciò dimostra che il nostro meccanismo di attivazione adattivo non solo riduce i costi computazionali, ma può effettivamente migliorare le prestazioni concentrando la capacità RGB sui momenti semanticamente critici.

In particolare, ColorTrigger supera tutti i modelli MLLM online esistenti, inclusi TimeChat-Online-7B con un punteggio di 62.4 e Dispider-7B con un punteggio di 57.2, confermando l'efficacia della combinazione del contesto continuo in scala di grigi con l'acquisizione RGB selettiva per la comprensione di video di lunga durata.

Conclusione

Mi piace sempre vedere innovazioni di questo tipo, non da ultimo perché l'IA è altamente e bisogno sempre crescente Il tema dell'energia (elettrica) è da tempo al centro di notizie poco incoraggianti, ed è positivo vedere una ricerca che, almeno indirettamente, affronta la questione.

È cinicamente confortante sapere che i risparmi energetici ottenuti in tali iniziative sono motivati da considerazioni commerciali, poiché queste ultime sono meno soggette a decisioni politiche a breve termine rispetto alle più nobili, ma più vulnerabili, preoccupazioni per il risparmio energetico e il riscaldamento globale. Per fortuna, lo stesso obiettivo viene raggiunto, seppur per ragioni diverse.

* Creata da me, con il solo scopo di riassumere l'idea principale dell'articolo per il lettore.

Prima pubblicazione giovedì 26 marzo 2026