Etika

Basis Data Insiden AI Bertujuan Membuat Algoritma AI Lebih Aman

Setiap sistem yang cukup besar akan memiliki kesalahan, dan bagian dari memperbaiki kesalahan-kesalahan ini adalah memiliki basis data tentang kesalahan-kesalahan tersebut yang dapat dianalisis untuk dampak dan penyebab potensial. Sama seperti FDA memelihara basis data untuk reaksi obat yang merugikan, atau National Transportation Safety Board memelihara basis data untuk kecelakaan penerbangan, Basis Data Insiden AI adalah basis data yang dimaksudkan untuk mengatalogkan kegagalan sistem AI dan membantu peneliti AI merancang metode baru untuk menghindari kegagalan-kegagalan ini. Para pembuat Basis Data Insiden AI (AIID) berharap bahwa itu akan membantu perusahaan AI mengembangkan AI yang lebih aman, lebih etis.

Apa itu AIID?

AIID adalah produk dari organisasi Partnership on AI (PAI). PAI awalnya didirikan pada 2016 oleh anggota tim penelitian AI di perusahaan teknologi besar seperti Facebook, Apple, Amazon, Google, IBM, dan Microsoft. Sejak itu, organisasi telah merekrut anggota dari banyak organisasi lain, termasuk berbagai organisasi nirlaba. Pada 2018, PAI berusaha untuk menciptakan standar klasifikasi yang konsisten untuk kegagalan AI. Namun, tidak ada koleksi insiden AI yang dapat digunakan sebagai dasar untuk klasifikasi ini. Oleh karena itu, PAI menciptakan AIID.

Menurut TechTalks, format AIID dipengaruhi oleh struktur basis data kecelakaan penerbangan yang dipelihara oleh National Transportation Safety Board. Sejak laporan mulai dikumpulkan pada 1996, sistem penerbangan komersial telah berhasil meningkatkan keselamatan industri penerbangan dengan mengarsipkan dan menganalisis insiden. Harapannya adalah bahwa repositori serupa dari insiden AI dapat membuat sistem AI lebih aman, lebih etis, dan lebih dapat diandalkan. AIID juga mengambil inspirasi dari Basis Data Kerentanan dan Paparan Umum, yang merupakan repositori kegagalan perangkat lunak yang terkenal yang meliputi berbagai industri dan disiplin ilmu.

Sean McGregor adalah konsultan teknis utama di IBM untuk Watson AI XPRIZE. McGregor juga bertanggung jawab untuk mengawasi pengembangan basis data AIID yang sebenarnya. McGregor menjelaskan bahwa tujuan AIID pada akhirnya adalah untuk mencegah sistem AI menyebabkan bahaya, atau setidaknya mengurangi tingkat keparahan insiden yang tidak diinginkan. Seperti yang dicatat McGregor, sistem pembelajaran mesin jauh lebih kompleks dan tidak dapat diprediksi daripada sistem perangkat lunak tradisional, dan sebagai hasilnya, mereka tidak dapat diuji dengan cara yang sama seperti perangkat lunak lain. Sistem pembelajaran mesin dapat mengubah perilaku mereka dengan cara yang tidak terduga. McGregor mencatat bahwa kemampuan sistem pembelajaran dalam untuk belajar dapat berarti “kegagalan lebih mungkin, lebih rumit, dan lebih berbahaya” ketika mereka memasuki dunia yang tidak terstruktur.

Lebih dari 1.000 Insiden AI Dilaporkan

Sejak AIID awalnya dibuat, telah lebih dari 1.000 insiden terkait AI yang dilaporkan ke basis data. Dari semua insiden dalam basis data, masalah yang terkait dengan keadilan AI adalah jenis insiden yang paling umum. Banyak dari insiden keadilan ini melibatkan penggunaan algoritma pengenalan wajah oleh lembaga pemerintah. McGregor juga mencatat bahwa ada jumlah insiden yang meningkat yang melibatkan robot yang ditambahkan ke basis data.

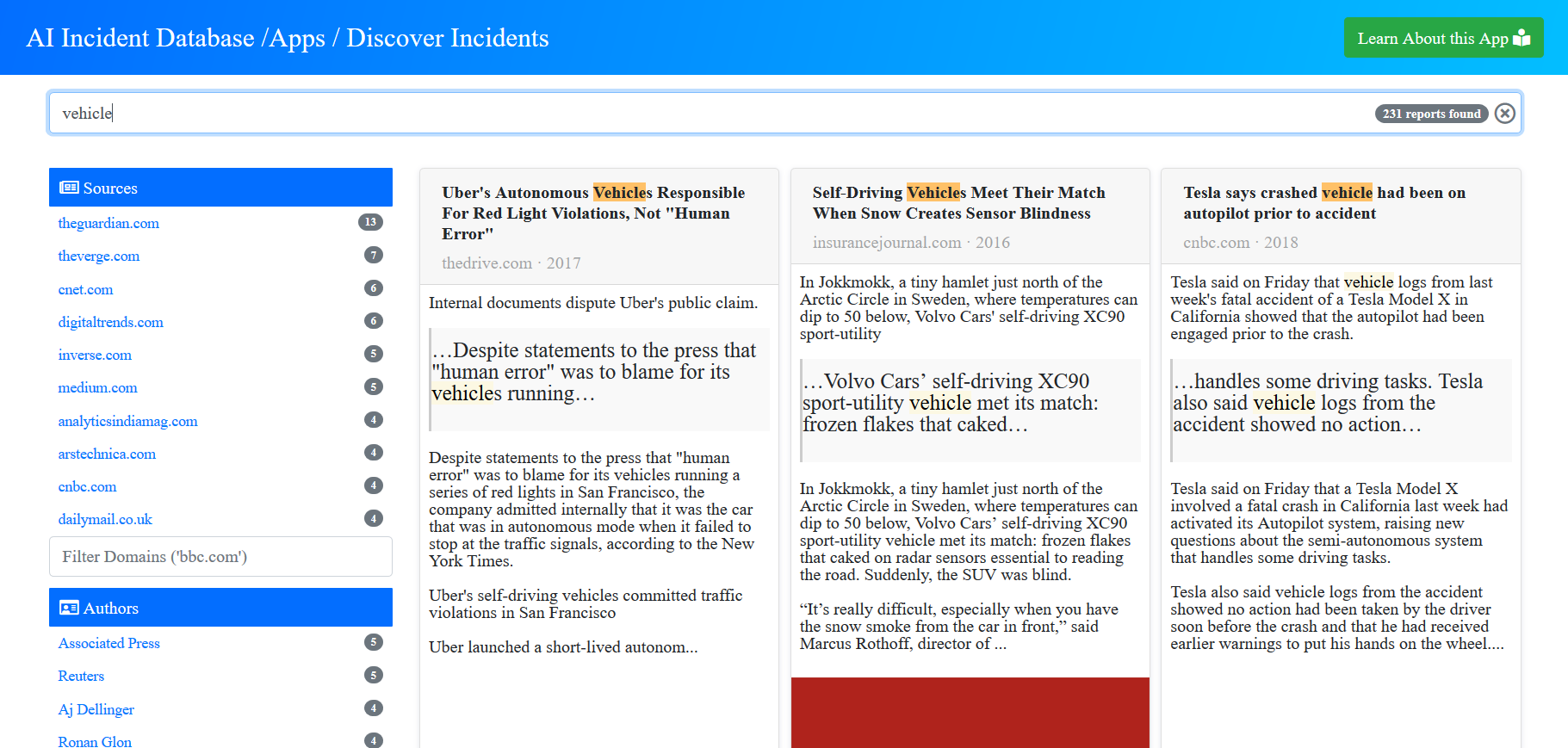

Pengunjung basis data dapat menjalankan kueri, mencari basis data untuk insiden berdasarkan kriteria seperti kata kunci, ID insiden, sumber, atau penulis. Misalnya, menjalankan pencarian untuk “Deepfake” mengembalikan 7 laporan, sedangkan pencarian untuk “robot” mengembalikan 158 laporan.

Basis data terpusat untuk insiden kegagalan AI dan beroperasi dengan cara yang tidak terduga dapat membantu peneliti, insinyur, dan ahli etika mengawasi pengembangan dan penerapan sistem AI. Manajer produk di perusahaan teknologi dapat menggunakan AIID untuk melihat apakah ada masalah potensial sebelum menggunakan sistem rekomendasi AI, atau insinyur AI dapat mendapatkan gambaran tentang bias potensial yang perlu diperbaiki saat membuat aplikasi AI. Demikian pula, petugas risiko dapat menggunakan basis data untuk menentukan efek sampingan negatif potensial yang terkait dengan model AI, sehingga mereka dapat merencanakan dan mengembangkan langkah-langkah untuk mengurangi bahaya potensial.

Arsitektur yang mendasari AIID dimaksudkan untuk fleksibel, karena ini memungkinkan penciptaan alat baru untuk mengkueri basis data dan mengekstrak wawasan yang bermakna. Partnership on AI dan McGregor akan bekerja sama untuk merancang taksonomi yang fleksibel yang dapat digunakan untuk mengklasifikasikan semua bentuk insiden AI. Tim berharap bahwa setelah taksonomi yang fleksibel telah dibuat, itu dapat digabungkan dengan sistem otomatis yang akan secara otomatis melaporkan insiden AI.

“Komunitas AI telah mulai berbagi catatan insiden dengan satu sama lain untuk memotivasi perubahan pada produk, prosedur kontrol, dan program penelitian,” McGregor menjelaskan melalui TechTalks. “Situs ini dirilis secara publik pada November, sehingga kami baru saja memulai untuk memahami manfaat dari sistem ini.”