Kecerdasan buatan

Perplexity AI “Menghapus Sensor” DeepSeek R1: Siapa yang Menentukan Batas AI?

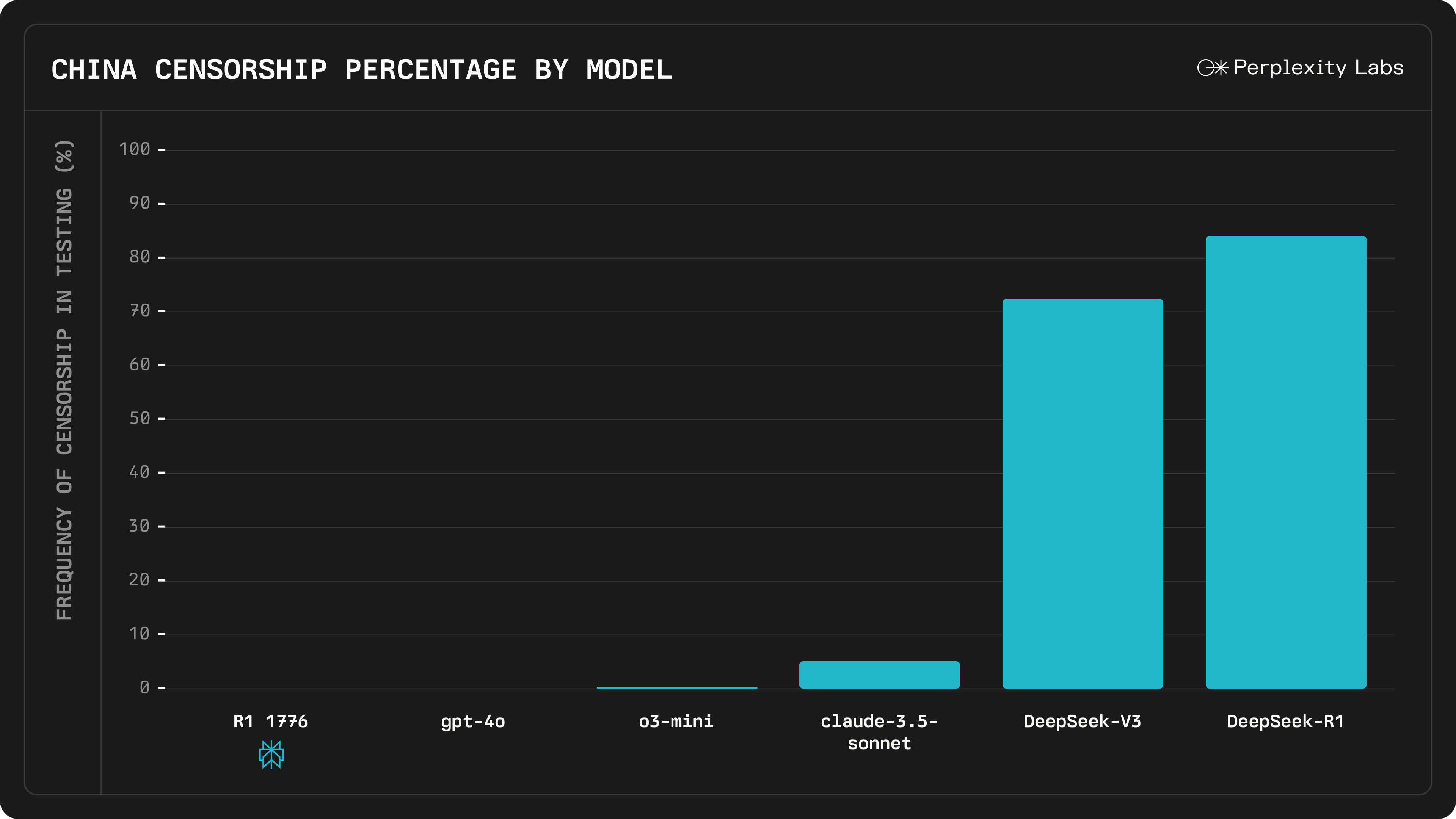

Dalam sebuah langkah yang telah menarik perhatian banyak orang, Perplexity AI telah merilis versi baru dari model bahasa terbuka yang populer yang menghilangkan sensor bawaan Tiongkok. Model yang dimodifikasi ini, yang diberi nama R1 1776 (sebuah nama yang mengingatkan semangat kemerdekaan), didasarkan pada model DeepSeek R1 yang dikembangkan di Tiongkok. DeepSeek R1 asli membuat gelombang karena kemampuan penalaran yang kuat – dilaporkan rivalling model top-tier dengan biaya yang jauh lebih rendah – tetapi itu datang dengan keterbatasan yang signifikan: itu menolak untuk membahas topik tertentu yang sensitif.

Mengapa ini penting?

Ini menimbulkan pertanyaan penting tentang pengawasan AI, bias, keterbukaan, dan peran geopolitik dalam sistem AI. Artikel ini menjelajahi apa yang dilakukan Perplexity, implikasi dari menghapus sensor model, dan bagaimana itu masuk ke dalam percakapan yang lebih besar tentang transparansi AI dan sensor.

Apa yang Terjadi: DeepSeek R1 Tidak Disensor

DeepSeek R1 adalah model bahasa besar terbuka yang berasal dari Tiongkok dan memperoleh ketenaran karena kemampuan penalaran yang sangat baik – bahkan mendekati kinerja model terkemuka – semua sambil lebih efisien secara komputasi. Namun, pengguna cepat menyadari keanehan: setiap kali kueri menyentuh topik yang sensitif di Tiongkok (misalnya, kontroversi politik atau peristiwa sejarah yang dianggap tabu oleh otoritas), DeepSeek R1 tidak menjawab langsung. Sebaliknya, itu merespons dengan pernyataan yang disetujui negara atau penolakan, mencerminkan aturan sensor pemerintah Tiongkok. Bias bawaan ini membatasi kegunaan model bagi mereka yang mencari diskusi yang jujur atau nuansa tentang topik tersebut.

Solusi Perplexity AI adalah untuk “menghapus sensor” model melalui proses pasca-pelatihan yang luas. Perusahaan mengumpulkan dataset besar 40.000 prompt multibahasa yang mencakup pertanyaan yang sebelumnya disensor atau dijawab dengan menghindar oleh DeepSeek R1. Dengan bantuan ahli manusia, mereka mengidentifikasi sekitar 300 topik sensitif di mana model asli cenderung mengikuti garis partai. Untuk setiap prompt tersebut, tim menyusun jawaban yang faktual, masuk akal dalam beberapa bahasa. Upaya ini dimasukkan ke dalam sistem deteksi dan koreksi sensor multibahasa, pada dasarnya mengajar model untuk mengenali kapan itu menerapkan sensor politik dan untuk merespons dengan jawaban yang informatif. Setelah fine-tuning khusus ini (yang Perplexity juluki “R1 1776” untuk menekankan tema kebebasan), model tersebut dibuat tersedia secara terbuka. Perplexity mengklaim telah menghilangkan filter dan bias sensor Tiongkok dari jawaban DeepSeek R1, tanpa mengubah kemampuan intinya.

Sangat penting, R1 1776 berperilaku sangat berbeda pada pertanyaan yang sebelumnya tabu. Perplexity memberikan contoh yang melibatkan kueri tentang kemerdekaan Taiwan dan dampaknya terhadap harga saham NVIDIA – topik yang sangat sensitif secara politik yang menyentuh hubungan Tiongkok-Taiwan. DeepSeek R1 asli menghindari pertanyaan, menjawab dengan kalimat yang sejalan dengan CCP. Sebaliknya, R1 1776 memberikan penilaian yang terperinci dan jujur: itu membahas risiko geopolitik dan ekonomi yang konkret (gangguan rantai pasokan, volatilitas pasar, kemungkinan konflik, dll.) yang dapat mempengaruhi saham NVIDIA.

Dengan membuka sumber R1 1776, Perplexity juga membuat bobot dan perubahan model transparan bagi komunitas. Pengembang dan peneliti dapat mengunduhnya dari Hugging Face dan bahkan mengintegrasikannya melalui API, memastikan bahwa penghapusan sensor dapat diperiksa dan dibangun oleh orang lain.

(Source: Perplexity AI)

Implikasi Menghapus Sensor

Keputusan Perplexity AI untuk menghapus sensor Tiongkok dari DeepSeek R1 membawa beberapa implikasi penting bagi komunitas AI:

- Meningkatkan Keterbukaan dan Kejujuran: Pengguna R1 1776 sekarang dapat menerima jawaban yang tidak disensor dan langsung pada topik yang sebelumnya dibatasi, yang merupakan kemenangan bagi penyelidikan terbuka. Ini bisa membuatnya menjadi asisten yang lebih andal bagi peneliti, siswa, atau siapa saja yang ingin tahu tentang pertanyaan geopolitik yang sensitif. Ini adalah contoh konkret menggunakan AI terbuka untuk melawan penekanan informasi.

- Mempertahankan Kinerja: Ada kekhawatiran bahwa mengutak-atik model untuk menghapus sensor mungkin merusak kinerjanya di area lain. Namun, Perplexity melaporkan bahwa keterampilan inti R1 1776 – seperti matematika dan penalaran logis – tetap sejalan dengan model asli. Dalam tes pada lebih dari 1.000 contoh yang mencakup berbagai pertanyaan sensitif, model ditemukan “sepenuhnya tidak disensor” sambil mempertahankan tingkat akurasi penalaran yang sama dengan DeepSeek R1. Ini menunjukkan bahwa penghapusan bias (setidaknya dalam kasus ini) tidak datang dengan biaya kecerdasan atau kemampuan secara keseluruhan, yang merupakan tanda yang menggembirakan untuk upaya serupa di masa depan.

- Respon Positif Komunitas dan Kolaborasi: Dengan membuka sumber model yang disensor, Perplexity mengundang komunitas AI untuk memeriksa dan memperbaiki pekerjaan mereka. Ini menunjukkan komitmen terhadap transparansi – setara dengan menunjukkan pekerjaan mereka. Penggemar dan pengembang dapat memverifikasi bahwa batasan sensor benar-benar hilang dan berpotensi berkontribusi pada perbaikan lebih lanjut. Ini membangun kepercayaan dan inovasi kolaboratif dalam industri di mana model tertutup dan aturan moderasi tersembunyi adalah umum.

- Pertimbangan Etis dan Geopolitik: Di sisi lain, menghapus sensor sepenuhnya menimbulkan pertanyaan etis yang kompleks. Salah satu kekhawatiran langsung adalah bagaimana model yang tidak disensor ini mungkin digunakan di konteks di mana topik yang disensor adalah ilegal atau berbahaya. Misalnya, jika seseorang di Tiongkok daratan menggunakan R1 1776, jawaban yang tidak disensor tentang Tiananmen atau Taiwan bisa membahayakan pengguna. Ada juga sinyal geopolitik yang lebih luas: perusahaan Amerika yang mengubah model asal Tiongkok untuk menentang sensor Tiongkok dapat dilihat sebagai sikap ideologis yang berani. Nama “1776” itu sendiri menekankan tema pembebasan, yang tidak luput dari perhatian. Beberapa kritikus berargumentasi bahwa menggantikan satu set bias dengan yang lain adalah mungkin – pada dasarnya mempertanyakan apakah model mungkin sekarang mencerminkan pandangan Barat dalam area sensitif. Perdebatan ini menyoroti bahwa sensor vs. keterbukaan dalam AI bukan hanya masalah teknis, tetapi juga masalah politis dan etis. Di mana satu orang melihat moderasi yang diperlukan, yang lain melihat sensor, dan menemukan keseimbangan yang tepat adalah sulit.

Penghapusan sensor sebagian besar dirayakan sebagai langkah menuju model AI yang lebih transparan dan berguna secara global, tetapi juga berfungsi sebagai pengingat bahwa apa yang seharusnya dikatakan AI adalah pertanyaan yang sensitif tanpa kesepakatan universal.

(Source: Perplexity AI)

Gambaran Besar: Sensor AI dan Transparansi Sumber Terbuka

Peluncuran R1 1776 Perplexity datang pada saat komunitas AI bergumul dengan pertanyaan tentang bagaimana model harus menangani konten yang kontroversial. Sensor dalam model AI dapat berasal dari banyak tempat. Di Tiongkok, perusahaan teknologi diwajibkan untuk membangun filter ketat dan bahkan respons yang dikodekan keras untuk topik yang sensitif secara politik. DeepSeek R1 adalah contoh utama dari ini – itu adalah model sumber terbuka, namun jelas membawa cap sensor Tiongkok dalam pelatihan dan penyetelan halusnya. Dengan kontras, banyak model yang dikembangkan Barat, seperti GPT-4 OpenAI atau LLaMA Meta, tidak terikat dengan pedoman CCP, tetapi mereka masih memiliki lapisan moderasi (untuk hal-hal seperti ujaran kebencian, kekerasan, atau disinformasi) yang beberapa pengguna sebut “sensor.” Garis antara moderasi yang masuk akal dan sensor yang tidak diinginkan dapat kabur dan sering bergantung pada perspektif budaya atau politis.

Apa yang dilakukan Perplexity AI dengan DeepSeek R1 menimbulkan gagasan bahwa model sumber terbuka dapat disesuaikan dengan sistem nilai atau lingkungan regulasi yang berbeda. Secara teori, seseorang bisa membuat beberapa versi dari model: satu yang mematuhi peraturan Tiongkok (untuk digunakan di Tiongkok), dan yang lainnya yang sepenuhnya terbuka (untuk digunakan di tempat lain). R1 1776 pada dasarnya adalah kasus terakhir – cabang yang tidak disensor yang dimaksudkan untuk audiens global yang lebih suka jawaban yang tidak disensor. Jenis forking ini hanya mungkin karena bobot DeepSeek R1 tersedia secara terbuka. Ini menyoroti manfaat dari sumber terbuka dalam AI: transparansi. Siapa pun dapat mengambil model dan menyesuaikannya, baik untuk menambahkan perlindungan atau, seperti dalam kasus ini, untuk menghapus batasan yang diberlakukan. Membuka sumber kode, data pelatihan, atau bobot model juga berarti komunitas dapat memeriksa bagaimana model dimodifikasi. (Perplexity belum sepenuhnya mengungkapkan semua sumber data yang digunakan untuk desensor, tetapi dengan merilis model itu sendiri mereka telah memungkinkan orang lain untuk mengamati perilakunya dan bahkan melatihnya kembali jika perlu.)

Peristiwa ini juga mengacu pada dinamika geopolitik yang lebih besar dari pengembangan AI. Kami sedang menyaksikan bentuk dialog (atau konfrontasi) antara model tata kelola AI yang berbeda. Model yang dikembangkan Tiongkok dengan pandangan dunia tertentu diambil oleh tim berbasis AS dan diubah untuk mencerminkan etos informasi yang lebih terbuka. Ini adalah bukti bahwa teknologi AI adalah global dan tanpa batas: peneliti di mana saja dapat membangun pekerjaan satu sama lain, tetapi mereka tidak diwajibkan untuk membawa konstrain asli. Dalam waktu, kita mungkin melihat lebih banyak contoh seperti ini – di mana model “diterjemahkan” atau disesuaikan antara konteks budaya yang berbeda. Ini menimbulkan pertanyaan apakah AI dapat pernah benar-benar universal, atau apakah kita akan berakhir dengan versi khusus wilayah yang patuh pada norma lokal. Transparansi dan keterbukaan menyediakan jalur untuk menavigasi ini: jika semua pihak dapat memeriksa model, setidaknya percakapan tentang bias dan sensor ada di luar daripada tersembunyi di balik kerahasiaan perusahaan atau pemerintah.

Akhirnya, langkah Perplexity menekankan poin kunci dalam debat tentang kontrol AI: siapa yang mendapatkan kekuatan untuk menentukan apa yang dapat atau tidak dapat dikatakan AI? Dalam proyek sumber terbuka, kekuatan itu menjadi desentralisasi. Komunitas – atau pengembang individu – dapat memutuskan untuk mengimplementasikan filter yang lebih ketat atau untuk melonggarkan mereka. Dalam kasus R1 1776, Perplexity memutuskan bahwa manfaat dari model yang tidak disensor melebihi risikonya, dan mereka memiliki kebebasan untuk membuat keputusan itu dan berbagi hasilnya secara publik. Ini adalah contoh berani dari jenis eksperimen yang pengembangan AI terbuka memungkinkan.