Sudut Anderson

Mencari ‘Burung Hantu dan Kadal’ di Audiens Pengiklan

Karena sektor periklanan online diperkirakan menghabiskan $740,3 miliar USD pada tahun 2023, mudah untuk memahami mengapa perusahaan periklanan menginvestasikan sumber daya yang cukup besar dalam penelitian visi komputer ini.

Meskipun tertutup dan protektif, industri ini terkadang menerbitkan studi yang mengisyaratkan pekerjaan propietary yang lebih maju dalam pengenalan wajah dan mata – termasuk pengenalan usia, yang sentral untuk statistik analitik demografi:

Mengestimasi usia dalam konteks periklanan di alam liar adalah hal yang menarik bagi pengiklan yang mungkin menargetkan demografi tertentu. Dalam contoh eksperimental ini, usia penyanyi Bob Dylan dilacak sepanjang tahun. Sumber: https://arxiv.org/pdf/1906.03625

Studi-studi ini, yang jarang muncul di repositori publik seperti Arxiv, menggunakan peserta yang direkrut secara sah sebagai dasar untuk analisis yang dipimpin AI yang bertujuan untuk menentukan seberapa besar, dan dengan cara apa, pemirsa berinteraksi dengan iklan.

Dlib’s Histogram of Oriented Gradients (HoG) sering digunakan dalam sistem estimasi wajah. Sumber: https://www.computer.org/csdl/journal/ta/2017/02/07475863/13rRUNvyarN

Insting Hewan

Dalam hal ini, secara alami, industri periklanan tertarik untuk menentukan false positives (kesempatan di mana sistem analitis salah mengartikan tindakan subjek), dan menetapkan kriteria yang jelas untuk saat pemirsa yang menonton iklan mereka tidak sepenuhnya berinteraksi dengan konten.

Seperti yang berkaitan dengan periklanan berbasis layar, studi cenderung fokus pada dua masalah di dua lingkungan. Lingkungan adalah ‘desktop’ atau ‘mobile’, masing-masing memiliki karakteristik yang memerlukan solusi pelacakan yang disesuaikan; dan masalah – dari sudut pandang pengiklan – diwakili oleh perilaku burung hantu dan kadal – kecenderungan pemirsa untuk tidak memperhatikan iklan yang ada di depan mereka.

Contoh perilaku ‘Burung Hantu’ dan ‘Kadal’ dalam subjek proyek penelitian periklanan. Sumber: https://arxiv.org/pdf/1508.04028

Jika Anda menjauh dari iklan yang dimaksud dengan seluruh kepala, ini adalah perilaku ‘burung hantu’; jika pose kepala Anda statis tetapi mata Anda melihat ke lain dari layar, ini adalah perilaku ‘kadal’. Dalam hal analitik dan pengujian iklan baru dalam kondisi yang terkendali, tindakan ini sangat penting untuk sistem untuk dapat menangkap.

Sebuah makalah baru dari SmartEye’s Affectiva acquisition mengatasi masalah ini, menawarkan arsitektur yang memanfaatkan beberapa kerangka kerja yang ada untuk menyediakan fitur yang dikombinasikan dan dikonkatkan di semua kondisi dan reaksi yang memungkinkan – dan untuk dapat menentukan apakah pemirsa bosan, terlibat, atau dalam beberapa cara jauh dari konten yang pengiklan ingin mereka tonton.

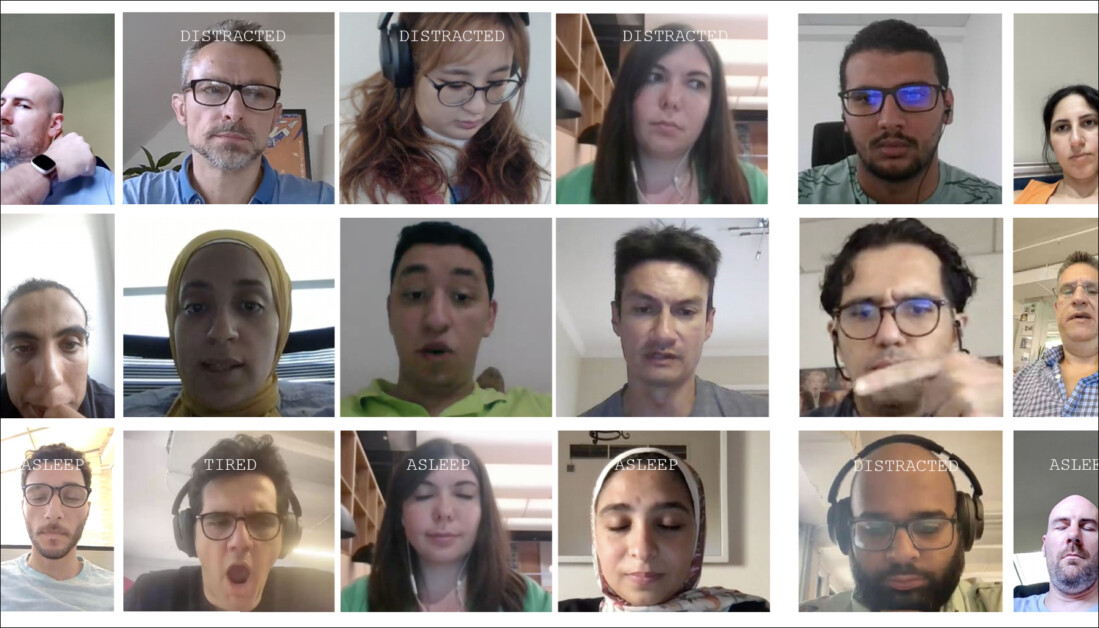

Contoh true dan false positives yang terdeteksi oleh sistem perhatian baru untuk berbagai sinyal gangguan, ditampilkan secara terpisah untuk perangkat desktop dan mobile. Sumber: https://arxiv.org/pdf/2504.06237

Para penulis menyatakan*:

‘Penelitian terbatas telah mempelajari pemantauan perhatian selama iklan online. Sementara studi ini fokus pada memperkirakan pose kepala atau arah pandangan untuk mengidentifikasi contoh pandangan yang teralihkan, mereka mengabaikan parameter kritis seperti jenis perangkat (desktop atau mobile), penempatan kamera relatif terhadap layar, dan ukuran layar. Faktor-faktor ini sangat mempengaruhi deteksi perhatian. ‘

‘Dalam makalah ini, kami mengusulkan arsitektur untuk deteksi perhatian yang mencakup deteksi berbagai gangguan, termasuk perilaku burung hantu dan kadal, berbicara, mengantuk (melalui menguap dan penutupan mata yang berkepanjangan), dan meninggalkan layar yang tidak diawasi. ‘

‘Tidak seperti pendekatan sebelumnya, metode kami mengintegrasikan fitur perangkat khusus seperti jenis perangkat, penempatan kamera, ukuran layar (untuk desktop), dan orientasi kamera (untuk perangkat mobile) dengan estimasi pandangan mentah untuk meningkatkan akurasi deteksi perhatian.’

Makalah baru ini berjudul Monitoring Viewer Attention During Online Ads, dan berasal dari empat peneliti di Affectiva.

Metode dan Data

Terutama karena sifat rahasia dan tertutup dari sistem tersebut, makalah baru ini tidak membandingkan pendekatan penulis secara langsung dengan saingan, tetapi lebih mempresentasikan temuan mereka secara eksklusif sebagai studi ablasion; makalah ini juga tidak mengikuti format umum literatur Visi Komputer. Oleh karena itu, kita akan melihat penelitian ini sebagaimana dipresentasikan.

Para penulis menekankan bahwa hanya sejumlah terbatas studi yang telah mengatasi deteksi perhatian secara khusus dalam konteks iklan online. Dalam AFFDEX SDK, yang menawarkan pengenalan wajah multi secara waktu nyata, perhatian diinferensi hanya dari pose kepala, dengan peserta dilabeli tidak perhatian jika sudut kepala mereka melewati ambang batas yang ditentukan.

Contoh dari AFFDEX SDK, sistem Affectiva yang mengandalkan pose kepala sebagai indikator perhatian. Sumber: https://www.youtube.com/watch?v=c2CWb5jHmbY

Dalam 2019 kolaborasi Automatic Measurement of Visual Attention to Video Content using Deep Learning, dataset sekitar 28.000 peserta diannotate untuk berbagai perilaku tidak perhatian, termasuk melihat ke lain, menutup mata, atau terlibat dalam kegiatan tidak terkait, dan model CNN-LSTM dilatih untuk mendeteksi perhatian dari penampilan wajah sepanjang waktu.

Dari makalah 2019, contoh yang menggambarkan status perhatian yang diprediksi untuk pemirsa yang menonton konten video. Sumber: https://www.jeffcohn.net/wp-content/uploads/2019/07/Attention-13.pdf.pdf

Namun, para penulis mengamati, upaya sebelumnya ini tidak mempertimbangkan faktor perangkat khusus, seperti apakah peserta menggunakan perangkat desktop atau mobile; atau ukuran layar atau penempatan kamera. Selain itu, sistem AFFDEX fokus hanya pada mengidentifikasi gangguan pandangan, dan mengabaikan sumber gangguan lain, sementara makalah 2019 mencoba mendeteksi serangkaian perilaku yang lebih luas – tetapi penggunaan satu CNN dangkal CNN mungkin, makalah tersebut menyatakan, tidak memadai untuk tugas ini.

Para penulis mengamati bahwa beberapa penelitian paling populer dalam garis ini tidak dioptimalkan untuk pengujian iklan, yang memiliki kebutuhan yang berbeda dibandingkan dengan domain seperti mengemudi atau pendidikan – di mana penempatan dan kalibrasi kamera biasanya tetap sebelumnya, bergantung pada pengaturan yang tidak terkendali, dan beroperasi dalam jangkauan pandangan yang terbatas dari perangkat desktop dan mobile.

Oleh karena itu mereka telah merancang arsitektur untuk mendeteksi perhatian pemirsa selama iklan online, memanfaatkan dua toolkit komersial: AFFDEX 2.0 dan SmartEye SDK.

Contoh analisis wajah dari AFFDEX 2.0. Sumber: https://arxiv.org/pdf/2202.12059

Kerja sebelumnya ini mengekstrak fitur tingkat rendah seperti ekspresi wajah, pose kepala, dan arah pandangan. Fitur-fitur ini kemudian diproses untuk menghasilkan indikator tingkat tinggi, termasuk posisi pandangan pada layar; menguap; dan berbicara.

Sistem ini mengidentifikasi empat jenis gangguan: pandangan off-screen; mengantuk,; berbicara; dan layar yang tidak diawasi. Sistem ini juga menyesuaikan analisis pandangan sesuai dengan apakah pemirsa menggunakan perangkat desktop atau mobile.

Dataset: Pandangan

Para penulis menggunakan empat dataset untuk memuat dan mengevaluasi sistem deteksi perhatian: tiga yang berfokus pada perilaku pandangan, berbicara, dan menguap; dan yang keempat ditarik dari sesi pengujian iklan nyata yang mengandung campuran jenis gangguan.

Karena kebutuhan khusus dari pekerjaan ini, dataset khusus dibuat untuk masing-masing kategori ini. Semua dataset yang dikurasi berasal dari repositori propietary yang menampilkan jutaan sesi rekaman peserta yang menonton iklan di rumah atau lingkungan kerja, menggunakan pengaturan berbasis web, dengan persetujuan yang diberitahukan – dan karena keterbatasan dari persetujuan tersebut, para penulis menyatakan bahwa dataset untuk pekerjaan baru ini tidak dapat dibuat tersedia untuk umum.

Untuk membangun dataset pandangan, peserta diminta untuk mengikuti titik yang bergerak di berbagai titik pada layar, termasuk tepi-tepinya, dan kemudian untuk melihat ke lain dari layar dalam empat arah (atas, bawah, kiri, dan kanan) dengan urutan yang diulangi tiga kali. Dengan cara ini, hubungan antara penangkapan dan cakupan didirikan:

Tangkapan layar yang menampilkan stimulus video pandangan pada (a) perangkat desktop dan (b) perangkat mobile. Bingkai pertama dan ketiga menampilkan instruksi untuk mengikuti titik yang bergerak, sementara bingkai kedua dan keempat meminta peserta untuk melihat ke lain dari layar.

Segmen titik yang bergerak dilabeli sebagai perhatian, dan segmen off-screen dilabeli sebagai tidak perhatian, menghasilkan dataset yang dilabeli dengan contoh positif dan negatif.

Setiap video berlangsung sekitar 160 detik, dengan versi terpisah dibuat untuk platform desktop dan mobile, masing-masing dengan resolusi 1920×1080 dan 608×1080.

Total 609 video dikumpulkan, terdiri dari 322 video desktop dan 287 video mobile. Label diterapkan secara otomatis berdasarkan konten video, dan dataset dibagi menjadi 158 sampel pelatihan dan 451 untuk pengujian.

Dataset: Berbicara

Dalam konteks ini, salah satu kriteria yang mendefinisikan ‘tidak perhatian’ adalah ketika seseorang berbicara selama lebih dari satu detik (yang bisa menjadi komentar singkat, atau bahkan batuk).

Karena lingkungan yang terkendali tidak merekam atau menganalisis audio, berbicara diinferensi dengan mengamati gerakan internal dari landmark wajah yang diestimasi. Oleh karena itu untuk mendeteksi berbicara tanpa audio, para penulis membuat dataset yang berdasar pada input visual, ditarik dari repositori internal mereka, dan dibagi menjadi dua bagian: yang pertama mengandung sekitar 5.500 video, masing-masing dilabeli secara manual oleh tiga annotator sebagai berbicara atau tidak berbicara (dari ini, 4.400 digunakan untuk pelatihan dan validasi, dan 1.100 untuk pengujian).

Bagian kedua terdiri dari 16.000 sesi yang dilabeli secara otomatis berdasarkan jenis sesi: 10.500 fitur peserta yang menonton iklan secara diam, dan 5.500 menampilkan peserta yang mengungkapkan pendapat tentang merek.

Dataset: Mengantuk

Sementara beberapa dataset mengantuk ada, termasuk YawDD dan Driver Fatigue, para penulis menyatakan bahwa tidak ada yang sesuai untuk skenario pengujian iklan, karena mereka baik fitur simulasi menguap atau mengandung kontorsi wajah yang bisa salah diartikan sebagai ketakutan, atau tindakan non-menguap lain.

Oleh karena itu para penulis menggunakan 735 video dari koleksi internal mereka, memilih sesi yang kemungkinan mengandung jaw drop yang berlangsung lebih dari satu detik. Setiap video dilabeli secara manual oleh tiga annotator sebagai aktif atau tidak aktif menguap. Hanya 2,6 persen bingkai mengandung menguap aktif, menekankan ketidakseimbangan kelas, dan dataset dibagi menjadi 670 video pelatihan dan 65 untuk pengujian.

Dataset: Gangguan

Dataset gangguan juga ditarik dari repositori penelitian iklan para penulis, di mana peserta telah menonton iklan nyata tanpa tugas yang ditugaskan. Total 520 sesi (193 pada perangkat mobile dan 327 pada lingkungan desktop) dipilih secara acak dan dilabeli secara manual oleh tiga annotator sebagai perhatian atau tidak perhatian.

Perilaku tidak perhatian termasuk pandangan off-screen, berbicara, mengantuk, dan layar yang tidak diawasi. Sesi ini mencakup wilayah yang beragam di seluruh dunia, dengan rekaman desktop lebih umum, karena penempatan webcam yang fleksibel.

Model Perhatian

Model perhatian yang diusulkan memproses fitur visual tingkat rendah, yaitu ekspresi wajah; pose kepala; dan arah pandangan – diekstrak melalui AFFDEX 2.0 dan SmartEye SDK yang disebutkan sebelumnya.

Fitur-fitur ini kemudian diubah menjadi indikator tingkat tinggi, dengan setiap gangguan ditangani oleh klasifikasi biner terpisah yang dilatih pada datasetnya sendiri untuk optimasi dan evaluasi independen.

Skema untuk sistem pemantauan yang diusulkan.

Model pandangan menentukan apakah pemirsa sedang melihat atau tidak melihat layar menggunakan koordinat pandangan yang dinormalisasi, dengan kalibrasi terpisah untuk perangkat desktop dan mobile. Proses ini dibantu oleh mesin Support Vector Machine (SVM) linier, yang dilatih pada fitur spasial dan temporal, dan mengintegrasikan jendela memori untuk memuluskan pergeseran pandangan yang cepat.

Untuk mendeteksi berbicara tanpa audio, sistem menggunakan wilayah mulut yang dipotong dan 3D-CNN yang dilatih pada segmen video percakapan dan non-percakapan. Label diberikan berdasarkan jenis sesi, dengan pemulusan temporal yang mengurangi false positives yang dapat dihasilkan dari gerakan mulut singkat.

Menguap dideteksi menggunakan potongan gambar wajah penuh, untuk menangkap gerakan wajah yang lebih luas, dengan 3D-CNN yang dilatih pada bingkai yang dilabeli secara manual (meskipun tugas ini diperumit oleh frekuensi rendah menguap dalam penonton alami, dan kesamaannya dengan ekspresi lain).

Layar yang tidak diawasi diidentifikasi melalui ketiadaan wajah atau pose kepala yang ekstrem, dengan prediksi yang dibuat oleh pohon keputusan.

Status perhatian akhir ditentukan menggunakan aturan tetap: jika modul mana pun mendeteksi ketidakperhatian, pemirsa ditandai tidak perhatian – pendekatan yang memprioritaskan sensitivitas, dan disesuaikan secara terpisah untuk konteks desktop dan mobile.

Pengujian

Seperti yang disebutkan sebelumnya, pengujian mengikuti metode ablasion, di mana komponen dihilangkan dan efek pada hasil dicatat.

Kategori ketidakperhatian yang berbeda yang diidentifikasi dalam studi.

Model pandangan mengidentifikasi perilaku off-screen melalui tiga langkah kunci: menormalisasi estimasi pandangan mentah, memperhalus output, dan memperkirakan ukuran layar untuk perangkat desktop.

Untuk memahami pentingnya setiap komponen, para penulis menghilangkan komponen-komponen tersebut secara individual dan mengevaluasi kinerja pada 226 video desktop dan 225 video mobile yang diambil dari dua dataset. Hasil, diukur dengan G-mean dan F1 skor, ditampilkan di bawah:

Hasil yang menunjukkan kinerja model pandangan penuh, serta versi dengan langkah pemrosesan yang dihilangkan.

Dalam setiap kasus, kinerja menurun ketika langkah dihilangkan. Normalisasi terbukti sangat berharga pada desktop, di mana penempatan kamera bervariasi lebih dari pada perangkat mobile.

Studi ini juga mengevaluasi bagaimana fitur visual memprediksi orientasi kamera mobile: lokasi wajah, pose kepala, dan arah pandangan mencetak 0,75, 0,74, dan 0,60, sementara kombinasi mereka mencapai 0,91, menunjukkan – menurut para penulis – keuntungan dari mengintegrasikan banyak petunjuk.

Model berbicara yang dilatih pada jarak bibir vertikal mencapai ROC-AUC 0,97 pada set uji yang dilabeli secara manual, dan 0,96 pada dataset yang dilabeli secara otomatis yang lebih besar, menunjukkan kinerja yang konsisten di kedua dataset.

Model menguap mencapai ROC-AUC 96,6 persen dengan menggunakan rasio aspek mulut saja, yang meningkat menjadi 97,5 persen ketika digabungkan dengan prediksi unit tindakan dari AFFDEX 2.0.

Model layar yang tidak diawasi mengklasifikasikan momen sebagai tidak perhatian ketika baik AFFDEX 2.0 maupun SmartEye gagal mendeteksi wajah selama lebih dari satu detik. Untuk mengevaluasi validitas ini, para penulis melabeli secara manual semua kejadian tidak ada wajah di dataset gangguan nyata, mengidentifikasi penyebab yang mendasari dari setiap aktivasi. Kasus yang ambigu (seperti gangguan kamera atau distorsi video) dikecualikan dari analisis.

Seperti yang ditunjukkan pada tabel hasil di bawah, hanya 27 persen aktivasi ‘tidak ada wajah’ disebabkan oleh pengguna yang secara fisik meninggalkan layar.

Alasan yang diperoleh untuk tidak menemukan wajah, dalam beberapa kasus.

Makalah tersebut menyatakan:

‘Meskipun layar yang tidak diawasi hanya membentuk 27% dari contoh yang memicu sinyal tidak ada wajah, sinyal ini diaktifkan untuk alasan lain yang menunjukkan ketidakperhatian, seperti peserta yang melihat ke lain dengan sudut yang ekstrem, melakukan gerakan berlebihan, atau menutupi wajah mereka secara signifikan dengan objek/tangan.’

Dalam pengujian kuantitatif terakhir, para penulis mengevaluasi bagaimana penambahan progresif berbagai sinyal gangguan – pandangan off-screen (melalui pandangan dan pose kepala), mengantuk, berbicara, dan layar yang tidak diawasi – mempengaruhi kinerja keseluruhan model perhatian.

Pengujian dilakukan pada dua dataset: dataset gangguan nyata dan subset pengujian dari dataset pandangan. Skor G-mean dan F1 digunakan untuk mengukur kinerja (meskipun mengantuk dan berbicara dikecualikan dari analisis dataset pandangan, karena keterbatasan relevansi dalam konteks ini).

Seperti yang ditunjukkan di bawah, deteksi perhatian meningkat secara konsisten ketika lebih banyak jenis gangguan ditambahkan, dengan pandangan off-screen, gangguan yang paling umum, menyediakan baseline yang paling kuat.

Pengaruh penambahan berbagai sinyal gangguan terhadap arsitektur.

Dari hasil ini, makalah tersebut menyatakan:

‘Dari hasil, kita dapat pertama menyimpulkan bahwa integrasi semua sinyal gangguan berkontribusi pada deteksi perhatian yang ditingkatkan.

‘Kedua, perbaikan dalam deteksi perhatian konsisten di seluruh perangkat desktop dan mobile. Ketiga, sesi mobile dalam dataset nyata menunjukkan pergerakan kepala yang signifikan ketika melihat ke lain, yang mudah dideteksi, menghasilkan kinerja yang lebih tinggi untuk perangkat mobile dibandingkan dengan desktop. Keempat, menambahkan sinyal mengantuk memiliki perbaikan yang relatif kecil dibandingkan dengan sinyal lain, karena mengantuk jarang terjadi. ‘

‘Terakhir, sinyal layar yang tidak diawasi memiliki perbaikan yang relatif lebih besar pada perangkat mobile dibandingkan dengan desktop, karena perangkat mobile dapat dengan mudah ditinggalkan.’

Para penulis juga membandingkan model mereka dengan AFFDEX 1.0, sistem sebelumnya yang digunakan dalam pengujian iklan – dan bahkan deteksi pandangan berbasis kepala model saat ini outperforms AFFDEX 1.0 di kedua jenis perangkat:

‘Perbaikan ini merupakan hasil dari mengintegrasikan gerakan kepala dalam kedua arah yaw dan pitch, serta menormalisasi pose kepala untuk memperhitungkan perubahan kecil. Gerakan kepala yang jelas dalam dataset mobile nyata menyebabkan model kepala kami berkinerja serupa dengan AFFDEX 1.0.’

Para penulis menutup makalah dengan putaran pengujian kualitatif (yang mungkin agak membosankan).

Contoh output dari model perhatian di seluruh perangkat desktop dan mobile, dengan setiap baris menampilkan contoh true dan false positives untuk berbagai jenis gangguan.

Para penulis menyatakan:

‘Hasil menunjukkan bahwa model kami secara efektif mendeteksi berbagai gangguan dalam pengaturan yang tidak terkendali. Namun, model ini terkadang menghasilkan false positives dalam beberapa kasus tepi, seperti kemiringan kepala yang parah saat mempertahankan pandangan pada layar, beberapa oklusi mulut, mata yang kabur secara berlebihan, atau gambar wajah yang sangat gelap. ‘

Kesimpulan

Sementara hasilnya mewakili kemajuan yang terukur tetapi berarti atas pekerjaan sebelumnya, nilai yang lebih dalam dari studi ini terletak pada gambaran yang ditawarkannya tentang dorongan yang berkelanjutan untuk mengakses keadaan internal pemirsa. Meskipun data dikumpulkan dengan persetujuan, metodologi ini menunjuk ke kerangka kerja masa depan yang dapat meluas melampaui pengaturan penelitian pasar yang terstruktur.

Kesimpulan yang agak paranoid ini hanya diperkuat oleh sifat tertutup, terkendali, dan dilindungi dari cabang penelitian ini.

* Konversi saya dari kutipan inline penulis menjadi tautan.

Dipublikasikan pertama kali pada Rabu, 9 April 2025