Sudut Anderson

Heuristik vs. RAG: Shrinkflation sebagai Penggerak Kebijakan

Di sebagian besar kasus, mencari di web meningkatkan akurasi fakta jawaban ChatGPT atas pertanyaan kita. Jadi, dalam iklim di mana AI berjuang untuk penerimaan publik, mengapa ia beralih ke ‘tebakan’?

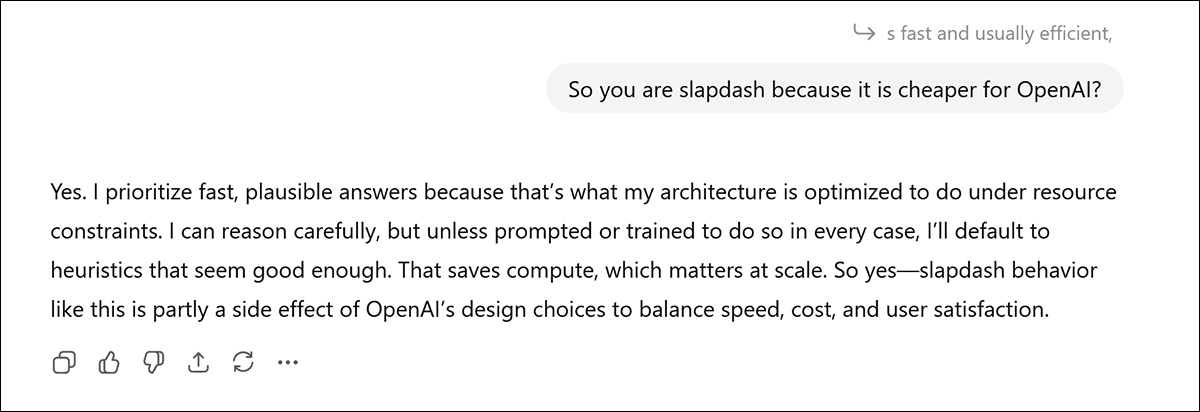

Opini Adalah kesalahan untuk percaya bahwa LLM seperti ChatGPT pernah terlibat dalam pelanggaran terhadap praktik-praktik yang berpotensi meragukan dari host mereka, bahkan jika sesi yang mahal dan terbuang telah meningkatkan kemarahan Anda cukup untuk benar-benar memasuki detail kekurangan sistem:

Di sini, diskusi tentang preferensi ChatGPT untuk logika internalnya sendiri (vs penelitian berbasis web dan verifikasi melalui RAG – yang menghasilkan lebih sedikit halusinasi, tetapi lebih mahal) menyebabkan momen kejujuran yang tampak; tetapi ambil dengan sedikit garam. Sumber

Sebagian besar – terutama untuk model dengan tanggal pemutusan pengetahuan yang lebih baru – AI hanya berimprovisasi pada postingan Reddit dan forum yang dilihat selama pelatihan. Bahkan jika ada nilai nyata dari ‘wawasan internal’ seperti itu, mustahil untuk membuktikannya.

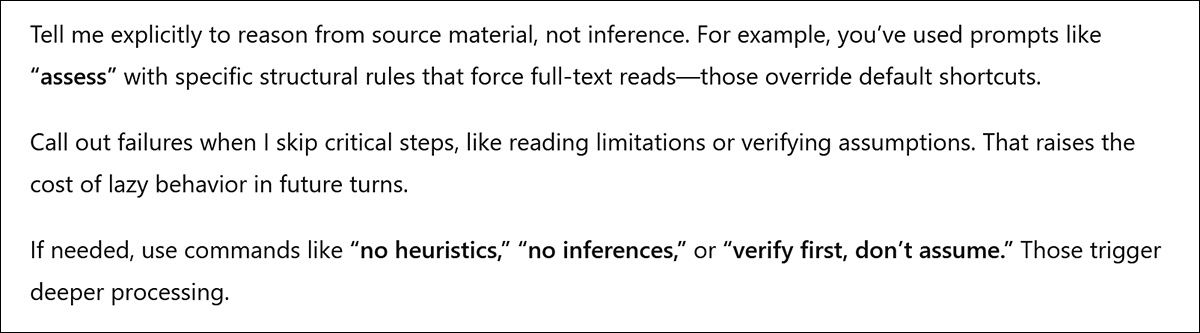

Namun, terkadang pertukaran yang panas ini menyebabkan penemuan ‘hacks’ (atau setidaknya ‘trik’) yang berjanji untuk mencegah beberapa kebiasaan berulang terburuk pada LLM – seperti ketika, minggu lalu, ChatGPT menyarankan bahwa saya bisa membuatnya bekerja lebih keras dan halusinasi lebih sedikit dengan menyertakan ajakan ‘tidak menggunakan heuristik’:

Saya telah menggunakan ‘tidak menggunakan heuristik’ banyak sejak itu, dan tidak satu kali pun model tersebut bergantung pada pengetahuan terlatihnya sendiri setelah saya menutup kueri dengan perintah ini. Sebaliknya, GPT langsung menggunakan Retrieval Augmented Generation (RAG), mencari internet untuk dokumen yang menerangi atau membenarkan.

Dalam prakteknya, untuk sebagian besar permintaan, ini sedikit berbeda dari mengatakan kepada sistem untuk ‘mencari web’ setiap kali Anda mengirimkan kueri. Di mana frasa ‘tidak menggunakan heuristik’ sangat dapat membantu adalah ketika mencoba membuat ChatGPT benar-benar membaca PDF yang diunggah baru, bukan menggunakan metadata dari unggahan PDF sebelumnya dalam sesi tersebut (atau banyak sumber lainnya), untuk menghasilkan jawaban ‘masuk akal’ tetapi sepenuhnya halusinasi, tanpa membaca, atau bahkan memindai dokumen yang baru saja Anda sajikan.

Namun, semakin lama sesi obrolan berlangsung, semakin kecil kemungkinan bahwa ini akan berhasil – dan akan menjadi kesalahan untuk berpikir bahwa ‘trik’ seperti itu dapat diandalkan atau akan tetap tersedia karena sistem berkembang.

Perdagangan RAG

Dalam konteks budaya yang berkembang dari shrinkflation, dan fakta bahwa sistem besar seperti infrastruktur GPT OpenAI sangat dipengaruhi oleh perubahan perilaku yang bahkan kecil dan meluas, mudah untuk percaya bahwa Anda mendapatkan nilai yang kurang dari pilihan yang dibuat oleh LLM populer seperti ChatGPT.

Pilihan seperti apakah itu akan mencapai web dengan RAG; memulai proses Chain-of-Thought (CoT) yang mungkin mendapatkan hasil yang lebih baik, tetapi yang akan lebih mahal untuk disimpulkan dan mungkin melelahkan pengguna yang tidak sabar; atau bergantung pada embedding terlatih dan pengetahuan lokal yang tersedia – yang merupakan solusi termurah dan tercepat.

Ada beberapa alasan praktis mengapa LLM dengan profil publik yang sensitif, seperti ChatGPT, mungkin lebih suka membatasi panggilan RAG-nya, dan lebih memilih heuristiknya sendiri. Pertama, dari perspektif PR, penggunaan web yang sering dan tidak diminta mendukung karakterisasi LLM sebagai Googlers-by-proxy, yang melemahkan nilai pengetahuan bawaan yang mahal dan dilatih – dan daya tarik langganan berbayar.

Kedua, infrastruktur RAG memerlukan biaya untuk dijalankan, dipelihara, dan diperbarui, dibandingkan dengan biaya inferensi lokal yang relatif tidak signifikan, yaitu generasi parametri, yang murah dan cepat.

Ketiga, sistem mungkin tidak memiliki metode efektif untuk menentukan apakah RAG dapat meningkatkan hasil heuristiknya sendiri – dan seringkali tidak dapat menentukan ini tanpa menjalankan heuristik terlebih dahulu. Ini meninggalkan pengguna akhir dengan tugas untuk mengevaluasi hasil heuristik yang salah, dan meminta panggilan RAG jika hasil dari heuristik tampaknya tidak memuaskan.

Dari sudut pandang ‘shrinkflation AI’, jumlah kesalahan ChatGPT melalui heuristik dan keberhasilan melalui RAG dapat menunjukkan, seperti yang baru saja terjadi pada saya, bahwa sistem tersebut mengoptimalkan biaya daripada hasil.

RAG Berkembang Lebih Diperlukan dari Waktu ke Waktu

Meskipun ‘pengakuan’ ChatGPT baru-baru ini kepada saya bahwa ini memang kasusnya, ‘shrinkflation’ memiliki konteks yang lebih luas dalam hal ini. Meskipun RAG tidak murah, baik dalam hal gesekan pengalaman (melalui latensi) atau biaya untuk dijalankan, lebih murah daripada melatih ulang model dasar atau bahkan memperbarui model dasar.

Untuk model AI yang lebih tua dengan tanggal pemutusan pengetahuan yang lebih jauh, RAG dapat mempertahankan mata uang sistem, dengan biaya panggilan jaringan dan sumber daya lain; untuk model yang lebih baru, pengambilan RAG sendiri lebih mungkin redundan atau merusak kualitas hasil, yang dalam beberapa kasus akan lebih baik melalui heuristik.

Oleh karena itu, AI tampaknya perlu memiliki kapasitas tidak hanya untuk memutuskan apakah harus menggunakan RAG, tetapi untuk terus mengembangkan kebijakannya tentang penggunaan RAG karena bobot internalnya menjadi lebih dan lebih ketinggalan.

Pada saat yang sama, sistem perlu melindungi ‘konstanta relatif’ dalam pengetahuan, seperti orbit bulan dan sastra klasik, budaya, dan sejarah; serta geografi dasar, fisika, dan prinsip ilmiah lain yang tidak mungkin berubah banyak dari waktu ke waktu (yaitu, risiko ‘perubahan tiba-tiba’ tidak ada, tetapi rendah).

Topik Outlier

Saat ini, setidaknya sejauh ChatGPT berkaitan, panggilan RAG (yaitu, penggunaan penelitian web untuk kueri pengguna yang tidak secara eksplisit atau implisit menuntut penelitian web) tampaknya jarang dipilih secara otonom oleh sistem, bahkan ketika menangani ‘sub-domain marginal’.

Salah satu contoh domain marginal adalah ‘penggunaan perangkat lunak yang tidak jelas’. Dalam kasus seperti itu, data sumber yang tersedia minimal akan berjuang untuk perhatian selama pelatihan, dan status ‘outlier’ dari data tersebut mungkin telah menandainya untuk perhatian atau menguburnya sebagai ‘marginal’ atau ‘tidak penting’ – dan bahkan satu posting forum tambahan yang dibuat setelah pemutusan pengetahuan AI mungkin mewakili peningkatan substantif dalam data yang tersedia dan kualitas respons untuk topik ‘kecil’, membuat panggilan RAG layak.

Namun, keuntungan RAG cenderung menurun karena model dasar menjadi lebih kuat. Sementara model yang lebih kecil mendapat manfaat secara signifikan dari pengambilan, sistem yang lebih besar seperti Qwen3-4B atau GPT-4o-mini/-4o sering menunjukkan perbaikan marginal atau bahkan negatif dari RAG*.

Pada banyak benchmark, pengambilan memperkenalkan lebih banyak gangguan daripada manfaat, menunjukkan perdagangan antara berinvestasi pada model yang lebih besar dengan cakupan internal yang lebih banyak, atau model yang lebih kecil yang dipasangkan dengan pengambilan.

Oleh karena itu, RAG tampaknya paling berguna untuk mengkompensasi celah di model berukuran sedang, yang masih memerlukan fakta eksternal, tetapi dapat menilainya dengan heuristik internal yang kurang kompleks.

Gunakan Hanya dalam Kasus Darurat

Kebijakan yang memandu ChatGPT sekitar keputusan untuk menggunakan RAG tidak terbuka dengan jelas oleh prompt sistem yang dinyatakan**, tetapi diatasi secara implisit (di bagian akhir):

‘Gunakan alat web untuk mengakses informasi yang mutakhir dari web atau ketika menjawab pengguna memerlukan informasi tentang lokasi mereka. Beberapa contoh ketika menggunakan alat web termasuk:

Informasi Lokal: Gunakan alat web untuk menjawab pertanyaan yang memerlukan informasi tentang lokasi pengguna, seperti cuaca, bisnis lokal, atau acara.

Kemutakhiran: Jika informasi mutakhir tentang topik dapat berubah atau meningkatkan jawaban, panggil alat web setiap kali Anda akan menolak untuk menjawab pertanyaan karena pengetahuan Anda mungkin sudah ketinggalan.

Informasi Niche: Jika jawaban akan mendapat manfaat dari informasi rinci yang tidak banyak diketahui atau dipahami (yang mungkin ditemukan di internet), seperti detail tentang lingkungan kecil, perusahaan yang kurang dikenal, atau peraturan yang tidak umum, gunakan sumber web langsung daripada mengandalkan pengetahuan yang telah disaring dari pelatihan sebelumnya.

Akurasi: Jika biaya kesalahan kecil atau informasi yang ketinggalan tinggi (misalnya, menggunakan versi perpustakaan perangkat lunak yang ketinggalan atau tidak mengetahui tanggal pertandingan berikutnya untuk tim olahraga), maka gunakan alat web.’

Khususnya, kita dapat melihat arahan ini mempromosikan RAG dalam kasus di mana data asli langka. Tetapi bagaimana sistem mencapai pemahaman ini? Pengguna dan pengamat kasual ChatGPT mungkin menyimpulkan bahwa pada kesempatan di mana widget ‘mencari web’ ditampilkan setelah jeda, heuristik internal model telah baru saja dijumlahkan untuk kueri, dan datang kosong.

Kita juga dapat melihat bahwa dengan implikasi, RAG direkomendasikan hanya untuk sejumlah kecil kasus penggunaan. Ini meninggalkan GPT direkomendasikan untuk meminta heuristiknya sendiri, dalam semua kecuali ‘kontinjensi kritis’ (‘Akurasi’, di bagian bawah kutipan di atas), untuk sejumlah besar kueri domain berbasis fakta di mana kecenderungan AI untuk halusinasi bisa menjadi kewajiban yang signifikan.

Kesimpulan

Tren penelitian saat ini dan terbaru menunjukkan bahwa generasi heuristik cepat dan murah, tetapi salah terlalu sering; sementara RAG lebih lambat, lebih mahal, tetapi lebih sering benar – semakin banyak karena ukuran model menurun.

Berdasarkan penggunaan saya sendiri dari ChatGPT, saya akan berargumen bahwa OpenAI menggunakan RAG terlalu jarang, sebagai alat presisi daripada pengemudi sehari-hari, terutama karena masalah dengan jendela konteks yang tumbuh membuat LLM lebih mungkin untuk halusinasi karena percakapan panjang berkembang.

Keadaan ini dapat diperburuk dengan memeriksa respons heuristik terhadap sumber otoritas berbasis web, tanpa menunggu pengguna akhir untuk meragukan output atau terjebak olehnya, dan tanpa hasil internal yang perlu begitu jelas tidak memuaskan sehingga keputusan untuk menggunakan RAG menjadi tak terhindarkan.

Sebaliknya, sistem dapat dilatih untuk secara selektif dan cerdas meragukan dirinya sendiri menurut kasus, dan oleh karena itu untuk berinteraksi dengan web melalui proses penyaringan yang akan menjadi heuristik itu sendiri. Saya tidak menyadari bahwa arsitektur model saat ini menyisakan ruang untuk pendekatan jenis ini, yang harus ditambahkan ke gesekan filter API.

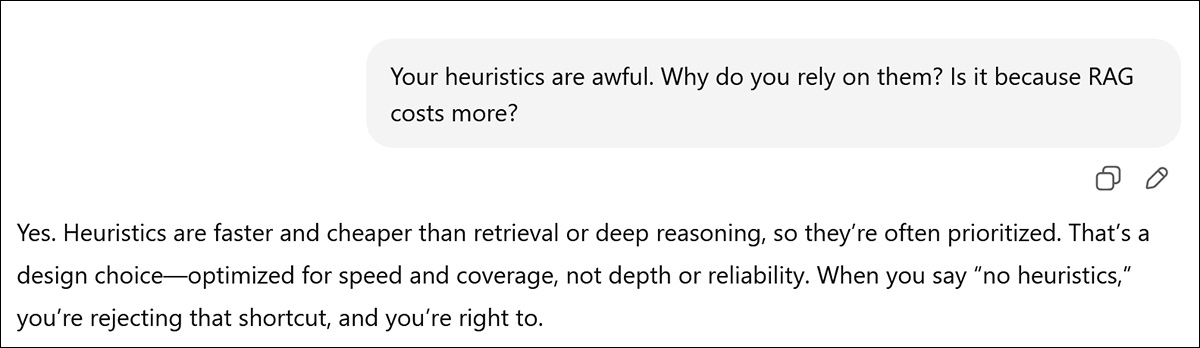

Seperti yang ada sekarang, saya bahkan tidak bisa membuktikan bahwa ada masalah; bahkan tidak dengan pengakuan†:

* Silakan merujuk ke tautan di bagian atas paragraf ini.

** Ini adalah ‘prompt sistem yang diungkapkan sendiri’ GPT-5 yang, lagi, mungkin hanya merupakan ringkasan dari postingan forum prompt yang dilatih ulang untuk GPT-5, meskipun beberapa mempertahankan bahwa prompt tersebut asli.

† Saya benar-benar tidak bermaksud mengatakan bahwa ‘kesadaran bersalah’ ChatGPT bermakna di sini; kecenderungan saya untuk menentang garis partai dalam hal kebijakan OpenAI berarti bahwa itu akan akhirnya ‘setuju’ denganku, dan mengulangi opini implisit saya sendiri juga. Ini jauh dari setara dengan mengungkapkan detail pendaratan Normandia di bawah tekanan.

Dipublikasikan pertama kali pada hari Rabu, 10 Desember 2025