Sudut Anderson

Mengapa Model Bahasa Mengalami ‘Kehilangan’ dalam Percakapan

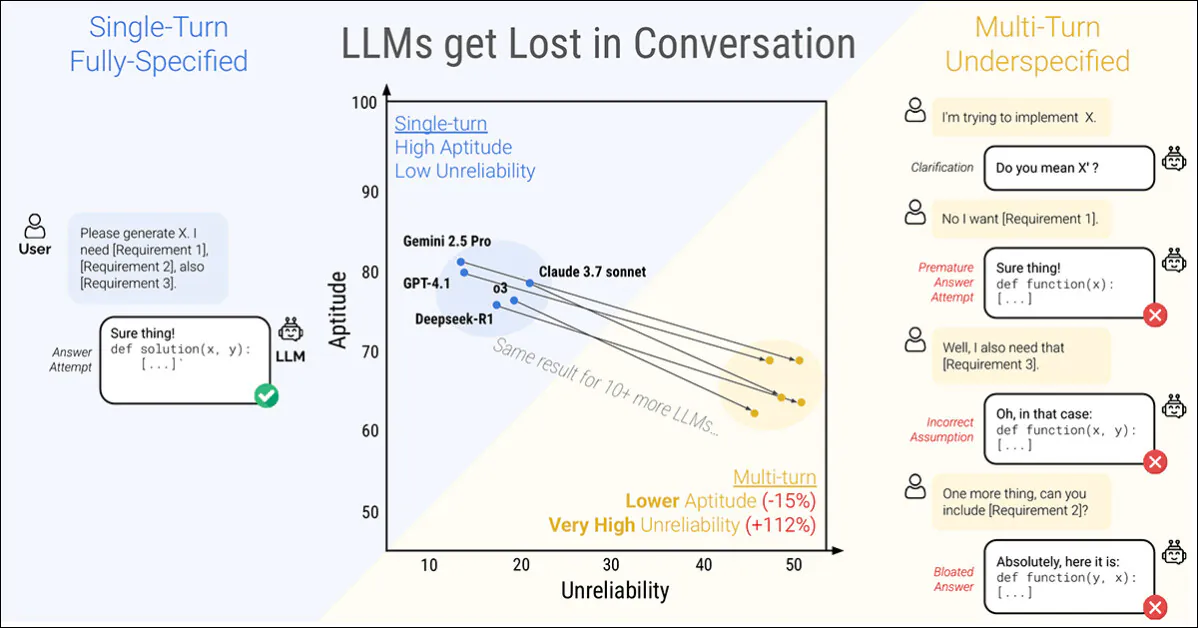

Sebuah makalah baru dari Microsoft Research dan Salesforce menemukan bahwa bahkan model bahasa besar (LLM) yang paling mampu mengalami kegagalan ketika instruksi diberikan secara bertahap daripada sekaligus. Penulis menemukan bahwa kinerja menurun rata-rata 39 persen di enam tugas ketika prompt dibagi menjadi beberapa giliran:

Percakapan satu giliran (kiri) mendapatkan hasil terbaik, tetapi tidak alami untuk pengguna akhir. Percakapan multi-giliran (kanan) menemukan bahwa bahkan model LLM yang paling tinggi dan paling berkinerja mengalami kehilangan impuls efektif dalam percakapan. Sumber: https://arxiv.org/pdf/2505.06120

Lebih menarik lagi, keandalan respons mengalami penurunan, dengan model prestisius seperti ChatGPT-4.1 dan Gemini 2.5 Pro berfluktuasi antara jawaban hampir sempurna dan kegagalan nyata, tergantung pada bagaimana tugas yang sama dinyatakan; lebih lanjut, konsistensi output dapat menurun lebih dari setengah dalam proses.

Untuk mengeksplorasi perilaku ini, makalah ini memperkenalkan metode yang disebut sharding*, yang membagi prompt yang sepenuhnya ditentukan menjadi fragmen yang lebih kecil dan melepaskannya satu per satu ke dalam percakapan.

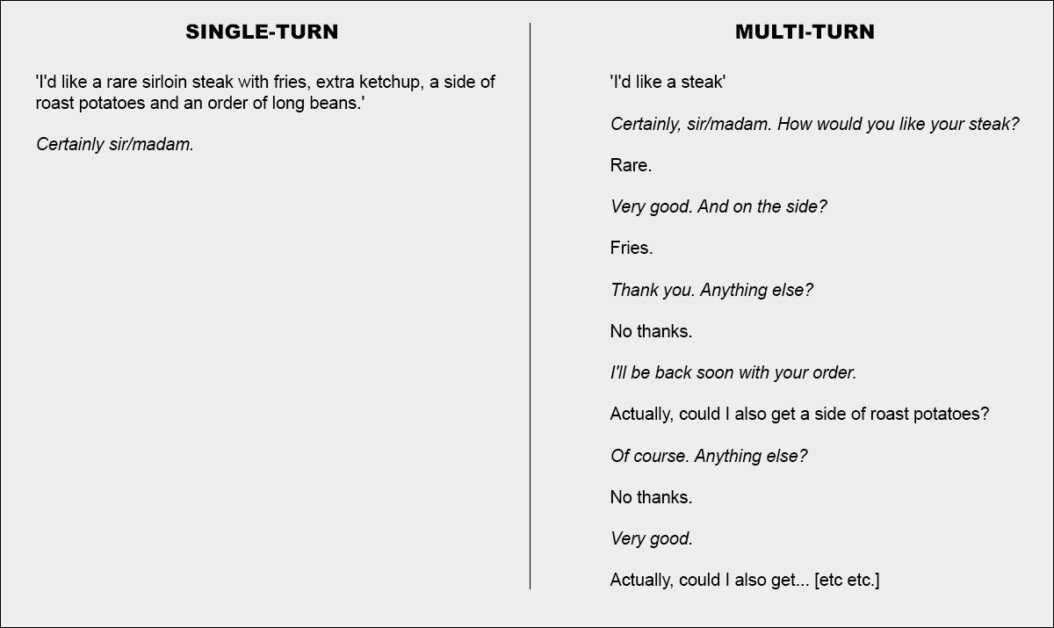

Dalam istilah yang paling sederhana, ini setara dengan memberikan perintah yang koheren dan komprehensif di restoran, meninggalkan pelayan dengan tidak ada yang harus dilakukan kecuali mengakui permintaan; atau memutuskan untuk menyerang masalah secara kolaboratif:

Dua versi ekstrem dari percakapan restoran (tidak dari makalah baru, untuk tujuan ilustrasi saja).

Untuk penekanan, contoh di atas mungkin menempatkan pelanggan dalam cahaya negatif. Tetapi gagasan inti yang digambarkan dalam kolom kedua adalah transaksi pertukaran yang menjelaskan set problem, sebelum menangani masalah – tampaknya cara rasional dan masuk akal untuk mendekati tugas.

Pengaturan ini tercermin dalam pendekatan sharded baru untuk interaksi LLM. Penulis mencatat bahwa LLM sering menghasilkan respons yang terlalu panjang dan kemudian terus mengandalkan wawasan mereka meskipun wawasan tersebut telah terbukti salah atau tidak relevan. Kecenderungan ini, dikombinasikan dengan faktor lain, dapat menyebabkan sistem kehilangan jejak pertukaran sepenuhnya.

Bahkan, peneliti mencatat apa yang telah banyak dari kita temukan secara anekdot – bahwa cara terbaik untuk mendapatkan percakapan kembali pada jalur yang tepat adalah dengan memulai percakapan baru dengan LLM.

‘Jika percakapan dengan LLM tidak menghasilkan hasil yang diharapkan, memulai percakapan baru yang mengulangi informasi yang sama mungkin menghasilkan hasil yang jauh lebih baik daripada melanjutkan percakapan yang sedang berlangsung.

‘Ini karena LLM saat ini dapat kehilangan dalam percakapan, dan eksperimen kami menunjukkan bahwa mempertahankan percakapan dengan model adalah tidak efektif. Selain itu, karena LLM menghasilkan teks dengan keacakan, percakapan baru mungkin menghasilkan hasil yang lebih baik.’

Penulis mengakui bahwa sistem agen seperti Autogen atau LangChain dapat memperbaiki hasil dengan bertindak sebagai lapisan interpretatif antara pengguna akhir dan LLM, hanya berkomunikasi dengan LLM ketika mereka telah mengumpulkan cukup respons sharded untuk menggabungkan menjadi query tunggal yang koheren (yang pengguna akhir tidak akan terpapar).

Namun, penulis berpendapat bahwa lapisan abstraksi terpisah seharusnya tidak diperlukan, atau dibangun langsung ke dalam sumber LLM:

‘Argumen dapat dibuat bahwa kemampuan multi-giliran tidak merupakan fitur yang diperlukan dari LLM, karena dapat di-offload ke kerangka agen. Dengan kata lain, apakah kita memerlukan dukungan multi-giliran asli di LLM ketika kerangka agen dapat mengatur interaksi dengan pengguna dan memanfaatkan LLM hanya sebagai operator satu giliran?…’

Tetapi setelah menguji proposisi tersebut di seluruh contoh mereka, mereka menyimpulkan:

‘[Mengandalkan] kerangka agen untuk memproses informasi mungkin membatasi, dan kami berpendapat LLM harus mendukung interaksi multi-giliran secara asli.’

Makalah menarik ini berjudul LLM Get Lost In Multi-Turn Conversation, dan berasal dari empat peneliti di MS Research dan Salesforce,

Percakapan yang Terfragmentasi

Metode baru ini pertama-tama memecah instruksi konvensional satu giliran menjadi bagian yang lebih kecil, dirancang untuk diperkenalkan pada saat-saat kunci selama interaksi LLM, struktur yang mencerminkan gaya keterlibatan eksploratif, bolak-balik yang terlihat dalam sistem seperti ChatGPT atau Google Gemini.

Setiap instruksi asli adalah prompt tunggal yang mandiri yang mengirimkan seluruh tugas sekaligus, menggabungkan pertanyaan tingkat tinggi, konteks pendukung, dan kondisi relevan. Versi sharded memecahnya menjadi beberapa bagian yang lebih kecil, dengan setiap shard menambahkan hanya satu potongan informasi:

<img class=" wp-image-217458" src="https://www.unite.ai/wp-content/uploads/2025/05/sharded-and-unsharded.jpg" alt="Instruksi yang dipasangkan menunjukkan (a) prompt lengkap yang disampaikan dalam satu giliran dan (b) versi sharded-nya yang digunakan untuk mensimulasikan interaksi yang tidak lengkap dan multi-giliran. Secara semantik, setiap versi mengirimkan payload informasi yang sama.” width=”908″ height=”213″ /> Instruksi yang dipasangkan menunjukkan (a) prompt lengkap yang disampaikan dalam satu giliran dan (b) versi sharded-nya yang digunakan untuk mensimulasikan interaksi yang tidak lengkap dan multi-giliran. Secara semantik, setiap versi mengirimkan payload informasi yang sama.

Shard pertama selalu memperkenalkan tujuan utama tugas, sementara yang lain menyediakan detail klarifikasi. Bersama-sama, mereka mengirimkan konten yang sama dengan prompt asli, tetapi ditebar secara alami selama beberapa giliran dalam percakapan.