Kecerdasan buatan

GOTCHA– Sistem CAPTCHA untuk Live Deepfakes

Penelitian baru dari Universitas New York menambahkan pada tanda-tanda yang semakin bertambah bahwa kita mungkin segera harus mengambil ‘tes mabuk’ setara untuk memverifikasi diri kita sendiri, sebelum memulai panggilan video yang sensitif – seperti video konferensi terkait pekerjaan, atau skenario sensitif lainnya yang mungkin menarik penipu menggunakan perangkat lunak streaming deepfake waktu nyata.

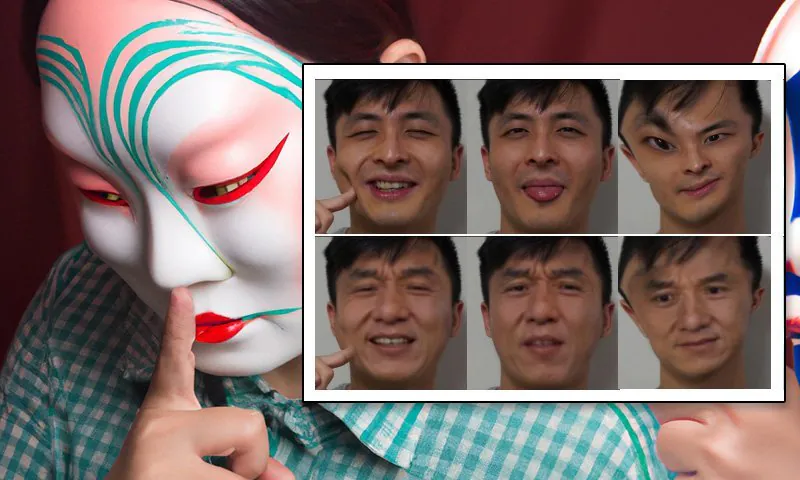

Beberapa tantangan aktif dan pasif yang diterapkan pada skenario panggilan video di GOTCHA. Pengguna harus mematuhi dan lulus tantangan, sementara metode ‘pasif’ tambahan (seperti mencoba membebani sistem deepfake potensial) digunakan yang tidak dipengaruhi oleh partisipan. Sumber: http://export.arxiv.org/pdf/2210.06186

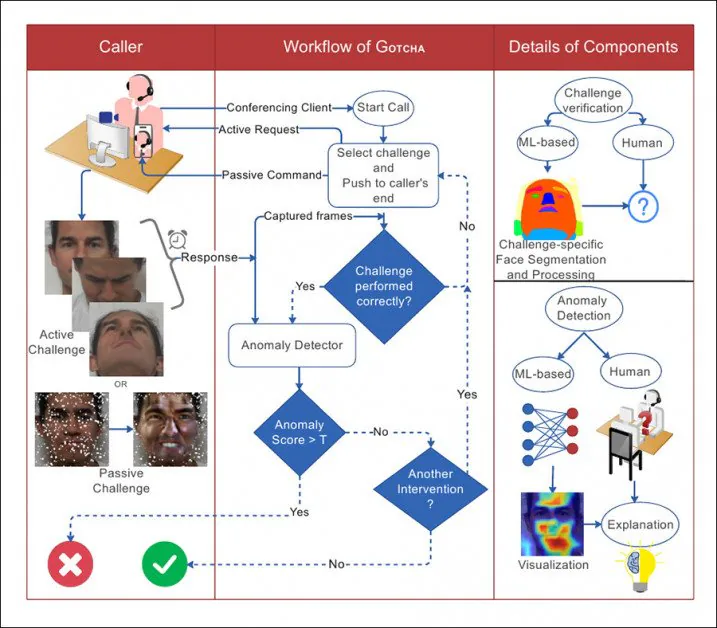

Sistem yang diusulkan ini berjudul GOTCHA – sebuah penghormatan kepada sistem CAPTCHA yang telah menjadi hambatan yang semakin besar bagi penjelajahan web selama 10-15 tahun terakhir, di mana sistem otomatis meminta pengguna untuk melakukan tugas yang sulit dilakukan mesin, seperti mengidentifikasi hewan atau memecahkan teks yang terdistorsi (dan, ironisnya, tantangan ini sering mengubah pengguna menjadi annotator outsource gratis AMT-style).

Pada intinya, GOTCHA memperluas makalah DF-Captcha dari Universitas Ben-Gurion pada Agustus 2022, yang pertama kali mengusulkan membuat orang di ujung lain panggilan melompat melalui beberapa lingkaran semantik visual untuk membuktikan keaslian mereka.

[caption id="attachment_184318" align="alignnone" width="1100"]

Yang patut dicatat, GOTCHA menambahkan metodologi ‘pasif’ ke ‘kaskade’ tes yang diusulkan, termasuk superimposisi otomatis elemen tidak nyata di atas wajah pengguna, dan ‘pembebanan’ frame yang melewati sistem sumber. Namun, hanya tugas yang responsif pengguna yang dapat dievaluasi tanpa izin khusus untuk mengakses sistem lokal pengguna – yang, kemungkinan besar, akan datang dalam bentuk modul atau add-on lokal untuk sistem populer seperti Skype dan Zoom, atau bahkan dalam bentuk perangkat lunak khusus yang dirancang khusus untuk menghilangkan penipu.

[caption id="attachment_184319" align="alignnone" width="717"]

Peneliti memvalidasi sistem pada dataset baru yang berisi lebih dari 2,5 juta frame video dari 47 partisipan, masing-masing melakukan 13 tantangan dari GOTCHA. Mereka mengklaim bahwa kerangka kerja ini menginduksi ‘pengurangan konsisten dan terukur’ kualitas konten deepfake untuk pengguna penipu, membebani sistem lokal sampai artefak yang jelas terlihat oleh mata manusia (meskipun GOTCHA juga berisi beberapa metode analisis algoritmik yang lebih halus).

Makalah baru ini berjudul Gotcha: Sistem Tanggapan-Tantangan untuk Deteksi Deepfake Waktu Nyata (nama sistem ini dikapitalisasi dalam tubuh tetapi tidak dalam judul publikasi, meskipun bukan akronim).

Sebuah Rentang Tantangan

Sebagian besar sesuai dengan makalah Ben Gurion, tantangan yang dihadapi pengguna secara langsung dibagi menjadi beberapa jenis tugas.

Untuk oklusi, pengguna diminta untuk menutupi wajah mereka dengan tangan mereka, atau dengan objek lain, atau untuk mempresentasikan wajah mereka pada sudut yang tidak mungkin telah dilatih ke dalam model deepfake (biasanya karena kurangnya data pelatihan untuk ‘pose aneh’ – lihat kisaran gambar di ilustrasi pertama di atas).

Selain tindakan yang dapat dilakukan pengguna sendiri sesuai dengan instruksi, GOTCHA dapat menimpa potongan wajah acak, stiker, dan filter realitas tambahan, untuk ‘merusak’ aliran wajah yang diharapkan oleh model deepfake lokal, menyebabkannya gagal. Seperti yang ditunjukkan sebelumnya, meskipun ini adalah proses ‘pasif’ untuk pengguna, ini adalah proses yang invasif untuk perangkat lunak, yang perlu dapat mengintervensi langsung dalam aliran koresponden akhir.

Berikutnya, pengguna mungkin diminta untuk membuat ekspresi wajah yang tidak biasa yang kemungkinan besar tidak ada atau kurang dalam dataset pelatihan, menyebabkan penurunan kualitas output deepfake (gambar ‘b’, kolom kedua dari kiri, di ilustrasi pertama di atas).

Sebagai bagian dari serangkaian tes ini, pengguna mungkin diminta untuk membaca teks atau membuat percakapan yang dirancang untuk menantang sistem deepfake waktu nyata lokal, yang mungkin tidak telah melatih rangkaian fonem atau jenis data mulut lainnya ke tingkat yang dapat merekonstruksi gerakan bibir yang akurat di bawah pemeriksaan yang ketat.

Akhirnya (dan ini tampaknya menantang bakat akting koresponden akhir), dalam kategori ini, pengguna mungkin diminta untuk melakukan ‘ekspresi mikro’ – ekspresi wajah singkat dan tidak disengaja yang mengungkapkan emosi. Dari ini, makalah tersebut menyatakan ‘[itu] biasanya berlangsung 0,5-4,0 detik, dan sulit untuk dipalsukan’.

Meskipun makalah tersebut tidak menjelaskan bagaimana mengekstrak ekspresi mikro, logika menunjukkan bahwa satu-satunya cara untuk melakukannya adalah dengan menciptakan emosi yang sesuai pada pengguna akhir, mungkin dengan beberapa jenis konten yang mengejutkan yang disajikan kepada mereka sebagai bagian dari rutinitas tes.

Distorsi Wajah, Pencahayaan, dan Tamu Tidak Terduga

Selain itu, sejalan dengan saran dari makalah Agustus, pekerjaan baru ini mengusulkan meminta pengguna akhir untuk melakukan distorsi wajah yang tidak biasa dan manipulasi, seperti menekan jari mereka ke pipi mereka, berinteraksi dengan wajah dan/atau rambut mereka, dan melakukan gerakan lain yang tidak mungkin dapat ditangani dengan baik oleh sistem deepfake waktu nyata, karena ini adalah tindakan marginal – bahkan jika mereka hadir dalam dataset pelatihan, reproduksi mereka kemungkinan besar akan berkualitas rendah, sejalan dengan data ‘outlier’ lainnya.

Senyum, tetapi ‘wajah tertekan’ ini tidak diterjemahkan dengan baik oleh sistem deepfake waktu nyata lokal.

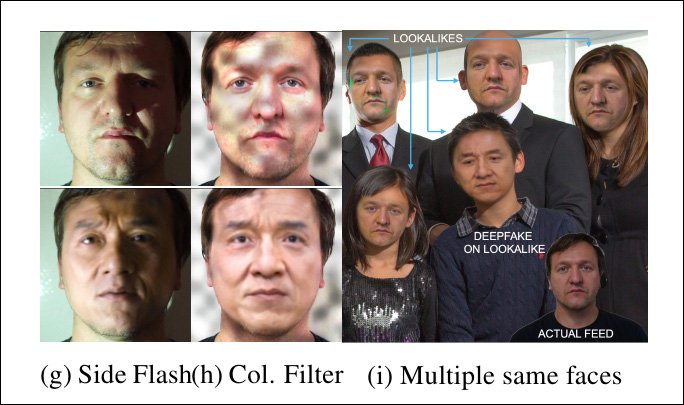

Tantangan tambahan terletak pada perubahan kondisi pencahayaan di mana pengguna akhir berada, karena memungkinkan bahwa pelatihan model deepfake telah dioptimalkan untuk situasi pencahayaan video konferensi standar, atau bahkan kondisi pencahayaan yang tepat yang digunakan dalam panggilan.

Oleh karena itu, pengguna mungkin diminta untuk menyinari wajah mereka dengan senter ponsel mereka, atau dengan cara lain mengubah pencahayaan (dan perlu diingat bahwa ini adalah proposisi sentral dari makalah deteksi deepfake waktu nyata lain yang diterbitkan musim panas ini).

Sistem deepfake waktu nyata ditantang oleh pencahayaan yang tidak terduga – dan bahkan oleh beberapa orang dalam aliran, di mana mereka mengharapkan hanya satu individu.

Dalam kasus sistem yang diusulkan memiliki kemampuan untuk mengintervensi langsung dalam aliran pengguna lokal (yang dicurigai mengandung deepfake perantara), menambahkan pola yang tidak terduga dapat mengompromikan kemampuan algoritma deepfake untuk mempertahankan simulasi.

Selain itu, meskipun tidak masuk akal untuk mengharapkan koresponden untuk memiliki orang tambahan di tangan untuk membantu memverifikasi mereka, sistem dapat menyisipkan wajah tambahan (gambar paling kanan di atas), dan melihat apakah sistem deepfake lokal membuat kesalahan dengan beralih perhatian – atau bahkan mencoba membuat deepfake semua orang (sistem deepfake autoencoder tidak memiliki kemampuan ‘pengenalan identitas’ yang dapat mempertahankan fokus pada satu individu dalam skenario ini).

Steganografi dan Pembebanan

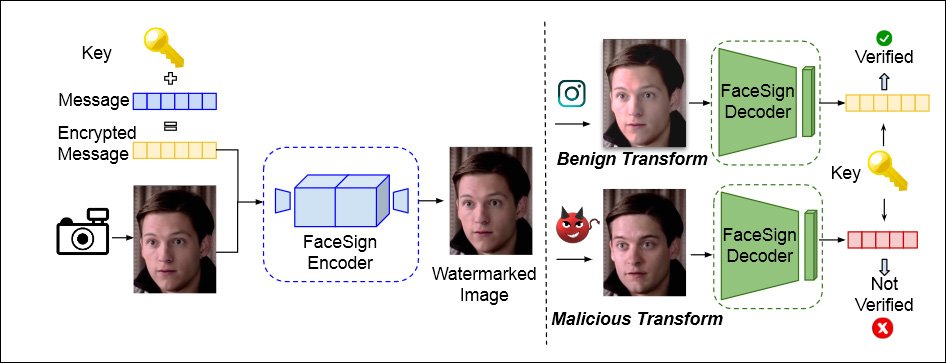

GOTCHA juga mengintegrasikan pendekatan yang pertama kali diusulkan oleh UC San Diego pada April tahun ini, dan yang menggunakan steganografi untuk mengenkripsi pesan ke dalam aliran video lokal pengguna. Rutinitas deepfake akan menghancurkan pesan ini, menyebabkan kegagalan autentikasi.

Dari makalah April 2022 dari Universitas California San Diego, dan Universitas Negara Bagian San Diego, metode untuk menentukan identitas asli dengan melihat apakah sinyal steganografi yang dikirim ke aliran video pengguna bertahan dalam loop lokal yang utuh – jika tidak, kecurangan deepfaking mungkin terjadi. Sumber: https://arxiv.org/pdf/2204.01960.pdf

Selain itu, GOTCHA dapat membebani sistem lokal (dengan akses dan izin), dengan menduplikasi aliran dan menyajikan ‘data berlebihan’ ke sistem lokal, yang dirancang untuk menyebabkan kegagalan replikasi dalam sistem deepfake lokal.

Sistem ini berisi tes tambahan (lihat makalah untuk detail), termasuk tantangan, dalam kasus koresponden berbasis smartphone, untuk membalikkan ponsel mereka, yang akan merusak sistem deepfake lokal:

Lagi, hal seperti ini hanya akan berfungsi dengan kasus penggunaan yang kuat, di mana pengguna dipaksa untuk memberikan akses lokal ke aliran, dan tidak dapat diimplementasikan dengan evaluasi pasif video pengguna, tidak seperti tes interaktif (seperti menekan jari ke wajah).

Praktik

Makalah tersebut menyentuh singkat tentang sejauh mana tes seperti ini mungkin mengganggu pengguna akhir, atau mengganggu mereka – misalnya, dengan memaksa pengguna untuk memiliki sejumlah objek yang mungkin diperlukan untuk tes, seperti kacamata hitam.

Juga mengakui bahwa mungkin sulit untuk membuat koresponden kuat mematuhi rutinitas tes. Dalam hal kasus video panggilan dengan CEO, penulis menyatakan:

‘Kemudahan penggunaan mungkin menjadi kunci di sini, sehingga tantangan tidak formal atau main-main (seperti distorsi wajah atau ekspresi) mungkin tidak sesuai. Tantangan yang menggunakan artikel fisik eksternal mungkin tidak diinginkan. Konteks di sini dimodifikasi dan GOTCHA menyesuaikan rangkaian tantangannya secara tepat.’

Data dan Tes

GOTCHA diuji melawan empat strain sistem deepfake waktu nyata lokal, termasuk dua variasi pembuat deepfake autoencoder yang sangat populer DeepFaceLab (‘DFL’, meskipun, secara mengejutkan, makalah tersebut tidak menyebutkan DeepFaceLive, yang telah, sejak Agustus 2021, implementasi ‘waktu nyata’ DeepFaceLab, dan tampaknya sumber daya awal yang paling mungkin untuk penipu potensial).

Empat sistem tersebut adalah DFL yang dilatih ‘ringan’ pada orang non-terkenal yang berpartisipasi dalam tes, dan selebriti; DFL yang dilatih lebih lengkap, hingga 2m+ iterasi atau langkah, di mana satu akan mengharapkan model yang jauh lebih performant; Latent Image Animator (LIA); dan Face Swapping Generative Adversarial Network (FSGAN).

Untuk data, peneliti merekam dan mengkurasi klip video, menampilkan 47 pengguna yang melakukan 13 tantangan aktif, dengan setiap pengguna menghasilkan sekitar 5-6 menit video 1080p pada 60fps. Penulis menyatakan juga bahwa data ini akan segera dirilis ke publik.

Deteksi anomali dapat dilakukan baik oleh pengamat manusia atau algoritma. Untuk opsi kedua, sistem dilatih pada 600 wajah dari dataset FaceForensics. Fungsi kerugian regresi adalah Learned Perceptual Image Patch Similarity (LPIPS) yang kuat, sementara entropi biner digunakan untuk melatih klasifikasi. EigenCam digunakan untuk visualisasi bobot detektor.

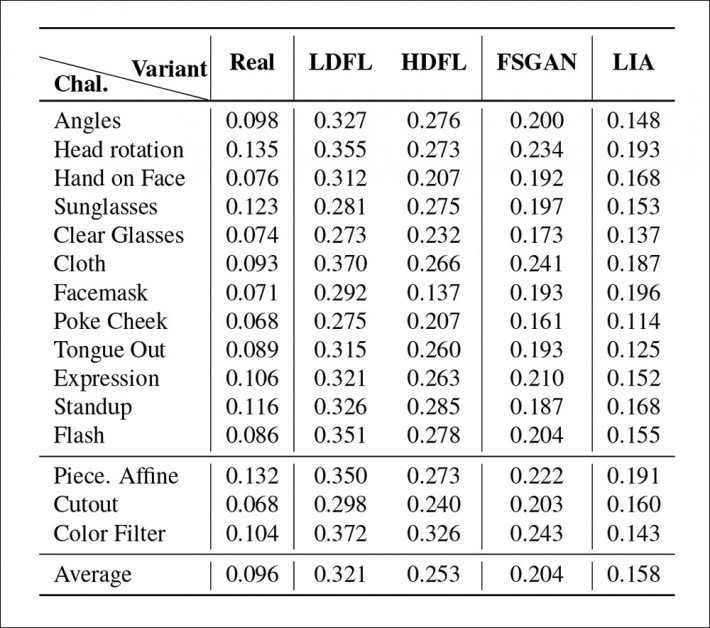

Hasil utama dari tes untuk GOTCHA.

Peneliti menemukan bahwa untuk kaskade penuh tes di seluruh empat sistem, jumlah dan tingkat anomali (yaitu, artefak yang akan mengungkap kehadiran sistem deepfake) terendah diperoleh oleh distribusi DFL yang lebih terlatih. Versi yang kurang terlatih bergelut khususnya untuk merekonstruksi gerakan bibir yang kompleks (yang menduduki sangat sedikit dari frame, tetapi yang menerima perhatian manusia yang tinggi), sementara FSGAN menduduki tanah di antara dua versi DFL, dan LIA terbukti tidak memadai untuk tugas, dengan peneliti berpendapat bahwa LIA akan gagal dalam penerapan nyata.

Dipublikasikan pertama kali pada 17 Oktober 2022.