Kecerdasan buatan

EAGLE: Menjelajahi Desain Ruang untuk Model Bahasa Besar Multimodal dengan Campuran Pengkode

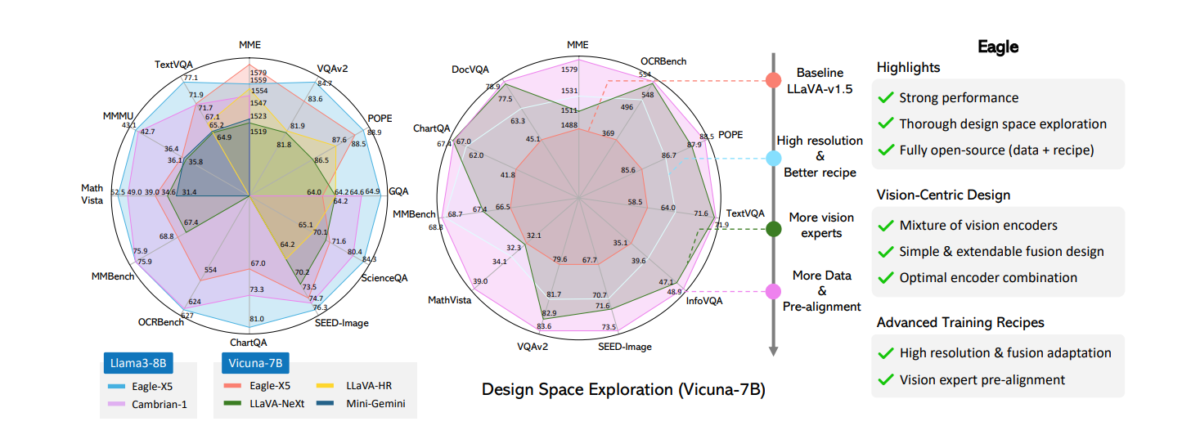

Kemampuan untuk menafsirkan informasi visual kompleks dengan akurat merupakan fokus penting dari model bahasa besar multimodal (MLLMs). Penelitian terbaru menunjukkan bahwa persepsi visual yang ditingkatkan secara signifikan mengurangi halusinasi dan meningkatkan kinerja pada tugas-tugas yang sensitif terhadap resolusi, seperti pengenalan karakter optik dan analisis dokumen. Beberapa MLLM terbaru mencapai hal ini dengan menggunakan campuran pengkode visi. Meskipun kesuksesan mereka, masih ada kekurangan perbandingan sistematis dan studi ablasion terperinci yang menangani aspek-aspek kritis, seperti pemilihan ahli dan integrasi beberapa ahli visi. Artikel ini menyediakan eksplorasi ekstensif dari desain ruang untuk MLLMs menggunakan campuran pengkode visi dan resolusi, kerangka Eagle yang berusaha untuk menjelajahi desain ruang untuk model bahasa besar multimodal dengan campuran pengkode. Temuan menunjukkan beberapa prinsip dasar yang umum untuk strategi yang berbeda, mengarah pada pendekatan desain yang sederhana namun efektif. Eagle menemukan bahwa hanya dengan menggabungkan token visual dari set pengkode visi yang komplementer adalah sama efektifnya dengan arsitektur pencampuran yang lebih kompleks atau strategi. Selain itu, Eagle memperkenalkan Pre-Alignment untuk menjembatani kesenjangan antara pengkode visi yang berfokus dan token bahasa, meningkatkan kohesi model. Hasilnya, keluarga MLLMs, Eagle, melampaui model terbuka lainnya pada benchmark MLLM utama.

Kerja Eagle terkait dengan desain arsitektur umum dari model bahasa besar multimodal (MLLMs). Selain garis penelitian terbuka yang disebutkan sebelumnya, keluarga MLLMs lainnya termasuk, tetapi tidak terbatas pada, MiniGPT-4, Lynx, Otter, QwenVL, CogVLM, VILA, GPT-4V, Gemini, dan Llama 3.1. Bergantung pada bagaimana sinyal visi diintegrasikan ke dalam model bahasa, MLLMs dapat dikategorikan secara luas menjadi model “perhatian antar moda” dan model “penyetelan awal”. Yang pertama menyuntikkan informasi visual ke dalam lapisan yang berbeda dari LLMs menggunakan perhatian antar moda, sedangkan yang terakhir memperlakukan token visual sebagai bagian dari urutan token bahasa dan langsung melampirkan mereka dengan penyematan teks. Model Eagle termasuk dalam keluarga penyetelan awal dengan mengikuti arsitektur multimodal LLaVA-styled. Mengingat bahwa MLLM adalah bidang yang tumbuh cepat, Eagle merekomendasikan merujuk pada studi dan survei yang lebih terperinci untuk wawasan lebih lanjut.

Kerja Eagle erat terkait dengan penelitian yang berfokus pada meningkatkan desain pengkode visi untuk MLLMs. Karya awal biasanya mengadopsi pengkode visi yang telah dilatih sebelumnya pada tugas-tugas penyelarasan visi-bahasa seperti CLIP dan EVA-CLIP. Pengkode visi yang lebih kuat, seperti SigLIP dan InternVL, telah diusulkan untuk meningkatkan tugas-tugas visi-bahasa dengan desain yang lebih baik, ukuran model yang lebih besar, dan resep pelatihan yang lebih efektif. Karena model sering dilatih sebelumnya pada gambar beresolusi rendah dan mungkin kekurangan kemampuan untuk mengkodekan detail halus, adaptasi resolusi yang lebih tinggi sering dilakukan untuk meningkatkan resolusi input MLLM. Selain adaptasi resolusi yang lebih tinggi, model seperti LLaVA-NeXT, LLaVA-UHD, Monkey, InternLM-XComposer, dan InternVL menggunakan tiling atau tiling adaptif untuk menangani input beresolusi tinggi, di mana gambar dibagi menjadi patch beresolusi rendah dan diproses secara terpisah. Meskipun kemampuan untuk menangani resolusi yang lebih tinggi dimungkinkan dengan memperkenalkan ahli visi tambahan, pendekatan ini berbeda sedikit dari teknik tiling, meskipun keduanya kompatibel dan dapat digabungkan.

EAGLE: Menggunakan Campuran Pengkode untuk Menjelajahi Desain Ruang untuk MLLMs

Kesuksesan model bahasa besar (LLMs) telah memicu minat yang signifikan dalam mengaktifkan kemampuan persepsi visual mereka, memungkinkan mereka untuk melihat, memahami, dan bernalar di dunia nyata. Di inti dari model bahasa besar multimodal (MLLMs) ini terdapat desain yang khas di mana gambar diubah menjadi serangkaian token visual oleh pengkode visi dan dilampirkan dengan penyematan teks. CLIP sering dipilih sebagai pengkode visi karena representasi visualnya yang sejalan dengan ruang teks dengan pelatihan sebelumnya pada pasangan gambar-teks. Bergantung pada arsitektur, resep pelatihan, dan cara token visi disuntikkan ke dalam model bahasa, keluarga MLLMs yang terkenal termasuk Flamingo, BLIP, PaLI, PaLM-E, dan LLaVA. Kebanyakan model ini mempertahankan resolusi input yang relatif rendah karena keterbatasan pengkode visi yang telah dilatih sebelumnya dan panjang urutan LLM. Kerja Eagle sejalan dengan model yang menggunakan beberapa pengkode visi untuk persepsi yang ditingkatkan.

Untuk contoh, model seperti Mousi dan Brave menggabungkan token visual dari pengkode visi yang berbeda dengan menggabungkan sepanjang kanal atau arah token. RADIO memperkenalkan metode distilasi multi-guru untuk mempersatukan kemampuan pengkode visi yang berbeda ke dalam satu model. MoAI, IVE, dan Prismer lebih lanjut menggunakan output dari ahli visi, seperti OCR, deteksi, atau estimasi kedalaman, untuk melengkapi informasi tambahan untuk MLLMs untuk menghasilkan jawaban. MoVA merancang jaringan pengaturan untuk menetapkan model visi optimal berdasarkan gambar dan instruksi yang diberikan.

Studi terbaru telah menunjukkan bahwa desain pengkode visi yang lebih kuat sangat penting untuk mengurangi halusinasi MLLM dan meningkatkan kinerja pada tugas-tugas yang sensitif terhadap resolusi seperti pengenalan karakter optik (OCR). Beberapa karya berfokus pada meningkatkan kemampuan pengkode visi, baik dengan meningkatkan data pelatihan dan parameter atau dengan membagi gambar menjadi patch beresolusi rendah. Namun, pendekatan ini sering memperkenalkan permintaan sumber daya pelatihan yang besar. Strategi yang efisien namun kuat adalah menggabungkan pengkode visual yang telah dilatih sebelumnya dengan tugas dan resolusi input yang berbeda, baik dengan menggabungkan pengkode resolusi yang lebih tinggi dengan pengkode CLIP, melampirkan fitur dari pengkode yang berbeda secara berurutan, atau mengadopsi strategi fusi dan pengaturan yang lebih kompleks untuk memaksimalkan manfaat dari pengkode yang berbeda. Pendekatan “campuran-ahli-visi” ini telah terbukti efektif, meskipun studi terperinci tentang ruang desainnya dengan ablasion yang ketat masih kurang, memotivasi Eagle untuk mengunjungi kembali area ini. Pertanyaan kunci masih ada: pengkode visi mana yang harus dipilih, bagaimana menggabungkan ahli yang berbeda, dan bagaimana menyesuaikan strategi pelatihan dengan lebih banyak pengkode visi.

Untuk menjawab pertanyaan ini, Eagle secara sistematis menyelidiki ruang desain campuran-pengkode-visi untuk persepsi MLLM yang ditingkatkan. Eksplorasi ruang desain ini melibatkan langkah-langkah berikut: 1) Benchmarking berbagai pengkode visi dan mencari adaptasi resolusi yang lebih tinggi; 2) Melakukan perbandingan “apfel ke apfel” antara strategi fusi pengkode visi; 3) Secara progresif mengidentifikasi kombinasi optimal dari beberapa pengkode visi; 4) Meningkatkan pre-alignment ahli visi dan campuran data. Langkah-langkah eksplorasi diilustrasikan dalam gambar berikut.

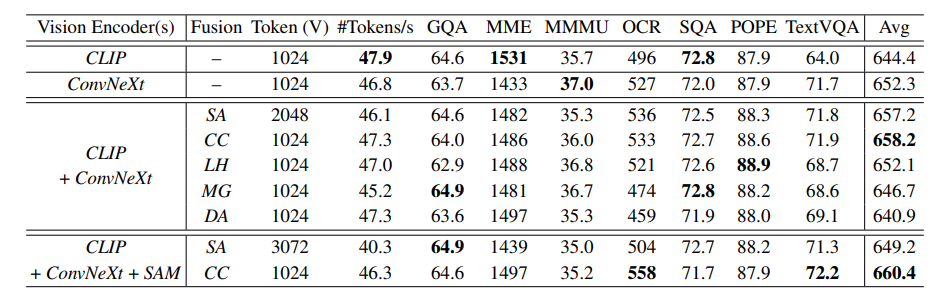

Studi Eagle mencakup kinerja pengkode visi yang telah dilatih sebelumnya pada tugas dan resolusi yang berbeda, seperti penyelarasan visi-bahasa, pembelajaran mandiri, deteksi, segmentasi, dan OCR. Menggunakan pendekatan round-robin, Eagle memulai dengan pengkode CLIP dasar dan menambahkan satu ahli tambahan pada satu waktu, memilih ahli yang memberikan perbaikan terbaik dalam setiap putaran.

Sementara kerja Eagle tidak pertama kalinya menggunakan beberapa pengkode visi dalam MLLMs, studi sistematis ini menyebabkan beberapa temuan kunci dalam pengaturan ini:

- Mengunci pengkode visi selama pelatihan MLLM penting. Ini berbeda dengan model seperti LLaVA dan lainnya yang mempertimbangkan beberapa pengkode visi atau guru, di mana membekukan pengkode visi telah menjadi praktik umum.

- Beberapa strategi fusi yang baru-baru ini diusulkan tidak menunjukkan keunggulan signifikan. Sebaliknya, penggabungan kanal sederhana muncul sebagai strategi fusi yang kompetitif, menawarkan efisiensi dan kinerja terbaik.

- Menggabungkan ahli visi tambahan menghasilkan keuntungan konsisten. Ini membuatnya menjadi jalur yang menjanjikan untuk secara sistematis meningkatkan persepsi MLLM, selain dari meningkatkan pengkode tunggal. Perbaikan ini terutama tampak ketika pengkode visi tidak dibekukan.

- Tahap pre-alignment kunci. Eagle memperkenalkan tahap pre-alignment di mana ahli visi non-teks yang tidak sejalan secara individual difinetuning dengan LLM yang dibekukan sebelum dilatih bersama. Tahap ini secara signifikan meningkatkan kinerja MLLM di bawah desain campuran-pengkode-visi.

Eagle: Metodologi dan Arsitektur

Tidak seperti metode sebelumnya yang berfokus pada strategi fusi baru atau arsitektur antara pengkode visi, tujuan Eagle adalah untuk mengidentifikasi desain minimalis untuk menggabungkan pengkode visi yang berbeda, didukung oleh ablasion terperinci dan menghilangkan komponen yang tidak perlu. Seperti yang ditunjukkan dalam gambar berikut, Eagle memulai dengan memperluas pengkode CLIP dasar ke dalam satu set ahli visi dengan arsitektur, tugas pelatihan, dan resolusi yang berbeda. Dengan ahli-ahli ini, Eagle kemudian membandingkan arsitektur fusi yang berbeda dan metode, serta mengeksplorasi bagaimana mengoptimalkan strategi pelatihan dengan beberapa pengkode.

Akhirnya, Eagle menggabungkan semua temuan dan memperluas pendekatan ke beberapa ahli visi dengan resolusi dan pengetahuan domain yang berbeda. Menggunakan data pelatihan yang sama dengan LLaVA-1.5, yang terdiri dari 595k pasangan gambar-teks, Eagle beralih ke tahap penyempurnaan terarah dengan mengumpulkan data dari serangkaian tugas dan mengubahnya menjadi percakapan multimodal, termasuk LLaVA-1.5, Laion-GPT4V, ShareGPT-4V, DocVQA, synDog-EN, ChartQA, DVQA, dan AI2D, menghasilkan 934k sampel.

Model ini pertama kali dilatih dengan pasangan gambar-teks selama satu epoch dengan ukuran batch 256, di mana model seluruhnya dibekukan, dan hanya lapisan proyektor yang diperbarui. Pada tahap kedua, model tersebut difinetuning pada data penyempurnaan terarah selama satu epoch dengan ukuran batch 128. Untuk eksplorasi ini, Eagle menggunakan Vicuna-7B sebagai model bahasa dasar. Tingkat pembelajaran diatur pada 1e-3 untuk tahap pertama dan 2e-5 untuk tahap kedua.

Pengkode CLIP yang Lebih Kuat

Eagle memulai eksplorasi dengan model CLIP, karena telah menjadi pilihan utama untuk banyak MLLMs. Sementara model CLIP dikenal meningkatkan tugas multimodal, keterbatasannya juga telah didokumentasikan dengan baik. Misalnya, banyak MLLMs yang ada cenderung menggunakan resolusi pelatihan CLIP yang telah dilatih sebelumnya (seperti 224 × 224 atau 336 × 336) sebagai resolusi input mereka. Dalam kasus ini, pengkode seringkali berjuang untuk menangkap detail halus yang penting untuk tugas-tugas yang sensitif terhadap resolusi seperti OCR dan pemahaman dokumen.

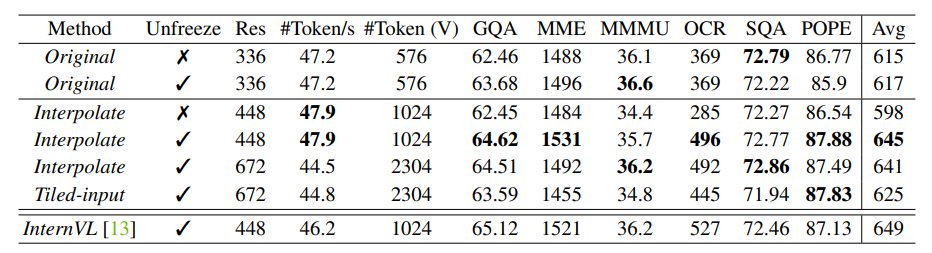

Untuk menangani peningkatan resolusi input, pendekatan umum adalah tiling, di mana gambar input dibagi menjadi ubin dan dienkodkan secara terpisah. Metode lain yang lebih sederhana adalah dengan langsung meningkatkan resolusi input dan menginterpolasi penyematan posisi model transformer visi jika perlu. Eagle membandingkan kedua pendekatan ini dengan pengkode visi yang dibekukan dan tidak dibekukan pada resolusi yang berbeda, dengan hasil yang terkandung dalam tabel di atas. Temuan dapat diringkas sebagai berikut:

- Mengunci pengkode CLIP mengarah pada perbaikan signifikan ketika diinterpolasi ke resolusi input MLLM yang lebih tinggi yang berbeda dari resolusi pelatihan CLIP, tanpa degradasi kinerja ketika resolusi tetap sama.

- Membekukan pengkode CLIP dan langsung menyesuaikannya dengan resolusi input MLLM yang lebih tinggi secara signifikan merusak kinerja.

- Di antara strategi yang dibandingkan, langsung menginterpolasi ke 448 × 448 dengan pengkode CLIP yang tidak dibekukan terbukti efektif dan efisien dalam hal kinerja dan biaya.

- Pengkode CLIP terbaik mencapai kinerja yang dekat dengan InternVL, meskipun menjadi model yang jauh lebih kecil (300M vs. 6B) dengan data pelatihan yang lebih sedikit.

Perlu diingat bahwa CLIP-448 memungkinkan Eagle untuk mencocokkan pengaturan dengan LLaVA-HR dan InternVL, di mana pengkode CLIP disesuaikan untuk menerima input 448 × 448 dan menghasilkan 1024 token patch. Untuk penyelidikan lebih lanjut, Eagle mengikuti strategi sederhana ini dengan meningkatkan resolusi input dan mengunci pengkode visi selama pelatihan.

Eagle mengamati bahwa strategi fusi yang ada, meskipun variasi desainnya, dapat dikategorikan secara luas sebagai berikut:

- Append Urutan: Langsung melampirkan token visual dari berbagai backbone sebagai urutan yang lebih panjang.

- Konkatenasi Kanal: Menggabungkan token visual sepanjang dimensi kanal tanpa meningkatkan panjang urutan.

- LLaVA-HR: Menyuntikkan fitur resolusi tinggi ke dalam pengkode visi resolusi rendah menggunakan adapter campuran-resolusi.

- Mini-Gemini: Menggunakan token CLIP sebagai kueri resolusi rendah untuk cross-attend pengkode visi resolusi tinggi lainnya dalam jendela lokal.

- Perhatian Deformable: Sebuah baseline baru yang diperkenalkan di atas Mini-Gemini, di mana perhatian jendela vanilla digantikan dengan perhatian deformable.

Sebagai gantinya, daripada melatih proyektor untuk menyelaraskan beberapa ahli visi secara bersamaan seperti dalam strategi pelatihan LLaVA asli, kita pertama-tama menyelaraskan representasi dari setiap ahli individu dengan model bahasa yang lebih kecil (Vicuna-7B dalam praktik) menggunakan supervisi prediksi token berikutnya. Seperti yang ditunjukkan dalam gambar di bawah, dengan pre-alignment, proses pelatihan keseluruhan terdiri dari tiga langkah: 1) Melatih setiap ahli visi yang telah dilatih sebelumnya dengan proyektor mereka sendiri pada data SFT, sambil menjaga model bahasa dibekukan; 2) Menggabungkan semua ahli visi dari langkah pertama dan melatih hanya proyektor dengan data pasangan gambar-teks; 3) Melatih model keseluruhan pada data SFT.

Eagle: Eksperimen dan Hasil

Setelah mengembangkan strategi dengan hati-hati, Eagle telah menetapkan prinsip-prinsip berikut untuk model: (1) mengintegrasikan lebih banyak ahli visi dengan resep pelatihan yang dioptimalkan; (2) menggabungkan beberapa ahli visi melalui konkatenasi kanal langsung; (3) melatih ahli visi secara terpisah melalui pre-alignment. Dalam bagian ini, untuk lebih menunjukkan keunggulan model Eagle, data pelatihan tambahan diinkorporasi, dan Eagle dibandingkan dengan MLLMs terdepan saat ini di berbagai tugas. Eagle menggunakan Vicuna-v1.5-7B, Llama3-8B, dan Vicuna-v1.5-13B sebagai model bahasa. Untuk pengkode visi, berdasarkan hasil di Bagian 2.6, model Eagle dinamai sebagai Eagle-X4, yang mencakup empat pengkode visi: CLIP, ConvNeXt, Pix2Struct, dan EVA-02, dan Eagle-X5, yang mencakup pengkode visi SAM tambahan.

Tugas Pertanyaan Visual

Eagle membandingkan seri model di seluruh tiga benchmark Pertanyaan Visual (VQA), termasuk GQA, VQAv2, dan VizWiz. Seperti yang ditunjukkan dalam tabel berikut, Eagle-X5 mencapai kinerja terdepan pada GQA dan VQAv2, menyoroti keunggulan mengintegrasikan ahli visi tambahan.

Tugas OCR dan Pemahaman Grafik

Untuk mengevaluasi kemampuan OCR, dokumen, dan pemahaman grafik Eagle, model tersebut diujikan pada OCRBench, TextVQA, dan ChartQA. Seperti yang ditunjukkan dalam tabel di atas, Eagle secara signifikan melampaui pesaing pada TextVQA, mendapat manfaat dari arsitektur resolusi tinggi dan integrasi pengkode visi yang berbeda. Terutama, Eagle mempertahankan desain sederhana, mendukung hingga 1024 token tanpa memerlukan dekomposisi ubin kompleks gambar.

Gambar di bawah ini menampilkan contoh kasus OCR dan pemahaman dokumen. Dengan adaptasi resolusi tinggi dan integrasi lebih banyak ahli visi, Eagle dapat mengidentifikasi teks kecil dalam gambar dan secara akurat mengekstrak informasi berdasarkan instruksi pengguna.

Untuk lebih memahami manfaat memperkenalkan ahli yang telah dilatih sebelumnya pada tugas visi lain, gambar berikut memvisualisasikan hasil dari model dengan hanya pengkode visi ConvNeXt dan CLIP, dibandingkan dengan hasil Eagle-X5. Dengan set lengkap pengkode visi, model berhasil memperbaiki kesalahan, menunjukkan bahwa bahkan ketika dilengkapi dengan pengkode visi resolusi tinggi yang telah dilatih sebelumnya pada penyelarasan visi-bahasa, kemampuan Eagle ditingkatkan dengan mengintegrasikan ahli visi tambahan yang telah dilatih sebelumnya pada tugas visi yang beragam.

Evaluasi Benchmark Multimodal

Eagle dievaluasi pada tujuh benchmark untuk MLLMs untuk menunjukkan kemampuannya dari berbagai perspektif, termasuk MME, MMBench, SEED, MathVista, MMMU, ScienceQA, dan POPE. Secara khusus, MME, MMBench, dan SEED menilai kinerja keseluruhan pada berbagai tugas dunia nyata yang melibatkan penalaran, pengenalan, pengetahuan, dan OCR. MMMU berfokus pada masalah yang menantang dari domain yang beragam yang memerlukan pengetahuan tingkat perguruan tinggi. POPE mengevaluasi halusinasi visual MLLMs. Metrik yang digunakan dalam evaluasi ini sesuai dengan pengaturan default dari benchmark ini. Eagle melaporkan skor persepsi untuk MME, en_dev split untuk MMBench, image split dari SEED, test-mini split dari MathVista, val split dari MMMU, skor F1 dari POPE, dan skor gambar untuk ScienceQA, memastikan keselarasan dengan skor yang dilaporkan dari model lain.

Pemikiran Akhir

Dalam artikel ini, kita telah membahas tentang Eagle, analisis mendalam tentang ruang desain untuk mengintegrasikan pengkode visi ke dalam model bahasa besar multimodal. Tidak seperti karya sebelumnya yang berfokus pada merancang paradigma fusi baru, Eagle menemukan bahwa pilihan desain sistematis sangat penting dan menemukan serangkaian teknik yang berguna. Langkah demi langkah, Eagle mengoptimalkan resep pelatihan pengkode visi individu, mengidentifikasi metode fusi yang dapat diperluas dan efisien, dan secara bertahap menggabungkan pengkode visi dengan pengetahuan domain yang berbeda. Hasilnya menyoroti pentingnya pertimbangan ruang desain dasar.