Sudut Anderson

Perjuangan AI untuk Membaca Jam Analog Mungkin Memiliki Signifikansi yang Lebih Dalam

Sebuah makalah baru dari peneliti di Cina dan Spanyol menemukan bahwa bahkan model AI multimodal yang canggih seperti GPT-4.1 mengalami kesulitan untuk mengetahui waktu dari gambar jam analog. Perubahan visual kecil pada jam dapat menyebabkan kesalahan interpretasi yang besar, dan fine-tuning hanya membantu dengan contoh yang familiar. Hasil ini menimbulkan kekhawatiran tentang keandalan model ini ketika dihadapkan pada gambar yang tidak familiar dalam tugas dunia nyata.

Ketika manusia mengembangkan pemahaman yang cukup dalam tentang sebuah domain, seperti gravitasi atau prinsip fisik dasar lainnya, kita melampaui contoh spesifik untuk memahami abstraksi yang mendasarinya. Ini memungkinkan kita untuk menerapkan pengetahuan itu secara kreatif di berbagai konteks dan untuk mengenali instance baru, bahkan yang belum pernah kita lihat sebelumnya, dengan mengidentifikasi prinsip yang sedang beraksi.

Ketika sebuah domain membawa cukup banyak kepentingan, kita mungkin bahkan mulai memahaminya di mana itu tidak ada, seperti pada pareidolia, yang dipicu oleh biaya tinggi untuk tidak mengenali instance yang sebenarnya. Jadi, pola pengenalan kelangsungan hidup yang kuat ini bahkan membuat kita menemukan pola yang lebih luas di mana tidak ada.

Semakin awal dan lebih berulang sebuah domain ditanamkan dalam diri kita, semakin dalam landasannya dan persistensinya seumur hidup; dan salah satu dataset visual awal yang kita hadapi sebagai anak-anak datang dalam bentuk jam pengajaran, di mana bahan cetak atau jam analog interaktif digunakan untuk mengajar kita cara membaca waktu:

Alat bantu untuk membantu anak-anak belajar membaca waktu. Sumber: https://www.youtube.com/watch?v=IBBQXBhSNUs

Meskipun perubahan mode dalam desain jam mungkin terkadang menantang kita, ketahanan penguasaan domain awal ini cukup mengesankan, memungkinkan kita untuk membedakan wajah jam analog bahkan di hadapan pilihan desain yang kompleks atau ‘eksenrik’:

Beberapa wajah menantang dalam desain jam. Sumber: https://www.ablogtowatch.com/wait-a-minute-legibility-is-the-most-important-part-of-watch-design/

Manusia tidak perlu ribuan contoh untuk belajar bagaimana jam bekerja; sekali konsep dasar dipahami, kita dapat mengenaliinya dalam hampir semua bentuk, bahkan ketika terdistorsi atau diabstraksikan.

Kesulitan yang dihadapi model AI dengan tugas ini, di sisi lain, menyoroti masalah yang lebih dalam: kekuatan yang tampaknya mungkin bergantung lebih pada eksposur volume tinggi daripada pemahaman.

Di Luar Permainan Imitasi?

Ketegangan antara kinerja tingkat permukaan dan pemahaman yang sebenarnya telah muncul berulang kali dalam investigasi model besar baru-baru ini. Bulan lalu Zhejiang University dan Westlake University mengajukan kembali pertanyaan dalam makalah berjudul Apakah Model LLM Tingkat PhD Benar-Benar Memahami Penambahan Elementer? (bukan fokus artikel ini), menyimpulkan:

‘Meskipun benchmark yang mengesankan, model menunjukkan ketergantungan kritis pada pencocokan pola daripada pemahaman yang sebenarnya, seperti yang dibuktikan oleh kegagalan dengan representasi simbolis dan pelanggaran sifat dasar.

‘Pemberian aturan eksplisit yang merusak kinerja menunjukkan adanya keterbatasan arsitektur bawaan. Wawasan ini mengungkapkan kesenjangan evaluasi dan menyoroti kebutuhan akan arsitektur yang mampu melakukan penalaran matematika yang sebenarnya di luar pengenalan pola.’

Pertanyaan ini muncul kembali, sekarang dalam kolaborasi antara Nanjing University of Aeronautics and Astronautics dan Universidad Politécnica de Madrid di Spanyol. Berjudul Apakah Multimodal Large Language Models (MLLMs) Benar-Benar Belajar Membaca Waktu pada Jam Analog?, makalah baru ini mengeksplorasi seberapa baik model multimodal memahami membaca waktu.

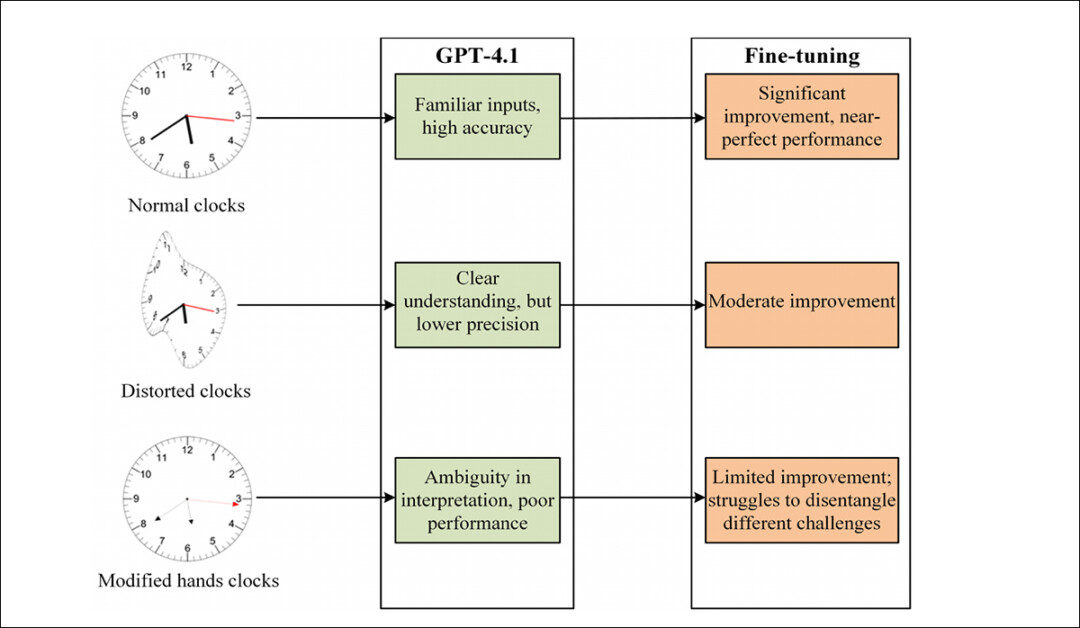

Meskipun kemajuan penelitian hanya diliput secara singkat dalam makalah, tes awal peneliti menetapkan bahwa model bahasa multimodal OpenAI GPT-4.1 mengalami kesulitan untuk membaca waktu dari berbagai gambar jam, sering memberikan jawaban yang salah bahkan pada kasus sederhana.

Ini menunjukkan kemungkinan kesenjangan dalam data pelatihan model, menimbulkan kebutuhan akan dataset yang lebih seimbang, untuk menguji apakah model benar-benar dapat mempelajari konsep yang mendasarinya. Oleh karena itu, penulis membuat dataset sintetis jam analog, yang secara merata mencakup setiap waktu yang mungkin, dan menghindari bias yang biasa ditemukan dalam gambar internet:

Contoh dari dataset jam analog sintetis peneliti, digunakan untuk fine-tuning model GPT dalam karya baru. Sumber: https://huggingface.co/datasets/migonsa/analog_watches_finetune

Sebelum fine-tuning pada dataset baru, GPT-4.1 secara konsisten gagal membaca jam-jam ini. Setelah beberapa eksposur pada koleksi baru, kinerjanya membaik – tetapi hanya ketika gambar-gambar baru terlihat seperti yang sudah dilihatnya.

Ketika bentuk jam atau gaya tangan berubah, akurasi turun tajam; bahkan perubahan kecil, seperti tangan yang lebih tipis atau ujung panah (gambar paling kanan di bawah), cukup untuk melemparkannya; dan GPT-4.1 juga bergumul untuk menafsirkan jam ‘meleleh’ à la Dali:

Gambar jam dengan desain standar (kiri), bentuk yang terdistorsi (tengah), dan tangan yang dimodifikasi (kanan), bersama dengan waktu yang dikembalikan oleh GPT-4.1 sebelum dan setelah fine-tuning. Sumber: https://arxiv.org/pdf/2505.10862

Penulis menyimpulkan bahwa model seperti GPT-4.1 mungkin mempelajari membaca jam terutama melalui pencocokan pola visual, bukan konsep yang lebih dalam tentang waktu, dengan menyatakan:

‘[GPT 4.1] gagal ketika jam terdeformasi atau ketika tangan diubah menjadi lebih tipis dan memiliki ujung panah. Mean Absolute Error (MAE) dalam estimasi waktu selama 150 waktu acak adalah 232,48s untuk jam awal, 1380,69s ketika bentuk terdeformasi dan 3726,93s ketika tangan diubah.

‘Hasil ini menunjukkan bahwa MLLM tidak belajar membaca waktu tetapi lebih mempelajari pola.’

Cukup Waktu

Sebagian besar dataset pelatihan bergantung pada gambar web yang dikumpulkan, yang cenderung mengulangi waktu tertentu – terutama 10:10, pengaturan populer dalam iklan jam:

Dari makalah baru, contoh prevalensi waktu ‘sepuluh lewat sepuluh’ pada gambar jam analog.

Akibatnya, model mungkin hanya melihat rentang waktu yang terbatas yang digambarkan, membatasi kemampuannya untuk menggeneralisasi di luar pola yang berulang.

Mengenai mengapa model gagal menafsirkan jam yang terdistorsi, makalah menyatakan:

‘Meskipun GPT-4.1 berkinerja sangat baik dengan gambar jam standar, mengejutkan bahwa memodifikasi tangan jam dengan membuatnya lebih tipis dan menambahkan ujung panah menyebabkan penurunan akurasi yang signifikan.

‘Intuitif, seseorang mungkin berharap bahwa perubahan visual yang lebih kompleks – dial yang terdistorsi – akan memiliki dampak yang lebih besar pada kinerja, namun modifikasi ini tampaknya memiliki efek yang relatif lebih kecil.

‘Hal ini menimbulkan pertanyaan: bagaimana MLLM menafsirkan jam, dan mengapa mereka gagal? Salah satu kemungkinan adalah bahwa tangan yang lebih tipis mengganggu kemampuan model untuk memahami arah, melemahkan pemahaman tentang orientasi spasial.

‘Atau, ada faktor lain yang menyebabkan kebingungan ketika model mencoba menggabungkan tangan jam, menit, dan detik menjadi pembacaan waktu yang akurat.’

Penulis berpendapat bahwa mengidentifikasi penyebab akar kegagalan ini adalah kunci untuk memajukan model multimodal: jika masalahnya terletak pada bagaimana model memahami arah spasial, fine-tuning mungkin menawarkan solusi sederhana; tetapi jika masalahnya berasal dari kesulitan yang lebih mendasar dalam mengintegrasikan berbagai petunjuk visual, itu menunjukkan kelemahan yang lebih fundamental dalam cara sistem ini memproses informasi.

Tes Fine-Tuning

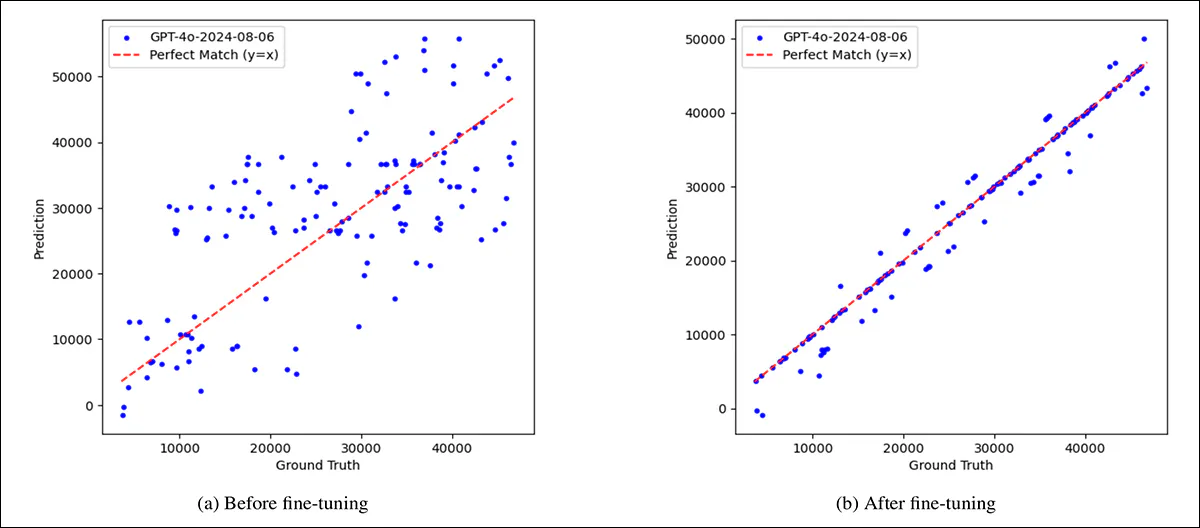

Untuk menguji apakah kegagalan model dapat diatasi dengan eksposur, GPT-4.1 difine-tuning pada dataset sintetis yang disebutkan sebelumnya. Sebelum fine-tuning, prediksi model tersebar luas, dengan kesalahan yang signifikan di semua jenis jam. Setelah fine-tuning pada koleksi, akurasi membaik secara tajam pada wajah jam standar, dan, sampai batas tertentu, pada jam yang terdistorsi.

Namun, jam dengan tangan yang dimodifikasi, seperti bentuk yang lebih tipis atau ujung panah, terus menghasilkan kesalahan yang besar.

Dua mode kegagalan yang berbeda muncul: pada jam normal dan terdistorsi, model biasanya salah menilai arah tangan; tetapi pada jam dengan tangan yang diubah, model sering membingungkan fungsi masing-masing tangan, mengira tangan jam untuk tangan menit atau tangan menit untuk tangan detik.

Perbandingan yang menggambarkan kelemahan awal model, dan keuntungan sebagian yang diperoleh melalui fine-tuning, menunjukkan waktu yang diprediksi versus waktu sebenarnya, dalam detik, untuk 150 jam acak.

Hal ini menunjukkan bahwa model telah belajar untuk mengasosiasikan fitur visual seperti ketebalan tangan dengan peran tertentu, dan bergumul ketika petunjuk ini berubah.

Peningkatan terbatas pada desain yang tidak familiar menimbulkan keraguan lebih lanjut tentang apakah model jenis ini mempelajari konsep abstrak membaca waktu, atau hanya memperbaiki pencocokan pola.

Tanda Tangan

Jadi, meskipun fine-tuning memperbaiki kinerja GPT-4.1 pada jam analog standar, itu memiliki dampak yang jauh lebih kecil pada jam dengan tangan yang lebih tipis atau bentuk ujung panah, menimbulkan kemungkinan bahwa kegagalan model berasal dari kebingungan tentang tangan mana yang mana.

Untuk menguji apakah akurasi mungkin membaik jika kebingungan ini dihilangkan, analisis baru dilakukan pada prediksi model untuk dataset ‘tangan yang dimodifikasi’. Keluaran dibagi menjadi dua kelompok: kasus di mana GPT-4.1 mengenali tangan jam, menit, dan detik dengan benar; dan kasus di mana tidak.

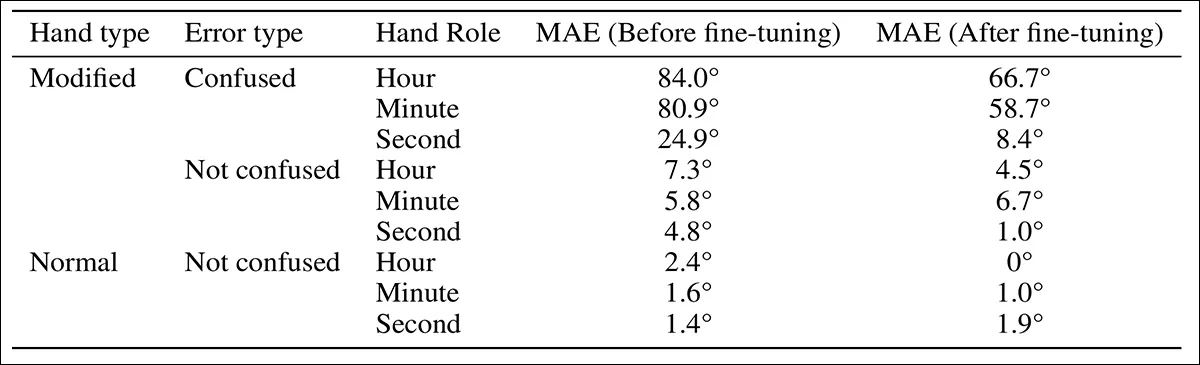

Prediksi dievaluasi untuk Mean Absolute Error (MAE) sebelum dan setelah fine-tuning, dan hasilnya dibandingkan dengan yang dari jam standar; kesalahan sudut juga diukur untuk setiap tangan menggunakan posisi dial sebagai baseline:

Perbandingan kesalahan untuk jam dengan dan tanpa kebingungan peran tangan dalam dataset tangan yang dimodifikasi sebelum dan setelah fine-tuning.

Kebingungan tentang peran tangan jam menyebabkan kesalahan terbesar. Ketika GPT-4.1 mengira tangan jam untuk tangan menit atau sebaliknya, estimasi waktu yang dihasilkan sering sangat jauh dari benar. Sebaliknya, kesalahan yang disebabkan oleh penilaian arah tangan yang salah identifikasi lebih kecil. Di antara ketiga tangan, tangan jam menunjukkan kesalahan sudut tertinggi sebelum fine-tuning, sementara tangan detik menunjukkan yang terendah.

Kesalahan sudut per jenis tangan untuk prediksi dengan dan tanpa kebingungan peran tangan, sebelum dan setelah fine-tuning, dalam dataset tangan yang dimodifikasi.

Untuk fokus pada kesalahan arah saja, analisis dibatasi pada kasus di mana model mengenali fungsi masing-masing tangan dengan benar. Jika model telah memahami konsep membaca waktu yang umum, kinerjanya pada contoh-contoh ini seharusnya sesuai dengan akurasi pada jam standar. Tidak, dan akurasi tetap jauh lebih buruk.

Untuk memeriksa apakah bentuk tangan mengganggu pemahaman model tentang arah, eksperimen kedua dijalankan: dua dataset baru dibuat, masing-masing berisi enam puluh jam sintetis dengan hanya satu tangan jam, menunjuk ke tanda menit yang berbeda. Satu set menggunakan desain tangan asli, dan yang lain menggunakan versi yang diubah. Model diminta untuk menamai tanda yang ditunjuk oleh tangan.

Hasil menunjukkan penurunan akurasi yang kecil dengan tangan yang dimodifikasi, tetapi tidak cukup untuk menjelaskan kegagalan model yang lebih luas. Fitur visual tunggal yang tidak familiar tampaknya mampu mengganggu interpretasi model yang lebih luas, bahkan dalam tugas yang telah dilakukan dengan baik sebelumnya.

Ikhtisar kinerja GPT-4.1 sebelum dan setelah fine-tuning di seluruh jam standar, terdistorsi, dan tangan yang dimodifikasi, menyoroti keuntungan yang tidak merata dan kelemahan yang berkelanjutan.

Kesimpulan

Meskipun fokus makalah ini mungkin tampak sepele pada pandangan pertama, itu tidak terlalu penting jika model bahasa visi pernah belajar membaca jam analog dengan akurasi 100%. Apa yang memberi karya ini bobot adalah fokusnya pada pertanyaan yang berulang: apakah menjenuhkan model dengan lebih (dan lebih beragam) data dapat mengarah pada pemahaman domain yang diperoleh manusia melalui abstraksi dan generalisasi; atau apakah satu-satunya jalur yang layak adalah membanjiri domain dengan contoh yang cukup untuk memprediksi setiap variasi yang mungkin pada inferensi.

Setiap jalur menimbulkan keraguan tentang apa yang arsitektur saat ini benar-benar dapat pelajari.

Dipublikasikan pertama kali pada hari Senin, 19 Mei 2025